(整理)BP神经网络工具箱.

BP神经网络的应用

基于MATLAB的BP神经网络应用人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

神经网络具有非线性自适应的信息处理能力,克服了传统人工智能方法对于直觉的缺陷,因而在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用。

神经网络与其他传统方法相组合,将推动人工智能和信息处理技术不断发展。

近年来,神经网络在模拟人类认知的道路上更加深入发展,并与模糊系统、遗传算法、进化机制等组合,形成计算智能,成为人工智能的一个重要方向。

MATLAB是一种科学与工程计算的高级语言,广泛地运用于包括信号与图像处理,控制系统设计,系统仿真等诸多领域。

为了解决神经网络问题中的研究工作量和编程计算工作量问题,目前工程领域中较为流行的软件MATLAB,提供了现成的神经网络工具箱(Neural Network Toolbox,简称NNbox),为解决这个矛盾提供了便利条件。

神经网络工具箱提供了很多经典的学习算法,使用它能够快速实现对实际问题的建模求解。

在解决实际问题中,应用MATLAB 语言构造典型神经网络的激活传递函数,编写各种网络设计与训练的子程序,网络的设计者可以根据需要调用工具箱中有关神经网络的设计训练程序,使自己能够从烦琐的编程中解脱出来,减轻工程人员的负担,从而提高工作效率。

一、人工神经网络的研究背景和意义人工神经网络是由具有适应性的简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应。

BP神经网络原理及其MATLAB应用

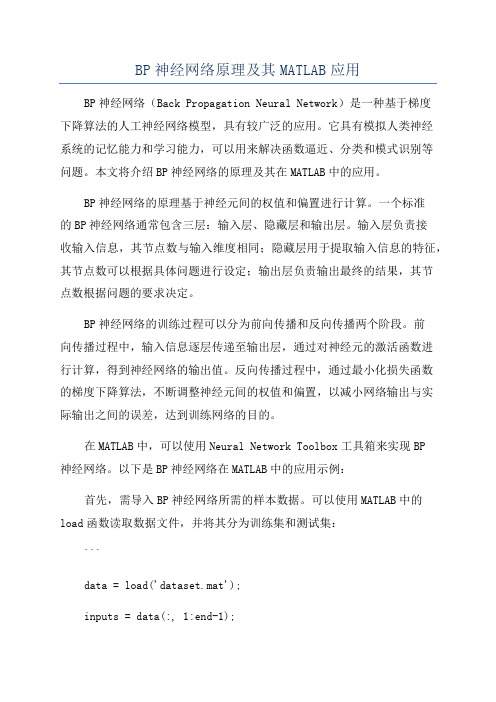

BP神经网络原理及其MATLAB应用BP神经网络(Back Propagation Neural Network)是一种基于梯度下降算法的人工神经网络模型,具有较广泛的应用。

它具有模拟人类神经系统的记忆能力和学习能力,可以用来解决函数逼近、分类和模式识别等问题。

本文将介绍BP神经网络的原理及其在MATLAB中的应用。

BP神经网络的原理基于神经元间的权值和偏置进行计算。

一个标准的BP神经网络通常包含三层:输入层、隐藏层和输出层。

输入层负责接收输入信息,其节点数与输入维度相同;隐藏层用于提取输入信息的特征,其节点数可以根据具体问题进行设定;输出层负责输出最终的结果,其节点数根据问题的要求决定。

BP神经网络的训练过程可以分为前向传播和反向传播两个阶段。

前向传播过程中,输入信息逐层传递至输出层,通过对神经元的激活函数进行计算,得到神经网络的输出值。

反向传播过程中,通过最小化损失函数的梯度下降算法,不断调整神经元间的权值和偏置,以减小网络输出与实际输出之间的误差,达到训练网络的目的。

在MATLAB中,可以使用Neural Network Toolbox工具箱来实现BP神经网络。

以下是BP神经网络在MATLAB中的应用示例:首先,需导入BP神经网络所需的样本数据。

可以使用MATLAB中的load函数读取数据文件,并将其分为训练集和测试集:```data = load('dataset.mat');inputs = data(:, 1:end-1);targets = data(:, end);[trainInd, valInd, testInd] = dividerand(size(inputs, 1), 0.6, 0.2, 0.2);trainInputs = inputs(trainInd, :);trainTargets = targets(trainInd, :);valInputs = inputs(valInd, :);valTargets = targets(valInd, :);testInputs = inputs(testInd, :);testTargets = targets(testInd, :);```接下来,可以使用MATLAB的feedforwardnet函数构建BP神经网络模型,并进行网络训练和测试:```hiddenLayerSize = 10;net = feedforwardnet(hiddenLayerSize);net = train(net, trainInputs', trainTargets');outputs = net(testInputs');```最后,可以使用MATLAB提供的performance函数计算网络的性能指标,如均方误差、相关系数等:```performance = perform(net, testTargets', outputs);```通过逐步调整网络模型的参数和拓扑结构,如隐藏层节点数、学习率等,可以进一步优化BP神经网络的性能。

matlab神经网络工具箱简介和函数及示例

目前,神经网络工具箱中提供的神经网络模型主 要应用于:

函数逼近和模型拟合 信息处理和预测 神经网络控制 故障诊断

神经网络实现的具体操作过程:

• 确定信息表达方式; • 网络模型的确定; • 网络参数的选择; • 训练模式的确定; • 网络测试

• 确定信息表达方式:

将领域问题抽象为适合于网络求解所能接受的 某种数据形式。

函数类型 输入函数

其它

函数名 称

netsum netprcd concur dotprod

函数用途

输入求和函数 输入求积函数 使权值向量和阈值向量的结构一致 权值求积函数

BP网络的神经网络工具箱函数

函数类型

函数名称 函数用途

前向网络创建 函数

传递函数

学习函数

函数类型 性能函数 显示函数

函数名 函数用途 称

三、BP网络学习函数

learngd 该函数为梯度下降权值/阈值学习函数,通过神经 元的输入和误差,以及权值和阈值的学习速率, 来计算权值或阈值的变化率。

调用格式; [dW,ls]=learngd(W,P,Z,N,A,T,E,gW,gA,D,LP,LS)

二、神经元上的传递函数

传递函数是BP网络的重要组成部分,必须是连续可 微的,BP网络常采用S型的对数或正切函数和线性函数。

• Logsig 传递函数为S型的对数函数。 调用格式为: • A=logsig(N)

N:Q个S维的输入列向量; A:函数返回值,位于区间(0,1) 中

② info=logsig(code)

问题形式的种类:

数据样本已知; 数据样本之间相互关系不明确; 输入/输出模式为连续的或者离散的; 输入数据按照模式进行分类,模式可能会 具有平移、旋转或者伸缩等变化形式; 数据样本的预处理; 将数据样本分为训练样本和测试样本

第2章MATLAB神经网络工具箱函数

表2-1 神经网络的通用函数和功能

函数名

功能

init( )

初始化一个神经网络

initlay( ) 层-层结构神经网络的初始化函数

initwb( ) 神经网络某一层的权值和偏值初始化函数

initzero( ) 将权值设置为零的初始化函数

train( )

神经网络训练函数

adapt( )

神经网络自适应训练函数

b=[0;-1];q=3;

%权值向量和一致化所需要的长度

Z=concur(b,q)

%计算一致化了的矩阵

X1=netsum(Z1,Z2),X2=netprod(Z1,Z2) %计算向量的和与积

结果显示:

Z= 0 0 0

-1 -1 -1

X1 = 0 4 6

-2 -2 2

X2 = -1 4 8

-15 -24 1

11

7. 权值点积函数dotprod( ) 网络输入向量与权值的点积可得到加权输入。函数

dotprod ( )的调用格式为: Z=dotprod (W,X)

式中,W为SR维的权值矩阵;X为Q组R维的输入向量; Z为Q组S维的W与X 的点积。 8. 网络输入的和函数netsum( )

网络输入的和函数是通过某一层的加权输入和偏值相 加作为该层的输入。调用格式:

第2章 MATLAB神经网络 工具箱函数

2.1 MATLAB神经网络工具箱函数 2.2 MATLAB神经网络工具箱的图形用户界面

1

利用神经网络能解决许多用传统方法无法解 决的问题。神经网络在很多领域中都有应用,以 实现各种复杂的功能。这些领域包括商业及经济 估算、自动检测和监视、计算机视觉、语音处理、 机器人及自动控制、优化问题、航空航天、银行 金融业、工业生产等。而神经网络是一门发展很 快的学科,其应用领域也会随着其发展有更大的 拓宽。

BP神经网络PPT全文

输出层与隐含层的激活函数可以不同,并且输出层

各单元的激活函数可有所区别

2024/8/16

26

2 多层网络的表达能力

按照Kolmogorov定理,任何一个判决均可用 前式所示的三层神经网络实现。

即: 只要给定足够数量的隐含层单元、适 当的非线性函数、以及权值, 任何由输入向输 出的连续映射函数均可用一个三层前馈神经网络 实现。

神经网络的计算通过网络结构实现;

不同网络结构可以体现各种不同的功能;

网络结构的参数是通过学习逐渐修正的。

2024/8/16

7

(1)基本的人工神经元模型

McCulloch-Pitts神经元模型

输入信号;链接强度与权向量;

信号累积

2024/8/16

激活与抑制

8

人工神经元模型的三要素 :

一组连接 一个加法器 一个激励函数

➢ 树突(dendrites), 接收来自外接的信息 ➢ 细胞体(cell body), 神经细胞主体,信息加工 ➢ 轴突(axon), 细胞的输出装置,将信号向外传递,

与多个神经元连接 ➢突触 (synapsse), 神经元经突触向其它神经元(胞体 或树突)传递信号

2024/8/16

5

(2)生物神经元的基本特征

5 假定:第l层为当前处理层;

其前一层l 1、当前层l、后一层l 1的计算单元序号为i, j,k;

位于当前层第j个计算单元的输出为Olj,j 1,..., nl

前层第i个单元到本层第j个单元的连接权值为ilj , i 1,..., nl1

本层第j个单元到后层第k个单元的连接权值为

l 1 jk

,

连接权值,突触连接强度

Matlab神经网络工具箱介绍ppt课件

自然语言处理

利用神经网络实现文本分类、机器翻译等功 能。

计算机视觉

通过神经网络提高图像识别、目标检测等任 务的准确率。

语音识别

利用神经网络实现更高效和准确的语音转文 字和语音合成。

控制与决策

在机器人、自动驾驶等领域,神经网络能够 提高系统的智能水平和决策能力。

THANKS.

MATLAB神经网络工具箱特点

易于使用 高度可定制 强大的可视化功能 广泛的集成

MATLAB神经网络工具箱提供了直观的图形用户界面,使得用 户可以轻松地创建、训练和测试神经网络模型。

用户可以根据需要自定义神经网络的架构、训练参数和性能指 标。

该工具箱支持数据可视化,使得用户可以更好地理解数据和神 经网络的性能。

初始化网络权重

随机初始化神经网络的权 重和偏置项。

训练神经网络

前向传播

根据输入数据计算输出结果, 计算误差。

反向传播

根据误差调整权重和偏置项, 更新网络参数。

选择优化算法

选择适合的优化算法,如梯度 下降、牛顿法等。

设置训练参数

设置训练轮数、学习率等参数 ,控制训练过程。

测试神经网络

01

测试数据集

混合模型

结合多种神经网络结构和 算法,实现更高效和准确 的预测。

MATLAB神经网络工具箱未来发展方向

集成更多算法

不断集成最新的神经网络算法,满足不同领域 的需求。

优化工具箱性能

提高工具箱的运行速度和稳定性,降低使用门 槛。

增强可视化功能

提供更丰富的可视化工具,帮助用户更好地理解和分析神经网络。

神经网络在人工智能领域的应用前景

MATLAB神经网络

02

工具箱

神经网络作业

BP神经网络及MATLAB实现实验报告姓名:李英杰学号:123109302专业:机械电子工程2013年6月19日1. BP网络的MATLAB设计MatlabR2012 神经网络工具箱(Neural Network toolbox) 为用户提供了丰富的神经网络设计与分析函数,可是用它们来编程不容易掌握。

我们通过对神经网络工具箱的实践应用研究表明,使用神经网络工具箱中的NNTool对神经网络进行设计和仿真简便易行直观,不需要编程,且设计和仿真的结果证明完全能够满足一般工程设计人员的需要,能够取得事半功倍的效果。

下面我们以一个单隐含层的BP网络设计为例,介绍利用神经网络工具箱中的NNTool对BP网络的设计和分析。

利用NNTool设计一个BP 网络,该网络的输入层和输出层的神经元个数均为1。

训练样本定义如下:输入变量为p =[-1 1 3 1;-1 1 5 -3]目标变量为 t = [-1 2 4 3]打开Matlab 应用软件后,双击Neural Network toolbox 中的NNTool 图标,或在命令窗口键入nntool,即可进入神经络设计主界面,如下图。

图1 NNTool 设计主界面1.训练样本数据的导入点击New按钮,在弹出窗口选择Date选项卡,按如图2,3所示创建输入变量和目标变量。

图2 创建新的输入变量图3 创建新的目标变量2.神经网络的创建点击主界面中点击New按钮,在弹出窗口选择Newwork选项卡,并在对话框中可对网络的名称、类型、结构和训练函数等进行设置,如图4 所示。

图4创建神经元网络界面在上面窗口中对该网络命名为:tracylee;网络类型为:Feed-forward backprop,即前馈BP神经网络;Input ranges :点击Get From Input下拉框选择样本输入变量p加入输入向量;Training function:在下拉列表中选择TRAINGDM训练函数;采用动量梯度下降算法训练 BP 网络。

(整理)MATLAB神经网络工具箱函数.

MATLAB 神经网络工具箱函数说明:本文档中所列出的函数适用于MATLAB5.3 以上版本,为了简明起见,只列出了函数名,若需要进一步的说明,请参阅MATLAB 的帮助文档。

1. 网络创建函数newp 创建感知器网络newlind 设计一线性层newlin 创建一线性层newff 创建一前馈BP 网络newcf 创建一多层前馈BP 网络newfftd 创建一前馈输入延迟BP 网络newrb 设计一径向基网络newrbe 设计一严格的径向基网络newgrnn 设计一广义回归神经网络newpnn 设计一概率神经网络newc 创建一竞争层newsom 创建一自组织特征映射newhop 创建一Hopfield 递归网络newelm 创建一Elman 递归网络2. 网络应用函数sim 仿真一个神经网络init 初始化一个神经网络adapt 神经网络的自适应化train 训练一个神经网络3. 权函数dotprod 权函数的点积ddotprod 权函数点积的导数dist Euclidean 距离权函数normprod 规范点积权函数negdist Negative 距离权函数mandist Manhattan 距离权函数linkdist Link 距离权函数4. 网络输入函数netsum 网络输入函数的求和dnetsum 网络输入函数求和的导数5. 传递函数hardlim 硬限幅传递函数hardlims 对称硬限幅传递函数purelin 线性传递函数tansig 正切S 型传递函数logsig 对数S 型传递函数dpurelin 线性传递函数的导数dtansig 正切S 型传递函数的导数dlogsig 对数S 型传递函数的导数compet 竞争传递函数radbas 径向基传递函数satlins 对称饱和线性传递函数6. 初始化函数initlay 层与层之间的网络初始化函数initwb 阈值与权值的初始化函数initzero 零权/阈值的初始化函数initnw Nguyen_Widrow 层的初始化函数initcon Conscience 阈值的初始化函数midpoint 中点权值初始化函数7. 性能分析函数mae 均值绝对误差性能分析函数mse 均方差性能分析函数msereg 均方差w/reg 性能分析函数dmse 均方差性能分析函数的导数dmsereg 均方差w/reg 性能分析函数的导数8. 学习函数learnp 感知器学习函数learnpn 标准感知器学习函数learnwh Widrow_Hoff 学习规则learngd BP 学习规则learngdm 带动量项的BP 学习规则learnk Kohonen 权学习函数learncon Conscience 阈值学习函数learnsom 自组织映射权学习函数9. 自适应函数adaptwb 网络权与阈值的自适应函数10. 训练函数trainwb 网络权与阈值的训练函数traingd 梯度下降的BP 算法训练函数traingdm 梯度下降w/动量的BP 算法训练函数traingda 梯度下降w/自适应lr 的BP 算法训练函数traingdx 梯度下降w/动量和自适应lr 的BP 算法训练函数trainlm Levenberg_Marquardt 的BP 算法训练函数trainwbl 每个训练周期用一个权值矢量或偏差矢量的训练函数11. 分析函数maxlinlr 线性学习层的最大学习率errsurf 误差曲面12. 绘图函数plotes 绘制误差曲面plotep 绘制权和阈值在误差曲面上的位置plotsom 绘制自组织映射图13. 符号变换函数ind2vec 转换下标成为矢量vec2ind 转换矢量成为下标矢量14. 拓扑函数gridtop 网络层拓扑函数hextop 六角层拓扑函数randtop 随机层拓扑函数。

Matlab中的神经网络工具箱介绍与使用

Matlab中的神经网络工具箱介绍与使用神经网络是一种模拟人脑思维方式的计算模型,它通过由多个神经元组成的网络,学习数据的特征和规律。

在计算机科学领域,神经网络被广泛应用于模式识别、数据挖掘、图像处理等诸多领域。

Matlab作为一种功能强大的科学计算软件,提供了专门用于神经网络设计和实现的工具箱。

本文将介绍Matlab中的神经网络工具箱,并探讨其使用方法。

一、神经网络工具箱的概述Matlab中的神经网络工具箱(Neural Network Toolbox)是一款用于构建和训练神经网络的软件包。

它提供了丰富的函数和工具,可用于创建不同类型的神经网络结构,如前向神经网络、反向传播神经网络、径向基函数神经网络等。

神经网络工具箱还包括了各种训练算法和性能函数,帮助用户对神经网络进行优化和评估。

二、神经网络的构建与训练在使用神经网络工具箱前,我们需要先了解神经网络的基本结构和原理。

神经网络由输入层、隐藏层和输出层组成,每一层都包含多个神经元。

输入层接受外部输入数据,通过权重和偏置项传递给隐藏层,最终输出到输出层,形成网络的输出结果。

构建神经网络的第一步是定义网络的结构,可以使用神经网络工具箱中的函数创建不同层和神经元的结构。

例如,使用feedforwardnet函数可以创建一个前向神经网络,输入参数指定了每个隐藏层的神经元数量。

然后,可以使用train函数对神经网络进行训练。

train函数可以选择不同的训练算法,如标准反向传播算法、Levenberg-Marquardt算法等。

通过设置训练参数,例如训练迭代次数和学习速率等,可以对网络进行优化。

三、神经网络的应用案例神经网络在许多领域都有广泛的应用,下面以图像分类为例,介绍如何使用神经网络工具箱来训练一个图像分类器。

首先,我们需要准备训练数据和测试数据。

训练数据通常包含一组已经标记好的图像和相应的标签。

为了方便处理,我们可以将图像转化为一维向量,并将标签转化为二进制编码。

matlab神经网络工具箱怎么用

matlab神经网络工具箱怎么用标题:Matlab神经网络工具箱的使用方法导言:Matlab神经网络工具箱是一个功能强大的工具,用于建立、训练和评估各种类型的神经网络。

本文将介绍如何使用Matlab神经网络工具箱进行神经网络的建立、训练和评估,帮助您更好地理解和使用这个工具箱。

一、Matlab神经网络工具箱的安装首先,您需要确保已成功安装了Matlab软件。

然后,您可以通过以下步骤来安装Matlab神经网络工具箱:1. 打开Matlab软件。

2. 在工具栏上选择“工具”菜单。

3. 在下拉菜单中选择“添加预定目录”。

4. 在弹出的窗口中,选择“文件夹”选项。

5. 点击“浏览”按钮,并选择包含神经网络工具箱的文件夹。

6. 点击“选择文件夹”按钮,然后点击“添加文件夹”按钮。

7. 点击“关闭”按钮,完成神经网络工具箱的安装。

二、神经网络的建立Matlab神经网络工具箱提供了多种类型的神经网络模型,如前馈神经网络、递归神经网络和自组织神经网络。

下面我们以前馈神经网络为例,介绍神经网络的建立方法:1. 打开Matlab软件,并在命令窗口中输入“nprtool”命令,打开“神经网络模式选择器”窗口。

2. 在“神经网络模式选择器”窗口中,选择“构建”按钮。

3. 在“神经网络模式选择器”窗口中,选择“前馈神经网络”选项,并点击“下一步”按钮。

4. 在“选择网络架构”窗口中,选择神经网络的层数、神经元数量和输入、输出数据的维度。

5. 点击“下一步”按钮,然后点击“完成”按钮,完成神经网络的建立。

三、神经网络的训练神经网络的训练是指通过将已知的输入和输出数据进行反复迭代调整网络参数,从而使网络能够更好地拟合输入输出之间的关系。

下面我们介绍神经网络的训练方法:1.在命令窗口中输入“trainlm”命令,选择Levenberg-Marquardt算法作为训练函数。

2.输入训练数据和目标数据,通过“trains”命令开始训练神经网络。

神经网络工具箱

神经网络工具箱神经网络工具箱版本6.0.4(R2010a版本)25-JAN-2010图形用户界面的功能。

nctool - 神经网络分类的工具。

nftool - 神经网络拟合工具。

nprtool - 神经网络模式识别工具。

nntool - 神经网络工具箱的图形用户界面。

nntraintool - 神经网络训练工具。

视图- 查看一个神经网络。

分析功能。

混乱- 分类混淆矩阵。

errsurf - 单输入神经元的误差表面。

maxlinlr - 最大的学习率的线性层。

鹏- 受试者工作特征。

距离函数。

boxdist - 箱距离函数。

DIST - 欧氏距离权重函数。

mandist - 曼哈顿距离权重函数。

linkdist - 链路距离函数。

格式化数据。

combvec - 创建载体的所有组合。

con2seq - 转换并行向量连续载体。

同意- 创建并发偏载体。

dividevec - 创建载体的所有组合。

ind2vec - 转换指数为载体。

最小最大- 矩阵行范围。

nncopy - 复印基质或细胞阵列。

normc - 规格化矩阵的列。

normr - 规格化行的矩阵的。

pnormc - 矩阵的伪规格化列。

定量- 值离散化作为数量的倍数。

seq2con - 转换顺序向量并发载体。

vec2ind - 将矢量转换成指数。

初始化网络功能。

initlay - 层- 层网络初始化函数。

初始化层功能。

initnw - 阮层的Widrow初始化函数。

initwb - 从重量和- 偏置层初始化函数。

初始化的重量和偏见的功能。

initcon - 良心的偏见初始化函数。

initzero - 零重量/偏置初始化函数。

initsompc - 初始化SOM的权重与主要成分。

中点- 中点重初始化函数。

randnc - 归一列重初始化函数。

randnr - 归行重初始化函数。

兰特- 对称随机重量/偏置初始化函数。

学习功能。

learncon - 良心的偏见学习功能。

神经网络工具箱nntool的使用方法

神经⽹络⼯具箱nntool的使⽤⽅法神经⽹络⼯具箱nntool的使⽤⽅法关于如何使⽤nntool神经⽹络⼯具箱进⾏“数据训练”的⽅法:1. 在命令窗⼝键⼊nntool命令打开神经⽹络⼯具箱;2. 点击Import按钮两次,分别把输⼊向量和⽬标输出加⼊到对应的窗⼝([Inputs]和[Targets])中,有两种可供选择的加⼊对象(点击Import 后可以看见),⼀种是把当前⼯作区中的某个矩阵加⼊,另⼀种是通过.mat⽂件读⼊;3. 点击[New Network]按钮,填⼊各参数:(以最常⽤的带⼀个隐层的3层神经⽹络为例说明,下⾯没有列出的参数表⽰使⽤默认值就可以了,例如Network Type为默认的BP神经⽹络);1) Input Range――这个通过点击Get From Input下拉框选择你加⼊的输⼊向量便可⾃动完成。

2) Training Function——最好使⽤TRAINSCG,即共轭梯度法,其好处是当训练不收敛时,它会⾃动停⽌训练,⽽且耗时较其他算法(TRAINLM, TRAINGD)少,也就是收敛很快(如果收敛的话),⽽且Train Parameters输⼊不多,也不⽤太多的技巧调整,⼀般指定迭代次数、结果显⽰频率和⽬标误差就可以了(详见下⽂)。

3) Layer 1 Number of Neurons——隐层的神经元个数,这是需要经验慢慢尝试并调整的,⼤致上由输⼊向量的维数、样本的数量和输出层(Layer2)的神经元个数决定。

4) Layer 1 Transfer Function——⼀般⽤TANSIG(当然也可以LOGSIG),即表⽰隐层输出是[-1,1]之间的实数,与LOGSIG相⽐范围更⼤。

5) Layer 2 Number of Neurons——输出层的神经元个数,对于两类问题,个数为1,取值分别为0和1,对于多类问题,个数为10,取值为等。

6) Layer 2 Transfer Function——如果是模式识别的两类(或者多类)问题,⼀般⽤LOGSIG,即表⽰输出层的输出是[0,1]之间的实数。

(完整word版)BP神经网络实验报告

BP 神经网络实验报告一、实验目的1、熟悉MATLAB中神经网络工具箱的使用方法;2、经过在MATLAB下面编程实现BP网络逼近标准正弦函数,来加深对BP网络的认识和认识,理解信号的正向流传和误差的反向传达过程。

二、实验原理由于传统的感知器和线性神经网络有自己无法战胜的弊端,它们都不能够解决线性不能分问题,因此在实质应用过程中碰到了限制。

而BP 网络却拥有优异的繁泛化能力、容错能力以及非线性照射能力。

因此成为应用最为广泛的一种神经网络。

BP 算法的根本思想是把学习过程分为两个阶段:第一阶段是信号的正向流传过程;输入信息经过输入层、隐层逐层办理并计算每个单元的实质输出值;第二阶段是误差的反向传达过程;假设在输入层未能获取希望的输出值,那么逐层递归的计算实质输出和希望输出的差值〔即误差〕,以便依照此差值调治权值。

这种过程不断迭代,最后使得信号误差到达赞同或规定的范围之内。

基于 BP 算法的多层前馈型网络模型的拓扑结构如上图所示。

BP 算法的数学描述:三层BP 前馈网络的数学模型如上图所示。

三层前馈网中,输入向量为: X ( x1 , x2 ,..., x i ,..., x n )T;隐层输入向量为:Y( y1 , y2 ,..., y j ,...y m ) T;输出层输出向量为: O (o1 , o2 ,..., o k ,...o l )T;希望输出向量为:d(d1 ,d 2 ,...d k ,...d l )T。

输入层到隐层之间的权值矩阵用 V 表示,V(v1 , v2 ,...v j ,...v m ) Y,其中列向量v j为隐层第 j 个神经元对应的权向量;隐层到输出层之间的权值矩阵用W 表示,W( w1 , w2 ,...w k ,...w l ) ,其中列向量 w k为输出层第k个神经元对应的权向量。

下面解析各层信号之间的数学关系。

对于输出层,有y j f (net j ), j1,2,..., mnet j v ij x i , j1,2,..., m对于隐层,有O k f (net k ), k1,2,...,lm net k wjkyi, k1,2,...,lj0以上两式中,转移函数 f(x) 均为单极性Sigmoid 函数:1f ( x)x1 ef(x) 拥有连续、可导的特点,且有 f ' (x) f ( x)[1 f ( x)]以上共同构成了三层前馈网了的数学模型。

BP神经网络

BP神经网络在函数逼近中的实现1.1 概述BP神经网络是目前人工神经网络模式中最具代表性,应用得最广泛的一种模型,具有自学习、自组织、自适应和很强的非线性映射能力,可以以任意精度逼近任意连续函数.近年来,为了解决BP网络收敛速度慢,训练时间长等不足,提出了许多改进算法.然而,在针对实际问题的BP网络建模过程中,选择多少层网络,每层多少个神经元节点,选择何种传递函数等,均无可行的理论指导,只能通过大量的实验计算获得.MATLAB中的神经网络工具箱(Neural NetworkToolbox,简称NNbox),为解决这一问题提供了便利的条件.神经网络工具箱功能十分完善,提供了各种MATLAB函数,包括神经网络的建立、训练和仿真等函数,以及各种改进训练算法函数,用户可以很方便地进行神经网络的设计和仿真,也可以在MATLAB源文件的基础上进行适当修改,形成自己的工具包以满足实际需要。

此项课题主要是针对MATLAB软件对BP神经网络的各种算法的编程,将神经网络算法应用于函数逼近和样本含量估计问题中,并分析比较相关参数对算法运行结果的影响。

人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

神经网络具有非线性自适应的信息处理能力,克服了传统人工智能方法对于直觉的缺陷,因而在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用。

Matlab工具箱中的BP与RBF函数要点

Matlab工具箱中的BP与RBF函数Matlab神经网络工具箱中的函数非常丰富,给网络设置合适的属性,可以加快网络的学习速度,缩短网络的学习进程。

限于篇幅,仅对本章所用到的函数进行介绍,其它的函数及其用法请读者参考联机文档和帮助。

1 BP与RBF网络创建函数在Matlab工具箱中有如表1所示的创建网络的函数,作为示例,这里只介绍函数newff、newcf、newrb和newrbe。

表 1 神经网络创建函数(1) newff函数功能:创建一个前馈BP神经网络。

调用格式:net = newff(PR,[S1 S2...S Nl],{TF1 TF2...TF Nl},BTF,BLF,PF) 参数说明:•PR - R个输入的最小、最大值构成的R×2矩阵;•S i–S NI层网络第i层的神经元个数;•TF i - 第i层的传递函数,可以是任意可导函数,默认为'tansig',可设置为logsig,purelin等;•BTF -反向传播网络训练函数,默认为'trainlm',可设置为trainbfg,trainrp,traingd等;•BLF -反向传播权值、阈值学习函数,默认为'learngdm';•PF -功能函数,默认为'mse';(2) newcf函数功能:创建一个N层的层叠(cascade)BP网络调用格式:net = newcf(Pr,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF) 参数同函数newff。

(3) newrb函数功能:创建一个径向基神经网络。

径向基网络可以用来对一个函数进行逼近。

newrb函数用来创建一个径向基网络,它可以是两参数网络,也可以是四参数网络。

在网络的隐层添加神经元,直到网络满足指定的均方误差要求。

调用格式:net = newrb(P,T,GOAL,SPREAD)参数说明:•P:Q个输入向量构成的R×Q矩阵;•T:Q个期望输出向量构成的S×Q矩阵;•GOAL:均方误差要求,默认为0。

(完整版)BP神经网络原理

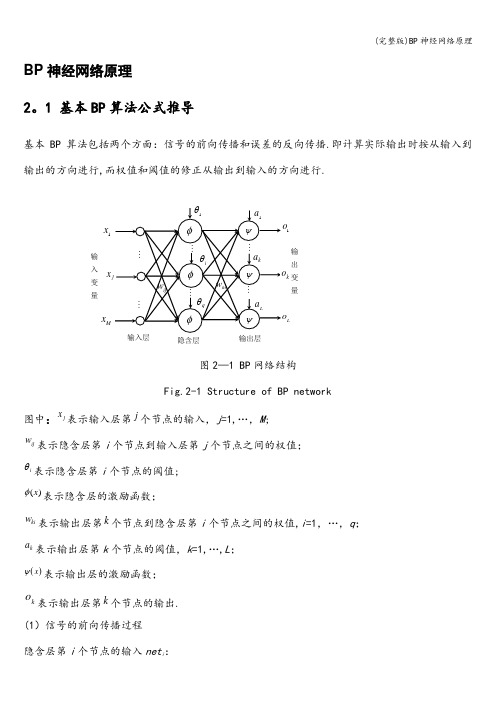

BP 神经网络原理2。

1 基本BP 算法公式推导基本BP 算法包括两个方面:信号的前向传播和误差的反向传播.即计算实际输出时按从输入到输出的方向进行,而权值和阈值的修正从输出到输入的方向进行.图2—1 BP 网络结构Fig.2-1 Structure of BP network图中:jx 表示输入层第j 个节点的输入,j =1,…,M ;ijw 表示隐含层第i 个节点到输入层第j 个节点之间的权值;iθ表示隐含层第i 个节点的阈值;()x φ表示隐含层的激励函数;ki w 表示输出层第k 个节点到隐含层第i 个节点之间的权值,i =1,…,q ;ka 表示输出层第k 个节点的阈值,k =1,…,L ; ()x ψ表示输出层的激励函数;ko 表示输出层第k 个节点的输出.(1)信号的前向传播过程 隐含层第i 个节点的输入net i :1Mi ij j ij net w x θ==+∑ (3—1)隐含层第i 个节点的输出y i :1()()Mi i ij j i j y net w x φφθ===+∑ (3-2)输出层第k 个节点的输入net k :111()qqMk ki i k ki ij j i ki i j net w y a w w x a φθ====+=++∑∑∑ (3—3)输出层第k 个节点的输出o k :111()()()qq M k k ki i k ki ij j i k i i j o net w y a w w x a ψψψφθ===⎛⎫==+=++ ⎪⎝⎭∑∑∑ (3—4)(2)误差的反向传播过程误差的反向传播,即首先由输出层开始逐层计算各层神经元的输出误差,然后根据误差梯度下降法来调节各层的权值和阈值,使修改后的网络的最终输出能接近期望值。

对于每一个样本p 的二次型误差准则函数为E p :211()2Lp k k k E T o ==-∑ (3—5)系统对P 个训练样本的总误差准则函数为:2111()2P Lp p k k p k E T o ===-∑∑ (3—6)根据误差梯度下降法依次修正输出层权值的修正量Δw ki ,输出层阈值的修正量Δa k ,隐含层权值的修正量Δw ij ,隐含层阈值的修正量i θ∆。

MATLAB神经网络工具箱

MATLAB神经网络工具箱与液位控制BP 模型的设计与仿真随着科学技术的发展,在控制领域中被控对象变得越来越复杂,控制系统呈现出复杂的非线性、时变及不确定性的特点,难于精确建模,有的虽然可以建立粗略的模型,但求解困难。

人工神经网络具有一定的自学习、自适应和非线性映射能力及容错性等优点,为解决复杂的非线性、不确定、不确知系统的控制问题开辟了一条新的途径。

其中,BP 网络,即基于误差反向传播算法的多层前馈神经网络,由于它可以以任意精度逼近任意的连续函数,因此被广泛应用于非线性建模、函数逼近、模式分类、智能控制及预测等领域。

MATLAB神经网络工具箱是以神经网络理论作为背景的专业工具箱,本文针对某发电厂液位控制建立BP 预测模型,利用目前工程领域流行的MATLAB 6.1中提供的神经网络工具箱,对网络模型进行训练和仿真,给出优化的BP 模型实现步骤。

MATLAB及其神经网络工具箱MATLAB是由MATHWORKS公司开发的一个高性能的技术计算语言。

它在一个简单易用的交互式环境中集成了计算、可视化和程序设计等强大的功能。

神经网络工具箱是MATLAB中集成的一个重要工具箱,工具箱中提供了面向不同神经网络模型特别是BP网络模型的丰富多彩的网络学习和训练函数,其中包括了BP算法和各种改进BP算法,为神经网络的仿真分析提供了极大的方便,从而使MATLAB成为目前世界上最为流行的神经仿真平台。

用户只要调用工具箱中相关函数并输入参数,就可以完成相应的训练仿真。

在本文液位控制BP模型的设计与仿真研究中,主要用到以下几个函数及其主要参数:1)Newff格式: net = newff(PR,[S1 S2… S nl],{TF1 TF2… TF nl},BTF,BLF,PF)其中net是神经网络名;S i是第i层神经网络的神经元个数,网络共有nl层;TFi 是第i层网络神经元的转移函数,缺省为tansig; BTF是BP训练函数,缺省为trainlm;BLF 是学习函数,缺省为learngdm;PF是性能函数,缺省为mse。

人工智能实验报告-BP神经网络算法的简单实现

⼈⼯智能实验报告-BP神经⽹络算法的简单实现⼈⼯神经⽹络是⼀种模仿⼈脑结构及其功能的信息处理系统,能提⾼⼈们对信息处理的智能化⽔平。

它是⼀门新兴的边缘和交叉学科,它在理论、模型、算法等⽅⾯⽐起以前有了较⼤的发展,但⾄今⽆根本性的突破,还有很多空⽩点需要努⼒探索和研究。

1⼈⼯神经⽹络研究背景神经⽹络的研究包括神经⽹络基本理论、⽹络学习算法、⽹络模型以及⽹络应⽤等⽅⾯。

其中⽐较热门的⼀个课题就是神经⽹络学习算法的研究。

近年来⼰研究出许多与神经⽹络模型相对应的神经⽹络学习算法,这些算法⼤致可以分为三类:有监督学习、⽆监督学习和增强学习。

在理论上和实际应⽤中都⽐较成熟的算法有以下三种:(1) 误差反向传播算法(Back Propagation,简称BP 算法);(2) 模拟退⽕算法;(3) 竞争学习算法。

⽬前为⽌,在训练多层前向神经⽹络的算法中,BP 算法是最有影响的算法之⼀。

但这种算法存在不少缺点,诸如收敛速度⽐较慢,或者只求得了局部极⼩点等等。

因此,近年来,国外许多专家对⽹络算法进⾏深⼊研究,提出了许多改进的⽅法。

主要有:(1) 增加动量法:在⽹络权值的调整公式中增加⼀动量项,该动量项对某⼀时刻的调整起阻尼作⽤。

它可以在误差曲⾯出现骤然起伏时,减⼩振荡的趋势,提⾼⽹络训练速度;(2) ⾃适应调节学习率:在训练中⾃适应地改变学习率,使其该⼤时增⼤,该⼩时减⼩。

使⽤动态学习率,从⽽加快算法的收敛速度;(3) 引⼊陡度因⼦:为了提⾼BP 算法的收敛速度,在权值调整进⼊误差曲⾯的平坦区时,引⼊陡度因⼦,设法压缩神经元的净输⼊,使权值调整脱离平坦区。

此外,很多国内的学者也做了不少有关⽹络算法改进⽅⾯的研究,并把改进的算法运⽤到实际中,取得了⼀定的成果:(1) 王晓敏等提出了⼀种基于改进的差分进化算法,利⽤差分进化算法的全局寻优能⼒,能够快速地得到BP 神经⽹络的权值,提⾼算法的速度;(2) 董国君等提出了⼀种基于随机退⽕机制的竞争层神经⽹络学习算法,该算法将竞争层神经⽹络的串⾏迭代模式改为随机优化模式,通过采⽤退⽕技术避免⽹络收敛到能量函数的局部极⼩点,从⽽得到全局最优值;(3) 赵青提出⼀种分层遗传算法与BP 算法相结合的前馈神经⽹络学习算法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1.神经网络神经网络是单个并行处理元素的集合,我们从生物学神经系统得到启发。

在自然界,网络功能主要由神经节决定,我们可以通过改变连接点的权重来训练神经网络完成特定的功能。

一般的神经网络都是可调节的,或者说可训练的,这样一个特定的输入便可得到要求的输出。

如下图所示。

这里,网络根据输出和目标的比较而调整,直到网络输出和目标匹配。

作为典型,许多输入/目标对应的方法已被用在有监督模式中来训练神经网络。

神经网络已经在各个领域中应用,以实现各种复杂的功能。

这些领域包括:模式识别、鉴定、分类、语音、翻译和控制系统。

如今神经网络能够用来解决常规计算机和人难以解决的问题。

我们主要通过这个工具箱来建立示范的神经网络系统,并应用到工程、金融和其他实际项目中去。

一般普遍使用有监督训练方法,但是也能够通过无监督的训练方法或者直接设计得到其他的神经网络。

无监督网络可以被应用在数据组的辨别上。

一些线形网络和Hopfield网络是直接设计的。

总的来说,有各种各样的设计和学习方法来增强用户的选择。

神经网络领域已经有50年的历史了,但是实际的应用却是在最近15年里,如今神经网络仍快速发展着。

因此,它显然不同与控制系统和最优化系统领域,它们的术语、数学理论和设计过程都已牢固的建立和应用了好多年。

我们没有把神经网络工具箱仅看作一个能正常运行的建好的处理轮廓。

我们宁愿希望它能成为一个有用的工业、教育和研究工具,一个能够帮助用户找到什么能够做什么不能做的工具,一个能够帮助发展和拓宽神经网络领域的工具。

因为这个领域和它的材料是如此新,这个工具箱将给我们解释处理过程,讲述怎样运用它们,并且举例说明它们的成功和失败。

我们相信要成功和满意的使用这个工具箱,对范例和它们的应用的理解是很重要的,并且如果没有这些说明那么用户的埋怨和质询就会把我们淹没。

所以如果我们包括了大量的说明性材料,请保持耐心。

我们希望这些材料能对你有帮助。

这个章节在开始使用神经网络工具箱时包括了一些注释,它也描述了新的图形用户接口和新的运算法则和体系结构,并且它解释了工具箱为了使用模块化网络对象描述而增强的机动性。

最后这一章给出了一个神经网络实际应用的列表并增加了一个新的文本--神经网络设计。

这本书介绍了神经网络的理论和它们的设计和应用,并给出了相当可观的MA TLAB和神经网络工具箱的使用。

2. 反向传播网络(BP网络)1.概述前面介绍了神经网络的结构和模型,在实际应用中,我们用的最广泛的是反向传播网络(BP网络)。

下面就介绍一下BP网络的结构和应用。

BP网络是采用Widrow-Hoff学习算法和非线性可微转移函数的多层网络。

一个典型的BP网络采用的是梯度下降算法,也就是Widrow-Hoff算法所规定的。

backpropagation就是指的为非线性多层网络计算梯度的方法。

现在有许多基本的优化算法,例如变尺度算法和牛顿算法。

神经网络工具箱提供了许多这样的算法。

这一章我们将讨论使用这些规则和这些算法的优缺点。

一个经过训练的BP网络能够根据输入给出合适的结果,虽然这个输入并没有被训练过。

这个特性使得BP网络很适合采用输入/目标对进行训练,而且并不需要把所有可能的输入/目标对都训练过。

为了提高网络的适用性,神经网络工具箱提供了两个特性--规则化和早期停止。

这两个特性和用途我们将在这一章的后面讨论。

这一章还将讨论网络的预处理和后处理技术以提高网络训练效率。

2.基础网络结构神经网络的结构前一章已详细讨论过,前馈型BP网络的结构结构和它基本相同,这里就不再详细论述了,这里着重说明以下几点:1.常用的前馈型BP网络的转移函数有logsig,tansig,有时也会用到线性函数purelin。

当网络的最后一层采用曲线函数时,输出被限制在一个很小的范围内,如果采用线性函数则输出可为任意值。

以上三个函数是BP网络中最常用到的函数,但是如果需要的话你也可以创建其他可微的转移函数。

2.在BP网络中,转移函数可求导是非常重要的,tansig、logsig和purelin都有对应的导函数dtansig、dlogsig和dpurelin。

为了得到更多转移函数的导函数,你可以带字符"deriv"的转移函数:tansig('deriv')ans = dtansig网络构建和初始化训练前馈网络的第一步是建立网络对象。

函数newff建立一个可训练的前馈网络。

这需要4个输入参数。

第一个参数是一个Rx2的矩阵以定义R个输入向量的最小值和最大值。

第二个参数是一个颟顸每层神经元个数的数组。

第三个参数是包含每层用到的转移函数名称的细胞数组。

最后一个参数是用到的训练函数的名称。

举个例子,下面命令将创建一个二层网络,其网络模型如下图所示。

它的输入是两个元素的向量,第一层有三个神经元,第二层有一个神经元。

第一层的转移函数是tan-sigmoid,输出层的转移函数是linear。

输入向量的第一个元素的范围是-1到2,输入向量的第二个元素的范围是0到5,训练函数是traingd。

net=newff([-1 2; 0 5],[3,1],{'tansig','purelin'},'traingd');这个命令建立了网络对象并且初始化了网络权重和偏置,因此网络就可以进行训练了。

我们可能要多次重新初始化权重或者进行自定义的初始化。

下面就是初始化的详细步骤。

在训练前馈网络之前,权重和偏置必须被初始化。

初始化权重和偏置的工作用命令init 来实现。

这个函数接收网络对象并初始化权重和偏置后返回网络对象。

下面就是网络如何初始化的:net = init(net);我们可以通过设定网络参数net.initFcn和yer{i}.initFcn这一技巧来初始化一个给定的网络。

net.initFcn用来决定整个网络的初始化函数。

前馈网络的缺省值为initlay,它允许每一层用单独的初始化函数。

设定了net.initFcn ,那么参数yer{i}.initFcn 也要设定用来决定每一层的初始化函数。

对前馈网络来说,有两种不同的初始化方式经常被用到:initwb和initnw。

initwb函数根据每一层自己的初始化参数(net.inputWeights{i,j}.initFcn)初始化权重矩阵和偏置。

前馈网络的初始化权重通常设为rands,它使权重在-1到1之间随机取值。

这种方式经常用在转换函数是线性函数时。

initnw通常用于转换函数是曲线函数。

它根据Nguyen和Widrow[NgWi90]为层产生初始权重和偏置值,使得每层神经元的活动区域能大致平坦的分布在输入空间。

它比起单纯的给权重和偏置随机赋值有以下优点:(1)减少神经元的浪费(因为所有神经元的活动区域都在输入空间内)。

(2)有更快的训练速度(因为输入空间的每个区域都在活动的神经元范围中)。

初始化函数被newff所调用。

因此当网络创建时,它根据缺省的参数自动初始化。

init 不需要单独的调用。

可是我们可能要重新初始化权重和偏置或者进行自定义的初始化。

例如,我们用newff创建的网络,它缺省用initnw来初始化第一层。

如果我们想要用rands重新初始化第一层的权重和偏置,我们用以下命令:yers{1}.initFcn = 'initwb';net.inputWeights{1,1}.initFcn = 'rands';net.biases{1,1}.initFcn = 'rands';net.biases{2,1}.initFcn = 'rands';net = init(net);网络模拟(SIM)函数sim 模拟一个网络。

sim 接收网络输入p,网络对象net,返回网络输出a,这里是simuff用来模拟上面建立的带一个输入向量的网络。

p = [1;2];a = sim(net,p)a =-0.1011(用这段代码得到的输出是不一样的,这是因为网络初始化是随机的。

)下面调用sim来计算一个同步输入3向量网络的输出:p = [1 3 2;2 4 1];a=sim(net,p)a =-0.1011 -0.2308 0.4955网络训练一旦网络加权和偏差被初始化,网络就可以开始训练了。

我们能够训练网络来做函数近似(非线性后退),模式结合,或者模式分类。

训练处理需要一套适当的网络操作的例子--网络输入p和目标输出t。

在训练期间网络的加权和偏差不断的把网络性能函数net.performFcn减少到最小。

前馈网络的缺省性能函数是均方误差mse--网络输出和目标输出t之间的均方误差。

这章的余项将描述几个对前馈网络来说不同的训练算法。

所有这些算法都用性能函数的梯度来决定怎样把权重调整到最佳。

梯度由叫做反向传播的技术决定,它要通过网络实现反向计算。

反向传播计算源自使用微积分的链规则。

基本的反向传播算法的权重沿着梯度的负方向移动,这将在下一节讲述。

以后的章节将讲述更复杂的算法以提高收敛速度。

反向传播算法反向传播算法中有许多变量,这一章将讨论其中的一些。

反向传播学习算法最简单的应用是沿着性能函数最速增加的方向--梯度的负方向更新权重和偏置。

这种递归算法可以写成:xk+1 = xk- a k g k这里xk是当前权重和偏置向量,g k是当前梯度,a k是学习速率。

有两种不同的办法实现梯度下降算法:增加模式和批处理模式。

在增加模式中,网络输入每提交一次,梯度计算一次并更新权重。

在批处理模式中,当所有的输入都被提交后网络才被更新。

下面两节将讨论增加模式和批处理模式。

增加模式训练法(ADAPT)函数adapt用来训练增加模式的网络,它从训练设置中接受网络对象、网络输入和目标输入,返回训练过的网络对象、用最后的权重和偏置得到的输出和误差。

这里有几个网络参数必须被设置,第一个是net.adaptFcn,它决定使用哪一种增加模式函数,缺省值为adaptwb,这个值允许每一个权重和偏置都指定它自己的函数,这些单个的学习函数由参数net.biases{i,j}.learnFcn、net.inputWeights{i,j}.learnFcn、yerWeights{i,j}.learnFcn和Gradient Descent (LEARDGD)来决定。

对于基本的梯度最速下降算法,权重和偏置沿着性能函数的梯度的负方向移动。

在这种算法中,单个的权重和偏置的学习函数设定为"learngd"。

下面的命令演示了怎样设置前面建立的前馈函数参数:net.biases{1,1}.learnFcn = 'learngd';net.biases{2,1}.learnFcn = 'learngd';yerWeights{2,1}.learnFcn = 'learngd';net.inputWeights{1,1}.learnFcn = 'learngd';函数learngd有一个相关的参数--学习速率lr。