自制折边机模型图

小学生简易航空模型的制作

简易航空模型的制作从人类诞生以来,一直都有一个梦,梦想着能像鸟儿一样飞翔。

人类为此伤透了脑筋:为什么鸟儿有翅膀就能飞上天空,人类却不能。

为此,我们的祖先制作出了种类繁多的风筝、竹晴蜒、孔明灯和木鸟模型。

它们在飞机发明的过程中起了重要的作用。

经过一代又一代人的努力。

人类终于梦想成真了。

1903年,美国莱特兄弟(哥哥威尔伯,弟弟奥维尔)利用汽油发动机制造的“飞行者”号在美国基蒂霍克成功进行了历史上第一次机械动力飞行,12秒钟飞行了36米。

此后在第一次世界大战中,飞机的性能得到迅速改善。

1927年,美国飞行员林白曾驾驶“圣路易精神号(Spirit of Saint Louis)”成功飞越纽约和巴黎之间的大西洋,连续飞行5809公里,飞行时间为33小时50分钟。

但是,我国在航空同工业发达的国家相比,还有不少差距。

开展航空模型小制作活动,可以使学生了解我国航空发展的历史和现状,激发学生从小立志献身于祖国的航空事业,为四化建设作出贡献。

航空模型的制作需要运用许多的科学知识,通过模型的制作,可以启发学生运用所学知识勇于实践,培养动手能力和创造能力。

初级橡筋动力模型飞机初级橡筋动力模型飞机是一个比较典型的传统普及项目。

通过制作、放飞初级橡筋动力模型飞机,可以对带有动力的自由飞项目有一个初步了解,为进一步学习制作复杂的模型飞机打下一个扎实的基础,是在初级模型滑翔机的基础上学习的延伸。

下面让我们来做一架初级橡筋动力模型飞机.第一节飞机的制作一、材料工具:一套初级橡筋动力模型飞机材料。

砂纸板、壁纸刀、尖嘴钳、铅笔、尺子、透明胶带、双面胶带、模型快干胶(白乳胶、502胶水均可)。

二、制作过程:1、制作机翼:将吹塑纸按图示尺寸裁出左右机翼制作翼型:在距前缘25mm处弯折一下,使它向上凸起6mm。

具体做法:先在折痕处的机翼下面用铅笔压一条印,然后沿此线弯折。

制作上反角:在每边距翼尖110mm处,从折痕到前缘切开一个口,再把翼尖翘起25°、切口最大处相距5mm,用透明胶带把切口粘上。

铝板、不锈钢、门窗加工全过程图解

韦xx加工厂学习总结经过将近一个月的xxx学习,从中也学到有很多有关板材加工相关的知识。

北京京湘联科技有限公司主要从事钣金加工及喷涂工事智能门窗制造等业务,针对金属薄板(京湘联工厂主要是对冷板、铝板、镀锌板和不锈钢板)一种综合冷加工工艺,包括一系列的剪、冲/切/复合、折、焊接、铆接、拼接、成型等。

一般完成一次板材加工入库需要几个过程,工厂技术部收到现场发来的板材加工图以后:技术部对加工图的深化、下料——剪板机剪板(剪板料)——刨槽机刨槽——数控冲床切边、冲孔——折弯机折弯板材——对成型板材组装、辅助焊接、打磨——喷涂前处理——喷涂板材——喷涂检测,包装入库。

一:技术部对加工图的深化,下料工厂技术部收到工地现场发来的各板材加工图,然后对加工图的进一步深化,包括对板材投影面的展开、计算面积(用做后期预算)以及对加工板材的数控编程,就可以下料了。

为了更好的节约原材料,编程时要合理的选择板材的拼接图使几张要加工的板材拼接起来符合原材料的常规尺寸。

在数控冲床的编程时,应当选择合理的换模次序,其一般原则是:先圆孔后方孔,先小孔后大孔、先中间后外形。

同时一套模具在选用以后,出于缩短加工时间的考虑,应该完成其在这个零件上的所有需要加工的型孔。

在合理选择换模次序的同时也应该选取模具的最佳走刀路线,以减少空行程,提高生产效率,并保证机床安全可靠的运行,一般每个不同的工件必须独立编程。

在对加工图深化的过程中要参照常用板材来进行选板、计算。

如下表1:二:剪板机剪板(剪板料)数控剪板机(下图1)是借于运动的上刀片和固定的下刀片,采用合理的刀片间隙,对各种厚度的金属板材施加剪切力,使板材按所需要的尺寸断裂分离,一般采用脚踏或按钮操纵进行单次或连续剪切金属。

数控剪板机可分为:脚踏式(人力)、机械数控剪板机式、液压摆式数控剪板机等。

数控剪板机常用来剪裁直线边缘的板料毛坯。

剪切工艺应能保证被剪板料剪切表面的直线性和平行度要求,并尽量减少板材扭曲,以获得高质量的工件。

新型折边机上压紧模的结构设计

20 1 ) 10 6

250 ) 2 0 0

摘要 : 数控 四边折边 机是 成形 盒形 零件最理 想的精 密高效设 备 , 而上 压 紧模 的结构设 计 是影 响 其 发展 的重要 因素之 一 介绍 了当前 上 压 紧模的 结构 及其 存在 的 问题 , 出 了一 种 新 型 的上 压 紧 提

3 新型 上 压 紧模 的 强 度 分析

依据 上 述 原 理 , 计 出如 图 6所 示 的 上 压 紧 设 模 。从 图 中可 以看 出 , 侧 的可转 动部 分 整个 上 左 压 紧模 的 薄 弱环 节 , 用 A Y 利 NS S软 件 , 立 其 有 建 限元 模 型 。选 用 S l9 oi 2单 元 _ , 对 其 进 行 自由 d 3并 J 网格划 分 。在折 边机 工作 时 , 5 mm 长 的模具 上 在 0 需 施加 4 N 的压 力 , k 施加 在两 部 件 接触 处 , 底 面 而

整个 动作 实现 起来非 常 困难 , 需要相 互配 合 且 相 互协 调 , 致使 数 控折边 机发展 缓慢 、 价格 高 昂。

配合 , 使得 上压 紧模 的长度与 工件需 折 弯的长 度相

匹配 。如 图 3所示 。

2 新 型 上 压 紧 模 结构 设 计

如 图 4所示 , 型上 压 紧模 分 为 4个 部 分 : 新 中 心模块 、 中心辅 助模 块 、 侧模块 、 侧模块 。左 右 左 右 模 块 由 2部分 组成— — 固定部 分与 转动部 分 , 有 其 2个 工作状 态 , 可通过 小 的液压 缸 来 实现 转 换 。如

万 欧元 / 。而 造 成折 边 机 发展 缓 慢 的 主要 原 因 台)

[ - - -

]

之一就是折弯机上压紧模结构复杂。

模型飞机制作

我重点向朋友们讲讲在制作过程中,机翼和水平尾翼安装角的控制。安装角的正确与否,关系到飞机在空中的姿态能否有效地操控。如果因安装角误差大到连各舵面都无法调整时,后果就非常严重了,甚至要摔机的。机翼和水平尾翼的安装角都是以飞机的拉力轴线为基准的,这架飞机的拉力轴线比较好找,从图可知,A、F、 G、H隔框的上边在一条直线上,这条线就是拉力轴线的平行线,把它平移到发动机的曲轴线的位置,就是这架飞机的拉力轴线。机身骨架做完后,一定把它画在机身上。尔后,在安装机翼和水平尾翼时,把它们的中心线和拉力轴线平行即可。好了,请看我的制作过程。

垂直尾翼、水平尾翼和尾力臂这三个要素合起来,就是“尾容量”。尾容量的大小,是说它对飞机的稳定和姿态变化贡献的大小。这个问题我们用真飞机来说明一下。像米格15和F16高速飞行的飞机,为了保证在高速飞行时的纵向稳定,其垂直尾翼设计得又大又高。像SU27和F18甚至设计成双垂直尾翼。而像运输机和客机,垂直尾翼就小得多。

6.确定重心位置。6.确定机身长度。翼展和机身的比例一般是70--80%。我选80%。那么机身的长度就确定为1200毫米。

7.确定机头的长度。机头的长度(指机翼前缘到螺旋浆后平面的之间的距离),等于或小于翼展的15%。我选定15%,即为225毫米。

8.确定垂直尾翼的面积。

<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<6

折弯机设计毕业设计

折弯机设计毕业设计折弯机设计毕业设计摘要在研究国内外折弯机械的发展状况和我国折弯机械存在的问题的基础上,根据零件作业的要求,设计了一种利用液压元件驱动单向作业的折弯机。

该机型采用曲柄滑块机构,解决了实际生产之中薄板材的折弯。

并且通过对机构的运动分析和计算,通过机构的转化来实现使折弯力在加工过程之中始终与零件时刻保持垂直的一台空调冷凝器后罩生产线上专用的三梁二柱式的非标准设备。

该折弯机的特点是结构简单,操作容易,工效高。

关键词:折弯机液压非标设备折弯机设计毕业设计AbstractIn studies the domestic and foreign knee bend machinery the development condition and our country bends at the knees in the question foundation which the machinery exists, according to the components work request, designed one kind to actuate the unidirectional work using the hydraulic pressure part the booklet bender.This type uses the crank slide organization, has solved during the actual production the thin plate knee bend.And through to the organization movement analysis and the computation, realizes through the organization transformation makes the knee bend strength throughout to maintain on a vertical air conditioning condenser rear cowl production line in the processing process with the components time the special-purpose three Liang two column type non-standard equipment.This booklet bender characteristic is the structure is simple, the operation is easy, the work efficiency is high.Key word: Folds the bender Hydraulic pressure Non-sign equipment折弯机设计毕业设计目录摘要 (I)Abstract (II)第1章绪论 (1)1.1国内外的科技现状 (1)1.1.1国内外的现状 (1)1.2选题目的和意义 (2)1.3本文主要研究内容 (2)第2章折弯产品的零件图 (3)第3章折弯机设计原理和机构方案的分析、比较、确定 (5)3.1折弯机设计原理的分析、比较、确定 (5)3.2 折弯机结构方案的分析、确定 (6)第4章折弯机设计的计算和结构说明 (7)4.1 折弯力的计算 (7)4.2 压边力的计算 (9)4.2.1压紧块的设计 (9)4.2.2 压边力的计算 (9)4.2.3压紧块中心位置的确定 (10)4.3 机架的受力分析 (11)4.3.1机架以及相关零件参数的确定 (11)4.3.2机架的受力分析 (13)4.4油缸的选取 (18)4.4.1压紧缸的选取 (18)4.4.2 折弯缸的选取 (19)4.5 液压系统的设计 (25)4.5.1负载分析 (25)4.5.2执行元件主要参数的确定 (25)4.5.3拟定液压系统原理图 (26)第5章典型零件的加工工艺过程 (28)折弯机设计毕业设计5.1导柱 (29)5.2压紧块的工艺安排 (31)结论 (38)致谢 (32)参考文献 (40)折弯机设计毕业设计CONTENTS Abstract (II)Chapter 1 Introduction (1)1.1Domestic and international current situation of science and technology. 11.1.1 Domestic and overseas status (1)1.2Purpose and significance of the theme (2)1.3The main research contents (2)Chapter 2Bending of product parts diagram (3)Chapter 3Bending machine design principle and mechanism analysis (5)3.1Bending machine design principle analysis, comparison, determine the. 53.2 Bending machine structure scheme analysis, determine the (6)Chapter 4Bending machine design calculation and structure (7)4.1 Bending force calculation (7)4.2 Blank holder force calculation (9)4.2.1The press block design (9)4.2.2 Blank holder force calculation (9)4.2.3The pressing block center position determination (10)4.3 A force analysis (11)4.3.1Housing and related parts parameters (11)4.3.2 A force analysis (13)4.4Cylinder selection (18)4.4.1The selection of pressure cylinder (18)4.4.2 The selection of pressure cylinder (19)4.5 The design of hydraulic system (25)4.5.1Load analysis (25)4.5.2Executive element to determine main parameters (25)4.5.3Formulation of the hydraulic system principle diagram (26)Chapter 5Typical parts machining process (28)5.1Guide pillar (29)折弯机设计毕业设计5.2Pressing block for process planning (31)Conclusion (38)Thanks (32)References (33)第1章绪论机械工业担负着国民经济各部门,包括工业,农业和社会生活各个方面提供各种性能先进,价格低廉,使用安全可靠的技术装备的任务,在现代化建设中是举足轻重的。

自制手动金属弯板机

自制手动金属弯板机乔治·埃弗里尔;郭牧楠【期刊名称】《电子制作》【年(卷),期】2015(000)013【总页数】3页(P18-20)【作者】乔治·埃弗里尔;郭牧楠【作者单位】ARRL;【正文语种】中文L.B.Cebik(W4RNL)在《QST》杂志1996 年10 月刊发布了一篇有趣的文章,文章中展示了一台他设计用来折弯金属板的弯板机。

本文将继续使用他的设计思路,并更进一步简化制作弯板机的过程,同时讲解在弯板时金属对于弯曲应力的反应。

最后添加一个制作金属小盒的模板。

为什么要制作一台弯板机几乎每个HAM 在自制设备的时候都会遇到需要金属外壳的情况。

曾经HAM 们可以在本地的电子商店里买到种类繁多的外壳。

但现在已经很难买到了,大多数这样的店铺都已经关闭,而还在营业的店里也只能买到特定种类的塑料外壳。

这样的情况迫使我们只能在两个方案中选择:订购一个外壳然后等着收货,或者使用一个不是特别适合的外壳。

工具和材料对了!为什么不自己做外壳呢?只需要很简单的工具就能做一个这样的弯板机!你只需要一把锯木头的木工锯,一把锯角钢的钢锯,一把锋利的小刀,一把手电钻,相应的钻头和两个C 字夹就可以了。

有一台小台钻可以让钻孔工作简单很多,但使用手电钻也一样可以完成制作。

除此之外还需要两个3 寸的合页,一根23 厘米长的压板,两根30 厘米长的40 角钢(我的是从整根4×40 角钢上截取的),还需要一些用来装合页的木工螺丝。

这些基本都可以在本地的五金店买到。

制作弯板机只需要下列五个简单步骤,你就可以做出这台弯板机。

图1 想要弯板机正常工作,合页必须像图中一样对齐切割木材总共需要切割6 根木材,两根用来装角钢和合页,两根较为粗壮的做弯板机的底,两根稍细一些的用作折弯时的把手。

这些木头的尺寸并没有什么精确值,不过要注意的是:折弯部分的平板必须足够窄,否则可能装不上固定被折弯件的C字夹。

在角钢上钻孔在两根30 厘米长的角钢上分别按等间距钻三个孔,这六个孔是用来装木工螺丝的,需要注意的是:为了使安装后螺丝头不突出表面,角钢钻孔后需要沉孔。

数控折边机工作原理

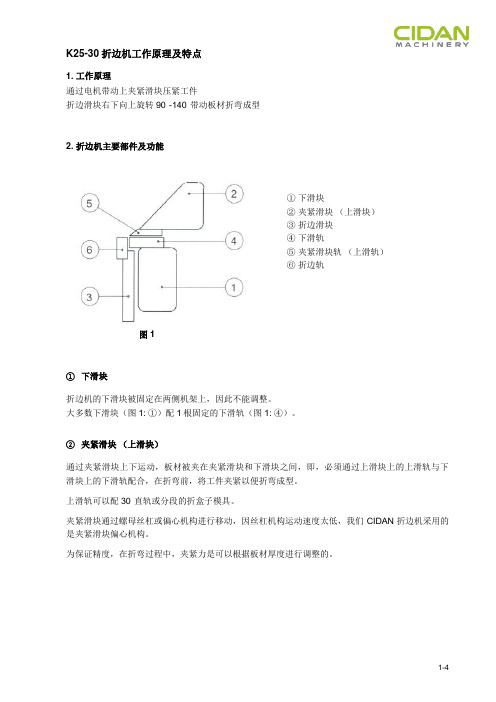

K25-30折边机工作原理及特点1. 工作原理通过电机带动上夹紧滑块压紧工件折边滑块右下向上旋转90°-140°带动板材折弯成型2. 折边机主要部件及功能①下滑块②夹紧滑块(上滑块)③折边滑块④下滑轨⑤夹紧滑块轨(上滑轨)⑥折边轨图1①下滑块折边机的下滑块被固定在两侧机架上,因此不能调整。

大多数下滑块(图1: ①)配1根固定的下滑轨(图1: ④)。

②夹紧滑块(上滑块)通过夹紧滑块上下运动,板材被夹在夹紧滑块和下滑块之间,即,必须通过上滑块上的上滑轨与下滑块上的下滑轨配合,在折弯前,将工件夹紧以便折弯成型。

上滑轨可以配30°直轨或分段的折盒子模具。

夹紧滑块通过螺母丝杠或偏心机构进行移动,因丝杠机构运动速度太低,我们CIDAN折边机采用的是夹紧滑块偏心机构。

为保证精度,在折弯过程中,夹紧力是可以根据板材厚度进行调整的。

③折边滑块随着夹紧滑块的旋转,位于夹紧滑块和下滑块之间的板材被折弯。

大多数折边机的折边滑块都配一套折边轨(图1: ⑥)。

B=轨道厚度图2从图2可以看出,折边轨厚度B设定了折边机所能折弯的Z-型件最小尺寸。

折边轨越窄,折边力要求越大,这点相当重要。

因此,对于同一台折边机,当使用较窄的折边轨比使用较宽的折边轨时,折弯能力会减弱。

为保证精度,折边轨与下滑轨之间的相对高度可根据板厚进行调整。

为保证折弯厚板工件的直线度,折边滑块配置了机械补偿机构。

3. 折边机折弯最小法兰边b=法兰边距离i=压紧边距离对于一般板料,法兰边距离(b)最低是10倍板厚。

对于碳钢,法兰边距离(b)最低是7倍板厚。

为避免机器及模具损坏,必须遵守上述规定。

四、K25-30特点CIDAN的K25型号采用坚固的焊接结构的机身及铸造的支腿,工作效率非常高,操作也很方便。

K25适合满负荷连续工作的最高需求条件,折弯滑块及压紧滑块为双边驱动,广泛的满足不同行业的需求。

CIDAN数控折边机与传统折弯机的对比1) 减少劳动强度--工件平放在工作台--1个人操作--省力、产品折弯不受人为影响导致精度偏差--安全、环保无油、无噪音--后挡料最长可做到4M长2) 万能模具系统--材质变化、板厚变化不用更换模具--异型工件折弯无需更换特殊模具--压死边、任意角度、折弯圆弧不需要重新变更模具--四周折弯,不需要重新更换模具或设备--节省更换模具及调试时间的浪费3) 无痕折弯--不锈钢、铝板表面要求高的敏感材质折弯无痕--不需要重新购买折弯专用保护膜--减少了由于垫膜而影响折弯精度--提高了工作效率4) 成型尺寸精度保证--折边机采用长边定位(折弯机短边定位)--落料不准的累积误差,集中在第1刀(折弯机集中在成型尺寸)--及时的修正由于落料不准而导致产品不良5) 不拉伤孔--折弯线离孔太近不会拉伤--孔边无明显的折痕6) 直线度一致性--机械结构无液压系统、PLC伺服控制--不受油温影响--不受材质、厚度影响7) 数控模拟折弯--中文操作界面易操作--自动折弯干涉提示--2维图形编程。

编织袋折边折角机械手设计

关于编织袋折边折角机械手设计机械2111王俊杰3112101103工业机器人是机械技术、电子技术与计算机技术有机结合在一起形成的一种机电一体化的产品,从其诞生起就受到人们的关心与重视。

经过几十年的发展,目前工业机器人技术已经很成熟。

工业机器人已从最初在解决劳动密集型工业中单调、重复的体力劳动发展到满足制造业自动化规模生产需要的工作。

其应用领域不断扩大,从最初主要应用于汽车工业发展到现在涉及制造业的各个行业。

目前我国国民经济的快速发展,先进制造业已进入一个新的发展阶段。

机械手是在机械化、自动化生产过程中发展起来的一种新型装置。

近年来,随着电子技术特别是电子计算机的广泛应用,机器人的研制和生产已成为高技术领域内迅速发展起来的一门新兴技术,它更加促进了机械手的发展,使得机械手能更好地实现与机械化和自动化的有机结合。

机械手虽然目前还不如人手那样灵活,但它具有能不断重复工作和劳动、不知疲劳、不怕危险、抓举重物的力量比人手大等特点,因此,机械手已受到许多部门的重视,并越来越广泛地得到了应用,例如:(1)机床加工工件的装卸,特别是在自动化车床、组合机床上使用较为普遍。

(2)在装配作业中应用广泛,在电子行业中它可以用来装配印制电路板,在机械行业中它可以用来组装零部件。

(3)可在劳动条件差,单调重复易子疲劳的工作环境工作,以代替人的劳动。

(4)可在危险场合下工作,如军工品的装卸、危险品及有害物的搬运等。

(5)宇宙及海洋的开发。

(6)军事工程及生物医学方面的研究和试验。

本次设计编织袋折边折角机械手,由于本人水平有限,虽然在学长帮助下和查找资料,也只能做到文中所示的程度,不足之处,望老师批评指出。

本课题要设计一套编织袋折边折角机械手,主要的设计有以下几个方面:(1)确定机械手的总体结构根据装配生产线搬运机械手的特点,确定液压搬运机械手的总体方案,保证机械手在空间有限位置的定位。

然后根据考虑的总体方案确定机械手的总体结构,可采用模块化的设计,将机械手分为若干个模块,对各个模块进行设计,最后把这些模块拼装起来组成机械手。

一种钢片自动折弯设备的制作方法

一种钢片自动折弯设备的制作方法本发明涉金属折弯设备技术领域,具体涉及一种钢片自动折弯设备。

背景技术:在金属零部件加工中,经常需要对片状金属进行折弯,因此会经常用到金属折弯机,折弯机在加工零件时,通常需要上料、定位、折弯和下料四个步骤,目前,人们需采用人工手动的方式完成。

这种作业方式提高了工人的劳动强度,生产效率低下。

同时,折弯机体积大,操作不方便,在进行小批量零件的加工时,生产成本高,效率低。

而且,人工操作折弯机时还存在较大的安全隐患。

随着工业自动化水平的提高,本领域技术人员尝试发明半自动及小型折弯机,以便减少人工操作,降低成本,提高效率,但效果并不理想。

现有的折弯机,自动化程度低,大部分都需要人工完成上料、定位和下料等操作,并没有充分解放劳动力。

技术实现要素:有鉴于此,本发明的目的是克服现有技术中的缺陷,提供一种钢片自动折弯设备,具有自动上料、送料和落料功能,不需要人工上料下料操作。

本发明的一种钢片自动折弯设备,包括机体,还包括:上料机构,设置在所述机体前端,用于承载并递送工件;送料机构,设置在所述上料机构的上方,具有运动机构以及工件吸取机构;折弯机构,设置在所述机体中,包括上刀模机构和下合模机构,所述上刀模机构包括设置在机体上方的下压装置以及设置在下压装置下压端上的上刀模,所述下合模机构设置在所述上刀模机构的下方,所述下合模机构包括安装台、固定模具、活动模具以及锁模机构,所述锁模机构驱动所述活动模具开模或锁模,所述固定模具和活动模具均设置于所述安装台上,锁模时固定模具和活动模具之间形成模腔,所述模腔上部具有供上刀模进入的开口,所述固定模具和活动模具在开口处设置有工件定位工装,所述送料机构将工件移送至所述工件定位工装上;所述安装台开设有落料口,所述落料口设置在所述模腔下方,且在开模时露出,锁模时闭合;集料槽,设置在落料口下方,用于收集开模后落下的折弯工件。

进一步,所述上料机构包括上料工装和顶升装置,所述上料工装设置在所述机体上,且所述上料工装具有工件容纳腔,所述顶升装置包括升降电机、升降丝杆以及通过丝母设置升降丝杆上的升降板,所述升降电机通过同步带带动升降丝杆转动,所述升降板上设有多根顶升柱,所述顶升柱贯穿所述上料工装的底部伸入所述工件容纳腔中,所述顶升柱的顶端设置有顶升板。

带风管折边机的设计与实现概要

Open Journal of Nature Science 自然科学, 2015, 3(3, 89-94Published Online August 2015 in Hans. /journal/ojns/10.12677/ojns.2015.33012The Design and Implementation of a Folding Machine with Wind PipesJingman Xia1, Wei Li1, Jie Tang1,2, Rong Liu1,21Chongqing Huafu Industrial Co., Ltd, Chongqing2Chongqing Changpeng Industrial Group Co., Ltd., ChongqingEmail: 515742230@Received: Aug. 1st, 2015; accepted: Aug. 14th, 2015; published: Aug. 21st, 2015Copyright © 2015 by authors and Hans Publishers Inc.This work is licensed under the Creative Commons Attribution International License (CC BY./licenses/by/4.0/AbstractFlap is a fundamental technology for processing. The folding machine plays an important role for the consistency, appearance and hemming productivity of the products. This equipment is a dedi-cated edging hemming device of the ceiling skylights, which issingle-station and works indepen-dently. Its functions are burring and adhesive, pressing and stereotype for skylights by the lifting mechanism, flanging mechanism, lifting mechanism, etc. Thus it would complete the edging action of the workpiece. In order to ensure that the workpiece is not contaminated, SMC oil-cylinder is selected for all edging parts. And the guiding of all lifting parts is made of linear motion bearings.The electrical systems adopt Omron PLC. The buttons of control adopt touch screen. The structure of the device is compact. The installation and retooling are convenient. And the parameter ad-justment is convenient. The device is easy to operate, and has high safety.KeywordsWind Pipes, Folding Machine, Hemming Device, Dormers带风管折边机的设计与实现夏静满1,厉伟1,汤捷1,2,刘荣1,21重庆华福车船电子设备制造有限公司,重庆2重庆长鹏实业(集团有限公司,重庆Email: 515742230@夏静满等收稿日期:2015年8月1日;录用日期:2015年8月14日;发布日期:2015年8月21日摘要“折边”是加工的一项基本工艺,折边机对产品的一致性、美观性及折边生产效率起着重要作用。