pso粒子群算法概述

粒子群优化算法PSO

将车辆任务点编号为0, 1,…L , 其中: 0 为 中心仓库; 1, 2,…L 为收货点。 • 定义变量如下:

f ki

• cij 为从任务点i到任务点j的运输成本(运输 距离)

• Z为所有车辆行驶距离总和

非满载车辆优化调度的数学模型为

该模型要求每个收 货点都得到车辆配 送服务, 并且限制 每个收货点的需求 只能由某一台车辆 完成, 同时保证每 条路径上各收货点 的总需求量不超过 此路径上配送车辆 的容量。在满足上 述条件的情况下, 使所有车辆行驶距 离之和Z 最小。

12/03/12

Particle Swarms Optimization

粒子群最佳化

整合群体行为、人类决策与鸟群行为发展成为 粒子群演算法。

【Eberhart, Kennedy, 1995】

Russ Eberhart

Bionic Computing

Bionic Computing Lab, 2005

(1) 对粒子第二维向量xi 的元素xij 进行取整操作 int (xij) , 即可得到分配给收货点j 的车辆k 。 (2) 对于车辆k 的行驶路径, 按照粒子第三维向量y i 的元素yij 的大小顺序来确定, 即首先找出由车辆 k 完成配送的收货点j , 然后按照j 所对应yij 的大小, 从小到大进行排序, 从而确定车辆k的行驶路径。

粒子群优化算法(PSO)

我们采用遗传算法的思想解决。 (1)w*v项可看作是一种变异操作。 (2)c1*(pbest-x) + c2*(gbest-x) 项可看作是一种 交叉操作。

交叉与变异

交叉: P1=(1 2 | 3 4 5 6 | 7 8 9) P2=(9 8 | 7 6 5 4 | 3 2 1) Q1=(1 2 | 7 6 5 4 | 3 8 9) Q2=(9 8 | 3 4 5 6 | 7 2 1) R=(1 2 | 3 4 5 6 | 7 8 9) S=(1 2 | 6 5 4 3 | 7 8 9)

756 4953

遗传算法 1.6s 28.1s 154.6s 200.6s 215.0s

567 3842

粒子群优化 0.016s 0.578s 31.9s 56.1s 73.9s

538 2579

时间分析

性能比较

模拟退火

遗传算法

粒子群优化

研究方向

• (1) 算法分析。PSO在实际应用中被证明是有效的, 但目前 还没有给出完整收敛性、收敛速度估计等方面的数学证明, 已有的工作还远远不够。 • (2) 参数选择与优化。参数w、c1、c2的选择分别关系粒子 速度的3个部分:惯性部分、社 会部分和感知部分在搜索中 的作用.如何选择、优化和调整参数,使得算法既能避免早 熟又 能比较快速地收敛,对工程实践有着重要意义。 • (3) 与其他演化计算的融合。如何将其它演化的优点和PSO 的优点相结合,构造出新的混合算 法是当前算法改进的一 个重要方向。 • (4) 算法应用。算法的有效性必须在应用中才能体现,广泛 地开拓PSO的应用领域,也对深化 研究PSO算法非常有意义。

粒子群优化算法(PSO)综述介绍

带收缩因子的PSO算法:

vi

t 1

X [ v i 1U 1 ( pbi x i ) 2U 2 ( gb x i )]

t t t t t t t

收缩因子保证了收敛性并提高了收敛速度。 显然,该迭代公式和标准迭代公式相比并无本质区别, 只要适当选取参数,二者完全相同。

局部PSO算法:

在计算机上模拟该模型的结果显示:当g_increment较大 时,所有的个体很快地聚集到“谷地”上;反之,粒子缓 慢地摇摆着聚集到“谷地”的四周。 受此模型启发Kennedy和Eberhart设计出了一种演化优化 算法,并通过不断的试验和试错,最后将此算法的基本型 固定为:

vi

t 1

v i 1U 1 ( pbi x i ) 2U 2 ( gb x i )

vi

t 1

v i 1U 1 ( pbi x i ) 2U 2 ( lb x i )

t t t t t为自身最优位置 pbest和种群最优位置gbest。 对应的,在局部版本中,微粒除了追随自身最优位置 pbest之外,不跟踪种群最优位置gbest,而是跟踪拓 扑邻域中的所有微粒的最优位置lbest。

算法思想:

1.初始化种群数量,使他们随机的分布在平面上; 2.根据模型评估每个粒子的位置; 3.如果一个粒子当前的位置比它之前的的位置好,则记录下 新位置,记为pbest;

4.确定种群中最好的粒子的位置,记为gbest;

5.根据公式:

vi

t 1

v i 1U 1 ( p bi x i ) 2U 2 ( g b x i )

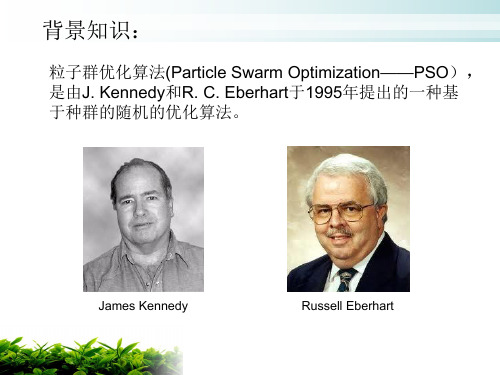

背景知识:

粒子群优化算法(Particle Swarm Optimization——PSO), 是由J. Kennedy和R. C. Eberhart于1995年提出的一种基 于种群的随机的优化算法。

粒子群优化算法综述介绍

粒子群优化算法综述介绍PSO算法的基本原理是通过多个个体(粒子)在解空间里的,通过不断更新个体的位置和速度来寻找最优解。

每个粒子都有自己的位置和速度,并根据个体历史最佳位置和群体历史最佳位置进行更新。

当粒子接近最优解时,根据历史最优位置和当前位置的差异进行调整,从而实现相对于当前位置的。

具体而言,PSO算法可以分为以下几个步骤:1.初始化粒子群:定义粒子的位置和速度以及适应度函数。

2.更新每个粒子的速度和位置:根据粒子的历史最佳位置和群体历史最佳位置,以及加权系数进行更新。

可以使用以下公式计算:v(i+1) = w * v(i) + c1 * rand( * (pbest(i) - x(i)) + c2 * rand( * (gbest - x(i))x(i+1)=x(i)+v(i+1)其中,v(i+1)是第i+1次迭代时粒子的速度,x(i+1)是第i+1次迭代时粒子的位置,w是惯性权重,c1和c2是学习因子,rand(是一个随机数,pbest(i)是粒子个体历史最佳位置,gbest是整个群体历史最佳位置。

3.更新每个粒子的个体历史最佳位置和群体历史最佳位置:根据当前适应度函数值,更新每个粒子的个体历史最佳位置,同时更新群体历史最佳位置。

4.判断终止条件:当达到预设的最大迭代次数或者适应度函数值达到预设的误差范围时,停止迭代,输出结果。

PSO算法的优点在于简单易用、易于实现、不需要求导和梯度信息,并且可以灵活地应用于各种问题。

然而,PSO算法也存在一些缺点,如易于陷入局部最优解、收敛速度较慢等。

为了克服这些限制,研究者们提出了各种改进的粒子群优化算法,如自适应权重粒子群优化算法(Adaptive Weight Particle Swarm Optimization, AWPSO)、混合粒子群优化算法(Hybrid Particle Swarm Optimization, HPSO)等。

这些算法通过引入更多的因素或策略来加快收敛速度、改善性能。

粒子群算法详解

粒子群算法详解

粒子群算法(ParticleSwarmOptimization,PSO)是一种基于群体智能的优化算法。

粒子群算法的基本思想是模拟鸟群或鱼群等群体智能行为,通过不断地调整粒子的位置和速度,使其逐步靠近最优解。

粒子群算法广泛应用于函数优化、机器学习、神经网络等领域。

粒子群算法的流程如下:

1.初始化粒子群的位置和速度;

2.计算每个粒子的适应度,并记录全局最优粒子;

3.根据全局最优粒子和个体最优粒子更新粒子的速度和位置;

4.重复步骤2和3直到达到预定的终止条件。

在粒子群算法中,粒子的位置和速度分别表示解空间中的一个点和该点的搜索方向和速度。

每个粒子都有一个适应度值,用来评估其搜索到的位置的好坏。

全局最优粒子是整个粒子群中适应度最高的粒子,而个体最优粒子是每个粒子自身经历过的最优位置。

粒子群算法的优点在于具有快速收敛速度、易于实现和高度可并行化等特点。

同时,粒子群算法也存在一些缺点,例如易陷入局部最优、对参数选择比较敏感等。

需要注意的是,粒子群算法不是一种万能的优化算法,它适用于一定范围内的函数优化问题。

在实际应用中,需要根据具体问题选择合适的优化算法。

- 1 -。

pso粒子群算法概述[文字可编辑]

![pso粒子群算法概述[文字可编辑]](https://img.taocdn.com/s3/m/325d1c3aa26925c52dc5bf2f.png)

xi ? xi ? Vi

在以式上(1面)、两(2个)中公,式i=为1,基2础,,…形,M成,了M后是来该P群S体O中粒子 的的总标数准形式

算法算介法绍介绍

从表P优S社示O解初会上。始学次在化每的速为一角 度一次度 大群的来 小随迭机看 和代粒, 方中子公 向,(粒式的随子机影(1通解响)过的);。跟第然公踪一后式两部通第个分过“二迭称极部代为值分找记”称到(忆最为pb项自, 身es认t,知gb项est,)来是更从新当自前己点。指向粒子自身最好点的一个矢量, 表在示找粒到子这两的个动最作优来值源后于,自粒子己通经过验下的面部的分公;式xi ?来公xi ? V更式i 新的自第己三部 分的称速为度群和位体置认。知项,是一个从当前点指向种群最好点的 矢(量1),式反映了粒子间的协同合作和知识共享。粒子就是 通动Vi(过。2? )?自式?己Vi的? c经1 ?验ra和nd同()伴? (中pb最est好i ?的xi经) ?验c2来? r决an定d (下) ? 一(gb步es的ti ?运xi )

在的在的式 总i式总数(1数()1、)i、(2()2中i)中,,i=i=1,1,2,2,……,,MM,,MM是是该该群群体体中中粒粒子子

算法算介法绍介绍

VpP优biSO解e是初s。t始粒在和化每子g为一b的一e次群s速的t随如迭度机代前;粒中子定,(义粒随子机;通解过)。跟然踪后两通个过“迭极代值找”到(最pb raesntd,g(b)e是st)介来于更新(自0己、。1)之间的随机数; X在的i 找速是到度粒这和两位子个置的最。当优前值后位,置粒。子通过下面的公式xi ?来xi ? V更i 新自己

数学建模——粒子群算法(PSO)

数学建模——粒子群算法(PSO)粒子群算法(Particle Swarm Optimization,PSO)是一种群体智能优化算法,通过模拟粒子在空间中的跳跃和信息共享来寻找最优解。

PSO 算法源自于对鸟群觅食行为的模拟,通过定义粒子的位置和速度,粒子通过互相通信和协同学习,逐步优化空间中的解。

PSO算法的基本思想是通过模拟粒子群在解空间中的运动来寻找最优解。

每个粒子都有自己的位置和速度,并且根据自己的经验和群体的经验来调整自己的位置和速度。

粒子的位置表示解空间中的一个解,速度表示在解空间中的移动方向和速度。

算法通过迭代更新粒子的位置和速度,使粒子群逐步从解空间的各个位置向最优解靠近。

PSO算法的具体步骤如下:1.初始化粒子群:设定粒子的初始位置和速度,并为每个粒子随机分配解空间中的一个初始解。

2.计算适应度值:根据目标函数计算每个粒子的适应度值。

3.更新个体最优解:对于每个粒子,根据自身的最优解和当前的最优解来更新自己的个体最优解。

4.更新群体最优解:对于每个粒子,根据全局最优解来更新粒子群的最优解。

5.更新粒子速度和位置:根据个体最优解和群体最优解来更新每个粒子的速度和位置。

6.判断终止条件:判断是否满足停止迭代的条件,如果满足则输出当前的最优解,否则返回第3步。

7.输出最优解:输出最优解。

PSO算法有一些特点和优势:1.简单易实现:PSO算法的实现非常简单,不需要复杂的数学推导和计算。

2.并行计算:PSO算法的每个粒子可以独立地计算自己的位置和速度,可以有效地使用并行计算的优势。

3.对局部最优解有一定的克服能力:通过信息共享和协同学习,PSO算法可以避免陷入局部最优解,并能逐步逼近全局最优解。

4.适用于连续空间和离散空间:PSO算法不仅适用于连续优化问题,也适用于离散优化问题。

然而,PSO算法也存在一些缺点:1.对参数敏感:PSO算法的性能很大程度上依赖于参数的调整,不同的问题可能需要调整不同的参数。

粒子群算法求解最小值

粒子群算法求解最小值

(实用版)

目录

一、粒子群算法概述

二、粒子群算法求解最小值的原理

三、粒子群算法在 MATLAB 中的实现

四、粒子群算法求解最小值的应用实例

五、总结

正文

一、粒子群算法概述

粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,于 1995 年由美国社会心理学家 James Kennedy 和电气工程师 Russell Eberhart 共同提出。

该算法的提出是受对鸟类群体行为进行建模与仿真的研究结果的启发。

粒子群优化算法通过个体间的协作与竞争,实现复杂空间最优解的搜索。

将群体中的个体视为 d 维空间中的粒子,该粒子以一定的速度在解空间运动,并向自身历史最优解和全局最优解靠拢。

二、粒子群算法求解最小值的原理

粒子群算法求解最小值主要通过以下步骤实现:

1.初始化粒子群:在解空间中随机分布一定数量的粒子,每个粒子包含四个变量(x, y, z, w),表示粒子在解空间中的位置。

2.评估适应度:根据粒子位置计算目标函数值,得到每个粒子的适应度。

3.更新个体最优解和全局最优解:比较当前粒子的适应度与其历史最

优解的适应度,如果当前适应度更优,则更新个体最优解。

同时,比较全局最优解与当前粒子的适应度,如果当前适应度更优,则更新全局最优解。

4.更新粒子速度和位置:根据个体最优解、全局最优解和当前位置,计算每个粒子的新速度和新位置。

5.检查停止条件:如果达到预设的最大迭代次数或全局最优解的适应度变化小于设定阈值,则停止迭代。

6.返回全局最优解:输出全局最优解及其对应的最小值。

PSO粒子群算法简介

(4)蛙跳算法(Shuffled Frog Leading Algorithm,简称SFLA)[2003年提出];

(5)人工蜂群算法(Artificial Bee Colony Algorithm,简称ABC)[2005年提出]; 除了上述几种常见的群体智能算法以外,还有一些并不是广泛应用的群体智能算法, 比如萤火虫算法、布谷鸟算法、蝙蝠算法以及磷虾群算法等等。

决定

群体历史最优位置

由此,将粒子群算法分为 全局粒子群算法和局部粒子群算法.

粒子群算法的构成要素- 邻域的拓扑结构

全局粒子群算法 1. 粒子自己历史最优值 2. 粒子群体的全局最优值 局部粒子群算法 1. 粒子自己历史最优值 2. 粒子邻域内粒子的最优值 邻域随迭代次数的增加线性变大,最后邻域扩展到整个粒子群。 经过实践证明:全局版本的粒子群算法收敛速度快,但是容易陷入局部 最优。局部版本的粒子群算法收敛速度慢,但是很难陷入局部最优。需要 在两方面做出平衡。

粒子群优化算法

PARTICLE SWARM OPTIMIZATION

进化算法

生物启发式算法

人工神经网络

粒子群优化算法

群体智能优化算法:

群体智能优化算法主要模拟了昆虫、兽群、鸟群和鱼群的群集行为,这些群体按照一种合 作的方式寻找食物,群体中的每个成员通过学习它自身的经验和其他成员的经验来不断地 改变搜索的方向。群体智能优化算法的突出特点就是利用了种群的群体智慧进行协同搜索, 从而在解空间内找到最优解。 常见的群体智能优化算法主要有如下几类:

k 1 自我认知部分 c1r1 ( pbestid xid ) 自我认知型粒子群算法 k 1 社会经验部分 c2 r2 ( gbestd xid )

粒子群算法求解最小值

粒子群算法求解最小值粒子群算法(PSO)是一种基于群体智能的优化算法,通过模拟鸟群觅食行为来寻找最优解。

在PSO中,每个候选解被称为一个粒子,粒子在空间中移动,并根据自己的经验和邻居的经验来更新自己的位置和速度。

PSO常用于求解连续优化问题,包括函数最小值的求解。

粒子群算法的基本原理是模拟鸟群觅食行为。

鸟群中的每个鸟通过与邻居的信息交流来调整自己的飞行方向。

在空间中,每个粒子代表一个解,其位置表示解的位置,速度表示解的方向和速度。

粒子的更新以全局最优解和局部最优解为依据,通过不断迭代空间,寻找最优解。

1.初始化粒子群:随机生成一些粒子,并给定每个粒子的位置和速度。

2.计算适应度:根据适应度函数计算每个粒子的适应度。

3.更新粒子的速度和位置:根据经验和邻居信息,更新每个粒子的速度和位置。

4.更新局部最优解:根据更新后的位置,更新每个粒子的局部最优解。

5.更新全局最优解:根据所有粒子的局部最优解,更新全局最优解。

6.判断终止条件:判断是否达到终止条件,如果满足则算法停止;否则返回步骤3在PSO算法中,粒子的速度和位置的更新公式为:v(i+1) = w * v(i) + c1 * rand( * (pbest(i) - x(i)) + c2 * rand( * (gbest - x(i))x(i+1)=x(i)+v(i+1)其中,v(i)表示第i个粒子的速度,x(i)表示第i个粒子的位置,w表示惯性权重,c1和c2表示加速度系数,pbest(i)表示第i个粒子的局部最优解,gbest表示全局最优解,rand(表示一个0到1之间的随机数。

总之,粒子群算法是一种基于群体智能的优化算法,通过模拟鸟群觅食行为来最优解。

它具有简单、易于实现和理解的优点,在各个领域有广泛的应用。

但是,也需要根据具体情况选择算法参数以及采取一些措施来克服其缺点。

pso粒子群代码

pso粒子群代码PSO粒子群算法(Particle Swarm Optimization,简称PSO)是一种基于群体智能的优化算法,模拟了鸟群或鱼群等群体行为,通过协作和信息共享来搜索最优解。

本文将介绍PSO粒子群算法的原理、步骤以及应用领域。

PSO算法的基本思想是通过模拟群体中每个个体的行为来寻找最优解。

在PSO算法中,每个个体被称为粒子,粒子的位置表示解空间中的一个候选解。

粒子的速度和位置是通过个体经验和群体经验来更新的,其中个体经验是指粒子自身在搜索过程中的最优解,群体经验是指整个群体中的最优解。

PSO算法的步骤如下:1. 初始化粒子群的位置和速度。

位置和速度的初始化可以是随机的,也可以根据问题的特点进行设置。

2. 计算每个粒子的适应度值。

适应度值表示解的优劣程度,可以根据问题的要求进行定义。

3. 更新粒子的速度和位置。

根据粒子的个体经验和群体经验,计算新的速度和位置。

4. 更新群体最优解。

根据粒子的适应度值更新群体最优解。

5. 判断终止条件。

可以是达到最大迭代次数或达到预定的适应度值。

6. 如果终止条件满足,则输出群体最优解;否则,返回第3步。

PSO算法具有以下特点:1. 算法简单易实现,不依赖于问题的具体形式,适用于多种优化问题。

2. 算法具有较快的搜索速度和较好的全局搜索能力。

3. 算法具有较少的参数,参数设置相对简单。

PSO算法在多个领域得到了广泛的应用,以下是一些典型的应用领域:1. 优化问题:PSO算法可以用于求解函数最优化问题,如函数极值、参数优化等。

2. 机器学习:PSO算法可以用于神经网络的训练、特征选择等问题。

3. 信号处理:PSO算法可以用于滤波、自适应控制等问题。

4. 图像处理:PSO算法可以用于图像分割、图像增强等问题。

5. 机器人路径规划:PSO算法可以用于机器人的路径规划、避障等问题。

总结:PSO粒子群算法是一种基于群体智能的优化算法,通过模拟群体行为来搜索最优解。

粒子群算法效率

粒子群算法效率粒子群算法(Particle Swarm Optimization, PSO)是一种群体智能算法,其灵感来源于鸟群捕食行为。

PSO算法通过模拟粒子在搜索空间中的移动来寻找问题的最优解。

它具有全局寻优能力强、算法简单且易于实现等优点,因此被广泛应用于各个领域。

粒子群算法的基本原理是通过维护一个粒子群,粒子群中的每个粒子表示搜索空间中的一个解,每个粒子都有自己的位置和速度。

在搜索过程中,每个粒子都会根据自身的经验和群体的经验来更新自己的位置和速度。

具体而言,粒子群算法包括以下几个步骤:1.初始化粒子群:确定粒子的初始位置和速度,一般是随机生成在搜索空间内的位置和速度。

2.计算适应度值:根据当前位置,计算每个粒子的适应度值,适应度值反映了粒子所对应解的优劣程度。

3.更新个体历史最优值:将每个粒子的当前位置和适应度值与其历史最优位置和适应度值进行比较,如果当前位置更优,则更新粒子的历史最优值。

4.更新全局最优值:将每个粒子的历史最优值与全局最优值进行比较,如果某个粒子的历史最优值更优,则更新全局最优值。

5.更新粒子速度和位置:根据当前速度、个体历史最优值和全局最优值来更新粒子的速度和位置。

6.判断停止条件:重复执行以上步骤,直到满足停止条件,例如达到最大迭代次数或找到满足要求的解。

粒子群算法的效率主要从以下几个方面进行评估:1.收敛速度:收敛速度是算法解决问题的效率指标,它反映了算法从初始状态到找到最优解所需的迭代次数。

粒子群算法通过合理的速度更新策略和适应度评估函数,能够较快地找到最优解,因此在收敛速度方面具有较高的效率。

2.局部搜索能力:粒子群算法具有全局寻优的能力,但在某些复杂问题中,初始种群的分布可能会导致算法陷入局部最优解,而无法找到全局最优解。

为了提高局部搜索能力,研究者提出了各种改进的粒子群算法,如自适应权重的PSO、混沌PSO等。

这些改进算法通过调整速度更新策略和搜索空间的探索程度,能够提高算法的效率。

基于粒子群优化的误差校准算法

基于粒子群优化的误差校准算法一、粒子群优化算法概述粒子群优化算法(Particle Swarm Optimization,简称PSO)是一种基于群体智能的优化技术,由Kennedy和Eberhart于1995年提出。

它模拟鸟群觅食行为,通过群体中个体之间的信息共享来寻找最优解。

PSO算法因其简单、鲁棒性好、易于实现等优点,在许多领域得到了广泛的应用。

1.1 粒子群优化算法的基本原理PSO算法中,每个个体称为粒子,粒子在解空间中搜索最优解。

每个粒子都有自己的位置和速度,并且会根据个体经验和群体经验来更新自己的位置和速度。

粒子的位置表示问题的潜在解,速度表示粒子移动的方向和距离。

1.2 粒子群优化算法的关键参数PSO算法的关键参数包括粒子速度、粒子位置、个体最优解和全局最优解。

个体最优解是指粒子自身历史上找到的最优解,全局最优解是指整个粒子群中所有粒子找到的最优解。

1.3 粒子群优化算法的更新规则粒子的位置和速度更新规则如下:- 速度更新:\[v_{i}^{t+1} = w \cdot v_{i}^{t} + c_1 \cdot r_1 \cdot (p_{i} - x_{i}^{t}) + c_2 \cdot r_2 \cdot (p_{g} - x_{i}^{t})\]- 位置更新:\[x_{i}^{t+1} = x_{i}^{t} + v_{i}^{t+1}\]其中,\(v_{i}^{t}\)和\(x_{i}^{t}\)分别表示粒子在第\(t\)时刻的速度和位置,\(p_{i}\)和\(p_{g}\)分别表示粒子的个体最优解和全局最优解,\(w\)是惯性权重,\(c_1\)和\(c_2\)是学习因子,\(r_1\)和\(r_2\)是随机数。

二、误差校准算法的应用背景误差校准算法在许多领域都有应用,如机器视觉、导航定位、传感器网络等。

误差校准的目的是减小或消除系统误差,提高系统的性能和精度。

传统的误差校准方法往往需要大量的实验数据和复杂的数学模型,而基于粒子群优化的误差校准算法提供了一种新的解决方案。

粒子群优化法-概述说明以及解释

粒子群优化法-概述说明以及解释1.引言1.1 概述粒子群优化法(Particle Swarm Optimization,简称PSO)是一种用于求解优化问题的启发式算法。

它模拟了鸟群或鱼群中的群体协作行为,通过不断更新粒子的位置和速度,逐步逼近最优解。

PSO算法最早由Russell Eberhart和James Kennedy于1995年提出,并在之后的二十多年里得到了广泛应用和研究。

PSO算法是一种简单但高效的优化算法,其灵感源于群体智能中的群体行为。

它通过模拟从鸟群和鱼群等自然界中观察到的协同行为,将搜索空间中的解表示为“粒子”,每个粒子根据自己当前的位置和速度信息动态调整,并通过与其他粒子的互动来引导搜索过程。

在PSO算法中,每个粒子都有自己的位置和速度,并且能够记忆并更新自己及其他粒子的最优解。

通过不断地根据历史最优值和邻域最优值进行位置和速度的更新,粒子能够在搜索空间中逐渐找到最优解。

PSO算法具有计算简单、易于实现、收敛速度较快等优点,能够应用于解决连续优化问题、离散优化问题以及多目标优化问题等多个领域。

总的来说,粒子群优化法是一种基于群体智能的优化算法,通过模拟自然界中群体的协同行为,实现了对复杂优化问题的求解。

在实际应用中,PSO算法已经在函数优化、图像处理、机器学习、工程设计等众多领域展现出了良好的性能和广阔的应用前景。

本文将详细介绍粒子群优化法的原理和应用领域,并探讨其优势和发展前景。

1.2文章结构1.2 文章结构本文将按以下顺序展开对粒子群优化法的深入研究和讨论:1.2.1 粒子群优化法的概述首先,我们将介绍粒子群优化法的概念以及其基本原理。

我们将讨论其运作方式,了解粒子群如何模拟鸟群在搜索问题中寻找全局最优解的行为。

1.2.2 粒子群优化法的应用领域接下来,我们将探讨粒子群优化法在不同领域中的广泛应用。

粒子群优化法已被应用于许多问题领域,包括函数优化、图像处理、数据挖掘等。

粒子群算法

粒子群算法(PSO)

算法在迭代30次后跳出循环,输出最优解为[0.0202,0.0426],此时目标函数值为 因为我们选用的例子为二次型规划,显然最优解为[0,0],最优值为0。 最后,我们用一个三维动画来展示一下粒子群算法的寻优过程。

粒子群算法(PSO)

一、粒子群算法的概述 粒子群算法(PSO)属于群智能算法的一种,是通过模拟鸟群捕食行为设计的。假设区域里就只有一块 食物(即通常优化问题中所讲的最优解),鸟群的任务是找到这个食物源。鸟群在整个搜寻的过程中,通 过相互传递各自的信息,让其他的鸟知道自己的位置,通过这样的协作,来判断自己找到的是不是最优解, 同时也将最优解的信息传递给整个鸟群,最终,整个鸟群都能聚集在食物源周围,即我们所说的找到了最 优解,即问题收敛。

粒子群算法(PSO)

粒子群算法(PSO)

粒子群算法(PSO)

粒子群算法(PSO)

粒子群优化算法(Particle Swarm Optimization,简称PSO), 由1995年Eberhart博士和Kennedy 博士共同提出,它源于对鸟群捕食行为的研究。粒子群优化算法的基本核心是利用群体中的个体对信息的 共享,从而使得整个群体的运动在问题求解空间中产生从无序到有序的演化过程,从而获得问题的最优解。 假设自己是一只身处鸟群中的鸟,现在要跟随头领去森林里找食物,我们每一只鸟都知道自己离食物的距 离,却又不知道食物在哪个方向。 所以,我们在森林里漫无目地的飞啊飞,每隔一段时间,大家会在微信群里共享一次各自与食物的距离。 然后鸟A发现自己与食物的距离是5公里,而群里鸟Z距离食物最近,只有50米的距离。 鸟A当机立断,在群里说:“我要去那看看!”然后一呼百应,鸟B、鸟C等都往鸟Z方向飞去,在鸟Z的周 围寻找食物。 就这样,本来大家都在沿着自己的方向飞,现在都要向鸟Z的位置靠拢,所以大家需要修改自己的飞行速 度和方向。 但是,当所有鸟儿准备调整自己的飞行轨迹时,鸟H突然想到:虽然现在鸟Z离食物只有50米,但是自己 曾经路过点P,那个位置离食物只有40米,所以它不知道自己是应该往点P方向还是往鸟Z的位置飞去。 鸟H就把自己的纠结发到了微信群里,然后大家一致决定,还是两者平衡一下,对两个位置进行矢量相加, 所以大家共同商量出了速度更新公式粒子群算法源自PSO)粒子群算法(PSO)

粒子群算法

粒子群算法粒子群算法(Particle Swarm Optimization,PSO)是一种群体智能优化算法,它模拟了鸟群觅食行为中个体在信息交流、合作与竞争中寻找最优解的过程。

粒子群算法在解决优化问题中具有较好的效果,尤其适用于连续优化问题。

粒子群算法的基本思想是模拟粒子在解空间中的移动过程,每个粒子代表一个候选解,粒子的位置表示解的一组参数。

每个粒子都有一个速度向量,表示粒子在解空间中的移动方向和速率。

算法的核心是通过更新粒子的位置和速度来搜索目标函数的最优解。

具体来说,粒子的位置和速度更新通过以下公式计算:$$v_i^{t+1} = w\cdot v_i^{t} + c_1 \cdot rand() \cdot (p_i^{best}-x_i^{t}) + c_2 \cdot rand() \cdot (p_g^{best}-x_i^{t})$$$$x_i^{t+1} = x_i^{t} + v_i^{t+1}$$其中,$v_i^{t}$是粒子$i$在时间$t$的速度,$x_i^{t}$是粒子$i$在时间$t$的位置,$p_i^{best}$是粒子$i$自身经历过的最好位置,$p_g^{best}$是整个种群中经历过的最好位置,$w$是惯性权重,$c_1$和$c_2$是加速度因子,$rand()$是一个0到1的随机数。

粒子群算法的优点在于简单、易于理解和实现,同时具有较好的全局搜索能力。

其收敛速度较快,可以处理多维、非线性和非光滑的优化问题。

另外,粒子群算法有较少的参数需要调节,因此适用于许多实际应用中的优化问题。

粒子群算法的应用领域非常广泛,包括机器学习、数据挖掘、图像处理、模式识别、人工智能等。

例如,在机器学习中,粒子群算法可以应用于神经网络的训练和参数优化;在数据挖掘中,粒子群算法可以用于聚类、分类和关联规则挖掘等任务;在图像处理中,粒子群算法可以用于图像分割、边缘检测和特征提取等;在模式识别中,粒子群算法可以用于目标检测和模式匹配等。

粒子群算法,输入输出

粒子群算法,输入输出

粒子群算法(Particle Swarm Optimization, PSO)是一种启发式优化算法,用于解决各种优化问题。

其输入和输出如下所述:

输入:

1. 问题定义,首先,需要明确定义优化问题,包括目标函数(需要最小化或最大化的函数)、约束条件(如果有的话)等。

2. 群体规模,确定粒子群中粒子的数量,这个数量通常由用户根据问题的复杂程度和计算资源来设定。

3. 最大迭代次数,确定算法运行的最大迭代次数,这有助于控制算法的运行时间和收敛性。

4. 初始解,确定粒子群中每个粒子的初始位置和速度,通常是随机生成的。

输出:

1. 最优解,算法的输出是找到的最优解,即使问题是最小化目标函数,也可以通过取其相反数来得到最大化目标函数的最优解。

2. 最优解对应的目标函数值,输出最优解对应的目标函数值,这是评价最优解优劣的重要指标。

3. 其他信息,有些实现可能还会输出收敛曲线、粒子的最优轨迹等额外信息,用于分析算法的性能和行为。

总之,粒子群算法的输入包括问题定义、群体规模、最大迭代次数和初始解,而输出则是找到的最优解及其对应的目标函数值。

在实际应用中,PSO算法可以根据具体问题进行调参和优化,以获得更好的结果。

pso算法代码

PSO算法代码1. PSO算法简介1.1 什么是PSO算法粒子群优化算法(Particle Swarm Optimization,简称PSO)是一种基于群体智能的随机优化算法。

它通过模拟鸟群觅食时个体间的信息共享和协同行为,在搜索空间中寻找最优解。

1.2 PSO算法原理PSO算法基于群体智能和其自适应能力,具有快速、全局搜索和简单的特点。

其基本原理如下: 1. 初始化粒子群,设置群体大小、位置和速度范围等参数。

2. 评估每个粒子的适应度,根据适应度确定个体最优解。

3. 更新全局最优解和个体最优解。

4. 根据公式更新粒子的速度和位置。

5. 重复步骤2-4,直到满足停止条件。

2. PSO算法代码实现2.1 PSO算法的伪代码以下是PSO算法的伪代码:初始化粒子群的位置和速度初始化全局最优解while (满足停止条件) dofor each 粒子 in 粒子群 do计算粒子的适应度更新个体最优解更新全局最优解for each 粒子 in 粒子群 do更新粒子速度更新粒子位置end while2.2 PSO算法的Python代码实现以下是一个简单的PSO算法的Python代码实现:import randomdef f(x):# 定义适应度函数,根据具体问题进行调整return x ** 2class Particle:def __init__(self, dim):self.position = [random.uniform(-5, 5) for _ in range(dim)]self.velocity = [random.uniform(-1, 1) for _ in range(dim)]self.best_position = self.positionself.best_fitness = f(self.position[0])class PSO:def __init__(self, dim, size, max_iter):self.dim = dimself.size = sizeself.max_iter = max_iterself.population = [Particle(dim) for _ in range(size)]self.global_best_position = self.population[0].positionself.global_best_fitness = self.population[0].best_fitnessdef update_particle(self, particle):# 更新粒子速度for i in range(self.dim):particle.velocity[i] = particle.velocity[i] + 2 * random.random() * \(particle.best_position[i] - particle.position[i]) + \2 * random.random() * (self.global_best_position[i] - particle. position[i])# 更新粒子位置for i in range(self.dim):particle.position[i] = particle.position[i] + particle.velocity[i]# 更新粒子最优解fitness = f(particle.position[0])if fitness < particle.best_fitness:particle.best_position = particle.positionparticle.best_fitness = fitness# 更新全局最优解if fitness < self.global_best_fitness:self.global_best_position = particle.positionself.global_best_fitness = fitnessdef optimize(self):for _ in range(self.max_iter):for particle in self.population:self.update_particle(particle)if __name__ == '__main__':pso = PSO(dim=1, size=50, max_iter=100)pso.optimize()print("Global Best:", pso.global_best_position, pso.global_best_fitness)3. PSO算法应用实例3.1 函数最小化问题假设有一个函数 f(x) = x^2,在定义域 [-5, 5] 内寻找最小值。

粒子群算法概述

“只有自我,没有社会” 完全没有信息的社会共享 导致算法收敛速度缓慢

粒子群算法的构成要素-权重因子 权重因子:惯性因子 、学习因子

k k-1 k 1 k 1 vid =wvid c1r1 ( pbestid xid ) c2r2 ( gbestd xid )

线性递减权值

run w wmax ( wmax wmin )* runmax

wmax最大惯性权重,wmin最小惯性权重,run当前迭代次 数,runmax为算法迭代总次数 较大的w有较好的全局收敛能力,较小的w则有较强的 局部收敛能力。因此,随着迭代次数的增加,惯性权重w 应不断减少,从而使得粒子群算法在初期具有较强的全局 收敛能力,而晚期具有较强的局部收敛能力。

k vid —第k次迭代粒子i飞行速度矢量的第d维分量 k xid —第k次迭代粒子i位置矢量的第d维分量

v =wv c1r1 ( pbestid x ) c2r2 ( gbestd x )

k id k-1 id

k 1 id

k 1 id

粒子速度更新公式包含三部分: 第一部分为粒子先前的速度 第二部分为“认知”部分,表示粒子本身的思考,可理解为 粒子i当前位置与自己最好位置之间的距离。 第三部分为“社会”部分,表示粒子间的信息共享与合作, 可理解为粒子i当前位置与群体最好位置之间的距离。

粒子群优化算法求最优解

D维空间中,有N个粒子;

粒子i位臵:xi=(xi1,xi2,…xiD),将xi代入适应函数f(xi)求适应值;

粒子i速度:vi=(vi1,vi2,…viD) 粒子i个体经历过的最好位臵:pbesti=(pi1,pi2,…piD)

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

(1)式 那么找到食物的最优策略是什么 Vi Vi c1 rand () ( pbesti xi ) c2 rand () ( gbesti xi ) (2)式

?

最简单有效的就是搜寻目前离食物最近的鸟的 xi xi Vi 周围区域。 在式 (1)、(2)中,i=1,2,…,M,M是该群体中粒子

公式 (2) 和 (3)被视为标准 pso 算法。 在式 (1)、 (2) 中, i=1,2,…, M, M是该群体中粒子 的总数

算法介绍 算法介绍

标 准 PSO算法的流程: (随机解)。然后通过迭代找到最 PSO 初始化为一群随机粒子 Step1: 初始化一群微粒(群体规模为m),包括随机位置和 优解。在每一次的迭代中,粒子通过跟踪两个“极值” (pb est,gbest) 来更新自己。 速度; x x V 在找到这两个最优值后,粒子通过下面的公式来更新自己 Step2: 评价每个微粒的适应度; 的速度和位置。 Step3: 对每个微粒,将其适应值与其经过的最好位置 (1)式 pbest作比较,如果较好,则将其作为当前的 Vi 最好位置 Vi c1 rand () ( pbesti xi ) c2 rand () ( gbesti xi ) pbest; (2)式 对每个微粒,将其适应值与其经过的最好位置 Step4: gbest 作比较,如果较好,则将其作为当前的 xi x V i i 最好位置gbest; 在式(1)、(2)中,i=1,2,…,M,M是该群体中粒子 Step5:根据(2)、(3)式调整微粒速度和位置; 的总数 Step6:未达到结束条件则转Step2。

的总数

算法介绍

算法介绍 算法介绍

抽象: PSO初始化为一群随机粒子(随机解)。然后通过迭代找到最 鸟被抽象为没有质量和体积的微粒 (点),并延伸到N维 优解。在每一次的迭代中,粒子通过跟踪两个“极值”(pb 空间,粒子 I 在N维空间的位置表示为矢量Xi=(x1,x est,gbest)来更新自己。 x , ,…,xN),飞行速度表示为矢量Vi=x(v 2在找到这两个最优值后,粒子通过下面的公式来更新自己 1 V v2,…,v ).每个粒子都有一个由目标函数决定的适应值(fitne N的速度和位置。 ss value) ,并且知道自己到目前为止发现的最好位置 (1) 式 (pbest) 和现在的位置 Xi .这个可以看作是粒子自己的 V V c rand () ( pbest i i 1 i xi ) c2 rand () ( gbesti xi ) 飞行经验.除此之外,每个粒子还知道到目前为止整个 (2)式 群体中所有粒子发现的最好位置(gbest)(gbest是pbest x x V i i 中的最好值)i .这个可以看作是粒子同伴的经验.粒子 在式 (1)、(2)中,i=1,2,…,M,M是该群体中粒子 就是通过自己的经验和同伴中最好的经验来决定下一步 的总数 的运动。

在式 (1)、 (2)中, i= 1, , …,M,M是该群体中粒子 以上面 两个 公式 为 基2 础 ,形成了后 来PSO 的总数 的标准形式

的速度和位置。

xi xi Vi

算法介绍 算法介绍

从社会学的角度来看,公式(1)的第一部分称为记忆项, PSO初始化为一群随机粒子(随机解)。然后通过迭代找到最 表示上次速度大小和方向的影响;公式第二部分称为自 优解。在每一次的迭代中,粒子通过跟踪两个“极值”(pb 身认知项,是从当前点指向粒子自身最好点的一个矢量, est,gbest)来更新自己。 x x V 表示粒子的动作来源于自己经验的部分;公式的第三部 在找到这两个最优值后,粒子通过下面的公式来更新自己 的速度和位置。 分称为群体认知项,是一个从当前点指向种群最好点的 矢量,反映了粒子间的协同合作和知识共享。粒子就是 (1)式 通过自己的经验和同伴中最好的经验来决定下一步的运 Vi Vi c1 rand () ( pbesti xi ) c2 rand () ( gbesti xi ) 动。 (2)式

粒子群优化算法 PSO

算法介绍 算法介绍

PSO初始化为一群随机粒子(随机解)。然后通过迭代找到最 粒子群优化算法(PSO)是一种进化计算技术(e 优解。在每一次的迭代中,粒子通过跟踪两个“极值”(pb volutionary computation),由Eberhart博士和k est,gbest)来更新自己。 ennedy 博士于 1995 年提出 (Kennedy xJ , Eberhart R. x V 在找到这两个最优值后,粒子通过下面的公式来更新自己 Particle swarm optimization.Proceedings of the IEEE Internati 的速度和位置。

onal Conference on Neural Networks.1995.1942~1948.)。源

算法介绍 算法介绍

设想这样一个场景:一群鸟在随机的搜索食物。 PSO初始化为一群随机粒子(随机解)。然后通过迭代找到最 优解。在每一次的迭代中,粒子通过跟踪两个“极值”(pb 在这个区域里只有一块食物,所有的鸟都不知 est,gbest)来更新自己。 道食物在那。但是它们知道自己当前的位置距 在找到这两个最优值后,粒子通过下面的公式来更新自己 离食物还有多远。 的速度和位置。

假设种群大小是N=3;在搜索空间中随机 更新粒子的历史最优位置和全局的最优位置。 v v c r ( pBest x ) c r ( gBest x ) 初始化每个解的速度和位置,计算适应函 0 * 2.5 3 0 0 1.5 2 p v (1.5,1) f1 89 f 9.5 ( 4) 90.25 16 106.25 1 数值,并且得到粒子的历史最优位置和群 0 . 5 2 0 0 1 x x v (8,5) (1.5,1) (9.5,4) 体的全局最优位置。 f1 89 2 2 步骤 v2 v,22 c1 r1 f ( pBest x )5) c r64 gBest 89 x2 ) 8 ( 25 2 2 2 2 ( v ( 3 ) 4 : 1 1 pBest = (8, 5) p1 1 0 2 0.3 (8 (5)) 6.1 0.5 (3) p v (6.1,1.8) pBest x5 (8, 5) 2 2 x ( 8 , 5 ) 1.1 2 1 0.1.21 5 (2 ) 0 2 0 ((1 9) 1.8 f2* 如果满足结束条件,则输出 1.1 102 100 101.21 )106 f2 x x v (5,9) (6.1,1.8) 2(1.1,10 2 .8) (1.1,10) 1 1 1 全局最优结果并结束程序, * f ( 5) 9 25 81 106 v ( 3 , 2 ) 2 2 101.21 f2 f2 p 注意! 2 否则,转向步骤 对于越界的位置,需要进行合法性调整 x2 (5,9) 继续执行。 (5,9) pBest2 2 2X 2x pBest 2 (1.1,10) x3 ) c 2 r ( gBest x3 ) v3 v3 c1 r1 ( pBest3 2 22 * 2 2 7) 49 64 113 v3 ( (1.7) 5 ,.3 f3 5) 512.25 0 2 0( .05 15.14 (8 ( ( 8) 7)) 3 . 5 f3 f3 p ( 3.5) 2.89 113 0 p3 3 2 0.8 ((5) (8)) 6.3 (3.5,6.3) v3 0 . 5 3 0 * x15.14 ( 7,8) pBest3 x3 (7, 8) f3 f3 x3 x v (7,8) (3.5,6.3) (3.5,1.7) 1 1 1 3.5, 1.7) w是惯量权重,一般取 [0,1]区间的数,这里假设为0.5 3 x3 ( pBest gBest pBest1 2.0 (8, 5) c1和c2为加速系数,通常取固定值 gBest pBest3 (3.5, 1.7)

xi xi Vi

c1和c2是学习因子,通常取c1= c2=2 (1)式 在每一维,粒子都有一个最大限制速度 Vmax,如果 Vi Vi c1 rand () ( pbest c2 rand () ( gbesti xi ) i xi ),那么这一维的速度 某一维的速度超过设定的 Vmax (2)式 就被限定为 Vmax 。( Vmax >0)

i i i

算法介绍 算法介绍

PSO初始化为一群随机粒子(随机解)。然后通过迭代找到最 代找到最优解。在每一次的迭代中,粒子通过跟踪 优解。在每一次的迭代中,粒子通过跟踪两个“极值” (pb 两个“极值” (pbest,gbest)来更新自己。 est,gbest) 来更新自己。 x x V x x V 在找到这两个最优值后,粒子通过下面的公式来更新自己 在找到这两个最优值后,粒子通过下面的公式来更 的速度和位置。 新自己的速度和位置。

i i i

算法介绍

迭代终止条件根据具体问题一般选为最大迭代 次数Gk或(和)微粒群迄今为止搜索到的最优位置 满足预定最小适应阈值。

PSO算法流程图和伪代码

开始 随机初始化每个粒子 评估每个粒子并得到全局最优 是 //功能:粒子群优化算法伪代码 //说明:本例以求问题最小值为目标 //参数:N为群体规模 procedure PSO for each particle i Initialize velocity Vi and position Xi for particle i Evaluate particle i and set pBesti = Xi end for gBest = min {pBesti} while not stop for i=1 to N Update the velocity and position of particle i Evaluate particle i if fit (Xi) < fit (pBesti) pBesti = Xi; if fit(pBesti) < fit (gBest) gBest = pBesti; end for end while print gBest end procedure