模式识别之二次和线性分类器

模式识别基本词汇名词解释

基本词汇

• 先验概率:预先已知的或者可以估计的模式识别系 统位于某种类型的概率。

• 类条件概率密度函数:系统位于某种类型条件下模 式样本X出现的概率密度分布函数。

• 后验概率:系统在某个具体的模式样本X条件下位 于某种类型的概率。

• 贝叶斯公式:两个事物X与w联合出现的概率称为联

合概率。利用该公式可以计算后验概率。

基本词汇

• 判别函数:是一组与各类别有关的函数,对 每一个样本可以计算出这组函数的所有函数 值,然后依据这些函数值的极值(最大或最 小)做分类决策。

• 决策域与决策面:根据判别函数组中哪一个 判别函数值为极值为准则可将特征空间划分 成不同的区域,称为决策域,相邻决策域的 边界是决策分界面或称决策面。

基本词汇

• 线性分类器:判别函数为线性函数的分类器 是线性分类器,此时决策分界面的方程是线 性方程。

• 非线性分类器:是非参数分类器的一种,其 中判别函数或决策面方程是某种特定的非线 性函数,如二次函数,多项式函数等。

• 分段线性分类器:相邻决策域的界面用分段 线性函数表示的分类器。

基本词汇

• 感知准则函数:是线性分类器的另一种著名 设计方法。该种方法通过迭代优化确定最佳 分界面。其特点是利用错分类信息对当前的 分界面进行修正。

基本词汇

• 参数估计:使用贝叶斯决策要知道先验概率,类分 布密度函数等统计参数,为此,要从训练样本集中 估计出这些统计参数,这就是参数估计。

• 非参数估计:在分布密度函数形式也不确定条件下 ,估计统计参数,称为非参数估计。

• 非参数分类器:不以统计参数为分类决策依据的分 类决策方法称为非参数分类器, 线性分类器、非线 性分类器以及近邻分类器都属于这种分类器,它们 不需要统计参数。

[数学]模式识别方法总结

![[数学]模式识别方法总结](https://img.taocdn.com/s3/m/9bfe35a6a0116c175f0e484a.png)

假定有m个类别ω1, ω2, …, ωm的模式识别问题,

每类有Ni(i=1, 2, …, m)个样本, 规定类ωi的判别函数

为

gi (x) min x xik

i

k 1, 2,

, Ni

其中, xki表示第i类的第k个元素。 判决准则: gi (x) ,则x∈ω 若 g j (x) i min j 1,2, , m

定义Fisher线性判决函数为

( 1 2 )2 J F (w ) S1 S2

分子反映了映射后两类中心的距离平方,

该值越大, 类间可

分性越好;

分母反映了两类的类内离散度,

从总体上来讲,

其值越小越好;

JF(w)的值越大越好。 使JF(w)达到最大值的w即为最

在这种可分性评价标准下,

如果P(ω1|x)<P(ω2|x), 则判决x属于ω2;

如果P(ω1|x)=P(ω2|x), 则判决x属于ω1或属于ω2。

这种决策称为最大后验概率判决准则, 也称为贝叶斯 (Bayes)判决准则。 假设已知P(ωi)和p(x|ωi)(i=1, 2, …, m), 最大后验概率判 决准则就是把样本x归入后验概率最大的类别中, 也就是,

0

Sigmoid (a) 取值在(0, 1)内; (b) 取值在(-1, 1)内

神经网络结构 神经网络是由大量的人工神经元广泛互连而成 的网络。 根据网络的拓扑结构不同, 神经网络可分

R( j | x) ( j , i ) P(i | x)

i 1 m

最小风险贝叶斯判决准则: 如果

R( k | x) min R( j | x)

j 1, 2 ,, m

模式识别--第二讲 线性分类器

第 1 页第二讲 线性分类器一、 判别函数1、 决策论方法在模式识别中,如果根据模式特征信息,按照决策论的思路,以一定的数量规则来采取不同的分类决策,将待识别的模式划分到不同的类别中去,就称为模式识别的决策论方法。

在决策论方法中,特征空间被划分成不同的区域,每个区域对应一个模式类,称为决策区域(Decision Region )。

当我们判定待识别的模式位于某个决策区域时,就判决它可以划归到对应的类别中。

图1 决策区域需要注意的是:决策区域包含模式类中样本的分布区域,但不等于模式类的真实分布范围。

2、 判别函数如果特征空间中的决策区域边界(Decision Boundary )可以用一组方程0)( x i G来表示,则将一个模式对应的特征向量x 代入边界方程中的)(x i G ,确定其正负符号,就可以确定该模式位于决策区域边界的哪一边,从而可以判别其应当属于的类别,)(x i G 称为判别函数(Discriminant Function )。

判别函数的形式可以是线性的(Linear )或非线性(Non-linear)的。

第 2 页例如图2就显示了一个非线性判别函数,当G (x )>0时,可判别模式x ∈ω1;当G (x )<0时,可判别x ∈ω2。

图2 非线性判别函数非线性判别函数的处理比较复杂,如果决策区域边界可以用线性方程来表达,则决策区域可以用超平面(Hyperplane )来划分,无论在分类器的学习还是分类决策时都比较方便。

例如图3中的特征空间可以用两个线性判别函数来进行分类决策:当G 21(x )>0且G 13(x )>0时,x ∈ω2; 当G 13(x )<0且G 21(x )<0时,x ∈ω3; 当G 21(x )<0 且 G 13(x )>0时,x ∈ω1;当G 21(x )>0且G 13(x )<0时,x 所属类别无法判别。

模式识别第二章(线性判别函数法)

2类判别区域 d21(x)>0 d23(x)>0 3类判别区域 d31(x)>0 d32(x)>0

0 1 2 3 4 5 6 7 8 9

x1

d23(x)为正

d32(x)为正

d12(x)为正

d21(x)为正

32

i j 两分法例题图示

33

3、第三种情况(续)

d1 ( x) d2 ( x)

12

2.2.1 线性判别函数的基本概念

• 如果采用增广模式,可以表达如下

g ( x) w x

T

x ( x1 , x 2 , , x d ,1)

w ( w1 , w 2 , , w d , w d 1 ) T

T

增广加权向量

2016/12/3

模式识别导论

13

2.1 判别函数(discriminant function) 1.判别函数的定义 直接用来对模式进行分类的准则函数。

模式识别导论

11

2.2.1 线性判别函数的基本概念

• 在一个d维的特征空间中,线性判别函数的

一般表达式如下

g ( x ) w1 x1 w 2 x 2 w d x d w d 1

g ( x ) w x w d 1

T

w为 加 权 向 量

2016/12/3

模式识别导论

1

d1 ( x ) d3 ( x )

2

3

d2 ( x) d3 ( x)

34

多类问题图例(第三种情况)

35

上述三种方法小结:

当c

但是

3 时,i j

法比

i i

法需要更多

模式识别第4章 线性判别函数

w1。

44

4.3 判别函数值的鉴别意义、权空间及解空间 4.3.2 权空间、解矢量与解空间

(3) 解空间

w1

先看一个简

单的情况。设一

维数据1,2属于

w0

1, -1,-2属

于2 求将1和

2区分开的w0 ,

w1。

45

4.3 判别函数值的鉴别意义、权空间及解空间 4.3.2 权空间、解矢量与解空间

(3) 解空间

53

第四章 线性判别方法

4.1 用判别域界面方程分类的概念

有 4.2 线性判别函数 监 4.3 判别函数值的鉴别意义、权空间及解空间 督 4.4 Fisher线性判别 分 4.5 一次准则函数及梯度下降法 类 4.6 二次准则函数及其解法

4.7 广义线性判别函数

54

4.4 Fisher线性判别

这一工作是由R.A.Fisher在1936年的论文中 所提出的,因此称为Fisher线性判别方法。

0123456789

x1

d23(x)为正

d32(x)为正 d12(x)为正 d21(x)为正

i j两分法例题图示

24

25

3、第三种情况(续)

d1(xr) d2(xr)

1

2

d1(xr ) d3(xr )

3

d2 (xr ) d3(xr )

多类问题图例(第三种情况)

26

27

上述三种方法小结:

8

4.2 线性判别函数

9

10

11

d3(xr) 0

不确定区域

r

xr xrxr xr xr

x2

?

d1(x) 0

1

2

3

x1 d2(xr ) 0

模式识别之二次和线性分类器课件

线性分类器利用训练数据集学习得到 一个线性函数,该函数可用于对新数 据进行分类。分类决策边界是一个超 平面,将不同类别的数据分隔开来。

线性分类器数学模型

线性函数

优化目标

正则化

线性分类器使用的线性函数通 常表示为权重向量和特征向量 的内积加上偏置项,即y = w^Tx + b,其中y是预测类别 ,w是权重向量,x是特征向量 ,b是偏置项。

模式识别之二课次件和线性分类器

contents

目录

• 引言 • 二次分类器原理 • 线性分类器原理 • 二次与线性分类器比较 • 二次和线性分类器应用案例 • 总结与展望

01

引言

模式识别概述

模式

01

在感知或观察事物时,人们所发现的事物之间规律性的关系或

特征。

模式识别

02

利用计算机对输入的信号进行分类或描述,以实现自动识别目

01

深度学习在模式识别 中的应用

深度学习技术为模式识别提供了新的 解决方案,能够自动提取数据的深层 特征,提高识别精度。

02

多模态数据融合

利用多模态数据融合技术,将不同来 源、不同类型的数据进行融合,提高 模式识别的性能和鲁棒性。

03

迁移学习在模式识别 中的应用

迁移学习技术可以将在一个任务上学 到的知识迁移到另一个任务上,从而 加速模型训练,提高识别效率。

自然语言处理领域应用案例

1 2

文本分类

通过训练二次和线性分类器,对文本进行分类, 如新闻、广告、评论等,提高信息处理的效率。

情感分析

利用分类器对文本中的情感进行识别和分析,为 企业了解用户需求、改进产品提供参考。

3

机器翻译

结合分类器对源语言进行识别和转换,实现不同 语言之间的自动翻译,促进跨语言交流。

模式识别:线性分类器

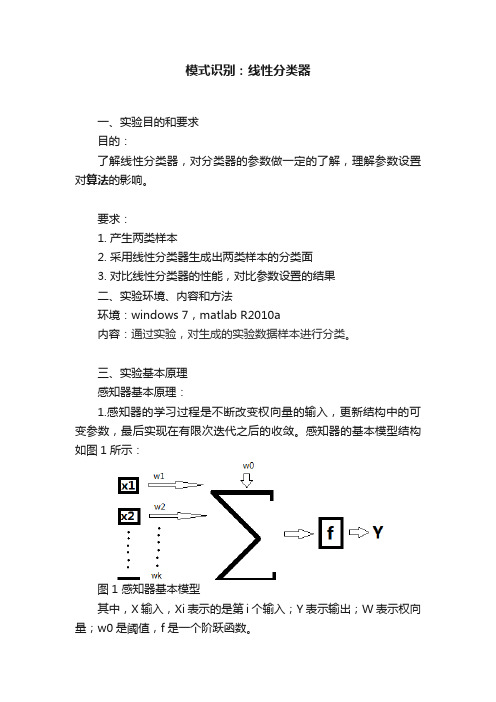

模式识别:线性分类器一、实验目的和要求目的:了解线性分类器,对分类器的参数做一定的了解,理解参数设置对算法的影响。

要求:1. 产生两类样本2. 采用线性分类器生成出两类样本的分类面3. 对比线性分类器的性能,对比参数设置的结果二、实验环境、内容和方法环境:windows 7,matlab R2010a内容:通过实验,对生成的实验数据样本进行分类。

三、实验基本原理感知器基本原理:1.感知器的学习过程是不断改变权向量的输入,更新结构中的可变参数,最后实现在有限次迭代之后的收敛。

感知器的基本模型结构如图1所示:图1 感知器基本模型其中,X输入,Xi表示的是第i个输入;Y表示输出;W表示权向量;w0是阈值,f是一个阶跃函数。

感知器实现样本的线性分类主要过程是:特征向量的元素x1,x2,……,xk是网络的输入元素,每一个元素与相应的权wi相乘。

,乘积相加后再与阈值w0相加,结果通过f函数执行激活功能,f为系统的激活函数。

因为f是一个阶跃函数,故当自变量小于0时,f= -1;当自变量大于0时,f= 1。

这样,根据输出信号Y,把相应的特征向量分到为两类。

然而,权向量w并不是一个已知的参数,故感知器算法很重要的一个步骤即是寻找一个合理的决策超平面。

故设这个超平面为w,满足:(1)引入一个代价函数,定义为:(2)其中,Y是权向量w定义的超平面错误分类的训练向量的子集。

变量定义为:当时,= -1;当时,= +1。

显然,J(w)≥0。

当代价函数J(w)达到最小值0时,所有的训练向量分类都全部正确。

为了计算代价函数的最小迭代值,可以采用梯度下降法设计迭代算法,即:(3)其中,w(n)是第n次迭代的权向量,有多种取值方法,在本设计中采用固定非负值。

由J(w)的定义,可以进一步简化(3)得到:(4)通过(4)来不断更新w,这种算法就称为感知器算法(perceptron algorithm)。

可以证明,这种算法在经过有限次迭代之后是收敛的,也就是说,根据(4)规则修正权向量w,可以让所有的特征向量都正确分类。

第4章 线性分类器

用上列方程组作图如下:

软件工程专业

0 .5

1

0 .5

g1 ( x) g 2 ( x) g1 ( x) g 3 ( x)

2

g 2 ( x ) g1 ( x ) g 2 ( x) g 3 ( x)

1 .0

g1 ( x) g3 ( x) 0

g21 ( x) 2, g31 ( x) 1, g32 ( x) 1

g3 j ( x) 0 因为 结论:所以X 属于ω 3类

5

2 判别区

x2 g 21 0

g 23 0

1判别区

g13 0

g23 ( x) 0

g12 ( x) 2, g13 ( x) 1, g 23 ( x) 1 g12 0

1

x1

边界

3

例如右上图:三类的分类问题,它 们的边界线就是一个判别函数

用判别函数进行模式分类,取决两个因素: 软件工程专业

判别函数的几何性质:线性与非线性 判别函数的参数确定:判别函数形式+参数 一类是线性判别函数:

线性判别函数:线性判别函数是统计模式识别的基本 方法之一,简单且容易实现 广义线性判别函数 所谓广义线性判别函数就是把非线性判别函数映射到 另外一个空间(高维)变成线性判别函数 分段线性判别函数

模式识别

软件工程专业 计算机与通信工程学院 计算机与通信工程学院

第四章 线性分类器

4.1 判别函数

假设对一模式X已抽取n个特征, 表示为: X ( x1 , x2 , x3 ,..., xn )T

软件工程专业

x2

2

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

• 同样,若f是单调增函数,则 •

它和 也是等价的判别函数。

• 这些性质可以使我们从一组判别函数推导出 另外的判别函数,以便计算上更加简单,或 者意义更清楚,便于理解。

2. 多类的二次和线性分类器 • 当每类都是正态分布,其均值和协方差矩 阵分别为mk和Kk时,这时的最小错误率决 策规则的判别函数为:

若

(※)

式中

•

称为判别函数(discriminant function

)。它表示决策规则。

• 由贝叶斯公式,

和

等价。即把

用在(※)式中时,决

策结果和

是一样的。

• 当先验概率相等时,p(x|ωk)也是一组等价的 判别函数。

• 一般地,若 下面定义的 :

是任意一组判别函数,则 也是一组等价的判别函数

• a>0,b是常数。(也可以是x的函数,但不 能是k的函数。)

• 由于自然对数是单调增的,所以可以定义 下面等价的判别函数:

(※)

• 这是二次判别函数。当所有类的先验概率相

等时,可以省略

。

• 前面已经证明,当两类的协方差矩阵相等时 ,二次分类器退化为线性分类器。多类时也 是如此。

•当

时,(※)式化为:

• 上式中,由于第一项和第四项对所有的类都 是相同的,所以等价的一组判别函数为:

• 上式是x的线性函数。

(※※)

• 下面考虑一些特定情况,说明二次和线性分 类器的应用。

• 以下假定各类的先验概率都相等。

• 例2:最小距离分类器。假定各类的先验概率

相等,而且各类

,

即x的各个分量不相关,且各类等方差。

解:这时的判别函数化为(P22(※)式 ):

• 后两项对所有类是共同的,可以省略。分母 中的 也可以去掉,因而有等价的判别函数 :

• 即使我们得到了密度函数,有时用似然比检 验的方法也很难计算,需要大量的时间和空 间。

• 因此我们有时考虑更简便易行的分类器设计 方法。用二次、线性、分段线性分类器。即 先规定分类器的数学形式,然后在适当的准 则下,来确定这些参数。

• 这一节先分析在什么条件下贝叶斯分类器变 成二次和线性分类器,然后讨论当这些条件 不满足时,如何设计“性能好”的参数分类器 。

• 上述例子是通信理论中信号检测的一个经典 例子。

• 假定有Nc种已知信号要检测。令x(t)表示接 收到的信号,mk(t)是已知的信号,k=1,2, …,Nc 。当mk(t)发送时,加入了白噪声w(t) ,

即:

• 白噪声w(t)是零均值、等方差、不相关的信

号(随机过程)。即在任意时刻ti,w(ti)的

• 这时的决策规则的含义是:x离哪类的均值 最近,就把它分到哪类。

• 例3 :内积分类器(相关分类器)

假定

。利用线性判别函数

有

• 若进一步假定每类的均值的模相等,即|mk| 相等,它们分布在半径为|mk|的一个超球面 上,且由于假定先验概率也相等,因此,等 价的判别函数为:

• 即将测量向量x和每类的均值mk作内积(或称 相关),然后选择值最大的,作为它的类。

• 当x落到决策边界的某一侧时,就把它分到 相应的类。也可以把上述二次分类器用到非 高斯分布的密度函数,但这时不能保证错误 率最小。(但所确定的边界是和二阶统计矩 (均值、方差)最相匹配的。)

• 任何具有(※※)式的分类器都叫作二次分 类器。只有A、b、c是由高斯密度函数确定 时,才叫高斯分类器。

• 例1:两维时的二次分类器的决策边界 假定两类模式都是高斯分布的,参数为:

求

的分类边界,并画出其曲线

。

• 解:

假定T=0,h(x)=T=0化为:

,是一双曲线 。

• 当先验概率相等时,最小错误率决策规则选 择密度函数大的。

• 由于第二类在x2方向上的方差大于类1的,这 样密度函数p(x|ω2)在x2方向上将有较广的延 伸。使得在左边R2区域内有p(x|ω2) > p(x|ω1) ,尽管这些点比较靠近类1的均值点。

模式识别之二次和线性 分类器

2020年4月28日星期二

• 这一节的目的(概念)有两个:

▪ 在一定的分布和条件下(如正态、等协方 差矩阵),贝叶斯决策可以导致二次或线 性分类器。

▪ 虽然贝叶斯决策(似然比检验)在错误率 或风险上是最优的,但必须知道类条件密 度。在大多数应用场合,类条件密度函数 是从有限的样本中估计的。后面我们将讲 一些密度函数估计的方法。但密度函数的 估计本身是一件复杂工作(其难度不低于 分类)并且需要大量样本。

• 在一维时,马氏距离 用方差标准化的一般距离。

• 展开h(x)式,有

,即比较 (※※)

• 式中

• 决策边界h(x)=T是二次曲面(超曲面):超 椭球面、超双曲面、超抛物面、超平面等, 或它们组合的形式。

• (为了确定二次曲面的形状,首先要消掉x的各分

量相乘的项,可采用旋转坐标系的方法,把坐标轴 旋转到A(※※)的特征向量的方向。曲面的几何 形状由A的特征值决定。如果A的特征值全部是正 的,则是超椭球面;如果特征值有些正,有些负, 则是超双曲面;如果有些特征值是0,则是超抛物 面。)

• 在前面的h(x)=方差矩阵相等,K1= K2= K,则矩阵A=0, 这时决策规则为:

式中

• 这时的决策边界就退化为线性决策边界(超 平面),相应的分类器为线性分类器。

二. 判别函数和多类分类器

1. 判别函数

• 当模式有

类,这时的最小错误率的

决策规则可以表示为:

一. 两类问题的二次和线性分类器

对于似然比检验的决策规则:

• 当各类的类条件密度是高斯分布时, • mi和Ki为均值向量和协方差矩阵。

• 这时似然比为

定义

,-2倍自然对数,则:

• 上式是二次分类器。计算x到各类均值mi的 Mahalanobis距离,然后和阈值 相比较,决定x属于第一或第二类。

均值为0,方差为 ,且当

时,

。

• 如果随机向量x和mk是由相应的时间函数取 样而成,即

• 这是一个相关分类器(内积分类器)的模式 识别问题。

• 假定|mk|2相等,即所有的信号具有相等的 能量。

• 把接收到的信号和已知信号作相关mkTx,然 后选择相关最大的。作相关时通常通过一个 “匹配滤波器”来实现。

匹配滤波器1 匹配滤波器2

┇

匹配滤波器Nc

选择最大 的输出