算术编码

ans算术编码

ANS(Asymmetric Numeral System)是一种熵编码算法,与哈夫曼编码(Huffman Coding)和算术编码(Arithmetic Coding)并列为常用三种熵编码算法。

ANS编码是一种自适应的编码技术,它可以根据输入数据的特性自动调整编码参数,以达到最佳的编码效果。

在ANS编码中,输入数据被表示为一个实数范围[0,1]内的浮点数,通过对这个浮点数进行量化、缩放和编码等操作,可以得到一个二进制编码。

在ANS编码中,输入数据被分为多个符号,每个符号都有一个概率和相应的量化参数。

编码器会根据这些参数和概率信息,计算出一个最优的量化值,使得编码后的数据与原始数据的误差最小。

在编码过程中,编码器还会不断调整量化参数,以适应输入数据的变化。

与哈夫曼编码和算术编码相比,ANS编码具有更高的压缩比和更好的适应性。

它可以根据输入数据的特性自动调整编码参数,以达到最佳的压缩效果。

同时,ANS编码还具有更快的解码速度和更低的解码复杂度。

需要注意的是,ANS编码是一种比较复杂的熵编码算法,需要一定的技术背景和经验才能掌握。

在实际应用中,需要根据具体的数据特性和应用场景来选择合适的熵编码算法。

算术编码与解码

算术编码与解码1、编码过程算术编码方法是将被编码的一则消息或符号串(序列)表示成0和1之间的一个间隔(Interval),即对一串符号直接编码成[0,1]区间上的一个浮点小数。

符号序列越长,编码表示它的间隔越小,表示这一间隔所需的位数就越多。

信源中的符号序列仍然要根据某种模式生成概率的大小来减少间隔。

可能出现的符号概率要比不太可能出现的符号减少范围小,因此,只正加较少的比特位。

在传输任何符号串之前,0符号串的完整范围设为[0,1]。

当一个符号被处理时,这一范围就依据分配给这一符号的那一范围变窄。

算术编码的过程,实际上就是依据信源符号的发生概率对码区间分割的过程。

输入:一个字符串输出:一个小数考虑某条信息中可能出现的字符仅有a b c 三种,要压缩保存的信息为bccb。

假设对a b c 三者在信息中的出现概率一无所知(采用自适应模型),暂时认为三者的出现概率相等,也就是都为1/3,将0 - 1 区间按照概率的比例分配给三个字符,即a 从0.0000 到0.3333,b 从0.3333 到0.6667,c 从0.6667 到 1.0000。

用图形表示就是:+-- 1.0000 | Pc = 1/3 | | +-- 0.6667 | Pb = 1/3 | | +-- 0.3333 | Pa = 1/3 | | +-- 0.0000对于第一个字符b,选择b 对应的区间0.3333 - 0.6667。

这时由于多了字符b,三个字符的概率分布变成:Pa = 1/4,Pb = 2/4,Pc = 1/4。

再按照新的概率分布比例划分0.3333 - 0.6667 这一区间,划分的结果可以用图形表示为:+-- 0.6667 Pc = 1/4 | +-- 0.5834 | | Pb = 2/4 | | | +-- 0.4167 Pa = 1/4 | +-- 0.3333接着字符c,上一步中得到的 c 的区间0.5834 - 0.6667。

算术编码

range=high一low=0.7一0.6=0.1 S将区间[0,1) [0.6,0.7) 注意:字符“”表示“分割为”字符。

1 编码过程

•

(3)对第2个字符t编码,使用的新生成范围 为[0.6,0.7),因为t的range low=0.70, range high=1.00,因此下一个low,high分别 为:

1 编码过程

•

将编码后的区间范围综合如图3-9 所示:

我们用0.6753031606代表字符串“state tree”,从而达到高 效编码的目的,这就是算术编码的基本思想。

1 编码过程

• 上述算术编码区间分割过程可用图3-10 表示。

2 解码过程

• 通过编码,最后一个子区间的的下界值 0.6753031606就是字符串“state tree”的惟一 编码。然后在解码时,通过判断哪一个字符能 拥有我们已编码的消息落在的空间来找出消息 中的第一个字符。由于0.6753031606落在[0.6, 0.7]之问,因此马上就可解得第1个符号是S。

•

按对‘state stree”’的算术编码过程为: (1)初始化时,被分割的范围 range=high -low=[0,1) = 1 - 0 = 1,下一个范围 的低、高端分别由下式计算: low=low+range×range low high=low+range×range high 其中等号右边的low为上一个被编码字符的 范围低值;range low和range high分别为本次 被编符号已给定出现的概率范围的low和high。

算术编码

• 用算术编码方法是将被编码的一个消息或一个 符号串(序列)表示成0和1之间的一个间隔, 即对一串符号直接编码成[0,1)区间上的一个 浮点小数,在传输任何符号串(消息)之前, 设符号串的完整范围为[0,1)。当一个符号被 处理时,这一范围就依据分配给这一符号的那 一范围变窄,间隔变小,当符号串序列越长, 则编码表示它的间隔越小,同时表示这一间隔 所需的位数就越多,直到完成对所有符号串的 编码。算术编码的过程,实际上就是依据信息 源符号串的发生概率对码区间分割的过程。

算术编码

二、算术编码的编码过程:

1、从信源符号全序列出发,将各信源序列依累 积概率分布函数的大小映射到[0,1]区间,将 [0,1]区间分成许多互不重叠的小区间。

2、此时每个符号序列均有一个小区间与之对 应,因而可在小区间内取点来代表该符号序列。

二、算术编码的编码过程:

1、累积分布函数递推公式与信源符号序列所对应的区间宽 度的递推公式的求得:

② 将F(S)的十进制小数形式换算成二进制小数C,取小数点 后 L 位,就可以得到序列的码字。

注:如果第L+1有尾数,就进位。

三、算术编码的特点

① 因为C≥F(S)

2L

由码字长度的计算公式可知,p(a)≥ 。 令S+1为按顺序正好在S后面的一个序列,则:

2 F(S 1) F(S) p(a) F(S) L C

① 累积分布函数的定义

设信源符号集A={a1 ,a2 ,,aq

P(ai ), P(ai ) 0(i 1,2,,q)

k 1

F(ak ) P(ai ) i 1

},其相应的概率分布为 ,累积分布函数:

a(i ,ak A )

② 以二元无记忆信源为例,将结果推广到一般情况。

无失真信源编码-------

算术编码

参考资料:《信息论与编码》傅祖芸 《信息论与编码》曹雪虹

一、算术编码简介

1、非分组码,它是从全序列出发,考虑符号之间的 依赖关系。

2、经香农-费诺-埃利斯编码推广而来的,直接对信 源符号序列进行编码输出。

3、即时码,信源符号序列对应的累积概率区间是不 重叠的。肯定也可以唯一译码。

如下图所示其累积分布函数F(S ) 的对应区间及一般多元

序列的累积函数的推导公式的得出:

算数编码介绍

算术编码,是图像压缩的主要算法之一。

是一种无损数据压缩方法,也是一种熵编码的方法。

和其它熵编码方法不同的地方在于,其他的熵编码方法通常是把输入的消息分割为符号,然后对每个符号进行编码,而算术编码是直接把整个输入的消息编码为一个数,一个满足(0.0 ≤ n < 1.0)的小数n。

二、算数编码历史早在1948年,香农就提出将信源符号依其出现的概率降序排序,用符号序列累计概率的二进值作为对芯源的编码,并从理论上论证了它的优越性。

1960年, Peter Elias发现无需排序,只要编、解码端使用相同的符号顺序即可,提出了算术编码的概念。

Elias没有公布他的发现,因为他知道算术编码在数学上虽然成立,但不可能在实际中实现。

1976年,R. Pasco和J. Rissanen分别用定长的寄存器实现了有限精度的算术编码。

1979年Rissanen和G. G. Langdon 一起将算术编码系统化,并于1981年实现了二进制编码。

1987年Witten等人发表了一个实用的算术编码程序,即CACM87(后用于ITU-T的H.263视频压缩标准)。

同期,IBM公司发表了著名的Q-编码器(后用于JPEG和JBIG图像压缩标准)。

从此,算术编码迅速得到了广泛的注意。

算术编码的基本原理是将编码的消息表示成实数0和1之间的一个间隔(Interval),消息越长,编码表示它的间隔就越小,表示这一间隔所需的二进制位就越多。

算术编码用到两个基本的参数:符号的概率和它的编码间隔。

信源符号的概率决定压缩编码的效率,也决定编码过程中信源符号的间隔,而这些间隔包含在0到1之间。

编码过程中的间隔决定了符号压缩后的输出。

给定事件序列的算术编码步骤如下:(1)编码器在开始时将“当前间隔” [ L, H) 设置为[0,1)。

(2)对每一事件,编码器按步骤(a)和(b)进行处理(a)编码器将“当前间隔”分为子间隔,每一个事件一个。

(b)一个子间隔的大小与下一个将出现的事件的概率成比例,编码器选择子间隔对应于下一个确切发生的事件相对应,并使它成为新的“当前间隔”。

算术编码详细讲解

算术编码详细讲解

嘿,朋友们!今天咱来唠唠算术编码。

这算术编码啊,就像是一个神奇的魔法盒子,能把信息压缩得紧紧的。

你看啊,平时咱们说话、写东西,那字啊、词啊就像一群小精灵,到处乱跑。

可算术编码呢,就像是个厉害的精灵管理员,能把它们整整齐齐地归置起来,还不占太多地方。

比如说吧,咱平时发消息,那字打得老长了,要是用了算术编码,嘿,说不定一下子就变短了好多呢!这多省事儿啊!

它不是那种简单粗暴的压缩方式,而是很精细、很巧妙的。

就好像你收拾房间,不是随便把东西乱扔,而是仔细地分类、摆放,让每样东西都有自己合适的位置。

算术编码就像是个聪明的小工匠,一点点地雕琢着信息,让它们变得更紧凑、更精炼。

你能想象到吗,那么多的信息,经过它的手,就变得小巧玲珑啦!

而且哦,算术编码还特别可靠。

就跟你有个特别靠谱的朋友似的,你把事情交给他,就特别放心。

它不会随便弄丢你的信息,也不会弄错,总是能把信息原原本本地给你保留下来。

咱再打个比方,算术编码就像是个厉害的厨师,能把一堆食材变成一道美味又精致的菜肴。

它把那些信息“加工”一下,让它们变得更有价值,更方便我们使用。

你说这算术编码神奇不神奇?它在信息处理的世界里,可真是个大功臣呢!能让我们的信息传输更快、更省空间。

所以啊,大家可别小瞧了这算术编码,它虽然不声不响的,但作用可大着呢!它就像一个隐藏在幕后的高手,默默地为我们的信息世界贡献着力量。

以后再遇到信息压缩的问题,咱就可以想到这个厉害的算术编码啦,它肯定能帮上大忙!怎么样,是不是对算术编码有了更深的认识呀?。

算术编码

为[0.0624,0.0688)

输入第五个符号a4后,对序列a1a2a3a3 a4进行编码,编码区

间为[0.06752,0.0688)

在区间[0.06752,0.0688)内的任何数字都可以表示消息

a1a2a3a3a4,例0.06752

7

无失真编码

算术编码—编码过程

步骤 1 2 3 4 5 6 输入 a1 a2 a3 a3 a4 编码间隔 [0,0.2) [0.04,0.08) [0.056,0.072) [0.0624,0.0688) [0.06752,0.0688)

输入第二个符号a2后,编码区间由[0,0.2)变为[0.04,0.08),当前区间 长度length=0.08-0.04=0.04

6

无失真编码

算术编码—编码过程

输入第三个符号a3后,对序列a1a2 a3进行编码,编码区间

为[0.056,0.072)

输入第四个符号a3后,对序列a1a2a3a3进行编码,编码区间

4

无失真编码

5

无失真编码

算术编码—编码过程

根据每个符号出现的概率将半开区间[0,1)分成四个区域

[0,0.2) [0.2,0.4) [0.4,0.8) [0.8,1)

对输入的第一个符号a1编码

symbol_high(a1)=0.2

symbol_low(a1)=0

high=0+1.0×0.2=0.2

无失真编码

算术编码

算术编码并不是将单个信源符号映射成一个码字,

而是把整个信源表示为实数线上0到1之间的一个 区间,其长度等于该序列的概率。 制作为实际的编码输出

在该区间内选择一个代表性的小数,转换为二进 消息序列中的每个元素都要用来压缩这个区间 消息序列中元素越多,所得到的区间就越小,当

三种常用的统计编码法

三种常用的统计编码法统计编码法是一种将符号转化为二进制编码的方法,常用于数据的存储和传输。

在统计编码法中,最常用的有三种方法,分别为霍夫曼编码、算术编码和字典编码。

下面将对这三种编码法进行详细介绍。

首先是霍夫曼编码法。

霍夫曼编码法是一种无损压缩编码方法,适用于频率分布不均匀的数据。

该编码法利用数据出现的概率进行编码,出现频率高的符号用较短的码字表示,而出现频率低的符号则用较长的码字表示。

这样可以使编码后的数据占用的位数最少。

算术编码是另一种常用的统计编码法。

它将整个消息作为一个整体来编码,而不是将消息划分为固定长度的符号进行编码。

算术编码通过维护一个区间,根据符号的概率分布,逐渐缩小区间的范围,最后将落在最终区间内的小数编码输出。

这样可以实现更高的压缩比,但解码复杂度较高。

最后是字典编码法。

字典编码法通过建立符号和编码之间的一一对应关系来进行编码。

它根据数据中的重复模式,将重复出现的符号用较短的码字表示,而不重复的符号则用较长的码字表示。

字典编码法常用于无损压缩算法中,如LZW算法。

三种常用的统计编码法在具体的应用场景和数据特征上都有所不同。

在选择编码方法时,需要考虑数据的分布、数据的类型、压缩比要求和解码复杂度等因素。

霍夫曼编码法适用于频率分布不均匀的数据,并且对解码的要求不高。

它可以在一定程度上提高压缩比,但解码时需要使用相同的霍夫曼编码表进行解码,因此对于无法完全传输编码表的场景可能不适用。

算术编码在压缩比方面优于霍夫曼编码,但解码复杂度较高,需要使用相同的符号概率分布来进行解码。

算术编码适用于数据中存在较多冗余信息的情况,可以达到较高的压缩比。

字典编码法通过建立符号和编码的对应关系,适用于数据中存在较多重复模式的情况。

它可以实现较高的压缩比,但需要建立和传输字典表,在某些场景下不便于使用。

综上所述,霍夫曼编码、算术编码和字典编码是三种常用的统计编码法。

它们在不同的应用场景和数据特征下具有不同的优势和适用性。

无损压缩算法的比较和分析

无损压缩算法的比较和分析常见的无损压缩算法包括LZ77、LZ78、LZW、Huffman编码、算术编码等。

下面对这些算法进行比较和分析。

1.LZ77LZ77算法是一种字典编码方法,通过寻找重复出现的数据片段,并用指针和长度来表示这些片段,从而实现无损压缩。

与其他算法相比,LZ77算法在压缩速度方面较快,但压缩率相对较低。

2.LZ78LZ78算法是一种基于字典编码的压缩算法,它将重复出现的片段替换为对应的指针,并在字典中新增新的片段。

与LZ77相比,LZ78算法具有更好的压缩效果,但压缩和解压缩的速度较慢。

3.LZWLZW算法是LZ78的改进版本,也是一种字典编码方法。

LZW算法通过将重复出现的片段编码为对应的指针,并将这些片段以及对应的指针存储在字典中,来实现压缩。

与LZ78相比,LZW算法在压缩效果上更好,但对字典的管理较复杂,导致压缩和解压缩速度较慢。

4. Huffman编码Huffman编码是一种基于字符出现频率的编码算法。

它通过统计字符出现的频率来构建一个最优前缀编码的树结构,从而实现无损压缩。

Huffman编码的压缩率较高,但压缩和解压缩的速度相对较慢。

5.算术编码算术编码是一种基于字符出现概率的编码算法。

它通过使用一个区间来表示整个数据流,将出现频率较高的字符用较短的区间表示,从而实现无损压缩。

算术编码的压缩率通常比Huffman编码更高,但压缩和解压缩的速度更慢。

综合比较上述算法,可以得出以下结论:1.LZ77和LZ78算法适用于实时压缩,因为它们在压缩和解压缩的速度方面较快,但压缩率较低。

2.LZW算法在压缩效果上较好,但对字典的管理较复杂,导致压缩和解压缩的速度较慢。

3. Huffman编码和算术编码在压缩率上较高,但压缩和解压缩的速度相对较慢。

根据具体需求,可以选择适合的无损压缩算法。

如果需要更快的压缩和解压缩速度,可以选择LZ77或LZ78算法;如果需要更好的压缩效果,可以选择LZW算法、Huffman编码或算术编码。

第二章算术编码

算术码之例(5)

用数轴来说明算术编码更直观 |————|————|————————| 0 0 1/4 1/2 1 1 1/4 10 7/16 1/2 11 1 7/16 110 17/32 111 3/4 1 …………………………………………… [0,1)分割成为2n区间,代表2n个序列。

12

17

算术码之例(11)

* 1.10 10.00 0.101 …………………………………… 0 0.01 101.01 ** 1.00 10101.00 0.00 0 0.01 10101.00 ** 1.00 1010100.00 移位次数=7, C=0.1010100

18

算术码之例(12)

0---2比特 1---与游程长度有关, L=2N+1或2N+2 N+1比特 p’(L)=p(1-p), l=2p+(1-p) [(N+1)p’(2N+1)/(2N+1) +p’(2N+2)/2]=0.997 =0.811/0.997=81.4% (92.7%) 编码效率有所下降。若保留4位可提高。

24

一般马氏链的算术编码(6)

3.进位引入差错的防止 [P(Aar)+p(Aar)]2-L(Aar) =[P(A)+p(A)∑P(ar|S)]W2-L(A) +[p(A)P(ar|S)]2-L(A)≦[P(A)+p(A)]2-L(A), 递推至加一序列B, [P(AB)+p(AB)]2-L(AB)≦[P(A)+p(A)]2-L(A), 若加B过程内未移位,则P(AB)-P(A)<1

21

一般马氏链的算术编码(3)

译码公式

算术编码

算术编码原理在给定符号集和符号概率的情况下,算术编码可以给出接近最优的编码结果。

使用算术编码的压缩算法通常先要对输入符号的概率进行估计,然后再编码。

这个估计越准,编码结果就越接近最优的结果。

例: 对一个简单的信号源进行观察,得到的统计模型如下:▪60% 的机会出现符号中性▪20% 的机会出现符号阳性▪10% 的机会出现符号阴性▪10% 的机会出现符号数据结束符. (出现这个符号的意思是该信号源'内部中止',在进行数据压缩时这样的情况是很常见的。

当第一次也是唯一的一次看到这个符号时,解码器就知道整个信号流都被解码完成了。

)算术编码可以处理的例子不止是这种只有四种符号的情况,更复杂的情况也可以处理,包括高阶的情况。

所谓高阶的情况是指当前符号出现的概率受之前出现符号的影响,这时候之前出现的符号,也被称为上下文。

比如在英文文档编码的时候,例如,在字母Q或者q出现之后,字母u出现的概率就大大提高了。

这种模型还可以进行自适应的变化,即在某种上下文下出现的概率分布的估计随着每次这种上下文出现时的符号而自适应更新,从而更加符合实际的概率分布。

不管编码器使用怎样的模型,解码器也必须使用同样的模型。

一个简单的例子以下用一个符号串行怎样被编码来作一个例子:假如有一个以A、B、C三个出现机会均等的符号组成的串行。

若以简单的分组编码会十分浪费地用2 bits来表示一个符号:其中一个符号是可以不用传的(下面可以见到符号B正是如此)。

为此,这个串行可以三进制的0和2之间的有理数表示,而且每位数表示一个符号。

例如,―ABBCAB‖ 这个串行可以变成0.011201(base3)(即0为A, 1为B, 2为C)。

用一个定点二进制数字去对这个数编码使之在恢复符号表示时有足够的精度,譬如0.001011001(base2) –只用了9个bit,比起简单的分组编码少(1 –9/12)x100% = 25%。

这对于长串行是可行的因为有高效的、适当的算法去精确地转换任意进制的数字。

python算术编码

python算术编码## 简介这篇原创文档将会介绍算术编码的基本原理和实现。

算术编码是一种无损数据压缩算法,在信息论领域得到广泛应用。

通过使用算术编码,可以将数据压缩成更短的编码序列,从而减少存储空间的需求。

## 基本原理算术编码的基本原理是将输入序列映射到一个实数区间中,并将该区间的特定部分表示为输出序列。

其实质是将较常见的序列映射为较短的编码,而较不常见的序列映射为较长的编码。

通过这种方式,可以实现数据的高度压缩。

具体而言,算术编码的过程如下:1. 将输入序列划分为不同的符号,并为每个符号分配一个概率。

2. 计算每个符号出现的概率区间(其实也可以是累积概率)。

3. 将整个区间根据各个符号的概率进行划分,并将输入序列映射到对应的子区间中。

4. 重复步骤3,直到得到一个唯一的编码序列。

## 实现步骤下面将介绍算术编码的实现步骤。

1. 初始化区间:将整个区间初始设置为[0, 1)。

2. 计算符号概率区间:针对每个输入符号,根据其出现的概率计算对应的区间。

可以通过累积概率或离散概率来计算。

3. 映射到区间:根据符号概率区间,将输入序列映射到对应的子区间中。

例如,如果输入序列为"ABBC",对应的符号概率区间为[0.2, 0.4),则将当前区间更新为子区间[0.2, 0.3)。

4. 缩小区间:重复步骤3,不断缩小区间,直到得到一个唯一的编码序列。

5. 输出编码序列:将最终的区间映射到一个编码序列中,并输出。

## 优缺点算术编码的优点在于其高度压缩的能力,能够将数据压缩到接近信息熵的程度。

另外,算术编码对于任意概率分布的符号集都能进行有效的编码。

然而,算术编码也存在一定的缺点。

首先,算术编码的实现相对复杂,需要进行精确的浮点数计算。

其次,算术编码对输入数据的顺序敏感,即输入序列的顺序不同,得到的编码序列也会不同。

## 总结算术编码是一种强大的数据压缩算法,其利用符号出现的概率将输入序列映射到一个实数区间中,并通过缩小区间来得到一个唯一的编码序列。

算术编码,符号序列,码字

摘要由于信源符号之间存在分布不均匀喝相关性,使得信源存在冗余度,信源编码的主要任务就是减少冗余,提高编码效率。

具体说就是针对信源输出符号序列的的统计特性,寻找一定的方法把信源输出符号序列变换为最短码字序列的方法。

信源编码的基础是信息论中的两个编码定理:无失真编码定理和限失真编码定理,前者是可逆编码的基础。

可逆是指当信源符号转换成代码后,可从代码无失真的恢复原信源符号。

关键字:算术编码,符号序列,码字。

目录1 课题描述 (1)2设计原理 (1)2.1 编码 (2)2.2解码 (2)3设计过程 (2)3.1算术编码过程简述 (2)3.2算术编码的特点 (3)3.3 设计程序 (3)图一算术编码结果 (8)总结 (9)参考文献 (10)1 课题描述编码实质上是对信源的原始符号按一定规则进行的一种变换。

编码可分为信源编码和信道编码。

信源编码:以提高通信有效性为目的的编码。

通常通过压缩信源的冗余度来实现。

采用的一般方法是压缩每个信源符号的平均比特数或信源的码率。

即同样多的信息用较少的码率传送,使单位时间内传送的平均信息量增加,从而提高通信的有效性。

信源编码理论是信息论的一个重要分支,其理论基础是信源编码的两个定理。

–无失真信源编码定理:是离散信源/数字信号编码的基础;–限失真信源编码定理:是连续信源/模拟信号编码的基础。

•信源编码的分类:–离散信源编码:独立信源编码,可做到无失真编码;–连续信源编码:独立信源编码,只能做到限失真信源编码;–相关信源编码:非独立信源编码。

信源编码的作用之一是设法减少码元数目和降低码元速率,即通常所说的数据压缩:作用之二是将信源的模拟信号转化成数字信号,以实现模拟信号的数字化传输。

最原始的信源编码就是莫尔斯电码,另外还有ASCII码和电报码都是信源编码。

但现代通信应用中常见的信源编码方式有:Huffman编码、算术编码、L-Z编码,这三种都是无损编码,另外还有一些有损的编码方式。

算术编码的原理

算术编码的原理算术编码是一种数据压缩算法,它可以将一个长字符串压缩成一个更短的数值。

它与其他数据压缩算法不同,它不是将整个字符串划分成固定长度的块,而是将每个字符映射为一个数字,再将这些数字压缩成一个数值。

算术编码的原理可以简单地概括为以下几点:1. 确定字符集在压缩之前,必须先确定字符集。

字符集包括所有可能出现的字符。

例如,在英语中,字符集包括所有字母、数字以及其他符号。

2. 计算每个字符的概率通过预处理或对大量数据的统计,可以计算每个字符在字符串中出现的概率。

3. 对每个字符进行编码编码的过程是将每个字符映射为一个数字。

这个数字必须能唯一地表示每个字符,并且尽可能不会出现冲突。

编码的方式可以根据具体情况进行选择,例如 ASCII 码就是一种常见的字符编码方式。

4. 计算每个字符的编码区间每个字符根据其在字符串中出现的概率,可以确定一个编码区间。

例如,一个字符在字符串中出现的概率为 0.25,则其编码区间为 0-0.25。

5. 压缩数据将每个字符的编码区间连续地组成一个区间,最终压缩成一个数值。

如果字符集很大,压缩后得到的数值可能非常大,因此需要使用高精度运算来处理。

6. 解压数据解压数据的过程就是将压缩后的数值还原为原始字符串的过程。

解压的过程需要根据先前编码的字符集和编码区间进行计算,从而还原字符串。

总之,算术编码的原理可以简单概括为确定字符集、计算每个字符的概率、为每个字符编码、计算每个字符的编码区间、压缩数据和解压数据。

虽然算术编码的实现比较复杂,但它可以很好地压缩数据,并且是一种通用的数据压缩算法。

算术编码的压缩率 -回复

算术编码的压缩率-回复算术编码是一种数据压缩技术,它通过将输入序列转换为一个介于0和1之间的小数来实现压缩。

在这篇文章中,我将详细介绍算术编码的原理和计算过程,并讨论它在不同场景下的压缩率。

首先,让我们来了解算术编码的基本原理。

算术编码使用一个很小的小数来代表输入序列中的每个符号。

每个符号都被映射到一个小数区间,这个区间的大小与该符号在序列中出现的概率成正比。

整个序列的编码就是由这些小数区间组成的。

算术编码的核心思想是利用每个符号在序列中出现的概率来决定其所占据的小数区间的大小。

出现概率越高的符号,其占据的区间就越大。

例如,如果一个符号在序列中出现的概率是0.4,那么它将被映射到一个占据整个区间长度的40的小数区间。

算术编码的计算过程分为编码和解码两个步骤。

在编码过程中,输入序列中的每个符号都被映射到一个小数区间,并将其累积乘以前一个符号的区间长度,直到整个序列都被编码为一个小数。

在解码过程中,通过不断缩小已知的小数区间来确定原始序列中的符号。

接下来,让我们来讨论算术编码的压缩率。

算术编码的压缩率取决于输入序列中各个符号的出现概率。

如果所有符号出现的概率都相等,那么每个符号所占据的小数区间的大小也是相等的,编码后的小数将接近于均匀分布。

在这种情况下,编码后的小数将需要更多的比特位来表示,压缩率较低。

然而,在实际应用中,符号的出现概率通常是不均匀的。

一些符号出现的概率高,而另一些符号出现的概率低。

这种情况下,算术编码可以实现较高的压缩率。

由于编码时使用的小数区间是根据符号出现概率来分配的,出现概率高的符号将占据较大的区间,从而被编码为较长的小数。

相反,出现概率低的符号将占据较小的区间,从而被编码为较短的小数。

这样一来,整个序列的编码长度就可以大大缩短,从而实现了较高的压缩率。

然而,算术编码的压缩率还受到一些其他因素的影响。

其中一个重要因素是输入序列的长度。

较长的序列可以更好地利用各个符号的出现概率,从而实现更高的压缩率。

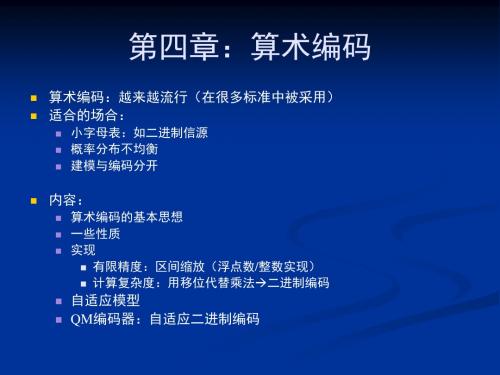

第四章:算术编码..

算术编码:越来越流行(在很多标准中被采用) 适合的场合:

小字母表:如二进制信源 概率分布不均衡 建模与编码分开

内容:

算术编码的基本思想 一些性质 实现 有限精度:区间缩放(浮点数/整数实现) 计算复杂度:用移位代替乘法二进制编码

自适应模型 QM编码器:自适应二进制编码

i1 P x ki i1 P x1 k , x2 i P x1 k i1 P x2 i P x1 k , where x x1x2

6 6 6

(2) FX 32 P( x1 1) P( x1 2) P(x 31) P(x 32) FX (2) P(x 31) P(x 32)

(k )

l

( k 1)

u

( k 1)

l

( k 1)

F

X

( xk 1)

TX x

u

(n)

l 2

(n)

只需知道信源的cdf,即信源的概率模型

算术编码:编码和解码过程都只涉及算术运算(加、减、乘、除)

产生标识:例

考虑随机变量X(ai) = i

u ( k ) l ( k 1) u ( k 1) l ( k 1) FX ( xk ) l ( k ) l ( k 1) u ( k 1) l ( k 1) FX ( xk 1)

词典顺序( Lexicographic order )

字符串的词典顺序:

T

(n) X

xi y:y

1 P y P xi xi 2

算术编码原理

算术编码原理算术编码是一种将字符序列压缩成一个浮点数的方法,它的压缩效率比传统的哈夫曼编码更高,因为它可以使用原本不是整数的浮点数表示更多的信息。

本文将介绍算术编码的原理,分为以下几个部分:一、概念解释1.1 算术编码的基本概念算术编码是在一个有限长度的区间内对字符序列进行编码的方式,其中每个字符对应的编码值是一个实数。

编码值在编码区间内是唯一的,且编码值可以通过解码得到压缩前的字符序列。

1.2 字符频率在进行算术编码时,需要知道每个字符在字符序列中出现的频率,频率可以是小数或整数,且每个字符的频率之和必须为1。

二、算法过程2.1 编码过程算术编码主要分为以下几个步骤:(1)定义初始编码区间根据字符频率,可以计算出每个字符的编码区间,例如字符A的编码区间是[0,0.3),字符B的编码区间是[0.3,0.5),字符C的编码区间是[0.5,0.6),字符D的编码区间是[0.6,1]。

(2)收缩编码区间根据每个字符的频率,计算每次的编码区间长度。

例如,如果字符序列是ABCD,且字符频率分别为0.3、0.2、0.1和0.4,那么初始编码区间的长度为1,第一次收缩后,区间缩小到0.3,表示字符A出现的概率为0.3。

第二次收缩后,区间缩小到0.06,表示字符AB出现的概率为0.06。

一直推进到最后,得到压缩后的编码值。

2.2 解码过程解码过程需要使用压缩后的编码值和字符频率进行计算。

例如,解码一个值为0.2的字符时,需要找到0.2所在的字符区间,然后计算该区间对应的字符。

三、算法特点3.1 压缩率高由于算术编码可以对每个字符对应的区间进行无限分割,因此可以表示更多的信息。

相比于传统的哈夫曼编码,算术编码可以达到更高的压缩率。

3.2 复杂度高虽然算术编码的压缩效果好,但是编码和解码的计算复杂度非常高,因此需要配合分治法、搜索算法等其它算法来减少计算量。

3.3 广泛应用算术编码在数据压缩、无损图像压缩、音频压缩、视频压缩等多个领域都有广泛应用。

算术编码的过程

算术编码的过程

算术编码的过程主要有三个步骤:

(1)文本的分析预处理:在此步骤中,我们将原始文本按照一定的标准进行分析,比如统计该文本中出现的每一个字符的概率,然后根据这些概率构建一棵概率二叉树,以用于对每一个字符或单词编号。

(2)编码:在这一步,我们将利用概率二叉树给原文本中出现的每一个字符或单词进行编号,以获得该文本的算术编码。

(3)解码:在这一步,我们将通过利用编码树,根据算术编码的编号,恢复文本中的原有内容。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

实现算术编码及其译码

一、实验内容

借助C++编程来实现对算术编码的编码及其译码算法的实现

二、实验环境

1.计算机

2.VC++6.0

三、实验目的

1.进一步熟悉算术编码的原理,及其基本的算法;

2.通过编译,充分对于算术编码有进一步的了解和掌握;

3.掌握C++语言编程(尤其是数值的进制转换,数值与字符串之间的转换

等)

四、实验原理

算术编码

算术编码的基本原理是将编码的消息表示成实数0和1之间的一个间隔,消息越长,编码表示它的间隔就越小,表示这一间隔所需的二进制位就越多。

算术编码用到两个基本的参数:符号的概率和它的编码间隔。

信源符号的概率决定压缩编码的效率,也决定编码过程中信源符号的间隔,而这些间隔包含在0到1之间。

编码过程中的间隔决定了符号压缩后的输出。

给定事件序列的算术编码步骤如下:

(1)编码器在开始时将“当前间隔”设置为[0,1)。

(2)对每一事件,编码器按步骤(a)和(b)进行处理

(a)编码器将“当前间隔”分为子间隔,每一个事件一个。

(b)一个子间隔的大小与下一个将出现的事件的概率成比例,编码器选择子间隔对应于下一个确切发生的事件相对应,并使它成为新的“当前间

隔”。

(3)最后输出的“当前间隔”的下边界就是该给定事件序列的算术编码。

编码过程

假设信源符号为{A, B, C, D},这些符号的概率分别为{ 0.1, 0.4, 0.2,0.3 },根据这些概率可把间隔[0, 1]分成4个子间隔:[0, 0.1], [0.1, 0.5],

[0.5, 0.7], [0.7, 1],其中[x,y]表示半开放间隔,即包含x不包含y。

上面的信息可综合在表03-04-1中。

下表为信源符号,概率和初始编码间隔

如果二进制消息序列的输入为:C A D A C D B。

编码时首先输入的符号是C,找到它的编码范围是[0.5,0.7]。

由于消息中第二个符号A的编码范围是[0,0.1],因此它的间隔就取[0.5, 0.7]的第一个十分之一作为新间隔[0.5,0.52]。

依此类推,编码第3个符号D时取新间隔为[0.514, 0.52],编码第4个符号A 时,取新间隔为[0.514, 0.5146],…。

消息的编码输出可以是最后一个间隔中的任意数。

整个编码过程如图03-04-1所示。

编码和译码的全过程分别表示在下表。

编码过程

译码过程

五、实验设计:

算术编码是一种无损数据压缩方法,也是一种熵编码的方法。

和其它熵编码方法不同的地方在于,其他的熵编码方法通常是把输入的消息分割为符号,然后对每个符号进行编码。

而算术编码是直接把整个输入的消息编码为一个数,一个满足(0.0 ≤ n < 1.0)的小数n。

所以用两个基本的参数:符号的概率和它的编码间隔。

信源符号的概率决定压缩编码的效率,也决定编码过程中信源符号的间隔,而这些间隔包含在0到1之间。

算术编码的算法思想如下:

(1)对一组信源符号按照符号的概率从大到小排序,将[0,1)设为当前分析区间。

按信源符号的概率序列在当前分析区间划分比例间隔。

(2)检索“输入消息序列”,锁定当前消息符号(初次检索的话就是第一个消息符号)。

找到当前符号在当前分析区间的比例间隔,将此间隔作为新的当前分析区间。

并把当前分析区间的起点(即左端点)指示的数“补加”到编码输出数里。

当前消息符号指针后移。

(3)仍然按照信源符号的概率序列在当前分析区间划分比例间隔。

然后重复第

二步。

直到“输入消息序列”检索完毕为止。

(4)最后的编码输出数就是编码好的数据。

六、实验程序:

#include<iostream.h>

#include"math.h"

//定义所需要用到的变量及数组

char S[100], A[10];

float P[10],f[10],gFs;

//编码程序

void bianma(int a,int h)

{

int i,j;

float fr;

float ps=1;

float Fs=0;

float Sp[100],b[100],F[100];

//以待编码的个数和字符个数为循环周期,将待编码的字符所对应的概率存入到Fs中for(i=0;i<h;i++)

{

for(j=0;j<a;j++)

{

if(S[i]==A[j])

{

Sp[i]=P[j];

fr=f[j];//将划分好的[0,1)区间的对应点赋值给fr

}

}

Fs=Fs+ps*fr;//从选择的子区间中继续进行下一轮的分割。

不断的进行这个过程,

直到所有符号编码完毕。

ps*=Sp[i]; //求Ps

}

cout<<"Fs="<<Fs<<endl;//显示最终的算术编码

gFs=Fs;

float l=log(1/ps)/log(2);//计算算术编码的码字长度l

if(l>(int)l)l=(int)l+1;

else l=int(l);

//将Fs转换成二进制的形式

int d[20];

int m=0;

while(l>m)

{

Fs=2*Fs;

if(Fs>1)

{

Fs=Fs-1;

d[m]=1;

}

else if(Fs<1)d[m]=0;

else {d[m]=1;break;}

m++;

}

int z=m;//解决有关算术编码的进位问题,给二进制数加1

if(m>=l)

{

while(1)

{

d[m-1]=(d[m-1]+1)%2;//最后位加1

if(d[m-1]==1)break;

else m--;

}

}

cout<<"s=";

for(int e=0;e<z;e++)

cout<<d[e];

cout<<endl;

}

//解码程序

void jiema(int a,int h)

{

int i,j;

float Ft,Pt;

float Fs=0,Ps=1;

for(i=0;i<h;i++)//以编码个数和符号个数为循环周期,对其进行解码{

for(int j=a-1;j>-1;j--)

{

Ft=Fs;

Pt=Ps;

Ft+=Pt*f[j];//对进行逆编码

Pt*=P[j];

if(gFs>=Ft)//对其进行判断,并且将值存入到数组A中

{

Fs=Ft;

Ps=Pt;

cout<<A[j];

break;

}

}

}

cout<<endl;

}

void main()

{

cout<<"输入所要编码的符号的个数,并按回车跳转:"<<endl;

int a,i,h=0;

cin>>a;

cout<<"请输入符号及其相对应的概率值,并按回车跳转:"<<endl;

for(i=0;i<a;i++)

{

char x;

float y;

cin>>x;

A[i]=x;//将字符依次存入数组A中

cin>>y;

P[i]=y;//将字符所对应的概率依次存入到数组P中

}

for(i=1;i<a;i++)

{

f[0]=0;

f[i]=f[i-1]+P[i-1];//将要编码的数据映射到一个位于[0,1)的实数区间中}

cout<<"请输入所要编码的符号序列,并以*结尾:"<<endl;

while(1)//这个while语句的作用是将要编码的字符存入到数组S中

{

char ss;

cin>>ss;

if(ss=='*')break;//在以“*”为结尾的时候结束存储

S[h++]=ss;

}

cout<<"输入的字符经过算术编码之后为:"<<endl;

bianma(a,h);

cout<<"由上述所对应的解码为:"<<endl;

jiema(a,h);

}

七、实验结果:

八、结果分析

首先根据显示输入所有的字符的个数,以及字符和其概率,经过对“CADACDB”编码之后,我们可以在屏幕上看到最终的编码结果为0.514388,与上式的分析结果相同,进过转换之后产生的二进制代码为10000011101011110。

同样也显示了译码结果和输入的相同,即同为“CADACDB”。

证明实验编码是可行的。

九、心得体会

这是第二次的信息论实验,借助上周编写的哈夫曼编码的知识和经验,以及在网络上的相关查阅,我也成功的做好了算术编码及其译码的实验,通过这个实验,让我对算术编码有了更进一步的了解,以及对C++的运用,因为我们之前都是使用C语言进行编写程序,对于知识有了新的吸收。

受益匪浅啊。