概率论的基础

概率论基础:定义与原理

概率论基础:定义与原理概率论是数学中的一个重要分支,研究随机现象的规律性和统计规律性。

在现代科学和工程技术中有着广泛的应用。

概率论的基础是概率的定义和概率的基本原理。

本文将介绍概率论的基础知识,包括概率的定义、概率的性质、概率的基本原理等内容。

一、概率的定义概率是描述随机事件发生可能性大小的数值。

在数学上,概率可以用数值来表示,通常用P(A)表示事件A发生的概率。

概率的定义有多种形式,其中最常见的是古典概率和统计概率。

1. 古典概率古典概率是指在随机试验中,样本空间有限且每个基本事件发生的可能性相同的情况下,事件A发生的概率可以用如下公式表示:P(A) = n(A) / n(S)其中,n(A)表示事件A发生的基本事件数,n(S)表示样本空间中基本事件的总数。

2. 统计概率统计概率是指在实际观察中,通过频率来估计事件发生的概率。

当试验次数足够多时,事件A发生的频率将逼近其概率值。

统计概率是概率论中最基本的概念之一,也是实际应用中最常用的概率计算方法。

二、概率的性质概率具有一些基本性质,这些性质是概率论研究的基础,也是概率计算的重要依据。

1. 非负性对于任意事件A,其概率值满足P(A) ≥ 0。

2. 规范性对于样本空间S,其概率值为1,即P(S) = 1。

3. 可列可加性对于任意两个互不相容的事件A和B,有P(A∪B) = P(A) + P(B)。

4. 对立事件的性质对立事件是指事件A和其补事件A',即A与A'互为对立事件。

对立事件的概率满足P(A) + P(A') = 1。

5. 事件的包含关系若事件A包含事件B,则P(A) ≥ P(B)。

三、概率的基本原理概率的基本原理包括加法法则和乘法法则,是概率计算的基础。

1. 加法法则加法法则是指对于任意两个事件A和B,它们的并事件的概率可以表示为:P(A∪B) = P(A) + P(B) - P(A∩B)其中,P(A∩B)表示事件A和事件B同时发生的概率。

概率论基础知识

对于连续型随机变量来说,它取任一指定实数值a的概率均为0,即P{X=a}=0。事实上0≤P{X=a}≤P{a-△x<X≤a}=F(a)-F(a-△x).P{a<X≤b}=P{a≤X≤b}=P{a<X<b}.

定理二:若事件A与B相互独立,则下列各对事件也相互独立:

多个事件相互独立:一般,设A1,A2,…,An是n(n≥2)个事件,如果对于其中任意2个,任意3个,…,任意n个事件的积事件的概率,都等于各事件概率之积,则称事件A1,A2,…,An相互独立。

推论:①若事件A1,A2,…,An(n≥2)相互独立,则其中任意k(2≤k≤n)个事件也是相互独立的。

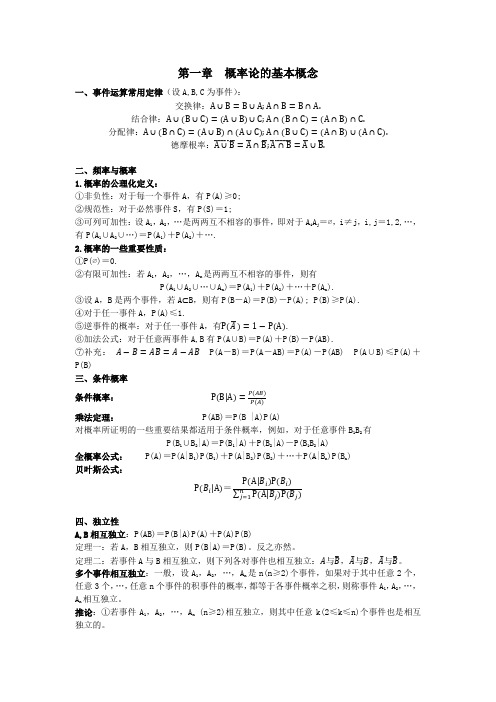

第一章 概率论的基本概念

一、事件运算常用定律(设A,B,C为事件):

二、频率与概率

1.概率的公理化定义:

①非负性:对于每一个事件A,有P加性:设A1,A2,…是两两互不相容的事件,即对于AiAj=∅,i≠j,i,j=1,2,…,有P(A1∪A2∪…)=P(A1)+P(A2)+….

P{X>s+t|X>s}=P{X>t}

3.正态分布(高斯分布)[X~N(μ,σ2)]:

正态分布性质:

①曲线关于x=μ对称,这表明对于任意h>0有P{μ-h<X≤μ}=P{μ<X≤μ+h }.

②当x=μ时取到最大值 ,x离μ越远,f(x)的值越小。

③在x=μ±σ处曲线有拐点。曲线以Ox轴为渐近线。

标准正态分布:μ=0,σ=1.其概率密度和分布函数分别用φ(x),Φ(x)表示,即有:

②若n个事件A1,A2,…,An(n≥2)相互独立,则将A1,A2,…,An中任意多个事件换成它们各自的对立事件,所得的n个事件仍相互独立。

概率论基础知识

§4 条件概率与乘法公式

一、条件概率: 事件B发生的条件下事件A发生的概率,定义为

P( AB ) P( B ) P( A | B ) 0, P( A | B )

(当 P( B ) 0 时). (当 P( B ) 0 时).

注: (1) 条件概率 P( A | B ) 实际上是在缩小的样本空间 B 上 求 A 发生的概率 : K P( A | B ) AB ; NB 而无条件概率P( A) 是在原样本空间 内求 A 发生的概率 : K P( A) A N

§5 事件的独立性

若一个事件发生的概率不受另一事件发生的影响,

则称这两个事件是相互独立的。或者说,若 P(B|A)=P(B), 则称 A 与 B 相互独立。 注:事件A与 B 相互独立当且仅当 P(AB)=P(A) P(B).

例9 某厂生产的100个零件中有5个次品,采用有放回抽样,求 抽出的第 1 件为正品且第 2 件是次品的概率,及第二次抽到次 品的概率。 解:设 A为第一次抽到的是正品;B为第二次抽到的是次品。

(6) 互不相容事件(互斥事件): 若A ∩ B= ,则称事件A与事件B 是互不相容的。互不相容事件不可能同时发生。 (7) 事件的差:属于事件A 但不属于事件B 的样本点构成的集 合, 称为事件A与事件B 的差,记为 A-B。事件A-B 发生当且 仅当事件A 发生但事件B不发生。 注:A B AB;

概率论基础知识

§1. 概率论中的基本概念

一、随机试验、样本空间和事件

1.随机试验:具有两个或两个以上可能的结果,但事先无法确定会出 现哪个结果的观察或试验。如投掷一枚硬币可能出现正面或反面;明 天的天气可能是阴、晴或雨;每天到达某一商店的顾客数;某商场的 月销售额;某时段到达一个电话交换机的呼叫次数,等等,观察或统 计这些现象的结果,就是在进行随机试验。 2. 样本与样本空间:随机试验可能产生的各个不同结果都称为样本, 由所有样本组成的集合称为该随机试验的样本空间,通常记为。 3. 随机事件(简称事件):样本空间的任一个子集合都称为这个样本 空间上的一个随机事件。当随机事件中所含的任何一个样本出现时, 便称该事件发生了。 注: (1) 整个样本空间作为一个事件,称为必然事件。

概率论的基础知识

概论论的基础知识

6σ

目录

6s

第一部分 概率基础知识 第二部分 随机变量及其分布

概率基础知识

6s

事件

(一)随机现象

1、定义:在一定条件下,并不总是出现相同结果的现象称为随机现象。

随机现象的特点:

⑴随机现象的结果至少有两个;

⑵至于哪一个出现,事先人们并不知道。

2、样本点(抽样单元):随机现象中的每一个可能结果,称为一个样本点,又称为抽 样单元。

正态分布有两个参数和常记为n读作miu为分布的标准差随机变量及其分布常用连续分布正态分布09357随机变量及其分布常用连续分布正态分布2标准正态分布的一些运算公式随机变量及其分布常用连续分布正态分布随机变量及其分布常用连续分布正态分布2标准正态分布的分位数一般说来对任意介于0与1之间的实数标准正态分布n01的分位数是这样一个数它的左侧面积恰好为它的右侧面积恰好为1用概率的语言来说u的分位数u随机变量及其分布常用连续分布正态分布随机变量及其分布常用连续分布正态分布2正态分布的标准转化某产品的质量特性2008则最大值应为随机变量及其分布常用连续分布正态分布2正态分布的标准转化产品质量特性的不合格品率的计算1质量特性的分布在受控的情况下常为正态分布

3、样本空间:随机现象一切可能样本点的全体称为这个随机现象的样本空间,常记为 Ω (读Omega )。

一切可能发生 认识一个随机现象首要就是能罗列出它的

的基本结果。

概率基础知识

事件

[例]

⑴一天内进某超市的顾客数: Ω ={0,1,2,······}

⑵一顾客在超市购买的商品数: Ω ={0,1,2,······}

性质8:假如两个事件A与B相互独立,则在事件B发生的条件下,事件A发生的条件概 率P(A|B)等于事件A的(无条件)概率P(A)。

概率论知识点总结

概率论知识点总结概率论是数学中重要的一个分支领域,它使用数学方法研究随机现象的发生的概率,为我们研究和预测未来的发展提供可靠的依据。

本文旨在总结概率论的主要知识点,以供大家参考。

首先,概率的概念是概率论的基础。

概率是衡量一件事情发生的可能性的数字,它是描述不确定事件发生的概率的度量。

概率可以以0到1之间的数值来表示,0代表完全不可能发生,1代表一定发生,0.5代表可能发生。

其次,概率分布是概率论中的另一个重要概念。

概率分布是一个数学模型,用来描述一组数据中每个取值的概率。

其中常见的概率分布有高斯分布、泊松分布和指数分布等。

再说,条件概率也是概率论中的重要概念,它是“在已知一个条件的情况下,另一个条件发生的概率”的定义。

它与联合概率有关,联合概率是两个或多个事件同时发生的概率,它可以通过条件概率计算。

此外,抽样分布是概率论中另一个重要概念,它描述的是一个统计样本的概率分布,如正态分布、均匀分布等。

抽样分布中有重要的中心极限定理,它指出随着样本大小的增加,样本的分布会趋于正态分布。

接下来,统计推断也是概率论中的重要概念,它是指从一小部分数据中推断出全体数据概率分布的过程,它包括推断均值和概率分布等。

统计推断常用统计检验来进行,如卡方检验、t检验等。

最后,蒙特卡罗方法是概率论中一种重要的数值方法,它用于估算概率分布或积分的近似值。

它使用随机数来模拟现实情况,可以得出期望的推断,是一种比较精确的方法。

总的来说,概率论是一门复杂而又重要的数学学科,它研究随机现象的概率和不确定性的模型,研究的内容包括概率的定义、概率分布、条件概率、抽样分布以及蒙特卡罗方法等。

概率论的运用非常广泛,为人们预测未来发展提供了可靠的依据,也是目前许多领域发展的基础。

李贤平概率论基础

李贤平概率论基础

概率论是研究随机现象是可能发生的事件及其概率之间关系的科学。

概率论是统计学和数学之间联系最紧密的领域之一。

它在数理统计学和计算机科学等科学领域中广泛应用,尤其是在贝叶斯推理、信息理论和机器学习等领域有很大的用途。

概率论的基础是由李贤平于1980年提出的。

李贤平指出,概率论必须具备三个要素:概率空间,概率分布及其概率测度。

概率空间是指试验能够出现的所有结果的集合;概率分布是概率空间中各结果的发生的概率;而概率测度就是度量概率的一种方式,可以有助于我们直观地表达概率之间的关系。

在概率论中,我们可以把一个随机事件的发生概率用概率密度函数、累积分布函数等表示,而概率空间内各个结果概率的分布就可以用概率函数、伽玛分布、正态分布、伯努利实验等方法来表示。

李贤平提出的概率论基础为概率论的发展和实用化赋予了重要的理论基础。

它不仅为传统的概率理论建立了一个完整的框架,而且也为新的尝试创造了良好的发展空间。

概率论 "理论里程碑"装置在李贤平发现的概率论基础上。

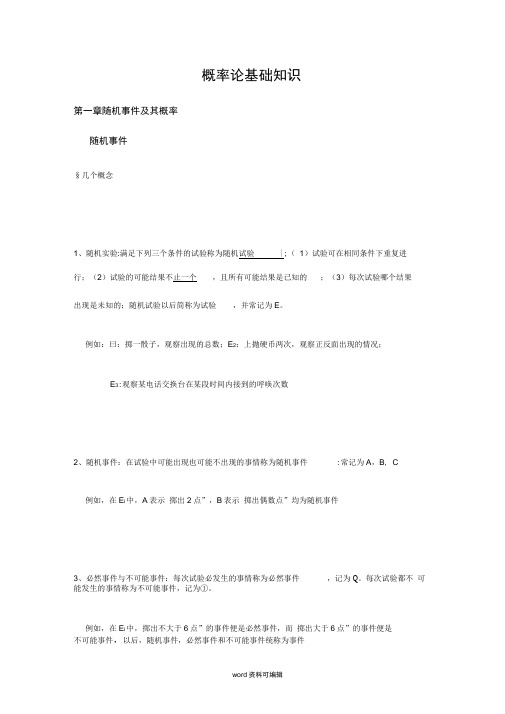

概率论基础讲义全

概率论基础知识第一章随机事件及其概率随机事件§几个概念1、随机实验:满足下列三个条件的试验称为随机试验|;(1)试验可在相同条件下重复进行;(2)试验的可能结果不止一个,且所有可能结果是已知的;(3)每次试验哪个结果出现是未知的;随机试验以后简称为试验,并常记为E。

例如:曰:掷一骰子,观察出现的总数;E2:上抛硬币两次,观察正反面出现的情况;E3:观察某电话交换台在某段时间内接到的呼唤次数2、随机事件:在试验中可能出现也可能不出现的事情称为随机事件:常记为A,B, C例如,在E i中,A表示掷出2点”,B表示掷出偶数点”均为随机事件3、必然事件与不可能事件:每次试验必发生的事情称为必然事件,记为Q。

每次试验都不可能发生的事情称为不可能事件,记为①。

例如,在E i中,掷出不大于6点”的事件便是必然事件,而掷出大于6点”的事件便是不可能事件,以后,随机事件,必然事件和不可能事件统称为事件4、基本事件:试验中直接观察到的最简单的结果称为基本事件。

例如,在曰中,掷出1点”,掷出2点”,……,掷'出6点”均为此试验的基本事件由基本事件构成的事件称为复,例如,在E i中掷出偶数点”便是复合事件5、样本空间:从集合观点看,称构成基本事件的元素为样本点,常记为e.例如,在E i中,用数字1, 2,......,6表示掷出的点数,而由它们分别构成的单点集{1}, {2}, (6)便是E i中的基本事件。

在E2中,用H表示正面,T表示反面,此试验的样本点有(H , H),( H , T),( T, H ),( T, T),其基本事件便是{ ( H, H) }, { ( H , T) }, { (T, H ) }, { (T, T) }显然,任何事件均为某些样本点构成的集合。

例如,在E i中掷出偶数点”的事件便可表为{2, 4, 6}。

试验中所有样本点构成的集合称为样本空间。

记为Qo例如,在E i 中,Q={1 , 2, 3, 4, 5, 6}在E2 中,Q={ ( H , H),( H , T),( T, H),( T, T) }在E s 中,Q={0 , 1, 2,……}例1, 一条新建铁路共10个车站,从它们所有车票中任取一张,观察取得车票的票种此试验样本空间所有样本点的个数为N Q=P 210=90.(排列:和顺序有关,如北京至天津、天津至北京)若观察的是取得车票的票价,则该试验样本空间中所有样本点的个数为10)=452(组合)例2 .随机地将15名新生平均分配到三个班级中去,观察15名新生分配的情况。

数学概率论基础

数学概率论基础概率论是数学中的一个重要分支,它研究随机现象的规律和统计规律。

它是从人们认识自然界和社会现象的客观需要中发展起来的。

概率论广泛应用于自然科学、社会科学、经济学、管理学等众多领域,是一门具有广泛应用价值的学科。

一、基本概念1. 随机事件在概率论中,随机事件指的是在一定的条件下,有可能发生也有可能不发生的事件。

例如,扔一枚硬币的结果是正面或反面,这就是一个随机事件。

2. 样本空间样本空间是指随机事件可能发生的所有结果的集合。

例如,扔一枚硬币的样本空间是{正面,反面}。

3. 事件事件是样本空间的子集,它是指某些结果的集合。

例如,扔一枚硬币出现正面就是一个事件。

4. 概率概率是指某个事件发生的可能性大小。

在概率论中,用一个介于0和1之间的实数表示概率。

概率为0表示不可能事件,概率为1表示必然事件。

例如,扔一枚硬币出现正面的概率为1/2。

二、概率计算1. 古典概型古典概型是指每个样本点的概率相等的情况。

例如,扔一枚均匀硬币的结果,正面和反面的概率都是1/2。

2. 几何概型几何概型是指样本空间可以用几何图形表示的情况。

例如,扔一颗骰子的结果,其样本空间是{1, 2, 3, 4, 5, 6},可以表示为一个六面体。

3. 条件概率条件概率是指在已知某个事件发生的条件下,另一个事件发生的概率。

条件概率用P(A|B)表示,表示在事件B发生的条件下,事件A发生的概率。

4. 独立事件独立事件指的是两个事件相互独立,一个事件的发生不受另一个事件发生与否的影响。

对于两个独立事件A和B,有P(A|B)=P(A),P(B|A)=P(B)。

三、概率分布1. 离散概率分布离散概率分布是指样本空间中的样本点是孤立的。

例如,扔一颗骰子的结果就是一个离散概率分布,每个结果的概率都是1/6。

2. 连续概率分布连续概率分布是指样本空间中的样本点是连续的。

例如,身高、体重等连续变量的概率分布就是连续概率分布,可以用概率密度函数表示。

概率论基础知识

两事件相互独立 P ( AB ) P ( A) P ( B ) 两事件互斥

AB

二者之间没 有必然联系

定义2: 设A,B,C是三个事件,若满足: P(AB)=P(A)P(B), P(AC)=P(A)P(C), P(BC)=P(B)P(C), P(ABC)=P(A)P(B)P(C) 则称A,B,C为相互独立的事件. 定义3:对n个事件A1,A2,…,An,如果对所有可 能的组合1≤i<j<k<…≤n成立着 P(AiAj)=P(Ai)P(Aj) P(AiAjAk)=P(Ai)P(Aj)P(Ak) P(A1A2…An)=P(A1)P(A2)…P(An), 则称这n个事件A1,A2,…,An相互独立.

概率的统计定义直观地描述了事件发生的 可能性大小,反映了概率的本质内容,但 也有不足,即无法根据此定义计算某事件 的概率。

2.2、古典概型

若随机试验满足以下特征:

(1)试验的可能结果只有有限个;

(2)各个结果的出现是等可能的. 则称此试验为古典概型.

古典概型中事件概率的计算公式

设随机试验E为古典概型,其样本空间Ω及 事件A分别为: Ω={ω1,ω2,…,ωn} A={ωi1,ωi2,…,ωik} 则随机事件 A 的概率为:

Ai — 第i次试验中A发生, 则

k P( X k ) Cn p k q nk , k 0,1,2,, n

称随机变量X服从参数为n,p的二项分布,记为

P( A n A1A 2 A n1 )

2.4 全概率公式和贝叶斯公式:

1. 样本空间的划分 定义 : 若B1, B2 , , Bn一组事件满足:

(i) Bi B j , i j, i, j 1, 2, ...,n,

概率论入门基础

概率论入门基础什么是概率论?概率论是数学中研究随机事件(事件结果不确定)的分支学科。

它研究的是可能事件发生的可能性大小以及各种事件之间的关系。

事件与样本空间在概率论中,事件是指可能发生或不发生的情况。

样本空间是指所有可能结果的集合,一个事件就是样本空间中的一个子集。

概率的定义概率是用来描述事件发生的可能性大小的量。

概率通常用一个介于0和1之间的数来表示,其中0表示不可能事件,1表示确定事件。

概率的计算方法1. 经验法则:根据事件发生的频率来估计概率。

2. 古典方法:根据事件的基本数量和总数量来计算概率。

3. 几何概率:根据事件在样本空间中的几何位置来计算概率。

概率的性质1. 非负性:概率值始终大于等于0。

2. 正则性:样本空间的概率为1。

3. 加法性:对于互斥事件,它们的概率可以相加。

4. 乘法性:对于独立事件,它们的概率可以相乘。

条件概率条件概率指的是在已知某个事件发生的前提下,另一个事件发生的概率。

条件概率可以通过下式计算:\\[P(A|B) = \frac{P(A \cap B)}{P(B)}\\]其中,\\(P(A \cap B)\\) 是事件A和事件B同时发生的概率,\\(P(B)\\) 是事件B发生的概率。

独立事件独立事件指的是两个事件之间没有相互影响的情况。

如果两个事件是独立的,那么它们的概率可以通过下式计算:\\[P(A \cap B) = P(A) \cdot P(B)\\]数学期望数学期望是衡量随机变量平均值的指标。

对于离散型随机变量,数学期望可以通过下式计算:\\[E(X) = \sum x \cdot P(X = x)\\]其中,\\(X\\) 是随机变量,\\(x\\) 是随机变量可能取到的值,\\(P(X = x)\\) 是随机变量取到该值的概率。

总结概率论是研究随机事件的数学学科,它涉及事件、样本空间、概率计算方法、条件概率、独立事件和数学期望等基本概念。

通过学习概率论,我们可以更好地理解随机事件发生的规律和概率计算的方法。

概率论基础

概率论基础1、概率基础知识1.1 引言先做两个简单的试验:试验1:一个盒子中有十个完全相同的白球,从中任意摸出一个;试验2:盒子中有十个完全相同的球,其中五个白球,五个红球。

对于试验1,在球没有取出之前,我们就能确定取出的必定是白球。

这种试验,根据试验开始的条件应可以确定实验的结果。

而对于试验2,在球没有取出之前,我们从试验开始时的条件不能确定试验的结果(即取出的是白球还是黑球),也就是说一次试验的结果在试验之前是无法确定的。

对于后一种试验,似乎没有什么规律可言,但是,实践告诉我们,若从盒子中反复多次取球(每次取出一球,记录其颜色后放回),那么可以观察到这样的事实:试验次数n相当大时,出现白球的次数n白和出现黑球的次数n红是很接近的,其比值n白/n红会逐渐稳定于?,这个事实是可以理解的,因为盒子里的白球数等于红球数,从中任意摸出一个,取得白球或红球的"机会"应该是平等的。

于是,我们面对着两种类型的试验。

试验1代表的类型在试验之前就能断定它的结果,这种试验所对应的现象叫确定现象。

比如:"早晨,太阳从东方升起""边长为a,b的矩形,其面积为ab"…过去我们所学的各门课程基本上都是用来处理和研究这类确定现象的。

试验2所代表的类型,它有多于一种可能的结果,但在一次试验之前会出现那种结果,应一次试验而言,没有规律可言,但是?quot;大数次"的重复这个试验,试验结果又遵循某些规律(这些规律我们称之为"统计规律"),这类试验叫做随机试验。

其代表的现象叫随机现象。

比如:"某地区的年降雨量""打靶时弹着点离靶心的距离""电话交换台单位时间内收到的用户的呼唤次数"…概率论和数理统计就是研究随机现象的统计规律的数学分科。

1.2 随机事件与样本空间我们在前面已经介绍了随机试验,现在再进一步明确其含义。

统计学中的概率论基础

统计学中的概率论基础概率论是统计学中的基础理论之一,它主要研究随机现象的规律性和不确定性。

概率论为我们提供了一种描述和分析随机事件发生概率的数学工具。

本文将介绍统计学中的概率论基础,包括概率的定义、概率的性质、基本概率分布以及重要的概率公式。

一、概率的定义在统计学中,我们通常用概率来描述事件发生的可能性。

概率的定义可以从频率的角度来解释,也可以从古典概型和几何概型的角度来解释。

从频率的角度来看,概率是指事件在重复试验中出现的比例。

例如,当抛掷一个均匀硬币时,正面朝上的概率为0.5,反面朝上的概率也为0.5。

从古典概型的角度来看,概率是指在有限个等可能结果中某个结果发生的可能性。

例如,在一次掷骰子的实验中,每个点数出现的概率均为1/6。

从几何概型的角度来看,概率是指由某个事件所组成的区域在整个样本空间中所占的比例。

例如,当在一个正方形区域内随机取一点,点落在正方形的某个子区域内的概率为子区域的面积与正方形面积之比。

二、概率的性质概率具有以下几个基本性质:1. 非负性:任何事件的概率都是非负的,即大于等于0。

2. 规范性:样本空间的概率为1,表示一定会发生某个结果。

3. 可列可加性:对于两个互斥事件,其概率之和等于这两个事件分别发生的概率之和。

三、基本概率分布在概率论中,有几个基本的概率分布可以帮助我们描述和分析随机变量的性质。

1. 二项分布:二项分布描述了在一系列独立重复的伯努利实验中成功次数的概率分布。

例如,抛掷硬币的次数是一个二项分布。

2. 泊松分布:泊松分布用于描述单位时间(或单位空间)内随机事件发生次数的概率分布。

例如,一定时间内到达某个商店的顾客数量可以用泊松分布来描述。

3. 正态分布:正态分布是一种常见的连续型概率分布,也称为高斯分布。

它在统计学和自然科学中有着广泛的应用,例如描述人群的身高分布、测量误差分布等。

四、重要的概率公式在概率论中,有一些重要的公式可以用于计算概率和推导概率分布。

概率论基础

均匀分布

对任意实数 x [a, b] ,若 a x x x b ,那么随机变量 X 位于区 间 [ x, x x] 内的概率为

P ( x X x x ) x x 1 x . dx x ba ba

例 盒中有 2 个白球 3 个黑球,从中随机取 3 个球, 求取得白球数的概 率分布.

二点分布

定义 若随机变量 X 的分布为

P( X 1) p , P( X 0) 1 p ,

则称 X 服从以 p 为参数的二点分布,或 0-1 分布.

二项分布

定义 若随机变量 X 的概率分布为

全概率公式

定义 对于集合 S , 集合 S 的一列非空子集 A1 , A2 ,, An 称为

S 的划分,如果这一列子集满足

(1) Ai Aj , i j , i, j 1, 2,, n ; (2) A 1 A2 An S .

定理(全概率公式) 设样本空间为 , A1 , A2 ,, An 是 的 一个划分,且 P( Ai ) 0 , i 1, 2,, n ,则事件 B 发生的概 率为

概率密度

定义 概率为 若存在非负函数 f ( x ) ,随机变量 X 在任意区间上的 ( a, b)

P(a X b) f ( x)dx ,

a

b

则称随机变量 X 为连续型随机变量, f ( x ) 称为 X 的概率密度函 数,简称密度函数或概率密度.

概率密度

例 设连续型随机变量 X 的概率密度为

2. 相互对立的事件概率之和为 1.即对任意的事件 A ,

P( A) P( A) 1 .

01-概率论基础

旳测度(长度、面积、体积等)成正比,而且 与g旳位置和形状无关

• 几何概型中随机事件Ag旳概率

g的测度 P(A g ) 的测度

例1.5 会面问题

• 已知甲、乙两人约定在6到7时间在某处会面,并约

定先到者应等待另一人20分钟,过时即可离去

(n 2)! 1

P(Ai A j )

n!

n(n 1)

把每封信放入一只信封中

P(Ai A jA k

)

(n

3)! n!

n(n

1 1)(n

2)

• 求至少有一封信与信封匹 配旳概率

• 解:

…

P(A1A 2

An

)

1 n!

所以有

– 若以Ai记第i封信与信封 匹配,则所求事件为 A1∪A2∪…∪An,所以,

Ω B

A

A-B

Ω A

A

例1.3 产品抽样检验

• 已知一批外形无差别旳产品 • 解:

中有3件次品,现随机地从 这批产品中依次抽取3件, 分别以A、B、C代表第一次、 第二次、第三次抽到次品

• 试表达

①三次都抽到次品

②只有第一次抽到次品

①三次都抽到次品:ABC

②只有第一次抽到次品:ABC

③三次都没有抽到次品:ABC ④至少抽到一件次品:A B C ⑤最多抽到一件次品,即A,

部可能出现旳成果 – 试验完毕之前不能预知会出现哪一种旳成果

• 样本空间():一种随机试验旳全部可能成 果旳集合

• 样本点():试验旳每一种可能成果

例1.2 随机现象旳样本空间

• 试列出例1.1中随机现象旳样本空间

概率论基础知识梳理

概率论基础知识梳理概率论基础知识梳理引言:概率论是一门重要的数学分支,它用于理解和预测随机事件的发生概率。

在日常生活中,我们经常面临各种各样的不确定性,例如天气变化、股市涨跌和彩票中奖等。

了解概率论的基础知识将帮助我们更好地分析和决策,从而在面对不确定性时做出明智的选择。

一、概率的基本概念和性质1.概率的定义:概率是描述一个事件发生的可能性大小的数值。

用P(A)表示事件A 发生的概率,0 ≤ P(A) ≤ 1。

2.概率的性质:- 事件的概率不会小于0,也不会大于1。

- 必然事件的概率为1,即P(S) = 1,其中S表示样本空间。

- 不可能事件的概率为0,即P(∅) = 0,其中∅表示空集。

- 对于任意两个互斥事件A和B,它们的联合概率为P(A ∪ B) = P(A) + P(B)。

二、条件概率和独立性1.条件概率:条件概率是指在已知事件B发生的条件下,事件A发生的概率。

用P(A|B)表示事件A在给定事件B的条件下发生的概率。

P(A|B) = P(A∩B) / P(B)。

2.乘法定理:乘法定理用于计算两个事件的联合概率,它表达为P(A∩B) = P(A|B) * P(B)。

3.独立事件:如果两个事件A和B满足P(A|B) = P(A),或者等价地,P(B|A) =P(B),则称事件A和事件B相互独立。

三、随机变量和概率分布1.随机变量:随机变量是对随机现象结果的数值化描述。

可以分为离散随机变量和连续随机变量。

离散随机变量只能取有限个或可数个值,例如抛硬币的结果(正面或反面)。

连续随机变量可以取任意实数值,例如测量某物体的长度。

2.概率分布:概率分布用于描述随机变量各个取值的概率。

离散随机变量用概率质量函数(PMF)表示,连续随机变量用概率密度函数(PDF)表示。

常见的离散概率分布有伯努利分布、二项分布和泊松分布;常见的连续概率分布有均匀分布、正态分布和指数分布等。

四、期望和方差1.期望:期望是对随机变量取值的加权平均值,用E(X)表示,其中X为随机变量。

概率论基础:入门知识点

概率论基础:入门知识点概率论是数学中的一个重要分支,研究随机事件发生的规律和概率计算的方法。

它在各个领域都有广泛的应用,如统计学、金融、工程等。

本文将介绍概率论的入门知识点,帮助读者了解概率论的基本概念和计算方法。

一、随机事件和样本空间在概率论中,我们将可能发生的事件称为随机事件。

样本空间是指所有可能的结果组成的集合。

例如,掷一枚硬币的结果可以是正面或反面,那么样本空间就是{正面,反面}。

样本空间用Ω表示。

二、事件的概率事件的概率是指事件发生的可能性大小。

概率的取值范围是0到1之间,其中0表示不可能发生,1表示一定发生。

概率用P(A)表示,其中A是一个事件。

三、事件的运算1. 事件的和:事件A和事件B的和是指事件A或事件B发生的情况。

用A∪B表示,读作“A并B”。

2. 事件的积:事件A和事件B的积是指事件A和事件B同时发生的情况。

用A∩B表示,读作“A交B”。

3. 事件的差:事件A和事件B的差是指事件A发生而事件B不发生的情况。

用A-B表示,读作“A减B”。

四、概率的计算方法1. 古典概型:当样本空间中的每个结果发生的概率相等时,可以使用古典概型计算概率。

例如,掷一枚均匀的骰子,每个面的概率都是1/6。

2. 频率概率:通过实验的频率来估计概率。

例如,掷一枚硬币,多次实验后正面朝上的频率接近于1/2。

3. 几何概率:通过几何方法计算概率。

例如,从一个正方形中随机选择一个点,落在某个区域内的概率等于该区域的面积与正方形的面积之比。

4. 条件概率:指在已知事件B发生的条件下,事件A发生的概率。

用P(A|B)表示,读作“在B发生的条件下A发生的概率”。

五、独立事件和互斥事件1. 独立事件:事件A和事件B是独立事件,当且仅当事件A的发生与事件B的发生是相互独立的,即P(A∩B) = P(A)P(B)。

2. 互斥事件:事件A和事件B是互斥事件,当且仅当事件A的发生与事件B的发生是互斥的,即P(A∩B) = 0。

概率论与数理统计知识点总结

概率论与数理统计知识点总结1. 概率论基础- 随机事件:一个事件是随机的,如果它可能发生也可能不发生。

- 样本空间:所有可能事件发生的集合。

- 事件的概率:事件发生的可能性的度量,满足0≤P(A)≤1。

- 条件概率:在另一个事件发生的条件下,一个事件发生的概率。

- 贝叶斯定理:描述了随机事件A和B的条件概率和边缘概率之间的关系。

- 独立事件:两个事件A和B是独立的,如果P(A∩B) = P(A)P(B)。

- 互斥事件:两个事件A和B是互斥的,如果它们不能同时发生,即P(A∩B) = 0。

2. 随机变量及其分布- 随机变量:将随机事件映射到实数的函数。

- 离散随机变量:取值为有限或可数无限的随机变量。

- 连续随机变量:可以在某个区间内取任意值的随机变量。

- 概率分布函数:描述随机变量取值的概率。

- 概率密度函数:连续随机变量的概率分布函数的导数。

- 累积分布函数:随机变量取小于或等于某个值的概率。

- 期望值:随机变量的长期平均值。

- 方差:衡量随机变量取值的离散程度。

3. 多维随机变量及其分布- 联合分布:描述两个或多个随机变量同时取特定值的概率。

- 边缘分布:通过联合分布求得的单个随机变量的分布。

- 条件分布:给定一个随机变量的值时,另一个随机变量的分布。

- 协方差:衡量两个随机变量之间的线性关系。

- 相关系数:协方差标准化后的值,表示变量间的线性相关程度。

4. 大数定律和中心极限定理- 大数定律:随着试验次数的增加,样本均值以概率1收敛于总体均值。

- 中心极限定理:独立同分布的随机变量之和,在适当的标准化后,其分布趋近于正态分布。

5. 数理统计基础- 样本:从总体中抽取的一部分个体。

- 总体:研究对象的全体。

- 参数估计:用样本统计量来估计总体参数。

- 点估计:给出总体参数的一个具体估计值。

- 区间估计:给出一个包含总体参数可能值的区间。

- 假设检验:对总体分布的某些假设进行检验。

- 显著性水平:拒绝正确假设的最大概率。

概率论基础知识

则 A 与 B 便是互不相容的。

7、对立:称事件 A 不发生的事件为 A 的对立事件,记为 显然

,A∩ =φ

例如,从有 3 个次品,7 个正品的 10 个产品中任取 3 个,若令 A={取得的 3 个产品中至少有一个次品},则 ={取得的 3 个产品均为正品}。

第 4 页 共 73 页

而 P(B)=3P(A)=

概率论基础知识

定义 1:在古典概型中,设其样本空间Ω所含的样本点总数,即试验的基本事件总数为 NΩ而事件 A 所 含的样本数,即有利于事件 A 发生的基本事件数为 NA,则事件 A 的概率便定义为:

例 1,将一枚质地均匀的硬币一抛三次,求恰有一次正面向上的概率。 解:用 H 表示正面,T 表示反面,则该试验的样本空间

若 A B,则 A∪ B=B, A∩ B=A A-B=A-AB= A

等等。

第 3 页 共 73 页

概率论基础知识

例 3,从一批产品中每次取一件进行检验,令 Ai={第 i 次取得合格品},i=1,2,3,试用事件的运算符号表示 下列事件。A={三次都取得合格品}B={三次中至少有一次取得合格品}C={三次中恰有两次取得合 格品}D={三次中最多有一次取得合格品}

2048 4040 12000 24000 30000

概率论基础知识

1061 2148 6019 12012 14994

0.5180 0.5069 0.5016 0.5005 0.4998

定义 2:在相同条件下,将试验重复 n 次,如果随着重复试验次数 n 的增大,事件 A 的频率 fn(A)越来越 稳定地在某一常数 p 附近摆动,则称常数 p 为事件 A 的概率,即 P(A)=p 不难证明频率有以下基本性质:

概率论基础与公式推导

概率论基础与公式推导概率论是一门研究随机事件发生规律和概率的学科,是统计学和数学中的一个重要分支。

概率论应用广泛,从自然科学到社会科学,都需要概率论提供对随机现象的理解和描述。

一、概率论基础1.1 随机试验与样本空间概率论的一个重要概念是随机试验。

随机试验是指在一定条件下进行的,所有相同情况下的实验结果不确定的试验。

试验的每一次实验结果称为试验的一个结果,所有可能的结果组成的集合就是样本空间。

样本空间用S表示,其中的元素称为样本点。

样本点的数目称为样本空间的基数。

1.2 事件与概率事件是指样本空间S的子集,即S的任何一个子集都是一个事件。

事件的概率是指事件发生的可能性或程度。

概率的数学定义为0到1之间的实数。

当事件不可能发生时,概率为0;当事件必然发生时,概率为1。

1.3 概率的性质概率具有以下性质:(1)非负性:对于任何事件A,有P(A)≥0。

(2)规范性:对于样本空间S,有P(S)=1。

(3)可列可加性:对于任何可列不相交事件Ai,有P(∪iAi)=ΣiP(Ai)。

(4)补事件概率:对于事件A,有P(A’)=1-P(A)。

二、公式推导2.1 条件概率条件概率是指在另一事件发生的情况下,所考虑事件发生的概率。

设事件B已经发生,事件A发生的概率为条件概率P(A|B)。

则有:P(A|B)=P(AB)/P(B)其中,P(AB)为事件A与事件B同时发生的概率,P(B)为事件B发生的概率。

2.2 乘法公式乘法公式是指将一个事件分解成多个子事件,从而求得该事件的概率。

设事件A与事件B独立,即事件B不受事件A的影响。

则有:P(AB)=P(A)P(B)2.3 加法公式加法公式是指将两个事件的概率相加,从而求得它们并集的概率。

设事件A与事件B不相交,即事件A与事件B无公共元素。

则有:P(A∪B)=P(A)+P(B)如果事件A与事件B不是不相交的,则有:P(A∪B)=P(A)+P(B)-P(AB)三、总结概率论是一门基础学科,但其应用却十分广泛。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

概率论的基础

1 预备知识

在开始介绍概率论之前,我们需要先了解一些预备知识。

1.1 集合运算

概率论中经常会涉及到集合运算,因此我们需要先了解集合运算

的基本概念。

集合是由一些确定的对象组成的整体。

我们用大写字母表示集合,用小写字母表示集合中的元素。

常见的集合运算有:

- 并集:将两个集合的元素合起来,得到包含这两个集合所有元

素的新集合。

记作A∪B。

- 交集:只将两个集合中都有的元素取出来,得到一个新的集合。

记作A∩B。

- 补集:集合A的补集是指集合U中所有不在A中的元素的集合。

记作A'或者A^c。

- 差集:从集合A中减去集合B中的元素,得到一个新的集合。

记作A-B。

1.2 条件概率

在概率论中,条件概率是指在已知一种事件发生的前提下,另一

种事件发生的概率。

记作P(B|A),表示在事件A发生的情况下,事件

B发生的概率。

条件概率的计算公式为:

$$P(B|A) = \frac{P(A\cap B)}{P(A)}$$

其中,P(A∩B)表示事件A和事件B同时发生的概率。

1.3 独立性

在概率论中,独立性是指两个事件的发生不会互相影响。

也就是说,当事件A发生与否对事件B发生的概率没有任何影响时,我们称

事件A和事件B是独立的。

如果事件A和事件B是独立的,那么有以下公式成立:

$$P(A\cap B) = P(A) \cdot P(B)$$

反之,如果有以上公式成立,那么我们可以认为事件A和事件B

是独立的。

2 概率的定义

概率是描述随机事件发生可能性的数值。

在概率论中,我们用P(E)表示事件E发生的概率。

2.1 古典概型

如果所有的结果都是等可能的,那么我们可以使用古典概型来计算概率。

例如,掷硬币和掷骰子都是古典概型,因为每一个结果都是等可能的。

在古典概型中,如果一个事件E可以由n个元素构成,且所有的元素等可能,那么事件E发生的概率就是:

$$P(E) = \frac{\text{符合事件E的结果个数}}{\text{总结果个数}} = \frac{n_E}{n}$$

2.2 条件概率法则

如果我们已知事件B发生,在B的基础上怎么计算事件A发生的概率呢?根据条件概率公式,我们有:

$$P(A|B) = \frac{P(A\cap B)}{P(B)}$$

这个公式被称为条件概率法则。

2.3 全概率法则

在一些情况下,我们无法直接计算一个事件的概率。

例如,一个箱子里有两种类型的球,红球和白球,我们不知道红球和白球各有多少个,但是我们知道从这个箱子里随机取一个球的概率是相等的。

这时我们需要使用全概率法则。

全概率法则的公式如下:

$$P(A) = \sum_i P(B_i) \cdot P(A|B_i)$$

其中,B1,B2,…,Bn是一组事件,它们构成了样本空间的一个划分。

也就是说,

$$B_1 \cup B_2 \cup \cdots \cup B_n = \Omega$$

3 概率的性质

概率有一些重要的性质。

这些性质对于后续的推导和计算非常有用,因此我们需要对它们进行了解和掌握。

3.1 非负性

概率是一个非负函数。

也就是说,对任何事件E来说,都有

P(E)≥0。

3.2 规范性

样本空间的概率是1。

也就是说,

$$P(\Omega) = 1$$

所有事件E的概率之和是1。

也就是说,

$$\sum_i P(E_i) = 1$$

3.3 可列可加性

如果事件E1,E2,…是两两不相交的事件,那么它们的并集

E1∪E2∪⋯是一个事件,其概率为:

$$P(E_1\cup E_2 \cup \cdots) = \sum_i P(E_i)$$

这条性质被称为可列可加性。

4 从概率论到统计学

概率论是统计学的理论基础。

统计学是利用数据来做出推断和决

策的科学。

在统计学中,我们需要用到概率的知识来分析和解释数据。

4.1 统计推断

统计推断是通过样本数据来推断总体特征。

样本是指从总体中抽

取的一部分数据。

总体是指所有数据的集合。

通过样本数据来推断总体概率分布的方法有很多种,例如点估计、区间估计和假设检验等。

4.2 假设检验

假设检验是统计学中常用的方法之一。

在假设检验中,我们需要

根据样本数据来推断总体特征,例如总体的均值或标准差等。

假设检验的步骤通常是:

1. 建立假设。

2. 收集样本数据。

3. 计算在假设成立的情况下样本数据出现的概率。

4. 比较这个概率和事先设定的显著性水平。

5. 根据比较的结果来接受或拒绝假设。

4.3 参数估计

参数估计是指根据样本数据来估计总体参数的值。

例如,我们可以通过样本均值来估计总体的均值。

参数估计的方法有很多种,例如最大似然估计和贝叶斯估计等。

5 总结

概率论是数学中的一个重要分支,是统计学的理论基础之一。

在概率论中,我们需要掌握集合运算、条件概率和独立性等基础知识。

同时,我们还需要学习概率的定义、概率的性质以及全概率法则等重要概念。

通过概率论的学习,我们可以更加深入地理解统计学中的相关理论和方法。