模式识别题目及答案

模式识别试卷及答案

模式识别试卷及答案一、选择题(每题5分,共30分)1. 以下哪一项不是模式识别的主要任务?A. 分类B. 回归C. 聚类D. 预测答案:B2. 以下哪种算法不属于监督学习?A. 支持向量机(SVM)B. 决策树C. K最近邻(K-NN)D. K均值聚类答案:D3. 在模式识别中,以下哪一项是特征选择的目的是?A. 减少特征维度B. 增强模型泛化能力C. 提高模型计算效率D. 所有上述选项答案:D4. 以下哪种模式识别方法适用于非线性问题?A. 线性判别分析(LDA)B. 主成分分析(PCA)C. 支持向量机(SVM)D. 线性回归答案:C5. 在神经网络中,以下哪种激活函数常用于输出层?A. SigmoidB. TanhC. ReLUD. Softmax答案:D6. 以下哪种聚类算法是基于密度的?A. K均值聚类B. 层次聚类C. DBSCAND. 高斯混合模型答案:C二、填空题(每题5分,共30分)1. 模式识别的主要任务包括______、______、______。

答案:分类、回归、聚类2. 在监督学习中,训练集通常分为______和______两部分。

答案:训练集、测试集3. 支持向量机(SVM)的基本思想是找到一个______,使得不同类别的数据点被最大化地______。

答案:最优分割超平面、间隔4. 主成分分析(PCA)是一种______方法,用于降维和特征提取。

答案:线性变换5. 神经网络的反向传播算法用于______。

答案:梯度下降6. 在聚类算法中,DBSCAN算法的核心思想是找到______。

答案:密度相连的点三、简答题(每题10分,共30分)1. 简述模式识别的基本流程。

答案:模式识别的基本流程包括以下几个步骤:(1)数据预处理:对原始数据进行清洗、标准化和特征提取。

(2)模型选择:根据问题类型选择合适的模式识别算法。

(3)模型训练:使用训练集对模型进行训练,学习数据特征和规律。

机器视觉与模式识别试题

机器视觉与模式识别试题一、简答题(每题10分,共10题)1. 请简要解释机器视觉的概念,并举例说明其在实际应用中的作用。

2. 什么是图像分割?请简要介绍常用的图像分割方法。

3. 请解释什么是特征提取,并描述至少两种常用的特征提取方法。

4. 什么是机器学习?简要描述监督学习和无监督学习的区别。

5. 请简要介绍常见的分类器,并说明它们的优缺点。

6. 什么是物体检测?请简要介绍常用的物体检测算法。

7. 请解释什么是模式识别,并举例说明其应用领域。

8. 简要介绍支持向量机(SVM)的原理及其应用。

9. 什么是深度学习?简要解释深度学习与传统机器学习的区别。

10. 简要介绍卷积神经网络(CNN)及其在图像分类中的应用。

二、分析题(共20分)1. 请分析图像分割的难点和挑战,并提出解决方案。

2. 请分析特征提取的关键问题,并探讨如何改进现有的特征提取方法。

3. 请分析支持向量机(SVM)的优势和不足,并提出使用SVM解决模式识别问题的注意事项。

4. 以人脸识别为例,分析深度学习模型相较于传统机器学习模型的优势和局限性。

三、应用题(共30分)1. 设计一个图像分类系统,能够将手写数字图像分为0~9十个类别。

请详细描述你的设计思路并给出实现代码。

2. 以目标检测为任务,设计一个基于卷积神经网络(CNN)的物体检测系统。

请详细描述你的设计思路并给出实现代码。

四、论述题(共40分)请综合所学的机器视觉与模式识别相关知识,自选一个课题进行深入探讨,并撰写一篇论文。

论文应包括问题定义、相关工作综述、解决方案设计和实验结果分析等内容。

请确保论文结构合理,逻辑清晰,表达准确。

以上是机器视觉与模式识别试题,根据题目要求,正文不再重复。

请根据试题内容自行判断和格式化撰写。

模式识别习题集答案解析

模式识别习题集答案解析1、PCA和LDA的区别?PCA是⼀种⽆监督的映射⽅法,LDA是⼀种有监督的映射⽅法。

PCA只是将整组数据映射到最⽅便表⽰这组数据的坐标轴上,映射时没有利⽤任何数据部的分类信息。

因此,虽然做了PCA后,整组数据在表⽰上更加⽅便(降低了维数并将信息损失降到了最低),但在分类上也许会变得更加困难;LDA在增加了分类信息之后,将输⼊映射到了另外⼀个坐标轴上,有了这样⼀个映射,数据之间就变得更易区分了(在低纬上就可以区分,减少了很⼤的运算量),它的⽬标是使得类别的点距离越近越好,类别间的点越远越好。

2、最⼤似然估计和贝叶斯⽅法的区别?p(x|X)是概率密度函数,X是给定的训练样本的集合,在哪种情况下,贝叶斯估计接近最⼤似然估计?最⼤似然估计把待估的参数看做是确定性的量,只是其取值未知。

利⽤已知的样本结果,反推最有可能(最⼤概率)导致这样结果的参数值(模型已知,参数未知)。

贝叶斯估计则是把待估计的参数看成是符合某种先验概率分布的随机变量。

对样本进⾏观测的过程,把先验概率密度转化为后验概率密度,利⽤样本的信息修正了对参数的初始估计值。

当训练样本数量趋于⽆穷的时候,贝叶斯⽅法将接近最⼤似然估计。

如果有⾮常多的训练样本,使得p(x|X)形成⼀个⾮常显著的尖峰,⽽先验概率p(x)⼜是均匀分布,此时两者的本质是相同的。

3、为什么模拟退⽕能够逃脱局部极⼩值?在解空间随机搜索,遇到较优解就接受,遇到较差解就按⼀定的概率决定是否接受,这个概率随时间的变化⽽降低。

实际上模拟退⽕算法也是贪⼼算法,只不过它在这个基础上增加了随机因素。

这个随机因素就是:以⼀定的概率来接受⼀个⽐单前解要差的解。

通过这个随机因素使得算法有可能跳出这个局部最优解。

4、最⼩错误率和最⼩贝叶斯风险之间的关系?基于最⼩风险的贝叶斯决策就是基于最⼩错误率的贝叶斯决策,换⾔之,可以把基于最⼩错误率决策看做是基于最⼩风险决策的⼀个特例,基于最⼩风险决策本质上就是对基于最⼩错误率公式的加权处理。

大学模式识别考试题及答案详解

大学模式识别考试题及答案详解Document number:PBGCG-0857-BTDO-0089-PTT1998一、填空与选择填空(本题答案写在此试卷上,30分)1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。

(1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。

(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2) (3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。

(1)二维空间(2)一维空间(3)N-1维空间7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。

(1)感知器算法(2)H-K算法(3)积累位势函数法8、下列四元组中满足文法定义的有(1)(2)(4)。

(1)({A, B}, {0, 1}, {A?01, A? 0A1 , A? 1A0 , B?BA , B? 0}, A)(2)({A}, {0, 1}, {A?0, A? 0A}, A)(3)({S}, {a, b}, {S ? 00S, S ? 11S, S ? 00, S ? 11}, S)(4)({A}, {0, 1}, {A?01, A? 0A1, A? 1A0}, A)二、(15分)简答及证明题(1)影响聚类结果的主要因素有那些?(2)证明马氏距离是平移不变的、非奇异线性变换不变的。

答:(1)分类准则,模式相似性测度,特征量的选择,量纲。

(2)证明:(2分)(2分)(1分)设,有非奇异线性变换:(1分)(4分)三、(8分)说明线性判别函数的正负和数值大小在分类中的意义并证明之。

模式识别作业题(1)

m 2 mn ] 是奇异的。 mn n 2

1

2、参考参考书 P314“模式识别的概要表示”画出第二章的知识结构图。 答:略。 3、现有两类分类问题。如下图所示, (1,

1 1 3 ) 、 ( , ) 、 (1, 3 ) 、 (1,-tan10°)为 3 2 2 3 3 ,- * tan 10° ) 、 (2,0)为 W2 类。 5 5

W1 类,其中(1,-tan10°)已知为噪声点; (1,0) 、 ( 自选距离度量方法和分类器算法,判别(

6 ,0)属于哪一类? 5

答:度量方法:根据题意假设各模式是以原点为圆心的扇状分布,以两个向量之间夹角(都 是以原点为起点)的余弦作为其相似性测度,P22。 然后使用 K 近邻法,K 取 3,求已知 7 个点与(

2

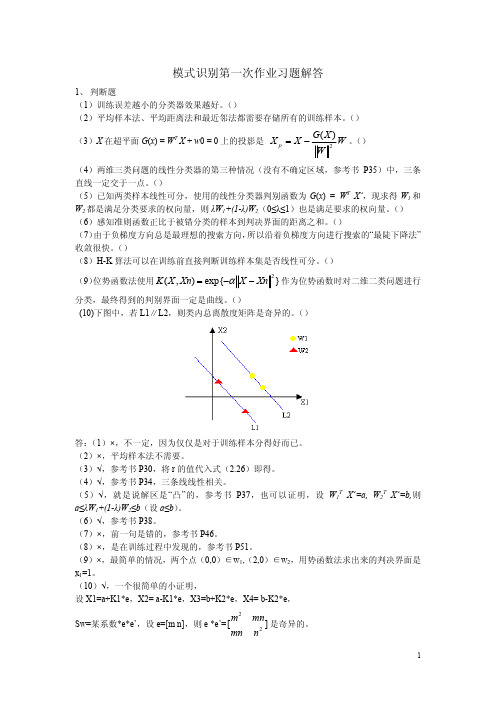

答: (1)×,不一定,因为仅仅是对于训练样本分得好而已。 (2)×,平均样本法不需要。 (3)√,参考书 P30,将 r 的值代入式(2.26)即得。 (4)√,参考书 P34,三条线线性相关。 ( 5 ) √ ,就是说解区是 “ 凸 ” 的,参考书 P37 ,也可以证明,设 W1T X’=a, W2T X’=b, 则 a≤λW1+(1-λ)W2≤b(设 a≤b) 。 (6)√,参考书 P38。 (7)×,前一句是错的,参考书 P46。 (8)×,是在训练过程中发现的,参考书 P51。 (9)×,最简单的情况,两个点(0,0)∈w1,(2,0)∈w2,用势函数法求出来的判决界面是 x1=1。 (10)√,一个很简单的小证明, 设 X1=a+K1*e,X2= a-K1*e,X3=b+K2*e,X4= b-K2*e, Sw=某系数*e*e’,设 e=[m n],则 e *e’= [

方法三:参照“两维三类问题的线性分类器的第二种情况(有不确定区域) ”的算法,求 G12,G23,G13。 G12*x1>0, G12*x2<0, G12=(-1,-1,-1)’ G23*x2>0, G23*x3<0, G23=(-1,-1,1)’ G13*x1>0, G13*x3<0, G12=(-1,-1,1)’ 有两条线重合了。

模式识别(三)课后上机作业参考解答

“模式识别(三).PDF”课件课后上机选做作业参考解答(武大计算机学院袁志勇, Email: yuanzywhu@) 上机题目:两类问题,已知四个训练样本ω1={(0,0)T,(0,1)T};ω2={(1,0)T,(1,1)T}使用感知器固定增量法求判别函数。

设w1=(1,1,1)Tρk=1试编写程序上机运行(使用MATLAB、 C/C++、C#、JA V A、DELPHI等语言中任意一种编写均可),写出判别函数,并给出程序运行的相关运行图表。

这里采用MATLAB编写感知器固定增量算法程序。

一、感知器固定增量法的MATLAB函数编写感知器固定增量法的具体内容请参考“模式识别(三).PDF”课件中的算法描述,可将该算法编写一个可以调用的自定义MATLAB函数:% perceptronclassify.m%% Caculate the optimal W by Perceptron%% W1-3x1 vector, initial weight vector% Pk-scalar, learning rate% W -3x1 vector, optimal weight vector% iters - scalar, the number of iterations%% Created: May 17, 2010function [W iters] = perceptronclassify(W1,Pk)x1 = [0 0 1]';x2 = [0 1 1]';x3 = [1 0 1]';x4 = [1 1 1]';% the training sampleWk = W1;FLAG = 0;% iteration flagesiters = 0;if Wk'*x1 <= 0Wk =Wk + x1;FLAG = 1;endif Wk'*x2 <= 0Wk =Wk + x2;FLAG = 1;endif Wk'*x3 >= 0Wk=Wk-x3;FLAG = 1; endif Wk'*x4 >= 0Wk =Wk -x4; FLAG = 1; enditers = iters + 1; while (FLAG) FLAG = 0; if Wk'*x1 <= 0Wk = Wk + x1; FLAG = 1; endif Wk'*x2 <= 0Wk = Wk + x2; FLAG = 1; endif Wk'*x3 >= 0 Wk = Wk - x3; FLAG = 1; endif Wk'*x4 >= 0 Wk = Wk - x4; FLAG = 1; enditers = iters + 1; endW = Wk;二、程序运行程序输入:初始权向量1W , 固定增量大小k ρ 程序输出:权向量最优解W , 程序迭代次数iters 在MATLAB 7.X 命令行窗口中的运行情况: 1、初始化1[111]T W = 初始化W 1窗口界面截图如下:2、初始化1kρ=初始化Pk 窗口界面截图如下:3、在MATLAB 窗口中调用自定义的perceptronclassify 函数由于perceptronclassify.m 下自定义的函数文件,在调用该函数前需要事先[Set path…]设置该函数文件所在的路径,然后才能在命令行窗口中调用。

计算机视觉测试题目及答案

计算机视觉测试题目及答案在计算机视觉领域,测试题目是评估一个人对于图像处理、模式识别和计算机视觉理论的理解和应用能力的重要方法。

下面将给出一些常见的计算机视觉测试题目及其答案,希望能够帮助您更好地了解和掌握相关知识。

1. 图像处理题目:请简要说明什么是图像处理,并列举三种常见的图像处理操作。

答案:图像处理是指对于数字图像进行一系列的操作,以改善图像质量、提取图像特征或实现其他目标的过程。

常见的图像处理操作包括:灰度化、平滑滤波、边缘检测、直方图均衡化、二值化、图像加减运算、图像变换等。

2. 模式识别题目:请简要说明什么是模式识别,并列举三种常用的模式识别方法。

答案:模式识别是指通过对输入模式进行学习和分类,从而实现对未知模式的自动识别的过程。

常用的模式识别方法包括:最近邻算法(K-Nearest Neighbor,KNN)、支持向量机(Support Vector Machine,SVM)、人工神经网络(Artificial Neural Network,ANN)、决策树(Decision Tree)、隐马尔可夫模型(Hidden Markov Model,HMM)等。

3. 计算机视觉理论题目:请简要说明什么是计算机视觉,并介绍计算机视觉的应用领域。

答案:计算机视觉是指通过计算机模拟人类视觉系统的信息处理机制,实现对数字图像或视频的自动分析、理解和处理的学科。

计算机视觉的应用领域非常广泛,包括目标检测与跟踪、人脸识别、视频监控、机器人导航、医学影像分析、自动驾驶等。

4. 图像特征提取题目:请简要说明什么是图像特征提取,并列举三种常用的图像特征。

答案:图像特征提取是指通过对图像进行一系列数学或统计操作,提取出图像中携带有重要信息的特征表示的过程。

常用的图像特征包括:颜色直方图、纹理特征(如灰度共生矩阵)、形状特征(如边缘直方图、轮廓描述子)以及局部特征(如SIFT、SURF等)。

5. 图像分类题目:请简要说明什么是图像分类,并介绍图像分类的主要步骤。

大学模式识别考试题及答案详解完整版

大学模式识别考试题及答案详解HUA system office room 【HUA16H-TTMS2A-HUAS8Q8-HUAH1688】一、填空与选择填空(本题答案写在此试卷上,30分)1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。

(1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。

(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2) (3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。

(1)二维空间(2)一维空间(3)N-1维空间7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。

(1)感知器算法(2)H-K算法(3)积累位势函数法8、下列四元组中满足文法定义的有(1)(2)(4)。

(1)({A, B}, {0, 1}, {A01, A 0A1 , A 1A0 , B BA , B 0}, A)(2)({A}, {0, 1}, {A0, A 0A}, A)(3)({S}, {a, b}, {S 00S, S 11S, S 00, S 11}, S)(4)({A}, {0, 1}, {A01, A 0A1, A 1A0}, A)二、(15分)简答及证明题(1)影响聚类结果的主要因素有那些?(2)证明马氏距离是平移不变的、非奇异线性变换不变的。

答:(1)分类准则,模式相似性测度,特征量的选择,量纲。

(2)证明:(2分)(2分)(1分)设,有非奇异线性变换:(1分)(4分)三、(8分)说明线性判别函数的正负和数值大小在分类中的意义并证明之。

模式识别习题及答案

模式识别习题及答案模式识别习题及答案模式识别是人类智能的重要组成部分,也是机器学习和人工智能领域的核心内容。

通过模式识别,我们可以从大量的数据中发现规律和趋势,进而做出预测和判断。

本文将介绍一些模式识别的习题,并给出相应的答案,帮助读者更好地理解和应用模式识别。

习题一:给定一组数字序列,如何判断其中的模式?答案:判断数字序列中的模式可以通过观察数字之间的关系和规律来实现。

首先,我们可以计算相邻数字之间的差值或比值,看是否存在一定的规律。

其次,我们可以将数字序列进行分组,观察每组数字之间的关系,看是否存在某种模式。

最后,我们还可以利用统计学方法,如频率分析、自相关分析等,来发现数字序列中的模式。

习题二:如何利用模式识别进行图像分类?答案:图像分类是模式识别的一个重要应用领域。

在图像分类中,我们需要将输入的图像分为不同的类别。

为了实现图像分类,我们可以采用以下步骤:首先,将图像转换为数字表示,如灰度图像或彩色图像的像素矩阵。

然后,利用特征提取算法,提取图像中的关键特征。

接下来,选择合适的分类算法,如支持向量机、神经网络等,训练模型并进行分类。

最后,评估分类结果的准确性和性能。

习题三:如何利用模式识别进行语音识别?答案:语音识别是模式识别在语音信号处理中的应用。

为了实现语音识别,我们可以采用以下步骤:首先,将语音信号进行预处理,包括去除噪声、降低维度等。

然后,利用特征提取算法,提取语音信号中的关键特征,如梅尔频率倒谱系数(MFCC)。

接下来,选择合适的分类算法,如隐马尔可夫模型(HMM)、深度神经网络(DNN)等,训练模型并进行语音识别。

最后,评估识别结果的准确性和性能。

习题四:如何利用模式识别进行时间序列预测?答案:时间序列预测是模式识别在时间序列分析中的应用。

为了实现时间序列预测,我们可以采用以下步骤:首先,对时间序列进行平稳性检验,确保序列的均值和方差不随时间变化。

然后,利用滑动窗口或滚动平均等方法,将时间序列划分为训练集和测试集。

(完整word版)模式识别题目及答案(word文档良心出品)

一、(15分)设有两类正态分布的样本集,第一类均值为T1μ=(2,0),方差11⎡⎤∑=⎢⎥⎣⎦11/21/2,第二类均值为T2μ=(2,2),方差21⎡⎤∑=⎢⎥⎣⎦1-1/2-1/2,先验概率12()()p p ωω=,试求基于最小错误率的贝叶斯决策分界面。

解 根据后验概率公式()()()()i i i p x p p x p x ωωω=, (2’)及正态密度函数11/21()exp[()()/2]2T i i i i nip x x x ωμμπ-=--∑-∑ ,1,2i =。

(2’) 基于最小错误率的分界面为1122()()()()p x p p x p ωωωω=, (2’) 两边去对数,并代入密度函数,得1111112222()()/2ln ()()/2ln T T x x x x μμμμ----∑--∑=--∑--∑ (1) (2’)由已知条件可得12∑=∑,114/3-⎡⎤∑=⎢⎥⎣⎦4/3-2/3-2/3,214/3-⎡⎤∑=⎢⎥⎣⎦4/32/32/3,(2’)设12(,)Tx x x =,把已知条件代入式(1),经整理得1221440x x x x --+=, (5’)二、(15分)设两类样本的类内离散矩阵分别为11S ⎡⎤=⎢⎥⎣⎦11/21/2, 21S ⎡⎤=⎢⎥⎣⎦1-1/2-1/2,各类样本均值分别为T 1μ=(1,0),T2μ=(3,2),试用fisher 准则求其决策面方程,并判断样本Tx =(2,2)的类别。

解:122S S S ⎡⎤=+=⎢⎥⎣⎦200 (2’) 投影方向为*112-2-1()211/2w S μμ-⎡⎤⎡⎤⎡⎤=-==⎢⎥⎢⎥⎢⎥--⎣⎦⎣⎦⎣⎦1/200 (6’)阈值为[]*0122()/2-1-131T y w μμ⎡⎤=+==-⎢⎥⎣⎦(4’)给定样本的投影为[]*0-12241T y w x y ⎡⎤===-<⎢⎥-⎣⎦, 属于第二类 (3’)三、 (15分)给定如下的训练样例实例 x0 x1 x2 t(真实输出) 1 1 1 1 1 2 1 2 0 1 3 1 0 1 -1 4 1 1 2 -1用感知器训练法则求感知器的权值,设初始化权值为0120w w w ===;1 第1次迭代(4’)2 第2次迭代(2’)3 第3和4次迭代四、 (15分)i. 推导正态分布下的最大似然估计;ii. 根据上步的结论,假设给出如下正态分布下的样本{}1,1.1,1.01,0.9,0.99,估计该部分的均值和方差两个参数。

模式识别期末考试题及答案

模式识别期末考试题及答案一、填空题1. 模式识别是研究通过_________从观测数据中自动识别和分类模式的一种学科。

答案:计算机算法2. 在模式识别中,特征选择的主要目的是_________。

答案:降低数据的维度3. 支持向量机(SVM)的基本思想是找到一个最优的超平面,使得两类数据的_________最大化。

答案:间隔4. 主成分分析(PCA)是一种_________方法,用于降低数据的维度。

答案:线性降维5. 隐马尔可夫模型(HMM)是一种用于处理_________数据的统计模型。

答案:时序二、选择题6. 以下哪种方法不属于模式识别的监督学习方法?()A. 线性判别分析B. 支持向量机C. 神经网络D. K-means聚类答案:D7. 在以下哪种情况下,可以使用主成分分析(PCA)进行特征降维?()A. 数据维度较高,且特征之间存在线性关系B. 数据维度较高,且特征之间存在非线性关系C. 数据维度较低,且特征之间存在线性关系D. 数据维度较低,且特征之间存在非线性关系答案:A8. 以下哪个算法不属于聚类算法?()A. K-meansB. 层次聚类C. 判别分析D. 密度聚类答案:C三、判断题9. 模式识别的目的是将输入数据映射到事先定义的类别中。

()答案:正确10. 在模式识别中,特征提取和特征选择是两个不同的概念,其中特征提取是将原始特征转换为新的特征,而特征选择是从原始特征中筛选出有用的特征。

()答案:正确四、简答题11. 简述模式识别的主要任务。

答案:模式识别的主要任务包括:分类、回归、聚类、异常检测等。

其中,分类和回归任务属于监督学习,聚类和异常检测任务属于无监督学习。

12. 简述支持向量机(SVM)的基本原理。

答案:支持向量机的基本原理是找到一个最优的超平面,使得两类数据的间隔最大化。

具体来说,SVM通过求解一个凸二次规划问题来确定最优超平面,使得训练数据中的正类和负类数据点尽可能远离这个超平面。

模式识别课后习题答案

– (1) E{ln(x)|w1} = E{ln+1(x)|w2} – (2) E{l(x)|w2} = 1 – (3) E{l(x)|w1} − E2{l(x)|w2} = var{l(x)|w2}(教材中题目有问题) 证∫ 明ln+:1p对(x于|w(12)),dxE={ln∫(x()∫p(|wp(x(1x|}w|w=1)2))∫n)+nl1nd(xx)所p(x以|w∫,1)Ed{xln=(x∫)|w(1p(}p(x(=x|w|Ew1)2{))ln)n+n+11d(xx)又|wE2}{ln+1(x)|w2} = 对于(2),E{l(x)|w2} = l(x)p(x|w2)dx = p(x|w1)dx = 1

对于(3),E{l(x)|w1} − E2{l(x)|w2} = E{l2(x)|w2} − E2{l(x)|w2} = var{l(x)|w2}

• 2.11 xj(j = 1, 2, ..., n)为n个独立随机变量,有E[xj|wi] = ijη,var[xj|wi] = i2j2σ2,计 算在λ11 = λ22 = 0 及λ12 = λ21 = 1的情况下,由贝叶斯决策引起的错误率。(中心极限 定理)

R2

R1

容易得到

∫

∫

p(x|w2)dx = p(x|w1)dx

R1

R2

所以此时最小最大决策面使得P1(e) = P2(e)

• 2.8 对于同一个决策规则判别函数可定义成不同形式,从而有不同的决策面方程,指出 决策区域是不变的。

3

模式识别(第二版)习题解答

模式识别复习要点和参考习题汇总

复习要点绪论1、举出日常生活或技术、学术领域中应用模式识别理论解决问题的实例。

答:我的本科毕设内容和以后的研究方向为重症监护病人的状态监测及预诊断,其中的第一步就是进展病人的死亡率预测,及模式识别理论密切相关。

主要的任务是分析数据库的8000名病人,统计分析死亡及非死亡的生理特征,用于分析预测新进病人的病情状态。

按照模式识别的方法步骤,首先从数据库中采集数据,包括病人的固有信息,生理信息,事件信息等并分为死亡组和非死亡组,然后分别进展数据的预处理,剔除不正常数据,对数据进展插值并取中值进展第一次特征提取,然后利用非监视学习的方法即聚类分析进展第二次特征提取,得到训练样本集和测试样本集。

分别利用判别分析,人工神经网络,支持向量机的方法进展训练,测试,得到分类器,实验效果比传统中采用的评价预测系统好一些。

由于两组数据具有较大重叠,特征提取,即提取模式特征就变得尤为重要。

语音识别,图像识别,车牌识别,文字识别,人脸识别,通信中的信号识别;① 文字识别汉字已有数千年的历史,也是世界上使用人数最多的文字,对于中华民族灿烂文化的形成和开展有着不可磨灭的功勋。

所以在信息技术及计算机技术日益普及的今天,如何将文字方便、快速地输入到计算机中已成为影响人机接口效率的一个重要瓶颈,也关系到计算机能否真正在我过得到普及的应用。

目前,汉字输入主要分为人工键盘输入和机器自动识别输入两种。

其中人工键入速度慢而且劳动强度大;自动输入又分为汉字识别输入及语音识别输入。

从识别技术的难度来说,手写体识别的难度高于印刷体识别,而在手写体识别中,脱机手写体的难度又远远超过了联机手写体识别。

到目前为止,除了脱机手写体数字的识别已有实际应用外,汉字等文字的脱机手写体识别还处在实验室阶段。

②语音识别语音识别技术技术所涉及的领域包括:信号处理、模式识别、概率论和信息论、发声机理和听觉机理、人工智能等等。

近年来,在生物识别技术领域中,声纹识别技术以其独特的方便性、经济性和准确性等优势受到世人瞩目,并日益成为人们日常生活和工作中重要且普及的安验证方式。

工业自动化中的机器视觉与模式识别考核试卷

4.深度学习通过卷积神经网络(CNN)等模型进行图像识别。CNN能自动学习图像特征,应用于图像分类、目标检测等领域,如人脸识别、物体分类等。

10.机器视觉中的模式识别技术可以用于无人驾驶汽车的环境感知。()

考生姓名:________答题日期:________得分:________判卷人:________

五、主观题(本题共4小题,每题10分,共40分)

1.请简述机器视觉系统在工业自动化中的应用,并列举至少三种常见的应用场景。

2.请解释什么是模式识别,并讨论其在机器视觉中的作用和重要性。

A. SVM

B. KNN

C.决策树

D.神经网络

17.下列哪种图像处理技术可以改变图像的对比度?()

A.直方图均衡化

B.滤波

C.灰度化

D.缩放

18.在机器视觉中,哪种镜头适用于大视场角图像采集?()

A.定焦镜头

B.变焦镜头

C.广角镜头

D.长焦镜头

19.下列哪种技术可以用于机器视觉中的三维重建?()

A.双目视觉

1.在机器视觉中,图像的像素分辨率是由______和______共同决定的。

2.常用的图像特征提取方法中,SIFT的全称是______。

3.在工业自动化中,机器视觉系统通常需要与______和______结合使用,以完成复杂的任务。

4.用于图像分割的边缘检测算法中,______算子对噪声较为敏感。

5.在模式识别中,K-means算法是一种______学习方法。

B.多对多

C.多对一

D.直接多分类

17.以下哪些是机器视觉在医疗影像分析中的应用?()

北航2019-2020学年第二学期期末《模式识别基础》试题

2019-2020学年第二学期期末《模式识别基础》试题考试日期:2020年6月17日,上午9:50–12:20 (满分100分)考试科目:《模式识别基础》学号:姓名:注意事项:1、请大家仔细审题,不要漏掉题目2、不要互相交流答案,杜绝试卷雷同一、单选题(每题2分,共10题)1. 下列不属于模式识别系统的基本构成单元的是( )A. 模式采集B. 特征选择与提取C. 模式分类D. 软件界面设计2. 下列不属于模式识别应用范畴的是()A. 利用书写板向计算机输入汉字B. 利用扫描仪向计算机输入图片C. 利用指纹来鉴定人的身份D. 利用语音向计算机输入汉字3. 哪条是贝叶斯分类器必须满足的先决条件( )A. 类别数已知且一定B. 每个类别的样本数已知C. 所有样本的总样本数已知D. 样本特征维度已知且一定4. Parzen窗法做概率密度估计时,当窗宽度变得很小时,容易出现( )A.噪声变弱B. 稳定性变差C. 分辨率变低D. 连续性变好5. 下面不属于非参数估计方法的是( )A. 直方图估计B. Parzen窗估计C. 贝叶斯估计D. K近邻估计6. Fisher线性判别函数的求解过程是将N维特征矢量投影在( )中进行A. 二维空间B. 一维空间C. (N-1)维空间D. N维空间7. 影响聚类算法结果的主要因素不包括( )A. 分类准则B. 已知类别的样本质量C. 特征选取D. 模式相似性测度8. 下列不属于估计量评价标准的是( )A. 无偏性B. 有效性C. 一致性D. 收敛性9. 关于感知器准则,以下说法错误的是( )A. 要求样本是线性可分的B. 可以用梯度下降法求解C. 当样本线性不可分时,感知器算法不能收敛D. 不能随意确定初始权向量10. 对于k均值(C均值)聚类算法,初始类心的选取非常重要,相比较而言,当对数据有一定了解时,如何选择c个样本作为初始类心较好( )A. 按输入顺序选B. 选相距最远的C. 随机挑选D. 选分布密度最高处的二、判断题(正确用“T”表示,错误用“F”表示;每题2分,共10题)1.模式所指的不是事物本身,而是从事物获得的信息,因此,模式往往表现为具有时间和空间分布的信息。

《模式识别》(边肇祺)习题答案

• 2.13 把连续情况的最小错误率贝叶斯决策推广到离散情况,并写出其判别函数。 • 2.14 写出离散情况条件风险R(ai |x)的定义,并指出其决策规则。 解: R(ai |x) = = R(ak |x) = min

c ∑ j =1 c ∑ j =1

λij P (wj |x) λij p(x|wj )P (wj )////omit the same part p(x)

1

模式识别(第二版)习题解答

§1

绪论

略

§2

贝叶斯决策理论

• 2.1 如果只知道各类的先验概率,最小错误率贝叶斯决策规则应如何表示? 解:设一个有C 类,每一类的先验概率为P (wi ),i = 1, ..., C 。此时最小错误率贝叶斯 决策规则为:如果i∗ = max P (wi ),则x ∈ wi 。

• 2.4 分别写出在以下两种情况 1. P (x|w1 ) = P (x|w2 ) 2. P (w1 ) = P (w2 ) 下的最小错误率贝叶斯决策规则。 解: 当P (x|w1 ) = P (x|w2 )时,如果P (w1 ) > P (w2 ),则x ∈ w1 ,否则x ∈ w2 。 当P (w1 ) = P (w2 )时,如果P (x|w1 ) > P (x|w2 ),则x ∈ w1 ,否则x ∈ w2 。 • 2.5 1. 对c类情况推广最小错误率率贝叶斯决策规则; 2. 指出此时使错误率最小等价于后验概率最大,即P (wi |x) > P (wj |x) 对一切j ̸= i 成立时,x ∈ wi 。 2

p(x|w2 )dx =

R2

p(x|w1 )dx

所以此时最小最大决策面使得P1 (e) = P2 (e) • 2.8 对于同一个决策规则判别函数可定义成不同形式,从而有不同的决策面方程,指出 决策区域是不变的。

模式识别习题及答案

第一章 绪论1.什么是模式?具体事物所具有的信息。

模式所指的不是事物本身,而是我们从事物中获得的___信息__。

2.模式识别的定义?让计算机来判断事物。

3.模式识别系统主要由哪些部分组成?数据获取—预处理—特征提取与选择—分类器设计/ 分类决策。

第二章 贝叶斯决策理论1.最小错误率贝叶斯决策过程? 答:已知先验概率,类条件概率。

利用贝叶斯公式得到后验概率。

根据后验概率大小进行决策分析。

2.最小错误率贝叶斯分类器设计过程?答:根据训练数据求出先验概率类条件概率分布 利用贝叶斯公式得到后验概率如果输入待测样本X ,计算X 的后验概率根据后验概率大小进行分类决策分析。

3.最小错误率贝叶斯决策规则有哪几种常用的表示形式? 答:4.贝叶斯决策为什么称为最小错误率贝叶斯决策?答:最小错误率Bayes 决策使得每个观测值下的条件错误率最小因而保证了(平均)错误率 最小。

Bayes 决策是最优决策:即,能使决策错误率最小。

5.贝叶斯决策是由先验概率和(类条件概率)概率,推导(后验概率)概率,然后利用这个概率进行决策。

6.利用乘法法则和全概率公式证明贝叶斯公式答:∑====mj Aj p Aj B p B p A p A B p B p B A p AB p 1)()|()()()|()()|()(所以推出贝叶斯公式7.朴素贝叶斯方法的条件独立假设是(P(x| ωi) =P(x1, x2, …, xn | ωi)⎩⎨⎧∈>=<211221_,)(/)(_)|()|()(w w x w p w p w x p w x p x l 则如果∑==21)()|()()|()|(j j j i i i w P w x P w P w x P x w P 2,1),(=i w P i 2,1),|(=i w x p i ∑==21)()|()()|()|(j j j i i i w P w x P w P w x P x w P ∑===Mj j j i i i i i A P A B P A P A B P B P A P A B P B A P 1)()|()()|()()()|()|(= P(x1| ωi) P(x2| ωi)… P(xn| ωi))8.怎样利用朴素贝叶斯方法获得各个属性的类条件概率分布?答:假设各属性独立,P(x| ωi) =P(x1, x2, …, xn | ωi) = P(x1| ωi) P(x2| ωi)… P(xn| ωi) 后验概率:P(ωi|x) = P(ωi) P(x1| ωi) P(x2| ωi)… P(xn| ωi)类别清晰的直接分类算,如果是数据连续的,假设属性服从正态分布,算出每个类的均值方差,最后得到类条件概率分布。

模式识别第二版答案完整版

1. 对c类情况推广最小错误率率贝叶斯决策规则; 2. 指出此时使错误率最小等价于后验概率最大,即P (wi|x) > P (wj|x) 对一切j ̸= i

成立时,x ∈ wi。

2

模式识别(第二版)习题解答

解:对于c类情况,最小错误率贝叶斯决策规则为: 如果 P (wi|x) = max P (wj|x),则x ∈ wi。利用贝叶斯定理可以将其写成先验概率和

(2) Σ为半正定矩阵所以r(a, b) = (a − b)T Σ−1(a − b) ≥ 0,只有当a = b时,才有r(a, b) = 0。

(3) Σ−1可对角化,Σ−1 = P ΛP T

h11 h12 · · · h1d

• 2.17 若将Σ−1矩阵写为:Σ−1 = h...12

h22 ...

P (w1) P (w2)

= 0。所以判别规则为当(x−u1)T (x−u1) > (x−u2)T (x−u2)则x ∈ w1,反

之则s ∈ w2。即将x判给离它最近的ui的那个类。

[

• 2.24 在习题2.23中若Σ1 ̸= Σ2,Σ1 =

1

1

2

策规则。

1]

2

1

,Σ2

=

[ 1

−

1 2

−

1 2

] ,写出负对数似然比决

1

6

模式识别(第二版)习题解答

解:

h(x) = − ln [l(x)]

= − ln p(x|w1) + ln p(x|w2)

=

1 2 (x1

−

u1)T

Σ−1 1(x1

−

u1)

−

1 2 (x2

模式识别与图像处理习题及解答

(b)当邻域中心移到某一像素时,首先对邻域元素进行排序,并储存其中值;然后邻域 中心移动到下一像素,再次对邻域元素进行排序,用该次排序的中值替换上次排序的中值; 如此逐个像素重复该过程,直至邻域中心逐个移动过图像的所有像素。 3. 说明式 1、2 代表的滤波器类型(带阻滤波器或带通滤波器) 。并写出其相对应的带阻/带 通->带通/带阻滤波器数学表达式子。

(1)

2

H (u , v ) 1 e

1 H (u , v) 得到,为:

( 2)

答: 式子( 1 )表示的滤波器为带阻滤波器,其相应的带通滤波器的表达式通过计算

0, H (u , v) 1, 0,

W 2 W W D0 , v) D0 2 D (u , v) D0

8 试从模式类与模式概念分析以下词之间的关系: 王老头,王老太,王明(广西大学学生) , 周强(年轻教师) ,老年人,老头,老太,年青人。 答案: 答:模式类:老年人 模式:王老太,老头,老太。 模式类:年青人 模式:王明(广西大学学生) ,周强(年轻教师) 模式类:老头 模式:王老头 模式类:老太 模式:王老太 9 canny 算法 答:step1:用高斯滤波器平滑图象; step2:用一阶偏导的有限差分来计算梯度的幅值和方向; step3:对梯度幅值进行非极大值抑制;step4:用双阈值算法检测和连接边缘。 10 KD 树原理与应用“ 答:k-d 树是早期发明的一种用于多维检索的树结构,它每一层都根据特定的关键码将对象 空间分解为两个, 在每一层用来进行决策的关键码称为识别器。 在结点分配的时候首先比较 该层的识别器,对于 k 维关键码,在第 i 层把识别器定义为 i mod k,对应的 0 为第一维,1 为第二维,依此类推。结点分配时,如果关键码小于识别器的值就放到左子树中,否则放到 右子树。K-d 能快速地对多维数据进行搜索、匹配。 综合题: 1.在图像增强(空间域方法)的课上曾提到分布在图像背景中孤立的暗或亮的像素团块,当 它们小于中值滤波器区域(模板)的一半时,经过中值滤波器处理后会被滤除(被其邻值同 化) 。假定滤波器尺寸为 n n , n 为奇数,请解释这种现象的原因。 答: n n 中值滤波模板共有 n 个元素点。由于 n 为奇数,因此对于中值 ,将会有

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一、

(15分)设有两类正态分布的样本集,第一类均值为T

1μ=(2,0),方差

11⎡⎤∑=⎢⎥⎣⎦11/21/2,第二类均值为T

2μ=(2,2),方差21⎡⎤∑=⎢⎥⎣⎦1-1/2-1/2

,先验概率12()()p p ωω=,试求基于最小错误率的贝叶斯决策分界面。

解 根据后验概率公式()()

()()

i i i p x p p x p x ωωω=

, (2')

及正态密度函数1

()()()/2]T i i i i p x x x ωμμ-=

--∑- ,1,2i =。

(2’) 基于最小错误率的分界面为1122()()()()p x p p x p ωωωω=, (2’) 两边去对数,并代入密度函数,得

1

1

11112222()()/2ln ()()/2ln T

T

x x x x μμμμ----∑--∑=--∑--∑ (1) (2’)

由已知条件可得12∑=∑,11

4/3-⎡⎤∑=⎢⎥⎣⎦4/3-2/3-2/3,21

4/3-⎡⎤∑=⎢⎥⎣⎦

4/32/32/3,

(2’) 设12(,)T

x x x =,把已知条件代入式(1),经整理得

1221440x x x x --+=, (5’)

二、

(15分)设两类样本的类内离散矩阵分别为11S ⎡⎤

=⎢

⎥

⎣⎦

11/21/2, 21S ⎡⎤=⎢⎥⎣⎦

1-1/2-1/2,各类样本均值分别为T 1μ=(1,0),T

2μ=(3,2),试用fisher 准则求其决策面方程,并判断样本T

x =

(2,2)的类别。

解:122S S S ⎡⎤

=+=⎢

⎥⎣⎦

200 (2’) 投影方向为*

1

12-2-1()211/2w S μμ-⎡⎤⎡⎤⎡⎤

=-==⎢⎥⎢⎥⎢⎥--⎣⎦⎣⎦

⎣⎦1/200 (6')

阈值为[]*0122()/2-1-131T y w μμ⎡⎤

=+==-⎢⎥⎣⎦

(4’)

给定样本的投影为[]*0-12241T y w x y ⎡⎤

===-<⎢⎥-⎣⎦

, 属于第二类 (3’)

三、 (15分)给定如下的训练样例

实例 x0 x1 x2 t(真实输出)

1 1 1 1 1

2 1 2 0 1

3 1 0 1 —1

4 1 1

2 -1

用感知器训练法则求感知器的权值,设初始化权值为0

120w w w ===;

1 第1次迭代

(4’)

2 第2次迭代

(2')

3 第3和4次迭代

四、 (15分)

i. 推导正态分布下的最大似然估计;

ii. 根据上步的结论,假设给出如下正态分布下的样本

{}1,1.1,1.01,0.9,0.99,估计该部分的均值和方差两个参数。

1 设样本为K={x 1, x

2 ,…, xN } ,

正态密度函数1

()()()/2]T

i i i i p x x x ωμμ-=--∑- (2’)

则似然函数为

121()(|)(,,...,|)(|)

N N

k k l p K p p ====∏θθx x x θx θ (2’)

对数似然函数1

()ln (|)N

k

k H p ==∑θx

θ (2’)

最大似然估计

1

ˆargmax ()argmax ln (|)

ML

n

k k l p ===∑θ

θ

θθx θ (2’)

对于正态分布11

ˆN

ML k

k x

N

μ

==∑,2211ˆˆ()N

ML

k

k x

N

σ

μ

==-∑ (2’) 2 根据1中的结果1

1ˆ=1N

ML k

k x N

μ

==∑,221

1ˆ

ˆ()=0.00404N

ML

k

k x

N

σμ

==-∑ (5’)

五、

(15分)给定样本数据如下:

T (-6,-6),T

(6,6) (1) 对其进行PCA 变换

(2) 用(1)的结果对样本数据做一维数据压缩 解(1)PCA 变换

1 求样本总体均值向量T T T

μ+

==(-6,-6)(6,6)(0,0) 2 求协方差矩阵T T

3636]/23636R ⎡⎤

+=⎢

⎥⎣⎦

=[(-6,-6)(-6,-6)(6,6)(6,6) (2’)

3求特征根,令

3636036

36λλ

-=-,得172λ=,20λ=。

(1’)

由i i i R ϕλϕ=,

得特征向量11/1ϕ⎡⎤

=⎢⎥⎣⎦

211ϕ⎡⎤

=⎢

⎥-⎣⎦

(2’) 则PCA

为126[,]6ϕϕ⎡--⎡⎤=⎢⎢⎥--⎣⎦⎢⎣

,126[,]6ϕϕ⎡⎡⎤=⎢⎢⎥⎣⎦⎢⎣ (5’)

(2)要做一维压缩,就是向最大特征根对应的特征向量做投影,得

- , (5')

六、

(10分)已知4个二维样本: T 1x =(0,0),T 2x =(0,1),T

3x =(1,2),

T

4x =(4,3)。

试用层次聚类把样本分成2类。

解:1 初始将每一个样本视为一类,得011{}G x =,022{}G x =,033{}G x =,0

44{}G x =

计算各类间的距离,得到距离矩阵0D ,(2')

2 将最短距离1对应的类011{}G x =,0

22{}G x =合并为一类,得到新的分类: (4’) 1001212{,}G G G =,1033{}G G =,10

44{}G G =

计算各类间的欧式距离,得到距离矩阵1

D (2')

3 将距离最小两类1001212{,}G G G =和10

33{}G G =合并为一类,得到新的分类

2000123123{,,}G G G G =,2044{}G G =

聚类结束,结果为

1123{,,}x x x ω=,24{}x ω= (2')

七、

(10分)已知4个二维样本:T 1x =(0,0),T 2x =(1,0),T

3x =(6,4),

T 4x =(7,5),T

5x =(10,9).取K=3,用K 均值算法做聚类

解: 1

K=3

,

初

始

化

聚

类

中

心

,

T

11(1)z x ==(0,0)

,

T 23(1)z x ==(6,4),T

35(1)z x ==(10,9) (2’)

2 根据中心进行分类,得112{,}x x ω=,234{,}x x ω=,35{}x ω= (2') 3

更

新

聚

类

中

心

,

T

112(2)()/2z x x =+=(1/2,0)

,

T T T 234(2)()/2z x x =+=+=(6,4)(7,5)(13/2,9/2),T

35(2)z x ==(10,9)

(4’)

4根据新的中心进行分类,得112{,}x x ω=,234{,}x x ω=,35{}x ω=,分类已经不再变化,因此最后的分类结果为112{,}x x ω=,234{,}x x ω=,35{}x ω= (2’)

八、

(10分)设论域1234{,,,}X x x x x =,给定X 上的一个模糊关系~

R ,其模糊矩阵为

10.80.80.20.810.850.20.80.8510.20.20.20.21R ⎡⎤

⎢⎥

⎢

⎥=⎢⎥⎢⎥⎣⎦

(1) 判断该模糊矩阵式模糊相似矩阵还是模糊等价矩阵 (2) 按不同的置信水平0.9,0.8λ

=给出分类结果

解:(1)因为 R R R = (计算过程 ),是模糊等价矩阵 (6')

(2)0.9

1

000010000100001R ⎡⎤⎢⎥⎢⎥=⎢⎥

⎢⎥

⎣⎦

,聚类结果为1234{},{},{},{}x x x x (2') 0.8

1110111011100

001R ⎡⎤⎢⎥⎢⎥=⎢⎥

⎢⎥

⎣⎦

,聚类结果为1234{,,},{}x x x x (2’)。