函数图像生成器

gan反演的原理

GAN反演的基本原理引言生成对抗网络(Generative Adversarial Network,简称GAN)是一种用于生成模型的机器学习算法。

GAN包含两个主要部分:生成器(Generator)和判别器(Discriminator)。

生成器试图生成与训练数据相似的数据样本,而判别器则试图区分真实数据和生成器产生的数据。

GAN反演是指通过训练好的GAN模型,以生成样本作为输入,通过迭代优化来还原出输入样本中隐藏信息的过程。

这个过程可以用于解决多种问题,如图像去噪、图像修复、图像超分辨率等。

基本原理GAN反演的基本原理可以概括为以下几个步骤:步骤1:训练一个GAN模型首先需要使用真实数据集来训练一个GAN模型。

这个模型包括一个生成器和一个判别器。

生成器将随机噪声作为输入,并试图生成与真实数据相似的样本。

判别器则接收真实数据和生成器产生的样本,并尝试区分它们。

在训练过程中,判别器和生成器相互竞争。

判别器希望能够正确地区分真实数据和生成样本,而生成器希望生成的样本能够骗过判别器。

通过反复迭代训练,判别器和生成器逐渐提高性能,最终达到一个动态平衡点。

步骤2:选择一个生成样本在GAN模型训练完毕后,我们可以选择一个生成样本作为输入进行反演。

这个样本可以是从噪声中生成的图像,也可以是从真实数据中经过一些处理得到的。

步骤3:定义目标函数在GAN反演中,我们需要定义一个目标函数来衡量生成样本与输入样本之间的差异。

目标函数通常包括两个部分:一是判别器对于生成样本的评价结果;二是输入样本与生成样本之间的差异度量。

步骤4:优化目标函数通过迭代优化目标函数,我们可以逐步改进生成样本,使其与输入样本越来越接近。

常用的优化方法包括梯度下降法、Adam等。

具体地说,在每一次迭代中,我们首先将生成样本输入判别器,并计算出判别器对于该样本的评价结果。

然后计算目标函数关于生成样本的梯度,并根据梯度更新生成样本。

通过不断迭代优化,我们可以逐渐改进生成样本,使其更接近输入样本。

fid名词解释

FID 名词解释FID 是一种常用的深度学习模型,用于生成具有类似于真实数据分布的新数据样本。

本文将介绍 FID 的定义、原理和应用场景。

下面是本店铺为大家精心编写的5篇《FID 名词解释》,供大家借鉴与参考,希望对大家有所帮助。

《FID 名词解释》篇1FID(Generative Flow-based Invertible Network) 是一种基于流式生成模型的深度学习模型,由 Hoffman 等人在 2018 年提出。

FID 的主要作用是生成具有类似于真实数据分布的新数据样本。

FID 原理上基于两个组成部分:1) 一个流式生成模型,该模型可以将一个随机噪声向量作为输入并生成一个新数据样本;2) 一个判别模型,该模型可以区分真实数据样本和生成数据样本。

在训练过程中,FID 通过将生成数据样本输入判别模型中来进行训练,并使用判别模型的输出来指导流式生成模型的训练,从而使得生成的数据样本更加接近真实数据样本。

FID 模型的创新之处在于,它可以通过引入额外的噪声向量来控制生成数据样本的多样性和复杂性。

此外,FID 模型还可以通过使用不同的损失函数来优化生成模型和判别模型的性能。

FID 的应用场景非常广泛,可以用于图像生成、自然语言处理、音频生成等领域。

例如,在图像生成中,FID 可以生成具有类似于真实图像分布的新图像样本,从而用于图像编辑、风格迁移等任务。

在自然语言处理中,FID 可以生成具有类似于真实文本分布的新文本样本,从而用于文本生成、机器翻译等任务。

《FID 名词解释》篇2FID(Fréchet Distance)是一种用于衡量两个概率分布之间差异的数学量度。

它是基于弗雷歇距离(Fréchet Distance)的概念,该距离最初是用于衡量两个连续函数之间的相似度。

在概率论中,FID 用于衡量两个概率分布之间的相似度,从而在生成模型中发挥重要作用。

生成对抗网络(GAN)是一种深度学习模型,其中包含两个部分:生成器和判别器。

如何使用ChatGPT技术进行图像生成

如何使用ChatGPT技术进行图像生成ChatGPT是一种基于深度学习的语言生成模型,它可以用于图像生成。

与传统的图像生成模型不同,ChatGPT可以通过对话的方式与用户进行交互,根据用户的描述生成逼真的图像。

本文将介绍如何使用ChatGPT技术进行图像生成,以及一些实践中的注意事项。

1. 数据准备要使用ChatGPT进行图像生成,首先需要准备一组图像数据作为训练集。

这组图像可以包括各种类别和风格的图片,以确保模型具有足够的多样性。

此外,每张图片还需要与之对应的文字描述。

这是为了让ChatGPT理解图像的内容和特征。

2. 模型训练使用准备好的训练数据,可以使用一种称为条件生成模型的技术来训练ChatGPT。

条件生成模型将图像描述作为输入,并生成与描述相关的图像作为输出。

在训练过程中,模型会学习到图像和描述之间的联系,以便于后续的生成过程。

模型训练的关键是选择适当的损失函数。

可以使用一种称为对抗生成网络(GAN)的框架,其中包括一个生成器和一个判别器。

生成器负责生成图像,判别器则负责判断生成的图像与真实图像之间的区别。

通过不断优化生成器和判别器之间的竞争,可以训练出高质量的图像生成模型。

3. 图像生成一旦ChatGPT完成训练,就可以用它来生成图像。

用户可以通过向ChatGPT提供文字描述来指导图像生成的过程。

用户的描述越具体和准确,生成的图像就越能满足需求。

在生成过程中,还可以采用一些技巧来增强图像的质量和多样性。

例如,可以通过调整生成器的潜在空间向量来控制图像的风格和特征。

还可以在生成器中添加一些随机噪声,以增加图像的多样性和独特性。

4. 实践中的注意事项在实践中使用ChatGPT进行图像生成时,需要注意以下几点:(1)数据质量:训练数据的质量会直接影响生成图像的质量。

确保训练数据集包含多样化的图像和对应的描述,以提高模型的泛化能力。

(2)模型选择:ChatGPT并不是唯一可用的模型,还有其他一些先进的图像生成模型可供选择。

函数曲线生成器的设计

函数曲线生成器的设计毛开梅;邹星【摘要】主要研究了通用函数方程的曲线绘制过程.根据用户输入的函数表达式,使用VC++编程语言对输入的字符串进行分析,并绘制出相对应的函数曲线;该研究包括函数方程式的解析和逆波兰式求值、规定区域内函数曲线初始值和初始方向的确定,以及函数曲线的逐点绘制过程;根据MFC图像绘制方法,对内存DC缓冲技术进行了研究,建立基于Bitmap的内存兼容DC,以高效地完成函数图像的平移和缩放操作方法;该研究已实现多项式函数、常用数学函数以及数学函数的复杂嵌套形式的绘制;当用户输入出现错误时,能够智能地提示错误位置;该研究对数学教学和函数模型研究具有深刻的意义.【期刊名称】《计算机测量与控制》【年(卷),期】2018(026)009【总页数】5页(P246-249,263)【关键词】方程式解析;逆波兰式求值;函数曲线绘制【作者】毛开梅;邹星【作者单位】西安铁路职业技术学院电子信息学院,西安 710014;西安铁路职业技术学院电子信息学院,西安 710014【正文语种】中文【中图分类】TP311.50 引言随着图形技术的日益广泛应用,计算机绘图方法的研究也就显得愈来愈重要。

目前已提出通用的像素级曲线生成算法。

其中较为卓著的有我国刘勇奎教授提出的“曲线的逐点生成算法”[1],它只用整数运算,可以绘制多种曲线,包括Bezier曲线、B样条曲线、多项式函数曲线等[2-3]。

该算法本身能自动调整前进的方向,因此无论曲线的走向如何变化,该算法都能随着曲线走向的变化而调整自己,使其总能与曲线的走向保持一致。

该课题的目的就是为了研究通用函数曲线的绘制算法,实现函数曲线绘制的软件。

本课题依据现有的曲线逐点绘制算法,并结合开发语言的特性,实现像素级的函数曲线生成器,并使用图像缓冲技术,解决可能遇到的闪屏等问题。

本课题实现函数曲线生成器将解决多项式函数、常用数学函数等的绘制问题,并允许函数相互嵌套组合,用户自由输入表达式,即可得到函数图像。

GAN(生成对抗网络)实现原理

GAN(生成对抗网络)实现原理生成对抗网络(GAN)是一种用于生成模型的机器学习技术,由Ian Goodfellow等人于2014年提出。

该网络的主要目标是通过训练两个竞争的神经网络模型,生成接近于真实数据分布的新样本。

GAN在图像生成、图像修复、文本生成等领域取得了重要的突破。

本文将介绍GAN的实现原理以及训练过程。

1. GAN基本结构GAN由两个主要的神经网络组成:生成器(Generator)和判别器(Discriminator)。

生成器的作用是生成伪造的数据,而判别器的作用是对真实数据和生成器生成的数据进行区分。

2. 训练过程GAN的训练过程可以分为以下几个步骤:- 初始化生成器和判别器的参数。

- 利用真实数据对判别器进行训练。

判别器在训练过程中学习如何区分真实数据和生成的数据。

- 利用生成器生成一批伪造的数据,并将这些数据与真实数据混合成一个训练集。

- 利用混合的训练集对判别器进行再次训练,目的是使判别器更加准确地区分真实数据和生成的数据。

- 在训练过程中,生成器和判别器相互竞争,不断调整自己的参数,直到达到一个平衡状态。

3. 损失函数GAN使用一个特定的损失函数来度量生成器和判别器的性能。

- 生成器的损失函数是生成的数据与真实数据之间的差异。

- 判别器的损失函数是判别器对真实数据和生成的数据进行分类的准确性。

通过优化这两个损失函数,可以使生成器和判别器达到一个动态平衡状态。

4. 训练技巧为了提高GAN的性能,可以采用一些训练技巧:- Batch Normalization: 在生成器和判别器中使用批量归一化,可以提高网络的稳定性和训练速度。

- 生成器和判别器的学习率:可以根据实际情况调整生成器和判别器的学习率,以提高训练效果。

- 权重正则化:通过对生成器和判别器的参数进行正则化处理,可以减少过拟合的发生。

5. GAN的应用GAN在图像生成、图像修复、文本生成等领域有着广泛的应用。

- 图像生成:GAN可以生成逼真的图像,例如生成逼真的人脸图像。

在MATLAB中使用深度学习进行图像处理

在MATLAB中使用深度学习进行图像处理随着人工智能和机器学习的发展,深度学习在图像处理领域日益重要。

MATLAB作为一种强大的数学计算平台,提供了丰富的工具和函数,用于应用深度学习算法进行图像处理。

本文将介绍如何在MATLAB中使用深度学习进行图像处理,并探讨一些常用的技术和应用。

I. 深度学习基础在介绍如何在MATLAB中使用深度学习进行图像处理之前,我们先来了解一些深度学习的基础知识。

深度学习是一种基于神经网络的机器学习方法,通过多层非线性处理单元来学习输入数据的表示和特征。

它的核心是神经网络模型,其中最常用的是卷积神经网络(Convolutional Neural Network, CNN)。

CNN模型由输入层、卷积层、池化层、全连接层和输出层组成,通过多层卷积和池化操作提取图像的局部特征,并通过全连接层进行分类或回归任务。

II. MATLAB中的深度学习工具箱MATLAB提供了深度学习工具箱(Deep Learning Toolbox),其中包含了一系列用于构建、训练和评估深度学习模型的函数和工具。

在使用MATLAB进行图像处理时,我们可以利用深度学习工具箱中的函数来构建和训练图像分类器、目标检测器等模型。

要使用深度学习工具箱,首先需要安装和配置MATLAB深度学习工具箱,具体方法可以参考MATLAB官方文档。

安装完成后,通过调用工具箱中的函数,可以快速构建和训练深度学习模型。

III. 图像分类任务图像分类是深度学习在图像处理中的一项重要任务。

在MATLAB中,我们可以使用深度学习工具箱中的卷积神经网络函数(如alexnet、vgg16、resnet50等)来构建和训练图像分类器。

图像分类器的训练过程通常包括数据准备、网络构建、网络训练和网络评估四个步骤。

首先,需要准备一个带有标签的数据集,该数据集包含图像样本和对应的标签信息。

接下来,可以通过调用深度学习工具箱中的函数来构建网络模型,并根据训练集进行网络训练。

generator原理

generator原理

生成器是一种能够生成连续值序列的设备或程序。

它基于某种算法或规则,通过不断计算和输出值来生成序列。

生成器可以用于各种应用,例如随机数生成、图像生成、文本生成等等。

在计算机编程中,生成器是一种特殊的函数。

它可以通过使用yield关键字来实现暂停和继续执行的功能。

当一个生成器函

数被调用时,它返回一个生成器对象。

每次调用生成器对象的`__next__()`方法时,生成器函数会从上次暂停的位置继续执行,直到遇到yield语句。

yield语句会暂停函数的执行,并返

回yield关键字后面的值作为生成器的一个值。

每次调用

`__next__()`方法,生成器都会继续执行,直到函数结束或者

再次遇到yield语句。

生成器函数可以通过生成器表达式或使用生成器语法糖来定义。

生成器表达式类似于列表推导式,但是它使用圆括号而不是方括号,并且返回一个生成器对象而不是列表。

生成器语法糖可以通过在函数定义中使用yield关键字来创建生成器函数。

生成器的优点是它们可以在需要时按需生成值,并且不需要存储所有的值。

这使得生成器在处理大规模数据集或无限序列时非常高效。

生成器还可以节省内存,因为它们一次只生成一个值。

此外,生成器还支持惰性计算,可以在需要时通过调用

`__next__()`方法来生成下一个值。

总之,生成器利用yield关键字和特殊的执行机制,可以高效

地生成连续值序列。

生成器的使用可以节省内存和提高效率,使其在各种编程应用中都具有重要作用。

论思维可视化工具教学应用的原则和着力点

论思维可视化工具教学应用的原则和着力点一、本文概述随着信息技术的飞速发展,教育领域正经历着一场前所未有的变革。

其中,思维可视化工具的出现及其在教学中的应用,已经成为这场变革中的重要组成部分。

本文旨在探讨思维可视化工具在教学应用中的原则和着力点,以期为教育工作者提供有益的参考和启示。

本文将简要介绍思维可视化工具的基本概念及其在教学中的重要作用。

接着,将深入探讨思维可视化工具在教学应用中的基本原则,包括学生中心原则、直观性原则、交互性原则和创新性原则。

这些原则是指导思维可视化工具有效应用的基础。

然后,本文将重点分析思维可视化工具在教学应用中的着力点。

这些着力点包括激发学生的学习兴趣和动力、促进学生的深度学习和理解、培养学生的创新思维和问题解决能力,以及提升教师的教学效果和效率。

通过对这些着力点的详细分析,可以更加明确思维可视化工具在教学中的实际应用价值。

本文将总结思维可视化工具在教学应用中的优势和挑战,并提出相应的建议和展望。

通过全面而深入的分析,本文旨在为教育工作者提供一套完整的思维可视化工具教学应用的理论框架和实践指南,以推动教育领域的持续发展和创新。

二、思维可视化工具的教学价值思维可视化工具在教学中的应用,具有深远的教学价值。

它有助于提升学生的思维能力。

通过使用思维可视化工具,学生可以将复杂的思维过程直观地呈现出来,从而更好地理解、分析和解决问题。

这种过程不仅能够锻炼学生的逻辑思维、批判性思维和创造性思维,还能帮助学生形成系统的知识框架和思维方式。

思维可视化工具能够增强教学效果。

通过将抽象的概念、理论或问题以直观、形象的方式展示出来,思维可视化工具可以帮助教师更好地讲解教学内容,提高学生的学习兴趣和参与度。

同时,它还能帮助学生更好地理解和记忆知识,提高学习效果。

思维可视化工具还有助于培养学生的自主学习能力。

在学习过程中,学生可以利用这些工具进行自我探究、自我反思和自我总结,从而逐步形成自主学习的习惯和能力。

gfpganer的参数

gfpganer的参数

对于gfpganer模型的参数,我可以从不同角度来进行解释。

首先,gfpganer是一个基于生成对抗网络(GAN)的模型,用于图像生成和编辑。

它的参数包括生成器和判别器的网络结构、损失函数的设置、优化器的选择以及训练过程中的超参数等。

在生成器的网络结构中,可能包括卷积层、反卷积层、残差连接等,这些结构会影响模型对图像特征的学习能力和生成图像的质量。

此外,生成器的参数还包括激活函数的选择、归一化层的设置等,这些都会影响生成器的输出结果。

判别器的网络结构也是gfpganer模型的重要参数之一,它通常包括卷积层和全连接层,用于对生成器生成的图像进行真假判别。

判别器的参数设置会影响模型对真实图像和生成图像的区分能力。

此外,损失函数的设置也是gfpganer模型的关键参数,常见的损失函数包括生成对抗损失、内容损失、感知损失等,它们用于衡量生成图像与真实图像之间的差异,指导模型学习生成高质量的图像。

优化器的选择和学习率的设置也是模型训练过程中的重要参数,不同的优化器和学习率会影响模型收敛的速度和稳定性。

最后,训练过程中的超参数如批大小、训练轮数等也是

gfpganer模型的参数之一,它们会影响模型的训练效果和生成图像

的质量。

综上所述,gfpganer模型的参数涉及到网络结构、损失函数、

优化器、超参数等多个方面,这些参数的设置会直接影响模型的性

能和生成图像的质量。

javascript自制函数图像生成器

javascript⾃制函数图像⽣成器 出于某种⽬的想做这个东西,顺便可以提供给GMA的⽤户&&放在博客园。

实现上只是简单的描点,加上⼀个相邻两点连线的开关,完全没有技术含量。

⽽且函数图像⼀旦多起来就会变卡。

瓶颈在隐函数的绘制,这个超烦,计算量⼀下⼦就上去了。

我的做法是把画布格成很多个60*60的⼩⽅格,先扫⼀遍⽅格边框上有没有零点,有就进这个⽅格绘图,没有就不管它了。

绘图的部分也牺牲了精度换取速度,当然相关参数都还给⽤户⾃⼰调。

结果还是挺慢的,但还可以接受啦。

效果还⾏ 接下来打算兹兹⼀下js语句做函数表达式,然后再加上⼀维时间(动态图)。

三维空间的话估计等我读了⼤学才能来做了……空间⼏何完全不⾏啊T_T 诸位聚聚如果有什么更好的函数渲染算法给点点建议啊……<?phprequire_once("style.php");><style>[UnSelect=YES]{-webkit-touch-callout: none; /* iOS Safari */-webkit-user-select: none; /* Chrome/Safari/Opera */-khtml-user-select: none; /* Konqueror */-moz-user-select: none; /* Firefox */-ms-user-select: none; /* Internet Explorer/Edge */}#mask{width:100%;height:100%;background:#000;opacity:0.5;position:fixed;top:0;left: 0;z-index: 100;display:none;}.notes{color:#FFFFFF;font-weight:800;font-size:20px;}</style><body><div id="mask"></div><div id="control" class="ui inverted segment" style="background-color:black;position:fixed;margin:auto;left:0;right:0;top:0;bottom:0;z-index:101;width:600px;height:500px;overflow:auto;display:none;"> <div id="function"><button class="ui green button" onclick="Add()">Add function</button><span class="ui divider"></span><span id="mod" style="display:none" name="0"><select class="ui dropdown" style="border-radius:5px;" onchange="FunctionChange(this)"><option value="0">Cartesian</option><option value="1">Polar</option><option value="2">Implicit</option><option value="3">Parameter</option></select><input type="color" style="width:20px;height:20px;border-radius:5px;"/><span style="display:inline"><span class="notes">y=</span><span class="ui input" name="Fun"><input/></span><span class="notes"></span><span class="ui input" style="display:none"><input/></span></span><button class="ui red button" onclick="Delete(this.parentNode)">Delete</button><span class="ui checkbox"><input type="checkbox" onclick="DrawLine(this.parentNode)"/><label style="color:white;">Draw Line</label></span><span style="display:none;margin-top:6px;font-size:80%;"><span class="notes"></span><span class="ui input" style="width:50px;"><input/></span><span class="notes"></span><span class="ui input" style="width:50px;"><input/></span><span class="notes"></span><span class="ui input" style="width:50px;"><input/></span></span><span class="ui divider" style="height:40px"></span></span></div><div class="title" UnSelect="YES" onclick="ShowOption(this)" style="color:white;cursor:pointer;font-size:17px;line-height:35px;font-weight:bold;"><i class="Caret Right icon"></i>Advanced Options <div id="option" UnSelect="YES" style="color:white;font-size:50%;font-family: Consolas,Monaco,monospace;display:none;transition:2s;line-height:30px;"><span class="notes">X:</span><span class="ui input"><input id="FunLx" style="width:180px;"/></span><span class="notes">~</span><span class="ui input"><input id="FunRx" style="width:180px;"/></span><br><span class="notes">Y:</span><span class="ui input"><input id="FunLy" style="width:180px;"/></span><span class="notes">~</span><span class="ui input"><input id="FunRy" style="width:180px;"/></span><br><span class="notes">Coordinate:</span><span class="ui input"><input id="FontStyle" style="width:200px;" value=""/></span><br><span class="ui checkbox"><input type="checkbox" id="sizelimit" checked="1"/><label style="color:white;">Size Limit</label></span><br><span class="notes">PointRadii:</span><span class="ui input"><input id="PointRadii" style="width:50px;" value="1"/></span><br><span class="notes">Scale:</span><span class="ui input"><input id="Scale" style="width:50px;" value="0.9"/></span><br><span class="ui checkbox"><input type="checkbox" id="DrawMoving" checked=1/><br><span class="notes" id="size"></span></div><span class="ui divider"></span><button class="ui blue button" onclick="change()">Draw</button></div><div id="main"><h1 class="ui header" UnSelect="YES" style=""><i class="book icon"></i><div class="content">Tools</div></h1><h1 align="center" UnSelect="YES">函数图像绘制⼯具</h1><div align="center" style="width:100%;height:70%;"><canvas id="graph"></canvas></div><div UnSelect="YES"><button class="ui green button" onclick="mask()">Control</button><button class="ui green button" onclick="redraw()">Reflash</button><!--<p id="map"></p>--></div><script>function $(id) {return document.getElementById(id);}function getRandomColor(){return '#'+('00000'+(Math.random()*0x1000000<<0).toString(16)).substr(-6);}function ischar(c){return (c>='a'&&c<='z')||(c>='A'&&c<='Z');}function isdigit(c){return c>='0'&&c<='9';}function ChangeToPointX(x){return parseInt((x-FunLx)/(FunRx-FunLx)*FunW);}function ChangeToPointY(y){return FunH-1-parseInt((y-FunLy)/(FunRy-FunLy)*FunH);}function priority(c){switch(c){case '(':{return 0;break;}case '+':{return 1;break;}case '-':{return 1;break;}case '*':{return 2;break;}case '/':{return 2;break;}case '^':{return 3;break;}default:{return -1;break;}}}function isopt(c){return priority(c)!=-1;}function SingleCalc(c,a,b){if (c=='+') return a+b;elseif (c=='-') return a-b;elseif (c=='*') return a*b;elseif (c=='/') return a/b;elseif (c=='^') return Math.pow(a,b);elsereturn NaN}function FunWork(f,x){switch(f){case "":{return x;break;}case "SIN":{return Math.sin(x);break;}case "COS":{return Math.cos(x);break;}case "TAN":{return Math.tan(x);break;}case "ABS":{return Math.abs(x);break;}case "SQRT":{return Math.sqrt(x);break;}case "LN":{return Math.log(x);break;}case "LOG":{return Math.log(x)/Math.LN2;break;}//2为底case "LG":{return Math.log(x)/Math.LN10;break;}//10为底case "FLOOR":{return Math.floor(x);break;}case "CEIL":{return Math.ceil(x);break;}case "INT":{return parseInt(x);break;}default:{return NaN;break;}}}function FunInit(F){F=F.replace(/sin/g,"SIN");F=F.replace(/cos/g,"COS");F=F.replace(/tan/g,"TAN");F=F.replace(/abs/g,"ABS");F=F.replace(/sqrt/g,"SQRT");F=F.replace(/ln/g,"LN");F=F.replace(/log/g,"LOG");F=F.replace(/lg/g,"LG");F=F.replace(/floor/g,"FLOOR");F=F.replace(/ceil/g,"CEIL");F=F.replace(/int/g,"INT");return F;}var ca=$("graph"),el=ca.getContext("2d"),fun=$("function"),eps=1e-12;var FunW=ca.parentNode.clientWidth,FunH=ca.parentNode.clientHeight,FunLx=-FunW/100,FunRx=FunW/100,FunLy=-FunH/100,FunRy=FunH/100,PR,tableX,tableY,tmp,countX,countY,Funstage var dir=[[0,1],[1,0],[0,-1],[-1,0],[1,1],[1,-1],[-1,1],[-1,-1]];var FontStyle="bold 12px Georgia";ca.width=FunW;ca.height=FunH;$("size").innerHTML="Size:"+FunW+"*"+FunH;function Calc(fun,X,Value){var number=new Array(),opt=new Array(),F=new Array(),now=0,f="",tmp,a,b,sign=1,base=0,j;for (var i=0;i<fun.length;i++){for (j=0;j<X.length;j++)if (X[j]==fun[i]){if (i==0||isopt(fun[i-1])) now=Value[j];else now*=Value[j];break;}if (j==X.length)if (fun[i]=='(') F.push(f),f="",opt.push('(');elseif (fun[i]==')'){number.push(now*sign);now=0;sign=1;base=0;while ((tmp=opt.pop())!='('){b=number.pop();a=number.pop();tmp=SingleCalc(tmp,a,b);now=FunWork(F.pop(),number.pop());}elseif (fun[i]=='.') base=1;elseif (fun[i]=='+'&&(i==0||priority(fun[i-1])!=-1));elseif (fun[i]=='-'&&(i==0||priority(fun[i-1])!=-1)) sign=-1;elseif (fun[i]=='e') if (i==0||isopt(fun[i-1])) now=Math.E;else now*=Math.E;elseif (fun[i]=='p'&&fun[i+1]=='i'){if (i==0||isopt(fun[i-1])) now=Math.PI;else now*=Math.PI;i+=1;}elseif (isdigit(fun[i])) if (base==0) now=now*10+(fun[i]-'0');else base/=10,now+=base*(fun[i]-'0');elseif (ischar(fun[i])) f+=fun[i];else if (isopt(fun[i])){number.push(now*sign);now=0;sign=1;base=0;var s=priority(fun[i]);if (s==-1) return 0;while (s<=priority(opt[opt.length-1])){b=number.pop();a=number.pop();tmp=SingleCalc(opt.pop(),a,b);number.push(tmp);}opt.push(fun[i]);}}number.push(now*sign);while (opt.length>0){b=number.pop();a=number.pop();tmp=SingleCalc(opt.pop(),a,b);number.push(tmp);}return number.pop();}function drawarc(x,y,R){el.beginPath();el.arc(x,y,R,0,Math.PI*2);el.closePath();el.fill();}function drawline(lx,ly,px,py){el.beginPath();el.moveTo(lx,ly);el.lineTo(px,py);el.closePath();el.stroke();}function gettable(){tmp=(FunRx-FunLx+eps)/20;tableX=1;countX=0;countY=0;while(tableX<tmp) tableX*=10;while(tableX/10>tmp) tableX/=10,countX++;if (tableX>=1) countX=0;if (tableX/5>tmp) tableX/=5,countX++;else if (tableX/2>tmp) tableX/=2,countX++;for (var i=parseInt(FunLx/tableX)+(FunLx>0);i*tableX<FunRx;i++){el.fillStyle=i==0?"#000000":"#CDB7B5";tmp=(i*tableX-FunLx)/(FunRx-FunLx)*FunW;el.fillRect(tmp,0,1,FunH);el.fillStyle="#000000";el.font=FontStyle;el.fillText((i*tableX).toFixed(countX),tmp+2,10);}tmp=(FunRy-FunLy+eps)/20;tableY=1;while(tableY<tmp) tableY*=10;while(tableY/10>tmp) tableY/=10,countY++;if (tableY/5>tmp) tableY/=5,countY++;else if (tableY/2>tmp) tableY/=2,countY++;if (tableY>=1) countY=0;for (var i=parseInt(FunLy/tableY)+(FunLy>0);i*tableY<FunRy;i++){el.fillStyle=i==0?"#000000":"#CDB7B5";tmp=(i*tableY-FunLy)/(FunRy-FunLy)*FunH;el.fillRect(0,FunH-1-tmp,FunW,1);el.fillStyle="#000000";el.font=FontStyle;el.fillText((i*tableY).toFixed(countY),0,FunH-1-tmp);}//$("map").innerHTML=tableX+" "+tableY;}function PCalc(i,j){return Calc(FUN,['x','y'],[FunLx+(FunRx-FunLx)/FunW*i,FunRy-(FunRy-FunLy)/FunH*j]);}function ImpDraw(x,y,X,Y,jump){if (x+X>FunW) X=FunW-x;if (y+Y>FunH) Y=FunH-y;var Imp=new Array(),tmp;if (X>jump)X/=jump;if (Y>jump)Y/=jump;for (var i=-1;i<=X;i+=1){Imp[i+1]=new Array();for (var j=-1;j<=Y;j+=1) Imp[i+1].push(PCalc(i*jump+x,j*jump+y));}for (var i=0;i<X;i+=1)for (var j=0;j<Y;j+=1)for (var k=0;k<4;k++)if (Imp[i+1][j+1]*Imp[i+1+dir[k][0]][j+1+dir[k][1]]<0) {drawarc(i*jump+x,j*jump+y,PR);break;}}function getfunction(){var group=document.getElementsByName("Fun"),x,y,R,lax,lay,px,py,color,OutSide,type,ValueL,ValueR,ValueS,DLc,tmp,TMP; PR=$("PointRadii").value;for (var k=1;k<group.length;k++){var gf=group[k].parentNode.parentNode;OutSide=1;type=gf.children[0].value;DLc=gf.children[4].children[0].checked;FUN=FunInit((group[k].children[0].value).toLowerCase());color=gf.children[1].value;el.fillStyle=el.strokeStyle=color;switch (type){for (var i=0;i<FunW;i++){x=FunLx+(FunRx-FunLx)/FunW*i;y=Calc(FUN,['x'],[x]);if (isNaN(y)) continue;px=i;py=ChangeToPointY(y);if (y>=FunLy&&y<FunRy){drawarc(px,py,PR);if (DLc) drawline(lax,lay,px,py);OutSide=0;}else{if (DLc) if (!OutSide) drawline(lax,lay,px,py);OutSide=1;}lax=px;lay=py;}break;}case '1':{ValueL=Calc(gf.children[5].children[1].children[0].value,[],[]);ValueR=Calc(gf.children[5].children[3].children[0].value,[],[]);ValueS=Calc(gf.children[5].children[5].children[0].value,[],[]);for (var i=ValueL;i<ValueR+ValueS-eps;i+=ValueS){if (i>ValueR) i=ValueR;R=Calc(FUN,['t'],[i]);x=R*Math.cos(i);y=R*Math.sin(i);px=ChangeToPointX(x);py=ChangeToPointY(y);if (FunLx<=x&&x<FunRx&&FunLy<=y&&y<FunRy){drawarc(px,py,PR);if (DLc) drawline(lax,lay,px,py);OutSide=0;}else{if (DLc) if (!OutSide) drawline(lax,lay,px,py);OutSide=1;}lax=px;lay=py;}break;}case '2':{var SpaceW=Calc(gf.children[5].children[1].children[0].value,[],[]),SpaceH=Calc(gf.children[5].children[3].children[0].value,[],[]),jump=Calc(gf.children[5].children[5].children[0].value,[],[]),Imp=new Array();for (var i=0;i*SpaceW<FunW;i+=1){Imp[i]=new Array();for (var j=0;j*SpaceH<FunH;j+=1) Imp[i].push(0);}for (var i=0,_i=0;i<FunW;i+=SpaceW,_i+=1)for (var j=0,_j=0;j<FunH;j+=SpaceH,_j+=1){//if (!Imp[_i][_j]||(!_i&&!Imp[_i-1][_j])){tmp=PCalc(i,j-1);for (var l=0;l<SpaceH&&j+l<FunH;l++)if (TMP=tmp,tmp=PCalc(i,j+l),TMP*tmp<0||Math.abs(tmp)<eps) {Imp[_i][_j]=1;if (_i) Imp[_i-1][_j]=1;break;} }//if (!Imp[_i][_j]||(!_j&&!Imp[_i][_j-1])){tmp=PCalc(i-1,j);for (var l=0;l<SpaceW&&i+l<FunW;l++)if (TMP=tmp,tmp=PCalc(i+l,j),TMP*tmp<0||Math.abs(tmp)<eps) {Imp[_i][_j]=1;if (_j) Imp[_i][_j-1]=1;break;} }}for (var i=0;i<Imp.length;i+=1)for (var j=0;j<Imp[i].length;j+=1)if (Imp[i][j]) ImpDraw(i*SpaceW,j*SpaceH,SpaceW,SpaceH,jump);break;}case '3':{ValueL=Calc(gf.children[5].children[1].children[0].value,[],[]);ValueR=Calc(gf.children[5].children[3].children[0].value,[],[]);ValueS=Calc(gf.children[5].children[5].children[0].value,[],[]);_FUN=FunInit((group[k].parentNode.children[3].children[0].value).toLowerCase());for (var i=ValueL;i<ValueR+ValueS-eps;i+=ValueS){if (i>ValueR) i=ValueR;x=Calc(FUN,['t'],[i]);y=Calc(_FUN,['t'],[i]);px=ChangeToPointX(x);py=ChangeToPointY(y);if (FunLx<=x&&x<FunRx&&FunLy<=y&&y<FunRy){drawarc(px,py,PR);if (DLc) drawline(lax,lay,px,py);OutSide=0;}else{if (DLc) if (!OutSide) drawline(lax,lay,px,py);OutSide=1;}lax=px;lay=py;}break;}}}}function redraw(){el.clearRect(0,0,FunW,FunH);gettable();if (Funstage!=1||$("DrawMoving").checked) getfunction();}function change(){FunLx=parseFloat($("FunLx").value);FunRx=parseFloat($("FunRx").value);FunLy=parseFloat($("FunLy").value);FunRy=parseFloat($("FunRy").value);FontStyle=$("FontStyle").value;redraw();}$("FunLx").value=FunLx;$("FunRx").value=FunRx;$("FunLy").value=FunLy;$("FunRy").value=FunRy;$("FontStyle").value=FontStyle;}function Scale(x,y,times){if (x<0||x>=FunW||y<0||y>=FunH) return;if ($("sizelimit").checked){if (times<1&&(FunRx-FunLx<MIN||FunRy-FunLy<MIN)) return;if (times>1&&(FunRx-FunLx>MAX||FunRy-FunLy>MAX)) return;}x=FunLx+(FunRx-FunLx)/FunW*x;y=FunLy+(FunRy-FunLy)/FunH*y;FunLx=x-(x-FunLx)*times;FunRx=x+(FunRx-x)*times;FunLy=y-(y-FunLy)*times;FunRy=y+(FunRy-y)*times;}ca.onmousedown=function(ob){MoX=yerX;MoY=yerY;Funstage=1;}ca.onmousemove=function(ob){if (Funstage!=1) return;var NoX,NoY,det;NoX=yerX;NoY=yerY;det=(MoX-NoX)/FunW*(FunRx-FunLx);FunLx+=det;FunRx+=det;det=(NoY-MoY)/FunH*(FunRy-FunLy);FunLy+=det;FunRy+=det;MoX=NoX;MoY=NoY;redraw();update();}ca.onmouseup=function(ob){if (Funstage==1){Funstage=0;redraw();}}ca.onmouseleave=function(ob){if (Funstage==1){Funstage=0;redraw();}}ca.onmousewheel=function(ob){ob=ob||window.event;ob.preventDefault();var ScaleRate=$("Scale").value;var detail;if(ob.wheelDelta)detail=ob.wheelDelta;else if(ob.detail)detail=ob.detail;if (detail>0) Scale(yerX,yerY,ScaleRate);else Scale(yerX,yerY,1/ScaleRate);redraw();update();}function Add(){var New=$("mod").cloneNode(true);New.style.display="block";New.children[1].value=getRandomColor();fun.appendChild(New);}function Delete(node){node.parentNode.removeChild(node);}function DrawLine(ob){//if (ob.className=="ui checkbox checked") ob.className="ui checkbox";else ob.className="ui checkbox checked";redraw();}function ShowOption(obj){obj=obj.children[0];if (obj.className=="Caret Right icon") obj.className="Caret Down icon",$("option").style.display="block";else obj.className="Caret Right icon",$("option").style.display="none"; }function FunctionChange(obj){var fi=0,la=2,v=obj.value;obj=obj.parentNode;obj.children[5].style.display="none";obj.children[2].style.display="inline";obj.children[2].children[3].style.display="none";if (v==0){obj.children[2].children[fi].innerHTML="y=";obj.children[2].children[la].innerHTML="";}else if (v==1){obj.children[2].children[fi].innerHTML="r=";obj.children[2].children[la].innerHTML="";obj.children[5].style.display="block";obj.children[5].children[0].innerHTML="t:";obj.children[5].children[1].children[0].value="0";obj.children[5].children[2].innerHTML="~";obj.children[5].children[3].children[0].value="2pi";obj.children[5].children[4].innerHTML=" Space:";obj.children[5].children[5].children[0].value="0.02";}else if (v==2){obj.children[2].children[fi].innerHTML="";obj.children[2].children[la].innerHTML="=0";obj.children[5].style.display="block";obj.children[5].children[0].innerHTML="SpaceW:";obj.children[5].children[1].children[0].value="60";obj.children[5].children[2].innerHTML=" SpaceH:";obj.children[5].children[3].children[0].value="60";obj.children[5].children[4].innerHTML=" Jump:";obj.children[5].children[5].children[0].value="3";}else if (v==3){obj.children[2].style.display="block";obj.children[2].children[3].style.display="inline";obj.children[2].children[fi].innerHTML="x=";obj.children[2].children[la].innerHTML=" y=";obj.children[5].style.display="block";obj.children[5].children[0].innerHTML="t:";obj.children[5].children[2].innerHTML="~";obj.children[5].children[3].children[0].value="1";obj.children[5].children[4].innerHTML=" Space:";obj.children[5].children[5].children[0].value="0.1";}}redraw();update();var maskobj=$("mask");var control=$("control");function mask(){if (maskobj.style.display=="block") control.style.display=maskobj.style.display="none";else control.style.display=maskobj.style.display="block"; }maskobj.onclick=function(){mask();}</script></div></body>View Code。

一次函数解析式生成器

一次函数解析式生成器1.引言1.1 概述一次函数解析式生成器是一个旨在帮助人们快速生成一次函数的解析式的工具。

在数学中,一次函数是一种形式简单而常见的函数,由一个常数和一个一次幂组成。

一次函数解析式的推导是数学学习中的基础内容,但对于一些初学者或者需要大量计算的人来说,手动推导这些解析式可能会耗费大量时间和精力。

因此,这个一次函数解析式生成器可以极大地简化一次函数解析式的推导过程。

它基于一系列的数学运算规则和算法,能够根据用户输入的一些关键数据自动生成对应的一次函数解析式。

无论是面对教学、研究还是实际应用,这个生成器都能够帮助人们节省时间和精力,提高工作效率。

在本文中,我们将首先介绍一次函数的定义和特点,帮助读者对一次函数有一个清晰的认识。

然后,我们将详细讲解一次函数解析式的推导方法,包括常见的系数计算和变量替换等步骤。

接着,我们将介绍一次函数解析式生成器的设计与实现,包括输入界面、运算规则和输出结果等部分。

最后,我们将通过一些应用案例和效果评估来展示这个生成器的实际价值和效果。

通过阅读本文,读者将能够了解一次函数的基本知识和特点,掌握一次函数解析式的推导方法,以及了解一次函数解析式生成器的设计与实现。

希望本文能够帮助读者更好地理解和应用一次函数,提高数学学习和实际工作的效率。

1.2文章结构【1.2 文章结构】在本篇长文中,我们将按照以下结构来组织和呈现关于一次函数解析式生成器的内容:1. 引言:在这一部分中,我们将简要介绍我们所要讨论的主题——一次函数解析式生成器。

首先,我们会给出这个生成器的定义和基本概念,然后详细说明本文的结构和目标。

2. 正文:这一部分将是本文的核心内容,我们将着重介绍一次函数的定义和特点。

具体地,我们会解释一次函数的基本概念和性质,如函数图像是一条直线、函数关系式中只包含一次项和常数项等。

此外,我们还将描述一次函数解析式的推导方法,包括通过已知点的坐标和斜率等信息来确定函数解析式的步骤和方法。

generate 函数

generate 函数"generate" 是一个非常通用的词,可以在多种上下文中使用。

但根据你给出的关键词,我可以提供几个与 "generate" 相关的常见函数或方法。

1.Python 中的generate 函数:o在 Python 中,generate 通常与生成器(generator)相关。

生成器是一种特殊类型的迭代器,它允许你按需生成值,而不是一次性生成所有值。

复制代码python`def generate_numbers(start, end):for i in range(start, end):yield i# 使用生成器for number in generate_numbers(1, 5):print(number)`2.Web 中的generate:o在Web开发中,特别是在前端开发中,generate 可能指的是生成 HTML、CSS 或JavaScript 的函数。

复制代码javascript`function generateHTML() {return '<div>Hello, World!</div>';}`3.图形生成:o在图形学或计算机图形中,generate 可能指的是生成图像、模型或其他视觉内容的函数或方法。

4.随机数生成:o generate 也可以用于生成随机数。

例如,在某些编程语言中,有专门的函数或方法来生成随机数。

5.代码生成:o在编译原理或某些工具中,generate 可能指的是从某种中间表示或抽象语法树生成目标代码的过程。

6.其他上下文:o在其他上下文中,generate 可能具有其他含义或用途。

例如,在密码学中,它可能指的是生成加密密钥或其他安全相关的数据。

如果你有特定的上下文或应用场景,请提供更多详细信息,以便我能为你提供更具体的答案或示例。

pyautogui里面locateall()用法

pyautogui里面locateall()用法在pyautogui中,`locateAll()`函数用于查找图像的所有出现位

置并返回一个生成器。

`locateAll()`函数的语法如下:

```python

pyautogui.locateAll(image, [screen=None])

```

其中,`image`参数表示要查找的图像的文件名或图像对象。

`screen`参数为可选参数,表示在哪个屏幕上查找图像,默认为None,表示查找所有屏幕。

`locateAll()`函数返回一个生成器对象,可以通过迭代来获取所

有匹配图像的位置。

每个位置都是一个四元组,包含左上角的x、y坐标,以及图像的宽度和高度。

以下是使用`locateAll()`函数的示例代码:

```python

import pyautogui

#查找并打印图像所有出现的位置

for position in pyautogui.locateAll('image.png'):

print(position)

```

拓展部分:

1. `locateAll()`函数的返回值是一个生成器对象,可以直接使用`list()`函数将其转换为列表进行处理。

2.可以结合其他pyautogui函数,如`click()`、`scroll()`等来进行自动化操作。

3.可以使用`confidence`参数来设置图像匹配的相似度阈值,默认为0.999,数值越低表示相似度要求越低。

4.如果无法找到图片,则返回None。

可以根据返回的结果来判断是否找到了图像,并根据需要进行相应的处理。

ImageDataGenerator

ImageDataGeneratorImageDataGenerator类的定义以及构造函数的参数详解ImageDataGenerator类的简单介绍Generate batches of tensor image data with real-time data augmentation.The data will be looped over (in batches).这个类是做什么⽤的?通过实时数据增强⽣成张量图像数据批次,并且可以循环迭代,我们知道在Keras中,当数据量很多的时候我们需要使⽤model.fit_generator()⽅法,该⽅法接受的第⼀个参数就是⼀个⽣成器。

简单来说就是:ImageDataGenerator()是keras.preprocessing.image模块中的图⽚⽣成器,可以每⼀次给模型“喂”⼀个batch_size⼤⼩的样本数据,同时也可以在每⼀个批次中对这batch_size个样本数据进⾏增强,扩充数据集⼤⼩,增强模型的泛化能⼒。

⽐如进⾏旋转,变形,归⼀化等等。

总结起来就是两个点:图⽚⽣成器,负责⽣成⼀个批次⼀个批次的图⽚,以⽣成器的形式给模型训练;对每⼀个批次的训练图⽚,适时地进⾏数据增强处理(data augmentation);数据增强处理(data augmentation)数据增强的⼿段有⾮常多种,这⾥指说⼀些代表性的。

旋转 | 反射变换(Rotation/reflection): 随机旋转图像⼀定⾓度; 改变图像内容的朝向;翻转变换(flip): 沿着⽔平或者垂直⽅向翻转图像;缩放变换(zoom): 按照⼀定的⽐例放⼤或者缩⼩图像;平移变换(shift): 在图像平⾯上对图像以⼀定⽅式进⾏平移;可以采⽤随机或⼈为定义的⽅式指定平移范围和平移步长, 沿⽔平或竖直⽅向进⾏平移. 改变图像内容的位置;尺度变换(scale): 对图像按照指定的尺度因⼦, 进⾏放⼤或缩⼩; 或者参照SIFT特征提取思想, 利⽤指定的尺度因⼦对图像滤波构造尺度空间. 改变图像内容的⼤⼩或模糊程度;对⽐度变换(contrast): 在图像的HSV颜⾊空间,改变饱和度S和V亮度分量,保持⾊调H不变. 对每个像素的S和V分量进⾏指数运算(指数因⼦在0.25到4之间), 增加光照变化;噪声扰动(noise): 对图像的每个像素RGB进⾏随机扰动, 常⽤的噪声模式是椒盐噪声和⾼斯噪声;错切变换(shear):效果就是让所有点的x坐标(或者y坐标)保持不变,⽽对应的y坐标(或者x坐标)则按⽐例发⽣平移,且平移的⼤⼩和该点到x轴(或y轴)的垂直距离成正⽐。

使用DCGAN实现图像生成

原始的GAN网络在训练过程中生成者生成图像质量不太稳定,无法得到高质量的生成者网络,导致这个问题的主要原因是生成者与判别者使用相同的反向传播网络,对生成者网络的改进就是用卷积神经网络替代原理的MLP 实现稳定生成者网络,生成高质量的图像。

这个就是Deep Convolutional Generative Adversarial Network (DCGAN)的由来。

相比GAN,DCGAN把原来使用MLP的地方都改成了CNN,同时去掉了池化层,改变如下:•判别器使用正常卷积,最后一层使用全连接层做预测判别•生成器根据输入的随机噪声,通过卷积神经网络生成一张图像•无论是生成器还是判别器都在卷积层后面有BN层•生成器与判别器分别使用relu与leaky relu作为激活函数,除了生成器的最后一层•生成器使用转置/分步卷积、判别器使用正常卷积。

最终DCGAN的网络模型如下:其中基于卷积神经网络的生成器模型如下:判别器模型如下:代码实现生成器:class Generator:def __init__(self, depths=[1024, 512, 256, 128], s_size=4): self.depths = depths + [3]self.s_size = s_sizeself.reuse = Falsedef __call__(self, inputs, training=False):inputs = tf.convert_to_tensor(inputs)with tf.variable_scope('g', reuse=self.reuse):# reshape from inputswith tf.variable_scope('reshape'):outputs = yers.dense(inputs, self.depths[0] * self.s_size * self.s_size) outputs = tf.reshape(outputs, [-1, self.s_size, self.s_size, self.depths[0]])outputs = tf.nn.relu(yers.batch_normalization(outputs, training=training ), name='outputs')# deconvolution (transpose of convolution) x 4with tf.variable_scope('deconv1'):outputs = yers.conv2d_transpose(outputs, self.depths[1], [5, 5], strides= (2, 2), padding='SAME')outputs = tf.nn.relu(yers.batch_normalization(outputs, training=training ), name='outputs')with tf.variable_scope('deconv2'):outputs = yers.conv2d_transpose(outputs, self.depths[2], [5, 5], strides= (2, 2), padding='SAME')outputs = tf.nn.relu(yers.batch_normalization(outputs, training=training ), name='outputs')with tf.variable_scope('deconv3'):outputs = yers.conv2d_transpose(outputs, self.depths[3], [5, 5], strides= (2, 2), padding='SAME')outputs = tf.nn.relu(yers.batch_normalization(outputs, training=training ), name='outputs')with tf.variable_scope('deconv4'):outputs = yers.conv2d_transpose(outputs, self.depths[4], [5, 5], strides= (2, 2), padding='SAME')# output imageswith tf.variable_scope('tanh'):outputs = tf.tanh(outputs, name='outputs')self.reuse = Trueself.variables = tf.get_collection(tf.GraphKeys.TRAINABLE_VARIABLES, sco pe='g')return outputs判别器:class Discriminator:def __init__(self, depths=[64, 128, 256, 512]):self.depths = [3] + depthsself.reuse = Falsedef __call__(self, inputs, training=False, name=''):def leaky_relu(x, leak=0.2, name=''):return tf.maximum(x, x * leak, name=name)outputs = tf.convert_to_tensor(inputs)with _scope('d' + name), tf.variable_scope('d', reuse=self.reuse):# convolution x 4with tf.variable_scope('conv1'):outputs = yers.conv2d(outputs, self.depths[1], [5, 5], strides=(2, 2), pad ding='SAME')outputs = leaky_relu(yers.batch_normalization(outputs, training=trainin g), name='outputs')with tf.variable_scope('conv2'):outputs = yers.conv2d(outputs, self.depths[2], [5, 5], strides=(2, 2), pad ding='SAME')outputs = leaky_relu(yers.batch_normalization(outputs, training=trainin g), name='outputs')with tf.variable_scope('conv3'):outputs = yers.conv2d(outputs, self.depths[3], [5, 5], strides=(2, 2), pad ding='SAME')outputs = leaky_relu(yers.batch_normalization(outputs, training=trainin g), name='outputs')with tf.variable_scope('conv4'):outputs = yers.conv2d(outputs, self.depths[4], [5, 5], strides=(2, 2), pad ding='SAME')outputs = leaky_relu(yers.batch_normalization(outputs, training=trainin g), name='outputs')with tf.variable_scope('classify'):batch_size = outputs.get_shape()[0].valuereshape = tf.reshape(outputs, [batch_size, -1])outputs = yers.dense(reshape, 2, name='outputs')self.reuse = Trueself.variables = tf.get_collection(tf.GraphKeys.TRAINABLE_VARIABLES, sco pe='d')return outputs损失函数与训练def loss(self, traindata):"""build models, calculate losses.Args:traindata: 4-D Tensor of shape `[batch, height, width, channels]`.Returns:dict of each models' losses."""generated = self.g(self.z, training=True)g_outputs = self.d(generated, training=True, name='g')t_outputs = self.d(traindata, training=True, name='t')# add each losses to collectiontf.add_to_collection('g_losses',tf.reduce_mean(tf.nn.sparse_softmax_cross_entropy_with_logits(labels=tf.ones([self.batch_size], dtype=tf.int64),logits=g_outputs)))tf.add_to_collection('d_losses',tf.reduce_mean(tf.nn.sparse_softmax_cross_entropy_with_logits(labels=tf.ones([self.batch_size], dtype=tf.int64),logits=t_outputs)))tf.add_to_collection('d_losses',tf.reduce_mean(tf.nn.sparse_softmax_cross_entropy_with_logits(labels=tf.zeros([self.batch_size], dtype=tf.int64),logits=g_outputs)))return {self.g: tf.add_n(tf.get_collection('g_losses'), name='total_g_loss'),self.d: tf.add_n(tf.get_collection('d_losses'), name='total_d_loss'),}def train(self, losses, learning_rate=0.0002, beta1=0.5):"""Args:losses dict.Returns:train op."""g_opt = tf.train.AdamOptimizer(learning_rate=learning_rate, beta1=beta1) d_opt = tf.train.AdamOptimizer(learning_rate=learning_rate, beta1=beta1) g_opt_op = g_opt.minimize(losses[self.g], var_list=self.g.variables)d_opt_op = d_opt.minimize(losses[self.d], var_list=self.d.variables)with tf.control_dependencies([g_opt_op, d_opt_op]):return tf.no_op(name='train')训练与输出loss曲线生成器图像变化 - 初始状态!生成器图像变化 - 1 epoch之后生成器图像变化 - 2 epoch之后。

gan生成器原理

gan生成器原理

GAN(生成对抗网络)是一种由生成器和判别器两个神经网络组成的模型,常用于生成逼真的图像、音频或其他类型的数据。

其原理如下:

1. 生成器网络:生成器接收随机噪声(通常为服从特定分布的向量)作为输入,通过一系列的神经网络层将输入映射为生成数据的输出。

生成器的目标是生成尽可能真实的数据,以欺骗判别器。

2. 判别器网络:判别器接收真实数据和生成器生成的数据作为输入,分别对其进行分类,判别其是真实数据还是生成数据。

判别器的目标是尽量准确地判断输入数据的真假。

3. 对抗训练:GAN的核心思想是通过生成器和判别器相互竞争、对抗学习。

在训练过程中,生成器生成一批数据,并将生成的数据输入到判别器中,判别器将真实数据和生成器生成的数据进行分类。

生成器根据判别器的分类结果来更新自己的参数,以提高生成的数据的真实度。

同时,判别器也根据生成器生成的数据对自己的参数进行更新,以提高对真实数据和生成数据的分类准确性。

4. 优化目标:GAN的训练可以通过最小化生成器和判别器的损失函数来实现。

生成器的损失函数通常为生成器生成的数据被判别器判断为真实数据的概率的负对数似然。

判别器的损失函数通常为生成器生成的数据被判别器判断为真实数据的概率的负对数似然加上真实数据被判别器判断为真实数据的概率的

负对数似然。

通过反复迭代训练,生成器和判别器可以互相提高,生成器生成的数据逐渐接近真实数据,判别器也能够更准确地判断输入数据的真假。

最终,生成器可以生成与真实数据相似甚至更好的数据。

高职试讲标准教案设计模板

一、课题名称[请在此处填写课题名称,例如:高等数学应用教程——微积分基础]二、课型、课时- 课型:理论课/实践课- 课时:2课时三、教学目标1. 知识与技能目标:- 学生能够理解并掌握微积分的基本概念,如导数、积分等。

- 学生能够运用微积分的基本方法解决实际问题。

2. 过程与方法目标:- 通过实例分析和小组讨论,培养学生分析问题和解决问题的能力。

- 通过实际操作,提高学生动手能力和实验技能。

3. 情感态度与价值观目标:- 培养学生对数学学科的兴趣和热情。

- 增强学生的科学精神和创新意识。

四、教学重难点1. 教学重点:- 微积分基本概念的理解和掌握。

- 微积分基本方法的运用。

2. 教学难点:- 复杂函数的求导和积分。

- 微积分在实际问题中的应用。

五、教具- 多媒体课件- 计算器- 实验器材(如:函数图像生成器)六、教学方法1. 讲授法:结合多媒体课件,系统地讲解微积分的基本概念和方法。

2. 讨论法:通过小组讨论,引导学生主动思考和解决问题。

3. 实验法:通过实际操作,让学生亲身体验微积分的应用。

4. 案例分析法:通过分析实际案例,提高学生的应用能力。

七、教学过程1. 导入新课:- 回顾上一节课的内容,引入本节课的主题。

- 提出与微积分相关的问题,激发学生的学习兴趣。

2. 讲授新课:- 讲解微积分的基本概念,如导数、积分等。

- 结合实例,讲解微积分的基本方法。

- 通过多媒体课件,展示微积分在实际问题中的应用。

3. 小组讨论:- 将学生分成小组,针对某个实际问题进行讨论。

- 每组推选一名代表进行汇报,分享讨论成果。

4. 实验操作:- 引导学生进行实验操作,验证微积分的基本方法。

- 学生在实验过程中遇到问题,及时给予指导和帮助。

5. 总结与反思:- 总结本节课的主要内容和收获。

- 引导学生反思自己在学习过程中的不足,并提出改进措施。

八、作业设计1. 完成课后习题,巩固所学知识。

2. 查阅资料,了解微积分在实际生活中的应用。

cyclegan数学公式

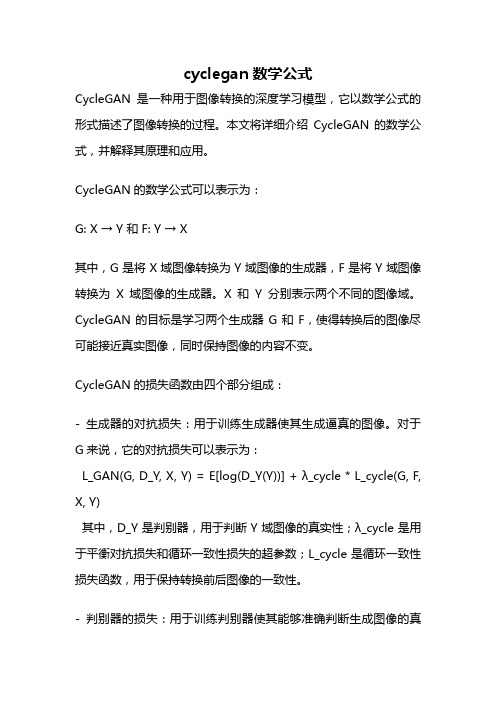

cyclegan数学公式CycleGAN是一种用于图像转换的深度学习模型,它以数学公式的形式描述了图像转换的过程。

本文将详细介绍CycleGAN的数学公式,并解释其原理和应用。

CycleGAN的数学公式可以表示为:G: X → Y 和F: Y → X其中,G是将X域图像转换为Y域图像的生成器,F是将Y域图像转换为X域图像的生成器。

X和Y分别表示两个不同的图像域。

CycleGAN的目标是学习两个生成器G和F,使得转换后的图像尽可能接近真实图像,同时保持图像的内容不变。

CycleGAN的损失函数由四个部分组成:- 生成器的对抗损失:用于训练生成器使其生成逼真的图像。

对于G来说,它的对抗损失可以表示为:L_GAN(G, D_Y, X, Y) = E[log(D_Y(Y))] + λ_cycle * L_cycle(G, F, X, Y)其中,D_Y是判别器,用于判断Y域图像的真实性;λ_cycle是用于平衡对抗损失和循环一致性损失的超参数;L_cycle是循环一致性损失函数,用于保持转换前后图像的一致性。

- 判别器的损失:用于训练判别器使其能够准确判断生成图像的真实性。

对于D_Y来说,它的损失可以表示为:L_DY(D_Y, X, Y) = E[log(D_Y(Y))] + E[log(1 - D_Y(G(X)))]- 循环一致性损失:用于保持转换前后图像的一致性,防止生成图像过于远离真实图像。

循环一致性损失可以表示为:L_cycle(G, F, X, Y) = E[||F(G(X)) - X||] + E[||G(F(Y)) - Y||]- 身份映射损失:用于保持图像的内容不变。

身份映射损失可以表示为:L_identity(G, F, X, Y) = E[||G(Y) - Y||] + E[||F(X) - X||]通过最小化以上四个损失函数,CycleGAN可以学习到两个生成器G和F,实现不同图像域之间的转换。

精选最新函数图像生成器三篇

1、数据转置为了便于打印,要将A列中的姓名,转换为多行多列。

D6单元格输入以下公式,按回车:=INDEX(A:A,SEQUENCE(E3,E4,2))&""SEQUENCE函数的作用是按指定的行列数生成序号,常用写法是:=SEQUENCE(行数,[列数],[开始数],[增量])先使用SEQUENCE函数,根据E3和E4单元格中指定的行列数,得到一个从2开始的多行多列的序号。

然后再使用INDEX函数返回A列对应位置的内容。

2、销售业绩排序如下图所示,要根据C列的销售套数,使用公式得到排序后的销售记录。

E2单元格输入以下公式,按回车。

=SORT(A2:C17,3,-1)SORT函数的作用是对数据区域中指定的行列进行排序,常用写法是:=SORT(数据区域,[对第几列(行)排序],[升序还是降序],[按行还是按列排序])第三参数使用-1,表示降序排序,使用1表示升序排序。

第四参数省略,表示按列方向排序。

3、多条件排序如下图所示,要根据销售处和销售套数两个指标,使用公式得到排序后的销售记录。

E2输入以下公式,按回车。

=SORTBY(A2:C17,A2:A17,1,C2:C17,-1)SORTBY的作用是对某个区域按多组条件进行排序,常用写法是:=SORTBY(数据区域,要排序的列1,[升序/降序],[要排序的列2],[升序/降序]..)4、提取不重复值如下图所示,要在值班记录中提取不重复的人员名单。

E2单元格输入以下公式,按回车:=UNIQUE(B2:C8)UNIQUE函数的作用是在数据表中提取不重复值的,工作方式类似于删除重复值功能,常用写法是:=UNIQUE(数据源,[按行/按列排序],[只提取出现一次的内容还是提取全部记录])5、提取符合条件的多个记录是某公司的春节值班费明细表,要根据G2单元格指定部门,返回该部门的所有记录。

F6单元格输入以下公式,按回车:=FILTER(A1:D11,A1:A11=G2)FILTER函数的作用是根据指定条件从列表中提取记录,常规用法是:=FILTER(数据区域,条件区域=指定条件,不符合条件时返回的内容)6、提取指定条件的不重复值要根据G1单元格中指定区域,从左侧表格中提取出该区域不重复的产品列表。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

7

思考: 1. 如何画出彩色的曲线? 2. 如何画出x y轴的箭头y=sin(x)的前提下,继续制 作y=cos(x),y=x^2以及画圆、画椭圆的曲线。 ▪ 以上分别制作单独按钮予以实现。

❖ 能否利用所学知识实现其他图形的绘制?

2020/3/4

9

2020/3/4

点的粗细

Picture1.PSet (1, 0), RGB(255, 0, 0)

位置(x,y)

颜色

2020/3/4

6

如何实现重复画点: dim x, y as single; For x =1 to 10 step 1

y = Sin(x) Pict?ure1.PSet (x, y) next x

2020/3/4

2020/3/4

5

先来看看如何画点:

2. 绘制x y轴 Picture1.Scale (-10, 10)-(10, -10) '定位坐标系 Picture1.Line (-10, 0)-(10, 0) 'X轴 Picture1.Line (0, -10)-(0, 10) ‘Y轴

3. 画点

Picture1.DrawWidth = 5

再探For语句

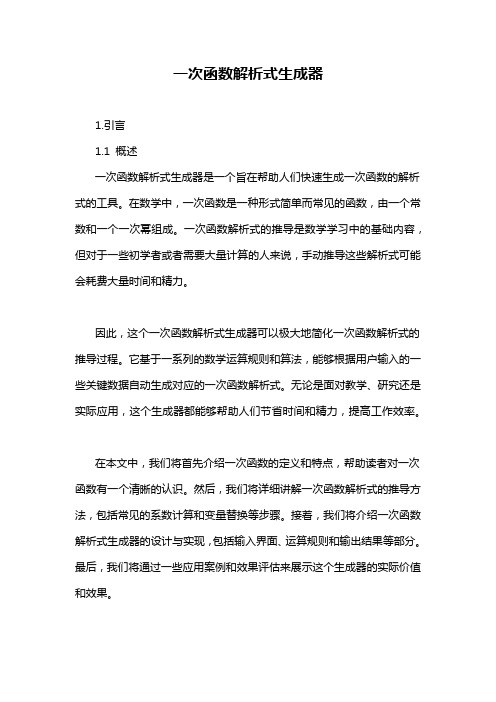

函数图像生成器的制作

曹毅

2020/3/4

1

上期回顾: ❖ 循环结构:

▪ 在计算机中,重复做某件事,可以用循环来解

决问题。

For 循环变量=初值 To 终值 [Step 步长]

语句组(循环体)

Next 循环变量

2020/3/4

2

实用小工具——函数图像生成器 ❖ 如图所示,不解释。

2020/3/4

3

算法分析

❖ 线由点组成,绘制函数曲线就是按照一定的规则

在坐标系中重复画点而成。

2020/3/4

4

先来看看如何画点:

1. 构建一个坐标系: ▪ Picture1.Scale (X1,Y1) - (X2,Y2)

▪ (x1,y1)指图片左上角的横、纵坐标

▪ (x2,y3)指图片右下角的横、纵坐标

▪ 例如:Scale (-10,10) - (10,-10) 定义了绘图 区域大小为20×20,坐标原点(0,0)在绘 图区域中心。

10