改进型模糊神经网络模型的构造

基于改进型神经网络的软测量模型的建立与应用

( 南京 邮 电大学 自动 化 学院 , 江苏省 南京 市 2 0 0 ) 10 3

摘 要 : 用改进 的 R F 径 向基 函数 ) 经 网络 ( 小波神 经 网络 ) 使 B( 神 即 来建模 , 并采 用改进算 法确定 其 隐含 层 节点的各 个参 数 , 然后 以一个 充填搅拌 生 产过 程 中的 料浆 浓度 为研 究对 象 , 立其 软 测量 模 建

度 的测量 提 出较为 优 良的方案 。

2 软测量整体方案的设计

21 机理分析和辅助变量的选择 . 通过 分析 软 测 量 对 象 ( 即料浆 浓 度 ) 以及 其 所 涉 及 的整个 充填 的工 艺流程 , 明确 该软测 量 的辅助 变量 。

由于沙浆 浓度 与沙 料 、 泥和水 的供 给值直 接相关 , 水 而 在一 般 的充填 系统 的搅 拌 过 程 中 , 其供 灰 量 和供 砂 量

误 差 为 +2 。 %

为了 提高 充填 体 的 质量 , 求 自动调 整灰 、 、 要 砂 水 的供 给量 , 对料 浆浓度 进行严 格 的测量 , 中对 沙浆 并 其 浓 度 的测量 是非 常重 要 的 , 精 度 的保 证 是 整 个 系统 其 正常运行 的关 键 。但是 , 目前 的一 些充填 系统 中 , 在 对 沙浆浓度 测 量都是 采 用在 线 测 量 仪表 , 些 仪 表经 多 这 年 使用后 , 统仪 表会老 化 , 系 检测 失 准 , 导致 供料 失控 、

可以选择采用 比值或恒值控制方法 , 若采用恒值控制

图 1 搅拌系统工艺流 程

方 法 量。但如果采用的是比值控制方法 , 也可 以选择辅助

在 图 1中 , 由搅拌 系 统把 灰 、 、 这 3种 物 料 按 砂 水

神经网络模型中的网络结构优化与训练教程

神经网络模型中的网络结构优化与训练教程神经网络模型是计算机科学领域中一种重要的机器学习方法,具有强大的数据处理和模式识别能力。

在构建神经网络模型时,选择合适的网络结构和进行有效的训练是十分关键的步骤。

本文将介绍神经网络模型中的网络结构优化与训练的教程,帮助读者了解如何优化网络结构和进行有效的训练。

1. 网络结构优化神经网络模型的网络结构包括输入层、隐藏层和输出层。

优化网络结构可以提高模型的性能和泛化能力。

下面将介绍几种常用的网络结构优化方法。

1.1 激活函数选择激活函数可以引入非线性变换,在神经网络中起到关键作用。

常用的激活函数有Sigmoid函数、ReLU函数和Tanh函数等。

在选择激活函数时,需要根据具体的任务需求和数据特点进行选择。

1.2 隐藏层数与神经元个数隐藏层数和神经元个数是网络结构中的重要参数。

增加隐藏层数可以提高网络的表达能力,但也会增加模型的复杂度。

神经元个数的选择要根据数据集的大小和复杂度进行调整,避免过拟合或欠拟合。

1.3 正则化正则化是一种常用的提高模型泛化能力的方法。

常见的正则化方法有L1正则化和L2正则化。

通过加入正则化项,可以降低模型的复杂度,减少过拟合的风险。

1.4 DropoutDropout是一种常用的正则化技术,可以在训练过程中随机地使一部分神经元失活。

这样可以减少神经元之间的依赖关系,增强模型的泛化能力。

2. 训练方法2.1 数据预处理在进行神经网络模型的训练之前,需要对原始数据进行预处理。

常见的预处理方法包括数据归一化、特征缩放和数据平衡等。

数据预处理可以提高训练的效果和模型的稳定性。

2.2 损失函数选择神经网络模型的训练过程中需要选择合适的损失函数。

根据任务的性质,常见的损失函数有均方误差损失函数、交叉熵损失函数和对比损失函数等。

选择合适的损失函数可以使模型更好地拟合数据。

2.3 批量梯度下降法批量梯度下降法是一种常用的训练方法,通过迭代更新模型参数来最小化损失函数。

基于T_S模型的模糊神经网络_孙增圻

n

∑ N 2 =

mi 。

i= 1

第三层的每个结点代表一条模糊规则, 它的作

用是用来匹配模糊规则的前件, 计算出每条规则的

77

适用度。即

Aj = m in{ Ls11j , Ls22j , …, Lsnnj } 或 Aj =

L L …L s11j s22j

snnj

其中 s1j ∈{ 1, 2, …, m1 } , s2j ∈{ 1, 2, …, m2 } , …, snj

isi

ci si )

2

,

x

( i

2) si

=

Lsi i =

g ( 2) isi

= e = e f

( i

2) si

-

(

x i - ci si R2isi

)2

i= 1, 2, …, n;

si = 1, 2, …, mi

第三层:

f

= ( 3)

j

m

in

{

x

( 2) 1s1j

,

x , ( 2) 2s2j

…,

x

设取误差代价函数为

78

清 华 大 学 学 报 ( 自 然 科 学 版)

1997, 37( 3)

r

∑ E =

1 2

( y dk

k= 1

-

yk) 2

( 1)

其中 y dk 和 y k 分别表示期望输出和实际输出。下面

首先给

出参数

p

k jl

的学习算

法。

9E

9p

k jl

=

9E 9y k 9y k 9y kj

分类号 T P 18

神经网络具有并行计算、分布式信息存储、容错 能力强及具备自适应学习功能等一系列优点。但神 经网络不适合于表达基于规则的知识, 因此在对神 经网络进行训练时, 由于不能很好利用已有的经验 知识, 常常只能将初始权值取为零或随机数, 从而增 加了网络的训练时间或陷入非要求的局部极值。模 糊逻辑也是一种处理不确定性和非线性以及其它不 适定性问题的有力工具。它比较适于表示那些模糊 或定性的知识, 其推理方式比较类似于人的思维模 式。但是一般说来它不容易实现自适应学习的功能。

动态环境下基于实际隶属函数的移动机器人路径规划

动态环境下基于实际隶属函数的移动机器人路径规划熊开封1,张华2(1.西南科技大学国家级综合性工程训练中心,四川绵阳621010;2.西南科技大学信息工程学院,四川绵阳621010)摘要:为优化模糊神经网络的实时性、学习速度、收敛性、稳定性,在移动机器人局部路径规划中构建了基于实际隶属函数T-S (Takagi-Sugeno )模型的改进型模糊神经网络。

对外部环境信息用多传感器(超声波、摄像头)采集并优化,将机器人横纵坐标及行进方向作为输入、机器人下一步行进方向及速度作为输出,以便机器人实现局部路径规划;结合动态环境下机器人路径规划的实际,综合考虑二维直角坐标体系下机器人、障碍物的位置、速度及运动方向等实时信息,推导出一种新的具有实际含义的隶属函数作为避碰隶属函数,并通过对比隐含层节点数对网络相对误差的影响来确定隶属函数层节点数,构建五层T-S 型模糊神经网络;在此基础上应用改进型误差反传学习算法,通过matlab 模拟实验仿真验证及对比分析,表明了改进型网络在优化网络实时性、学习速度、收敛性、稳定性方面有良好的性能。

关键词:T-S 型模糊神经网络;局部路径规划;实际隶属函数;matlab 仿真;优化中图分类号:TP24文献标识码:A文章编号:1001-7119(2015)09-0168-06Path Plan for Mobile Robot Under Dynamic Enviroment Based on the Actual Membership FunctionXiong Kaifeng 1,Zhang Hua 2(1.State-level Comprehensive Engineering Training Center ,SWUST ,Mianyang 621010,China ;2.College of Information Engineering ,SWUST ,Mianyang 621010,China )Abstract :To optimize the fuzzy neural network real time,learning speed,convergence and stability,mobile robot local path planning improved fuzzy neural network model based on the actual membership function t-s type (Takagi-Sugeno )is presented.This method is to use multiple sensors(ultrasonic ,camera)to collect the external environment information and optimize them,the robot coordinate transverse,longitudinal axis coordinates and direction were used as input variables,the robot move to the next step and direction speed were used as the output variable,this helps to robot local path planning implementation.This method is to make the gaussian function deformed as membership function ,and by comparing the relative error of the node number of implicit layer of network to determine the membershipfunction layer node number,to construct the five layers of the T-S type fuzzy neural network.On the basis of the improved error back propagation,simulation verification by matlab simulation and comparison analysis,show that the improved fuzzy neural network has a good performance in optimization of network learning speed,convergence,stability.Keywords :t-s type fuzzy neural network ;local path planning ;matlab simulation ;actual membershipfunction ;optimization收稿日期:2013-11-28基金项目:四川省科技支撑计划项目(项目编号:2013GZX0152);西南科技大学青年基金项目(项目编号:11zx3103)。

基于改进型Elman神经网络预测模糊神经网络控制的变风量空调设计

房问的灯光负荷、 设备负荷差别较大 , 每层 采 用 1台组 合式 空调 机 , 造成 了房 间温 度 因不 能调 节

而产 生 的过 冷或 过热 的现 象 , 同时 各设 备 问 及演

播室、 语 录 室冬 季严 重超 温 。

效果 。 由于 变 风 量 空 调 系 统 灵 活 性 高 , 节 能 性 强, 因此 , 已成 为 现代 智 能 建 筑领 域 炙 手 可 热 的 研 究对 象 。现 在 大部 分 空 调 控 制仍 采 用 传 统 的

中图分类弩 : T P 3 9 1 文 献标 志 码 : B 文 誊 缡 号 :1 6 7 4 ~ 8 4 l 7 ( 2 ( ) 1 3 ) 0 1 4 ) 0 5 3 4 ) 5

0 引 言

变 风量 ( V a r i a b l e A i r V o l u m e , V A V) 空 调 系 统 是 一种 全 空 气 系统 , 它通过使送风温度 固定 , 并 自动根 据 室 内参 数 要 求 的 变 化 或 空 调 的负 荷 变 化 情况 调 节 送 风 量 , 因 此 获 得 了显 著 的 节 能

( )+

{

个 关键 步骤 是确 定 隐层结 点数 f , 其中 f 的初 始值

确 定式 为

l : Jo . 4 3 a r n+ 0 . 1 2 n + 2 . 5 4 m+ 0 . 7 7 n+ 0 . 3 5+ 0 . 5 1

变 风量 空调 系统 主 要 由空气 处 理 机组 、 送 回 风 系统 ( 送、 回风 风道 ) 、 末 端装 置 ( 有 些末 端 装 置 带有 送 风散 流器 ) 和 相 关 的 自动 控 制 系统 组 成 。

1 工 程 背 景

神经网络模型的结构设计与参数调整方法

神经网络模型的结构设计与参数调整方法引言:神经网络模型是一种模拟人脑神经元工作原理的计算模型,它通过输入数据进行学习和训练,以预测和分类任务为目标。

然而,模型的结构设计和参数调整是影响其性能和效果的关键因素。

本文将介绍神经网络模型的结构设计和参数调整方法,并探讨其在优化模型性能方面的作用。

一、神经网络模型的结构设计方法1. 输入层和输出层设计:神经网络模型的输入层接收原始数据,输出层给出模型的预测结果。

在结构设计中,输入层的节点数量应与待处理数据的特征数量相匹配,输出层的节点数量则根据任务需求进行设置。

例如,对于图像分类任务,输出层的节点数通常与类别数相等。

2. 隐藏层设计:隐藏层是神经网络模型的核心组成部分,起到对输入数据进行处理和特征抽取的作用。

隐藏层的节点数量和层数对模型的性能有重要影响。

通常情况下,增加隐藏层的节点数量和层数能够提升模型的表达能力,但也容易导致过拟合现象。

因此,在设计隐藏层时需要考虑提高模型效果和控制复杂度的平衡。

3. 激活函数选择:激活函数在神经网络模型中用于引入非线性变换,使模型能够更好地拟合复杂的数据分布。

常见的激活函数包括sigmoid函数、ReLU函数和tanh函数等。

在结构设计中,根据任务的特性选择合适的激活函数可以提升模型的表达能力和收敛速度。

4. 正则化和归一化技术:正则化和归一化技术可以在模型训练过程中对参数进行约束,防止过拟合和提高模型的鲁棒性。

例如,L1和L2正则化可以对模型的权重进行限制,避免某些特征对模型预测结果的过度依赖。

另外,归一化技术如Batch Normalization可以将输入数据按特定规则进行缩放,提高模型的训练效果和泛化能力。

二、神经网络模型的参数调整方法1. 学习率调整:学习率是神经网络模型中一个重要的超参数,它决定了模型在每一次参数更新中的步长大小。

合适的学习率能够加速模型的收敛速度,而过大或过小的学习率则可能导致训练过程困难或收敛到局部最优解。

基于改进型BP神经网络的模型参考自适应控制系统

l 詈

厂 ( )

1

了

,

三( 4 )厂 ’ (

詈 c 。 s l 三

。

‘

弓 I 言 在现代化 的工业 生产 中, 随 着生产率 的不断提 高 , 对 产品质产过 程 变得 E t 益 复杂 , 要 在越 来越 复 杂的动态 系统 及过 程与环境高 度不确 定的情 况下 获得更好 的的 控制效

1 ) 网络的输 入、 输 出应作标 准化处 理; 2 ) Y 较小时, 学习速度 o 【 应 较大 , 而n 的取值可以适 当放宽 。 其 中, d 为学 习速度 , n 为惯性 系数 , Y为 自 变 量 因数 , 6 占为 误 差精

两个 比较典 型的 问题 。 一是收敛 速度慢 , 二是 容易陷入局 部极 小。 对此 度, N 为 网络收 敛时的学 习次数 。

果, 这就使得 控制面临新 的挑战 。 1 、 B P 神经 网络 及其 改 进算 法

。 一 号

从式 ( 4 ) 可知 , 由于采 用分段 函数 形式 , 不 仅具 有分段线 性 函数 的 阈 值作用, 当信号 较大时, 输 出立刻变 为0 或l , 同时, 又可通过 调节y , 从而调 节误差 曲面的偏 导数 , 避免 在误差 函数的 最小点附近 发生 过冲现 象 , 确 保收 敛到 最小点 , 因此 , 网络 性能 得到改善 。 但是 , 使用该 构造 函数时 应

出层的相应 权值 , 直 到满足精 度要 求或 网络不收 敛。 众所周知 , B P 网络 的学 习过程是 对一个高度非线性 函数求全局最优 问题 , 网络训练 中存在 已有很 多学 者提 出了 各种解 决方案和修 正算 法 , 如 累计误 差校 正算法 、 s 函数输 出限幅算法 、 结合遗传算法 的优化权值算法等。

神经网络算法的优化和改进

神经网络算法的优化和改进随着科技的发展和人类对于信息处理能力的需求提升,神经网络算法成为了研究和应用的热点之一。

然而,神经网络算法中存在一些问题,例如模型的泛化能力不足、训练速度较慢等等。

因此,优化和改进神经网络算法成为了当前热门的研究方向。

本文将探讨神经网络算法的优化和改进,以及研究进展和应用前景。

一、神经网络算法中存在的问题1.泛化能力不足泛化能力是衡量神经网络算法性能的重要指标之一,它表示模型在训练集以外的数据上的表现能力。

泛化能力不足会导致模型对噪声数据等不良因素过于敏感,或者在未知数据上的预测能力较差。

2.训练速度慢神经网络算法训练的过程中,需要进行反向传播优化权重,这个过程需要大量的计算资源和时间。

训练速度慢会影响算法的实际应用效果,并且阻碍了算法的进一步发展。

3.过拟合神经网络算法的一个缺点是容易出现过拟合现象。

当模型过于复杂并且参数过多时,模型会过于拟合训练集数据,忽略了真实数据的规律性,导致泛化能力降低。

二、优化神经网络算法的思路1.改进神经网络结构神经网络模型的抽象层次较高,具体的因素比较难以分析和优化。

因此,调整神经网络结构是一种可行的思路。

例如,采用更加合适的激活函数、添加正则化项等等,这些方法可以有效提高神经网络的泛化能力。

2.优化神经网络训练方法为了加速神经网络模型的训练,可以优化反向传播和参数更新的方法。

这些方法包括使用梯度下降算法、基于批处理的训练算法以及引入振荡、动量等优化技巧,可以提高神经网络训练的速度和稳定性。

3.引入新的技术和算法优化神经网络随着计算机技术和算法的不断发展,研究人员不断提出新的方法和技术优化神经网络。

这些方法包括卷积神经网络、递归神经网络、自编码神经网络等等,在特定的场景下用于优化神经网络可以取得很好的效果。

三、神经网络算法的改进和应用神经网络算法的不断改进与完善,使其在实际应用中具有了广泛的应用前景。

以下是一些神经网络算法的具体应用场景:1.图像识别基于神经网络的图像识别算法已经成为了目前最先进的技术之一。

基于信息融合的改进型模糊神经网络

第三层 为模糊规 则层 , 这里 每一个节点均 代表 在 n 个事 实情况下单 个规 则 o 的激励强 度 。 层 的总节点数 为 m = 该

Hm j 。

第 四层为规 则组合层 , 一层将 具有相 同结果 的规 则组 这 合在一起形成输 出模糊量 的一个 分值 , 它们 之间 的加权 系数

通过训练获得。

多规 则总激励强度计算 和输 出值 清晰化处理 。在模糊控制系 统实现过 程中, 在建立规则库较难 的问题 , 存 且规则库一旦建

立就无法更改 , 这使实 际应用 系统受 到很大 的限制 。在 以往 的研究中 , 没能 就规 则库 的学 习 提 出成 熟 的研 究”2。对 于 . 】

组合模糊规则 和清 晰化 处理三 个方 面展开 重点研究 , 绍这 介

种模糊神经 网络 。

各个 步骤 。 第一层为输入层 , 该层各个节点与多传感器数据融 合 系统中 / 传感器的测量值直接相连 , 的节点数为 / 7 , 个 该层 7 , 。

第二层 为模糊化 处理层 , 该层 各个节 点代 表一个语言变

J n o 6 u e2 o

基 于信 息 融合 的 改进 型模糊 神 经 网络

周 中 良 于 雷 , , 李永华 ( .空军工程 大 学 工程 学院 , 西 西安 703 ; 2 1 陕 10 8 .西 北工业 大 学 电子 工程 学院 , 西 西安 70 7 ) 陕 10 2

(h n_i g zo @ 13 n t zo g l n_ h u . e) a 6

非要求的局部极值 。模糊控制 (R 善于处理不确定 性、 F) 模糊 性或定性的知识 ; 但缺乏学 习和 自适应 能力 。

神经网络的优化与改进

神经网络的优化与改进神经网络作为人工智能的核心技术,被广泛应用于图像识别、自然语言处理、语音识别等领域。

然而,在实际应用过程中,神经网络模型存在一些问题,如模型的复杂度、训练时间、可解释性不足等。

因此,神经网络的优化与改进一直是人工智能研究人员的重要方向之一。

一、深度学习中的优化方法使用梯度下降算法来调整神经网络的权重和偏置系数是一种常见的优化方法。

在深度学习中,梯度下降算法又分为批量梯度下降算法、随机梯度下降算法和小批量梯度下降算法。

批量梯度下降算法每次使用全部的训练样本来计算梯度,然后更新权重和偏置。

这种方法的优点是稳定,但训练时间长,需要大量的存储空间。

随机梯度下降算法则是随机选择一个训练样本计算梯度并更新权重和偏置,重复这个过程直到所有样本都被用于训练。

这种方法的优点是收敛速度快,但也容易陷入局部最优解。

小批量梯度下降算法则是在样本中选择一个较小的批次来计算梯度,然后更新权重和偏置。

这种方法结合了批量梯度下降算法和随机梯度下降算法的优点,通常被广泛采用。

二、神经网络的学习率调整方法学习率是控制模型更新步长的超参数,它决定了模型的收敛速度。

学习率过高会导致模型无法收敛或直接变成震荡状态,学习率过低则会导致模型收敛时间过长。

因此,调整学习率是优化神经网络的一个重要方法。

学习率衰减是一个常用的调整方法。

在训练过程中,随着模型逐渐收敛,学习率也应相应减小。

另外,自适应学习率算法也是一个有效的方法,如AdaGrad、RMSprop、Adam等。

这些算法能够根据梯度运行时的状态自动调整学习率,以更好地适应数据变化。

三、神经网络模型的正则化方法正则化是一种常见的降低模型复杂度的方法,可以有效地避免过拟合。

常用的正则化方法包括L1正则化、L2正则化和Dropout 方法。

L1正则化和L2正则化是通过在损失函数中加入正则项对权重进行约束的方法。

L1正则化将权重向量转化为具有稀疏性质的权重向量,可以有效地减少参数数量并提升模型的泛化能力。

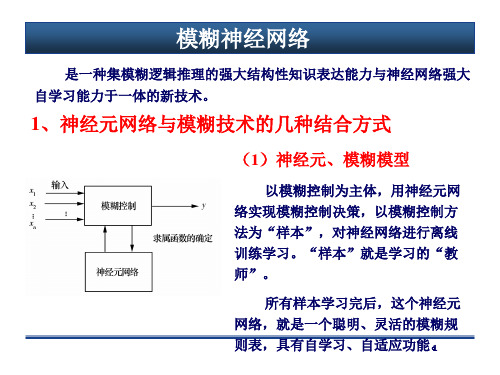

模糊神经网络

模糊神经网络简介模糊神经网络(FNN)是一种结合模糊逻辑和神经网络的方法,旨在处理模糊信息与不确定性。

该网络模拟人类大脑处理模糊信息的机制,能够有效地应对现实世界中的模糊问题。

模糊逻辑模糊逻辑是一种处理模糊性的数学工具,它引入了模糊集合和模糊运算,能够描述事物之间的模糊关系。

与传统的逻辑相比,模糊逻辑更符合人类认知过程,能够更好地处理模糊信息。

神经网络神经网络是一种由神经元和连接权重构成的计算模型,它能够通过学习不断优化权重,从而实现对输入数据的自适应建模。

神经网络在模式识别、预测和优化等方面表现出色。

模糊神经网络模糊神经网络将模糊逻辑和神经网络相结合,利用神经网络的自适应学习能力和模糊逻辑的模糊描述能力,有效地处理模糊信息。

FNN将模糊集合映射到神经网络,通过训练调整连接权重,实现对模糊规则的建模与推理。

FNN的特点•模糊描述能力:FNN能够处理模糊和不确定性信息,更适合于现实世界中的复杂问题。

•自适应学习:FNN可以根据输入数据进行权重调整,不断优化网络性能。

•非线性映射:FNN具有非线性映射能力,能够建模复杂的非线性关系。

•规则推理:FNN能够根据事先定义的模糊规则进行推理和决策。

应用领域模糊神经网络在诸多领域得到广泛应用: - 模糊控制:用于处理模糊和不确定性信息的系统控制。

- 模糊识别:用于模糊模式识别和特征提取。

- 模糊优化:用于解决模糊目标函数的优化问题。

- 模糊决策:用于模糊环境中的决策问题。

结语模糊神经网络作为模糊信息处理的有效工具,将模糊逻辑和神经网络的优势相结合,为处理现实世界中的复杂问题提供了一种全新的视角和方法。

随着人工智能技术的不断发展,模糊神经网络有望在更广泛的领域发挥重要作用。

利用改进T-S模糊神经网络恢复MMW图像

利用改进T-S模糊神经网络恢复MMW图像尚丽;周燕【摘要】为有效消除毫米波(MMW)图像中的非线性噪声,利用T-S模糊神经网络(T-S-FNN)对不确定信息进行有效区分的特性,实现MMW图像中非线性信息噪声的逼近,达到消噪的目的.为克服T-S-FNN规则冗余的缺点,考虑前件网络基于自适应模糊聚类的隶属度函数约束及后件网络的权值优化学习,对其前件及后件的结构和学习算法进行改进,使T-S-FNN的计算简化、鲁棒性更强.利用改进的T-S-FNN 对MMW图像进行处理,实验结果表明,该模型具有较好的非线性噪声抑制能力.【期刊名称】《计算机工程与设计》【年(卷),期】2018(039)005【总页数】5页(P1463-1466,1489)【关键词】非线性信息;模糊神经网络;TS模糊模型;毫米波图像;图像消噪【作者】尚丽;周燕【作者单位】苏州市职业大学电子信息工程学院,江苏苏州215104;苏州市职业大学电子信息工程学院,江苏苏州215104【正文语种】中文【中图分类】TN911.730 引言毫米波(milli-meter wave,MMW)图像在系统成像过程中会渗入很多未知的噪声[1,2],且图像的非线性信息缺失非常严重,图像视觉效果较差,研究有效的MMW图像恢复方法一直是备受关注的课题[2]。

而模糊神经网络(fuzzy neural network,FNN)模型兼有模糊系统和神经网络模型的优点[3-5],能够解决很多传统技术无能为力的、不确定的、且非常复杂的非线性问题[6-8]。

因此,本文引入FNN技术来实现MMW图像的非线性滤波,从而获得图像细节和轮廓边缘较清晰的MMW图像。

目前,T-S模糊系统已被实践证实是一种典型的、有效的非线性处理手段[2,8,9]。

然而,常用的T-S模糊系统中的规则数目和规则层的神经元数目都没有合理的确定方法,常常出现规则冗余的情况;另外,T-S模糊模型中的结构和优化算法也比较复杂,计算速度较慢。

模糊神经网络简介

以神经网络为主体,将输入空间分割成若干不同型式的模糊推论 组合,对系统先进行模糊逻辑判断,以模糊控制器输出作为神经元网 络的输入(串)。

后者具有自学习的智能控制特性。

2

模糊神经网络

(3)神经与模糊模型

根据输入量的不同性质分别由神经网络与模糊控制直接处理输入 信息,并作用于控制对象(并),更能发挥各自的控制特点。来自y 取小运算。∑

ec

……

∏

wnn

outi(j3) ini(j3) out1(i2) out2(2j)

i 1,2,3; j 1,2,3

∏

输入层 模糊化 模糊推理 去模糊化

10

基于标准模型的模糊神经网络

…… …… ……

∏ w11

∏

e

……

∏ wij

y

∑

ec

……

∏

wnn

∏

输入层 模糊化 模糊推理 去模糊化

(4)在结构上将二者融为一体

构成模糊神经网络,利用神经网络来实现模糊推理,在本质上是 模糊系统的实现。

3

模糊神经网络 优点:

1)模糊神经网络虽然也是局部逼近网络,但是它是按照 模糊系统模型建立的,网络中的各个结点及所有参数均有 明显的物理意义,因此这些参数的初值可根据模糊系统的 定性知识加以确定,经过上述学习算法的训练,收敛后的 网络能够满足系统所要求的输入输出关系,这是模糊神经 网络同单纯神经网络相比其优点所在。

1

N

Z

0.5

P

outi(j2) ini(j2)

(out ) e (1)

outi(1) aij bij 2

2

Aij

i

隶属度 μ

0

神经网络模式识别的改进及应用

神经网络模式识别的改进及应用神经网络是一种常用的模式识别算法,其具有自适应性和非线性映射的能力,因此被广泛应用于各个领域中,如图像识别、语音识别、自然语言处理等。

目前存在一些问题和改进空间,下面将介绍一些神经网络模式识别的改进方法以及应用案例。

1. 深度学习:深度学习是神经网络的一种改进方法,通过增加网络的深度和复杂度,可以提高模式识别的准确率。

深度学习将输入层与输出层之间的隐藏层逐层堆叠,从而实现对输入数据的多层次抽象和分层表示。

2. 卷积神经网络(CNN):卷积神经网络是一种特殊的神经网络结构,其在图像识别中具有很好的性能。

CNN通过卷积层和池化层对输入数据进行局部感知和特征提取,从而实现对图像的高效识别。

3. 递归神经网络(RNN):递归神经网络是一种具有动态记忆能力的神经网络结构,适用于序列数据的模式识别。

RNN通过将上一时刻的隐藏状态作为输入,从而实现对序列数据的连续建模和预测。

4. 长短期记忆网络(LSTM):长短期记忆网络是一种改进的RNN结构,专门用于解决长序列数据中的梯度消失问题。

LSTM通过引入记忆单元和门控机制,可以有效地处理长期依赖性和长距离依赖关系。

在实际应用中,神经网络模式识别已经被广泛应用于各个领域。

以下是神经网络模式识别的一些应用案例:1. 图像识别:神经网络可以通过训练数据集学习到图像的特征表示,并实现对图像的分类、检测等任务。

卷积神经网络在图像分类、物体识别等方面具有很好的性能,已经被应用于人脸识别、车辆识别等场景。

2. 语音识别:神经网络可以通过对语音信号进行特征提取,实现对语音的识别和理解。

深度神经网络在语音识别中具有很好的性能,已经被应用于语音助手、智能音箱等场景。

神经网络模式识别是一种强大的算法,通过不断的改进和应用,可以实现对不同类型数据的高效处理和准确识别,对推动人工智能技术的发展具有重要意义。

改进型BP神经网络方法在会计舞弊识别中的应用研究的开题报告

改进型BP神经网络方法在会计舞弊识别中的应用研究的开题报告题目:改进型BP神经网络方法在会计舞弊识别中的应用研究一、研究背景和意义会计舞弊作为一种经济犯罪行为,一直是社会关注的焦点之一。

在经济全球化的背景下,会计舞弊的手段和方式不断更新,对会计舞弊识别提出了更高的要求。

基于传统的统计学方法往往存在着维度过高、数据量庞大、识别精度较低等缺点,而基于神经网络的方法原理简单、识别效果较好,因此被广泛应用于会计舞弊识别领域。

本研究旨在对传统的BP神经网络进行改进,提高识别精度和稳定性,实现在会计舞弊识别中的更为准确和实用的应用。

二、研究内容和方法1. 总结与比较现有BP神经网络模型的优缺点,提出改进思路和方向。

2. 设计改进型BP神经网络模型,探究新的神经网络结构和训练算法。

在构建神经网络时,考虑将时间序列数据纳入,以提高数据的利用效率和识别精度。

在训练算法方面,采用深度学习方法和半监督训练算法,以更好地利用数据集信息。

3. 测试改进型BP神经网络模型的性能,以标准数据集验证模型精度和稳定性。

通过比较实验结果,评估改进等方法的实际效果。

三、预期成果本研究将提出一种改进型BP神经网络模型,构建更加高效和准确的会计舞弊识别系统。

预计其将具有如下特点:1. 改进型BP神经网络的结构与训练算法,明显提高神经网络的精度和稳定性,并适用于实际应用场景。

2. 模型能够对会计舞弊进行识别和分类,准确性达到较高水平。

3. 针对会计舞弊识别领域的特点,将时间序列数据纳入模型中,能够更为完整地利用数据集信息。

四、研究计划和进度1. 2020年10月-2020年12月:研究和总结现有BP神经网络模型的应用情况和技术缺陷。

2. 2021年1月-2021年3月:提出改进思路和方向,设计改进型BP神经网络模型。

3. 2021年4月-2021年7月:开展实验,验证改进型BP神经网络模型的性能和准确性。

4. 2021年8月-2021年10月:整理研究成果,撰写论文,并进行论文答辩。

深度神经网络结构的改进与优化

深度神经网络结构的改进与优化深度神经网络(DNN)在现代人工智能领域发挥了重要作用,但是在网络深度和规模增加的情况下,训练和操作DNN变得越来越困难。

为了克服这些问题,研究人员一直在尝试改进和优化DNN的结构。

在本文中,我们将讨论一些当前正在研究的DNN结构改进和优化技术。

一、批量标准化(Batch Normalization, BN)批量标准化是一种旨在加速和稳定神经网络训练的技术。

批量标准化引入了一种标准化方法,对于每层的输出进行标准化,以确保输入分布的稳定性,并且降低了一些过拟合。

该技术使得网络快速训练和更好的准确性。

尤其是在深层/大型网络的情况下,批量标准化的优势更为明显。

二、残差网络(Residual Network, ResNet)残差网络是一种新的DNN结构,可以帮助我们构建非常深的神经网络。

它鼓励各层之间的信息流动,同时减少了网络的退化(当网络层数增加时,网络准确率会降低)。

残差网络的基本组成单元是残差块,该块充分利用了输入和输出之间的残差信息。

ResNet已被证明在各种计算机视觉任务中的准确率相对其他模型有很大提高。

三、深度可分离卷积(Depthwise Separable Convolution, DSC)深度可分离卷积是一种有效的卷积操作,目前已经成为许多图像分割和对象检测网络的核心功能。

深度可分离卷积由一个深度和一个空间可分离卷积组成,因为它可以在减少计算量的同时提高网络的精确度。

它还可以缩小神经网络,从而减少了模型的大小,还可加快模型训练速度。

四、注意力机制(Attention Mechanism)注意力机制是一种关键技术,用于优化神经网络的信息交互和选择性注意。

它为每个输入元素分配一个权重,以便更加关注重要特征。

这种技术已广泛应用于自然语言处理,图像分类和对象检测等研究领域。

注意力机制可以提高模型的准确率,同时减少了复杂度,使得神经网络更容易可解释。

五、深度监督学习(Deep Supervision)深度监督学习是一种有效的DNN优化技术,可以增加DNN的稳定性和准确性。

神经网络预测模型的自身改进研究

神经网络预测模型的自身改进研究神经网络是一种重要的机器学习方法,已经在许多领域取得了重要的应用和成果。

然而,随着问题复杂度的增加和数据规模的扩大,神经网络模型仍然面临许多挑战。

为了提高神经网络模型的性能和效果,研究人员进行了大量的改进研究,以下是一些常见的改进方法。

首先,一些常用的改进方法包括优化算法的改进和网络结构的改进。

例如,传统的随机梯度下降算法可以通过使用动量、自适应学习率等技术进行改进,以加速网络收敛和避免陷入局部最优。

此外,研究人员还提出了一些新的优化算法,如Adam、Adagrad等,用于解决传统算法的缺点。

此外,研究人员还提出了一些新的网络结构,如卷积神经网络(CNN)、循环神经网络(RNN)、残差网络(ResNet)等,用于解决特定类型的问题。

其次,一些改进方法致力于增强网络的泛化能力和防止过拟合。

过拟合是指模型在训练集上表现很好,但在测试集上表现较差,导致模型无法很好地泛化到未见过的数据。

为了解决这个问题,研究人员提出了一些正则化技术,如L1和L2正则化、dropout等,用于限制模型的复杂性和减少参数的数量。

此外,研究人员还提出了一些数据增强技术,如图片旋转、缩放、平移等,用于增加数据的多样性,提高模型的泛化能力。

此外,一些改进方法致力于提高网络模型的训练速度和效率。

传统的神经网络模型在大规模数据集上的训练非常耗时,因此研究人员提出了一些加速技术,如小批量训练、并行计算、GPU加速等,用于加快网络的训练速度。

此外,研究人员还提出了一些剪枝技术,用于减少网络中冗余的参数和连接,进一步提高网络的效率。

最后,一些改进方法致力于提高网络模型的鲁棒性和适应性。

鲁棒性是指模型对输入数据的变化和扰动的敏感程度,适应性是指模型在面对领域变化和新任务时的表现。

为了提高网络模型的鲁棒性和适应性,研究人员提出了一些对抗性训练技术,如生成对抗网络(GAN)、对抗样本训练等,用于增加模型对不同类型攻击的抵抗能力。

模糊神经网络的结构与实现方法

模糊神经网络的结构与实现方法概述:在数学、计算机科学、人工智能领域中,神经网络是一种模仿人类神经系统结构与功能的数学模型,被广泛用于模式识别、机器学习和人工智能等领域。

模糊神经网络就是基于模糊数学理论的神经网络。

本文将介绍模糊神经网络的基本结构和实现方法。

模糊神经网络的基本结构:模糊神经网络的结构与普通神经网络的结构类似,由输入层、隐藏层和输出层三个部分组成。

1.输入层:输入层用于接收外部输入的模糊信息。

一般来说,输入的信息经过模糊化处理,以便于神经网络进行处理。

这些信息可以是关于物体颜色、大小、形状和运动方向等方面的特征。

2.隐藏层:隐藏层通常用于进行信息加工、转化和计算。

在模糊神经网络中,隐藏层的作用是将输入的模糊信息转换成一组更加抽象和具有判断性质的特征。

这些特征可以用于后续的分类和识别。

3.输出层:输出层将隐藏层计算后的特征转换成分类结果。

在模糊神经网络中,输出层的结果通常为一组置信度或概率,表示某个输入向量属于每个不同类别的可能性大小。

模糊神经网络的实现方法:模糊神经网络的实现方法一般分为两种:基于规则的模糊神经网络和基于学习的模糊神经网络。

1.基于规则的模糊神经网络:基于规则的模糊神经网络是一种预设规则的模糊推理方法。

它使用if-then规则作为知识表示形式,通过模糊逻辑运算对规则进行推理,以得出输出结果。

这种方法的优点是不需要进行训练,但是缺点是规则需要手动预设,需要专家经验,并且容易出现规则矛盾的情况。

2.基于学习的模糊神经网络:基于学习的模糊神经网络是一种通过样本训练来确定模型参数的方法。

它使用输入和输出的训练样本集来训练网络的权重和阈值,以得出输出结果。

这种方法的优点是可以自动学习知识,并且可以处理复杂的非线性问题,但是需要大量的训练数据和时间。

总结:模糊神经网络作为一种非常有效的神经网络类型,已经被广泛应用于图像处理、模式识别、控制系统等领域。

本文简要介绍了模糊神经网络的基本结构和实现方法,并且指出了它的优点和缺点。

基于改进Elman神经网络的CFRP补强钢板界面脱粘预测研究

基于改进Elman神经网络的CFRP补强钢板界面脱粘预测研

究

王庆松;张玉;张洪雨;陈柏桦

【期刊名称】《振动与冲击》

【年(卷),期】2024(43)3

【摘要】针对碳纤维复合材料(carbon fiber reinforced polymer, CFRP)补强钢结构出现内部界面脱粘损伤后难以观测的问题,结合Lamb波检测方法和神经网络提出了一种界面脱粘预测方法。

搭建了基于Lamb波的CFRP补强钢板信号分析试验平台,利用ABAQUS软件建立了CFRP补强钢板的机电耦合有限元模型,并通过试验验证了有限元模型的准确性。

将长方形和圆形两种脱粘形状的信号在时域和频域内进行分析,基于自适应遗传算法改进的Elman神经网络建立了CFRP补强钢板脱粘预测模型,并将与脱粘面积相关性较高的信号特征数据作为预测模型的特征数据。

对预测模型进行性能测试,脱粘形状为长方形和圆形预测值的平均绝对百分比误差分别为3.03%和8.06%,结果表明改进的Elman网络对于脱粘损伤具有较好的预测精度。

【总页数】8页(P120-127)

【作者】王庆松;张玉;张洪雨;陈柏桦

【作者单位】中国石油大学(北京)安全与海洋工程学院;中油国际管道有限公司【正文语种】中文

【中图分类】TB553

【相关文献】

1.基于改进型Elman神经网络预测模糊神经网络控制的变风量空调设计

2.基于Elman神经网络改进ARIMA模型的网络负荷预测研究

3.基于神经网络的金属基复合材料结构中深层界面脱粘缺陷识别

4.钢板屈服对CFRP-钢界面粘接性能影响的试验研究

5.基于改进的Elman神经网络的病虫害预测模型研究

因版权原因,仅展示原文概要,查看原文内容请购买。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

模糊神经网络作为具有一定的处理定性与定量知识的技术与方法,可充分利用模糊逻辑所具有的

较强的结构性知识表达能力,以及神经网络强大的自学习和定量数据的直接处理能力.在网络训练学习

过程中,采用了自适应学习速率,克服了单一、固定不变的学习速率缺陷.将此模型应用于汽轮发电机

组状态监测中,简化了模糊推理输出公式,减少运算量,加快了收敛速度.

历一个激励传递函数之后的输出组成.模糊神经元结构模型,如图1所示.图1中:模糊神经元的输入

模糊信号为。,一,;输出模糊信号为;模糊数叫。,叫一,一1分别对应输入.. z。,z一,z的

连接权值.模糊神经元的输入(一0,1,.,”一1)、输出.y和连接权硼(—O,1,.,”一1)均在[O,1]上

取值,分别对应模糊集的隶属程度...

叫时,训.. =

===叫;..

(3)若.. y-

--x。>卵,则

(工)对权值.. (J—o,1,.,一1),当叫.. >时,叫一(叫。一.. )V0;当≤q。时,

叫)叫;..

(1I)对权值.. (i=0,1,.,一1;.. 0,1,.,一1),当.. >时,一( ”一.. ”)V0;当

对改进的模糊神经网络进行训练,训练样本为表1中的数据,训练所得的模糊权值数据的集合即为

模糊知识库.通过.. VisualC++语言程序仿真实现,得到一种可能的模糊知识库表示,如表2所示.

表2汽轮发电机组模糊神经网络知识库结构..

Tab.2 RepositorystructureofFNNforturbogeneratorunit

参考文献:..

[1] 高隽.智能信息处理方法导论[M].北京:机械工业出版社,20

004.

[2] 韩力群.人工神经网络理论、设计及应用[M].北京:化学工业出版社,20

002.

[3] 张乃尧,阎平凡.神经网络与模糊控制[M].北京:清华大学出版社,19

998.

[4]朱晓铭,王士同.单体模糊神经网络的学习规则及其收敛性研究[J].计算机研究与发展,2001,38(9):1057—1060

0,1,.,m一1;隐含层第.. J个模糊神经元的净输入..

1

z,LU~),,,7—1

一V(z八Z.1)J一01.,

,,2.

隐含层与输出层的连接权值叫;∈Eo,1],J—..

]

0,1,.,一1;输出层的净输入z:一V(0:八图2模糊神经网络结构模型..

叫;。’),其中,是隐层节点J的输出,输出层的输

改进的模糊神经网络结构由3层组成,其中输入层采用.. lO个模糊神经元,对应每个样本的10个指

标参数.隐含层模糊神经元数目仍按文[8]的选取原则,用5个模糊神经元表示.输出层由于是监测发电

机组运行的状态,所以采用.. 1个模糊神经元作为网络输出.

表1汽轮发电机组各状态的隶属函数值

Tab.1 Valuesofthemembershipfunctionofeachstateinaturbogeneratorunit

据不同指标的特性建立相应隶属函数,获得每个样本.. 1O个数据,如表.. 1所示.输出的样本.. 1~6的贴近

度()分别为.. 0.639,0.402,0.451,0.468,0.654,0.343.根据表.. 1,建立基于乘积一求和的模糊.. BP神经

网络,从而判断发电机组运行的良好、正常或不正常状态.

Esh—ogFybss{ntosfynuantr,nhnwhbierigagrtmJ.orao

]WANGSitn.uz

zzaiucin,uz

zzerlewokadteeyrdlannloih~]Junlf

SoftwareResearch,1999,30(3):325—334...

E6h,.. AHARUM.oosdrtosncnetoanua—uz

Fig.2 StructuremodelofFNN

出一-厂(z ).

为保证活化函数的值分布在[01]区间内,取活化函数_厂(z)为线性函数,有..

-厂()一[-1+exp(一4(x一0.5)

))].

2修改模糊权值的训练学习规则

模糊神经网络的学习规则,是在网络训练过程中,对网络模糊权值和阀值的修正规则.传统的模糊

活化函数,通常采用Sigmoid函数、高斯函数和线性函数等...

Fig.1 Structuremodel

offuz

zzyneurons

1.2模糊神经网络结构

模糊神经网络是多输入单输出的,由输入层、隐含层和输出层组成,其结构模型如图2所示.

第.. 1层为输入层,设有.. ”个输入模糊神经元,各节点直接与网络输入连接,网络输入是按相应隶属

被广泛地应用到多变量、非线性强,且自身数学描述不易得到的复杂系统的控制中.作为新的智能信息

处理方法Ⅲ,模糊神经网络对人工智能和模式识别的发展有重要作用具有良好的发展前景_]文[-提

,2.31

出了基于输入幂集的模糊神经元模型,并研究了模糊反向传播学习算法.文[4]研究了基于极大一极小方

法的模糊神经元,并研究了学习规则及其收敛性.然而,文[3—4]所研究的学习规则是基于单训练模式,

收稿日期:.. 200901—10

通信作者:李钟慎(17一,教授,.-allsyq.d.l

ll

91)男,主要从事先进控制理论与控制工程的研究Emi:zcw@hueue

基金项目:福建省自然科学基金资助项目(E0710

0018)

第3期刘云辉,等:改进型模糊神经网络模型的构造

函数模糊化后的模糊量.第2层为隐含层,设有m个模糊神经元,其作用与普通神经网络基本相同,实

采用基于乘积一求和的模糊.. BP神经网络,对上例得到的量化输出为0.545,得到汽轮发电机组运行

状况正常的结论,这与监测结果是一致的.通过仿真比较,文E87的学习训练次数为.. 2310次,而采用基

于极大一极小模糊算子的神经网络学习次数为.. 1436次,学习速度更快,效果更好.

4结束语

了收敛速度.采用此学习算法对实际汽轮发电机组运行状态进行监测,结果表明,模型具有较强的状态监测能

力,达到预期的目的.

关键词:模糊神经网络模型;模糊神经元;学习规则;状态监测

中图分类号:TP183文献标识码:A

模糊神经网络(FNN)具备强大的结构性知识表达能力,以及自身参数调整优化的能力.因此,它

f良好,.. >0.60,..

g()一正常,.. 0.40≤.. ≤0.60,..

l不正常,.. <o.40.

例如,对.. 1组新的监测样本{波形偏差,波动方差,相关性,1倍频幅值,2倍频幅值,3倍频幅值,

第3期刘云辉,等:改进型模糊神经网络模型的构造..

4倍频幅值,5倍频幅值,6倍频幅值,分频幅值}一{48.50,230.64,0.96,260.75,59.67,40.64,..

出,学习速率也可以实时调整.因而,使网络的学习更加平稳和精确.

258华侨大学学报(自然科学版) 2010芷

对训练样本集中的任意训练样本P,若实际输出z与网络输出Y满足Iymx。I≤r/(r/是给定的训

练学习精度),则称模糊神经网络是收敛的_

__7].

改进型模糊神经网络学习算法,在模糊权值的修改上,采用的是当输出.. z。一.. >叩时,若;<

改进型模糊神经网络模型的构造

刘云辉,李钟慎..

(华侨大学机电及自动化学院,福建泉州.. 362021)

摘要:利用模糊系统和神经网络的优势,构造一种改进型模糊神经网络模型.从极大一极小模糊算子的模糊

神经元入手,提出改进的修改模糊权值的训练学习规则.改进后的模糊神经网络模型大大减少了运算量,提高

叫.. ≤时,;一;

在以上的步骤中,为训练学习精度(0<叩一1),卢为学习速率,两者的大小都将影响学习算法的收

敛速度.在网络训练学习过程中,采用了自适应学习速率以克服单一学习速率的缺陷。其调整公式为..

f1.05p(n),.. SSE(+ 1)< SSE(+1),..

p(n+1)一.. 0.7p(n),.. SSE(+1)>1.04SsE(+1),..

zzerigagrtmsbrdete

]YANSiMASSmecnieainoovninlerlfylannloihygaind—..

scnmehd,]FyStadSse,00121:16.

Lf()其他

ln,.

上式中:72为训练次数;ssE(”)为第”次误差平方和,sSE()=

===72,(。-

--y)。,一1,2,.,是;为学习样

l一.. 1

本个数;z为训练样本P的实际输出;为训练后的实际输出值.

学习算法相对于文[5—6],其权值修改不是仅依赖于网络的输出,而是还要依赖于相应神经元的输

改进的模糊神经网络学习算法有如下.. 4个步骤...

(1)若Iy-

--x。l≤呀,则权值无需再进行调整...

(2)若.. 517一.. >刁,则

(I)对权值.. (j=o,1。.,m-

--1),当。<时,。一(。+)八1;当。≥。时,

一;..

(1I)对权值.. (i=0,1,.,一1;一0,1,.,一1),当.. <时,叫一( ”+ “)八1;当

或~g(1。增加权值以使网络输出增加;-

--x若叫;,

,,降低权