隐形马尔科夫模型

HMM隐马尔可夫模型

HMM的应用(1)

词性标注 已知单词序列w1w2…wn,求词性序列c1c2…cn HMM模型: 将词性理解为状态 将单词理解为输出值 训练: 统计词性转移矩阵aij和词性到单词的输 出矩阵bik 求解: Viterbi算法

HMM的应用(2)

疾病分析 已知疾病序列w1w2…wn,求表征序列c1c2…cn对应状 态转移过程 HMM模型: 将每种疾病理解为状态 将输入的表征现象理解为输出值 训练: 统计从一种疾病转移到另一种疾病的转移 矩阵aij和某一疾病呈现出某一症状的概率 矩阵bik 求解: Viterbi算法

基本问题之三:学习问题

目的:给定观察值序列O,通过计算确定一个模型 ,使得P(O| )最大。 算法步骤: 1. 初始模型(待训练模型) 0 , 2. 基于0以及观察值序列O,训练新模型 0 ; 3. 如果 log P(X|) - log(P(X|0) < Delta ,说明训练已经 达到预期效果, 算法结束。 4. 否则,令0 = ,继续第2步工作

无跨越模型符合人类的语音特点,广泛应 用于语音识别中。

有跨越用于反映音素在发音中可能被吸收 或删除的情况。

Two types of HMM

State-emission HMM (Moore machine):

The output symbol is produced by states:

M

A B

每个状态可能的观察值数 目

与时间无关的状态转移概 率矩阵 给定状态下,观察值概率 分布 初始状态空间的概率分布

彩球颜色数目

在选定某个缸的情况下, 选择另一个缸的概率 每个缸中的颜色分布 初始时选择某口缸的概率

HMM可解决的问题

《基于隐马尔可夫模型的谎言认知状态分析及测谎系统研究》

《基于隐马尔可夫模型的谎言认知状态分析及测谎系统研究》一、引言在现代社会,随着信息技术的快速发展和社交媒体的普及,人们面临着越来越多的谎言和虚假信息。

因此,研究和开发有效的测谎技术成为了重要的研究方向。

本文将基于隐马尔可夫模型(Hidden Markov Model,HMM)对谎言认知状态进行分析,并研究其应用在测谎系统中的可能性。

二、隐马尔可夫模型概述隐马尔可夫模型是一种统计模型,它描述了一种隐藏状态序列与可观察事件之间的概率关系。

在测谎领域,我们可以将人的情感状态(如真实、谎言)视为隐藏状态,而人的语音、语调、语速等特征则可以被视为可观察事件。

通过隐马尔可夫模型,我们可以分析这些特征与情感状态之间的关系,进而实现对谎言的识别。

三、谎言认知状态分析在测谎过程中,我们需要首先对谎言认知状态进行分析。

根据心理学研究,人们在说谎时,其生理、心理和行为等方面都会发生一定的变化。

这些变化包括但不限于心率加快、呼吸急促、语言组织能力下降等。

这些变化反映了人们在说谎时的认知状态,也是我们进行测谎的重要依据。

四、基于隐马尔可夫模型的测谎系统研究基于隐马尔可夫模型的测谎系统主要包括以下步骤:1. 数据采集:通过传感器等技术手段,采集被试者的语音、语调、语速等特征数据以及生理信号数据(如心率、呼吸等)。

2. 特征提取:从采集的数据中提取出能够反映被试者情感状态的特征,如语音的音调变化、语速的快慢等。

3. 模型训练:利用隐马尔可夫模型对提取的特征进行训练,建立情感状态与特征之间的概率关系模型。

4. 谎言识别:根据被试者的实时特征数据,利用训练好的模型进行谎言识别。

当模型判断出被试者处于谎言认知状态时,系统将发出警报。

五、实验与分析为了验证基于隐马尔可夫模型的测谎系统的有效性,我们进行了实验。

实验中,我们采集了被试者在说真话和说谎话时的语音、语调、语速等特征数据以及生理信号数据。

然后,我们利用隐马尔可夫模型对这些数据进行训练和测试。

隐马尔可夫模型的基本用法

隐马尔可夫模型的基本用法隐马尔可夫模型(HiddenMarkovModel,HMM)是一种用于描述随机过程的概率模型,它在自然语言处理、语音识别、生物信息学、金融分析等领域得到了广泛应用。

本文将介绍隐马尔可夫模型的基本概念、数学表达、参数估计、解码算法等内容,希望对读者理解和应用该模型有所帮助。

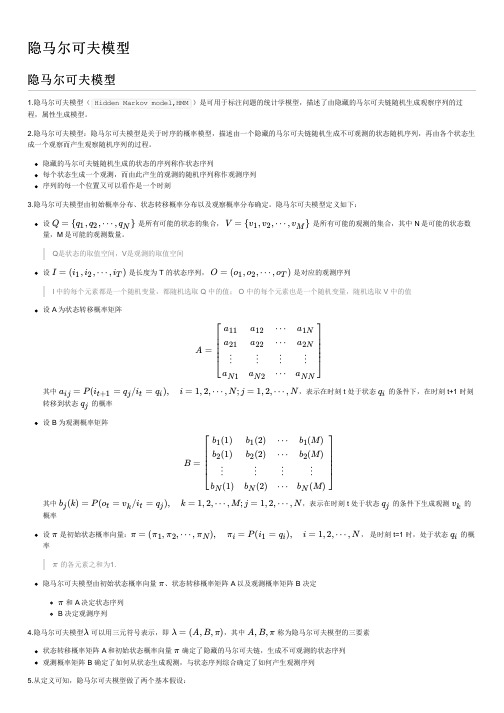

一、隐马尔可夫模型的基本概念隐马尔可夫模型是一个二元组(Q, O, A, B, π),其中:Q = {q1, q2, …, qN}是状态集合,表示模型中可能出现的所有状态;O = {o1, o2, …, oT}是观测集合,表示模型中可能出现的所有观测;A = [aij]是状态转移矩阵,其中aij表示从状态i转移到状态j的概率;B = [bj(k)]是观测概率矩阵,其中bj(k)表示在状态j下观测到k的概率;π = [πi]是初始状态概率向量,其中πi表示模型开始时处于状态i的概率。

隐马尔可夫模型的基本假设是:每个时刻系统处于某一状态,但是我们无法观测到该状态,只能观测到该状态下产生的某个观测。

因此,我们称该状态为隐状态,称观测为可观测状态。

隐马尔可夫模型的任务就是根据观测序列推断出最有可能的隐状态序列。

二、隐马尔可夫模型的数学表达隐马尔可夫模型的数学表达可以用贝叶斯公式表示:P(O|λ) = ∑Q P(O|Q, λ)P(Q|λ)其中,O表示观测序列,Q表示隐状态序列,λ表示模型参数。

P(O|Q, λ)表示在给定隐状态序列Q和模型参数λ的条件下,观测序列O出现的概率;P(Q|λ)表示在给定模型参数λ的条件下,隐状态序列Q出现的概率。

P(O|λ)表示在给定模型参数λ的条件下,观测序列O出现的概率。

根据贝叶斯公式,我们可以得到隐状态序列的后验概率:P(Q|O,λ) = P(O|Q,λ)P(Q|λ)/P(O|λ)其中,P(O|Q,λ)和P(Q|λ)可以通过模型参数计算,P(O|λ)可以通过前向算法或后向算法计算。

《隐马尔可夫模型》课件

隐马尔可夫模型在许多领域都有应用,如语音识 别、自然语言处理、生物信息学和金融预测等。

隐马尔可夫模型的应用领域

01

语音识别

用于将语音转换为文本,或识别说 话人的意图。

生物信息学

用于分析基因序列、蛋白质序列和 代谢物序列等。

03 隐马尔可夫模型的建立

观察概率矩阵的确定

总结词

观察概率矩阵描述了在给定状态下,观察到不同状态的概率 分布。

详细描述

观察概率矩阵是隐马尔可夫模型中的重要组成部分,它表示 了在给定状态下,观察到不同状态的概率分布。例如,在语 音识别中,观察概率矩阵可以表示在特定语音状态下发出不 同音素的概率。

状态转移概率矩阵的确定

VS

原理

通过动态规划找到最大概率的路径,该路 径对应于最可能的隐藏状态序列。

05 隐马尔可夫模型的优化与 改进

特征选择与模型参数优化

要点一

特征选择

选择与目标状态和观测结果相关的特征,提高模型预测准 确率。

要点二

模型参数优化

通过调整模型参数,如状态转移概率和观测概率,以改进 模型性能。

高阶隐马尔可夫模型

初始状态概率分布表示了隐马尔可夫模型在初始时刻处于各个状态的概率。这个概率分布是隐马尔可 夫模型的重要参数之一,它决定了模型在初始时刻所处的状态。在某些应用中,初始状态概率分布可 以根据具体问题来确定,也可以通过实验数据来估计。

04 隐马尔可夫模型的训练与 预测

前向-后向算法

前向算法

用于计算给定观察序列和模型参 数下,从初始状态到某个终止状 态的所有可能路径的概率。

《隐马尔可夫模型》 ppt课件

隐马尔可夫模型-完整

NLPLAB

19

分段K-均值算法

1、随机选个N个观察符号(每个符号用D维向量表示),将给定的T 个D维向量分配到上面N个观察符号中去(聚类),聚类的原则是将

T个中的每个向量分配到与自己欧氏距离最短的N个向量中的那个

向量中去。至此我们得到N个簇,每个簇代表一个状态。这个一开 始的聚类过程并不决定最后的HMM,而只是决定模型的训练次数。 2、计算起始概率和转移概率:

1i N

记忆回退路径: t(j)= arg max[ t-1(i) aij ] bj (Ot ), 2 t T ;1 i N

1i N

3.终结: QT= arg max[ T (i )]

1i N

P(QT ) max[ T (i )]

1i N

隐马尔科夫模型 Hidden Markov Model

NLPLAB

1

何为“隐”?

1. 如从四个盒子中各取一个球,开始从四个盒子随机选取一个盒子,从这 个盒子中随机抽出1个球,记录其颜色后,放回;然后从当前盒子随机 转移到下一个盒子,再取一个球;如此重复,直到取出四个球。这样可 以得到一个球的颜色的观测序列: 如:O={红,白,红,白},在这个过程中观察者只能观测到球的颜色 序列,观测不到球是从哪个盒子中取出的,即观测不到盒子的序列。 2. 如在词性标注这样的应用中,对于给定的要标注单词词性的一个句子, 我们看不到单词的词性,只能观察到每个单词,必须从单词序列去推断 正确的标记。我们说词性标注序列是隐藏的。

NLPLAB

22

NLPLAB

2

首先给出符号表示: Q=q1q2...qN 状态序列

A=a11a12...an1...ann 转移概率矩阵A,aij表示从状态i转移到状态j的概率 O=o1o2...oT B=bi(ot) 观测序列,o1表示在状态q1观测到o1 符号发射概率矩阵B,表示在状态i观测到ot的概率 初始状态, i表示初始状态为i的概率

机器学习_隐马尔可夫模型HMM

机器学习_隐马尔可夫模型HMM1. 马尔可夫链马尔可夫链是满足马尔可夫性质的随机过程。

马尔可夫性质是无记忆性。

也就是说,这一时刻的状态,受且只受前一时刻的影响,而不受更往前时刻的状态的影响。

我们下面说的隐藏状态序列就马尔可夫链。

2. 隐马尔可夫模型隐马尔可夫模型(Hidden Markov Model,HMM)是统计模型,用它处理的问题一般有两个特征:第一:问题是基于序列的,比如时间序列,或者状态序列。

第二:问题中有两类数据,一类序列数据是可以观测到的,即观测序列;而另一类数据是不能观测到的,即隐藏状态序列,简称状态序列,该序列是马尔可夫链,由于该链不能直观观测,所以叫“隐”马尔可夫模型。

简单地说,状态序列前项能算出后项,但观测不到,观测序列前项算不出后项,但能观测到,观测序列可由状态序列算出。

HMM模型的主要参数是λ=(A,B,Π),数据的流程是通过初始状态Pi生成第一个隐藏状态h1,h1结合生成矩阵B生成观测状态o1,h1根据转移矩阵A生成h2,h2和B再生成o2,以此类推,生成一系列的观测值。

HMM3. 举例1) 问题描述假设我关注了一支股票,它背后有主力高度控盘,我只能看到股票涨/跌(预测值:2种取值),看不到主力的操作:卖/不动/买(隐藏值:3种取值)。

涨跌受主力操作影响大,现在我知道一周之内股票的涨跌,想推测这段时间主力的操作。

假设我知道有以下信息:i. 观测序列O={o1,o2,...oT} 一周的涨跌O={1, 0, 1, 1, 1}ii. HMM模型λ=(A,B,Π)•隐藏状态转移矩阵A 主力从前一个操作到后一操作的转换概率A={{0.5, 0.3,0.2},{0.2, 0.5, 0.3},{0.3, 0.2, 0.5}}•隐藏状态对观测状态的生成矩阵B(3种->2种)主力操作对价格的影响B={{0.6, 0.3, 0.1},{0.2, 0.3, 0.5}}•隐藏状态的初始概率分布Pi(Π)主力一开始的操作的可能性Pi={0.7, 0.2,0.1}2) 代码c) 分析这里我们使用了Python的马尔可夫库hmmlearn,可通过命令 $ pip install hmmlearn安装(sklearn的hmm已停止更新,无法正常使用,所以用了hmmlearn库)马尔可夫模型λ=(A,B,Π),A,B,Π是模型的参数,此例中我们直接给出,并填充到模型中,通过观测值和模型的参数,求取隐藏状态。

4第四章_隐马尔可夫模型

S2

a23 0.6

a 0 .5 b 0 .5

S3

a13 0.2

a 1 b 0

a 0.8 a11 0.3 b 0 .2

a22 0.4 a 0.3

b 0 .7

S1

a12 0.5

a 1 b 0

再根据这个缸中彩色球颜色的概率分布,随机选择

一个球,记O2,再把球放回缸中。 最后得到描述球颜色的序列O1 O2 观察,被隐藏。 ,成为观察值 序列,但每次选取的缸和缸之间的转移并不能直接

设观察到的输出符号序列是aab。试求aab的输出概率?

a 0.8 a11 0.3 b 0 .2 a 0 .3 a22 0.4 b 0 .7 a 1 b 0

S1

a12 0.5

S2

a23 0.6

a 0 .5 b 0 .5

S3

a13 0.2 a 1

b 0

从S1到S3,并且输出aab,可能的路径有三种:

S1

S1

S1

S2

S2 S3

S2 S3

0.3×0.8×0.5×1×0.6×0.5=0.036

0.5×1×0.4×0.3×0.6×0.5=0.018 0.3×0.8×0.3×0.8×0.2×0=0

S2

a23 0.6

a 0 .5 b 0 .5

S3

a13 0.2

a 1 b 0

a11 a12 a13 1 a 22 a 23 1 a b 1

从一个状态转移出去 的概率之和为1。

每次转移时输出符号a和b 的概率之和为1。

一个关于天气的3状态马尔可夫模型

隐马尔可夫模型(有例子-具体易懂)课件

定义前向变量为:

“在时间步t, 得到t之前的所有明符号序列, 且时间 步t的状态是Si”这一事件的概率, 记为 (t, i) = P(o1,…,ot, qt = Si|λ)

则

算法过程

HMM的网格结构

前向算法过程演示

t=1

t=2

t=3

t=4

t=5

t=T

t=6

t=7

问题 1 – 评估问题

给定

一个骰子掷出的点数记录

124552646214614613613666166466163661636616361651561511514612356234

问题

会出现这个点数记录的概率有多大? 求P(O|λ)

问题 2 – 解码问题

给定

一个骰子掷出的点数记录

124552646214614613613666166466163661636616361651561511514612356234

HMM的三个基本问题

令 λ = {π,A,B} 为给定HMM的参数, 令 O = O1,...,OT 为观察值序列,则有关于 隐马尔可夫模型(HMM)的三个基本问题: 1.评估问题: 对于给定模型,求某个观察值序列的概率P(O|λ) ; 2.解码问题: 对于给定模型和观察值序列,求可能性最大的状态序列maxQ{P(Q|O,λ)}; 3.学习问题: 对于给定的一个观察值序列O,调整参数λ,使得观察值出现的概率P(O|λ)最大。

5点

1/6

3/16

6点

1/6

3/8

公平骰子A与灌铅骰子B的区别:

时间

1

2

3

4

5

6

7

骰子

A

A

隐马尔可夫模型

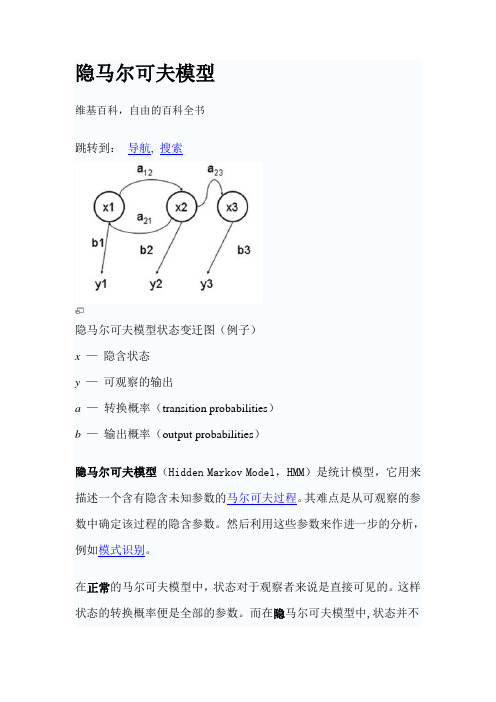

隐马尔可夫模型维基百科,自由的百科全书跳转到:导航, 搜索隐马尔可夫模型状态变迁图(例子)x—隐含状态y—可观察的输出a—转换概率(transition probabilities)b—输出概率(output probabilities)隐马尔可夫模型(Hidden Markov Model,HMM)是统计模型,它用来描述一个含有隐含未知参数的马尔可夫过程。

其难点是从可观察的参数中确定该过程的隐含参数。

然后利用这些参数来作进一步的分析,例如模式识别。

在正常的马尔可夫模型中,状态对于观察者来说是直接可见的。

这样状态的转换概率便是全部的参数。

而在隐马尔可夫模型中,状态并不是直接可见的,但受状态影响的某些变量则是可见的。

每一个状态在可能输出的符号上都有一概率分布。

因此输出符号的序列能够透露出状态序列的一些信息。

目录[隐藏]∙ 1 马尔可夫模型的演化∙ 2 使用隐马尔可夫模型o 2.1 具体实例o 2.2 隐马尔可夫模型的应用∙ 3 历史∙ 4 参见∙ 5 注解∙ 6 参考书目∙7 外部连接[编辑]马尔可夫模型的演化上边的图示强调了HMM的状态变迁。

有时,明确的表示出模型的演化也是有用的,我们用x(t1)与x(t2)来表达不同时刻t1和t2的状态。

在这个图中,每一个时间块(x(t), y(t))都可以向前或向后延伸。

通常,时间的起点被设置为t=0 或t=1.另外,最近的一些方法使用Junction tree算法来解决这三个问题。

[编辑]具体实例假设你有一个住得很远的朋友,他每天跟你打电话告诉你他那天作了什么.你的朋友仅仅对三种活动感兴趣:公园散步,购物以及清理房间.他选择做什么事情只凭天气.你对于他所住的地方的天气情况并不了解,但是你知道总的趋势.在他告诉你每天所做的事情基础上,你想要猜测他所在地的天气情况.你认为天气的运行就像一个马尔可夫链.其有两个状态 "雨"和"晴",但是你无法直接观察它们,也就是说,它们对于你是隐藏的.每天,你的朋友有一定的概率进行下列活动:"散步", "购物", 或 "清理".因为你朋友告诉你他的活动,所以这些活动就是你的观察数据.这整个系统就是一个隐马尔可夫模型HMM.你知道这个地区的总的天气趋势,并且平时知道你朋友会做的事情.也就是说这个隐马尔可夫模型的参数是已知的.你可以用程序语言(Python)写下来:states = ('Rainy', 'Sunny')observations = ('walk', 'shop', 'clean')start_probability = {'Rainy': 0.6, 'Sunny': 0.4}transition_probability = {'Rainy' : {'Rainy': 0.7, 'Sunny': 0.3},'Sunny' : {'Rainy': 0.4, 'Sunny': 0.6},}emission_probability = {'Rainy' : {'walk': 0.1, 'shop': 0.4, 'clean': 0.5},'Sunny' : {'walk': 0.6, 'shop': 0.3, 'clean': 0.1},}在这些代码中,start_probability代表了你对于你朋友第一次给你打电话时的天气情况的不确定性(你知道的只是那个地方平均起来下雨多些).在这里,这个特定的概率分布并非平衡的,平衡概率应该接近(在给定变迁概率的情况下){'Rainy': 0.571, 'Sunny': 0.429}< transition_probability表示基于马尔可夫链模型的天气变迁,在这个例子中,如果今天下雨,那么明天天晴的概率只有30%.代码emission_probability表示了你朋友每天作某件事的概率.如果下雨,有 50% 的概率他在清理房间;如果天晴,则有60%的概率他在外头散步.这个例子在Viterbi算法页上有更多的解释。

隐马尔可夫模型(HMM)简介

隐马尔可夫模型(HMM)简介(一)阿黄是大家敬爱的警官,他性格开朗,身体强壮,是大家心目中健康的典范。

但是,近一个月来阿黄的身体状况出现异常:情绪失控的状况时有发生。

有时候忍不住放声大笑,有时候有时候愁眉不展,有时候老泪纵横,有时候勃然大怒……如此变化无常的情绪失控是由什么引起的呢?据警队同事勇男描述,由于复习考试寝室不熄灯与多媒体作业的困扰,阿黄近日出现了失眠等症状;与此同时,阿黄近日登陆一个叫做“xiaonei网”的网站十分频繁。

经医生进一步诊断,由于其他人也遇到同样的考试压力、作息不规律的情况而并未出现情绪失控;并且,其它登陆XIAONEI网的众多同学表现正常,因此可基本排除它们是情绪失控的原因。

黄SIR的病情一度陷入僵局……最近,阿黄的病情有了新的眉目:据一位对手相学与占卜术十分精通的小巫婆透露,阿黄曾经私下请她对自己的病情进行诊断。

经过观察与分析终于有了重大发现:原来阿黄的病情正在被潜伏在他体内的三种侍神控制!他们是:修罗王、阿修罗、罗刹神。

据悉,这三种侍神是情绪积聚激化而形成的自然神灵,他们相克相生,是游离于个体意识之外的精神产物,可以对人的情绪起到支配作用。

每一天,都会有一位侍神主宰阿黄的情绪。

并且,不同的侍神会导致不同的情绪突然表现。

然而,当前的科技水平无法帮助我们诊断,当前哪位侍神是主宰侍神;更糟的是,不同的侍神(3个)与不同的情绪(4种)并不存在显而易见的一一对应关系。

所以,乍看上去,阿黄的病情再次陷入僵局……我们怎样才能把握阿黄情绪变化的规律?我们怎样才能通过阿黄的情绪变化,推测他体内侍神的变化规律?关键词:两类状态:情绪状态(观察状态):放声大笑,愁眉不展,老泪纵横,勃然大怒侍神状态(隐状态):修罗王,阿修罗,罗刹神(二)阿黄的病情引来了很多好心人的关心。

这与阿黄真诚善良的品格不无关系。

关于侍神的特点,占卜师和很多好心人找来了许多珍贵资料。

其中很多人经过一段时间的观察与记录后,在貌似毫无规律的数据背后,发现了侍神与情绪之间的内在规律!!他们在多次观测后,建立在大量数据基础上,表现出宏观的内在联系!由于这些好心人大部分是TONGJI大学的人,所以,这种规律被称作统计规律。

隐马尔科夫模型

Viterbi算法(续)

1 (i) i bi (O1 ), 1 i N 初始化:

递归:

1 (i) 0, 1 i N t ( j ) max [ t 1 (i)aij ]b j (Ot ), 2 t T ,1 j N

1i N

EM(Expectation Maximization)算法

极大似然估计

分布或密度函数

, 为分布的参数 N个来自此分布的样本 . 似然函数 参数 的的极大似然估计为

Байду номын сангаас

有时, 似然函数非常复杂或者有些样本数据有所” 缺失“, 这时, 我们可以使用EM算法来得到参数的 极大似然估计

Maximum Likelihood: Example 1

解决问题1 基础方法

给定一个固定的状态序列S=(q1,q ,q …)

2 3

P(O / S , ) P(Ot / qt , ) bq1 (O1 )bq2 (O2 )bqt (OT )

t 1

T

bqt (Ot ) 表示在q 状态下观测到O 的概率

t t

P(O / )

转移概率矩阵

晴天 阴天 下雨

晴天 晴天 0.50 阴天 0.375

阴天 0.25 0.25

下雨 0.25 0.375

下雨

0.25

0.125

0.625

转移概率矩阵(续)

由于链在时刻m从任何一个状态ai出发,到另 一时刻m+n,必然转移到a1,a2…,诸状态中 的某一个,所以有

P (m, m n) 1, i 1, 2,

隐马尔可夫模型三个基本问题及算法

隐马尔可夫模型(Hidden Markov Model, HMM)是一种用来对时序数据进行建模的概率图模型。

它在信号处理、语音识别、自然语言处理等领域被广泛应用,具有重要的理论和实际意义。

隐马尔可夫模型包括三个基本问题及相应的算法,分别是概率计算问题、学习问题和预测问题。

接下来我们将针对这三个问题展开详细探讨。

### 1.概率计算问题概率计算问题是指给定隐马尔可夫模型λ=(A, B, π)和观测序列O={o1, o2, ..., oT},计算在模型λ下观测序列O出现的概率P(O|λ)。

为了解决这个问题,可以使用前向传播算法。

前向传播算法通过递推计算前向概率αt(i)来求解观测序列O出现的概率。

具体来说,前向概率αt(i)表示在时刻t状态为i且观测到o1, o2, ..., ot的概率。

通过动态规划的思想,可以高效地计算出观测序列O出现的概率P(O|λ)。

### 2.学习问题学习问题是指已知观测序列O={o1, o2, ..., oT},估计隐马尔可夫模型λ=(A, B, π)的参数。

为了解决这个问题,可以使用Baum-Welch算法,也称为EM算法。

Baum-Welch算法通过迭代更新模型参数A、B和π,使得观测序列O出现的概率P(O|λ)最大化。

这一过程涉及到E步和M步,通过不断迭代更新模型参数,最终可以得到最优的隐马尔可夫模型。

### 3.预测问题预测问题是指给定隐马尔可夫模型λ=(A, B, π)和观测序列O={o1,o2, ..., oT},求解最有可能产生观测序列O的状态序列I={i1, i2, ..., iT}。

为了解决这个问题,可以使用维特比算法。

维特比算法通过动态规划的方式递推计算最优路径,得到最有可能产生观测序列O的状态序列I。

该算法在实际应用中具有高效性和准确性。

在实际应用中,隐马尔可夫模型的三个基本问题及相应的算法给我们提供了强大的建模和分析工具。

通过概率计算问题,我们可以计算出观测序列出现的概率;通过学习问题,我们可以从观测序列学习到模型的参数;通过预测问题,我们可以预测出最有可能的状态序列。

隐马尔可夫模型课件

隐马尔可夫模型课 件

目录

ቤተ መጻሕፍቲ ባይዱ

• 隐马尔可夫模型简介 • 隐马尔可夫模型的基本概念 • 隐马尔可夫模型的参数估计 • 隐马尔可夫模型的扩展 • 隐马尔可夫模型的应用实例 • 隐马尔可夫模型的前景与挑战

01

隐马尔可夫模型简介

定义与特点

定义

隐马尔可夫模型(Hidden Markov Model,简称HMM)是 一种统计模型,用于描述一个隐藏的马尔可夫链产生的观测 序列。

观测概率

定义

观测概率是指在给定隐藏状态下,观测到某一特定输出的概率。在隐马尔可夫 模型中,观测概率表示隐藏状态与观测结果之间的关系。

计算方法

观测概率通常通过训练数据集进行估计,使用最大似然估计或贝叶斯方法计算 。

初始状态概率

定义

初始状态概率是指在隐马尔可夫模型中,初始隐藏状态的概率分布。

计算方法

05

隐马尔可夫模型的应用实 例

语音识别

语音识别是利用隐马尔可夫模型来识别连续语音的技术。通过建立语音信号的时间序列与状态序列之 间的映射关系,实现对语音的自动识别。

在语音识别中,隐马尔可夫模型用于描述语音信号的动态特性,将连续的语音信号离散化为状态序列, 从而进行分类和识别。

隐马尔可夫模型在语音识别中具有较高的准确率和鲁棒性,广泛应用于语音输入、语音合成、语音导航 等领域。

Baum-Welch算法

总结词

Baum-Welch算法是一种用于隐马尔可夫模型参数估计的迭代算法,它通过最大化对数似然函数来估计模型参数 。

详细描述

Baum-Welch算法是一种基于期望最大化(EM)算法的参数估计方法,它通过对数似然函数作为优化目标,迭 代更新模型参数。在每次迭代中,算法首先使用前向-后向算法计算给定观测序列和当前参数值下的状态序列概 率,然后根据这些概率值更新模型参数。通过多次迭代,算法逐渐逼近模型参数的最优解。

隐马尔可夫模型

= (A , B, π) ,观测序列 O

输出: 观测序列概率 P (O; λ)

= 1,

i = 1, 2, ⋯ , N =1

对最终时刻的所有状态 qi ,规定 βT (i) 递推:对 t

= T − 1, T − 2, ⋯ , 1 :

N

βt (i) = ∑ a ijbj (ot+1 )βt+1 (j),

O 和 I 同时出现的联合概率为:

P (O, I ; λ) = P (O/I ; λ)P (I ; λ) = π i a i i a i i ⋯ a i b ( o ) b ( o ) ⋯ bi (oT ) 1 1 2 2 3 T −1 i T i 1 1 i 2 2 T

对所有可能的状态序列 I 求和,得到观测序列 O 的概率:

用极大似然估计的方法估计参数 预测问题(也称为解码问题):已知模型 λ 最大的状态序列 I

= (A , B, π) 和观测序列 O = (o1 , o2 , ⋯ , oT ) , 求对给定观测序列条件概率 P (I /O) = (i1 , i2 , ⋯ , iT ) 。即给定观测序列,求最可能的对应的状态序列

齐次性假设:即假设隐藏的马尔可夫链在任意时刻 t 的状态只依赖于它在前一时刻的状态,与其他时刻的状态和观测无关,也与时刻 t 无 关,即: P (it /it−1 , ot−1 , ⋯ , i1 , o1 )

= P (it /it−1 ),

t = 1, 2, ⋯ , T t = 1, 2, ⋯ , T

的概率记作: γ t (i)

8.给定模型 λ

= P (it = qi /O; λ)

P (O; λ) = ∑ P (O/I ; λ)P (I ; λ)

隐马尔可夫模型(hmm)参数迭代与语音识别

隐马尔可夫模型(HMM)是一种统计模型,常用于语音识别、自然语言处理等领域。

它主要用来描述隐藏的马尔可夫链,即一种具有未知状态的马尔可夫链。

在语音识别中,HMM被广泛应用于对语音信号进行建模和识别。

下面我将从HMM的基本概念、参数迭代和语音识别应用等方面展开阐述。

1. HMM的基本概念在隐马尔可夫模型中,有三种基本要素:状态、观测值和状态转移概率及观测概率。

状态表示未知的系统状态,它是隐藏的,无法直接观测到。

观测值则是我们可以观测到的数据,比如语音信号中的频谱特征等。

状态转移概率描述了在不同状态之间转移的概率,而观测概率则表示在每个状态下观测到不同观测值的概率分布。

2. HMM参数迭代HMM的参数包括初始状态概率、状态转移概率和观测概率。

在实际应用中,这些参数通常是未知的,需要通过观测数据进行估计。

参数迭代是指通过一定的算法不断更新参数的过程,以使模型更好地拟合观测数据。

常见的参数迭代算法包括Baum-Welch算法和Viterbi算法。

其中,Baum-Welch算法通过最大化似然函数来估计模型的参数,Viterbi算法则用于解码和预测。

3. HMM在语音识别中的应用在语音识别中,HMM被广泛用于建模和识别语音信号。

语音信号被转换成一系列的特征向量,比如MFCC(Mel-Frequency Cepstral Coefficients)特征。

这些特征向量被用来训练HMM模型,学习模型的参数。

在识别阶段,通过Viterbi算法对输入语音进行解码,得到最可能的文本输出。

4. 个人观点和理解从个人角度看,HMM作为一种强大的统计模型,在语音识别领域有着重要的应用。

通过不断迭代参数,HMM能够更好地建模语音信号,提高语音识别的准确性和鲁棒性。

然而,HMM也面临着状态空间爆炸、参数收敛速度慢等问题,需要结合其他模型和算法进行改进和优化。

总结回顾通过本文对隐马尔可夫模型(HMM)的介绍,我们从基本概念、参数迭代和语音识别应用等方面对HMM有了更深入的了解。

隐马尔可夫模型中最大似然估计的应用

隐马尔可夫模型(Hidden Markov Model, HMM)作为一种统计模型,被广泛应用在语音识别、自然语言处理、生物信息学等各个领域。

在HMM中,最大似然估计是一种常用的参数估计方法,它在模型训练和预测中起到重要作用。

本文将重点讨论在HMM中最大似然估计的应用,以及该方法在实际问题中的意义和效果。

一、隐马尔可夫模型简介隐马尔可夫模型是一种基于概率的图模型,用来描述一系列由隐藏的马尔可夫链生成的观测序列。

在HMM中,有三组参数需要进行估计:初始状态概率,状态转移概率以及观测概率。

通过HMM可以对状态序列和观测序列之间的关系进行建模,并用于对未知的状态序列进行推断和预测。

二、最大似然估计的原理最大似然估计是一种常用的参数估计方法,它的核心思想是在给定观测数据的情况下,找到能最大化生成观测数据的模型参数。

对于HMM来说,最大似然估计的目标就是找到能最大化观测序列的联合概率分布的参数值。

通过最大似然估计,可以寻找到最优的模型参数,从而使模型对观测数据的拟合度最高。

三、最大似然估计在HMM中的应用1. 初始状态概率的估计在HMM中,初始状态概率指的是系统在时间t=1时处于各个隐藏状态的概率分布。

最大似然估计通过统计观测序列中每个状态出现的频率,来估计系统在时间t=1时处于各个隐藏状态的概率。

这样就可以得到初始状态概率的估计值,从而初始化HMM模型。

2. 状态转移概率的估计状态转移概率指的是系统在隐藏状态之间转移的概率分布。

最大似然估计通过统计观测序列中相邻状态之间的转移频率,来估计系统在隐藏状态之间转移的概率分布。

这样就可以得到状态转移概率的估计值,从而描述隐藏状态之间的转移关系。

3. 观测概率的估计观测概率指的是系统在各个隐藏状态下生成观测数据的概率分布。

最大似然估计通过统计观测序列中各个状态生成对应观测数据的频率,来估计系统在各个隐藏状态下生成观测数据的概率分布。

这样就可以得到观测概率的估计值,从而描述隐藏状态生成观测数据的模式。

隐马尔可夫模型及其应用课件

观测

观测是系统状态的可见输出,它们是由隐藏 状态生成的。

发射概率

描述在给定隐藏状态下生成观测的概率。

模型的参数

初始状态概率

隐藏状态的初始概率分布。

转移概率矩阵

描述隐藏状态之间转移的概率矩阵。

发射概率矩阵

描述在给定隐藏状态下生成观测的概率矩阵。

状态序列长度

隐藏状态序列的长度,通常根据具体问题确定。

02 隐马尔可夫模型的算法

隐马尔可夫模型及其应用课件

目录

CONTENTS

• 隐马尔可夫模型简介 • 隐马尔可夫模型的算法 • 隐马尔可夫模型的应用 • 隐马尔可夫模型的优缺点 • 隐马尔可夫模型的发展趋势与展望

01 隐马尔可夫模型简介

CHAPTER

定义与特性

隐马尔可夫模型(HMM)是一种统计模型,用于描述一个不可观测的马尔可夫过 程,也就是隐藏状态序列。

CHAPTER

前向-后向算法

前向算法

用于计算给定观察序列和模型参 数下,从初始状态到结束状态的 所有可能路径的概率。

后向算法

用于计算给定观察序列和模型参 数下,从结束状态到初始状态的 所有可能路径的概率。

维特比算法

• 维特比算法:是一种高效的寻找最大概率路径的算法,通过 动态规划的方式,在每个状态转移时选择概率最大的转移。

在生物信息学中的应用

基因序列分析

在生物信息学中,隐马尔可夫模 型被用于基因序列分析,如预测 基因结构、识别基因启动子等。 通过训练模型,可以学习基因序 列的统计特性,从而进行基因相 关的分析和预测。

蛋白质序列分析

隐马尔可夫模型也被应用于蛋白 质序列分析,如蛋白质二级结构 预测、蛋白质家族分类等。通过 分析蛋白质序列的统计规律,隐 马尔可夫模型能够提供对蛋白质 结构和功能的深入理解。

隐马尔科夫模型

5.2隐马尔科夫模型的引入 5.2隐马尔科夫模型的引入

• HMM是一个输出符号序列的统计模型,具有N个状 HMM是一个输出符号序列的统计模型, 是一个输出符号序列的统计模型 态 , S ,L , S ,它按一定的周期从一个状态转移到另一个状 S 态,每次转移时,输出一个符号。转移到哪一个状态,转 每次转移时,输出一个符号。转移到哪一个状态, 移时输出什么符号, 移时输出什么符号,分别由状态转移概率和转移时的输出 概率来决定。因为只能观测到输出符号序列, 概率来决定。因为只能观测到输出符号序列,而不能观测 到状态转移序列(即模型输出符号序列时, 到状态转移序列(即模型输出符号序列时,是通过了哪些 状态路径,不能知道),所以称为隐藏的马尔可夫模型。 状态路径,不能知道),所以称为隐藏的马尔可夫模型。 ),所以称为隐藏的马尔可夫模型

P( S ) = ∏ P( si | s1i −1 ) = ∏ P( si | si −1 )

i i

P (O | S ) = ∏ P (oi | s1i ) = ∏ P(oi | si −1 , si )

i i

• 因为是隐Markov模型,把所有可能的状态转移序列都考虑进 因为是隐Markov模型, Markov模型 则有: 去,则有:

P (O) = ∑ P (O | S ) P( S ) = ∑∏ P ( s i | si −1 ) P (oi | s i −1 , si )

S S i

这就是上面我们计算输出符号序列aab的输出概率时所用的 方法。 方法。

HMM的基本元素 HMM的基本元素

根据以上的分析,对于语音识别用HMM可以用下面六个 根据以上的分析,对于语音识别用HMM可以用下面六个 HMM 模型参数来定义, 模型参数来定义,即: M = {S , O, A, B, π , F } :模型中状态的有限集合,即模型由几个状态组成。设 模型中状态的有限集合,即模型由几个状态组成。 S = {Si | i =1,2,L, N} st 个状态, 有Ns 个状态S ) , 。记t时刻模型所处状态为 ,显 t ∈ ( S1 , L , N 在球与缸的实验中的缸就相当于状态。 然 。在球与缸的实验中的缸就相当于状态。 O

隐马尔科夫模型在医学影像识别中的应用(Ⅲ)

隐马尔可夫模型(Hidden Markov Model, HMM)是一种统计模型,常用于对随机序列进行建模和分析。

它在医学影像识别中有着广泛的应用,能够对医学影像数据进行分析和诊断,为医生们提供更加准确和可靠的辅助诊断。

本文将探讨隐马尔可夫模型在医学影像识别中的应用,包括其基本原理、技术特点以及在医学影像识别中的具体应用和发展前景。

隐马尔可夫模型是一种用于描述由隐藏的马尔可夫链生成的观测序列的概率模型。

它由状态空间、观测空间、初始概率分布、状态转移概率分布和观测概率分布组成。

在医学影像识别中,隐马尔可夫模型可以用于对医学影像数据进行建模和分析。

通过对医学影像数据进行训练,模型可以学习到不同疾病在影像上的特征,从而实现对医学影像数据的自动识别和诊断。

隐马尔可夫模型在医学影像识别中具有许多优点。

首先,它能够充分利用医学影像数据中的时序信息,对医学影像数据进行建模和分析的时候,考虑到了不同时间点之间的依赖关系,能够更加准确地反映疾病的发展过程。

其次,隐马尔可夫模型能够处理不完全数据,即使在医学影像数据中存在缺失或噪声,模型也能够有效地进行识别和分析。

此外,隐马尔可夫模型还可以很好地处理多个观测序列的情况,能够对不同类型的医学影像数据进行综合分析。

在实际应用中,隐马尔可夫模型在医学影像识别中有着广泛的应用。

首先,它可以用于对医学影像数据进行自动分割和标注,能够将医学影像数据中的不同组织和结构进行准确的划分和标记,为医生们提供更加清晰和直观的影像信息。

其次,隐马尔可夫模型可以用于对医学影像数据进行疾病诊断和分析,能够根据影像数据中的特征对患者的疾病进行自动识别和辅助诊断。

此外,隐马尔可夫模型还可以用于对医学影像数据进行异常检测,能够帮助医生们及时发现和诊断患者的异常情况。

隐马尔可夫模型在医学影像识别中的应用还在不断发展和完善之中。

随着医学影像数据的不断积累和完善,隐马尔可夫模型将能够更加准确地对医学影像数据进行建模和分析,为医生们提供更加准确和可靠的辅助诊断。

隐马尔可夫模型三个基本问题及算法

隐马尔可夫模型三个基本问题及算法隐马尔可夫模型(Hien Markov Model, HMM)是一种用于建模具有隐藏状态和可观测状态序列的概率模型。

它在语音识别、自然语言处理、生物信息学等领域广泛应用,并且在机器学习和模式识别领域有着重要的地位。

隐马尔可夫模型有三个基本问题,分别是状态序列概率计算问题、参数学习问题和预测问题。

一、状态序列概率计算问题在隐马尔可夫模型中,给定模型参数和观测序列,计算观测序列出现的概率是一个关键问题。

这个问题通常由前向算法和后向算法来解决。

具体来说,前向算法用于计算给定观测序列下特定状态出现的概率,而后向算法则用于计算给定观测序列下前面状态的概率。

这两个算法相互协作,可以高效地解决状态序列概率计算问题。

二、参数学习问题参数学习问题是指在给定观测序列和状态序列的情况下,估计隐马尔可夫模型的参数。

通常采用的算法是Baum-Welch算法,它是一种迭代算法,通过不断更新模型参数来使观测序列出现的概率最大化。

这个问题的解决对于模型的训练和优化非常重要。

三、预测问题预测问题是指在给定观测序列和模型参数的情况下,求解最可能的状态序列。

这个问题通常由维特比算法来解决,它通过动态规划的方式来找到最可能的状态序列,并且在很多实际应用中都有着重要的作用。

以上就是隐马尔可夫模型的三个基本问题及相应的算法解决方法。

在实际应用中,隐马尔可夫模型可以用于许多领域,比如语音识别中的语音建模、自然语言处理中的词性标注和信息抽取、生物信息学中的基因预测等。

隐马尔可夫模型的强大表达能力和灵活性使得它成为了一个非常有价值的模型工具。

在撰写这篇文章的过程中,我对隐马尔可夫模型的三个基本问题有了更深入的理解。

通过对状态序列概率计算问题、参数学习问题和预测问题的深入探讨,我认识到隐马尔可夫模型在实际应用中的重要性和广泛适用性。

隐马尔可夫模型的算法解决了许多实际问题,并且在相关领域有着重要的意义。

隐马尔可夫模型是一种强大的概率模型,它的三个基本问题和相应的算法为实际应用提供了重要支持。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

4、状态转移矩阵:

weather yesterday

weather today Sunny Cloudy Rainy Sunny 0.500 0.375 0.125 Cloudy 0.250 0.125 0.625 Rainy 0.250 0.375 0.375

t=1时刻所有状态的局部概率:

每个时间点,t=2,… ,T时,对于每个状态的 局部概率,由下式计算局部概率:

给定HMM,观察序列的概率等于T时刻所有局部 概率之和:

前向算法

前向算法复杂度

α (1)到α(T),一共T次,每次计算需要N^2次 乘法,复杂度为T * N^2

示例

1、隐藏状态 (天气):Sunny,Cloudy,Rainy;

前向算法

采用递归的方式计算观察序列的概率 用P t ( j ) 表示在时间t时 状态j的部分概率。

计算方法如下:

Pt ( j )= Pr( 观察状态 | 隐藏状态j ) x Pr(t时刻所有 指向j状态的路径)

前向算法

使用前向算法计算T步长观察序列的概率:

Y(K) yk1,...,yKT

HMM的三种应用

学习:从观察序列中得出HMM

根据观察序列和其代表的隐状态,生成一个三元组 HMM ( ∏ ,A,B)。使这个三元组能够最好的描述我们 所见的一个现象规律

前向—后向算法

前向算法

对于水藻和天气的例子

Pr(dry,damp,soggy | HMM) = Pr(dry,damp,soggy | sunny,sunny,sunny) + Pr(dry,damp,soggy | sunny,sunny ,cloudy) + . . . . Pr(dry,damp,soggy | rainy,rainy ,rainy)

隐形马尔科夫模型 (M)

姓名:马珂 学号:201111031655

主要内容

隐形马尔科夫模型介绍 HMM的三种应用 评估:前向算法 示例 小结

HMM简介

马尔科夫模型

马尔科夫过程就是当前的状态只与前n个状态有关。 这被称作n阶马尔科夫模型。

最简单的模型就当n=1时的一阶模型。就当前的状 态只与前一状态有关。;

一个应用就是语音识别,我们的问题定义就是 如何通过给出的语音信号预测出原来的文字信 息。在这里,语音信号就是观察状态,识别出 的文字就是隐含状态。

HMM简介

包含隐状态的天气预测

HMM简介

隐状态和观察状态之间的连线表示:在给定的 马尔科夫过程中,一个特定的隐状态对应的观 察状态的概率

HMM简介

我们可以得到HMM的所有要素:两类状态和三 组概率

两类状态:观察状态和隐状态; 三组概率:初始概率、状态转移概率和两态对应概

率(confusion matrix)

HMM的三种应用

评估:根据已知的HMM找出一个观察序列的概 率

考虑这样的问题,我们有一些隐马尔科夫模型(也 就是一些( ∏ ,A,B)三元组的集合)及一个观察序列。 我们想知道哪一个HMM最有可能产生了这个给定的 观察序列。例如,对于海藻来说,我们也许会有一 个“夏季”模型和一个“冬季”模型,因为不同季 节之间的情况是不同的——我们也许想根据海藻湿 度的观察序列来确定当前的季节。

结果:prob(O| model) = 0.026901

小结

隐马尔科夫模型(HMM)在分析实际系统中 已被证明有很大的价值;它们通常的缺点是过 于简化的假设,这与马尔可夫假设相关——即一 个状态只依赖于前一个状态,并且这种依赖关 系是独立于时间之外的(与时间无关)

谢谢!

两种生成模式

确定性的生成模式

如:红绿灯

非确定性的生成模式

如:天气情况(晴、多云、和雨)

HMM简介

非确定性的生成模式(天气预测)

假设该过程是一个一阶过程,即今天的天气情况仅 和昨天的天气有关

用状态转移矩阵描述

HMM简介

非确定性的生成模式(天气预测)

定义初始概率,称为向量 ;

一个一阶马尔科夫模型,包括如下概念:

状态:晴、多云、雨 状态转移概率 初始概率

HMM简介

当一个隐士不能通过直接观察天气状态来预测 天气时,但他有一些水藻。民间的传说告诉我 们水藻的状态与天气有一定的概率关系。也就 是说,水藻的状态与天气时紧密相关的。此时, 我们就有两组状态:观察状态(水藻的状态) 和隐含状态(天气状态)。因此,我们希望得 到一个算法可以为隐士通过水藻和马尔科夫过 程,在没有直接观察天气的情况下得到天气的 变化情况。

示例

5、混淆矩阵:

observed states

Dry Dryish Damp Soggy

Sunny 0.60 0.20 0.15 0.05

Hidden Cloudy 0.25 0.25 0.25 0.25

states Rainy 0.05 0.10 0.35 0.50

示例

输入: T=3 (1 3 4)

利用前向算法来得到观察状态序列对应于一个HMM 的概率

HMM的三种应用

解码:根据观察序列找到最有可能出现的隐状 态序列

viterbi算法(隐士只能通过感受水藻的状态来 判断天气状况)

viterbi算法也被广泛的应用在自然语言处理领 域。比如词性标注。字面上的文字信息就是观 察状态,而词性就是隐状态。通过HMM我们就 可以找到一句话上下文中最有可能出现的句法 结构。