机器学习分类方法详细讨论_决策树和随机森林

了解机器学习中的随机森林算法和决策树模型

了解机器学习中的随机森林算法和决策树模型一、介绍机器学习中的随机森林算法和决策树模型是常用的监督学习方法,被广泛应用于分类和回归问题。

本文将详细介绍这两个模型的原理以及它们在机器学习中的应用。

二、决策树模型1. 原理决策树是通过一系列的判断条件对数据进行分类或预测的模型。

其原理是基于对样本特征属性进行分割,直至得到能够完全分开不同类别的叶节点。

决策树模型具有易于理解、可解释性强等优点,适用于处理有离散特征和连续特征的数据集。

2. 构建过程决策树模型构建过程包括选择最佳划分属性、生成子节点以及递归构建子树等步骤。

通过计算划分属性的信息增益或其他指标,选择最佳属性作为当前节点的分裂条件。

然后将数据集按照该属性值进行划分,并递归地生成子节点,直到满足停止条件(如达到叶节点或深度限制)为止。

3. 应用领域决策树模型在多个领域都能得到广泛应用。

例如,在医学领域,可以利用决策树模型对患者的症状和各种检测指标进行分类,以辅助医生做出诊断决策。

在金融领域,可以通过构建决策树模型进行信用评分,帮助银行判断借款人的还款能力。

三、随机森林算法随机森林是一种基于集成学习思想的算法,它由多个决策树组成。

它通过对原始数据集进行有放回抽样(bootstrap)得到多个样本子集,并利用这些子集构建不同的决策树。

最后通过投票或平均等方式综合各决策树的结果来做出最终预测。

随机森林算法能够处理高维度数据和离群点,并且不容易过拟合。

2. 构建过程随机森林算法包括两个重要步骤:创建随机子集和构建决策树。

创建随机子集时,首先从原始数据集中进行有放回抽样得到训练集,然后再从每个特征子集中选择最佳划分属性。

构建决策树的过程与决策树模型相似,但在节点划分时只考虑随机子集中的一部分特征。

3. 应用领域随机森林算法被广泛用于文本分类、图像识别、推荐系统等领域。

在文本分类中,可以利用随机森林对文章或评论进行情感分析,帮助企业了解用户对其产品的态度。

在推荐系统中,可以利用随机森林对用户的历史行为进行分析,并给出个性化的推荐结果。

5决策树与随机森林

5决策树与随机森林决策树和随机森林是机器学习中常用的两种算法模型。

它们具有简单、易解释性好的特点,并且能够处理分类和回归问题。

在本文中,我将对决策树和随机森林进行详细介绍,并比较它们之间的差异。

1.决策树决策树的优点包括:-模型易理解和解释,可以以图形化的方式展示决策规则;-能够处理数据集中的离群值和缺失值;-具有快速的训练和预测速度。

然而,决策树也存在一些缺点:-容易过拟合,特别是当树的深度较大时;-对输入数据的变化敏感,可轻微的数据变化可能导致树的结构完全不同;-无法处理连续型特征,需要将其离散化。

2.随机森林随机森林是一种通过集成多个决策树来改进预测准确性的方法。

在随机森林中,每个决策树的训练数据都是通过采用有放回的随机抽样(bootstrap)从原始训练数据中选取的。

另外,在每个节点的划分过程中,随机森林通常只考虑一个随机选取的特征子集,而不是所有的特征。

最终的预测结果是通过对所有决策树的预测结果进行投票或平均得到。

随机森林的优点包括:-通过对多个决策树的集成,可以减少模型的方差,提高预测准确性;-能够处理高维数据和大量特征;-对于缺失值的处理相对鲁棒。

随机森林的缺点主要包括:-模型的解释性不如单棵决策树;-训练过程相对较慢,因为需要构建多个决策树;-在处理一些回归问题时,可能会出现预测结果过多集中于一部分数值的情况。

总结:决策树和随机森林在模型构建和应用方面有很多相似之处,都可以处理分类和回归问题。

但在实际应用中,可以根据具体情况选取适合的算法。

如果对模型的解释性要求更高,数据集样本量较小,可以选择决策树;如果需要更高的预测准确性,处理高维数据,可以选择随机森林。

同时,我们还可以通过调整决策树和随机森林的参数来提高模型性能,比如限制决策树的最大深度、调整随机森林中树的数量等。

《决策树与随机森林》课件

交叉验证

使用交叉验证来评估模型的泛化能力,以避 免过拟合。

随机森林的参数调整

1 2

决策树数量

调整决策树的数量,以找到最优的模型性能。

特征子集大小

调整在每一步分裂中选择的特征子集大小,以找 到最优的模型性能。

3

决策树深度

调整决策树的深度限制,以防止过拟合或欠拟合 。

05

决策树与随机森林的应用场景

分类问题

THANKS

感谢观看

随机森林的优缺点

可解释性强

每棵决策树都可以单独解释,有助于理解模型的工作原理。

鲁棒

对异常值和噪声具有较强的鲁棒性。

随机森林的优缺点

对参数敏感

随机森林中的参数如树的数量、特征选择比例等对模型性能影响较大。

可能产生过拟合

当数据集较小或特征过多时,随机森林可能产生过拟合。

04

随机森林算法

随机森林的生成

决策树的基本原理

特征选择

选择最能划分数据集的特征进行分裂,以减少决 策树的深度和复杂度。

剪枝

通过去除部分分支来降低过拟合的风险,提高模 型的泛化能力。

决策规则

将每个叶子节点映射到一个类别或值,根据该节 点所属类别或值进行预测。

决策树的优缺点

优点

易于理解和解释,分类效果好,对异常值和缺失值容忍度高 。

在构建每棵决策树时,随 机选择一部分特征进行划 分,增加模型的泛化能力 。

多样性

通过生成多棵决策树,增 加模型的多样性,降低过 拟合的风险。

集成学习

将多棵决策树的预测结果 进行汇总,利用投票等方 式决定最终输出,提高分 类任务的准确率。

随机森林的优缺点

高效

能够处理大规模数据集,计算效率高 。

决策树、随机森林的用法

决策树、随机森林的用法

决策树和随机森林是机器学习中常用的模型,它们可以用于分类和回归任务。

首先,让我们来讨论一下决策树。

决策树是一种树形结构的模型,它通过对数据集中的特征进行一系列的判断和分支,最终形成一个树状的决策过程。

在分类任务中,决策树可以根据输入的特征对实例进行分类;在回归任务中,决策树可以根据输入的特征对实例进行数值预测。

决策树的优点之一是易于理解和解释,因为它们可以直观地呈现出决策过程。

然而,决策树容易过拟合,因此通常会与剪枝等方法结合来提高泛化能力。

接下来,让我们来谈谈随机森林。

随机森林是由多棵决策树组成的集成学习模型。

它通过对数据集进行自助采样(bootstrap sampling)来构建多棵决策树,并且在每棵树的训练过程中,对特征进行随机选择。

最终的分类(或回归)结果是由多棵树的投票(或平均)得到的。

随机森林具有很高的准确性和鲁棒性,能够处理高维数据和大规模数据集,同时也不容易过拟合。

此外,由于随机森林的训练过程可以并行化,因此在处理大规模数据时具有较高的效率。

在实际应用中,决策树和随机森林可以用于各种领域,如金融、医疗、电子商务等,用于客户分类、风险评估、预测销售额等任务。

此外,它们也可以用于特征选择,因为在训练过程中可以得到特征

的重要性排名,从而帮助我们理解数据。

需要注意的是,对于不同

的数据集和任务,我们需要对模型进行调参以获得最佳性能。

总之,决策树和随机森林是强大且灵活的机器学习模型,它们

在实际应用中具有广泛的用途,可以帮助我们解决各种分类和回归

问题。

决策树 随机森林 原理 与区别

决策树随机森林原理与区别

决策树和随机森林都是机器学习中常用的模型,它们都属于监督学习的范畴。

首先我们来看一下决策树的原理。

决策树是一种树形结构,用于决策分析。

它通过一系列的规则对数据进行分类或预测。

决策树的构建过程是一个递归地选择最优特征,并根据该特征对数据集进行划分的过程。

在构建决策树的过程中,通过对数据集进行划分,使得每个子集内的数据尽可能属于同一类别,从而实现对数据的分类和预测。

而随机森林是基于决策树构建的一种集成学习方法。

它通过构建多个决策树,并将它们进行组合来完成对数据的分类或预测。

随机森林的构建过程是通过对训练集进行有放回抽样,然后对每个子样本集构建一个决策树,最后将这些决策树进行组合,通过投票或取平均值的方式来进行分类或预测。

决策树和随机森林的区别在于,决策树是单个树形结构,它对数据进行分类或预测的能力受到树的深度和分裂规则的影响。

而随机森林是由多个决策树组成的集成模型,它通过对多个决策树的组合来提高整体模型的泛化能力和鲁棒性。

另外,随机森林在构建决策树的过程中引入了随机性,这样可以减小过拟合的风险,提高模

型的稳定性。

总的来说,决策树和随机森林都是常用的机器学习模型,它们都可以用于分类和预测任务。

决策树是单个树形结构,而随机森林是由多个决策树组成的集成模型,通过对多个决策树的组合来提高模型的性能。

在实际应用中,需要根据具体的问题和数据集的特点来选择合适的模型。

决策树与随机森林模型的比较与使用指南(五)

决策树与随机森林模型的比较与使用指南引言在机器学习领域,决策树和随机森林是两种常见的模型。

它们都属于监督学习中的分类和回归方法,可以被广泛应用于数据挖掘、预测分析等领域。

本文将比较决策树和随机森林的特点和优劣,并给出使用指南,帮助读者在实际问题中选择合适的模型。

决策树模型决策树是一种树形结构的分类器,它通过对属性进行划分来逐步构建树形结构,最终得到一个可用于预测的模型。

决策树的建立过程中,会根据数据集中的特征进行划分,直到满足停止划分的条件为止。

决策树模型具有可解释性强、易于理解和实现的优点,同时对异常值和缺失值具有较好的容忍性。

然而,决策树模型容易过拟合,对数据的噪声敏感,泛化能力较差。

随机森林模型随机森林是一种集成学习方法,它通过构建多棵决策树,并且随机选择特征进行划分,最终根据多棵树的投票结果得出最终的分类结果。

相比于单棵决策树,随机森林具有更好的泛化能力和抗过拟合能力,能够处理高维数据和大规模数据集。

随机森林模型在处理分类和回归问题时表现良好,但是由于需要构建多棵树,计算成本较高。

比较与使用指南对于决策树模型和随机森林模型的选择,需要根据具体问题和数据集的特点来决定。

如果数据集较小,且数据具有较好的线性可分性,可以考虑使用决策树模型,由于决策树容易理解和解释,适用于需要可解释性较强的场景。

而对于大规模数据集和高维特征,以及需要更好的泛化能力和抗过拟合能力的场景,随机森林模型更适合。

另外,对于数据集中存在缺失值和异常值的情况,由于决策树模型具有较好的容忍性,也可以考虑使用决策树模型。

在使用决策树和随机森林模型时,还需要注意一些问题。

首先是特征选择,对于决策树模型和随机森林模型,特征选择是影响模型性能的关键因素。

在构建决策树或随机森林时,需要选择合适的特征进行划分,以提高模型的准确性和泛化能力。

其次是模型参数的调优,对于随机森林模型来说,需要调优的参数相对较多,需要根据具体问题和数据集进行调优选择。

决策树和随机森林

决策树和随机森林

决策树和随机森林都是基于树的算法,他们都可以用来解决分类和回

归问题。

决策树是一种树状图数据结构,它以关于属性的条件分支形式存

储数据。

决策树的优势在于模型易于解释和理解,非常适合作为通过视觉

或可视化的方式表达和解释结果的模型。

它可以用于编码大量的属性关系,并能够有效的处理具有缺失值和噪声的数据集。

然而,决策树也有一些缺点,例如它的复杂性和过拟合的可能。

而随机森林是一种机器学习算法,它位于决策树和贝叶斯方法之间,

通过在大量决策树之间进行加权,来降低过拟合现象。

它可以建立一个由

多个决策树组成的森林,并且可以有效处理大量的数据。

随机森林算法改

善了决策树的过拟合现象,具有更高的分类准确性和鲁棒性。

另外它也可

以有效地处理各种类型的属性,处理大量的实例和多种样本分布。

决策树和随机森林在解决不同的问题时有所不同。

对于具有较少噪声

的数据集,决策树通常具有更高的准确性。

但是,对于有噪声的数据集,

随机森林通常可以更好地处理这些噪声,而且也不太可能出现过拟合的情况。

此外,随机森林也可以有效地处理具有多种样本分布的数据集。

总的来说。

决策树与随机森林模型的比较与使用指南(Ⅰ)

决策树与随机森林模型的比较与使用指南在机器学习领域,决策树和随机森林是两种常见的分类和回归模型。

它们都可以用于处理结构化数据,如表格数据或特征向量。

本文将对决策树与随机森林这两种模型进行比较,并提供使用指南。

一、决策树决策树是一种树形结构的模型,用于表示各种可能的决策路径。

它通过对数据的特征进行递归分割,最终生成一个树状结构。

在决策树中,每个节点代表一个特征,每个分支代表一个可能的取值,而每个叶子节点代表一个类别或数值输出。

使用决策树模型时,可以根据特征的重要性来进行特征选择,也可以解释模型的预测结果。

此外,决策树模型对数据的缺失值和异常值有较强的鲁棒性,能够处理非线性关系和交互效应。

但是,决策树模型也存在一些缺点。

它容易过拟合,尤其是在处理高维数据时。

另外,决策树对数据的微小变化较为敏感,容易产生不稳定的结果。

二、随机森林随机森林是一种集成学习方法,通过构建多个决策树来进行分类或回归。

在随机森林中,每个决策树都是由对原始数据进行有放回抽样得到的不同训练集构建而成。

最终的预测结果是由所有决策树的预测结果取平均值或投票决定。

随机森林模型具有较高的准确率和泛化能力,对于大规模高维数据集也有很好的表现。

它能够有效地减少过拟合的风险,对噪声和异常值有一定的鲁棒性。

然而,随机森林模型也有一些缺点。

它对于数据集中的线性关系不够敏感,有时可能会产生较大的计算开销。

此外,由于随机森林模型的复杂性,对于模型的解释相对困难。

三、如何选择在选择模型时,可以根据实际的问题和数据情况来进行权衡。

如果数据集较小,并且希望得到模型的解释和可视化结果,可以选择决策树模型。

如果数据集较大,并且追求更高的准确率和泛化能力,可以选择随机森林模型。

另外,在使用随机森林模型时,可以通过调节决策树的数量、树的深度和特征的个数等超参数来优化模型的性能。

在训练过程中,还可以通过交叉验证等方法来评估模型的性能,并进行模型选择。

总之,决策树和随机森林是两种常见的机器学习模型,它们各自具有一定的优势和不足。

数据分析中的决策树和随机森林算法

数据分析中的决策树和随机森林算法数据分析在各个领域中发挥着重要的作用,帮助人们更好地理解和应对复杂的问题。

而在数据分析的过程中,决策树和随机森林算法是常见且广泛应用的两种方法。

它们能够从大量的数据中提取有价值的信息,辅助决策和预测。

本文将详细介绍决策树和随机森林算法的原理和应用,并对比它们的优缺点。

一、决策树算法决策树算法是一种基于树形结构的监督学习方法,通过将数据集分割成较小的子集,逐步构建决策树来进行决策和预测。

决策树的节点表示属性或特征,分支代表属性的取值,叶节点表示决策结果。

决策树的构建过程主要包括三个步骤:特征选择、树的构建和剪枝。

特征选择是指通过某种指标选择最佳的特征作为节点,将数据集划分成更具分类能力的子集。

树的构建是指根据选择的特征递归地将子集进一步划分,直到子集中的数据都属于同一类别或者满足停止条件。

剪枝是为了避免过拟合,通过删除某些节点来简化决策树。

决策树算法具有以下优点:易于理解和解释,可以处理数值型和离散型数据,对缺失值和异常值具有较好的鲁棒性。

然而,决策树的训练过程容易受到训练集的噪声和特征选择的不准确性等因素的影响,容易产生过拟合现象。

二、随机森林算法随机森林算法是一种集成学习方法,由多个决策树组成。

每个决策树都是通过对原始数据集进行有放回抽样(bootstrap)得到的。

在每个节点上,随机森林会随机选择一部分特征进行特征选择,再选择最佳特征进行节点分割。

最终,随机森林通过投票或平均值来进行决策。

随机森林算法继承了决策树算法的优点,并对其进行了改进。

相比于单个决策树,随机森林具有更高的预测准确性和鲁棒性。

通过集成多个决策树,随机森林可以降低过拟合的风险,并且能够处理大规模高维数据集。

此外,随机森林还可以通过特征重要性评估每个特征在分类任务中的重要程度。

然而,随机森林算法也存在一些缺点。

首先,随机森林的训练过程较慢,特别是在处理大规模数据集时。

其次,随机森林模型的结果较难解释,不如决策树直观。

决策树和随机森林用于分类和回归问题的原理和应用

决策树和随机森林用于分类和回归问题的

原理和应用

决策树和随机森林都是机器学习中的重要算法,可以用于分类和回归问题。

决策树的工作原理是通过将数据集划分为不同的子集

来进行决策,每个子集对应一个节点,并且每个节点都包含一个条件判断。

决策树易于理解和解释,它可用于处理分类和回归问题,并且能够处理数值型和离散型特征。

然而,决策树容易过拟合,特别是在处理复杂的问题时,需要使用剪枝等技术进行优化。

随机森林是一种集成学习方法,通过结合多个决策树的预测结果,提高了模型的泛化能力。

它通过随机选择样本和特征来构建多个决策树,并使用投票(分类)或平均(回归)方法来进行最终预测。

随机森林能够处理大量的高维数据,并且对噪声和异常值具有较好的鲁棒性。

相对于单个决策树,随机森林通常具有更好的泛化性能。

在应用方面,决策树和随机森林都被广泛用于分类和回归问题。

例如,在信用卡欺诈检测中,可以使用决策树或随机森林来根据用户的行为预测其是否可能进行欺诈活动。

在医疗领域,决策树和随机森林可以用于根据病人的症状和病史预测其可能的疾病。

此外,随机森林也被广泛用于自然语

言处理中,例如在机器翻译和语音识别中,可以使用随机森林来预测词义或语音到文本的转换。

总之,决策树和随机森林都是强大的机器学习算法,可以用于处理分类和回归问题。

在实际应用中,它们通常需要根据具体的问题进行适当的调整和优化。

决策树与随机森林模型的比较与使用指南(四)

决策树与随机森林模型的比较与使用指南随着大数据和人工智能技术的迅猛发展,机器学习模型在各个领域得到了广泛的应用。

决策树和随机森林作为经典的机器学习算法,在数据挖掘和预测建模中扮演着重要的角色。

本文将对决策树和随机森林进行比较,并提供使用指南,帮助读者更好地理解和应用这两种模型。

1. 决策树模型决策树是一种基于树形结构来进行决策的模型。

它通过对样本数据进行分类和预测,构建一个树形的决策流程。

在决策树中,每个节点代表一个属性,每个分支代表这个属性的一个取值,而每个叶子节点代表一个类别或者一个数值。

决策树的优点是易于理解和解释,能够处理多种数据类型,并且可以处理大规模的数据集。

然而,决策树容易过拟合,对噪声和异常值敏感,因此需要进行剪枝操作来避免过拟合。

2. 随机森林模型随机森林是一种集成学习方法,它由多个决策树组成。

在随机森林中,每棵决策树都是基于不同的随机样本和随机特征构建的,然后将它们进行整合得到最终的预测结果。

随机森林通过利用多个模型的集成来提高预测的准确性和稳定性,同时减少了过拟合的风险。

由于随机森林能够处理高维数据和大规模数据集,并且不需要对数据进行特征缩放,因此在实际应用中得到了广泛的应用。

3. 决策树与随机森林的比较在比较决策树和随机森林时,可以看出它们各自的特点。

决策树简单直观,易于理解和解释,但容易过拟合;而随机森林通过集成多个决策树,提高了预测的准确性和稳定性,同时减少了过拟合的风险。

因此,在实际应用中,可以根据具体的场景和数据特点来选择合适的模型。

4. 使用指南在使用决策树和随机森林模型时,需要注意以下几点:- 数据准备:对于决策树和随机森林模型,需要对数据进行预处理和特征工程,包括缺失值处理、数据标准化、特征选择等操作。

此外,需要将数据集划分为训练集和测试集,用于模型的训练和评估。

- 模型选择:在选择模型时,需要根据实际情况和数据特点来决定使用决策树还是随机森林。

如果数据集较小,且希望获得更好的解释性和可解释性,可以选择决策树模型;如果数据集较大,且需要更高的预测准确性和稳定性,可以选择随机森林模型。

决策树和随机森林区别

决策树和随机森林区别

决策树和随机森林是数据挖掘和机器学习领域中常用的两种建模技术,它们被广泛应用于分类和回归任务。

两者区别如下:

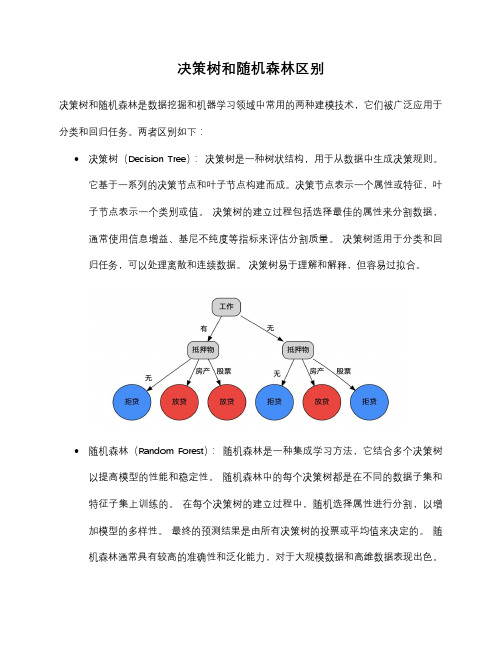

•决策树(Decision Tree): 决策树是一种树状结构,用于从数据中生成决策规则。

它基于一系列的决策节点和叶子节点构建而成。

决策节点表示一个属性或特征,叶子节点表示一个类别或值。

决策树的建立过程包括选择最佳的属性来分割数据,通常使用信息增益、基尼不纯度等指标来评估分割质量。

决策树适用于分类和回归任务,可以处理离散和连续数据。

决策树易于理解和解释,但容易过拟合。

•随机森林(Random Forest): 随机森林是一种集成学习方法,它结合多个决策树以提高模型的性能和稳定性。

随机森林中的每个决策树都是在不同的数据子集和特征子集上训练的。

在每个决策树的建立过程中,随机选择属性进行分割,以增加模型的多样性。

最终的预测结果是由所有决策树的投票或平均值来决定的。

随机森林通常具有较高的准确性和泛化能力,对于大规模数据和高维数据表现出色。

对于决策树,您可以将其视为一个基本的决策规则生成器,而随机森林则是一种通过组合多个决策树来改进性能的技术。

在实际应用中,根据问题的性质和数据的特点,您可以选择使用决策树或随机森林来构建预测模型。

探索机器学习算法之决策树与随机森林

探索机器学习算法之决策树与随机森林决策树与随机森林是机器学习领域中常用的算法,它们能够对数据进行分类和回归分析。

本文将围绕这两个算法展开探索,分析它们的原理、应用以及优缺点。

一、决策树算法决策树是一种基于树状结构的分类算法,通过对样本数据集进行递归的二分,将数据划分为不同的类别。

决策树的节点代表一个特征,分支代表特征的不同取值,叶子节点表示分类结果。

1. 决策树的原理决策树的生成过程分为特征选择和决策树的构建两个步骤。

特征选择的目标是找到最优划分特征,常用的评估指标有信息增益、信息增益比和基尼指数。

构建决策树时,可以采用递归的方式,不断迭代选择特征进行分类,直到满足某个条件为止。

2. 决策树的应用决策树算法广泛应用于数据挖掘、医学诊断、金融分析等领域。

例如,在医学诊断中,决策树可以根据病人的症状和体征,判断其患有哪种疾病。

在金融领域,决策树可以用于信用评估,根据客户的个人信息预测其还款能力。

3. 决策树的优缺点决策树的优点包括易于理解和解释、能够处理多分类问题、能够处理缺失数据等。

然而,决策树容易过拟合,对噪声数据敏感,需要进行剪枝等操作来提高泛化能力。

二、随机森林算法随机森林是一种集成学习的算法,通过将多个决策树进行集成,提高分类或回归的准确性。

1. 随机森林的原理随机森林的生成过程包括两个随机性:随机采样和随机特征选择。

随机采样是从原始数据集中有放回地随机抽取样本,生成多个子数据集。

随机特征选择是在每个节点中,从所有特征中随机选择一部分特征,用于特征的划分。

每个子数据集和子特征集构建一个决策树,最后通过投票或取平均值的方式融合多个决策树的预测结果。

2. 随机森林的应用随机森林被广泛应用于图像识别、数据分类、文本分析等领域。

例如,在图像识别中,随机森林可以根据图像的特征,判断图像中是否包含某个物体;在数据分类中,随机森林可以对用户进行人群分析,根据用户的行为预测其喜好。

3. 随机森林的优缺点随机森林的优点包括预测准确性高、能够处理大规模数据、具有抗过拟合能力等。

决策树与随机森林模型的比较与使用指南(六)

决策树与随机森林模型的比较与使用指南引言在机器学习领域,决策树和随机森林是两种常见的模型。

它们都属于监督学习算法,用于分类和回归任务。

本文将比较这两种模型的特点和适用场景,并给出它们的使用指南。

1. 决策树决策树是一种以树状图作为基本模型的预测模型,它使用树状图来呈现算法的决策过程。

决策树的节点表示特征属性,分支表示在这个特征上的取值,叶子节点表示最终的分类或回归结果。

决策树算法的优点是易于理解和解释,可以处理数值型和标称型数据,对缺失值不敏感。

但是,决策树也有一些缺点。

它很容易产生过拟合问题,尤其是在处理复杂的数据集时。

决策树的不稳定性也使得它对数据的微小变化非常敏感。

2. 随机森林随机森林是一种集成学习方法,它由多棵决策树组成。

每棵树都是独立训练的,而且在选择划分节点时,随机森林会引入随机性,使得每棵树都有所不同。

最终的分类或回归结果是由多棵树的结果综合得到的。

随机森林相对于单棵决策树有很多优点。

它不容易过拟合,因为多棵树的结果会互相抵消。

同时,随机森林对于高维数据和大规模数据的处理能力也相对较好。

另外,随机森林对于缺失值的处理也很有效。

3. 比较在决策树和随机森林之间进行比较,可以得出以下结论:- 决策树相对简单,易于理解和解释,但容易过拟合;- 随机森林是一种集成学习方法,能够降低过拟合风险,对缺失值和大规模数据处理能力强。

因此,在实际应用中,可以根据数据集的复杂度和规模来选择合适的模型。

对于简单的问题,可以选择决策树;而对于复杂的问题,尤其是大规模数据集,随机森林可能是更好的选择。

4. 使用指南在使用决策树和随机森林模型时,有一些常见的注意事项需要考虑:- 数据预处理:对于决策树和随机森林模型来说,数据预处理是非常重要的。

包括缺失值处理、数据标准化、特征选择等步骤,都会对模型的性能产生影响。

- 超参数调优:在使用随机森林模型时,需要对一些超参数进行调优,例如树的数量、最大深度、最小叶子节点等。

决策树与随机森林的原理与应用

决策树与随机森林的原理与应用决策树和随机森林是机器学习领域中常见且强大的算法。

它们不仅在分类和回归问题上表现出色,还具有解释性强的优势。

本文将详细介绍决策树和随机森林的原理以及在实际应用中的一些案例。

一、决策树的原理决策树是一种基于树状结构进行决策的算法。

它通过对数据集进行递归划分,使得每个子集中的样本具有相同或者相似的特征,最终生成一个可解释的决策树模型。

1. 特征选择决策树的特征选择是通过计算每个特征的信息增益或者基尼指数来进行的。

信息增益衡量了在给定特征的条件下,划分前后的信息不确定性减少的程度;而基尼指数则可以度量一个子集中样本被错误分类的概率。

2. 决策树的生成决策树的生成是通过递归地选择最佳划分特征来进行的。

将数据集划分为足够纯净的子集,可以采用各种算法,如ID3、C4.5和CART算法。

这些算法根据特征选择的不同方法,生成了不同类型的决策树。

3. 决策树的剪枝为了避免决策树过拟合训练数据,需要进行剪枝操作。

剪枝是通过对生成的决策树进行修剪,移除一些不必要的节点,从而提高决策树的泛化能力。

二、随机森林的原理随机森林是一种基于集成学习的算法,它集成了多个决策树来进行分类和回归任务。

随机森林的核心思想是利用随机化的方式构建多个决策树,然后通过投票方式进行结果集成。

1. 随机特征选择在随机森林中,每个决策树的特征选择是随机进行的。

不同的决策树可能选取的特征不同,这样可以增加模型的多样性,提高整体性能。

2. 自助采样法随机森林使用自助采样法(Bootstrap Sampling)对原始数据集进行有放回的采样,生成多个不同训练集来构建多个决策树。

这样可以使得每个决策树的训练集略有差异,增加模型的多样性。

3. 随机森林的集成随机森林的集成是通过对多个决策树的结果进行投票或平均来得到最终的预测结果。

在分类问题中,采用投票的方式选择出现次数最多的类别;在回归问题中,采用平均的方式获得数值型的输出。

三、决策树和随机森林的应用决策树和随机森林在各个领域都有广泛的应用。

机器学习技术中的随机森林算法详解

机器学习技术中的随机森林算法详解随机森林(Random Forest)是一种强大的机器学习算法,它结合了决策树的思想和随机性的特点,用于解决分类和回归问题。

随机森林在实际应用中表现出色,广泛应用于数据挖掘、图像识别、金融预测等领域。

本文将详细介绍随机森林算法的原理和应用。

一、决策树和随机性在介绍随机森林之前,首先需要了解决策树的原理。

决策树是一种树状结构,其中每个内部节点表示一个特征或属性,每个叶节点表示一个类别。

通过一系列的特征选择和节点分割,决策树能够对样本进行分类或回归预测。

然而,单个决策树容易出现过拟合问题,即在训练集上表现出色,但在新样本上的泛化能力较差。

为了解决这个问题,引入了随机性的概念。

二、随机森林的原理随机森林算法通过构建多个决策树并取其结果的投票平均来达到准确预测的目的。

以下是随机森林算法的主要步骤:1. 随机森林的构建:(1)从原始数据集中用有放回抽样的方法随机选择n个样本,用于构建一个决策树。

(2)从m个特征中随机选择k个特征(通常情况下,k的值为sqrt(m)或log2(m)),作为该决策树的输入特征。

(3)重复上述两个步骤,构建多个决策树。

2. 随机森林的预测:对于分类问题,可采用投票法:将测试样本通过所有决策树,得到每个决策树的预测结果,再根据投票结果确定最终的类别。

对于回归问题,可采用平均法:将测试样本通过所有决策树,得到每个决策树的预测值,再将所有决策树的预测值取平均作为最终结果。

三、随机森林的优势1. 降低过拟合风险:通过随机选择特征和样本进行决策树构建,减小了过拟合的概率,提高了模型的泛化能力。

2. 处理大型数据集:随机森林算法的并行计算能力强,适用于大规模的数据集,能够有效提高训练速度。

3. 可解读性强:随机森林能够给出特征的重要性排序,通过分析决策树可以获得关于数据的见解。

四、随机森林的应用1. 特征选择:通过分析决策树中特征的重要性,可以选择对分类或回归有较大贡献的特征。

分级机的分类

分级机的分类分级机是一种常用于分类和预测的机器学习模型,它能够根据给定的特征对数据进行分组。

在本文中,我们将介绍几种常见的分级机分类算法,并对其原理和应用进行详细讨论。

一、决策树(Decision Tree)决策树是一种基于树状结构的分类算法,它通过一系列的决策规则对数据进行分类。

决策树的每个节点代表一个特征,每个分支代表一个特征的取值,而叶节点则代表一个类别。

决策树的构建过程是一个自顶向下的递归过程,通过选择最优的特征进行划分,直到满足停止条件为止。

决策树的优点是易于理解和解释,但容易过拟合。

二、随机森林(Random Forest)随机森林是一种基于决策树的集成学习方法,它通过构建多个决策树并对它们进行投票来进行分类。

随机森林的每个决策树都是基于不同的训练集和特征子集构建的,这样可以降低模型的方差和过拟合的风险。

随机森林的优点是能够处理高维数据和大规模数据集,但在处理少量数据时可能会过于复杂。

三、支持向量机(Support Vector Machine)支持向量机是一种二分类模型,它通过寻找一个最优的超平面来进行分类。

支持向量机的目标是找到一个最大化间隔的超平面,使得正负样本之间的距离最大化。

支持向量机的优点是泛化能力强,适用于高维空间和非线性问题,但在处理大规模数据集时计算复杂度较高。

四、朴素贝叶斯(Naive Bayes)朴素贝叶斯是一种基于贝叶斯定理和特征条件独立性假设的分类算法。

朴素贝叶斯的核心思想是通过计算样本在各个类别下的条件概率来进行分类。

朴素贝叶斯的优点是模型简单、计算效率高,但对于特征之间存在依赖关系的情况下表现较差。

五、K近邻(K-Nearest Neighbors)K近邻是一种基于实例的分类算法,它通过计算待分类样本与训练集中最近的K个样本的类别来进行分类。

K近邻的核心思想是相似的样本具有相似的类别。

K近邻的优点是简单易懂,对于样本分布复杂的情况下表现较好,但计算复杂度较高。

决策树与随机森林模型的比较与使用指南

在机器学习领域,决策树和随机森林都是常用的分类模型。

它们都是监督学习算法,用于解决分类和回归问题。

在本文中,我们将比较这两种模型,并提供它们的使用指南。

决策树是一种树形结构,它通过一系列的规则对数据进行分类或回归。

决策树的每个节点代表一个特征属性,每个分支代表这个特征属性的一个取值,而每个叶节点代表一种分类或回归结果。

决策树的优点是易于理解和解释,可以处理数字和分类数据。

然而,决策树也有一些限制。

它很容易过拟合,特别是在处理高维数据时。

而且,决策树对数据中的噪声非常敏感,可能导致不稳定的结果。

为了解决这些问题,随机森林模型应运而生。

随机森林是一种集成学习算法,它通过多个决策树对数据进行分类或回归。

随机森林的每棵树都是独立训练的,而且每棵树的输入数据也是随机选择的。

最后,通过取多个决策树的投票结果或平均值来得到最终的分类或回归结果。

随机森林的优点是在减少过拟合的同时提高了预测准确度,对于高维数据和大规模数据有很好的效果。

然而,随机森林也有一些缺点。

它在处理噪声数据时可能会导致不同的树之间产生差异,从而降低了模型的稳定性。

而且,随机森林模型的训练时间相对决策树来说更长。

在实际使用中,我们如何选择决策树和随机森林呢?以下是一些建议:首先,如果数据比较简单且干净,决策树可能是一个不错的选择。

决策树能够提供直观的决策过程,并且训练速度快。

其次,如果数据比较复杂且噪声较多,那么随机森林可能更适合。

随机森林通过组合多个决策树的结果,减少了过拟合的风险。

另外,如果模型的解释性很重要,那么决策树可能更合适。

决策树的决策过程很容易理解,可以帮助我们理解数据中的规律。

最后,如果我们需要预测新数据的分类或回归结果,而且需要较高的准确度,那么随机森林可能更适合。

随机森林通过集成多个模型的结果,通常能够得到比单个决策树更好的预测结果。

在使用决策树和随机森林时,我们还需要注意一些问题。

首先,要注意调参。

决策树和随机森林都有一些参数需要调整,比如树的深度、最小叶子节点数等。

机器学习中的决策树与随机森林算法

机器学习中的决策树与随机森林算法决策树和随机森林是常用的机器学习算法,特别适用于分类和回归问题。

决策树是一种基于树结构的预测模型,它通过将数据逐步分割成小的决策单元来实现预测。

而随机森林是由多个决策树组成的集成算法,通过投票机制来进行预测。

决策树算法的基本原理是将数据逐步分割成不纯度最小的子集。

在决策树算法中,我们需要选择一个合适的特征进行分割,以使得每个子集的纯度增加。

纯度可以通过不同的指标来衡量,比如基尼指数、信息增益、信息增益比等。

通过递归的方式构建决策树,直到达到终止条件,即数据集的纯度达到要求或者不再有合适的特征可以选择。

构建好的决策树可以通过遍历树的路径来进行预测,将样本沿着树进行分割,最终到达叶子节点并返回该节点对应的类别。

随机森林算法是通过将多个独立的决策树进行集成来提高预测性能。

随机森林的基本原理是通过有放回地对原始数据进行抽样来生成多个不同的数据集,然后分别使用这些数据集来构建独立的决策树。

在构建每个决策树时,我们会随机选择一定数量的特征进行分割。

这样可以保证每个决策树都是不同的,从而避免了过拟合的问题。

在预测时,随机森林算法采用投票机制来决定最终结果。

每个决策树都会对给定的样本进行预测,然后将所有决策树的预测结果进行统计,选择得票最多的类别作为最终的预测结果。

通过集成多个独立的决策树,随机森林能够有效地降低模型的方差,并提高模型的鲁棒性和泛化能力。

决策树和随机森林算法在机器学习中具有以下优点:1.算法易于理解和解释,可以可视化地展示决策过程。

2.可以处理离散型和连续型变量,对于缺失值和异常值也有一定的鲁棒性。

3.在处理高维数据时也能够表现出良好的性能,不需要进行特征规约。

4.对于非线性关系的建模能力较强。

5.在处理大规模数据集时也能够高效地进行计算,可以并行地构建独立的决策树。

然而,决策树和随机森林算法也存在一些缺点:1.决策树容易过拟合,特别是当树的深度较大时,容易产生过于复杂的模型。

决策树与随机森林模型的比较与使用指南(十)

决策树与随机森林模型的比较与使用指南一、简介数据挖掘和机器学习领域中,决策树和随机森林是两种常用的模型。

它们被广泛应用于分类和回归问题,具有易于理解和解释的特点。

本文将对这两种模型进行比较,并给出使用指南。

二、决策树模型决策树是一种树形结构的分类器,它通过一系列规则将数据集划分为不同的类别。

决策树的节点代表属性测试,边代表测试结果,叶子节点代表类别标签。

决策树的构建过程是一个递归的过程,根据数据集的特征选择最优的属性进行划分,直到满足停止条件为止。

决策树模型的优点在于易于理解和解释,可以处理数值型和类别型数据,对缺失值不敏感。

然而,决策树容易过拟合,泛化能力不强。

为了解决这个问题,人们提出了随机森林模型。

三、随机森林模型随机森林是一种集成学习方法,通过构建多棵决策树并将它们合并来提高模型的泛化能力。

随机森林的基本思想是通过随机选择特征和数据样本来构建多棵决策树,最后将它们进行投票或平均来得到最终的分类结果。

随机森林模型具有很好的泛化能力,并且对于高维数据和大规模数据有较好的处理能力。

它能够有效地减少过拟合的问题,不需要对数据进行特征缩放,对异常值不敏感。

四、决策树与随机森林的比较1.泛化能力:随机森林优于决策树。

随机森林通过集成多个决策树来减少过拟合的风险,因此具有更好的泛化能力。

2.适用场景:决策树适用于小型数据集,且数据特征明显的情况下。

而随机森林适用于大型高维数据集,能够处理复杂的分类和回归问题。

3.模型解释:决策树更容易理解和解释,而随机森林作为集成学习模型,其结果更难以直观解释。

5.使用指南在选择模型时,需要根据具体的问题和数据情况来决定。

对于小型数据集和简单问题,可以选择决策树模型。

而对于大型高维数据集和复杂问题,建议使用随机森林模型。

在实际使用时,需要注意调参和特征选择。

对于决策树模型,可以通过限制树的深度、最小叶子节点数等参数来避免过拟合。

而对于随机森林模型,可以通过调整树的数量、特征选择的随机性等参数来优化模型性能。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

– 期望错误率最小原则

• 思想:选择期望错误率最小的子树进行剪枝 • 对树中的内部节点计算其剪枝和不剪枝可能出现的期望错误率, 比较后加以取舍

决策树的用法

• 大数据集 (理想情况):

– 将数据集划分成3部分: GS, VS, TS – 根据GS生成一个树 – 根据VS进行后剪枝 – 在TS测试该树的准确率

Complexity

• 过拟合的原因:训练样本带噪声或不充分等

树的剪枝

• 剪枝原因和目的:解决决策树对训练样本的过拟 合问题 • 解决方法:剪枝(预剪枝,后剪枝)和树组合 • 后剪枝原则

– 最小描述长度原则(MDL)

• 思想:最简单的是最好的 • 做法:对Decision-Tree 进行二进位编码,编码所需二进位最 少的树即为“最佳剪枝树”

• 小数据集 (通常)

– 根据整个数据集生成一个树 – 用10折交叉验证进行后剪枝 – 用10折交叉验证测试树的准确率

分类器组合

• AdaBoosting(Adaptive Boosting)

– 对每个样本赋予一个权重,代表该样本被当前分类器 选入训练集的概率,并根据预测函数的输出与期望输 出的差异调整权重:如某个样本点已被正确分类,则 它的权重减小,否则,它的权重增大;通过这种方式, 使得学习算法能集中学习较难判别的样本。 – 经过T轮训练,得到T个分类函数 {f1,f2,…,fT}及对应的 权重{β1, β2,…, βT},最终的分类规则为加权投票法

信息增益——Information gain (ID3/C4.5) • 所有属性假设都是取离散值的字段(ID3) • 经过修改之后可以适用于连续值字段(C4.5) 基尼指数——Gini index (Classification and Regression Tress,CART,Breiman,1984) • 能够适用于离散和连续值字段

随机森林的特点

• 两个随机性的引入,使得随机森林不容易陷入过 拟合 • 两个随机性的引入,使得随机森林具有很好的抗 噪声能力 • 对数据集的适应能力强:既能处理离散型数据, 也能处理连续型数据,数据集无需规范化。 • 可生成一个Proximities=(pij)矩阵,用于度量样 本之间的相似性: pij=aij/N, aij表示样本i和j出现在 随机森林中同一个叶子结点的次数,N随机森林 中树的颗数。 • 可以得到变量重要性排序(两种:基于OOB误分 率的增加量和基于分裂时的GINI下降量)

信息增益

• 任意样本分类的期望信息:

– I(s1,s2,……,sm)=-∑Pi log2(pi) (i=1..m)

• 其中,数据集为S,m为S的分类数目, Pi≈|Si/|S| • Ci为某分类标号,Pi为任意样本属于Ci的概率, si为分类Ci上 的样本数

– I(s1,s2,……,sm)越小, s1,s2,……,sm就越有序(越纯), 分类效果就越好。

• 分裂属性选择规则:选择具有最大信息增益的属 分裂属性选择规则: 性为分裂属性

基尼指数

• 集合T包含N个类别的记录,那么其Gini指标就是 pj 类别j出现的频率 • 如果集合T分成m部分 N1 , N2 ,…, Nm 。那么这个 分割的Gini就是

gini split(T ) = N 1 gini( ) +L+ N m gini( ) T1 Tm N N

机器学习高手必读

• 决策树 • 随机森林 • 贝叶斯方法

随机森林

• 决策树 • 分类器组合 • 随机森林

决策树的定义

• 决策树是这样的一颗树:

– 每个内部节点上选用一个属性进行分割 – 每个分叉对应一个属性值 – 每个叶子结点代表一个分类

A1 a11 A2 c1 a21 c1 a22 c2 a31 c2 a32 c1 a13 a12 A3

n gini(T ) = 1− ∑ p 2 j j =1

• 分裂属性选择规则:选择具有最小Ginisplit的属性 分裂属性选择规则:选择具有最小 为分裂属性 (对于每个属性都要遍历所有可能的 分割方法).

过拟合

Error Underfitting Overfitting

Errorunseen

ErrorLS

随机森林

• • • • 随机森林定义 随机森林算法 随机森林的泛化误差 OOB(Out-Of-Bag)估计:泛化误差的一个 估计 • 随机森林的特点

随机森林的定义

• 随机森林是一个树型分类器{h(x,βk),k=1,…} 的集合。其中元分类器h(x,βk)是用CART算 法构建的没有剪枝的分类回归树;x是输入 向量;βk是独立同分布的随机向量,决定了 单颗树的生长过程;森林的输出采用简单 多数投票法(针对分类)或单颗树输出结 果的简单平均(针对回归)得到。

随机森林分类性能的主要因素

• 森林中单颗树的分类强度(Strength):每 颗树的分类强度越大,则随机森林的分类 性能越好。 • 森林中树之间的相关度(Correlation):树 之间的相关度越大,则随机森林的分类性 能越差。

OOB估计

• 计算1(以树为单位):对每颗树,利用未被该树 选中的训练样本点,统计该树的误分率;将所有 树的误分率取平均得到随机森林的OOB误分率 • 计算2(以样本为单位):对每个样本,计算它作 为OOB样本的树对它的分类情况(约1/3的树); 然后以简单多数投票作为该样本的分类结果;最 后用误分个数占样本总数的比率作为随机森林的 OOB误分率 • OOB误分率是随机森林的泛化误差的一个无偏估 计 • OOB估计是高效的,其结果近似于需要大量计算 的k折交叉验证。

随机森林算法

• 随机选取训练样本集:使用Bagging方法形 成每颗树的训练集 • 随机选取分裂属性集:假设共有M个属性, 指定一个属性数F≤M,在每个内部结点, 从M个属性中随机抽取F个属性作分裂属性 集,以这F个属性上最好的分裂方式对结点 进行分裂(在整个森林的生长过程中, F的 值一般维持不变) • 每颗树任其生长,不进行剪枝

• 由属性A划分为子集的熵:

– A为属性,具有V个不同的取值, S被A 划分为V 个子 集s1,s2,……,sv,sij是子集sj中类Ci的样本数。 – E(A)= ∑(s1j+ ……+smj)/s * I(s1j,……,smj) – 信息增益:Gain(A)= I(s1,s2,……,sm) - E(A)

主要参考文献

1. J.R. Quinlan. Induction of Decision Trees[J].Machine learning 1986,1:81-106. 2. S.L. Salzberg.Book Review:C4.5 Programs for Machine Learning by J.Ross Quinlan[J]. Machine Learning,1994,3:235-240. 3. L.Breiman, J.Friedman,al.et. Classification and Regression Trees[M]. New York: Chapman & Hall,1984. 4. L.Breiman. Random Forests[J].Machine Learning,2001,45(1):5-32. 5. /users/breiman/ra ndomforests

决策树框架

• 决策树生成算法分成两个步骤

– 树的生成

• 开始,数据都在根节点 • 递归的进行数据分片

– 树的剪枝

• 防止过拟合

• 决策树使用: 对未知数据进行分割

– 按照决策树上采用的分割属性逐层往下,直到 一个叶子节点

决策树续2—分裂属性的选择度量

原则:分类效果最好的(或分类最纯的, 或能使树的路径最短)的属性 常用度量

• Bagging(Breiman,1996)

– 在训练的每一轮中,均从原始样本集S中有放回地随机 抽取训练样本集T(T的样本个数同S),这样一个初始 样本在某轮训练中可能出现多次或根本不出现( S中每 个样本未被抽取的概率为(1-1/|S|)|S|≈0.368,当|S|很大 时)。 – 最终的分类规则为简单多数投票法或简单平均法

AdaBoosting和Bagging的比较

• Adaboosting的训练集选取与前面各轮的学 习结果相关;而Bagging训练集的选取是随 机的,各轮训练集之间相互独立。 • Adaboosting的每个分量分类器有权重,而 Bagging的没有权重。 • Adaboosting的每个分量分类器只能循序生 成,而Bagging可以并行生成。