立体匹配十大概念综述

立体匹配的原理

立体匹配的原理

立体匹配是一种计算机视觉技术,它可以用来识别和定位物体的三维形状。

它的基本原理是,通过比较两个图像中的特征点,来确定它们之间的相对位置和距离。

立体匹配的基本步骤是:首先,使用特征检测算法,从图像中检测出特征点;其次,使用特征描述算法,为每个特征点提取出一组特征描述符;然后,使用特征匹配算法,将两幅图像中的特征点进行匹配;最后,使用三角测量算法,计算出两个图像之间的相对位置和距离。

立体匹配技术可以用来实现计算机视觉的多种应用,如机器人定位、机器视觉检测、三维重建等。

它可以帮助机器人更准确地定位物体,也可以帮助机器视觉系统更准确地检测物体,从而提高机器视觉系统的准确性和可靠性。

此外,立体匹配技术还可以用来实现三维重建,从而获得物体的三维模型,从而更好地理解物体的形状和结构。

总之,立体匹配是一种有效的计算机视觉技术,它可以用来实现机器人定位、机器视觉检测和三维重建等多种应用,从而提高机器视觉系统的准确性和可靠性。

基于深度学习的立体匹配算法研究

基于深度学习的立体匹配算法研究随着现代科技的不断进步,深度学习在计算机视觉领域发挥着越来越重要的作用。

其中,在立体匹配算法的研究中,深度学习的应用已经得到了广泛的认可和应用。

本文将着重探讨基于深度学习的立体匹配算法研究。

一、立体匹配算法概述立体匹配算法是指通过对两幅具有一定视角差异的图像进行比较,以获取三维立体信息的一种算法。

其中,匹配是立体重建和视觉跟踪的核心技术之一。

立体匹配算法从原理上可以分为基于局部和全局两种方法。

其中,基于局部的匹配可以快速地获得立体信息,但是对于复杂的场景表达能力有限;基于全局的匹配可以获得更好的匹配结果,但是执行效率较低。

因此,为了更好地平衡算法的效率和精度,立体匹配算法在发展中不断探索着新的方法和策略。

其中,基于深度学习的立体匹配算法的应用正成为发展的趋势。

二、基于深度学习的立体匹配算法原理基于深度学习的立体匹配算法主要使用卷积神经网络(Convolutional Neural Network,CNN)作为核心模型,通过训练得到二者视差差异下的匹配结果。

其中,CNN模型能够通过局部和全局特征学习获得场景的高维度特征,从而实现立体匹配结果的生成。

在具体实现中,基于深度学习的立体匹配算法需要针对不同的问题选择不同的模型。

例如,对于低纹理或重复纹理的场景,深度学习模型可以通过引入弱监督机制来提高算法的性能;对于复杂的场景,则需要设计多级网络结构来提高算法的表达能力。

此外,基于深度学习的立体匹配算法还需要对数据进行预处理和增强,例如对图像进行去噪、颜色平衡和几何变换等操作,从而提高算法的稳定性和鲁棒性。

三、基于深度学习的立体匹配算法应用与研究进展目前,基于深度学习的立体匹配算法已经成为立体匹配研究的热点。

其中,一些最新的研究进展已经取得了很好的效果。

例如,一些研究者使用基于深度学习的方法,大大提高了立体匹配算法的识别准确率,以及执行效率。

同时还有一些研究探索了结合多源数据的联合学习方案,从而在不同场景下对立体匹配结果进行优化和融合。

基于深度学习的双目立体匹配方法综述

基于深度学习的双目立体匹配方法综述

尹晨阳;职恒辉;李慧斌

【期刊名称】《计算机工程》

【年(卷),期】2022(48)10

【摘要】双目立体匹配是计算机视觉领域的经典问题,在自动驾驶、遥感、机器人感知等诸多任务中得到广泛应用。

双目立体匹配的主要目标是寻找双目图像对中同名点的对应关系,并利用三角测量原理恢复图像深度信息。

近年来,基于深度学习的立体匹配方法在匹配精度和匹配效率上均取得了远超传统方法的性能表现。

将现有基于深度学习的立体匹配方法分为非端到端方法和端到端方法。

基于深度学习的非端到端方法利用深度神经网络取代传统立体匹配方法中的某一步骤,根据被取代步骤的不同,该类方法被分为基于代价计算网络、基于代价聚合网络和基于视差优化网络的3类方法。

基于深度学习的端到端方法根据代价体维度的不同可分为基于3D代价体和基于4D代价体的方法。

从匹配精度、时间复杂度、应用场景等多个角度对非端到端和端到端方法中的代表性成果进行分析,并归纳各类方法的优点以及存在的局限性。

在此基础上,总结基于深度学习的立体匹配方法当前面临的主要挑战并展望该领域未来的研究方向。

【总页数】12页(P1-12)

【作者】尹晨阳;职恒辉;李慧斌

【作者单位】西安交通大学数学与统计学院

【正文语种】中文

【中图分类】TP391

【相关文献】

1.基于粗-精立体匹配的双目视觉目标定位方法

2.基于OpenCV的双目立体匹配方法

3.基于超像素分割的孪生网络双目立体匹配方法研究

4.基于双目视觉的改进特征立体匹配方法

5.基于多尺度聚合神经网络的双目视觉立体匹配方法

因版权原因,仅展示原文概要,查看原文内容请购买。

3D视觉中的立体匹配算法研究与改进

3D视觉中的立体匹配算法研究与改进在3D视觉领域中,立体匹配算法是一项重要的技术,用于处理立体图像的深度信息。

立体匹配算法旨在通过对图像中的对应点进行匹配,确定它们之间的距离,从而重构场景的三维结构。

本文将对3D视觉中的立体匹配算法进行研究与改进。

一、立体匹配算法的基本原理立体匹配算法的基本原理是通过比较左右两幅立体图像的像素信息,找到它们之间的对应点,并计算出距离或深度信息。

常用的立体匹配算法包括视差法、基于特征的立体匹配、图割算法等。

视差法是最传统的立体匹配算法之一。

它通过比较左右图像中像素的灰度值差异来确定对应点的视差值,再通过一定的几何关系计算出深度信息。

视差法简单易实现,但对于纹理丰富、边缘模糊等情况下的图像匹配效果不佳。

基于特征的立体匹配算法利用图像中的特征点(如角点、边缘等)进行匹配,以获得更准确的结果。

该算法通常包括特征提取、特征匹配和深度计算等步骤。

特征点的选择和匹配精度对立体匹配结果的准确性有着重要影响。

图割算法是一种基于图论的立体匹配算法,它将立体匹配问题转化为图割问题。

通过构建能量函数,利用图割算法来计算最小代价的匹配结果。

图割算法具有较高的准确性和鲁棒性,但计算复杂度较高,不适用于实时系统。

二、立体匹配算法的常见问题在实际应用中,立体匹配算法仍然存在一些问题,限制了其性能和应用范围。

主要问题包括视差失真、运动物体处理、低纹理区域匹配等。

视差失真是指由于视角变化或透视变换等原因导致匹配误差增大。

特别是在远处或大角度情况下,视差估计会出现积累误差,使得深度信息不准确。

解决视差失真问题的方法包括视角校正、立体图像重建等。

运动物体处理是指当场景中存在运动物体时,立体匹配算法难以准确地匹配对应点。

运动物体造成图像中的对应点轻微偏移,导致匹配错误。

针对这个问题,可以采用背景建模、光流估计等方法来提高立体匹配的稳定性。

低纹理区域匹配是立体匹配中的一个挑战性问题。

在低纹理区域,图像中的对应点很少或没有,难以准确匹配。

立体视觉中的立体匹配技术研究与应用的开题报告

立体视觉中的立体匹配技术研究与应用的开题报告一、选题意义随着立体显示技术的不断发展,立体视觉的应用范围越来越广泛,涉及到图像、视频处理、医疗、军事、工业等多个领域。

其中,立体匹配技术是实现立体视觉的核心技术之一,在三维重建、深度检测、目标跟踪等方面都有着广泛的应用。

因此,研究立体匹配技术的理论模型、方法和应用具有重要的科学意义和实际价值。

二、研究内容本研究旨在探讨基于区域分割的立体匹配技术的理论模型、方法和应用。

具体研究内容包括以下几个方面:1. 立体匹配技术的基本概念和原理,包括视差、视差图、视差匹配、立体匹配算法等。

2. 基于区域分割的立体匹配技术的理论模型和方法,该方法分为分块匹配、窗口匹配、全局匹配等多个部分,其中分块匹配是最基本的算法,窗口匹配和全局匹配是对分块匹配的改进,能够获得更准确的匹配结果。

3. 立体匹配技术的应用,包括图像重建、深度检测、目标跟踪等。

其中,图像重建是利用立体匹配技术从双目图像中恢复三维模型,深度检测是检测物体在场景中的深度,目标跟踪是在目标运动过程中保持对目标的跟踪。

三、研究方法本研究采用文献调研和理论分析相结合的方法,首先对立体匹配技术的基本概念和原理进行归纳总结,然后对基于区域分割的立体匹配技术的理论模型和方法进行深入探讨,最后对立体匹配技术在图像重建、深度检测、目标跟踪等方面的应用进行综述和分析。

四、预期成果本研究预期达成以下几个成果:1. 归纳总结立体匹配技术的基本概念和原理,形成完整的理论框架。

2. 探讨基于区域分割的立体匹配技术的理论模型和方法,分析其优缺点和适用范围。

3. 综述立体匹配技术在图像重建、深度检测、目标跟踪等方面的应用,并对其未来发展趋势进行展望。

五、研究计划本研究拟按照以下计划进行:1. 第一阶段(1个月):阅读相关文献,总结立体匹配技术的基本概念和原理。

2. 第二阶段(2个月):探讨基于区域分割的立体匹配技术的理论模型和方法。

3. 第三阶段(2个月):综述立体匹配技术在图像重建、深度检测、目标跟踪等方面的应用。

立体匹配十大概念综述

立体匹配十大概念综述一、概念立体匹配算法主要是通过建立一个能量代价函数,通过此能量代价函数最小化来估计像素点视差值。

立体匹配算法的实质就是一个最优化求解问题,通过建立合理的能量函数,增加一些约束,采用最优化理论的方法进行方程求解,这也是所有的病态问题求解方法。

二、主要立体匹配算法分类1)根据采用图像表示的基元不同,立体匹配算法分为:A、区域立体匹配算法(可获取稠密视差图。

缺点:受图像的仿射畸变和辐射畸变影响较大;像素点约束窗口的大小与形状选择比较困难,选择过大,在深度不连续处,视差图中会出现过度平滑现象;选择过小,对像素点的约束比较少,图像信息没有得到充分利用,容易产生误匹配。

)B、基于特征的立体匹配算法(可获得稀疏的视差图,经差值估计可获得稠密视差图。

可提取点、线、面等局部特征,也可提取多边形和图像结构等全局特征。

缺点:特征提取易受遮挡、光线、重复纹理等影响较大;差值估计计算量大)C、基于相位立体匹配算法(假定在图像对应点中,其频率范围内,其局部相位是相等的,在频率范围内进行视差估计)2)依据采用最优化理论方法的不同,立体匹配算法可以分为:A、局部的立体匹配算法B、全局的立体匹配算法三、匹配基元(match primitive)目前匹配算法中所采用的匹配基元可以分成两大类:1)在所有图象像素点上抽取量测描述子A、像素灰度值(最简单、直接,但必须在同一光照条件下获得)B、局部区域灰度函数(主要是利用求得在各种大小不同窗口中灰度分布的导数信息,描述像素点周围的结构矢量。

)C、卷积图象符号(利用各种大小算子与图象进行卷积,用灰度梯度局部极大值或极小值作为特征信息,描述整个图像)2)图像特征A、过零点B、边缘(由于边缘是图像特征位置的标志,对灰度值的变化不敏感,边缘是图像匹配的重要特征和描述子)C、角点(虽然其没有明确的数学定义,但大家普遍认为角点,即二维图像亮度变化剧烈的点或边缘曲线上曲率极值点)四、区域匹配算法基本原理是给定在一幅图像上的某一点,选取该像素点邻域内的一个子窗口,在另一幅图像中的一个区域内,根据某种相似性判断依据,寻找与子窗口图像最为相似的子图,而其匹配的子图中对应的像素点就为该像素的匹配点。

计算机视觉中的立体匹配算法研究

计算机视觉中的立体匹配算法研究一、引言计算机视觉是近年来发展迅速的一个领域,其中立体匹配算法是其中一个重要的研究方向。

立体匹配算法是指通过两张在不同视角下的图像,基于这两张图像之间的差异来计算得到物体的深度信息,从而达到对物体进行三维重建的目的。

二、立体匹配的基础原理立体匹配算法的基础原理是通过两幅不同角度下得到的图像中,对应点的像素位置之间的差异来计算出每个像素点的视差,并进而推算出物体的深度信息。

对于一组立体图像,在处理之前需要进行预处理,包括图像去噪、灰度化和边缘检测等,以便于得到更加精确的匹配结果。

然后,在经过预处理之后,可以通过三种不同的方式进行匹配:基于特征点的匹配、基于区域的匹配和深度神经网络。

1.基于特征点的匹配基于特征点的匹配是指通过对图像进行特征提取,然后通过对特征点进行匹配来计算像素点的视差。

这一方法的主要优点是速度比较快,但是对于复杂的场景下,匹配误差较大,容易出现匹配失败的情况。

2.基于区域的匹配基于区域的匹配是指通过对图像进行分块,然后在每个块内进行匹配来计算像素点的视差。

对于复杂的场景,此方法可以得到更加精确的匹配结果。

但是,对于复杂的场景,该方法的计算量比较大,处理速度比较慢。

3.深度神经网络近年来,深度神经网络的发展为立体匹配的处理提供了新的思路。

基于深度神经网络的方法可以通过学习大量的图像,从而获得更加精确的匹配结果。

同时,由于神经网络是可以并行计算的,因此处理速度较快。

三、算法的比较和优缺点分析针对不同的应用场景,可以选择不同的立体匹配算法来进行处理。

通过对三种不同的立体匹配算法的比较和分析,可以得到以下的结论:1.基于特征点的匹配方法可以在处理速度和精度之间取得平衡,但是对于复杂的场景下,容易出现匹配错误的情况。

2.基于区域的匹配方法可以得到更加精确的匹配结果,但是对于复杂的场景,计算量比较大。

3.基于深度神经网络的方法可以通过学习大量的图像,得到更加精确的匹配结果。

《2024年立体匹配与点云重建关键技术的研究》范文

《立体匹配与点云重建关键技术的研究》篇一一、引言随着计算机视觉和三维测量技术的飞速发展,立体匹配与点云重建技术已成为三维重建领域中的关键技术。

立体匹配是获取物体三维信息的重要手段,而点云重建则是将立体匹配得到的数据进行整合、处理,最终生成三维模型的过程。

本文将重点研究立体匹配与点云重建的关键技术,并探讨其应用前景。

二、立体匹配技术研究立体匹配是利用两幅或多幅从不同视角拍摄的图像,通过算法提取出相应的特征点,并计算这些特征点在空间中的位置信息,从而得到物体的三维结构信息。

其关键技术包括特征提取、特征匹配和视差估计。

1. 特征提取特征提取是立体匹配的基础,其目的是从图像中提取出具有代表性的特征点。

常见的特征点包括角点、边缘点、区域等。

提取出的特征点应具有较好的区分性和稳定性,以便于后续的匹配和视差估计。

目前,常用的特征提取方法包括SIFT、SURF、ORB等。

2. 特征匹配特征匹配是将提取出的特征点进行匹配的过程。

由于两幅图像之间存在视角差异、光照变化、噪声干扰等因素,因此需要采用一定的算法进行特征点的匹配。

常见的特征匹配方法包括基于区域的匹配、基于特征的匹配和基于模型的匹配等。

其中,基于特征的匹配方法具有较高的准确性和鲁棒性。

3. 视差估计视差估计是立体匹配的核心步骤,其目的是根据匹配的特征点计算视差图。

视差图反映了物体在不同视角下的位置信息,是三维重建的重要依据。

常见的视差估计方法包括块匹配算法、区域生长算法、基于全局优化的方法等。

其中,基于全局优化的方法具有较高的准确性和鲁棒性。

三、点云重建技术研究点云重建是将立体匹配得到的视差图进行整合、处理,生成三维模型的过程。

其关键技术包括数据预处理、曲面重建和纹理映射。

1. 数据预处理数据预处理是对原始点云数据进行去噪、补全、平滑等处理的过程。

由于在实际测量过程中,可能会受到噪声、遮挡等因素的影响,导致获取的点云数据存在缺失、错误等问题。

因此,需要进行数据预处理以提高点云数据的精度和完整性。

高精度立体匹配的快速算法及其应用

高精度立体匹配的快速算法及其应用随着科技的不断进步和发展,计算机视觉技术越来越成熟,应用场景也越来越广泛。

其中,立体匹配技术在计算机视觉领域扮演着非常重要的角色。

立体匹配技术是指通过计算机分析图像中特定物体在左右两眼视野中的视差,进而还原出该物体在三维空间中的位置和形状。

而高精度立体匹配则是指对立体匹配算法的一种改进,旨在提高匹配精度和匹配速度。

本文将会深入探讨高精度立体匹配的快速算法及其应用。

一、高精度立体匹配的概念及意义在计算机视觉领域中,高精度立体匹配是指通过多种复杂算法实现对立体匹配技术的改进,旨在提高匹配结果的准确性和可靠性。

高精度立体匹配技术的出现,不仅使得计算机视觉应用范围更加广泛,而且也对各行各业的信息化建设起到了很大推动作用。

高精度立体匹配的意义主要表现在以下几个方面:1. 提高计算机视觉的应用效果立体匹配技术广泛应用于计算机视觉领域中的三维建模、虚拟现实、机器人视觉、安防监控等众多应用场景。

通过高精度立体匹配技术的改进,可以提高计算机对物体的识别和还原能力,进而提高计算机视觉应用的效果。

2. 降低应用成本相对于传统的立体匹配技术,高精度立体匹配技术更加准确、稳定和快速,可以大大降低应用成本。

同时,高精度立体匹配技术还通过对图像中特征点的提取和优化,能够提高图像压缩比率,从而更加节约存储空间和带宽资源。

3. 推动科学技术发展重建等。

这些领域的持续发展,不仅可以促进社会经济发展,还可以推动科学技术的发展和进步,使人类社会更为智能化和便捷化。

二、高精度立体匹配的算法及其优缺点尽管高精度立体匹配技术已经得到了广泛应用,但是其算法的研究仍然是一个热点领域。

目前,多种高精度立体匹配算法被提出,例如基于灰度信息的算法、基于特征点的算法、基于全局优化的算法等。

这里将重点介绍一下高精度立体匹配算法的特点和优缺点。

1. 基于灰度信息的算法基于灰度信息的算法是立体匹配算法中的一种经典方式。

该算法通过分析图像中特定物体在两张图像中的灰度特性(例如亮度、对比度等),进而计算出该物体在三维空间中的位置和形状。

立体匹配方法

立体匹配方法

立体匹配方法是计算机视觉中常用的一种技术,用于将多张图像中对应的像素点进行匹配,从而得到物体的三维模型。

在匹配的过程中,需要考虑到图像间的视差以及图像中的噪声等因素,因此需要采用一定的算法来解决这些问题。

目前常用的立体匹配方法包括基于区域的方法、基于特征点的方法和基于深度学习的方法。

其中,基于区域的方法主要通过计算图像中的灰度值和梯度等信息来匹配对应的像素点,但是这种方法容易受到图像中的纹理和光照等因素的影响。

基于特征点的方法则是通过提取图像中的关键点,如角点和边缘点等,来进行匹配。

但是这种方法可能会忽略图像中其他重要的信息,如纹理和颜色等。

近年来,随着深度学习技术的发展,基于深度学习的立体匹配方法也得到了广泛的应用。

这种方法通过训练神经网络来实现像素点的匹配,可以有效地解决图像中的噪声和复杂纹理等问题。

总之,立体匹配方法是计算机视觉中重要的一种技术,不仅可以用于三维重建和物体识别等领域,也可以在机器人导航和自动驾驶等领域中发挥重要作用。

- 1 -。

立体匹配算法的研究和应用

立体匹配算法的研究和应用一、本文概述立体匹配算法是计算机视觉领域中的一个重要研究方向,它旨在从两个或多个不同视角的图像中恢复出场景的深度信息。

这一技术在三维重建、机器人导航、自动驾驶、虚拟现实和增强现实等领域有着广泛的应用前景。

本文将对立体匹配算法的研究现状、基本原理、常见算法以及实际应用进行深入探讨。

本文将概述立体匹配算法的发展历程和研究现状,介绍其在计算机视觉领域的重要性以及面临的挑战。

接着,文章将详细阐述立体匹配算法的基本原理,包括立体视觉的基本原理、图像预处理、特征提取与匹配、视差计算与优化等关键步骤。

在此基础上,本文将重点介绍几种经典的立体匹配算法,如基于全局能量最小化的算法、基于局部窗口的算法、基于特征的算法等,并分析它们的优缺点和适用范围。

文章还将关注近年来兴起的深度学习在立体匹配领域的应用,探讨其带来的性能提升和创新点。

本文将讨论立体匹配算法在实际应用中的案例,如三维重建、机器人导航、自动驾驶等,并分析其在实际应用中的挑战和未来的发展趋势。

通过本文的综述,读者可以对立体匹配算法有一个全面而深入的了解,为相关研究和应用提供有益的参考。

二、立体匹配算法的基本理论立体匹配算法是计算机视觉领域的重要研究方向,旨在从两幅或多幅不同视角的图像中恢复出场景的三维信息。

其基本理论涉及图像处理、模式识别、计算机视觉等多个学科,是机器视觉领域的核心技术之一。

立体匹配算法的核心是寻找图像对之间的对应点,即立体匹配点。

这些点在左右两幅图像中应具有相同的空间位置,但在像素坐标上存在差异,这种差异被称为视差。

通过计算这些视差值,我们可以得到场景的深度信息。

立体匹配算法的基本流程包括预处理、特征提取、匹配代价计算、视差计算和后处理等步骤。

预处理主要是对原始图像进行滤波、增强等操作,以提高图像质量。

特征提取则是从图像中提取用于匹配的特征信息,如角点、边缘等。

匹配代价计算是根据提取的特征,计算不同像素点之间的匹配代价,即相似度度量。

双目立体视觉匹配技术综述

双目立体视觉匹配技术综述

曹之乐;严中红;王洪

【期刊名称】《重庆理工大学学报(自然科学版)》

【年(卷),期】2015(029)002

【摘要】立体视觉匹配技术是立体视觉研究的核心问题.立体匹配方法在不同的应用领域有着不同的应对策略.介绍了双目视觉立体匹配技术的原理和一些研究关键点.通过总结现有各种算法的优缺点,对基于区域的立体匹配算法和基于全局的立体匹配算法进行了深入论述和研究,最后对立体匹配算法的未来发展做了展望.对研究者选择立体匹配算法有一定参考意义.

【总页数】6页(P70-75)

【作者】曹之乐;严中红;王洪

【作者单位】重庆理工大学药学与生物工程学院,重庆400054;重庆理工大学药学与生物工程学院,重庆400054;重庆理工大学药学与生物工程学院,重庆400054【正文语种】中文

【中图分类】TP39

【相关文献】

1.双目立体视觉匹配技术现状与发展 [J], 张煦;朱振宇;张合富

2.双目立体视觉匹配技术综述 [J], 曹之乐;严中红;王洪;

3.双目立体视觉的障碍物检测方法综述 [J], 曾日金;袁华

4.立体视觉中的立体匹配技术研究的现状与展望综述 [J], 侯小丽

5.基于双目视觉立体匹配技术的双目测距研究 [J], 李明东;卢彪;金传宇

因版权原因,仅展示原文概要,查看原文内容请购买。

立体匹配技术浅析

立体匹配算法简介

立体匹配算法分类——基于全局约束算法

基于全局约束算法利用对应扫描线或整个图像数据信息进行计算,着重解决 图像中不确定区域的匹配问题,能到达全局最优解. 全局最优算法的本质是将 对应点的匹配问题转化为寻找某一能量函数的全局最优问题,通常跳过代价 聚合步骤,直接计算视差值. 这类算法的核心环节包括:1) 能量函数构造方 法;2) 能量函数优化求解策略. 4) 其他全局算法:A协作算法的灵感源于人类视觉计算模型,其所用的非线 性迭代操作在整体行为上类似于全局算法.B非线性扩散算法的研究热点集 中在提高遮挡问题的处理性能上.C置信度传播算法,此算法能得到全局算 法的精度和局部算法的效率.

立体视觉的基本原理

立体视觉系统的组成

(5)深度确定

根据立体匹配的结果,计算出图像对应点的视差值,然 后根据视差值得到图像的深度信息。

(6)三维重建

立体视觉的最终目的是为了恢复景物可视表面的完整信 息 ,即三维重建。

立体匹配算法简介

立体匹配

立体匹配一直是三维场景结构信息获取的研究热 点之一,其基本原理是从两个视点观察同一景物以 获取立体像对,匹配出相应像点,从而计算出视差 并获得三维信息. 20 世纪80 年代,美国麻省理工 学院的Marr 提出了一种视觉计算理论并应用在双 目匹配上,使两张有视差的平面图产生具有深度的 立体图形,从而奠定了立体视觉发展的理论基础。

立体匹配算法简介

立体匹配算法分类——基于局部约束算法

基于局部约束算法利用兴趣点周围的局部信息进行计算,涉及信息量较少,相 应的计算复杂度较低, 但其对噪声较敏感,对无纹理区域、视差不连续区域和 遮挡区域匹配效果不理想。 3) 相位匹配算法:基于傅立叶平移定理的相位匹配算法的本质,是对带通 滤波后的时/ 空2频域定位性的基元信号相位信息进行处理而得到像对间的 视差。究其本质,相位匹配就是寻找局部相位相等的对应点。

立体匹配算法研究综述

立体匹配算法研究综述曾文献;郭兆坤【摘要】Stereo matching algorithm ,as the core content of binocular stereo vision ,is a tech‐nique that obtains parallax and obtains corresponding depth information by matching two or moreimages .Through the research and analysis of stereo matching algorithms at home and abroad ,the stereo matching algorithm aresummarized ,elaborated global stereo matching algo‐rithm and local stereo matching algorithm ,finally summarizes the stereo matching algorithms challenges and prospects for stereo matching algorithms .%立体匹配算法作为双目立体视觉的核心内容,是通过匹配两幅或者多幅图像获得视差并得到相应深度信息的技术.本文通过对国内外立体匹配算法的研究与分析,对立体匹配算法进行了综述,详细阐述了全局立体匹配算法和局部立体匹配算法,最后总结了当前立体匹配算法面临的挑战以及对立体匹配算法的展望.【期刊名称】《河北省科学院学报》【年(卷),期】2018(035)002【总页数】6页(P43-48)【关键词】立体匹配;全局立体匹配;局部立体匹配【作者】曾文献;郭兆坤【作者单位】河北经贸大学,河北石家庄 050061;河北经贸大学,河北石家庄050061【正文语种】中文【中图分类】TP391.40 前言双目立体视觉通过模仿人类视觉原理来获取丰富的三维立体数据,尤其是深度信息。

立体匹配

引言本文回顾在双眼视觉系统在过去25年领域的经验和理论的重大发展。

我们限制我们的调查主要是对人体的立体感,双目对比总结与讨论,其中有关单单位神经生理学和人类大脑成像。

我们有刺激的重要工作,确定几个关键争议这些问题。

在立体视觉的情况下,这些争议包括在双眼的深度和表面的位置显示校验编码与相位,空间尺度上的差距限制的依赖,闭塞的作用的看法,并在3D的议案。

在双眼竞争的情况下,争议,包括眼睛对刺激RIV-alry竞争动态,“自上而下”的影响作用,双眼竞争的相互作用。

关于双眼的对比总结,文章侧重于两个代表车型突出在这一研究领域的不断变化的复杂性。

1。

介绍25周年发行的视觉研究包括两个散文覆盖双眼视力,两者投入几乎完全立体感。

主教和佩蒂格鲁(1986)提供了一个生动的领导到后发现显示校验选择性神经元在猫和猴(1佐贺事件若以OGY其中既有作者是中央的球员)。

贝拉Julesz(1986)对待读者到第一手的发展和完善的帐户随机点立体图(RDS)和从发现的IES的影响,使用立体的破土探头。

julesz的文章还简要评论的立体感和之间的关系双眼竞争。

如何景观描绘在这两个改变散文因为他们写在25年?回答这个问题是我们的挑战,在这50周年征文双眼视。

和挑战将是:双眼视领域一直显着活跃在过去25年,但页面限制排除高分辨率图像的景观的变化。

相反,我们必须提供一个低分辨率的概述,突出一些(但当然不是全部)的显着发现和重要理论的进步。

对于那些寻求更详细的说明发现和进步,也有一些优秀的书籍,CHAP-TERS和评语,填写在这篇文章中丢失的细节,我们在有关章节中,将列出这些来源。

唉,有一些议题,我们不会触及,即使他们双眼视域范围之内。

这些包括知觉视觉方向(Erkelens及面包车去研磨,1994年),辐辏眼运动(麦克斯韦Schor,2006年)和临床疾病双眼视(斯坦曼,斯汀曼和Garzia,2000)。

幸运的是,双眼视力有一个全面的调查,公布霍华德和罗杰斯(2002),广博的书提供所有主题深入概述下跌的标题下的双眼双眼视力严重视力;学生应考虑拥有本重要的书。

立体匹配算法

⽴体匹配算法转载请注明出处:⽴体匹配算法最新动态:相关⽂献:介绍⽴体匹配的基本原理:⽴体匹配综述性⽂章:⽴体匹配算法的基本⽬标:找出图像的每个像素点在另⼀个视⾓的图像上对应的像素点,算出视差图像,估算出景深图像。

最简单的SAD块匹配算法//Stereo Match By SAD#include <opencv2/opencv.hpp>#include <vector>#include <algorithm>#include <iostream>#include <windows.h>#include <string>using namespace std;using namespace cv;DWORD t1;DWORD t2;void timebegin(){t1 = GetTickCount();}void timeend(string str){t2 = GetTickCount();cout << str << " is "<< (t2 - t1)/1000 << "s" << endl;}float sadvalue(const Mat &src1, const Mat &src2){Mat matdiff = cv::abs(src1 -src2);int saddiff = cv::sum(matdiff)[0];return saddiff;}float GetMinSadIndex(std::vector<float> &sad){float minsad = sad[0];int index = 0;int len = sad.size();for (int i = 1; i < len; ++i){if (sad[i] < minsad){minsad = sad[i];index = i;}}return index;}void MatDataNormal(const Mat &src, Mat &dst){normalize(src, dst, 255, 0, NORM_MINMAX );dst.convertTo(dst, CV_8UC1);}void GetPointDepthRight(Mat &disparity, const Mat &leftimg, const Mat &rightimg,const int MaxDisparity, const int winsize){int row = leftimg.rows;int col = leftimg.cols;if (leftimg.channels() == 3 && rightimg.channels() == 3){cvtColor(leftimg, leftimg, CV_BGR2GRAY);cvtColor(rightimg, rightimg, CV_BGR2GRAY);}//Mat disparity = Mat ::zeros(row,col, CV_32S);int w = winsize;int rowrange = row - w;int colrange = col - w - MaxDisparity;for (int i = w; i < rowrange; ++i){int *ptr = disparity.ptr<int>(i);for (int j = w; j < colrange; ++j){//Rect rightrect;Mat rightwin = rightimg(Range(i - w,i + w + 1),Range(j - w,j + w + 1));std::vector<float> sad(MaxDisparity);for (int d = j; d < j + MaxDisparity; ++d){//Rect leftrect;Mat leftwin = leftimg(Range(i - w,i + w + 1),Range(d - w,d + w + 1));sad[d - j] = sadvalue(leftwin, rightwin);}*(ptr + j) = GetMinSadIndex(sad);}}}void GetPointDepthLeft(Mat &disparity, const Mat &leftimg, const Mat &rightimg,const int MaxDisparity, const int winsize){int row = leftimg.rows;int col = leftimg.cols;if (leftimg.channels() == 3 && rightimg.channels() == 3){cvtColor(leftimg, leftimg, CV_BGR2GRAY);cvtColor(rightimg, rightimg, CV_BGR2GRAY);}//Mat disparity = Mat ::zeros(row,col, CV_32S);int w = winsize;int rowrange = row - w;int colrange = col - w;for (int i = w; i < rowrange; ++i){int *ptr = disparity.ptr<int>(i);for (int j = MaxDisparity + w; j < colrange; ++j){//Rect leftrect;Mat leftwin = leftimg(Range(i - w,i + w + 1),Range(j - w,j + w + 1));std::vector<float> sad(MaxDisparity);for (int d = j; d > j - MaxDisparity; --d){//Rect rightrect;Mat rightwin = rightimg(Range(i - w,i + w + 1),Range(d - w,d + w + 1));sad[j - d] = sadvalue(leftwin, rightwin);}*(ptr + j) = GetMinSadIndex(sad);}}}//(Left-Right Consistency (LRC)void CrossCheckDiaparity(const Mat &leftdisp, const Mat &rightdisp, Mat &lastdisp,const int MaxDisparity, const int winsize){int row = leftdisp.rows;int col = rightdisp.cols;int w = winsize;int rowrange = row - w;int colrange = col - MaxDisparity - w;int diffthreshold = 2;for (int i = w; i < row -w; ++i){const int *ptrleft = leftdisp.ptr<int>(i);const int *ptrright = rightdisp.ptr<int>(i);int *ptrdisp = lastdisp.ptr<int>(i);for (int j = MaxDisparity + w; j < col - MaxDisparity - w; ++j){int leftvalue = *(ptrleft + j);int rightvalue = *(ptrright + j - leftvalue );int diff = abs(leftvalue - rightvalue);if (diff > diffthreshold){*(ptrdisp + j) = 0;}else{*(ptrdisp + j) = leftvalue;}}}}int main(){Mat leftimg = imread("left1.png",0);Mat rightimg = imread("right1.png",0);if (leftimg.channels() == 3 && rightimg.channels() == 3){cvtColor(leftimg, leftimg, CV_BGR2GRAY);cvtColor(rightimg, rightimg, CV_BGR2GRAY);}float scale = 1;int row = leftimg.rows * scale;int col = leftimg.cols * scale;resize(leftimg, leftimg, Size( col, row));resize(rightimg,rightimg, Size(col, row));Mat depthleft = Mat ::zeros(row,col, CV_32S);Mat depthright = Mat ::zeros(row,col, CV_32S);Mat lastdisp = Mat ::zeros(row,col, CV_32S);int MaxDisparity = 60 * scale;int winsize = 31*scale;timebegin();GetPointDepthLeft(depthleft, leftimg, rightimg, MaxDisparity, winsize);GetPointDepthRight(depthright, leftimg, rightimg, MaxDisparity, winsize);CrossCheckDiaparity(depthleft,depthright, lastdisp, MaxDisparity, winsize);timeend("time ");MatDataNormal(depthleft,depthleft);MatDataNormal(depthright, depthright);MatDataNormal(lastdisp, lastdisp);namedWindow("left", 0);namedWindow("right", 0);namedWindow("depthleft", 0);namedWindow("depthright", 0);namedWindow("lastdisp",0);imshow("left", leftimg);imshow("right", rightimg);imshow("depthleft", depthleft);imshow("depthright", depthright);imshow("lastdisp",lastdisp);string strsave = "result_";imwrite(strsave +"depthleft.jpg", depthleft);imwrite(strsave +"depthright.jpg", depthright);imwrite(strsave +"lastdisp.jpg",lastdisp);waitKey(0);return0;} left.png right.png left1_depthleft.jpg right1_depthleft.jpg lastdispOpenCv中实现了三种⽴体匹配算法:BM算法SGBM算法 Stereo Processing by Semiglobal Matching and Mutual InformationGC算法算法⽂献:Realistic CG Stereo Image Dataset with Ground Truth Disparity Maps参考:BM算法:速度很快,效果⼀般void BM(){ IplImage * img1 = cvLoadImage("left.png",0);IplImage * img2 = cvLoadImage("right.png",0);CvStereoBMState* BMState=cvCreateStereoBMState();assert(BMState);BMState->preFilterSize=9;BMState->preFilterCap=31;BMState->SADWindowSize=15;BMState->minDisparity=0;BMState->numberOfDisparities=64;BMState->textureThreshold=10;BMState->uniquenessRatio=15;BMState->speckleWindowSize=100;BMState->speckleRange=32;BMState->disp12MaxDiff=1;CvMat* disp=cvCreateMat(img1->height,img1->width,CV_16S);CvMat* vdisp=cvCreateMat(img1->height,img1->width,CV_8U);int64 t=getTickCount();cvFindStereoCorrespondenceBM(img1,img2,disp,BMState);t=getTickCount()-t;cout<<"Time elapsed:"<<t*1000/getTickFrequency()<<endl;cvSave("disp.xml",disp);cvNormalize(disp,vdisp,0,255,CV_MINMAX);cvNamedWindow("BM_disparity",0);cvShowImage("BM_disparity",vdisp);cvWaitKey(0);//cvSaveImage("cones\\BM_disparity.png",vdisp);cvReleaseMat(&disp);cvReleaseMat(&vdisp);cvDestroyWindow("BM_disparity");} left.png right.png disparity.jpgSGBM算法,作为⼀种全局匹配算法,⽴体匹配的效果明显好于局部匹配算法,但是同时复杂度上也要远远⼤于局部匹配算法。

立体匹配算法

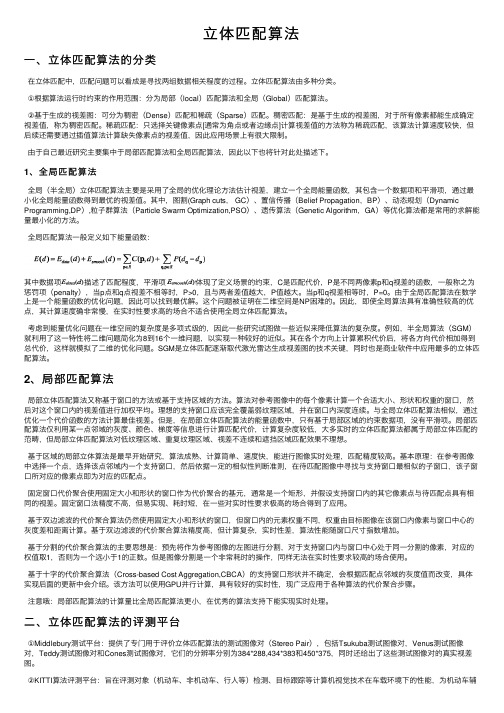

⽴体匹配算法⼀、⽴体匹配算法的分类在⽴体匹配中,匹配问题可以看成是寻找两组数据相关程度的过程。

⽴体匹配算法由多种分类。

①根据算法运⾏时约束的作⽤范围:分为局部(local)匹配算法和全局(Global)匹配算法。

②基于⽣成的视差图:可分为稠密(Dense)匹配和稀疏(Sparse)匹配。

稠密匹配:是基于⽣成的视差图,对于所有像素都能⽣成确定视差值,称为稠密匹配。

稀疏匹配:只选择关键像素点[通常为⾓点或者边缘点]计算视差值的⽅法称为稀疏匹配,该算法计算速度较快,但后续还需要通过插值算法计算缺失像素点的视差值,因此应⽤场景上有很⼤限制。

由于⾃⼰最近研究主要集中于局部匹配算法和全局匹配算法,因此以下也将针对此处描述下。

1、全局匹配算法全局(半全局)⽴体匹配算法主要是采⽤了全局的优化理论⽅法估计视差,建⽴⼀个全局能量函数,其包含⼀个数据项和平滑项,通过最⼩化全局能量函数得到最优的视差值。

其中,图割(Graph cuts, GC)、置信传播(Belief Propagation,BP)、动态规划(Dynamic Programming,DP),粒⼦群算法(Particle Swarm Optimization,PSO)、遗传算法(Genetic Algorithm,GA)等优化算法都是常⽤的求解能量最⼩化的⽅法。

全局匹配算法⼀般定义如下能量函数:其中数据项描述了匹配程度,平滑项体现了定义场景的约束,C是匹配代价,P是不同两像素p和q视差的函数,⼀般称之为惩罚项(penalty),当p点和q点视差不相等时,P>0,且与两者差值越⼤,P值越⼤。

当p和q视差相等时,P=0。

由于全局匹配算法在数学上是⼀个能量函数的优化问题,因此可以找到最优解。

这个问题被证明在⼆维空间是NP困难的。

因此,即使全局算法具有准确性较⾼的优点,其计算速度确⾮常慢,在实时性要求⾼的场合不适合使⽤全局⽴体匹配算法。

考虑到能量优化问题在⼀维空间的复杂度是多项式级的,因此⼀些研究试图做⼀些近似来降低算法的复杂度。

立体匹配综述

立体匹配综述

立体匹配是一种计算机视觉中的基本问题,它的目标是找到两个或多个摄像头或图像之间的对应点。

这个问题的解决可以用于3D建模、虚拟现实、自动驾驶、机器人导航等领域。

立体匹配综述主要包括以下方面:

1. 立体匹配的定义和基本原理:立体匹配是指在两个或多个图

像之间找到对应点,这种对应关系可以用于感知深度信息和三维重构。

2. 立体匹配方法的分类:立体匹配方法可以分为基于区域的方法、基于特征点的方法、基于光流的方法、基于深度学习的方法等。

3. 常用的立体匹配算法:常用的立体匹配算法包括SAD、SSD、NCC、 Census、GC等,每种算法都有其优点和缺点。

4. 立体匹配中的误差和评价指标:立体匹配中的误差包括视差

误差、深度误差、精度误差等,评价指标包括准确率、召回率、F1

值等。

5. 立体匹配的应用:立体匹配在3D重建、虚拟现实、自动驾驶、机器人导航等领域都有广泛的应用。

总之,立体匹配综述是对立体匹配的一个全面介绍,对于计算机视觉和机器人领域的研究人员和开发者都有很大的参考价值。

- 1 -。

《立体匹配与点云重建关键技术的研究》范文

《立体匹配与点云重建关键技术的研究》篇一一、引言立体匹配与点云重建是计算机视觉和三维重建领域的重要技术。

随着科技的发展,这两个技术已成为机器人导航、虚拟现实、无人驾驶、地形测绘等多个领域的重要应用手段。

本文将针对立体匹配与点云重建的关键技术进行深入研究,并探讨其在实际应用中的价值。

二、立体匹配技术立体匹配是利用两个或多个视角的图像信息,通过算法处理得到物体在三维空间中的位置信息。

其核心在于寻找同一物体在不同视角下的对应点,即立体匹配点对。

1. 立体匹配的基本原理立体匹配的基本原理是通过分析两个或多个视角的图像,寻找相同物体在不同视角下的对应点。

这些对应点被称为立体匹配点对,通过这些点对可以计算出物体的三维空间位置信息。

2. 立体匹配的关键技术(1)特征提取:从图像中提取出具有代表性的特征点,如角点、边缘点等。

(2)相似性度量:通过计算不同图像中特征点的相似性,得到匹配代价。

(3)匹配策略:根据匹配代价选择合适的匹配点对,常用的有全局匹配和局部匹配两种策略。

(4)优化算法:通过优化算法提高匹配精度和效率,如动态规划、图割法等。

三、点云重建技术点云重建是通过获取物体表面的大量离散点信息,进而恢复物体三维结构的过程。

在立体匹配的基础上,可以利用点云重建技术生成物体的三维模型。

1. 点云重建的基本原理点云重建的基本原理是通过获取物体表面的大量离散点信息,利用空间几何关系恢复物体三维结构。

这些离散点信息被称为点云数据,通过处理这些数据可以生成物体的三维模型。

2. 点云重建的关键技术(1)数据获取:通过激光扫描、深度相机等设备获取物体表面的点云数据。

(2)数据预处理:对原始点云数据进行去噪、补全等处理,提高数据质量。

(3)三维模型重建:通过空间几何关系和算法处理,将预处理后的点云数据转化为三维模型。

(4)模型优化:对生成的三维模型进行优化,如平滑处理、纹理映射等,提高模型的真实感和细节表现力。

四、立体匹配与点云重建的融合应用立体匹配与点云重建技术的融合应用在多个领域具有广泛的应用前景。

计算机视觉图像配准资料

2)立体匹配立体匹配是指根据对所选特征的计算来建立特征间的对应(correspondence),从而建立同一个空间点在不同图像中的像点之间的关系,并由此得到相应的视差(disparity)图像。

立体匹配是立体视觉中最重要、最困难的步骤。

视差图像代表了左右两幅图像之间的对应关系,然后由二角测量原理就可以求得景物的深度(depth)。

学位论文作者.题名〔D〕.保存地点.保存单位.年份葛亮图像建模中立体匹配问题的研究[D]计算机软件与理论重庆大学, 2009LHUILLIER和QUAN【20 ]从特征点匹配出发,提出了基于区域增长的类稠密匹配算法,效果良好,但该算法只能用十纹理丰富的图像,在纹理单一的区域,匹配关系的传播就会停止。

图像匹配图像匹配是指通过一定的匹配算法在两幅或多幅图像之间识别同名点,如二维图像匹配中通过比较目标区和搜索区中相同大小的窗口的相关系数,取搜索区中相关系数最大所对应的窗口中心点作为同名点。

其实质是在基元相似性的条件下,运用匹配准则的最佳搜索问题。

图像匹配主要可分为以灰度为基础的匹配和以特征为基础的匹配。

1、灰度匹配灰度匹配的基本思想:以统计的观点将图像看成是二维信号,采用统计相关的方法寻找信号间的相关匹配。

利用两个信号的相关函数,评价它们的相似性以确定同名点。

灰度匹配通过利用某种相似性度量,如相关函数、协方差函数、差平方和、差绝对值和等测度极值,判定两幅图像中的对应关系。

最经典的灰度匹配法是归一化的灰度匹配法,其基本原理是逐像素的把一个以一定大小的实时图像窗口的灰度矩阵,与参考图像的所有可能的窗口灰度阵列,按某种相似性度量方法进行搜索比较的匹配方法,从理论上说就是采用图像相关技术。

利用灰度信息匹配方法的主要缺陷是计算量太大,因为使用场合一般都有一定的速度要求,所以这些方法很少被使用。

现在已经提出了一些相关的快速算法,如幅度排序相关算法,FFT相关算法和分层搜索的序列判断算法等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

立体匹配十大概念综述

一、概念

立体匹配算法主要是通过建立一个能量代价函数,通过此能量代价函数最小化来估计像素点视差值。

立体匹配算法的实质就是一个最优化求解问题,通过建立合理的能量函数,增加一些约束,采用最优化理论的方法进行方程求解,这也是所有的病态问题求解方法。

二、主要立体匹配算法分类

1)根据采用图像表示的基元不同,立体匹配算法分为:

A、区域立体匹配算法(可获取稠密视差图。

缺点:受图像的仿射畸变和辐射畸变影响较大;像素点约束窗口的大小与形状选择比较困难,选择过大,在深度不连续处,视差图中会出现过度平滑现象;选择过小,对像素点的约束比较少,图像信息没有得到充分利用,容易产生误匹配。

)

B、基于特征的立体匹配算法(可获得稀疏的视差图,经差值估计可获得稠密视差图。

可提取点、线、面等局部特征,也可提取多边形和图像结构等全局特征。

缺点:特征提取易受遮挡、光线、重复纹理等影响较大;差值估计计算量大)

C、基于相位立体匹配算法(假定在图像对应点中,其频率范围内,其局部相位是相等的,在频率范围内进行视差估计)

2)依据采用最优化理论方法的不同,立体匹配算法可以分为:

A、局部的立体匹配算法

B、全局的立体匹配算法

三、匹配基元(match primitive)

目前匹配算法中所采用的匹配基元可以分成两大类:

1)在所有图像像素点上抽取量测描述子

A、像素灰度值(最简单、直接,但必须在同一光照条件下获得)

B、局部区域灰度函数(主要是利用求得在各种大小不同窗口中灰度分布的导数信息,描述像素点周围的结构矢量。

)

C、卷积图像符号(利用各种大小算子与图象进行卷积,用灰度梯度局部极大值或极小值作为特征信息,描述整个图像)

2)图像特征

A、过零点

B、边缘(由于边缘是图像特征位置的标志,对灰度值的变化不敏感,边缘是图像匹配的重要特征和描述子)

C、角点(虽然其没有明确的数学定义,但大家普遍认为角点,即二维图像亮度变化剧烈的点或边缘曲线上曲率极值点)

四、区域匹配算法

基本原理是给定在一幅图像上的某一点,选取该像素点邻域内的一个子窗口,在另一幅图像中的一个区域内,根据某种相似性判断依据,寻找与子窗口图像最为相似的子图,而其匹配的子图中对应的像素点就为该像素的匹配点。

一般单纯的区域匹配都遇到如下限制:

1)针对弱纹理或存在重复纹理的区域,匹配结果不好

2)该算法不适应于深度变化剧烈的场景

3)对光照、对比度和噪声比较敏感

4)子窗体的大小很难选择

五、特征匹配算法

特征的匹配算法,主要是基于几何特征信息(边缘、线、轮廓、兴趣点、角点和几何基元等),针对几何特征点进行视差估计,所以先要提取图像的特征点,尽而利用这些特征点的视差值信息来重建三维空间场景。

匹配所需要的主要步骤:图像预处理、提取特征、特征点的匹配获取稀疏视差图,如果想得到稠密的视差图,需要采用插值的方法。

六、全局匹配算法

全局立体匹配算法主要是采用了全局的优化理论方法估计视差,建立全局能量函数,通过最小化全局能量函数得到最优视差值。

全局匹配算法得到的结果比较准确,但是其运行时间比较长,不适合实时运行。

主要的算法有图割(graph cuts)、信念传播(belief propagation)、动态规划等算法。

七、局部匹配算法(个人觉得跟区域匹配类似,角度不同而已)

主要是采用局部优化方法进行视差值估计,局部立体匹配算法有 SAD,SSD 等算法,与全局立体匹配算法一样,也是通过能量最小化方法进行视差估计,但是,在能量函数中,只有数据项,而没有平滑项。

主要分为三类:自适应窗体立体匹配算法、自适应权值的立体匹配算法和多窗体立体匹配算法。

八、立体匹配约束

1)极线约束

2)唯一性约束

3)视差连续性约束

4)顺序一致性约束

5)相似性约束

九、相似性判断标准

1)像素点灰度差的平方和,即 SSD

2)像素点灰度差的绝对值和,即 SAD

3)归一化交叉相关,简称 NCC

4)零均值交叉相关,即 ZNCC

5)Moravec 非归一化交叉相关,即 MNCC

6)Kolmogrov-Smrnov 距离,即 KSD

7)Jeffrey 散度

8)Rank 变换(是以窗口内灰度值小于中心像素灰度值的像素个数来代替中心像素的灰度值)

9)Census 变换(是根据窗口内中心像素灰度与其余像素灰度值的大小关系得一串位码,位码长度等于窗口内像素个数减一)

十、评价参数

立体匹配算法是一个病态问题,一般通过建立能量函数,利用最小化能量函数,和一些约束条件,采用最优化理论方法进行求解方程。

公认的定量评价参数有:均方根误差(Root-mean-squared)和误匹配率(percentage of bad matching pixels)。