特征值特征向量的计算

特征值与特征向量的计算方法

特征值与特征向量的计算方法特征值与特征向量是矩阵理论中的重要概念,用于解决矩阵特征与变换特性的相关问题。

在本文中,将介绍特征值与特征向量的定义和计算方法,以及它们在实际问题中的应用。

一、特征值与特征向量的定义在矩阵理论中,对于一个n阶方阵A,如果存在一个非零向量x,使得Ax=kx(k为标量),那么k称为矩阵A的特征值,x称为对应于特征值k的特征向量。

特征向量可以理解为在矩阵变换下保持方向不变的向量,而特征值则表示特征向量在变换中的伸缩比例。

二、要计算特征值和特征向量,可以使用以下步骤:1. 首先,由于特征值和特征向量的定义基于方阵,所以需要确保矩阵A是方阵,即行数等于列数。

2. 接下来,根据特征值和特征向量的定义方程Ax=kx,将其改写为(A-kI)x=0(I为单位矩阵)。

3. 为了求解此方程组的非零解,需要求出(A-kI)的零空间(核)。

4. 将(A-kI)的零空间表示为Ax=0的齐次线性方程组,采用高斯消元法或其它线性方程组求解方法,求得方程的基础解系,即特征向量。

5. 特征向量已找到,接下来通过将每个特征向量代入原方程式Ax=kx中,计算出对应的特征值。

值得注意的是,特征值是一个多重属性,即一个特征值可能对应多个线性无关的特征向量。

此外,方阵A的特征值计算方法存在多种,如幂迭代法、QR迭代法等。

三、特征值与特征向量的应用特征值与特征向量在物理、工程、经济等领域具有广泛的应用。

1. 物理学中,特征值与特征向量可用于解析力学、量子力学等领域中的问题,如研究振动系统的固有频率、粒子的角动量等。

2. 工程学中,特征值与特征向量可用于电力系统的稳定性分析、机械系统的振动模态分析等。

3. 经济学中,特征值与特征向量可用于描述经济模型中的平衡点、稳定性等重要特征。

此外,特征值与特征向量在图像识别、数据降维、网络分析等领域也有重要的应用。

总结:特征值和特征向量在矩阵理论中有着重要的地位和应用价值。

通过计算特征值和特征向量,可以揭示矩阵在变换中的性质和特点,并应用于各个学科领域,为问题求解提供了有效的工具和方法。

特征值与特征向量定义与计算

特征值与特征向量定义与计算特征值(eigenvalue)和特征向量(eigenvector)是线性代数中重要的概念,在许多数学和科学领域中都有广泛的应用。

特征值和特征向量可以帮助我们理解和解决许多实际问题,如物理的振动问题、量子力学中的量子态等。

设A是一个n阶方阵,如果存在一个非零向量x使得Ax=kx,其中k 是一个常数,那么常数k称为矩阵A的特征值,非零向量x称为矩阵A对应于特征值k的特征向量。

特征值和特征向量的计算:对于给定的方阵A,我们可以通过求解特征方程来计算其特征值和特征向量。

设λ为矩阵A的特征值,x为A对应于λ的特征向量,则有方程(A-λI)x=0,其中I是单位矩阵。

求解特征方程的一般步骤如下:1.计算A-λI,形成一个新的矩阵。

2.根据这个矩阵,设置行列式为0,形成特征方程。

3.解特征方程,即求特征值λ的值。

4.将每一个特征值代入(A-λI)x=0,形成一个线性方程组。

5.解线性方程组,求解特征向量x。

需要注意的是,对于一个n阶矩阵A,其特征值的个数不超过n,且特征值可以是复数。

特征值和特征向量的性质:1.矩阵A和其转置矩阵A^T有相同的特征值。

2.两个矩阵A和B的特征值之和等于它们的直和A⊕B的特征值。

3.两个矩阵A和B的特征值之积等于它们的张量积A⊗B的特征值。

4.方阵A与其逆矩阵A^(-1)的特征值互为倒数,非零特征值满足这个特性。

5.方阵A的特征向量张成一个特征子空间,而特征值决定了这个特征子空间的维度。

特征值和特征向量在线性代数中有许多重要应用,包括:2.特征向量的正交性:特征向量张成的特征子空间中的向量是两两正交的,可以用于求解正交变换、对角化、正交投影等。

3.特征值的重要性:特征值大小可以用于判断矩阵的稳定性、收敛性等性质,可以用于分析无线电信号的频域特征等。

总而言之,特征值与特征向量是矩阵分析中非常重要的概念和工具,它们在物理、工程、计算机科学等领域中都有广泛的应用。

特征值和特征向量计算的数值方法

特征值和特征向量计算的数值方法在数学和计算机科学领域中,特征值和特征向量是非常重要的概念。

特征值和特征向量的计算有许多不同的数值方法,本文将介绍其中一些常见的数值方法,并分析它们的优劣和适用范围。

一、特征值和特征向量的定义在矩阵理论中,给定一个n×n的矩阵A,如果存在一个非零向量v和一个标量λ,使得Av=λv,那么称v为矩阵A的特征向量,λ为矩阵A的特征值。

特征值和特征向量的计算可以帮助我们理解矩阵的性质以及解决一些实际问题。

二、幂法幂法是计算特征值和特征向量的常用数值方法之一。

幂法的基本思想是通过多次迭代,逐渐逼近矩阵的特征值和特征向量。

具体操作如下:1. 初始化一个非零向量b0;2. 进行迭代计算:bi+1 = A * bi / ||A * bi||;3. 取出近似特征向量的最后一列:v = bn;4. 进行迭代计算特征值:λ = (Av)T * v / (vT * v)。

幂法的主要优点是简单易懂,且只需要进行矩阵向量乘法和内积计算。

然而,幂法仅能求取具有最大特征值的特征向量,而且对于存在多个特征值相等的情况并不适用。

三、反幂法反幂法是幂法的一种改进方法,用于求取矩阵A的最小特征值和对应的特征向量。

反幂法的基本步骤如下:1. 初始化一个非零向量b0;2. 进行迭代计算:bi+1 = (A - μI)^-1 * bi / ||(A - μI)^-1 * bi||;3. 取出近似特征向量的最后一列:v = bn;4. 进行迭代计算特征值:λ = (Av)T * v / (vT * v)。

反幂法的改进之处在于引入了矩阵的逆运算,通过使用矩阵A减去一个合适的常数μ乘以单位矩阵来实现。

反幂法适用于矩阵A的特征值接近于μ的情况。

四、QR方法QR方法也是一种常用的特征值计算方法,它适用于求解所有特征值以及对应的特征向量。

QR方法的基本思想是将一个矩阵分解为正交矩阵Q和上三角矩阵R的乘积,然后迭代地将矩阵A转化为更接近上三角形的形式。

特征值和特征向量

特征值和特征向量首先,我们先来了解一下矩阵。

矩阵是由一个矩形的数组组成的,其中的每个元素都可以是实数或复数。

例如,3x3的矩阵可以写为:A=[abc][def][ghi]Av=λv那么v就是矩阵A的特征向量,λ就是矩阵A的特征值。

换句话说,特征向量在矩阵的变换下只发生拉伸或缩放,而不发生旋转或扭曲。

特征值表示特征向量被拉伸或缩放的比例。

det(A - λI) = 0其中,det表示矩阵的行列式,I是单位矩阵。

通过解特征方程,我们可以求得特征值λ。

然后,我们可以将每个特征值代入原方程Av =λv中,从而求得对应的特征向量v。

1.矩阵的对角化:特征值和特征向量可以帮助我们将一个复杂的矩阵对角化,即将矩阵表示为对角矩阵的形式。

对角化后的矩阵更容易进行计算和分析,也更便于推导矩阵的性质。

2.矩阵的相似性:如果一个方阵A和B有相同的特征值和特征向量,那么A和B是相似的。

相似的矩阵在一些数学和物理问题中具有相同的性质和行为,因此,通过特征值和特征向量可以判断矩阵的相似性。

3.矩阵的主成分分析(PCA):主成分分析是一种常用的数据降维方法,它可以通过计算矩阵的特征值和特征向量,将高维数据降低到低维空间中。

通过PCA,我们可以找到数据中最重要的特征和主要方向,从而减少冗余信息。

4.矩阵的奇异值分解(SVD):奇异值分解是矩阵分解的一种重要方法,它可以将一个任意形状的矩阵表示为三个矩阵的乘积。

在奇异值分解中,矩阵的特征值和特征向量扮演了重要的角色。

5.线性变换和矩阵的谱:特征值和特征向量可以帮助我们理解和描述线性变换和矩阵的谱。

谱是矩阵A的特征值的集合,它可以提供关于矩阵的一些性质信息,比如矩阵的正定性、对称性、收敛性等。

总结起来,特征值和特征向量是矩阵理论中非常重要的概念。

它们可以帮助我们理解和描述矩阵的性质和变换,以及在许多实际问题中的应用。

特征值和特征向量的计算和应用对于数学、物理、工程和计算机科学等领域都有重要意义。

特征值与特征向量定义与计算

特征值与特征向量特征值与特征向量的概念及其计算定义1. 设A是数域P上的一个n阶矩阵,l是一个未知量,称为A的特征多项式,记ƒ(l)=| lE-A|,是一个P上的关于l的n次多项式,E是单位矩阵。

ƒ(l)=| lE-A|=l n+a1l n-1+…+a n= 0是一个n次代数方程,称为A的特征方程。

特征方程ƒ(l)=| lE-A|=0的根(如:l0) 称为A的特征根(或特征值)。

n次代数方程在复数域内有且仅有n 个根,而在实数域内不一定有根,因此特征根的多少和有无,不仅与A有关,与数域P 也有关。

以A的特征值l0代入(lE-A)X=q,得方程组(l0E-A)X=q,是一个齐次方程组,称为A的关于l0的特征方程组。

因为|l0E-A|=0,(l0E-A)X=q必存在非零解X(0),X(0) 称为A的属于l0的特征向量。

所有l0的特征向量全体构成了l0的特征向量空间。

一.特征值与特征向量的求法对于矩阵A,由AX=l0X,l0EX=AX,得:[l0E-A]X=q即齐次线性方程组有非零解的充分必要条件是:即说明特征根是特征多项式|l 0E-A| =0的根,由代数基本定理有n个复根l1, l2,…, l n,为A的n个特征根。

当特征根l i (I=1,2,…,n)求出后,(l i E-A)X=q是齐次方程,l i均会使|l i E-A|=0,(l i E-A)X=q必存在非零解,且有无穷个解向量,(l i E-A)X=q 的基础解系以及基础解系的线性组合都是A的特征向量。

例1. 求矩阵的特征值与特征向量。

解:由特征方程解得A有2重特征值l1=l2=-2,有单特征值l3=4对于特征值l1=l2=-2,解方程组(-2E-A)x=q得同解方程组x1-x2+x3=0解为x1=x2-x3 (x2,x3为自由未知量)分别令自由未知量得基础解系所以A的对应于特征值l1=l2=-2的全部特征向量为x=k1x1+k2x2 (k1,k2不全为零)可见,特征值l=-2的特征向量空间是二维的。

特征值与特征向量的求解

特征值与特征向量的求解特征值和特征向量是线性代数中一对重要的概念,广泛应用于物理学、工程学和计算机科学等领域。

在本篇文章中,我们将深入探讨特征值和特征向量的定义、性质以及求解方法。

一、特征值与特征向量的定义在介绍特征值与特征向量的求解方法之前,我们先来了解它们的定义。

在一个n维向量空间V中,若存在一个n阶方阵A和一个非零向量X,使得下式成立:AX = λX其中,λ为标量,称为矩阵A的特征值;X为矩阵A的特征向量。

特征值与特征向量的求解方法有多种,下面将介绍其中两种常用的方法。

二、特征值与特征向量的求解方法1. 特征方程法特征方程法是求解特征值和特征向量的一种常用方法。

假设A是一个n阶方阵,我们的目标是求解它的特征值和特征向量。

首先,我们将上述特征方程AX = λX两边同时左乘一个单位矩阵I,得到:(A-λI)X = 0其中,I为n阶单位矩阵,0为n维零向量。

由于X为非零向量,所以矩阵(A-λI)必须是奇异矩阵,即其行列式为0:|A-λI| = 0这就是特征方程。

接下来,我们需要求解特征方程|A-λI| = 0的根λ,即矩阵A的特征值。

求解得到的特征值λ可以有重根。

然后,将每个特征值λ带入原特征方程(A-λI)X = 0,解得对应的特征向量X。

注意,对于每个不同的特征值,我们都可以对应多个特征向量。

通过特征方程法,我们可以求解出矩阵A的所有特征值和对应的特征向量。

2. 幂法幂法是求解矩阵特征值和特征向量的一种迭代方法,适用于大规模稀疏矩阵。

幂法的基本思想是:通过迭代将初始向量不断与矩阵A进行乘法运算,使得向量的模不断增大,趋向于对应最大特征值的特征向量。

具体做法是:1) 先选择一个非零向量X0作为初始向量。

2) 迭代计算X(k+1) = AX(k),其中k表示迭代次数。

3) 归一化向量X(k+1),即X(k+1) = X(k+1) / ||X(k+1)||,其中||X(k+1)||表示向量X(k+1)的模。

特征值特征向量的求法

求特征向量方法:从定义出发,Ax=cx,A为矩阵,c为特征值,x为特征向量。

特征向量的简介矩阵的特点向量是矩阵实际上的主要观点之一,它有着普遍的使用,数学上,线性变换的特点向量是一个非简并的向量,其标的目的在该变换下稳定,该向量在此变换下缩放的比例称为其特点值。

性质线性变换的特点向量是指在变换下标的目的稳定,或者容易地乘以一个缩放因子的非零向量,特点向量对应的特点值是它所乘的阿谁缩放因子,特点空间就是由一切有着类似特点值的特点向量构成的空间,还包含零向量,但要留意零向量自身不是特点向量。

线性变换的主特点向量是最大特点值对应的特点向量,特点值的几何重次是相应特点空间的维数,有限维向量空间上的一个线性变换的谱是其一切特点值的聚集。

例子跟着地球的自转,除在转轴上的两个箭头,每一个从地心往外指的箭头都在扭转。

思索地球在自转一小时后的变换:地心指向天文南极的箭头是这个变换的一个特点向量,可是从地心指向赤道上任何一点的箭头不会是一个特点向量,又由于指向顶点的箭头没有被地球的自转拉伸,所以它的特点值是1。

薄金属板关于一个固定点平均舒展,使得板上每个点到该固定点的间隔翻倍。

这个舒展是一个具有特点值2的变换,从该固定点到板上任何一点的向量都是一个特点向量,而相应的特点空间是一切这些向量的聚集。

定理谱定理在有限维的状况,将一切可对角化的矩阵作了分类:它显示一个矩阵是可对角化的,当且仅当它是一个正轨矩阵,留意这包含自共轭(厄尔米特)的状况,这很有效,由于对角化矩阵T的函数f(T)的观点是明白的,在采取更一般的矩阵的函数的时候谱定理的用处就更分明了。

应用因子分析在要素剖析中,一个协变矩阵的特点向量对应于要素,而特点值是要素负载。

要素剖析是一种统计学技术,用于社会科学和市场剖析、产品管理、运筹计划和其他处置大量data的使用科学。

其目的是用称为要素的少数的不成观察随机变量来说明在一些可观察随机变量中的变更。

特征脸在图象处置中,面部图象的处置可以看做重量为每一个像素的灰度的向量,该向量空间的维数是像素的个数,一个规范化脸部图形的一个大型data聚集的协变矩阵的特点向量称为特点脸。

特征值与特征向量的概念性质及其求法

特征值与特征向量的概念性质及其求法特征值与特征向量是矩阵的一个重要特性,它们描述了矩阵在一些方向上的特殊性质。

特征值是一个标量,特征向量是一个向量。

特征值与特征向量的关系可以用方程表示:A*v=λ*v,其中A是一个矩阵,v是这个矩阵的特征向量,λ是对应的特征值。

换句话说,一个矩阵A作用在它的特征向量v上,结果是一个与v方向相同但大小为λ倍的新向量。

1.特征向量可以是零向量,但非零向量的特征向量被称为非零特征向量。

2.矩阵的特征值与特征向量是成对出现的,一个特征向量可以对应多个特征值,但一个特征值只能对应一个特征向量。

3.如果一个矩阵A的特征向量v对应的特征值λ,那么任意与v成比例的向量都是A的特征向量,且对应的特征值也是λ。

4.一个n×n的矩阵最多有n个特征值,即使重复的特征值,在进行特征值分解的时候也有对应的不同特征向量。

求解特征值与特征向量的方法有很多种,以下介绍两种常用的方法:1. 特征方程法:对于一个n×n的矩阵A,它的特征值可以通过求解特征方程 det(A−λI) = 0 来获得。

其中,λ表示特征值,I表示单位矩阵。

解特征方程得到的根即为特征值。

2. 幂迭代法:该方法适用于大型矩阵的求解。

假设矩阵A的最大特征值为λ1,对应的特征向量为x1、选取一个初始向量x0,通过迭代xk = A*xk−1,可以逼近特征向量x1、最终,通过归一化得到单位特征向量。

1.数据降维:在主成分分析(PCA)中,特征向量被用来定义新的特征空间,从而实现数据降维。

2.图像处理:特征值与特征向量被用来表示图像的特征,例如人脸识别中的特征向量。

3.振动分析:特征向量被用来描述物体的固有振动模式,通过求解特征值和特征向量,可以预测物体在不同频率下的振动表现。

总结来说,特征值和特征向量是矩阵的一个重要特性,它们描述了矩阵在一些方向上的特殊性质。

特征值与特征向量可以通过特征方程法和幂迭代法来求解。

在实际应用中,特征值与特征向量被广泛应用于数据降维、图像处理、振动分析等领域。

特征向量和特征值的求法

特征向量和特征值的求法在线性代数中,特征向量和特征值是非常重要的概念。

它们在矩阵的分析和应用中有着广泛的应用。

本文将介绍特征向量和特征值的定义、求法以及它们的应用。

特征向量和特征值的定义对于一个n阶方阵A,如果存在一个非零向量x,使得Ax=kx,其中k为一个常数,那么x就是A的一个特征向量,k就是A的对应的特征值。

特征向量和特征值是成对出现的,一个特征向量对应一个特征值。

特征向量和特征值的求法求解特征向量和特征值的方法有很多种,下面介绍两种常用的方法。

方法一:特征多项式法对于一个n阶方阵A,其特征多项式为f(λ)=|A-λI|,其中I为n阶单位矩阵。

求解特征值就是求解f(λ)=0的根。

求解特征向量就是将特征值代入(A-λI)x=0中,解出x。

方法二:幂法幂法是一种迭代方法,用于求解矩阵的最大特征值和对应的特征向量。

具体步骤如下:1. 任意选择一个非零向量x0作为初始向量。

2. 迭代计算xk+1=Axk/||Axk||,其中||Axk||为Axk的模长。

3. 当xk+1与xk的差距小于某个阈值时,停止迭代。

此时xk+1就是A的最大特征值对应的特征向量。

特征向量和特征值的应用特征向量和特征值在矩阵的分析和应用中有着广泛的应用。

下面介绍几个常见的应用。

1. 矩阵的对角化对于一个n阶方阵A,如果存在n个线性无关的特征向量,那么A 可以对角化,即存在一个对角矩阵D和一个可逆矩阵P,使得A=PDP^-1。

对角化后的矩阵D的对角线上的元素就是A的特征值。

2. 矩阵的相似性如果存在一个可逆矩阵P,使得A=PBP^-1,那么A和B是相似的。

相似的矩阵具有相同的特征值,但不一定具有相同的特征向量。

3. 矩阵的谱半径矩阵的谱半径是指矩阵的所有特征值的模长的最大值。

谱半径在控制论、信号处理等领域有着广泛的应用。

总结本文介绍了特征向量和特征值的定义、求法以及应用。

特征向量和特征值在矩阵的分析和应用中有着广泛的应用,掌握它们的求法和应用可以帮助我们更好地理解和应用线性代数的知识。

特征向量和特征值计算

特征向量和特征值计算

特征向量和特征值是线性代数中非常重要的概念,它们在多个领域都有广泛的应用。

本文将介绍如何计算特征向量和特征值。

首先,我们需要知道特征向量和特征值的定义。

对于一个n x n 的矩阵A,如果存在非零向量v和标量λ,使得Av=λv成立,则v

称为A的特征向量,λ称为A的特征值。

计算特征向量和特征值的步骤如下:

1. 求出A-λI的行列式det(A-λI),其中I是n阶单位矩阵,det表示行列式。

2. 解出方程det(A-λI)=0,得到λ的值。

3. 将λ的值代入(A-λI)x=0,求出x的解,x就是对应的特征向量。

需要注意的是,特征向量是非零向量,所以解出的x值不能为0向量。

在实际计算中,通常使用特征值分解来求解特征向量和特征值。

特征值分解是将一个矩阵分解为特征向量和特征值的形式,可以用于矩阵对角化等问题。

具体步骤如下:

1. 计算矩阵A的特征值λ1, λ2, ..., λn。

2. 对于每个特征值λi,求出对应的特征向量xi。

3. 将所有特征向量组成一个矩阵X=[x1, x2, ..., xn]。

4. 将所有特征值组成对角矩阵Λ=diag(λ1, λ2, ..., λn)。

5. 则A可以表示为A=XΛX^-1。

特征向量和特征值的计算在机器学习、信号处理、量子力学等领域都有广泛的应用。

掌握其计算方法可以帮助我们更好地理解和应用相关的理论和算法。

特征值与特征向量的计算

特征值与特征向量的计算特征值和特征向量是线性代数中的重要概念,广泛应用于各个领域的数学和工程问题中。

它们的计算方法也是学习线性代数的基础知识之一。

本文将介绍特征值与特征向量的概念以及计算方法。

一、特征值与特征向量的定义在矩阵的运算中,特征值和特征向量是由方阵产生的重要结果。

对于一个方阵A,当存在一个非零向量v使得满足以下等式时:Av = λv其中,λ为标量,称为特征值,而v称为矩阵A对应于λ的特征向量。

特征值和特征向量的计算可以帮助我们理解矩阵的性质,比如矩阵的对角化、矩阵的相似性等。

二、特征值与特征向量的计算方法1. 通过特征方程求解要计算一个矩阵的特征值和特征向量,最常见的方法是通过特征方程求解。

对于一个n阶方阵A,其特征值求解的步骤如下:a) 计算矩阵A与单位矩阵的差值A-λI,其中λ为待求的特征值,I 为n阶单位矩阵。

b) 解特征方程|A-λI|=0,求得特征值λ。

c) 将求得的特征值代入方程A-λI=0,解出特征向量v。

2. 使用特征值分解方法特征值分解是另一种计算特征值和特征向量的方法,适用于对角化矩阵。

对于对角化矩阵A,其特征值分解的步骤如下:a) 求解A的特征值λ和对应的特征向量v。

b) 将特征向量v按列组成矩阵P。

c) 求解对角矩阵D,其中D的对角线元素为特征值。

d) 根据A=PDP^-1,将计算得到的矩阵P和D代入,求解出矩阵A。

三、特征值与特征向量的应用特征值与特征向量的计算方法在实际应用中具有广泛的应用,以下是几个常见的应用场景:1. 机器学习中的主成分分析(PCA)主成分分析是一种常用的降维技术,通过特征值与特征向量的计算可以实现数据降维和分析。

2. 物理学中的量子力学量子力学中,量子态可由特征向量表示,相应的能量则为特征值,通过求解特征值和特征向量,可以揭示微观粒子的性质。

3. 图像处理中的特征提取在图像处理的过程中,通过计算图像的特征值和特征向量,可以提取出图像的关键信息,用于图像识别、分类等任务。

特征值特征向量的计算

A的特征多项式

方程 A lE 0

A的特征方程

定义 2 设A为n阶方阵,l1,l2,L L ,lm为其特征值组,

则其特征方程可表示为:

l l1 k1 l l2 k2 L L l lm km 0

则ki称为 li的代数重数(重数),而li 特征子空间的维数

称为几何重数(度数)。

di dimVi 显然:

证明:设l是A的特征值,是A的属于l的特征向量 则 0,且A l 方程A2 3A 2E O两边右乘

A2 3A 2E A2 3A 2E Al 3l 2

l 2 3l 2 (l 2 3l 2) 0

由 0

l2 3l 2 0

l 1l 2 0

l 1 或l 2

把l1 =2代入方程(A- lE)X=O ,得

(A -2E)X=O

3 1 0 x1 0 4 1 0 x2 0 1 0 0 x3 0

3x1 4x1

x2 x2

0 0

x1 0

x1 x2

0 0

0取 x3Fra bibliotek1,得一基础解系

V1

0

于是,A的属于l1

1

=2的全部特征向量为:c1V1

因此 :l0是A的特征值

求A的特征值步骤: (1) 计算n阶行列式

l0使 A lE 0成立 l0是特征方程A lE 0的根

A lE

(2)令 A lE 0

解得方程的根l1,l2,… ,ln, 则l1, l2,… ,ln即是A的特征值

设

a11

A

a21 an1

a12 a22 an2

A的对应于特征值li的特征向量: 方程组(A-liE)X=O的全部非零解

步骤:1)把 l= li代入方程(A-liE)X=O 得一齐次线性方程组(A-liE)X=O

特征值特征向量的计算

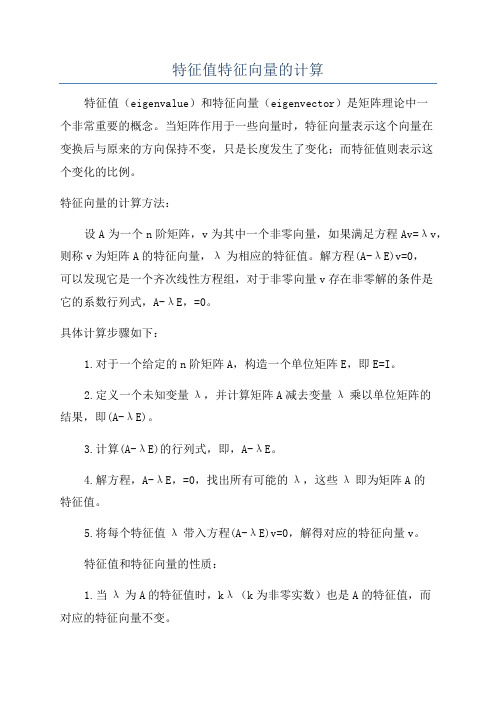

特征值特征向量的计算特征值(eigenvalue)和特征向量(eigenvector)是矩阵理论中一个非常重要的概念。

当矩阵作用于一些向量时,特征向量表示这个向量在变换后与原来的方向保持不变,只是长度发生了变化;而特征值则表示这个变化的比例。

特征向量的计算方法:设A为一个n阶矩阵,v为其中一个非零向量,如果满足方程Av=λv,则称v为矩阵A的特征向量,λ为相应的特征值。

解方程(A-λE)v=0,可以发现它是一个齐次线性方程组,对于非零向量v存在非零解的条件是它的系数行列式,A-λE,=0。

具体计算步骤如下:1.对于一个给定的n阶矩阵A,构造一个单位矩阵E,即E=I。

2.定义一个未知变量λ,并计算矩阵A减去变量λ乘以单位矩阵的结果,即(A-λE)。

3.计算(A-λE)的行列式,即,A-λE。

4.解方程,A-λE,=0,找出所有可能的λ,这些λ即为矩阵A的特征值。

5.将每个特征值λ带入方程(A-λE)v=0,解得对应的特征向量v。

特征值和特征向量的性质:1.当λ为A的特征值时,kλ(k为非零实数)也是A的特征值,而对应的特征向量不变。

2. 特征值的和等于矩阵的迹(trace),即A的所有特征值之和等于tr(A)。

3.特征向量可以通过特征值来缩放得到,即一个特征向量可以乘以一个常数得到一个沿着同一方向的新的特征向量。

特征值和特征向量的应用:1.特征值和特征向量常用于解决线性代数中的一系列问题,如解线性方程组、矩阵的对角化等。

2.在求解最优化问题时,特征值和特征向量可以用于求解函数的极值。

3.在机器学习和数据分析中,特征值和特征向量常被用于数据降维、图像处理、聚类分析等任务。

总之,特征值和特征向量是矩阵理论中非常重要的概念,其计算方法可以通过解矩阵方程得到。

它们的性质和应用广泛存在于数学、工程和计算机科学的各个领域,对理解和解决实际问题具有重要意义。

特征值与特征向量定义与计算

特征值与特征向量定义与计算特征值(eigenvalue)是指对于一个n阶方阵A,如果存在非零向量x使得Ax=kx,其中k是一个常数,那么k被称为A的特征值,x被称为对应于特征值k的特征向量(eigenvector)。

特征向量是非零向量x,特征向量关于特征值的命名较为模糊,如eigenvector(特征向量)和characteristic vector(特征向量)是指同一概念。

一般通过选取适当的非零向量,使得线性变换矩阵作用于该向量后,只改变向量的长度而不改变方向。

1.对于给定的n阶矩阵A,求解其特征方程。

特征方程的形式为,A-λI,=0,其中λ是待求特征值,I是单位矩阵。

求解特征方程可以得到n个特征值。

2.对于每个特征值λ,求解特征方程(A-λI)x=0,其中x是特征向量。

这是一个线性方程组,通过高斯消元法或其他方法求解,可以得到特征向量。

特征值和特征向量之间的关系可以通过下面的等式描述:Ax=λx。

即矩阵A作用于特征向量x后,结果是特征值λ与特征向量的乘积。

特征向量与特征值的性质:1.对于n阶矩阵A,最多有n个线性无关的特征向量。

2. 特征向量可以通过线性组合得到,即如果x1和x2是矩阵A对应于特征值λ的特征向量,则任意实数a、b,ax1+bx2仍然是对应于特征值λ的特征向量。

3.一个矩阵的不同特征值对应的特征向量是线性无关的。

特征值和特征向量的应用:1.特征值和特征向量在信号处理中常用于图像压缩和模式识别等领域。

2.特征值和特征向量可以用于求解矩阵的指数、对角化、独立性等问题。

3.特征向量可以用于判断矩阵或线性变换的性质,如对称矩阵的特征向量必然正交。

总结:特征值和特征向量是矩阵和线性变换的重要特性,它们可以用于求解矩阵的乘法、对角化、矩阵方程等问题。

特征值和特征向量具有一些重要的性质,如线性无关性、正交性等。

特征值和特征向量在计算机科学、物理、工程和其他领域中有广泛的应用。

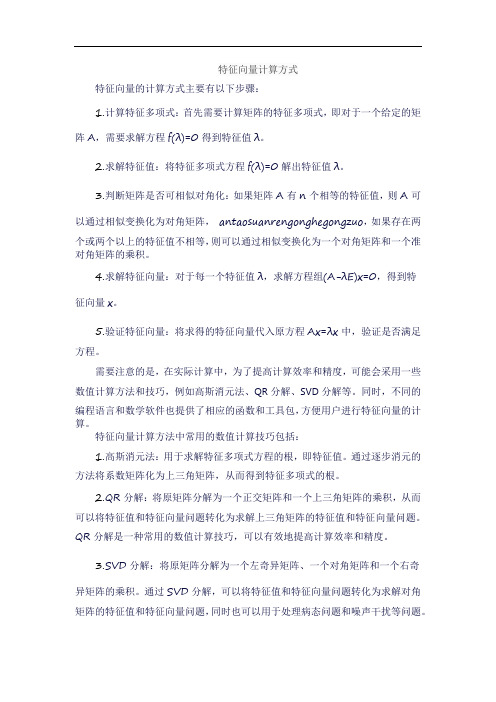

特征向量计算方式

特征向量计算方式特征向量的计算方式主要有以下步骤:1.计算特征多项式:首先需要计算矩阵的特征多项式,即对于一个给定的矩阵A,需要求解方程f(λ)=0得到特征值λ。

2.求解特征值:将特征多项式方程f(λ)=0解出特征值λ。

3.判断矩阵是否可相似对角化:如果矩阵A有n个相等的特征值,则A可以通过相似变换化为对角矩阵,antaosuanrengonghegongzuo,如果存在两个或两个以上的特征值不相等,则可以通过相似变换化为一个对角矩阵和一个准对角矩阵的乘积。

4.求解特征向量:对于每一个特征值λ,求解方程组(A-λE)x=0,得到特征向量x。

5.验证特征向量:将求得的特征向量代入原方程Ax=λx中,验证是否满足方程。

需要注意的是,在实际计算中,为了提高计算效率和精度,可能会采用一些数值计算方法和技巧,例如高斯消元法、QR分解、SVD分解等。

同时,不同的编程语言和数学软件也提供了相应的函数和工具包,方便用户进行特征向量的计算。

特征向量计算方法中常用的数值计算技巧包括:1.高斯消元法:用于求解特征多项式方程的根,即特征值。

通过逐步消元的方法将系数矩阵化为上三角矩阵,从而得到特征多项式的根。

2.Q R分解:将原矩阵分解为一个正交矩阵和一个上三角矩阵的乘积,从而可以将特征值和特征向量问题转化为求解上三角矩阵的特征值和特征向量问题。

QR分解是一种常用的数值计算技巧,可以有效地提高计算效率和精度。

3.S VD分解:将原矩阵分解为一个左奇异矩阵、一个对角矩阵和一个右奇异矩阵的乘积。

通过SVD分解,可以将特征值和特征向量问题转化为求解对角矩阵的特征值和特征向量问题,同时也可以用于处理病态问题和噪声干扰等问题。

4.迭代法:对于一些难以直接求解的特征值和特征向量问题,可以采用迭代法进行求解。

例如,使用Jacobi迭代法或Gauss-Seidel迭代法等迭代方法来逼近特征值和特征向量。

5.数值稳定性和误差控制:在特征向量计算中,需要注意数值稳定性和误差控制。

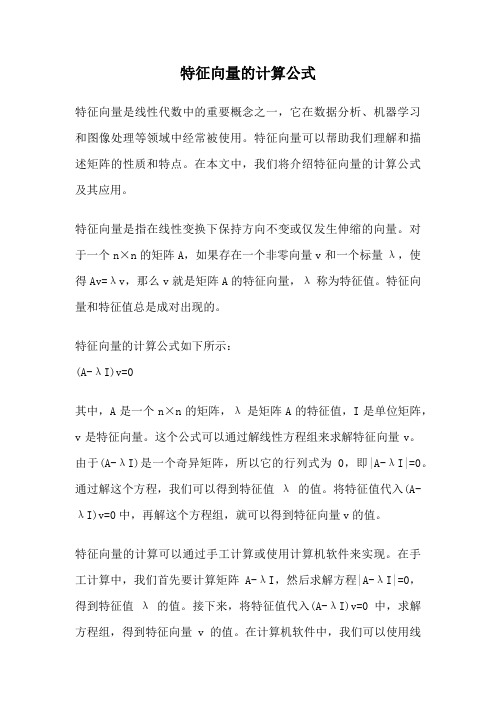

特征向量的计算公式

特征向量的计算公式特征向量是线性代数中的重要概念之一,它在数据分析、机器学习和图像处理等领域中经常被使用。

特征向量可以帮助我们理解和描述矩阵的性质和特点。

在本文中,我们将介绍特征向量的计算公式及其应用。

特征向量是指在线性变换下保持方向不变或仅发生伸缩的向量。

对于一个n×n的矩阵A,如果存在一个非零向量v和一个标量λ,使得Av=λv,那么v就是矩阵A的特征向量,λ称为特征值。

特征向量和特征值总是成对出现的。

特征向量的计算公式如下所示:(A-λI)v=0其中,A是一个n×n的矩阵,λ是矩阵A的特征值,I是单位矩阵,v是特征向量。

这个公式可以通过解线性方程组来求解特征向量v。

由于(A-λI)是一个奇异矩阵,所以它的行列式为0,即|A-λI|=0。

通过解这个方程,我们可以得到特征值λ的值。

将特征值代入(A-λI)v=0中,再解这个方程组,就可以得到特征向量v的值。

特征向量的计算可以通过手工计算或使用计算机软件来实现。

在手工计算中,我们首先要计算矩阵A-λI,然后求解方程|A-λI|=0,得到特征值λ的值。

接下来,将特征值代入(A-λI)v=0中,求解方程组,得到特征向量v的值。

在计算机软件中,我们可以使用线性代数库来进行计算,比如使用NumPy库中的eig函数。

特征向量具有很多应用。

首先,特征向量可以帮助我们理解和描述矩阵的性质和特点。

通过计算特征向量,我们可以了解矩阵的主要特征和变换规律,从而更好地理解和分析数据。

其次,特征向量在机器学习中被广泛应用。

在特征提取和降维等任务中,特征向量可以作为重要的特征表示,帮助我们提取和选择最具代表性的特征。

此外,在图像处理中,特征向量可以用来描述图像的纹理、形状和颜色等特征,从而实现图像的分析和识别。

总结一下,特征向量是线性代数中的重要概念,它可以帮助我们理解和描述矩阵的性质和特点。

特征向量的计算公式是(A-λI)v=0,通过解这个方程组可以求解特征向量。

特征值与特征向量的求法总结

特征值与特征向量的求法总结特征值与特征向量是线性代数中的重要概念,广泛应用于各个领域的数学和工程问题中。

在本文中,我们将总结特征值与特征向量的求法,并介绍它们的应用。

一、特征值与特征向量的定义在矩阵理论中,给定一个n阶方阵A,如果存在一个非零向量x,使得Ax与x的线性关系为Ax=λx,其中λ为常数,则称λ为矩阵A的特征值,x为对应于特征值λ的特征向量。

二、特征值与特征向量的求法要求解矩阵A的特征值和特征向量,需要解决以下问题:1. 求解特征值:设特征值为λ,需要解决方程|A-λI|=0,其中I为单位矩阵。

这个方程称为特征方程,其解即为矩阵A的特征值。

2. 求解特征向量:已知特征值λ后,需要求解方程(A-λI)x=0的非零解,其中x为特征向量。

这个方程组称为特征方程组,其解即为矩阵A的特征向量。

特征值和特征向量的求解可以通过以下步骤进行:1. 求解特征值:解特征方程|A-λI|=0,得到特征值λ1, λ2, ..., λn。

2. 求解特征向量:将每个特征值代入方程组(A-λI)x=0,解得对应的特征向量x1, x2, ..., xn。

三、特征值与特征向量的应用特征值与特征向量在许多领域中都有重要的应用,下面我们介绍几个常见的应用场景:1. 特征值分解:特征值分解是将一个矩阵分解为特征值和特征向量的乘积的形式,常用于矩阵的对角化和求解矩阵的幂等问题。

2. 主成分分析:主成分分析是一种常用的数据降维技术,通过计算协方差矩阵的特征值和特征向量,将原始数据转换为新的特征空间,以实现数据的降维和特征提取。

3. 图像处理:特征值与特征向量在图像处理中有着广泛的应用,如图像压缩、图像去噪、图像特征提取等。

4. 控制系统分析:在控制系统中,特征值与特征向量可以用于分析系统的稳定性和响应特性,如振荡频率、阻尼比等。

5. 网络分析:特征值与特征向量在网络分析中有着重要的作用,例如用于社交网络中节点的中心性分析、网络的连通性分析等。

特征值对应的特征向量怎么算

特征值对应的特征向量怎么算

通常求特征值和特征向量即为求出该矩阵能使哪些向量(当然是特征向量)只发生拉伸,使其发生拉伸的程度如何(特征值大小)。

这样做的意义在于看清一个矩阵在那些方面能产生最大的效果,并根据所产生的每个特征向量(一般研究特征值最大的那几个)进行分类讨论与研究。

1、求特征向量:

一旦找到特征值λ,相应的特征向量可以通过求解特征方程(A –λI)v=0得到,其中v为待求特征向量,I为单位阵。

没有实特征值的一个矩阵的例子是顺时针旋转90度。

2、数值计算:

在实践中,大型矩阵的特征值无法通过特征多项式计算,计算该多项式本身相当费资源,而精确的“符号式”的根对于高次的多项式来说很难计算和表达:阿贝尔-鲁费尼定理显示高次(5次或更高)多项式的根无法用n次方根来简单表达。

对于估算多项式的根的有效算法是有的,但特征值的小误差可以导致特征向量的巨大误差。

求特征多项式的零点,即特征值的一般算法,是迭代法。

最简单的方法是幂法:取一个随机向量v,然后计算一系列单位向量。

这个序列几乎总是收敛于绝对值最大的特征值所对应的特征向量。

这个算法很简单,但是本身不是很有用。

但是,像QR算法这样的算法正是以此为基础的。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

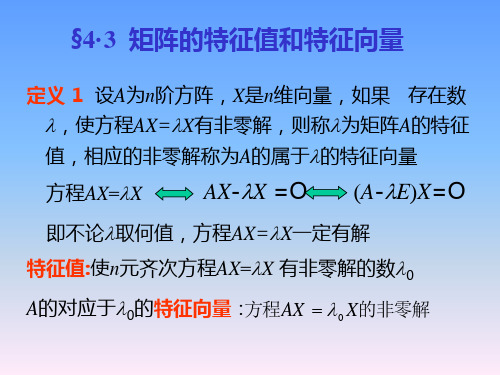

定义 1 设A为n阶方阵,X是n维向量,如果 存在 数λ,使方程AX=λX有非零解,则称λ为矩阵A的特 征值,相应的非零解称为A的属于λ的特征向量 方程AX=λX

AX-λX =O

(A-λE)X=O

即不论λ取何值,方程AX=λX一定有解 特征值: 特征值:使n元齐次方程AX=λX 有非零解的数λ0 A的对应于λ0的特征向量 方程AX = λ0 X的非零解 特征向量: 特征向量

1、求n阶方阵 的特征值: 、 阶方阵A的特征值 阶方阵 的特征值:

数λ0是A的特征值

λ0使方程AX= λX有非零解

λ 0 使方程( A λE )X = O有非零解

A λE = 0

n元齐次方程组 ( A λE )X = O有非零解

因此 :λ0是A的特征值 的特征值步骤: 求A的特征值步骤: 的特征值步骤 (1) 计算n阶行列式

2、求A的属于特征值λ的特征向量 、 的属于特征值

设λi是A的特征值,则方程AX=λi , X有非零解. 即方程(A-λiE)X=O有非零解, A的对应于特征值λi的特征向量: 方程组(A-λiE)X=O的全部非零解

步骤:1)把 λ= λi代入方程(A-λiE)X=O 得一齐次线性方程组(A-λiE)X=O 2)求出(A-λiE)X=O的一个基础解系 V1、V2、…、Vs 3) A的属于特征值λi 的特征向量为: c1V1 + c2V2 + L+ csVs c1 , c2 ,L, cs 是不全为零任意常数

a12 L a1n a2 n L A11 A21 = L An1 a21 L an1 = a22 λ L L L an 2

ann λ a1n a2n L

a11 λ A λE =

A12

L

A1n

A22 L A2 n L L L An 2 L Ann

L ann λ

τ ( j1 j2 L jn )

3 1 例如:对 A = 5 1 ,取

λ=4,代入方程AX= λX

得 AX= 4X

Q 3 A 4E = 5

(A-4E)X=O

1 4 1 0

1 5

0 1 = 4 5

0 = 0

1 5

(A-4E)X= O

1 x1 5 x 2

x1 + x 2 0 5x 5x = 0 2 1

r 即 ai 是方程 AX = λi X 的非零解 r r r 即有Aai = λi ai ,且 ai ≠ 0 r r r a 要证: 1 , a2 ,LL , am 线性无关

设: 1α1 + x2α2 +L+ xmαm = 0 x

在(1)式两边左乘A,得

A( x1α1 + x2α2 +L+ xmαm ) = 0

x1 1 0 分别取 , x 0 1 3

x2 = 2x1 2x3

1 0 V2 = 2,V3 = 2 0 1

令

,得基础解系

于是,A的属于λ2=λ3 = 7的全部特征向量为:

1 0 c2V2 + c3V3 = c2 2 + c3 2 0 1

2 8 2

4 x1 0 2 x 2 = 0 5 x 3 0

4 0 18 1 0 9 0 0 ` → 0 1 0 0 2 0 2 0 0 1 0 0 0

0 1 0 → 0 0 0

5 2 A = 2 8 4 2

4 0 1 → 0 2 0 0 5 0

A λE = fn (λ)

A的特征多项式 A的特征方程

方程 A λE = 0

定义 2 设A为n阶方阵, λ1 , λ2 ,LL , λm } 为其特征值组, { 则其特征方程可表示为:

( λ λ1 ) ( λ λ2 )

k1

k2

LL ( λ λm )

km

=0

则ki称为 λi的代数重数(重数),而λi 特征子空间的维数 称为几何重数(度数)。

得 λ1 =-2, λ 2 = λ 3= 7(二重根) 则A的特征值为λ 1 =-2,λ 2 = λ 3= 7 把λ1 =-2代入方程(A-λE)X=O ,得 (A +2E)X=O

5 A = 2 4 2 8 2 4 2 5 0 1 0 → 2 4 0

5 2 4

4 8 2 1 2 5

3 2 4 A = 2 6 2 4 2 3

2 6λ 2 4 3λ 3λ 7 + λ 2 = 2

的特征值与特征向量

2 6λ 0 4 7 λ 3 λ 7 + λ 2 6λ 0

2

1 λ 4 0

2 = 2

= ( 7 + λ ) 8 ( 1 λ )( 6 λ ) = ( 2 λ )( 7 λ )

( 2 )令 A λ E = 0

λ0使 A λE = 0成立 λ 0 是特征方程 A λE = 0的根

A λE

解得方程的根λ1,λ2,… ,λn, 则λ1, λ2,… ,λn即是A的特征值

a11 a21 设 A= L a n1

a12 L a1n a11 λ a12 L a22 L a2n a21 a22 λ L AλE = L L L L L L an2 L an2 L ann an1

2 0 2

0 0 1

0 0 0

x1 2x2 = 0 2x2 + x3 = 0

x1 = 2x2 x3 = 2x2

取 x2 = 1

2 ,得一基础解系 V1 = 1 2

于是,A的属于λ1=-2的全部特征向量为:

2 c1V1 = c1 1 , (c1 ≠ 0 ) 2

把λ2 = λ3= 7代入方程(A-λE)X=O ,得 (A -7E)X=O

3x1 + x2 = 0 4x1 + x2 = 0 x =0 1

3 4 1 1 1 0 0 x1 0 x 2 0 x 3 0 = 0 0

x1 =0 x2 =0

把λ2= λ3= 1代入方程(A- λE)X=O ,得 (A-E)X=O

2 4 1 1 2 0

0 于是,A的属于λ1 =2的全部特征向量为:c1V1 = c10,(c1 ≠ 0) 1

0 x1 0 0 x 2 = 0 1 x 3 0

取 x3 = 1

0 ,得一基础解系V1 = 0 1

2 1 0 0 2 1 0 0 行变换 0 0 0 0 A = 4 2 0 0 1 0 1 0 1 0 1 0

λ1 x1 λ1α 1 + λ 2 x 2 λ 2α 2 + L + λ m x m λ mα m = 0

λ1 x1α 1 + λ 2 x 2α 2 + L + λ m x mα m = 0

2 2 2

(3)

x 1α 1 + x 2 α

2 2

2

+ L + x mα

2

m

= 0

λ 1 x 1α 1 + λ 2 x 2α 2 + L + λ m x m α m = 0

λ1 x1α 1 + λ 2 x 2α 2 + L + λ m x m α m = 0 λ1

m 1

(1) (2) (3) (m)

x1α 1 + λ 2

M

m 1

x 2α 2 + L + λ m

m 1

x mα m = 0

做矩阵乘积:

1 1 λ2 λ1 L L m1 λ1 λ2m1 L 1 x1α1' x1α1' 0 ' ' L λm x2α2 x2α2 = 0 =B M M L L M m1 x α ' x α ' 0 L λm m m m m

证(1):kλ是 kA的特征值 因为 α是A的属于λ的特征向量, 即α是方程AX=λX的非零解, 所以有 Aα=λα 且α≠0 要证方程(kA)X=(kλ)X 有非零解 因为(kA)α =k(Aα) =k (λα) =(kλ)α 且α≠0 ,所以α是方程kAX=kλX的非零解 kλ是 kA的特征值

4 2 4 2 1 2

2 0 0 0 0 0

4 x1 0 2 x 2 = 0 4 x 3 0

4 2 4 0 2 A = 2 1 2 0 → 0 4 2 4 0 0

1 0 0

2 x1 + x 2 + 2 x 3 = 0

证(3)当A可逆时,λ≠0,且λ-1是A-1的特征值 先证当A可逆时, λ≠0: 反证:若不然,λ=0 由Aα= λα ,得Aα=0 因为A可逆,两边左乘A-1 ,得α=0。矛盾 再证λ-1是A-1的特征值: 因为 Aα=λα, 两边左乘A-1 ,得

di = dim Vi 显然: k1 + k2 + LL + km = n

di <= ki

2 【例1】求 A = 5

3 的特征值 4

3 4λ

解: A λ E =

2λ 5

= ( 2 λ )( 4 λ ) 15 = λ 2 6λ 7

令 A λ E = 0 , 得 λ1 =-1,λ2 =7 则A的特征值为λ1 =-1,λ2 =7

, (c2 , c3不全为零)

定理 1 n阶方阵A的不同特征值对应的特征向量线性 无关。 即 若α 1 是属于特征值λ1 的特征向量 α 2 是属于特征值λ2的特征向量 且λ1 ≠λ2 ,则α 1 与 α 2 线性无关

证明:设λ1、λ2 、…、λm是A的m个不同的特征值, α1、α2、 … αm是分别属于λ1、λ2 、…、λm 的特征向量,

x1 + x2 = 0 5x1 5x2 = 0

x1 + x2 = 0

有非零解