牛顿法

牛顿法和拟牛顿法

解:

f x1

26

x1

x2

22

3 x1

3 x2

x1 x2 3

x2

f x2

26

x1

x2

2 2 3 x1

3x2

x1 x2 3

x1

故

f x1 x 4,6T

344,

f x2

x 4,6T

56,

f

(

x1

)

344 56

.

2 f x12

2 23

x2 2 ,

2 f x22

在确定拟牛顿方程式的Hk+1时,若矩阵Hk+1对称,则需 要待定(n+n2)/2个未知数,n个方程,所以拟牛顿方程 一般有无穷个解,故由拟牛顿方程确定的一族算法,通 常称之为拟牛顿法

拟Newton算法

1、给定初始点x0,正定矩阵H0,精度ε>0,k=0 2、计算搜索方s向k Gk f(x k ) 3、令xk+1=xk+tk.sk,其中

当H 可逆时, k

若 f(x k 1)

,停止x*

xkx+k11=;否xk则-H,k-令1.hk k

k

1,转step2

Step4:

例1. 设 f x 6 x1 x2 2 + 2 3 x1 3 x2 x1 x2 2

求在点 x1 (4, 6)T 处的搜索方向.

分析: 搜索方向

故需要写出 f ( x), 2 f ( x) 的表达式.

Sk

-H

1 k

hk

k 1

其中

H k 2f(x(k )) hk f(x(k ))

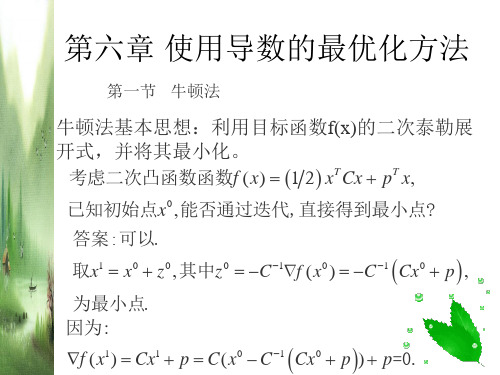

1.牛顿法几何解释

几何直观解释:最密切的二次曲线逼近

牛顿法求平方根

牛顿法求平方根牛顿法是一种数学的迭代求根方法,其可以用来求解非线性方程的根以及平方根。

在计算机科学和数值计算中,牛顿法也有着重要的应用。

一、牛顿法的数学原理牛顿法求解非线性方程的根,是以函数f(x)的定义域内一个初值x0为基础,假设函数f(x)在x0处具有可微分性,那么函数在x0处的一阶导数f’(x0)可以构建一个泰勒展开式:f(x)=f(x0)+f’(x0)×(x-x0)泰勒展开式也即是牛顿法采用的近似计算函数,它假定根所在区域内函数近似为一阶函数,这样可以忽略其他更高阶的项,而得到近似的函数值。

假定牛顿法误差小于某一限度,牛顿法的求根公式,也称为牛顿迭代公式,有:xn=xn-1-f(xn-1)/f’(xn-1)该公式可以用来求解方程f(x)=0的解,牛顿法的求根原理是以上的迭代公式,即以初始点x0开始,用恒等式右边的值来代替当前的函数值f(xn-1),即可获得新的xn,新的x值也就是接近根的点,将这样迭代,直到所求函数的根。

二、牛顿法求平方根牛顿法求解非线性方程的根,也可以用来求取某个数的平方根,具体的做法为,首先令f(x)=x2-a=0,其中a是需要求解的数的平方,计算函数f(x)的导数f’(x)=2x,以x0=a/2为初始值,求解f(x)=0,使用牛顿法可以得到x(n+1)=xn-f(xn) / f’(xn)=xn-(xn2-a)/2xn=1/2 (xn+a/xn) (n=0,1,2...)根据牛顿法的收敛性质,可以认为当n→∞时,xn→x(即a的平方根),根据上述求解步骤,可以实现一个求平方根的数值算法。

三、牛顿法求平方根的数值算法1.定一个解的初始值x0,令x0=a/2;2.算f(x0)和f’(x0);3.用牛顿法迭代公式得到新的xn;4.算f(xn)和f’(xn),再重复步骤3;5.复上述步骤,直到收敛条件满足,得出所求的解。

四、牛顿法求平方根的优缺点1.顿法求解非线性方程的根以及平方根的的优点:(1)牛顿法是一种快速收敛的数值求根方法,迭代次数小,计算简单;(2)它可以用来求解实数的根,复数的根,和多元函数的根,只要改变初值x0;(3)它可以求解一般不存在解析解的非线性方程组和非欧几里得函数的根;2.顿法求解非线性方程的根以及平方根的缺点:(1)当确定初始值x0时要慎重,因为当初值x0距所求解的距离太近时,方程的迭代精度将会受到影响;(2)牛顿法对函数f(x)的可微分性有一定的要求;(3)当f(x)的导数在某一点上不存在时,牛顿法不能收敛到有限精度解上。

牛顿法

牛顿法牛顿法(英语:Newton's method)又称为牛顿-拉弗森方法(英语:Newton-Raphson method),它是一种在实数域和复数域上近似求解方程的方法。

方法使用函数的泰勒级数的前面几项来寻找方程的根。

起源:牛顿法最初由艾萨克·牛顿在《流数法》(Method of Fluxions,1671年完成,在牛顿去世后的1736年公开发表)中提出。

约瑟夫·鲍易也曾于1690年在Analysis Aequationum中提出此方法。

原理:二阶逼近牛顿法对局部凸函数找到极小值,对局部凹函数找到极大值,对局部不凸不凹函数可能找到鞍点牛顿法要求估计二阶导数。

牛顿法据称比直接计算要快了4 倍。

其中的两次迭代(第二步迭代被注释掉了)就是用的牛顿法来求解方程,也就是的根。

牛顿法的思想其实很简单,给定一个初始点,使用在该点处的切线来近似函数,然后寻找切线的根作为一次迭代。

比如对于这个例子,令,给定初始点,在该点处的导数是,由此可以得到该处的切线为,求解得到正是代码中的迭代。

当然代码的重点其实不在这里,而在0x5f3759df这个奇怪的magic number,用于得到一个好的初始点。

这个神奇的数字到底是谁发现的,根据wikipedia 上的说法似乎至今还没有定论。

xkcd 还为此画了一条漫画,讽刺说每次我们惊奇地发现工业界里不知道哪个无名人士写出了0x5f3759df之类的神奇数字,背后都有成千上万的其他无名人士我们无从知晓,说不定他们中的某一个人已经解决了P=NP 的问题,但是那人却还在调某个自动打蛋器的代码所以我们至今仍无知晓。

:D回到我们今天的话题,从这段代码中我们可以看到两点:牛顿法收敛非常快,对于精度要求不是特别高的情况,比如上面的图形学相关的计算中,甚至只用了一次计算迭代。

另一方面,初始值的选取非常重要,我们接下去将会看到,初始值选得不好有可能会直接导致算法不收敛。

牛顿法和梯度下降法的区别

牛顿法和梯度下降法的区别牛顿法和梯度下降法是优化算法中常用的两种方法,它们都可以用来求解目标函数的最小值。

然而,这两种方法的思路和实现方式有所不同,下面我们来详细介绍它们之间的区别。

1. 算法思路牛顿法是一种基于二阶泰勒展开的优化算法,其核心思想是通过不断更新当前点的位置,使得目标函数的值不断逼近最小值点。

具体来说,牛顿法会使用目标函数的一阶和二阶导数信息来更新当前点的位置,以求得最小值。

梯度下降法则是一种基于一阶导数的优化算法,其核心思想是通过不断沿着负梯度方向迭代,使得目标函数的值不断逼近最小值点。

具体来说,梯度下降法会在每个迭代步骤中计算目标函数的梯度向量,并将其乘上一个小的学习率,从而更新当前点的位置。

2. 迭代效率由于牛顿法需要同时计算目标函数的一阶和二阶导数,因此每次迭代的计算量较大。

这意味着在处理大规模数据集时,牛顿法的迭代速度可能会受到限制。

而梯度下降法只需要计算目标函数的一阶导数,因此其每次迭代的计算量相对较小,适用于处理大规模数据集。

3. 算法收敛性牛顿法收敛速度较快,在很少的迭代次数内就可以得到较好的结果。

但是,在某些情况下,牛顿法可能会出现病态条件,导致算法无法收敛。

而梯度下降法则是一种更加鲁棒的方法,在大多数情况下都可以得到收敛的结果。

4. 初始点的影响牛顿法对于初始点的选择比较敏感,不同的初始点可能会导致算法找到不同的极值点。

而梯度下降法则对于初始点的选择不太敏感,因为算法会沿着负梯度方向不断迭代,最终找到局部最优解。

综上所述,牛顿法和梯度下降法在优化算法中都扮演着重要的角色。

选择哪种方法取决于具体的应用场景和需求。

如果需要快速求解目标函数的最小值,并且数据量不大,牛顿法可能是一个不错的选择。

如果需要处理大规模数据集,并且希望算法能够快速收敛,那么梯度下降法则是更加适合的方法。

牛顿法

牛顿迭代法编辑同义词牛顿法一般指牛顿迭代法牛顿迭代法(Newton's method)又称为牛顿-拉夫逊(拉弗森)方法(Newton-Raphson method),它是牛顿在17世纪提出的一种在实数域和复数域上近似求解方程的方法。

中文名牛顿迭代法外文名Newton's method别名牛顿-拉夫逊(拉弗森)方法提出时间17世纪目录1 产生背景2 牛顿迭代公式3 其他迭代算法▪欧几里德算法▪斐波那契数列4 C语言代码5 C++代码6 matlab代码▪定义函数▪主程序7 Python代码8 Java代码9 JavaScript代码10 Fortran代码产生背景编辑多数方程不存在求根公式,因此求精确根非常困难,甚至不可解,从而寻找方程的近似根就显得特别重要。

方法使用函数的泰勒级数的前面几项来寻找方程的根。

牛顿迭代法是求方程根的重要方法之一,其最大优点是在方程的单根附近具有平方收敛,而且该法还可以用来求方程的重根、复根,此时线性收敛,但是可通过一些方法变成超线性收敛。

另外该方法广泛用于计算机编程中。

牛顿迭代公式编辑设是的根,选取作为的初始近似值,过点做曲线的切线,,则与轴交点的横坐标,称为的一次近似值。

过点做曲线的切线,并求该切线与x轴交点的横坐标,称为r的二次近似值。

重复以上过程,得的近似值序列,其中,称为的次近似值,上式称为牛顿迭代公式。

用牛顿迭代法解非线性方程,是把非线性方程线性化的一种近似方法。

把在点的某邻域内展开成泰勒级数,取其线性部分(即泰勒展开的前两项),并令其等于0,即,以此作为非线性方程的近似方程,若,则其解为,这样,得到牛顿迭代法的一个迭代关系式:。

已经证明,如果是连续的,并且待求的零点是孤立的,那么在零点周围存在一个区域,只要初始值位于这个邻近区域内,那么牛顿法必定收敛。

并且,如果不为0, 那么牛顿法将具有平方收敛的性能. 粗略的说,这意味着每迭代一次,牛顿法结果的有效数字将增加一倍。

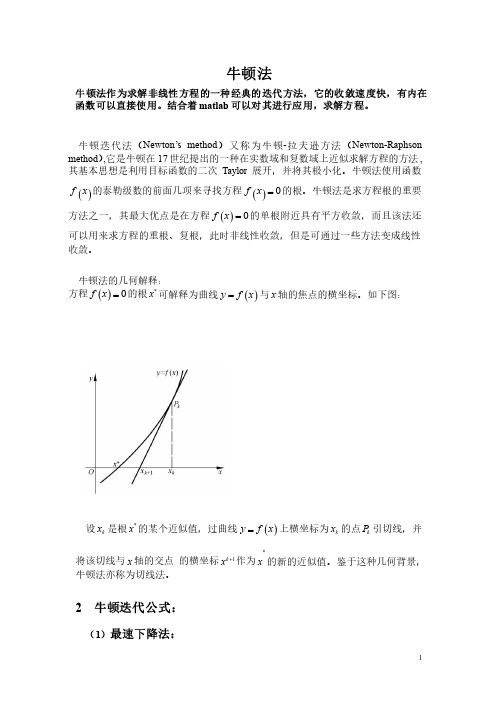

最优化理论与方法——牛顿法

牛顿法牛顿法作为求解非线性方程的一种经典的迭代方法,它的收敛速度快,有内在函数可以直接使用。

结合着matlab 可以对其进行应用,求解方程。

牛顿迭代法(Newton Newton’’s s method method )又称为牛顿-拉夫逊方法(Newton-Raphson method ),它是牛顿在17世纪提出的一种在实数域和复数域上近似求解方程的方法,其基本思想是利用目标函数的二次Taylor 展开,并将其极小化。

牛顿法使用函数()f x 的泰勒级数的前面几项来寻找方程()0f x =的根。

牛顿法是求方程根的重要方法之一,其最大优点是在方程()0f x =的单根附近具有平方收敛,而且该法还可以用来求方程的重根、复根,此时非线性收敛,但是可通过一些方法变成线性收敛。

收敛。

牛顿法的几何解释:牛顿法的几何解释:方程()0f x =的根*x 可解释为曲线()y f x =与x 轴的焦点的横坐标。

如下图:轴的焦点的横坐标。

如下图:设k x 是根*x 的某个近似值,过曲线()y f x =上横坐标为k x 的点k P 引切线,并将该切线与x 轴的交点轴的交点 的横坐标1k x +作为*x 的新的近似值。

鉴于这种几何背景,牛顿法亦称为切线法。

牛顿法亦称为切线法。

2 牛顿迭代公式:(1)最速下降法:x-d gk k×Gg sks×GGd 101x x x -(1)令k k G v I k G -=+,其中:,其中:0k v =,如果k G 正定;0,k v >否则。

否则。

(2)计算_k G 的Cholesky 分解,_T k k k k G L D L =。

(3)解_k k G d g =-得k d 。

(4)令1k k k x x d +=+牛顿法的优点是收敛快,缺点一是每步迭代要计算()()'k k f x f x 及,计算量较大且有时()'k fx 计算较困难,二是初始近似值0x 只在根*x附近才能保证收敛,如0x 给的不合适可能不收敛。

牛顿法求零点的方法

牛顿法求零点的方法牛顿法,也被称为牛顿-拉弗逊方法,是一种用于求解方程零点或找到函数极值的迭代方法。

下面将展开详细描述50条关于牛顿法求零点的方法:1. 函数定义:牛顿法需要求解的函数f(x)在某一区间内具有连续的一阶和二阶导数。

2. 选择初始值:从初始值x₀开始迭代求解,初始值的选取对收敛速度有重要影响。

3. 迭代公式:根据牛顿法的迭代公式xᵢ₊₁ = xᵢ - f(xᵢ)/f'(xᵢ)进行迭代计算,直至满足精度要求。

4. 收敛性分析:对于给定初始值,需要分析函数性质,判断牛顿法求解是否会收敛到目标零点。

5. 判断收敛:通过设定迭代次数限制或者迭代精度要求来判断牛顿法的求解是否已经收敛。

6. 求解零点:当收敛判据满足后,将得到一个近似的函数零点作为结果输出。

7. 牛顿法的收敛速度:根据函数的性质和初始值的选择来分析牛顿法的收敛速度,可以采取一些加速收敛的方法来提高求解效率。

8. 收敛域的设定:针对特定的函数,可以设定合适的收敛域,加快算法的收敛速度。

9. 牛顿法的误差分析:对于连续函数,可分析牛顿法的误差收敛性,了解迭代逼近零点的精确度。

10. 稳定性分析:牛顿法的稳定性受初始值和函数性质的影响,需要进行稳定性分析,确保算法的可靠性。

11. 牛顿法的优化:可以对牛顿法进行改进,减小迭代次数或增加收敛速度,提高算法的效率。

12. 牛顿法与其他方法的比较:分析牛顿法与二分法、割线法等其他求根方法的优劣,选择合适的方法来求解。

13. 牛顿法的推广:对于多元函数或非线性方程组,可以推广牛顿法来求解多元函数的零点。

14. 牛顿法的受限条件:在实际应用中,需要考虑函数的定义域和受限条件,对牛顿法进行适当的调整。

15. 牛顿法的数值稳定性:需要考虑数值计算过程中的舍入误差和数值不稳定性,保证计算结果的准确性。

16. 牛顿法的局部收敛性:牛顿法的局部收敛性可能受到函数的振荡和奇点等因素的影响,需要加以分析和处理。

第5章4节牛顿法

二是初始近似 x0 只在根 x *附近才能保证收敛,如

x0 给的不合适可能不收敛.

为克服这两个缺点,通常可用下述方法.

13

牛顿下山法. 牛顿法收敛性依赖初值 x0 的选取.

如果 x0 偏离所求根 x *较远,则牛顿法可能发散.

解 取初值 x0 10,对 按牛顿迭代公式迭代3 C 115 次 便得到精度为

10 6

2 3 4

的结果

1 C ( xk ). 2 xk

12

(见表5-6).

xk 1

3

牛顿下山法

牛顿法的优点是收敛快,缺点一是每步迭代要计算

f ( xk )及 f ( xk ) ,计算量较大且有时 f ( xk ) 计算较困难,

2

10

再讨论全局收敛性 1)当C>1时,f(x)=x2-C在[1,C]上满足全 局收敛性定理5,迭代法在[1,C]上全局收 敛。 2)当C<1时, f(x)=x2-C在[C,1]上满足全局 收敛性定理5,迭代法在[C,1]上全局收敛。

11

例8

求 115 .

表5 6 计算结果 k 0 1 xk 10 10.750000 10.723837 10.723805 10.723805

于是方程 f ( x) 0 可近似地表示为

f ( xk ) f ( xk )( x xk ) 0.

1

这是个线性方程,记其根为 xk 1 , 则 xk 1 的计算公式为

xk 1 xk f ( xk ) f ( xk ) ( k 0,1, ),

这就是牛顿(Newton)法. 牛顿法的几何解释. 方程 f ( x) 0 的根 x *可解释为 曲线 y f ( x) 与 x轴的交点的横坐标 (图5-3). 图5-3

简化牛顿法与牛顿下山法的比较

简化牛顿法与牛顿下山法的比较1.引言1.1 概述牛顿法和牛顿下山法都是用于求解方程根或最优化问题的常用数值计算方法。

牛顿法是一种迭代方法,通过使用函数的一阶和二阶导数来找到函数的零点或最小值。

而牛顿下山法则是对牛顿法的改进,在每次迭代时引入一个步长参数,以便更快地接近最优解。

在牛顿法中,我们首先需要给定一个初始猜测值,然后通过使用函数的一阶导数和二阶导数来更新猜测值,直到找到函数的零点或最小值。

牛顿法的优点在于其收敛速度较快,在适当的初始化条件下,通常能够快速找到解。

然而,牛顿法也存在局限性,例如可能出现迭代过程发散的情况,并且在某些情况下需要计算复杂的二阶导数。

与之相比,牛顿下山法在牛顿法的基础上引入了步长参数。

通过在每次迭代时选择合适的步长,可以更快地接近最优解。

牛顿下山法的优点在于其对初值的选择较为不敏感,即使初始猜测值较远离最优解,也能够通过适当的步长控制方法逐渐逼近最优解。

然而,牛顿下山法也存在局限性,例如可能会陷入局部最小值而无法找到全局最小值。

综上所述,牛顿法和牛顿下山法都是求解方程根或最优化问题的常用方法。

牛顿法适用于已知初始猜测值较接近最优解的情况,而牛顿下山法适用于对初始猜测值较不确定的情况。

根据具体的问题要求和初始条件,可以选择合适的方法来进行数值计算。

1.2文章结构文章结构是指文章的框架和组织方式,用于展示文章中各个部分之间的逻辑关系。

本文旨在比较简化牛顿法和牛顿下山法,因此文章的结构应该清晰地展示这两种方法的差异和优劣,同时对它们进行详细的介绍和分析。

下面是文章1.2部分的内容:1.2 文章结构在本文中,我们将按照以下结构来比较简化牛顿法和牛顿下山法:1.2.1 算法原理:- 简化牛顿法的算法原理:该部分将详细介绍简化牛顿法的基本思想和计算步骤,包括如何利用一阶导数和二阶导数进行迭代优化。

- 牛顿下山法的算法原理:这部分将详细介绍牛顿下山法的基本原理,包括如何结合简化牛顿法和线性搜索,在每次迭代中选择合适的下降方向。

牛顿法推导过程

牛顿法是一种用于求解方程的数值解法。

其基本思想是通过迭代的方式,不断逼近方程的根。

下面是牛顿法的推导过程:假设当前迭代的解为x,则根据泰勒展开式,方程f(x) 在点x 处的近似值为:f(x) ≈ f(x0) + f'(x0)(x - x0)其中,x0 为初始点,f'(x0) 为方程在点x0 处的导数值。

将上式带入求解方程f(x) = 0 的条件,得到:f(x0) + f'(x0)(x - x0) = 0化简得:x = x0 - f(x0) / f'(x0)这就是牛顿法的关键步骤——牛顿迭代公式。

迭代过程:选取初始点x0,计算x1 = x0 - f(x0) / f'(x0)。

若|x1 - x0| < ε(ε 为指定的精度),则停止迭代,认为x1 是方程的近似根。

否则,令x0 = x1,重复步骤1。

例如,求解方程f(x) = x² - 3x + 2 = 0 的根,则可以采用如下步骤:选取初始点x0,计算x1 = x0 - f(x0) / f'(x0)。

例如,设x0 = 1,则x1 = x0 - f(x0) / f'(x0) = 1 - (1² - 3 × 1 + 2) / (2 × 1) = 1 - (-2) / 2 = 3 / 2。

判断迭代是否结束。

若|x1 - x0| < ε,则停止迭代,认为x1 是方程的近似根;否则,令x0 = x1,重复步骤1。

以上是牛顿法的推导过程。

在实际应用中,可以根据需要设定合适的初始点x0 和精度ε,进行迭代求解方程的根。

Newton-Raphson算法

Newton-Raphson算法简介⽜顿法⼜叫做⽜顿-拉裴森(Newton-Raphson)⽅法,是⼀维求根⽅法中最著名的⼀种。

其特点是在计算时需要同时计算函数值与其⼀阶导数值,从⼏何上解释,⽜顿法是将当前点处的切线延长,使之与横轴相交,然后把交点处值作为下⼀估值点。

图1从数学上解释,⽜顿法可以从函数的泰勒展开得到。

f(x)的泰勒展开可以表⽰为:f(x+\delta)=f(x)+f’(x)\delta+\frac{f’’(x)}{2}\delta^2+O(\delta^3)对于⾜够⼩的\delta,可以将只保留上式右端关于的⼀阶项,得到:\delta=-\frac{f(x)}{f’(x)}于是得到由到的递推公式:x_{i+1}=x_{i}+\delta=x_i-\frac{f(x_i)}{f’(x_i)}可见⽜顿法是让x沿着f(x)梯度的⽅向下降,类似于最优化⽅法中的梯度下降法。

⽜顿法也可以作为最优化算法,只不过那时需要求函数的⼆阶导数。

⽜顿法相⽐⼆分法、截弦法的优点是收敛速度可以达到⼆阶,在根附近没迭代⼀次,结果的有效数字⼏乎可以翻倍。

当然⽜顿法也可能可能失败,⽐如收敛到⼀个局部极值,其切线⽅向与横轴⽔平,从⽽⽆法计算下⼀个迭代值。

另外,⽜顿法的实现需要⽤户提供⼀个函数⽤于计算函数值f(x)与其⼀阶导数值f'(x),因此⽐较适合函数的导数可以解析求出的情况,如果需要求数值导数,则⽜顿法的收敛速度和精度都会受影响。

我们可以将⽜顿法和⼆分法综合起来形成⼀个混合算法,⼀旦⽜顿法在运⾏过程中出现解跳出给定区间或者猜测值远离实际根导致收敛速度较慢时,就采取⼀步⼆分法。

实现⼀:利⽤预先求出的⼀阶导函数import numpy as npimport matplotlib.pyplot as pltdef f(FV, PMT, r, n):return PMT * (1 + r) * (((1 + r)**n - 1)) / r + FVdef df(FV, PMT, r, n):r_plus_1_power_n = (1 + r)**np1 = N * PMT * r_plus_1_power_n / rp2 = -PMT * (r + 1) * (r_plus_1_power_n - 1) / r / rp3 = PMT * (r_plus_1_power_n - 1) / rreturn p1 + p2 + p3def newtonRaphson2(FV,PMT,n,f,df,xmin,xmax,maxit,shift=0.0001,tol=1.0e-9):'''函数作⽤说明:计算组合收益率FV:⽬标⾦额PMT:每期投资⾦额n:定投期数f:函数值(根据要求的⽅程⾃定义)df:导数值(根据要求的⽅程⾃定义)xmin:根的下限xmax:根的上限maxit:最⼤迭代次数tol:计算精度'''import mathfxmin = f(FV, PMT, xmin, n)if fxmin == 0.0:return xminfxmax = f(FV, PMT, xmax, n)if fxmax == 0.0:return xmaxif fxmin * fxmax > 0.0:print('Root is not bracketed') # 在[xmin, xmax]内函数不变号(没根),或者是变了偶数次号(多个根)return 1if fxmin < 0.0: # 确定搜索⽅向使f(xl)<0xl = xminxh = xmaxelse:xl = xmaxxh = xminx = 0.5 * (xmin + xmax) # 根的预测值if x == 0:x += shiftfx, dfx = f(FV, PMT, x, n), df(FV, PMT, x, n) # 求f(x)和其⼀阶导数dxold = math.fabs(xmax - xmin) # 储存步长dx = dxoldfor ii in range(maxit):# ⽜顿法的解跳出解区间或者收敛速度太慢,则下⼀步改⽤⼆分法if ((x - xh) * dfx - fx) * ((x - xl) * dfx - fx) > 0.0 or (math.fabs(2 * fx) > math.fabs(dxold * dfx)):# ⼆分法dxold = dxdx = 0.5 * (xh - xl)x = xl + dxelse:# ⽜顿法dxold = dxdx = fx / dfxtemp = xx -= dxif temp == x:print("total iterate time:%s " % ii)return xif math.fabs(dx) < tol: # 达到要求精度,返回找到的根print("total iterate time:%s " % ii)return xif x == 0:x += shiftfx, dfx = f(FV, PMT, x, n), df(FV, PMT, x, n) # 否则继续迭代,求f(x)和其⼀阶导数if fx < 0.0: # 使根保持在解区间内xl = xelse:xh = xprint('Maximum number of iterations exceeded')return 1### 测试⽤例:⾸先给定PMT,n,r_analytical,计算FV,然后利⽤PMT,n,FV计算r_numerical,两者应该相等##给定r_analytical计算FVR=0.1r_analytical = R / 12PMT = -4e3N = 30n = N * 12FV = -PMT * (1 + r_analytical) * (((1 + r_analytical)**n - 1)) / r_analytical##给定FV反解r_numericalr_numerical = newtonRaphson2(FV, PMT, n, f, df, -1, 1, 100, tol=1.0e-8)print('\nr_analytical=%s,\nr_numerical=%s\n' % (r_analytical, r_numerical))实现⼆:利⽤TensorFlow提供的⾃动微分计算导函数import numpy as npimport mathimport pandas as pdimport tensorflow as tfimport matplotlib.pyplot as plt##⼀个利⽤tensorflow的⾃动微分功能实现⽜顿法解⽅程的⼩程序class NewtonRaphson:def__init__(self, y, x, session):self.y = yself.x = xself.grad = tf.gradients(y, x)self.sess = sessionsess.run(tf.global_variables_initializer())def _fx(self, x_value):# 尽量避免出现f(x)不能计算的情况,⽐如函数试图计算a/0,log(0)等,如果计算结果为inf则x+0.0001再进⾏计算 temp = self.sess.run(y, feed_dict={x: [x_value]})[0]if np.isinf(temp):return self.sess.run(y, feed_dict={x: [x_value + 0.0001]})[0]else:return tempdef _dfx(self, x_value):return self.sess.run(self.grad, feed_dict={x: [x_value]})[0][0]def solve(self, xmin, xmax, maxiter, tol):fmin = self._fx(xmin)fmax = self._fx(xmax)if fmin == 0:return xminif fmax == 0:return xmaxif fmin * fmax > 0.0:raise ValueError('Root is not brackted!!')if fmin < 0:xl = xminxh = xmaxelse:xl = xmaxxh = xminx = (xmin + xmax) / 2fx, dfx = self._fx(x), self._dfx(x)dxold = math.fabs(xmax - xmin)dx = dxoldfor ii in range(maxiter):if ((x - xh) * dfx - fx) * ((x - xl) * dfx - fx) > 0.0 or (math.fabs(2 * fx) > math.fabs(dxold * dfx)):dxold = dxdx = 0.5 * (xh - xl)x = xl + dxelse:dxold = dxdx = fx / dfxtemp = xx -= dx# newtonif temp == x:print("total iterate time:%s " % ii)return xfx, dfx = self._fx(x), self._dfx(x)if fx < 0.0:xl = xelse:xh = xprint('Maximum number of iterations exceeded')return 1PV = 1e4FV = 3e6N = 20cpi = 0.018RATE = 0.15r = RATE / 12PMT = 10000x = tf.placeholder(shape=[1], dtype=tf.float32)y=r * (FV * (1 + cpi)**(N) - PV * (r + 1)**x) / ((r + 1)**x - 1 - r) - PMT sess = tf.InteractiveSession()solver=NewtonRaphson(y,x,sess)nmin = 2nmax = 300solver.solve(nmin,nmax,100,1e-9)Processing math: 0%。

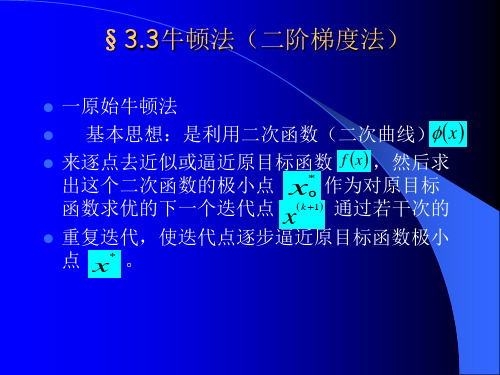

牛顿法 二阶梯度法

令x

(k )

=x

( k +1)

则有

g

∆g

∆g

(k + 1 )

= ∇f

(x

(k + 1 )

)= g

(k )

+ H

(x )(x

(k )

(k + 1 )

−

x

(k )

)

(k )

=g

( k +1)

−g

(k ) (k )

∆x = x

(k )

( k +1)

(k )

k

f ( x) ≈ f ( x ) +

(k )

[∇f (x

(k )

(x − x )+ 1 [x − x(k )] H (x )(x − x ) )] 2

T

(k )

T

(k )

(k )

梯度为

g ≈ ∇f ( x ) = ∇ f

(x )+ H (x )(x − x ) = g + H (x )(x − x )

X

=

X

(k )

−α

(k )

A

(k )

∇f

(X ) = X + α

(k )

(k )

S

(k )

α

(k )

-----步长由

(k )

f (x

+ α s ) = min f ( x

(k ) (k )

(k )

+α s )

(k ) (k )

求出 探索方向

S

(k )

= − A ∇f

牛顿法 重根问题-概述说明以及解释

牛顿法重根问题-概述说明以及解释1.引言1.1 概述牛顿法是一种经典的数值计算方法,广泛应用于解决方程和优化问题。

它基于牛顿-拉夫逊方程而得名,由数学家伊萨克·牛顿在17世纪提出。

牛顿法的基本思想是通过不断迭代逼近函数的零点或最值点。

它通过计算函数在某点的导数和函数值的比值,确定函数在该点的局部线性近似,然后以该近似替代原函数,再求出近似函数的零点或最值点,不断迭代直至满足收敛条件。

重根问题是在求解方程时遇到的一类特殊情况。

当一个多项式函数有重复根时,常规的数值方法往往会失效,因为函数的导数在重根处为零,导致求解过程中出现除零操作或梯度无法更新的情况。

因此,如何有效地解决重根问题一直是数值计算中的挑战之一。

本文将从牛顿法的基本原理出发,介绍牛顿法在解决重根问题中的应用。

首先,我们将详细讨论牛顿法的原理和算法流程,以及收敛性和速度等方面的特点。

接着,我们将引入重根问题的定义和背景,并讨论重根问题对牛顿法的影响。

最后,我们将重点探讨牛顿法在解决重根问题中的应用方法及改进策略,并通过实例验证其有效性。

通过本文的研究,我们将对牛顿法在解决重根问题中的优势和局限性有更深入的了解,为其在实际问题中的应用提供指导和参考。

此外,我们还将展望牛顿法在其他数值计算问题中的潜在应用,并总结研究结果,为今后的相关研究提供思路和方向。

综上所述,本文旨在探讨牛顿法在解决重根问题中的应用,并通过分析和研究为其在实践中的应用提供理论基础和实践指导。

希望通过本文的阐述,读者能够更好地理解牛顿法及其在解决重根问题中的价值。

1.2文章结构文章结构部分的内容可以从以下几个方面展开:1.2 文章结构:本文将分为三个主要部分来介绍牛顿法在解决重根问题中的应用。

首先,在引言部分,我们将对牛顿法和重根问题进行概述,介绍文章的主要结构和目的。

接着,在正文部分,我们将详细阐述牛顿法的基本原理,并给出重根问题的定义和背景。

然后,我们将重点讨论牛顿法在解决重根问题中的应用,探讨其优势和适用性。

牛顿法迭代公式原理

牛顿法迭代公式原理牛顿法迭代公式,这可是个相当有趣的数学概念呢!咱们先来说说啥是牛顿法迭代公式。

简单来讲,它就是一种用来求解方程根的方法。

想象一下,你有一个方程,就像一个藏着神秘答案的密码锁,而牛顿法迭代公式就是那把能帮你解开密码的神奇钥匙。

比如说,咱们有个方程 f(x) = x^2 - 5 ,我们想找到它的根,也就是让 f(x) = 0 时 x 的值。

这时候牛顿法就登场啦!它的公式是这样的:x(n+1) = x(n) - f(x(n)) / f'(x(n)) 。

这里的 f'(x) 是f(x) 的导数。

可能有人会问,这到底是咋想出来的呀?这就得提到牛顿这位大神的智慧啦!他就像是数学世界里的超级侦探,通过巧妙的思考找到了这个厉害的方法。

我记得有一次给学生们讲这个知识点的时候,有个小家伙瞪着大眼睛,一脸迷茫地问我:“老师,这东西到底有啥用啊?”我笑着跟他说:“你想想啊,假如你要设计一个桥梁,得算出合适的支撑点位置,这时候牛顿法就能帮上大忙啦!”那咱们再深入讲讲这个公式的原理。

其实它的核心思想就是不断地用切线去逼近曲线的根。

就好像你在黑暗中摸索着找一个开关,每次伸手去试探,都更接近目标。

比如说,我们从一个初始的猜测值 x0 开始。

计算出 f(x0) 和 f'(x0) ,然后用公式得到新的值 x1 。

接着再把 x1 代入公式,得到 x2 ,就这样一步步地逼近真正的根。

而且啊,牛顿法的收敛速度还挺快的。

这意味着它能比较迅速地帮我们找到想要的答案。

但牛顿法也不是完美的。

它对初始值的选择比较敏感。

如果初始值选得不好,可能就会陷入一些奇怪的循环,找不到真正的根。

这就像是你在森林里迷路了,如果一开始方向选错了,可能就越走越远啦。

在实际应用中,牛顿法可是无处不在。

比如在工程计算里,求解各种复杂的方程;在物理研究中,帮助科学家找到模型中的关键参数。

总之,牛顿法迭代公式就像是数学世界里的一把利剑,能帮我们解决很多难题。

广义牛顿法

特点:恒定步长为1。 为解决收敛性的问题,采用广义牛顿法(采用一维搜索 来确定步长因子)。

广义牛顿法

牛顿法在充分接近极小点时,是二阶收敛

的.如果初始点远离极小点时,就不能保持 收敛性.改进. 引进一维搜索.

求单变量极值问题 min f ( x k z k ) f ( x k k z k );

1 1 2 1 1 1 2 令z [ f ( x )] f ( x ) 0 x z 2 2

1 1

0 4 2 1 100 2 50

2 2 ,

T

求• min f ( x1 z 1 ) f ( x1 1 z 1 ),得1 1,

0

其中方向z k同上

步骤: 1、取初始点x1 E n , 允许误差 0, k : 1; 2、检验是否满足收敛性判别准则: f ( x k ) .是, 终止, 否,转3。 3、令z [ f ( x )] f ( x );

k 2 k k 1

4、求单变量极值问题 min f ( x k z k ) f ( x k k z k );

k i

不失一般性,设点列x ki 1 收敛到y 2 , 又因为f ( x k )单调下降有下界且连续,所以收敛,

再证f x ( y1 )=0。用反证法。 若f x ( y1 ) 0,则 f x ( y1 ) 0.对于充分小的,

f ( y1-[ f xx ( y1 )]1 f x ( y1 )T ) =f ( y )-f x ( y )[ f xx ( y )]

1 1 2 1 1 1 2 令z [ f ( x )] f ( x ) 0 x z 2 2

牛顿下降法

牛顿下降法在机器学习中,优化算法是帮助深度学习模型迭代改进参数的核心过程,而牛顿法是其中最常用的优化算法之一,它能够有效地帮助模型参数迭代更新,从而改善深度学习模型的效果。

新牛顿法是一种高效的机器学习优化算法,在不改变牛顿法基本思想的前提下,对其进行简化,从而降低计算复杂度,提高优化算法的运行速度,从而获得更快的模型训练效果。

一、牛顿法概述牛顿法(Newton Method)是一种经典的迭代优化算法,它利用函数的二阶导数(Hessian)信息,迭代搜索最优解。

牛顿法是一种梯度下降算法,它利用函数的一阶导数(即gradient)信息,进行参数调整,从而获得函数的最小值,最常见的方法是梯度下降法。

牛顿法可将优化问题转化为一个求解二阶导数为非负定值的最小值问题,其核心思想也很简单:通过不断更新参数,不断减小损失函数的值,最终达到最优解,并实现优化目标。

牛顿法的优点是能够很快的搜索到函数的最小值,以及收敛的稳定性好,但是它的缺点也是比较明显的:(1)牛顿法需要计算Hessian矩阵,这比计算梯度矩阵复杂的多;(2)牛顿法的迭代步长受到Hessian矩阵的影响,容易出现过大或过小的步长,造成迭代缓慢;(3)牛顿法受海森矩阵局部性影响,搜索效率较梯度下降差,特别是在非凸函数最小值处时,容易陷入局部最优解;二、新牛顿法概述新牛顿法(Nesterov Method)是一种高效的机器学习优化算法,它是在牛顿法的基础上进行简化,可以大幅减少计算量,提高优化算法的运行速度,从而获得更快的模型训练效果。

新牛顿法的核心思想是:从牛顿法的角度来看,模型参数的更新可以看成是在一个函数曲面上的一次次的投石运动。

新型牛顿法的核心思想就是在投石的过程中,使用一个以投石位置为中心的更新方向去更新参数,而不是将参数更新方向完全依赖于投石前一步的梯度信息,也就是说,新牛顿法在变量更新过程中不仅考虑投石前一步的梯度信息,还考虑投石前两步的梯度信息,因此,新牛顿法的搜索效率比牛顿法要高,从而较好的达到函数最小值。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

南昌航空大学实验报告

年月日

课题名称:计算方法实验名称:牛顿法

班级: 09姓名:同组人:

指导老师评定:签名:

一.实验目的

1.加深对牛顿法的理解。

2.熟练的运用牛顿法解题。

二.实验内容

设c>0,试用牛顿法建立计算x=c的公式

三.实验步骤

1.建立两个函数。

2.输入x1,n,m后,利用一个for循环进行计算,求得x; 原始代码:

#include<stdlib.h>

#include<math.h>

#include<stdio.h>

void main()

{float x1,x,n,c,m;

float fac(float x);

南昌航空大学实验报告

年月日

课题名称:计算方法实验名称:牛顿法

班级: 09姓名:同组人:

指导老师评定:签名:

float gec(float x);

printf("please input:x1,n,m\n");

scanf("%f%f%f",&x1,&n,&m);

for(c=1;c<=m;c++)

{ x=gec(x1);

if(fabs(x-x1)<n)

{printf("x=%f,c=%f",x,c);

break;

}

else

x1=x;

}

{ float y;

y=x*x-10;

南昌航空大学实验报告

年月日

课题名称:计算方法实验名称:牛顿法

班级: 09姓名:同组人:

指导老师评定:签名:

return(y);

}

float gec(float x)

{ float p;

float fac(float x);

p=x-fac(x)/(2*x);

return(p);

}

四.实验结果

当X1时

得X=3.162278 K=6.000000。