matlab多元线性回归模型

第15讲 MATLAB 多元线性回归分析

变量 Y 线性依赖于某个变量 X i ;若检验的结果是 接受 H 0 ,则说明所有变量 X 1 , X 2 ,..., X p 对变量的线性 关系是不重要的。

本章目录

16

回 归 分析

2 线性回归

—多元线性回归

2.3 回归方程的假设检验—模型的检验

x i (1, xi1 ,...,xip )

例

本章目录

22

i 1,2,...,n

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

自变量的选择

本章目录

23

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

提

选择自变量的准则 选择自变量进入回归模型的方法

纲

(SAS实例)

本章目录

24

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

1. 引言

因变量

y 自变量为 x , x ,, x

1 2

p

满足线性关系

p

y x x e

0 1 1 p

(I)

对 x1 , x2 ,, x p y 进行 n 次观测, 所得的 n 组数据为

xi1 , xi 2 ,, xip, (i 1,2,, n)

它们均满足(I)式

25

本章目录

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

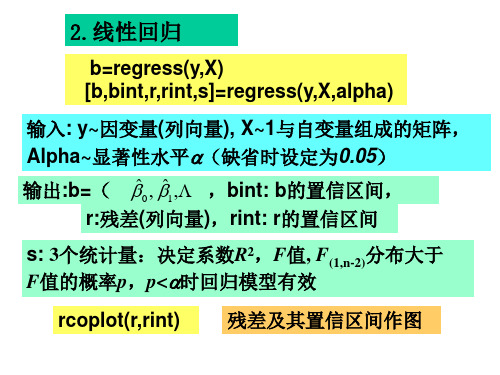

第八讲MATLAB中多元线性回归

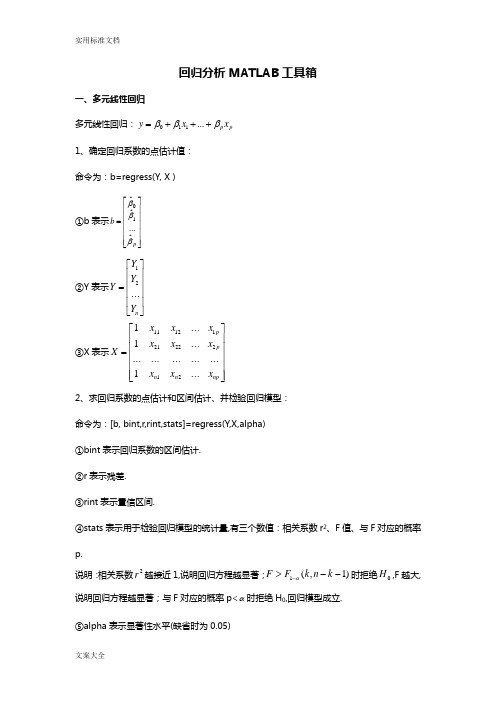

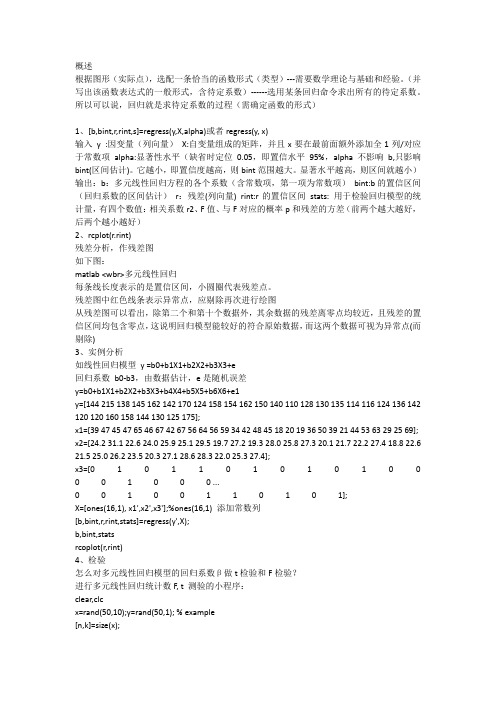

b=regress(y,X) [b,bint,r,rint,s]=regress(y,X,alpha) 输入: 因变量 列向量), 因变量(列向量 与自变量组成的矩阵, 输入 y~因变量 列向量 X~1与自变量组成的矩阵, 与自变量组成的矩阵 Alpha~显著性水平α(缺省时设定为 缺省时设定为0.05) 显著性水平 ) 输出:b=( β 0 , β1 , ( ), ),bint: b的置信区间, 输出 的置信区间, r:残差 列向量 ,rint: r的置信区间 残差(列向量 残差 列向量), 的 s: 3个统计量:决定系数 2,F值, F(1,n-2)分布大于 个统计量: 个统计量 决定系数R 值 F值的概率 ,p<α时回归模型有效 值的概率p, 回归模型有效 值的概率 rcoplot(r,rint) 残差及其置信区间作图 残差及其置信区间作图 及其

回归 模型

序 号 1 2 3 … 10 血 压 144 215 138 … 154

血压与年龄、体重指数、 例3: 血压与年龄、体重指数、吸烟习惯

年 龄 39 47 45 … 56 体重 指数 24.2 31.1 22.6 … 19.3 吸烟 习惯 0 1 0 … 0 序 号 21 22 23 … 30 血 压 136 142 120 … 175 年 龄 36 50 39 … 69 体重 指数 25.0 26.2 23.5 … 27.4 吸烟 习惯 0 1 0 … 1

β0 β1 β2 β3

R2= 0.8462 F= 44.0087 p<0.0001 s2 =53.6604

这时置信区间不包含零点, 统计量增大 统计量增大, 这时置信区间不包含零点,F统计量增大,可决系 数从0.6855增大到 增大到0.8462 ,我们得到回归模型为: 我们得到回归模型为: 数从 增大到

Matlab 多元线性回归

/输出结果如图所示:/

因 此 我 们 可 得 bˆ0 = −16.0730, , bˆ1 = 0.7194.

bˆ0 的置信区间 ( − 33.7071, 1.5612) ,

bˆ1 的置信区间 (0.6047, 0.834). r2 = 0.9282, F = 180.9531, p = 0.0000.

多元线性回归模型的一般形式为:

Yi =β0 +β1X1i +β2X2i + +βk Xki +μi , i=1,2, ,n

(1)

其中 k 为解释变量的数目, β j ( j = 1,2, ,k) 称为回归系数(regression coefficient)。上

式也被称为总体回归函数的随机表达式。它的非随机表达式为:

Matlab 多元线性回归

1、 多元线性回归

在回归分析中,如果有两个或两个以上的自变量,就称为多元回归。事实上,一种现象 常常是与多个因素相联系的,由多个自变量的最优组合共同来预测或估计因变量,比只用一 个自变量进行预测或估计更有效,更符合实际。

在实际经济问题中,一个变量往往受到多个变量的影响。例如,家庭消费支出,除了受 家庭可支配收入的影响外,还受诸如家庭所有的财富、物价水平、金融机构存款利息等多种 因素的影响,表现在线性回归模型中的解释变量有多个。这样的模型被称为多元线性回归模 型。(multivariable linear regression model )

在 Matlab 图示所示:

/输出结果如图所示:/

bˆ0 = 62.4054, bˆ0 的置信区间 ( − 99.1786, 223.9893) , bˆ1 = 1.5511, bˆ1 的置信区间 (−0.1663, 3.2685) , 因此我们可得 bˆ2 = 0.5102, , bˆ2 的置信区间 (−1.1589, 2.1792) , bˆ3 = 0.1019, bˆ3 的置信区间 (−1.6385, 1.8423) , bˆ4 = −1441. bˆ4 的置信区间 (−1.7791, 1.4910). r2 = 0.9824, F = 111.4792, p = 0.0000. p < 0.05,回归模型 y = −62.4054 +1.5511x1 + 0.5102x2 +0.1019x3 -0.1441x4成立.

Matlab_多元的线性回归

1、 多元线性回归Matlab 多元线性回归在回归分析中,如果有两个或两个以上的自变量,就称为多元回归。

事实上,一种现象常常是与多个因素相联系的,由多个自变量的最优组合共同来预测或估计因变量,比只用一个自变量进行预测或估计更有效,更符合实际。

在实际经济问题中,一个变量往往受到多个变量的影响。

例如,家庭消费支出,除了受 家庭可支配收入的影响外,还受诸如家庭所有的财富、物价水平、金融机构存款利息等多种 因素的影响,表现在线性回归模型中的解释变量有多个。

这样的模型被称为多元线性回归模型。

(multivariable linear regression model)多元线性回归模型的一般形式为:Y i =0+1 X 1i +2X 2i + …+k X ki +i ,i=1,2,…n(1)其中 k 为解释变量的数目, βj j( j = 1,2,…k )称为回归系数(regression coefficient)。

上式也被称为总体回归函数的随机表达式。

它的非随机表达式为:Y i =0+1 X 1i +2X 2i + …+k X ki , i=1,2, …n kj j也被称为偏回归系数(partial regression coefficient)。

,2、 多元线性回归计算模型Y=0+1 X 1+2X 2+ …+k X k +,~N(0,2) (3)(2)多元性回归模型的参数估计,同一元线性回归方程一样,也是在要求误差平方和(Σe) 为最小的前提下,用最小二乘法或最大似然估计法求解参数。

设( x 11,x 12,…,x 1p ,y 1),…,(x n1,x n2,…,x np ,y n ) 是一个样本,用最大似然估计法估计参数:取,…,,当b 0=,b 1=,…,b p=时,Q=达到最小。

(4)化简可得:ββββμ βββββββββεεδ,ˆ0b 1ˆb p b ˆ0ˆb1ˆb p b ˆ21101)...(ip p i ni i x b x b b y ----∑=⎪⎪⎩⎪⎪⎨⎧-----=∂∂=-----=∂∂∑∑===ni ij ip p i i j n i ip p i i x x b x b b y b Q x b x b b y b Q 1011011100)(20)(2 ⎪⎪⎩⎪⎪⎨⎧-----=∂∂=-----=∂∂∑∑===n i ij ip p i i jn i ip p i i x x b x b b y b Q x b x b b y b Q1011011100)(20)(2引入矩阵: y方程组(5)可以化简得:X X X 可得最大似然估计值:BX ’Y⎪⎪⎪⎪⎪⎭⎪⎪⎪⎪⎪⎬⎫=++++=++++=+++∑∑∑∑∑∑∑∑∑∑∑∑∑∑============n i n i n i n i ni i ip ip p i ip i ip ip n i n i n i i i i ip i p i i i i ni ni ni i ip p i i y x x b x x b x x b x b y x x x b x x b x b x b y x b x b x b n b 111112221101111112122111011122110,,,⎪⎪⎪⎪⎪⎭⎫⎝⎛np n n p p x x xx x x x x x 212222111211111X X X b b b B p ')'(ˆˆˆˆ110-=⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=(8)的估计是:公式(8)为P 元经验线性回归方程。

Matlab实现多元的回归实例

Matlab 实现多元回归实例(一)一般多元回归一般在生产实践和科学研究中,人们得到了参数(),,n x x x =⋅⋅⋅1和因变量y 的数据,需要求出关系式()y f x =,这时就可以用到回归分析的方法。

如果只考虑f 是线性函数的情形,当自变量只有一个时,即,(),,n x x x =⋅⋅⋅1中n =1时,称为一元线性回归,当自变量有多个时,即,(),,n x x x =⋅⋅⋅1中n ≥2时,称为多元线性回归。

进行线性回归时,有4个基本假定: ① 因变量与自变量之间存在线性关系; ② 残差是独立的; ③ 残差满足方差奇性; ④ 残差满足正态分布。

在Matlab 软件包中有一个做一般多元回归分析的命令regeress ,调用格式如下:[b, bint, r, rint, stats] = regress(y,X,alpha) 或者[b, bint, r, rint, stats] = regress(y,X) 此时,默认alpha = 0.05. 这里,y 是一个1n ⨯的列向量,X 是一个()1n m ⨯+的矩阵,其中第一列是全1向量(这一点对于回归来说很重要,这一个全1列向量对应回归方程的常数项),一般情况下,需要人工造一个全1列向量。

回归方程具有如下形式:011m m y x x λλλε=++⋅⋅⋅++其中,ε是残差。

在返回项[b,bint,r,rint,stats]中, ①01m b λλλ=⋅⋅⋅是回归方程的系数;②int b 是一个2m ⨯矩阵,它的第i 行表示i λ的(1-alpha)置信区间; ③r 是1n ⨯的残差列向量;④int r 是2n ⨯矩阵,它的第i 行表示第i 个残差i r 的(1-alpha)置信区间; 注释:残差与残差区间杠杆图,最好在0点线附近比较均匀的分布,而不呈现一定的规律性,如果是这样,就说明回归分析做得比较理想。

⑤ 一般的,stast 返回4个值:2R 值、F_检验值、阈值f ,与显著性概率相关的p 值(如果这个p 值不存在,则,只输出前3项)。

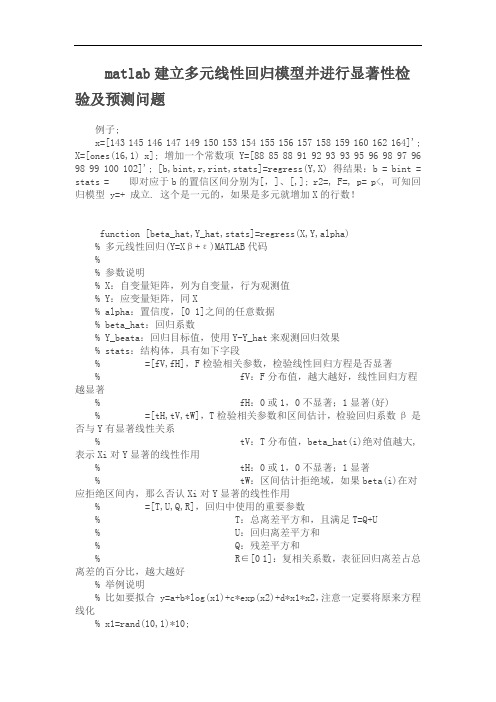

matlab建立多元线性回归模型并进行显著性检验及预测问题

matlab建立多元线性回归模型并进行显着性检验及预测问题例子;x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]';X=[ones(16,1) x]; 增加一个常数项Y=[88 85 88 91 92 93 93 95 96 98 97 96 98 99 100 102]'; [b,bint,r,rint,stats]=regress(Y,X) 得结果:b = bint = stats = 即对应于b的置信区间分别为[,]、[,]; r2=, F=, p= p<, 可知回归模型y=+ 成立. 这个是一元的,如果是多元就增加X的行数!function [beta_hat,Y_hat,stats]=regress(X,Y,alpha)% 多元线性回归(Y=Xβ+ε)MATLAB代码%?% 参数说明% X:自变量矩阵,列为自变量,行为观测值% Y:应变量矩阵,同X% alpha:置信度,[0 1]之间的任意数据% beta_hat:回归系数% Y_beata:回归目标值,使用Y-Y_hat来观测回归效果% stats:结构体,具有如下字段% =[fV,fH],F检验相关参数,检验线性回归方程是否显着% fV:F分布值,越大越好,线性回归方程越显着% fH:0或1,0不显着;1显着(好)% =[tH,tV,tW],T检验相关参数和区间估计,检验回归系数β是否与Y有显着线性关系% tV:T分布值,beta_hat(i)绝对值越大,表示Xi对Y显着的线性作用% tH:0或1,0不显着;1显着% tW:区间估计拒绝域,如果beta(i)在对应拒绝区间内,那么否认Xi对Y显着的线性作用% =[T,U,Q,R],回归中使用的重要参数% T:总离差平方和,且满足T=Q+U% U:回归离差平方和% Q:残差平方和% R∈[0 1]:复相关系数,表征回归离差占总离差的百分比,越大越好% 举例说明% 比如要拟合y=a+b*log(x1)+c*exp(x2)+d*x1*x2,注意一定要将原来方程线化% x1=rand(10,1)*10;% x2=rand(10,1)*10;% Y=5+8*log(x1)+*exp(x2)+*x1.*x2+rand(10,1); % 以上随即生成一组测试数据% X=[ones(10,1) log(x1) exp(x2) x1.*x2]; % 将原来的方表达式化成Y=Xβ,注意最前面的1不要丢了% [beta_hat,Y_hat,stats]=mulregress(X,Y,%% 注意事项% 有可能会出现这样的情况,总的线性回归方程式显着的=1),% 但是所有的回归系数却对Y的线性作用却不显着=0),产生这种现象的原意是% 回归变量之间具有较强的线性相关,但这种线性相关不能采用刚才使用的模型描述,% 所以需要重新选择模型%C=inv(X'*X);Y_mean=mean(Y);% 最小二乘回归分析beta_hat=C*X'*Y; % 回归系数βY_hat=X*beta_hat; % 回归预测% 离差和参数计算Q=(Y-Y_hat)'*(Y-Y_hat); % 残差平方和U=(Y_hat-Y_mean)'*(Y_hat-Y_mean); % 回归离差平方和T=(Y-Y_mean)'*(Y-Y_mean); % 总离差平方和,且满足T=Q+UR=sqrt(U/T); % 复相关系数,表征回归离差占总离差的百分比,越大越好[n,p]=size(X); % p变量个数,n样本个数% 回归显着性检验fV=(U/(p-1))/(Q/(n-p)); % 服从F分布,F的值越大越好fH=fV>finv(alpha,p-1,n-p); % H=1,线性回归方程显着(好);H=0,回归不显着% 回归系数的显着性检验chi2=sqrt(diag(C)*Q/(n-p)); % 服从χ2(n-p)分布tV=beta_hat./chi2; % 服从T分布,绝对值越大线性关系显着tInv=tinv+alpha/2,n-p);tH=abs(tV)>tInv; % H(i)=1,表示Xi对Y显着的线性作用;H(i)=0,Xi对Y的线性作用不明显% 回归系数区间估计tW=[-chi2,chi2]*tInv; % 接受H0,也就是说如果在beta_hat(i)对应区间中,那么Xi与Y线性作用不明显stats=struct('fTest',[fH,fV],'tTest',[tH,tV,tW],'TUQR',[T,U,Q,R]);。

matlab 多元与非线性回归即拟合问题regress、nlinfit

回归(拟合)自己的总结(20100728)1:学三条命令:polyfit(x,y,n)---拟合成一元幂函数(一元多次) regress(y,x)----可以多元,nlinfit(x,y,’fun ’,beta0) (可用于任何类型的函数,任意多元函数,应用范围最主,最万能的)2:同一个问题,可能这三条命令都可以使用,但结果肯定是不同的,因为拟合的近似结果,没有唯一的标准的答案。

相当于咨询多个专家。

3:回归的操作步骤:(1) 根据图形(实际点),选配一条恰当的函数形式(类型)---需要数学理论与基础和经验。

(并写出该函数表达式的一般形式,含待定系数)(2) 选用某条回归命令求出所有的待定系数所以可以说,回归就是求待定系数的过程(需确定函数的形式)配曲线的一般方法是: (一)先对两个变量x 和y 作n 次试验观察得n i y x ii,...,2,1),,( 画出散点图,散点图(二)根据散点图确定须配曲线的类型. 通常选择的六类曲线如下:(1)双曲线xba y +=1 (2)幂函数曲线y=a bx , 其中x>0,a>0(3)指数曲线y=a bx e 其中参数a>0.(4)倒指数曲线y=a xb e/其中a>0,(5)对数曲线y=a+blogx,x>0(6)S 型曲线x be a y -+=1(三)然后由n 对试验数据确定每一类曲线的未知参数a 和b.一、一元多次拟合polyfit(x,y,n)一元回归polyfit多元回归regress---nlinfit(非线性)二、多元回归分析(其实可以是非线性,它通用性极高)对于多元线性回归模型:e x x y p p ++++=βββ 110设变量12,,,px x x y 的n 组观测值为12(,,,)1,2,,i i ip i x x x y i n= .记 ⎪⎪⎪⎪⎪⎭⎫⎝⎛=np n n p p x x x x x x x x x x 212222111211111,⎪⎪⎪⎪⎪⎭⎫⎝⎛=n y y y y 21,则⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=p ββββ 10 的估计值为排列方式与线性代数中的线性方程组相同()拟合成多元函数---regress 使用格式:左边用b=或[b, bint, r, rint, stats]= 右边用regress(y, x) 或regress(y, x, alpha)---命令中是先y 后x,---须构造好矩阵x(x 中的每列与目标函数的一项对应) ---并且x 要在最前面额外添加全1列/对应于常数项 ---y 必须是列向量---结果是从常数项开始---与polyfit 的不同。

matlab建立多元线性回归模型并进行显著性检验及预测问题

matlab建立多元线性回归模型并进行显著性检验及预测问题例子;x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]';X=[ones(16,1) x]; 增加一个常数项 Y=[88 85 88 91 92 93 93 95 96 98 97 9698 99 100 102]'; [b,bint,r,rint,stats]=regress(Y,X) 得结果:b = bint = stats = 即对应于b的置信区间分别为[,]、[,]; r2=, F=, p= p<, 可知回归模型 y=+ 成立. 这个是一元的,如果是多元就增加X的行数!function [beta_hat,Y_hat,stats]=regress(X,Y,alpha)% 多元线性回归(Y=Xβ+ε)MATLAB代码%% 参数说明% X:自变量矩阵,列为自变量,行为观测值% Y:应变量矩阵,同X% alpha:置信度,[0 1]之间的任意数据% beta_hat:回归系数% Y_beata:回归目标值,使用Y-Y_hat来观测回归效果% stats:结构体,具有如下字段% =[fV,fH],F检验相关参数,检验线性回归方程是否显著% fV:F分布值,越大越好,线性回归方程越显著% fH:0或1,0不显著;1显著(好)% =[tH,tV,tW],T检验相关参数和区间估计,检验回归系数β是否与Y有显著线性关系% tV:T分布值,beta_hat(i)绝对值越大,表示Xi对Y显著的线性作用% tH:0或1,0不显著;1显著% tW:区间估计拒绝域,如果beta(i)在对应拒绝区间内,那么否认Xi对Y显著的线性作用% =[T,U,Q,R],回归中使用的重要参数% T:总离差平方和,且满足T=Q+U% U:回归离差平方和% Q:残差平方和% R∈[0 1]:复相关系数,表征回归离差占总离差的百分比,越大越好% 举例说明% 比如要拟合 y=a+b*log(x1)+c*exp(x2)+d*x1*x2,注意一定要将原来方程线化% x1=rand(10,1)*10;% x2=rand(10,1)*10;% Y=5+8*log(x1)+*exp(x2)+*x1.*x2+rand(10,1); % 以上随即生成一组测试数据% X=[ones(10,1) log(x1) exp(x2) x1.*x2]; % 将原来的方表达式化成Y=Xβ,注意最前面的1不要丢了% [beta_hat,Y_hat,stats]=mulregress(X,Y,%% 注意事项% 有可能会出现这样的情况,总的线性回归方程式显著的=1),% 但是所有的回归系数却对Y的线性作用却不显著=0),产生这种现象的原意是% 回归变量之间具有较强的线性相关,但这种线性相关不能采用刚才使用的模型描述,% 所以需要重新选择模型%C=inv(X'*X);Y_mean=mean(Y);% 最小二乘回归分析beta_hat=C*X'*Y; % 回归系数βY_hat=X*beta_hat; % 回归预测% 离差和参数计算Q=(Y-Y_hat)'*(Y-Y_hat); % 残差平方和U=(Y_hat-Y_mean)'*(Y_hat-Y_mean); % 回归离差平方和T=(Y-Y_mean)'*(Y-Y_mean); % 总离差平方和,且满足T=Q+UR=sqrt(U/T); % 复相关系数,表征回归离差占总离差的百分比,越大越好[n,p]=size(X); % p变量个数,n样本个数% 回归显著性检验fV=(U/(p-1))/(Q/(n-p)); % 服从F分布,F的值越大越好fH=fV>finv(alpha,p-1,n-p); % H=1,线性回归方程显著(好);H=0,回归不显著% 回归系数的显著性检验chi2=sqrt(diag(C)*Q/(n-p)); % 服从χ2(n-p)分布tV=beta_hat./chi2; % 服从T分布,绝对值越大线性关系显著tInv=tinv+alpha/2,n-p);tH=abs(tV)>tInv; % H(i)=1,表示Xi对Y显著的线性作用;H(i)=0,Xi 对Y的线性作用不明显% 回归系数区间估计tW=[-chi2,chi2]*tInv; % 接受H0,也就是说如果在beta_hat(i)对应区间中,那么Xi与Y线性作用不明显stats=struct('fTest',[fH,fV],'tTest',[tH,tV,tW],'TUQR',[T,U,Q,R]) ;。

多元回归分析报告matlab

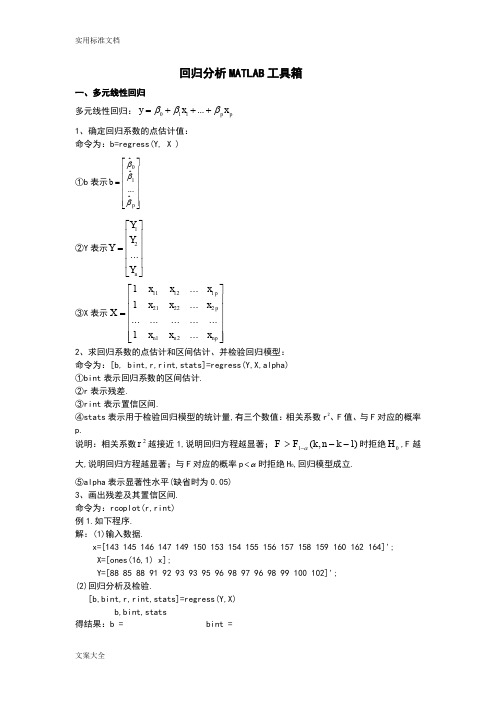

回归分析MATLAB 工具箱一、多元线性回归多元线性回归:p p x x y βββ+++=...110 1、确定回归系数的点估计值: 命令为:b=regress(Y, X ) ①b 表示⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=p b βββˆ...ˆˆ10②Y 表示⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=n Y Y Y Y (2)1③X 表示⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=np n n p p x x x x x x x x x X ...1............ (1) (12)12222111211 2、求回归系数的点估计和区间估计、并检验回归模型:命令为:[b, bint,r,rint,stats]=regress(Y,X,alpha) ①bint 表示回归系数的区间估计. ②r 表示残差.③rint 表示置信区间.④stats 表示用于检验回归模型的统计量,有三个数值:相关系数r 2、F 值、与F 对应的概率p.说明:相关系数2r 越接近1,说明回归方程越显著;)1,(1-->-k n k F F α时拒绝0H ,F 越大,说明回归方程越显著;与F 对应的概率p α<时拒绝H 0,回归模型成立.⑤alpha 表示显著性水平(缺省时为0.05) 3、画出残差及其置信区间. 命令为:rcoplot(r,rint) 例1.如下程序. 解:(1)输入数据.x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]'; X=[ones(16,1) x];Y=[88 85 88 91 92 93 93 95 96 98 97 96 98 99 100 102]'; (2)回归分析及检验.[b,bint,r,rint,stats]=regress(Y,X) b,bint,stats得结果:b = bint =-16.0730 -33.7071 1.5612 0.7194 0.6047 0.8340 stats =0.9282 180.9531 0.0000即7194.0ˆ,073.16ˆ10=-=ββ;0ˆβ的置信区间为[-33.7017,1.5612], 1ˆβ的置信区间为[0.6047,0.834]; r 2=0.9282, F=180.9531, p=0.0000,我们知道p<0.05就符合条件, 可知回归模型 y=-16.073+0.7194x 成立. (3)残差分析,作残差图. rcoplot(r,rint)从残差图可以看出,除第二个数据外,其余数据的残差离零点均较近,且残差的置信区间均包含零点,这说明回归模型 y=-16.073+0.7194x 能较好的符合原始数据,而第二个数据可视为异常点.(4)预测及作图.z=b(1)+b(2)*xplot(x,Y,'k+',x,z,'r')二、多项式回归(一)一元多项式回归.1、一元多项式回归:1121...+-++++=m m m m a x a x a x a y(1)确定多项式系数的命令:[p,S]=polyfit(x,y,m)说明:x=(x 1,x 2,…,x n ),y=(y 1,y 2,…,y n );p=(a 1,a 2,…,a m+1)是多项式y=a 1x m +a 2x m-1+…+a m x+a m+1的系数;S 是一个矩阵,用来估计预测误差. (2)一元多项式回归命令:polytool(x,y,m) 2、预测和预测误差估计.(1)Y=polyval(p,x)求polyfit 所得的回归多项式在x 处的预测值Y ;(2)[Y,DELTA]=polyconf(p,x,S,alpha)求polyfit 所得的回归多项式在x 处的预测值Y 及预测值的显著性为1-alpha 的置信区间Y ±DELTA ;alpha 缺省时为0.5.例1. 观测物体降落的距离s 与时间t 的关系,得到数据如下表,求s. (关于t 的回归方程2解法一:直接作二次多项式回归. t=1/30:1/30:14/30;s=[11.86 15.67 20.60 26.69 33.71 41.93 51.13 61.49 72.90 85.44 99.08 113.77 129.54 146.48];[p,S]=polyfit(t,s,2) 得回归模型为:1329.98896.652946.489ˆ2++=t t s解法二:化为多元线性回归. t=1/30:1/30:14/30;s=[11.86 15.67 20.60 26.69 33.71 41.93 51.13 61.49 72.90 85.44 99.08 113.77 129.54 146.48];T=[ones(14,1) t' (t.^2)'];[b,bint,r,rint,stats]=regress(s',T); b,stats得回归模型为:22946.4898896.651329.9ˆt t s++= 预测及作图:Y=polyconf(p,t,S)plot(t,s,'k+',t,Y,'r')(二)多元二项式回归多元二项式回归命令:rstool(x,y,’model ’, alpha)说明:x 表示n ⨯m 矩阵;Y 表示n 维列向量;alpha :显著性水平(缺省时为0.05);model 表示由下列4个模型中选择1个(用字符串输入,缺省时为线性模型):linear(线性):m m x x y βββ+++= 110purequadratic(纯二次):∑=++++=nj j jjm m x x x y 12110ββββinteraction(交叉):∑≤≠≤++++=mk j k j jkm m x x x x y 1110ββββquadratic(完全二次):∑≤≤++++=mk j k j jkm m x x x x y ,1110ββββ例1. 设某商品的需求量与消费者的平均收入、商品价格的统计数据如下,建立回归模型,预测平均收入为1000、价格为6时的商品需求量. 需求量 10075 80 70 50 65 90 100 110 60收入 1000 600 1200500 300 400 1300 1100 1300 300 价格 5 7 6 6 8 7 5 4 3 9解法一:选择纯二次模型,即2222211122110x x x x y βββββ++++=.直接用多元二项式回归:x1=[1000 600 1200 500 300 400 1300 1100 1300 300]; x2=[5 7 6 6 8 7 5 4 3 9];y=[100 75 80 70 50 65 90 100 110 60]'; x=[x1' x2'];rstool(x,y,'purequadratic')在左边图形下方的方框中输入1000,右边图形下方的方框中输入6,则画面左边的“Predicted Y ”下方的数据变为88.47981,即预测出平均收入为1000、价格为6时的商品需求量为88.4791.在画面左下方的下拉式菜单中选”all ”, 则beta 、rmse 和residuals 都传送到Matlab 工作区中.在Matlab 工作区中输入命令:beta, rmse 得结果:beta =110.5313 0.1464 -26.5709 -0.0001 1.8475 rmse =4.5362故回归模型为:2221218475.10001.05709.261464.05313.110x x x x y +--+=剩余标准差为4.5362, 说明此回归模型的显著性较好.解法二:将2222211122110x x x x y βββββ++++=化为多元线性回归:X=[ones(10,1) x1' x2' (x1.^2)' (x2.^2)'];[b,bint,r,rint,stats]=regress(y,X); b,stats结果为: b =110.5313 0.1464 -26.5709 -0.00011.8475 stats =0.9702 40.6656 0.0005三、非线性回归 1、非线性回归:(1)确定回归系数的命令:[beta,r,J]=nlinfit(x,y,’model ’, beta0)说明:beta 表示估计出的回归系数;r 表示残差;J 表示Jacobian 矩阵;x,y 表示输入数据x 、y 分别为矩阵和n 维列向量,对一元非线性回归,x 为n 维列向量;model 表示是事先用m-文件定义的非线性函数;beta0表示回归系数的初值.(2)非线性回归命令:nlintool(x,y,’model ’, beta0,alpha) 2、预测和预测误差估计:[Y,DELTA]=nlpredci(’model ’, x,beta,r,J)表示nlinfit 或nlintool 所得的回归函数在x 处的预测值Y 及预测值的显著性为1-alpha 的置信区间Y ±DELTA. 例1. 如下程序.解:(1)对将要拟合的非线性模型y=a x b e /,建立m-文件volum.m 如下:function yhat=volum(beta,x) yhat=beta(1)*exp(beta(2)./x); (2)输入数据: x=2:16;y=[6.42 8.20 9.58 9.5 9.7 10 9.93 9.99 10.49 10.59 10.60 10.80 10.60 10.90 10.76];beta0=[8 2]'; (3)求回归系数:[beta,r ,J]=nlinfit(x',y','volum',beta0); beta (4)运行结果:beta =11.6036 -1.0641 即得回归模型为:xey 10641.16036.11-=(5)预测及作图:[YY,delta]=nlpredci('volum',x',beta,r ,J); plot(x,y,'k+',x,YY,'r')四、逐步回归1、逐步回归的命令:stepwise(x,y,inmodel,alpha)说明:x 表示自变量数据,m n ⨯阶矩阵;y 表示因变量数据,1⨯n 阶矩阵;inmodel 表示矩阵的列数的指标,给出初始模型中包括的子集(缺省时设定为全部自变量);alpha 表示显著性水平(缺省时为0.5).2、运行stepwise 命令时产生三个图形窗口:Stepwise Plot,Stepwise Table,StepwiseHistory.在Stepwise Plot窗口,显示出各项的回归系数及其置信区间.(1)Stepwise Table窗口中列出了一个统计表,包括回归系数及其置信区间,以及模型的统计量剩余标准差(RMSE)、相关系数(R-square)、F值、与F对应的概率P.例1. 水泥凝固时放出的热量y与水泥中4种化学成分x1、x2、x3、 x4有关,今测得一组数据如下,试用逐步回归法确定一个线性模型.解:(1)数据输入:x1=[7 1 11 11 7 11 3 1 2 21 1 11 10]';x2=[26 29 56 31 52 55 71 31 54 47 40 66 68]';x3=[6 15 8 8 6 9 17 22 18 4 23 9 8]';x4=[60 52 20 47 33 22 6 44 22 26 34 12 12]';y=[78.5 74.3 104.3 87.6 95.9 109.2 102.7 72.5 93.1 115.9 83.8 113.3 109.4]';x=[x1 x2 x3 x4];(2)逐步回归.①先在初始模型中取全部自变量:stepwise(x,y)得图Stepwise Plot 和表Stepwise Table.图Stepwise Plot中四条直线都是虚线,说明模型的显著性不好.从表Stepwise Table中看出变量x3和x4的显著性最差.②在图Stepwise Plot中点击直线3和直线4,移去变量x3和x4.移去变量x3和x4后模型具有显著性虽然剩余标准差(RMSE)没有太大的变化,但是统计量F的值明显增大,因此新的回归模型更好.(3)对变量y和x1、x2作线性回归.X=[ones(13,1) x1 x2];b=regress(y,X)得结果:b =52.57731.46830.6623故最终模型为:y=52.5773+1.4683x1+0.6623x2或这种方法4元二次线性回归clc;clear;y=[1.84099 9.67 23.00 38.12 1.848794 6.22 12.22 19.72 1.848794 5.19 10.09 15.31 ];X1=[60.36558 59.5376 58.89861 58.74706 60.59389 60.36558 59.2 58.2 60.36558 59.97068 59.41918 58. X2=[26.1636 26.35804 26.82438 26.91521 25.90346 25.9636 27.19256 27.42153 26.1636 26.07212 26.5872 X3=[0.991227 0.994944 0.981322 0.98374 1.011865 0.991227 1.074772 1.107678 0.991227 0.917904 1.06043 X4=[59.37436 58.54265 57.91729 57.69332 59.58203 59.37436 57.76722 57.42355 59.37436 59.05278 58.3587format short gY=y'X11=[ones(1,length(y));X1;X2;X3;X4]'B1=regress(Y,X11)% 多元一次线性回归[m,n]=size(X11)X22=[];for i=2:nfor j=2:nif i<=jX22=([X22,X11(:,i).*X11(:,j)]);elsecontinueendendendX=[X11,X22];B2=regress(Y,X)% 多元二次线性回归[Y X*B2 Y-X*B2]plot(Y,X11*B1,'o',Y,X*B2,'*')hold on,line([min(y),max(y)],[min(y),max(y)]) axis([min(y) max(y) min(y) max(y)])legend('一次线性回归','二次线性回归')xlabel('实际值');ylabel('计算值')运行结果:Y =1.8419.672338.121.84886.2212.2219.721.84885.1910.0915.31X11 =1 60.366 26.164 0.99123 59.3741 59.538 26.358 0.99494 58.5431 58.899 26.824 0.98132 57.9171 58.747 26.915 0.98374 57.6931 60.594 25.903 1.0119 59.5821 60.366 25.964 0.99123 59.3741 59.2 27.193 1.0748 57.7671 58.2 27.422 1.1077 57.4241 60.366 26.164 0.99123 59.3741 59.971 26.072 0.9179 59.0531 59.419 26.587 1.0604 58.3591 58.891 27.061 1.1239 57.767B1 =1488.9-4.3582-9.6345-61.514-15.359m =12n =5B2 =3120.4-7129.2-622.23-362.71-105.061388.1120.25199.25379.58170.48-796.41ans =1.841 1.8449 -0.0039029.67 9.67 1.0058e-00923 23 1.397e-00938.12 38.12 3.539e-0101.8488 1.8488 1.6394e-0096.22 6.227.2643e-01012.22 12.22 2.6077e-01019.72 19.72 -2.0489e-0101.8488 1.8449 0.0039025.19 5.19 1.4529e-00910.09 10.09 1.0803e-00915.31 15.31 4.0978e-010由图形可以看出,多元二次线性回归效果非常好,即,相当于Y=3120.4*X1 -7129.2 *X2 + 0*X3+ 0*X4 -622.23*X1*X1 -362.71*X1*X2 -105.06*X1*X3 + 1388.1*X1*X4 +120.25*X2*X2+ 199.25 *X2*X3+ 379.58*X2*X4 + 170.48*X3*X3+ 0*X3*X4 -796.4。

matlab建立多元线性回归模型并进行显著性检验及预测问题

matlab建立多元线性回归模型并进行显着性检验及预测问题例子;x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]';X=[ones(16,1) x]; 增加一个常数项Y=[88 85 88 91 92 93 93 95 96 98 97 96 98 99 100 102]'; [b,bint,r,rint,stats]=regress(Y,X) 得结果:b = bint = stats = 即对应于b的置信区间分别为[,]、[,]; r2=, F=, p= p<, 可知回归模型y=+ 成立. 这个是一元的,如果是多元就增加X的行数!function [beta_hat,Y_hat,stats]=regress(X,Y,alpha)% 多元线性回归(Y=Xβ+ε)MATLAB代码%?% 参数说明% X:自变量矩阵,列为自变量,行为观测值% Y:应变量矩阵,同X% alpha:置信度,[0 1]之间的任意数据% beta_hat:回归系数% Y_beata:回归目标值,使用Y-Y_hat来观测回归效果% stats:结构体,具有如下字段% =[fV,fH],F检验相关参数,检验线性回归方程是否显着% fV:F分布值,越大越好,线性回归方程越显着% fH:0或1,0不显着;1显着(好)% =[tH,tV,tW],T检验相关参数和区间估计,检验回归系数β是否与Y有显着线性关系% tV:T分布值,beta_hat(i)绝对值越大,表示Xi对Y显着的线性作用% tH:0或1,0不显着;1显着% tW:区间估计拒绝域,如果beta(i)在对应拒绝区间内,那么否认Xi对Y显着的线性作用% =[T,U,Q,R],回归中使用的重要参数% T:总离差平方和,且满足T=Q+U% U:回归离差平方和% Q:残差平方和% R∈[0 1]:复相关系数,表征回归离差占总离差的百分比,越大越好% 举例说明% 比如要拟合y=a+b*log(x1)+c*exp(x2)+d*x1*x2,注意一定要将原来方程线化% x1=rand(10,1)*10;% x2=rand(10,1)*10;% Y=5+8*log(x1)+*exp(x2)+*x1.*x2+rand(10,1); % 以上随即生成一组测试数据% X=[ones(10,1) log(x1) exp(x2) x1.*x2]; % 将原来的方表达式化成Y=Xβ,注意最前面的1不要丢了% [beta_hat,Y_hat,stats]=mulregress(X,Y,%% 注意事项% 有可能会出现这样的情况,总的线性回归方程式显着的=1),% 但是所有的回归系数却对Y的线性作用却不显着=0),产生这种现象的原意是% 回归变量之间具有较强的线性相关,但这种线性相关不能采用刚才使用的模型描述,% 所以需要重新选择模型%C=inv(X'*X);Y_mean=mean(Y);% 最小二乘回归分析beta_hat=C*X'*Y; % 回归系数βY_hat=X*beta_hat; % 回归预测% 离差和参数计算Q=(Y-Y_hat)'*(Y-Y_hat); % 残差平方和U=(Y_hat-Y_mean)'*(Y_hat-Y_mean); % 回归离差平方和T=(Y-Y_mean)'*(Y-Y_mean); % 总离差平方和,且满足T=Q+UR=sqrt(U/T); % 复相关系数,表征回归离差占总离差的百分比,越大越好[n,p]=size(X); % p变量个数,n样本个数% 回归显着性检验fV=(U/(p-1))/(Q/(n-p)); % 服从F分布,F的值越大越好fH=fV>finv(alpha,p-1,n-p); % H=1,线性回归方程显着(好);H=0,回归不显着% 回归系数的显着性检验chi2=sqrt(diag(C)*Q/(n-p)); % 服从χ2(n-p)分布tV=beta_hat./chi2; % 服从T分布,绝对值越大线性关系显着tInv=tinv+alpha/2,n-p);tH=abs(tV)>tInv; % H(i)=1,表示Xi对Y显着的线性作用;H(i)=0,Xi对Y的线性作用不明显% 回归系数区间估计tW=[-chi2,chi2]*tInv; % 接受H0,也就是说如果在beta_hat(i)对应区间中,那么Xi与Y线性作用不明显stats=struct('fTest',[fH,fV],'tTest',[tH,tV,tW],'TUQR',[T,U,Q,R]);。

matlab多元线性回归

matlab多元线性回归Matlab多元线性回归是利用矩阵运算和统计学方法,来建立一个若干变量之间的线性关系模型。

Matlab可以实现多元线性回归,最常用的方法是最小二乘法(OrdinaryLeast Squares ,OLS)。

下面我们拟定一个多元线性回归问题,看看Matlab的意图如何解决它。

假设现在需要研究三个变量(X1,X2,X3)与输出Y的关系,则可以将Y与这三个变量的关系模型用下式表示:Y=β0+β1X1+β2X2+β3X3其中β0,β1,β2,β3等参数均未知,但是可以根据实验数据估计。

Matlab使用regress函数来实现多元线性回归,算法思想是为所有变量设定一组备用变量,然后拟合出令这些变量与被解释变量之间的最佳关系,从而实现多元回归模型的建立。

以上面那个例子来说,可以将X1,X2,X3的备用变量表示如:X1=1,X2=1,X3=1然后,可以建立如下的解释变量矩阵:Y=1×1+X1×X2+X2×X3+X3×1 ,注意第一行、第一列都是1,这是因为要拟合的模型中右侧的常数项,也就是β0。

一旦矩阵X(X表示解释变量组成的矩阵)和向量Y(被解释变量)建立完成,就可以使用Matlab中提供的regress函数了:[B,BINT,R,RINT,STATS]=regress(Y,X),其中B就是回归系数(参数β0,β1,β2,β3),BINT是该参数的置信区间,R是残差,RINT是拟合的置信区间,STATS包含 R2等其他统计量。

有了这些参数,就可以代入给定的回归模型,去预测Y的值,从而实现多元线性回归的目的。

Matlab多元线性回归可以更轻松便捷地实现复杂多变量间的相关性分析。

但是,在实际应用中,选取最优变量组以及其他模型调整是非常重要的,要仔细考虑实际问题所具有的特色,去尝试多种模型,才能得到最佳结果。

(完整版)Matlab线性回归(拟合)

Matlab 线性回归(拟合)对于多元线性回归模型:e x x y p p ++++=βββΛ110设变量12,,,p x x x y L 的n 组观测值为12(,,,)1,2,,i i ip i x x x y i n =L L .记 ⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=np n n p p x x x x x x x x x x ΛΛΛΛΛΛΛΛ212222*********,⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=n y y y y M 21,则⎪⎪⎪⎪⎪⎭⎫ ⎝⎛=p ββββM 10 的估计值为 y x x x b ')'(ˆ1-==β(11.2) 在Matlab 中,用regress 函数进行多元线性回归分析,应用方法如下:语法:b = regress(y, x)[b, bint, r, rint, stats] = regress(y, x)[b, bint, r, rint, stats] = regress(y, x, alpha)b = regress(y, x),得到的1+p 维列向量b 即为(11.2)式给出的回归系数β的估计值.[b, bint, r, rint, stats]=regress(y, x) 给出回归系数β的估计值b ,β的95%置信区间((1)2p +⨯向量)bint ,残差r 以及每个残差的95%置信区间(2⨯n 向量)rint ;向量stats 给出回归的R 2统计量和F 以及临界概率p 的值.如果i β的置信区间(bint 的第1i +行)不包含0,则在显著水平为α时拒绝0i β=的假设,认为变量i x 是显著的.[b, bint, r, rint, stats]=regress(y, x, alpha) 给出了bint 和rint 的100(1-alpha)%的置信区间.三次样条插值函数的MATLAB 程序matlab 的splinex = 0:10; y = sin(x); %插值点xx = 0:.25:10; %绘图点yy = spline(x,y,xx);plot(x,y,'o',xx,yy)非线性拟合非线性拟合可以用以下命令(同样适用于线形回归分析):1.beta = nlinfit(X,y,fun,beta0)X给定的自变量数据,Y给定的因变量数据,fun要拟合的函数模型(句柄函数或者内联函数形式),beta0函数模型中系数估计初值,beta返回拟合后的系数2.x = lsqcurvefit(fun,x0,xdata,ydata)fun要拟合的目标函数,x0目标函数中的系数估计初值,xdata自变量数据,ydata 函数值数据X拟合返回的系数(拟合结果)nlinfit格式:[beta,r,J]=nlinfit(x,y,’model’, beta0)Beta 估计出的回归系数r 残差J Jacobian矩阵x,y 输入数据x、y分别为n*m矩阵和n维列向量,对一元非线性回归,x为n维列向量。

多元回归分析报告matlab

回归分析MATLAB 工具箱一、多元线性回归多元线性回归:p p x x y βββ+++=...110 1、确定回归系数的点估计值: 命令为:b=regress(Y, X ) ①b 表示⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=p b βββˆ...ˆˆ10②Y 表示⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=n Y Y Y Y (2)1③X 表示⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡=np n n p p x x x x x x x x x X (1)............ (1) (12)12222111211 2、求回归系数的点估计和区间估计、并检验回归模型: 命令为:[b, bint,r,rint,stats]=regress(Y,X,alpha) ①bint 表示回归系数的区间估计. ②r 表示残差. ③rint 表示置信区间.④stats 表示用于检验回归模型的统计量,有三个数值:相关系数r 2、F 值、与F 对应的概率p.说明:相关系数2r 越接近1,说明回归方程越显著;)1,(1-->-k n k F F α时拒绝0H ,F 越大,说明回归方程越显著;与F 对应的概率p α<时拒绝H 0,回归模型成立. ⑤alpha 表示显著性水平(缺省时为0.05)3、画出残差及其置信区间. 命令为:rcoplot(r,rint) 例1.如下程序. 解:(1)输入数据.x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]'; X=[ones(16,1) x];Y=[88 85 88 91 92 93 93 95 96 98 97 96 98 99 100 102]'; (2)回归分析及检验.[b,bint,r,rint,stats]=regress(Y,X) b,bint,stats得结果:b = bint =-16.0730 -33.7071 1.5612 0.7194 0.6047 0.8340 stats =0.9282 .9531 0.0000即7194.0ˆ,073.16ˆ10=-=ββ;0ˆβ的置信区间为[-33.7017,1.5612], 1ˆβ的置信区间为[0.6047,0.834]; r 2=0.9282, F=180.9531, p=0.0000,我们知道p<0.05就符合条件, 可知回归模型 y=-16.+0.7194x 成立. (3)残差分析,作残差图. rcoplot(r,rint)从残差图可以看出,除第二个数据外,其余数据的残差离零点均较近,且残差的置信区间均包含零点,这说明回归模型 y=-16.+0.7194x 能较好的符合原始数据,而第二个数据可视为异常点. (4)预测及作图.z=b(1)+b(2)*x plot(x,Y,'k+',x,z,'r')二、多项式回归 (一)一元多项式回归.1、一元多项式回归:1121...+-++++=m m m m a x a x a x a y (1)确定多项式系数的命令:[p,S]=polyfit(x,y,m)说明:x=(x 1,x 2,…,x n ),y=(y 1,y 2,…,y n );p=(a 1,a 2,…,a m+1)是多项式y=a 1x m +a 2x m-1+…+a m x+a m+1的系数;S 是一个矩阵,用来估计预测误差. (2)一元多项式回归命令:polytool(x,y,m) 2、预测和预测误差估计.(1)Y=polyval(p,x)求polyfit 所得的回归多项式在x 处的预测值Y ;(2)[Y,DELTA]=polyconf(p,x,S,alpha)求polyfit 所得的回归多项式在x 处的预测值Y 及预测值的显著性为1-alpha 的置信区间Y ±DELTA ;alpha 缺省时为0.5.例1. 观测物体降落的距离s 与时间t 的关系,得到数据如下表,求s. (关于t 的回归方程2ˆct bt a s++=)解法一:直接作二次多项式回归. t=1/30:1/30:14/30;s=[11.86 15.67 20.60 26.69 33.71 41.93 51.13 61.49 72.90 85.44 99.08 113.77 129.54 146.48]; [p,S]=polyfit(t,s,2) 得回归模型为:1329.98896.652946.489ˆ2++=t t s解法二:化为多元线性回归. t=1/30:1/30:14/30;s=[11.86 15.67 20.60 26.69 33.71 41.93 51.13 61.49 72.90 85.44 99.08 113.77 129.54 146.48];T=[ones(14,1) t' (t.^2)']; [b,bint,r,rint,stats]=regress(s',T);b,stats 得回归模型为:22946.4898896.651329.9ˆt t s++= 预测及作图: Y=polyconf(p,t,S) plot(t,s,'k+',t,Y,'r')(二)多元二项式回归多元二项式回归命令:rstool(x,y,’model ’, alpha)说明:x 表示n ⨯m 矩阵;Y 表示n 维列向量;alpha :显著性水平(缺省时为0.05);model 表示由下列4个模型中选择1个(用字符串输入,缺省时为线性模型):linear(线性):m m x x y βββ+++=Λ110purequadratic(纯二次):∑=++++=nj j jjm m x x x y 12110ββββΛinteraction(交叉):∑≤≠≤++++=mk j k j jkm m x x x x y 1110ββββΛquadratic(完全二次):∑≤≤++++=mk j k j jkm m x x x x y ,1110ββββΛ例1. 设某商品的需求量与消费者的平均收入、商品价格的统计数据如下,建立回归模型,预测平均收入为1000、价格为6时的商品需求量. 需求量 100 75 80 70 50 65 90 100 110 60 收入10006001200500300400130011001300300价格5766875439解法一:选择纯二次模型,即2222211122110x x x x y βββββ++++=.直接用多元二项式回归:x1=[1000 600 1200 500 300 400 1300 1100 1300 300]; x2=[5 7 6 6 8 7 5 4 3 9];y=[100 75 80 70 50 65 90 100 110 60]'; x=[x1' x2'];rstool(x,y,'purequadratic')在左边图形下方的方框中输入1000,右边图形下方的方框中输入6,则画面左边的“Predicted Y ”下方的数据变为88.47981,即预测出平均收入为1000、价格为6时的商品需求量为88.4791.在画面左下方的下拉式菜单中选”all ”, 则beta 、rmse 和residuals 都传送到Matlab 工作区中.在Matlab 工作区中输入命令:beta, rmse 得结果:beta = 110.5313 0.1464 -26.5709 -0.0001 1.8475 rmse = 4.5362故回归模型为:2221218475.10001.05709.261464.05313.110x x x x y +--+=剩余标准差为4.5362, 说明此回归模型的显著性较好.解法二:将2222211122110x x x x y βββββ++++=化为多元线性回归:X=[ones(10,1) x1' x2' (x1.^2)' (x2.^2)']; [b,bint,r,rint,stats]=regress(y,X); b,stats 结果为: b =110.5313 0.1464 -26.5709 -0.0001 1.8475 stats =0.9702 40.6656 0.0005三、非线性回归 1、非线性回归:(1)确定回归系数的命令:[beta,r,J]=nlinfit(x,y,’model ’, beta0)说明:beta 表示估计出的回归系数;r 表示残差;J 表示Jacobian 矩阵;x,y 表示输入数据x 、y 分别为矩阵和n 维列向量,对一元非线性回归,x 为n 维列向量;model 表示是事先用m-文件定义的非线性函数;beta0表示回归系数的初值. (2)非线性回归命令:nlintool(x,y,’model ’, beta0,alpha) 2、预测和预测误差估计:[Y,DELTA]=nlpredci(’model ’, x,beta,r,J)表示nlinfit 或nlintool 所得的回归函数在x 处的预测值Y 及预测值的显著性为1-alpha 的置信区间Y ±DELTA. 例1. 如下程序.解:(1)对将要拟合的非线性模型y=a x b e /,建立m-文件volum.m 如下: function yhat=volum(beta,x) yhat=beta(1)*exp(beta(2)./x); (2)输入数据: x=2:16;y=[6.42 8.20 9.58 9.5 9.7 10 9.93 9.99 10.49 10.59 10.60 10.80 10.60 10.90 10.76];beta0=[8 2]'; (3)求回归系数:[beta,r ,J]=nlinfit(x',y','volum',beta0); beta (4)运行结果:beta =11.6036 -1.0641 即得回归模型为:xey 10641.16036.11-=(5)预测及作图:[YY,delta]=nlpredci('volum',x',beta,r ,J);plot(x,y,'k+',x,YY,'r')四、逐步回归1、逐步回归的命令:stepwise(x,y,inmodel,alpha)n⨯阶矩阵;y表示因变量数据,1⨯n阶矩阵;inmodel表示矩说明:x表示自变量数据,m阵的列数的指标,给出初始模型中包括的子集(缺省时设定为全部自变量);alpha表示显著性水平(缺省时为0.5).2、运行stepwise命令时产生三个图形窗口:Stepwise Plot,Stepwise Table,Stepwise History.在Stepwise Plot窗口,显示出各项的回归系数及其置信区间.(1)Stepwise Table窗口中列出了一个统计表,包括回归系数及其置信区间,以及模型的统计量剩余标准差(RMSE)、相关系数(R-square)、F值、与F对应的概率P.例1. 水泥凝固时放出的热量y与水泥中4种化学成分x1、x2、x3、x4有关,今测得一组数据如下,试用逐步回归法确定一个线性模型.解:(1)数据输入:x1=[7 1 11 11 7 11 3 1 2 21 1 11 10]';x2=[26 29 56 31 52 55 71 31 54 47 40 66 68]';x3=[6 15 8 8 6 9 17 22 18 4 23 9 8]';x4=[60 52 20 47 33 22 6 44 22 26 34 12 12]';y=[78.5 74.3 104.3 87.6 95.9 109.2 102.7 72.5 93.1 115.9 83.8 113.3 109.4]'; x=[x1 x2 x3 x4];(2)逐步回归.①先在初始模型中取全部自变量:stepwise(x,y)得图Stepwise Plot 和表Stepwise Table.图Stepwise Plot中四条直线都是虚线,说明模型的显著性不好.从表Stepwise Table中看出变量x3和x4的显著性最差.②在图Stepwise Plot中点击直线3和直线4,移去变量x3和x4.移去变量x3和x4后模型具有显著性虽然剩余标准差(RMSE)没有太大的变化,但是统计量F的值明显增大,因此新的回归模型更好.(3)对变量y和x1、x2作线性回归.X=[ones(13,1) x1 x2];b=regress(y,X)得结果:b =52.57731.46830.6623故最终模型为:y=52.5773+1.4683x1+0.6623x2或这种方法4元二次线性回归clc;clear;y=[1.84099 9.67 23.00 38.12 1.848794 6.22 12.22 19.72 1.848794 5.19 10.09 15.31 ];X1=[60.36558 59.5376 58.89861 58.74706 60.59389 60.36558 59.2 58.2 60.36558 59.97068 59.41918 5 X2=[26.1636 26.35804 26.82438 26.91521 25.90346 25.9636 27.19256 27.42153 26.1636 26.07212 26.27.06063];X3=[0.991227 0.994944 0.981322 0.98374 1.011865 0.991227 1.074772 1.107678 0.991227 0.917904 1 1.1239];X4=[59.37436 58.54265 57.91729 57.69332 59.58203 59.37436 57.76722 57.42355 59.37436 59.05278 57.76687];format short gY=y'X11=[ones(1,length(y));X1;X2;X3;X4]'B1=regress(Y,X11)% 多元一次线性回归[m,n]=size(X11)X22=[];for i=2:nfor j=2:nif i<=jX22=([X22,X11(:,i).*X11(:,j)]);elsecontinueendendendX=[X11,X22];B2=regress(Y,X)% 多元二次线性回归[Y X*B2 Y-X*B2]plot(Y,X11*B1,'o',Y,X*B2,'*')hold on,line([min(y),max(y)],[min(y),max(y)]) axis([min(y) max(y) min(y) max(y)]) legend('一次线性回归','二次线性回归') xlabel('实际值');ylabel('计算值')运行结果:Y =1.8419.672338.121.84886.2212.2219.721.84885.1910.0915.31X11 =1 60.366 26.164 0.99123 59.3741 59.538 26.358 0.99494 58.5431 58.899 26.824 0.98132 57.9171 58.747 26.915 0.98374 57.6931 60.594 25.903 1.0119 59.5821 60.366 25.964 0.99123 59.3741 59.2 27.193 1.0748 57.7671 58.2 27.422 1.1077 57.4241 60.366 26.164 0.99123 59.3741 59.971 26.072 0.9179 59.1 59.419 26.587 1.0604 58.3591 58.891 27.061 1.1239 57.767 B1 =1488.9-4.3582-9.6345-61.514-15.359m =12n =5B2 =3120.4-7129.2-622.23-362.71-105.061388.1120.25.25379.58170.48-796.41ans =1.841 1.8449 -0.0039029.67 9.67 1.0058e-00923 23 1.397e-00938.12 38.12 3.539e-1.8488 1.8488 1.6394e-0096.22 6.227.2643e-12.22 12.22 2.6077e-19.72 19.72 -2.0489e-1.8488 1.8449 0.0039025.19 5.19 1.4529e-00910.09 10.09 1.0803e-00915.31 15.31 4.0978e-由图形可以看出,多元二次线性回归效果非常好,即,相当于Y=3120.4*X1 -7129.2 *X2 + 0*X3 + 0*X4 -622.23*X1*X1 -362.71*X1*X2 -105.06*X1*X3 + 1388 120.25*X2*X2+ .25 *X2*X3+ 379.58*X2*X4 + 170.48*X3*X3+ 0*X3*X4 -796.41*X4*X4。

MATLAB多元回归

概述根据图形(实际点),选配一条恰当的函数形式(类型)---需要数学理论与基础和经验。

(并写出该函数表达式的一般形式,含待定系数)------选用某条回归命令求出所有的待定系数。

所以可以说,回归就是求待定系数的过程(需确定函数的形式)1、[b,bint,r,rint,s]=regress(y,X,alpha)或者regress(y, x)输入y :因变量(列向量)X:自变量组成的矩阵,并且x要在最前面额外添加全1列/对应于常数项alpha:显著性水平(缺省时定位0.05,即置信水平95%,alpha不影响b,只影响bint(区间估计)。

它越小,即置信度越高,则bint范围越大。

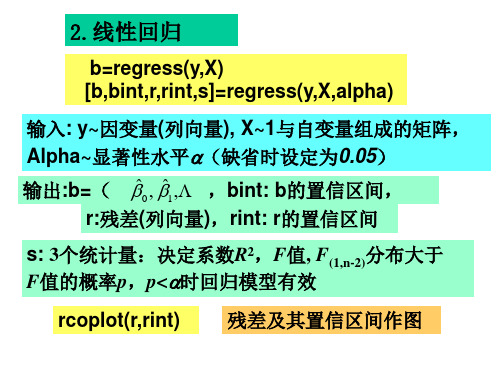

显著水平越高,则区间就越小)输出:b:多元线性回归方程的各个系数(含常数项,第一项为常数项)bint:b的置信区间(回归系数的区间估计)r:残差(列向量) rint:r的置信区间stats: 用于检验回归模型的统计量,有四个数值:相关系数r2、F值、与F对应的概率p和残差的方差(前两个越大越好,后两个越小越好)2、rcplot(r.rint)残差分析,作残差图如下图:matlab<wbr>多元线性回归每条线长度表示的是置信区间,小圆圈代表残差点。

残差图中红色线条表示异常点,应剔除再次进行绘图从残差图可以看出,除第二个和第十个数据外,其余数据的残差离零点均较近,且残差的置信区间均包含零点,这说明回归模型能较好的符合原始数据,而这两个数据可视为异常点(而剔除)3、实例分析如线性回归模型y =b0+b1X1+b2X2+b3X3+e回归系数b0-b3,由数据估计,e是随机误差y=b0+b1X1+b2X2+b3X3+b4X4+b5X5+b6X6+e1y=[144 215 138 145 162 142 170 124 158 154 162 150 140 110 128 130 135 114 116 124 136 142 120 120 160 158 144 130 125 175];x1=[39 47 45 47 65 46 67 42 67 56 64 56 59 34 42 48 45 18 20 19 36 50 39 21 44 53 63 29 25 69]; x2=[24.2 31.1 22.6 24.0 25.9 25.1 29.5 19.7 27.2 19.3 28.0 25.8 27.3 20.1 21.7 22.2 27.4 18.8 22.6 21.5 25.0 26.2 23.5 20.3 27.1 28.6 28.3 22.0 25.3 27.4];x3=[0 1 0 1 1 0 1 0 1 0 1 0 0 0 0 1 0 0 0 ...0 0 1 0 0 1 1 0 1 0 1];X=[ones(16,1), x1',x2',x3'];%ones(16,1) 添加常数列[b,bint,r,rint,stats]=regress(y',X);b,bint,statsrcoplot(r,rint)4、检验怎么对多元线性回归模型的回归系数β做t检验和F检验?进行多元线性回归统计数F, t 测验的小程序:clear,clcx=rand(50,10);y=rand(50,1); % example[n,k]=size(x);X=[ones(n,1),x];%构建结构阵X,A=X'*X; %求算信息阵A,C=inv(A); %求算信息阵的逆阵,b=X\y, % 求算回归统计数向量,其中第一行为回归截距a,RSS=y'*y-b'*X'*y, %求算离回归平方和,MSe=RSS/(n-k-1),%求算离回归方差,Up=b.*b./diag(C);%求算偏回归平方和,其中第一行是a与0差异的偏平方和,F=Up/MSe,%F测验,其中第一行为a与0差异的F值,sb=sqrt(MSe*diag(C)); %求算回归统计数标准误,t=b./sb, % 回归统计数的t 测验,其中第一行为a与0差异的t测验值。

Matlab多元线性回归

Matlab多元线性回归Matlab多元线性回归[ b , bint , r , rint , stats ]=regress ( y , x ) ,其中b 是回归⽅程中的参数估计值,bint 是b 的置信区间,r 和rint 分别表⽰残差及残差对应的置信区间。

StatS 数组包含三个数字,分别是相关系数,F 统计量及对应的概率p 值。

拟合结果:Y=b(1)x(1)+b(2)x(2)+b(3)x(3)+…+b(n)x(n)b(1)是系数,x(1)为全1的⼀个列向量。

注意:不是插值。

x=[1097 1284 1502 1394 1303 1555 1917 2051 2111 2286 2311 2003 2435 2625 2948 3155 3372];%因变量时间序列数据y=[698 872 988 807 738 1025 1316 1539 1561 1765 1762 1960 1902 2013 2446 2736 2825];%⾃变量时间序列数据X=[ones(size(x')),x'];[b,bint,r,rint,stats]=regress(y',X,0.05);%调⽤⼀元回归分析函数rcoplot(r,rint)%画出在置信度区间下误差分布.举例:x =1 2 4 91 4 3 71 5 9 01 9 1 8>> y=[10 3 90 48]';>> [ b , bint , r , rint , stats ]=regress ( y , x )得到的结果b =-186.833316.023821.85718.5952bint =NaN NaNNaN NaNNaN NaNNaN NaNr =1.0e-013 *-0.5684rint =NaN NaNNaN NaNNaN NaNNaN NaNstats =1 NaN NaN NaN另外,⽤b=inv(x)*y得到的结果和上⾯⽤regression得到的⼀样。

MATLAB中多元线性回归

0 1 2 3

R2= 0.8462 F= 44.0087 p<0.0001 s2 =53.6604

这时置信区间不包含零点,F统计量增大,可决系 数从0.6855增大到0.8462 ,我们得到回归模型为:

ˆ 58 . 5101 0 . 4303 x 1 2 . 3449 x 2 10 . 3065 x 3 y

y与x1的散点图 线性回归模型

y与x2的散点图

y 0 1 x1 2 x 2 3 x 3

回归系数0, 1, 2, 3 由数据估计, 是随机误差

n=30;m=3; y=[144 215 138 145 162 142 170 124 158 154 162 150 140 110 128 130 135 114 116 124 136 142 120 120 160 158 144 130 125 175]; x1=[39 47 45 47 65 46 67 42 67 56 64 56 59 34 42 48 45 18 20 19 36 50 39 21 44 53 63 29 25 69]; x2=[24.2 31.1 22.6 24.0 25.9 25.1 29.5 19.7 27.2 19.3 28.0 25.8 27.3 20.1 21.7 22.2 27.4 18.8 22.6 21.5 25.0 26.2 23.5 20.3 27.1 28.6 28.3 22.0 25.3 27.4]; x3=[0 1 0 1 1 0 1 0 1 0 1 0 0 0 0 1 0 0 0 0 0 1 0 0 1 1 0 1 0 1];

n n

DW

t2

( e t e t 1 ) /

2

利用MATLAB进行多元线性回归

模型建立

血压y,年龄x1,体重指数x2,吸烟习惯x3

y与x1的散点图 线性回归模型

y与x2的散点图

y x x x 0 1 1 2 2 3 3

回归系数0, 1, 2, 3 由数据估计, 是随机误差

n=30;m=3; y=[144 215 138 145 162 142 170 124 158 154 162 150 140 110 128 130 135 114 116 124 136 142 120 120 160 158 144 130 125 175]; x1=[39 47 45 47 65 46 67 42 67 56 64 56 59 34 42 48 45 18 20 19 36 50 39 21 44 53 63 29 25 69]; x2=[24.2 31.1 22.6 24.0 25.9 25.1 29.5 19.7 27.2 19.3 28.0 25.8 27.3 20.1 21.7 22.2 27.4 18.8 22.6 21.5 25.0 26.2 23.5 20.3 27.1 28.6 28.3 22.0 25.3 27.4]; x3=[0 1 0 1 1 0 1 0 1 0 1 0 0 0 0 1 0 0 0 ... 0 0 1 0 0 1 1 0 1 0 1];

(4)对回归模型进行检验 首先进行残差的正态性检验:jbtest,ttest

其次进行残差的异方差检验: 戈德菲尔德一匡特 (Goldfeld—Quandt)检验 戈德菲尔德检验,简称为G—Q检验.为了检验异方差 性,将样本按解释变量排序后分成两部分,再利用样 本1和样本2分别建立回归模型,并求出各自的残差平 方和RSSl和RSS2。如果误差项的离散程度相同(即为 同方差的),则RSSl和RSS2的值应该大致相同;若两 者之间存在显著差异,则表明存在异方差. 检验过程 中为了“夸大”残差的差异性,一般先在样本中部去 掉C个数据(通常取c=n/4),再利用F统计量判断差 异的显著性:

MATLAB 回归分析regress,nlinfit,stepwise函数

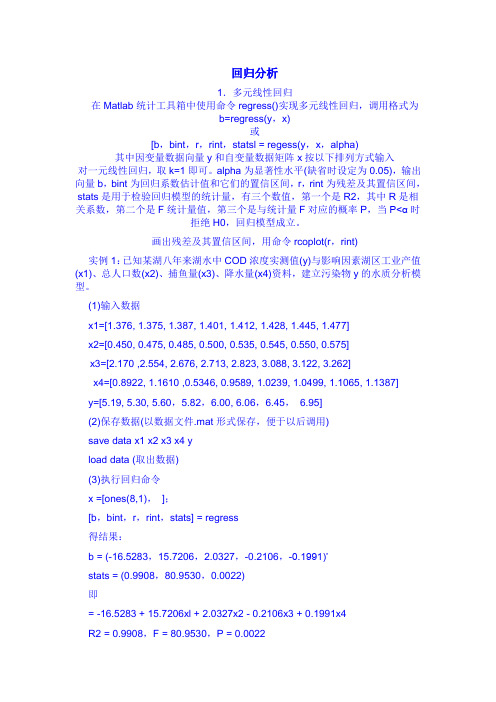

回归分析1.多元线性回归在Matlab统计工具箱中使用命令regress()实现多元线性回归,调用格式为b=regress(y,x)或[b,bint,r,rint,statsl = regess(y,x,alpha)其中因变量数据向量y和自变量数据矩阵x按以下排列方式输入对一元线性回归,取k=1即可。

alpha为显著性水平(缺省时设定为0.05),输出向量b,bint为回归系数估计值和它们的置信区间,r,rint为残差及其置信区间,stats是用于检验回归模型的统计量,有三个数值,第一个是R2,其中R是相关系数,第二个是F统计量值,第三个是与统计量F对应的概率P,当P<α时拒绝H0,回归模型成立。

画出残差及其置信区间,用命令rcoplot(r,rint)实例1:已知某湖八年来湖水中COD浓度实测值(y)与影响因素湖区工业产值(x1)、总人口数(x2)、捕鱼量(x3)、降水量(x4)资料,建立污染物y的水质分析模型。

(1)输入数据x1=[1.376, 1.375, 1.387, 1.401, 1.412, 1.428, 1.445, 1.477]x2=[0.450, 0.475, 0.485, 0.500, 0.535, 0.545, 0.550, 0.575]x3=[2.170 ,2.554, 2.676, 2.713, 2.823, 3.088, 3.122, 3.262]x4=[0.8922, 1.1610 ,0.5346, 0.9589, 1.0239, 1.0499, 1.1065, 1.1387]y=[5.19, 5.30, 5.60,5.82,6.00, 6.06,6.45,6.95](2)保存数据(以数据文件.mat形式保存,便于以后调用)save data x1 x2 x3 x4 yload data (取出数据)(3)执行回归命令x =[ones(8,1),];[b,bint,r,rint,stats] = regress得结果:b = (-16.5283,15.7206,2.0327,-0.2106,-0.1991)’stats = (0.9908,80.9530,0.0022)即= -16.5283 + 15.7206xl + 2.0327x2 - 0.2106x3 + 0.1991x4R2 = 0.9908,F = 80.9530,P = 0.00222.非线性回归非线性回归可由命令nlinfit来实现,调用格式为[beta,r,j] = nlinfit(x,y,'model’,beta0)其中,输人数据x,y分别为n×m矩阵和n维列向量,对一元非线性回归,x 为n维列向量model是事先用m-文件定义的非线性函数,beta0是回归系数的初值,beta是估计出的回归系数,r是残差,j是Jacobian矩阵,它们是估计预测误差需要的数据。

matlab多元线性回归模型

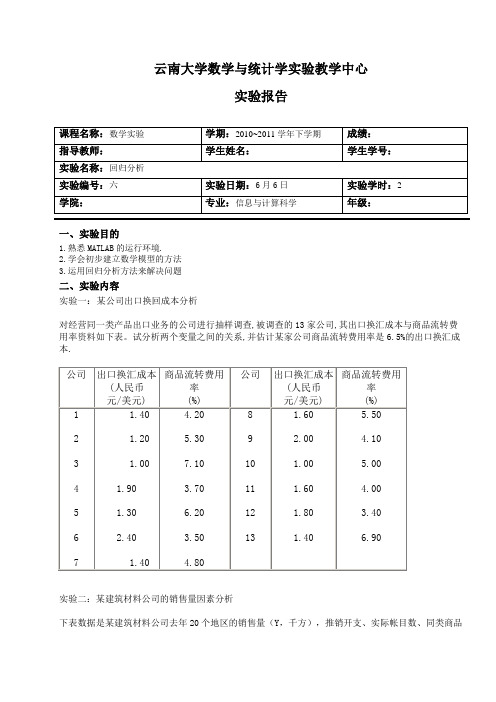

云南大学数学与统计学实验教学中心实验报告一、实验目的1.熟悉MATLAB的运行环境.2.学会初步建立数学模型的方法3.运用回归分析方法来解决问题二、实验内容实验一:某公司出口换回成本分析对经营同一类产品出口业务的公司进行抽样调查,被调查的13家公司,其出口换汇成本与商品流转费用率资料如下表。

试分析两个变量之间的关系,并估计某家公司商品流转费用率是6.5%的出口换汇成本.实验二:某建筑材料公司的销售量因素分析下表数据是某建筑材料公司去年20个地区的销售量(Y,千方),推销开支、实际帐目数、同类商品竞争数和地区销售潜力分别是影响建筑材料销售量的因素。

1)试建立回归模型,且分析哪些是主要的影响因素。

2)建立最优回归模型。

提示:建立一个多元线性回归模型。

三、实验环境Windows 操作系统; MATLAB 7.0.四、实验过程实验一:运用回归分析在MATLAB 里实现输入:x=[4.20 5.30 7.10 3.70 6.20 3.50 4.80 5.50 4.10 5.00 4.00 3.40 6.90]'; X=[ones(13,1) x];Y=[1.40 1.20 1.00 1.90 1.30 2.40 1.40 1.60 2.00 1.00 1.60 1.80 1.40]'; plot(x,Y,'*');[b,bint,r,rint,stats]=regress(Y,X,0.05); 输出: b = 2.6597 -0.2288bint = 1.8873 3.4322-0.3820 -0.0757stats = 0.4958 10.8168 0.0072 0.0903即==1,0ˆ6597.2ˆββ,-0.2288,0ˆβ的置信区间为[1.8873 3.4322],1,ˆβ的置信区间为[-0.3820 -0.0757]; 2r =0.4958, F=10.8168, p=0.0072 因P<0.05, 可知回归模型 y=2.6597-0.2288x 成立.11.522.5散点图估计某家公司商品流转费用率是6.5%的出口换汇成本。

matlab多元拟合

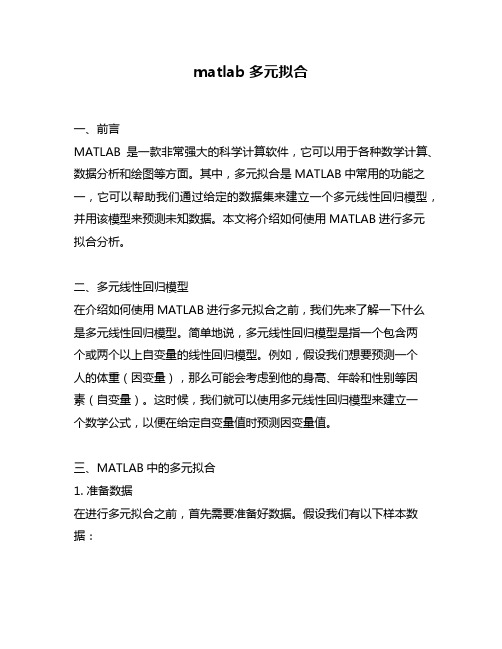

matlab多元拟合一、前言MATLAB是一款非常强大的科学计算软件,它可以用于各种数学计算、数据分析和绘图等方面。

其中,多元拟合是MATLAB中常用的功能之一,它可以帮助我们通过给定的数据集来建立一个多元线性回归模型,并用该模型来预测未知数据。

本文将介绍如何使用MATLAB进行多元拟合分析。

二、多元线性回归模型在介绍如何使用MATLAB进行多元拟合之前,我们先来了解一下什么是多元线性回归模型。

简单地说,多元线性回归模型是指一个包含两个或两个以上自变量的线性回归模型。

例如,假设我们想要预测一个人的体重(因变量),那么可能会考虑到他的身高、年龄和性别等因素(自变量)。

这时候,我们就可以使用多元线性回归模型来建立一个数学公式,以便在给定自变量值时预测因变量值。

三、MATLAB中的多元拟合1. 准备数据在进行多元拟合之前,首先需要准备好数据。

假设我们有以下样本数据:x1 = [1, 2, 3, 4, 5]';x2 = [0.5, 1.0, 1.5, 2.0, 2.5]';y = [2.5, 3.8, 4.9, 6.1, 7.2]';其中,x1和x2是两个自变量的取值,y是因变量的取值。

这里我们只有5个样本数据,实际应用中可能需要更多的数据。

2. 建立模型在MATLAB中,可以使用fitlm函数来建立一个多元线性回归模型。

例如,我们可以使用以下代码来建立一个包含两个自变量的模型:X = [x1 x2];mdl = fitlm(X,y,'linear');其中,X是自变量矩阵,y是因变量向量,'linear'表示采用线性回归模型。

运行以上代码后,MATLAB将会输出该模型的详细信息。

3. 模型分析建立好模型之后,我们可以对其进行分析。

例如,可以使用mdl.Coefficients来查看每个自变量的系数和常数项:disp(mdl.Coefficients);这将输出如下结果:Estimate StdError tStat pValue(Intercept) -0.0836 0.4929 -0.1695 0.8808x1 1.9008 0.2883 6.5927 <0.0001x2 1.8484 0.3657 5.0454 <0.0001从上面的结果可以看出,自变量x1和x2对因变量y的影响都是显著的(p值<0.05),而常数项的影响不显著(p值>0.05)。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

云南大学数学与统计学实验教学中心

实验报告

一、实验目的

1.熟悉MATLAB的运行环境.

2.学会初步建立数学模型的方法

3.运用回归分析方法来解决问题

二、实验内容

实验一:某公司出口换回成本分析

对经营同一类产品出口业务的公司进行抽样调查,被调查的13家公司,其出口换汇成本与商品流转费用率资料如下表。

试分析两个变量之间的关系,并估计某家公司商品流转费用率是6.5%的出口换汇成本.

实验二:某建筑材料公司的销售量因素分析

下表数据是某建筑材料公司去年20个地区的销售量(Y,千方),推销开支、实际帐目数、同类商品

竞争数和地区销售潜力分别是影响建筑材料销售量的因素。

1)试建立回归模型,且分析哪些是主要的影响因素。

2)建立最优回归模型。

提示:建立一个多元线性回归模型。

三、实验环境

Windows 操作系统; MATLAB 7.0.

四、实验过程

实验一:运用回归分析在MATLAB 里实现

输入:x=[4.20 5.30 7.10 3.70 6.20 3.50 4.80 5.50 4.10 5.00 4.00 3.40 6.90]'; X=[ones(13,1) x];

Y=[1.40 1.20 1.00 1.90 1.30 2.40 1.40 1.60 2.00 1.00 1.60 1.80 1.40]'; plot(x,Y,'*');

[b,bint,r,rint,stats]=regress(Y,X,0.05); 输出: b = 2.6597 -0.2288

bint = 1.8873 3.4322

-0.3820 -0.0757

stats = 0.4958 10.8168 0.0072 0.0903

即==1,0ˆ6597.2ˆββ,-0.2288,0ˆβ的置信区间为[1.8873 3.4322],1,ˆβ的置信区间为[-0.3820 -0.0757]; 2r =0.4958, F=10.8168, p=0.0072 因P<0.05, 可知回归模型 y=2.6597-0.2288x 成立.

1

1.5

2

2.5

散点图

估计某家公司商品流转费用率是6.5%的出口换汇成本。

将x=6.5代入回归模型中,得到 >> x=6.5;

>> y=2.6597-0.2288*x y =

1.1725

实验二:在MATLAB 里实现, ①首先建立回归模型 输出:

x1=[5.5 2.5 8.0 3.0 3.0 2.9 8.0 9.0 4.0 6.5 5.5 5.0 6.0 5.0 3.5 8.0 6.0 4.0 7.5 7.0]'; x2=[31 55 67 50 38 71 30 56 42 73 60 44 50 39 55 70 40 50 62 59]'; x3=[10 8 12 7 8 12 12 5 8 5 11 12 6 10 10 6 11 11 9 9]'; x4=[8 6 9 16 15 17 8 10 4 16 7 12 6 4 4 14 6 8 13 11]';

Y=[79.3 200.1 163.2 200.1 146.0 177.7 30.9 291.9 160.0 339.4 159.6 86.3 237.5 107.2 155.0 201.4 100.2 135.8 223.3 195.0]'; X=[ones(20,1) x1 x2 x3 x4];

[b,bint,r,rint,stats]=regress(Y,X,0.05); b,bint,stats 输出: b = 191.9158 -0.7719 3.1725 -19.6811 -0.4501 bint =

103.1071 280.7245 -7.1445 5.6007 2.0640 4.2809 -25.1651 -14.1972 -3.7284 2.8283 stats =

0.9034 35.0509 0.0000 644.6510

即0ˆβ= 191.9158 1,ˆβ=-0.7719 2ˆβ= 3.1725 3

ˆβ=-19.6811 4ˆβ=-0.4501; 0ˆβ的置信区间为[103.1071 280.7245];1,ˆβ的置信区间为[-7.1445 5.6007];2ˆβ的置信区间为[2.0640 4.2809];3

ˆβ的置信区间为[-25.1651 -14.1972];4ˆβ的置信区间为[-3.7284 2.8283]; 2r = 0.9034, F=35.0509, p=0.0000

因P<0.05, 可知回归模型 y=191.9158 -0.7719x1+3.1725*x2-19.6811*x3 -0.4501*x4成立. ②分析哪些是主要的影响因素

输入:x1=[5.5 2.5 8.0 3.0 3.0 2.9 8.0 9.0 4.0 6.5 5.5 5.0 6.0 5.0 3.5 8.0 6.0 4.0 7.5 7.0]'; x2=[31 55 67 50 38 71 30 56 42 73 60 44 50 39 55 70 40 50 62 59]'; x3=[10 8 12 7 8 12 12 5 8 5 11 12 6 10 10 6 11 11 9 9]'; x4=[8 6 9 16 15 17 8 10 4 16 7 12 6 4 4 14 6 8 13 11]';

Y=[79.3 200.1 163.2 200.1 146.0 177.7 30.9 291.9 160.0 339.4 159.6 86.3 237.5 107.2 155.0

201.4 100.2 135.8 223.3 195.0]'; X=[x1 x2 x3 x4]; stepwise(X,Y);

X 1

X 2X 3X 4

Coefficients with Error Bars

1

71

727374Model History

R M S E

从表Stepwise Table 中分析得出变量x2和x3为主要的影响因素。

-25

-20

-15

-10

-5

5

X 1

X 2X 3X 4

Coefficients with Error Bars

1

2

3

20

406080Model History

R M S E

③移去非关键变量x1和x4后模型具有显著性.虽然剩余标准差(RMSE)都有了变化,统计量F的值明显增大,因此新的回归模型更好.就得到最优模型。

输入:

X1=[ones(20,1) x2 x3];

[b,bint,r,rint,stats]=regress(Y,X1);

b,bint,stats

输出:

b =

186.0484

3.0907

-19.5140

bint =

110.4254 261.6715

2.1657 4.0156

-24.5597 -14.4683

stats =

0.9024 78.6295 0.0000 574.1580

P=0.0000<0.05,说明回归模型的回归效果显著;

最优回归方程为:y=186.0484+3.0907*x2-19.5140*x3

五、实验总结

1.遇到的问题及解决过程

2.产生的错误及原因分析

3.体会和收获

六、参考文献

[1]数学实验,重庆大学数学系傅鹂、龚劬、刘琼荪、何中市编著,科学出版社,2000年9月.

七、教师评语。