最新01一元线性回归分析lm

《一元线性回归》课件

使用评价指标对模型的性能进行评估。

《一元线性回归》PPT课 件

一元线性回归是一种用于探索变量之间关系的统计方法。本课件将介绍一元 线性回归的基本概念、模型、参数估计、模型评估以及Python实现。

一元线性回归-简介

一元线性回归是一种分析两个变量之间线性关系的方法。在这一节中,我们 将介绍一元线性回归的定义、使用场景以及它的重要性。

决定系数

4

方的平均值。

衡量模型对观测值的解释能力,取值范 围从0到1。

一元线性回归-Python实现

导入数据

使用Python的pandas库导入数据集。

划分数据集

将数据集划分为训练集和测试集。

预测结果

使用测试集数据对模型进行预测。

特征工程

选择合适的特征并对其进行处理。

训练模型

使用训练集数据训练线性Байду номын сангаас归模型。

一元线性回归-线性回归模型

1

简单线性回归模型

一个自变量和一个因变量之间的线性关

多元线性回归模型

2

系。

多个自变量和一个因变量之间的线性关

系。

3

线性回归模型的假设

包括线性关系、平均误差为零、误差具 有相同的方差、误差相互独立等。

一元线性回归-模型参数估计

1

最小二乘法

通过最小化观测值和模型预测值之间的平方误差来估计模型参数。

2

矩阵求导

使用矩阵求导的方法来计算模型参数的最优解。

3

梯度下降法

通过迭代的方式逐步优化模型参数,使得模型预测值与观测值之间的差距最小。

一元线性回归-模型评估

1

对模型误差的描述

通过各种指标来描述模型预测值和观测

一类线性回归模型异方差性的LM检验

1

i

,

2 举例

考虑如下一元线 性回归模型 : y i = β 0 +β 1 xi + ξ ei , 其中 x i 由如下方式生成 : x i =ξ i ; i ~ U ( 1 , 31 ) , i = 1 , …, n 。 式中 U ( 1 , 31) 为区间 ( 1 , 31) 上的均匀分布 , ei ( i

此时对于模型 ( 1) , 假设检验 ( 2) 又可表述为

3 收稿日期 : 2008203210 作者简介 : 李华鹏( 1981 - ) ,男 ,河南周口人 ,在读硕士 ,主要从事数理统计研究 , ( T el ) 13485349793

290 θ ) 5L ( � 1 = θ 5 2 1 2 θ ) 5 L( � θ θ 5 5 ′

形式 :

2 σ (α (3) i = σ 0 +α ′ Zi ) , 其中σ( ) 是一个可 微函 数 ,σ(α ′ 0 ) > 0 ,且σ ( α (α ( α α 0 ) > 0 (这里 σ ′ 0 ) 表示 σ 0 ) 的导数 ) , 0 和 α=

并定 义 ^ e i = yi - β ^0 ML - β ^1 ML x i1 … - β ^ ( p - 1) ML

(2)

然估计为 β v ML = ( ^ ^ 0ML β ,^1 ML ,β ^ ( p- 1) ML ) ′ ,

2 2 2 vi = ( 1 , x , …, x iq ) ′ , g i = ei / σ i - 1 , i = 1 , …, n 2 i1

2 在处理统计假设 ( 2 ) 时 , 通常假定σ i 具有如下

2 2 n n

太 原 理 工 大 学 学 报 第 39 卷

一元线性回归分析

总体回归函数

·y i4

y01x

样本回归

·y i 3

yˆ0ˆ1x 函数

yi0

· y i0 0 1 x i E y x x i

·y ·y

i i

2 1

0

2019/11/5

xi 朱晋

x

16

• 回归函数(PRF)说明被解释变量Y的平均状态

(总体条件期望)随解释变量X变化的规律。

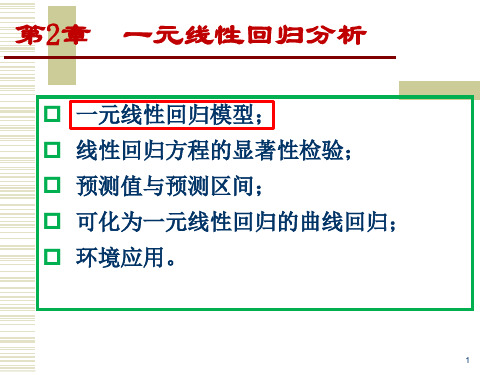

第2章 一元线性回归分析

• §2.1 :回归分析及回归模型 • §2.2 :一元线性模型的参数估计 • §2.3 :参数估计值的性质及统计推断 • §2.4 :一元线性模型的统计检验 • §2.5 :一元线性模型的预测

2019/11/5

朱晋

1

§2.1 :回归分析及回归模型

一、变量间的关系及回归分析的基本概念 二、总体回归函数 三、随机扰动项 和总体回归模型的基本假设 四、样本回归函数

2019/11/5

朱晋

24

该样本的散点图(scatter diagram):

1700 1500 1300 Y 1100

900 700 500

0

500

1000

1500 X

2000

2500

3000

样本散点图近似于一条直线,画一条直线以尽可能好地拟

合该散点图,由于样本取自总体,可以该线近似地代表总体回 归线。该线称为样本回归线(sample regression lines),其函 数形式记为:

• 函数形式可以是线性或非线性的。

例2.1中:E(Y|Xi)01Xi 为 一线 性 函数 。 其中,1与 2 为未知然而固定的参数,称为回归系数 (regressioncoefficients) 。

一元线性回归分析

模型评估指标

模型评估指标用于衡量回归模型的拟合优度和预测精度。常用的指标包括均 方误差、决定系数和标准化残差等,可以帮助我们评估模型的有效性和适用 性。

参数估计方法

参数估计是确定回归模型中各个参数的取值的过程。常用的参数估计方法包括最小二乘法、最大似然估 计法和贝叶斯估计法等,可以帮助我们找到最优的参数估计结果。

一元线性回归分析

回归分析是一种用于建立变量之间关系的统计方法。本演示将介绍一元线性 回归模型的构建、参数估计、模型假设检验以及模型预测和应用。

回归分析的概述

回归分析是一种通过建立变量之间的关系来描述和预测现象的统计方法。它 可以帮助我们理解变量之间的因果关系,并从中推断出未知的检验

模型假设检验用于验证回归模型的假设是否成立。常见的假设检验包括检验回归系数的显著性、整体模 型的显著性以及模型的线性关系等,可以帮助我们判断模型是否可靠。

回归诊断和残差分析

回归诊断和残差分析通过检查模型的残差来评估模型的拟合优度和假设的满 足程度。常用的诊断方法包括残差图、QQ图和离群值分析等,可以帮助我们 发现模型的不足和改进方向。

模型预测和应用

回归模型可以用于预测未知观测值,并帮助我们做出决策和制定策略。它在经济学、社会科学、医学等 领域具有广泛的应用,可以为决策者提供有力的数据支持。

一元线性回归分析

一元线性回归分析摘要:一元线性回归分析是一种常用的预测和建模技术,广泛应用于各个领域,如经济学、统计学、金融学等。

本文将详细介绍一元线性回归分析的基本概念、模型建立、参数估计和模型检验等方面内容,并通过一个具体的案例来说明如何应用一元线性回归分析进行数据分析和预测。

1. 引言1.1 背景一元线性回归分析是通过建立一个线性模型,来描述自变量和因变量之间的关系。

通过分析模型的拟合程度和参数估计值,我们可以了解自变量对因变量的影响,并进行预测和决策。

1.2 目的本文的目的是介绍一元线性回归分析的基本原理、建模过程和应用方法,帮助读者了解和应用这一常用的数据分析技术。

2. 一元线性回归模型2.1 模型表达式一元线性回归模型的基本形式为:Y = β0 + β1X + ε其中,Y是因变量,X是自变量,β0和β1是回归系数,ε是误差项。

2.2 模型假设一元线性回归模型的基本假设包括:- 线性关系假设:自变量X与因变量Y之间存在线性关系。

- 独立性假设:每个观测值之间相互独立。

- 正态性假设:误差项ε服从正态分布。

- 同方差性假设:每个自变量取值下的误差项具有相同的方差。

3. 一元线性回归分析步骤3.1 数据收集和整理在进行一元线性回归分析之前,需要收集相关的自变量和因变量数据,并对数据进行整理和清洗,以保证数据的准确性和可用性。

3.2 模型建立通过将数据代入一元线性回归模型的表达式,可以得到回归方程的具体形式。

根据实际需求和数据特点,选择适当的变量和函数形式,建立最优的回归模型。

3.3 参数估计利用最小二乘法或最大似然法等统计方法,估计回归模型中的参数。

通过最小化观测值与回归模型预测值之间的差异,找到最优的参数估计值。

3.4 模型检验通过对回归模型的拟合程度进行检验,评估模型的准确性和可靠性。

常用的检验方法包括:残差分析、显著性检验、回归系数的显著性检验等。

4. 一元线性回归分析实例为了更好地理解一元线性回归分析的应用,我们以房价和房屋面积之间的关系为例进行分析。

第一节一元线性回归分析-

一元线性回归模型

x的线性函数 随机误差

二、未知参数的估计

Y x , ~ N (0 ,2 ).

对 于 样 本 ( x 1 , Y 1 ) , ( x 2 , Y 2 ) ,, ( x n , Y n ) , 它 满 足

n

x2

] 2

(xi x)2

i 1

则ˆ ~N(,[1

n

n

x2

]2)

(xi x)2

i1

3 .对 x x 0 , 回 归 方 程 Y ˆ 0 = ˆ ˆ x 0 的 分 布

n

Y ˆ0ˆˆx0i n1(n 1n (x(ixi x)xx)2)Yi in 1((xxiixx))x20Yi

(

n i 1

xi

n

( xi

i 1

)ˆ (

) ˆ

n i 1

xi2

n i 1

)ˆ

yi

n i 1

xi

yi

12ˆ 800ˆ 811 800ˆ 53418ˆ 54107

求解得

ˆ= 35.82 ˆ0.476

则 Y 关 于 x 的 线 性 回 归 方 程 为

i 1

i 1

2. (,)的最大似然估 根 计 Y 据 1,Y2, ,Yn的独立性可度 得函 到数 联

Li n 11 2πexp 2 12(yixi)2

(1 2π)nexp 2 12i n 1(yixi)2 .

观 察 散 点 图 ,( x ) 具 有 线 性 函 数 x 的 形 式 .

2.建立回归模型

(x)x一元线性回归问题

01一元线性回归分析lm

一元线性回归分析1一元回归分析在进行回归分析时,我们必需知道或假定在两个随机之间存在着一定的关系。

这种关系可以用Y 的函数的形式表示出来,即Y 是所谓的因变量,它仅仅依赖于自变量X ,它们之间的关系可以用方程式表示。

在最简单的情况下,Y 与X 之间的关系是线性关系。

用线性函数a+bX 来估计Y 的数学期望的问题称为一元线性回归问题。

即,上述估计问题相当于对x 的每一个值,假设bx a y E +=)(,而且,),(~2σbx a N y +,其中a, b, σ2都是未知参数,并且不依赖于x 。

对y作这样的正态假设,相当于设:ε++=bx a y(3)其中),0(~2σεN ,为随机误差,a, b, σ2都是未知参数。

这种线性关系的确定常常可以通过两类方法,一类是根据实际问题所对应的理论分析,如各种经济理论常常会揭示一些基本的数量关系;另一种直观的方法是通过Y 与X 的散点图来初步确认。

对于公式(3)中的系数a 、b ,需要由观察值),(i i y x 来进行估计。

如果由样本得到了a ,b 的估计值为b aˆ,ˆ,则对于给定的x ,a+bx 的估计为x b aˆˆ+,记作y ˆ,它也就是我们对y 的估计。

方程 x b a yˆˆˆ+= (4)称为y 对x 的线性回归方程,或回归方程,其图形称为回归直线。

例1:有一种溶剂在不同的温度下其在一定量的水中的溶解度不同,现测得这种溶剂在温度x 下,溶解于水中的数量y 如下表所示:这里x 是自变量,y 是随机变量,我们要求y 对x 的回归。

其散点图如下:2.确定回归系数(应用最小二乘法)在样本的容量为n 的情况下,我们我们可以得到n 对观察值为),(i i y x 。

现在我们要利用这n 对观察值来估计参数a ,b 。

显然,y 的估计值为:bx a y+=ˆ 在上式中a ,b 为待估计的参数。

估计这两个参数的方法有极大似然法和最小二乘法。

其中最小二乘法是求经验公式时最常用的一种方法,也最简单。

第三章一元线性回归分析

第三章 一元线性回归一元线性回归分析的对象是两个变量的单向因果关系,模型的核心是两变量线性函数,分析方法是回归分析。

一元线性回归是经典计量经济分析的基础。

第一节一元线性回归模型一、变量间的统计关系社会经济现象之间的相互联系和制约是社会经济的普遍规律。

在一定的条件下,一些因素推动或制约另外一些与之联系的因素发生变化。

这种状况表明在经济现象的内部和外部联系中存在着一定的因果关系,人们往往利用这种因果关系来制定有关的经济政策,以指导、控制社会经济活动的发展。

而认识和掌握客观经济规律就要探求经济现象间经济变量的变化规律。

互有联系的经济变量之间的紧密程度各不相同,一种极端的情况是一个变量能完全决 定另一个变量的变化。

比如:工业企业的原材料消耗金额用y 表示,生产量用1x 表示,单位产量消耗用2x 表示,原材料价格用3x 表示,则有:123y x x x =。

这里,y 与123,,x x x ,是一种确定的函数关系。

然而,现实世界中,还有不少情况是两个变量之间有着密切的联系,但它们并没有密切到由一个可以完全确定另一个的程度。

例如:某种高档费品的销售量与城镇居民的收入;粮食产量与施肥量之间的关系;储蓄额与居民的收入密切相关。

从图示上可以大致看出这两种关系的区别:一种是对应点完全落到一条函数曲线上;另一种是并不完全落在曲线上,而有的点在曲线上,有的点在曲线的两边。

对于后者这种不能用精确的函数关系来描述的关系正是计量经济学研究的重要内容。

二、一元线性回归模型 1.模型的建立一个例子,见教材66页:总体回归模型:01i i i Y X ββε=++ 理解:(1)误差的随机性使得Y 和X 之间呈现一种随机的因果关系;(2)Y i 的取值由两部分组成,一类是系统内影响,一类是系统外影响。

样本回归直线:01i i Y X ββ=+样本回归模型:01i i i Y X e ββ=++2.模型的假设(1) 误差项i ε的数学期望无论I 取什么值都是零。

一元线性回归法linlm

b

x y xy x2 x2

101.8389 ,

a y bx -28.6883

y

[ yi (a bxi )]2 n2

0.931912

利用肖维涅舍弃判据来剔除测量值中带有粗差的数 据,列表如下(n=16时,Cu=2.15):

y'=a+bxi-Cu·σy

y"=a+bxi+Cu·σy

令Y lห้องสมุดไป่ตู้ y, X x,A lna, B b

则方程可化为:Y A BX

可求得,BA

A B

A B

Alna,Bba b

eA eAA B B

线性方程 y a bx

a y bx

xy x y

,

b

x2 x2

a b. x2

b

n(

x

1 2

x

2

)

.

y

r

xy x y

n 14 15 16 17 18 19 20 21 22 Cu 2.10 2.13 2.15 2.17 2.20 2.22 2.24 2.26 2.28

n 23 24 25 30 40 50 75 100 200 Cu 2.30 2.31 2.33 2.39 2.49 2.58 2.71 2.81 3.02

最终得到最佳的拟合直线方程(也称回归方程):

y a bx

• 需要考虑的两个问题

* 经验公式是否合适——相关系数 * 测量列是否存在粗差——肖维涅舍弃判据

附:相关系数表和肖维涅系数表

注意

*相关系数 r

1.只有当x和y之间存在线性关系时,拟合的直线才有

意义。

2.为了检验拟合的直线有无意义,引入一个叫相关系 数r来判别,r的定义为:

高考数学知识点解析一元线性回归分析与预测

高考数学知识点解析一元线性回归分析与预测高考数学知识点解析:一元线性回归分析与预测在高考数学中,一元线性回归分析与预测是一个重要的知识点,它不仅在数学学科中具有重要地位,还在实际生活中有着广泛的应用。

接下来,让我们一起深入了解这个知识点。

一元线性回归分析是一种用于研究两个变量之间线性关系的统计方法。

简单来说,就是通过一组数据,找到一条直线,使得这些数据点尽可能地靠近这条直线。

我们先来看一个简单的例子。

假设我们想研究学生的学习时间和考试成绩之间的关系。

我们收集了一些学生的学习时间(自变量 x)和对应的考试成绩(因变量 y)的数据。

那么,如何找到它们之间的线性关系呢?这就需要用到一元线性回归方程:y = a + bx 。

其中,a 是截距,b 是斜率。

b 表示 x 每增加一个单位,y 的平均变化量;a 则表示当 x 为 0 时,y 的值。

那么,如何确定 a 和 b 的值呢?这就要用到最小二乘法。

最小二乘法的基本思想是使得实际数据点与回归直线上的对应点的纵坐标之差的平方和最小。

通过一系列的计算,可以得到 a 和 b 的计算公式。

在实际计算中,我们通常会先计算出一些中间量,比如 x 的平均值x,y 的平均值ȳ ,以及 x 和 y 的乘积的总和、x 的平方的总和等等。

然后,代入公式就可以求出 a 和 b 的值。

求出回归方程后,我们就可以用它来进行预测了。

比如,已知一个学生的学习时间,就可以通过回归方程预测他可能的考试成绩。

但需要注意的是,这种预测是基于统计规律的,并不是绝对准确的。

一元线性回归分析在实际生活中有很多应用。

比如,经济学家可以用它来研究物价和消费之间的关系,企业可以用它来预测销售额和广告投入之间的关系,医学家可以用它来分析药物剂量和治疗效果之间的关系等等。

然而,在使用一元线性回归分析时,也需要注意一些问题。

首先,变量之间的线性关系必须是合理的。

如果两个变量之间的关系不是线性的,强行使用一元线性回归分析可能会得到错误的结果。

一元线性回归分析的原理

一元线性回归分析的原理

一元线性回归分析是一种用于研究变量之间相互关系的统计分析方法。

它旨在

在一组数据中,以一个线性方程的式子去拟合变量之间的关系。

借此,分析一个独立变量(即自变量)和一个取决变量(即因变量)之间的关系,求出最合适的回归系数。

一元线性回归分析可以用来发现和描述变量之间的复杂方程式,用来估计参数,以及构建预测模型。

具体而言,一元线性回归分析指的是自变量和因变量之间有线性关系的回归分析。

也就是说,自变量和因变量均遵从一元线性方程,也就是y=βx+α,其中y

为因变量,x为自变量,β为系数,α为常数。

通过一元线性回归分析可以精确

的定义出变量之间的关系,从而可以得出最佳的回归系数和常数,并估计每个参数。

一元线性回归分析用于研究很多方面,例如决策科学、经济学和政治学等领域。

例如,在政治学研究中,可以使用一元线性回归分析来分析政府的软性政策是否能够促进社会发展,以及社会福利是否会影响民众的投票行为。

在经济学研究中,则可以使用一元线性回归分析来检验价格是否会影响消费水平,或检验工资水平是否会影响经济增长率等。

总结而言,一元线性回归分析是一种有效的研究变量之间关系的统计分析方法,精确地检验独立变量和取决变量之间的关系,从而求得最合适的回归系数和常数,并用该回归方程式构建预测模型,为决策提供参考。

计量经济学课件一元线性回归

二、参数的普通最小二乘估计(OLS)

给定一组样本观测值(Xi, Yi)(i=1,2,…n)要 求样本回归函数尽可能好地拟合这组值. 普通最小二乘法(Ordinary least squares, OLS) 给出的判断标准是:二者之差的平方和

ˆ ˆ X )) 2 ˆ ) (Y ( Q (Yi Y i i 0 1 i

640000 352836 1210000 407044 1960000 1258884 2890000 1334025 4000000 1982464 5290000 2544025 6760000 3876961 8410000 4318084 10240000 6682225 12250000 6400900 53650000 29157448

ˆ Y 顺便指出 ,记 y ˆi Y i

则有

ˆ ˆ X ) ( ˆ ˆ X e) ˆi ( y 0 1 i 0 1 ˆ (X X ) 1 e 1 i n i

可得

ˆx ˆi y 1 i

(**)

(**)式也称为样本回归函数的离差形式。

注意:

在计量经济学中,往往以小写字母表示对均值 的离差。

易知 故

x k x

i

i

2 i

0

k X

i

i

1

ˆ k i i 1 1

ˆ ) E ( k ) k E ( ) E( i i 1 i i 1 1 1

同样地,容易得出

ˆ ) E ( w ) E( ) w E ( ) E( i i i i 0 0 0 0

1 (2 ) n

n 2

1 2

一元线性回归公式

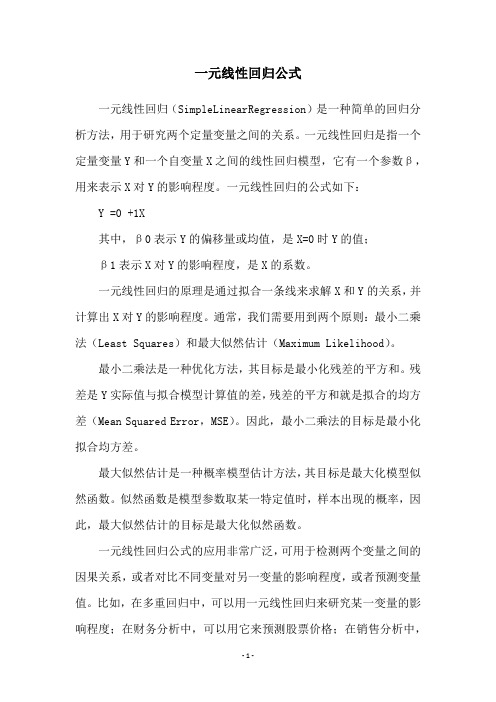

一元线性回归公式一元线性回归(SimpleLinearRegression)是一种简单的回归分析方法,用于研究两个定量变量之间的关系。

一元线性回归是指一个定量变量Y和一个自变量X之间的线性回归模型,它有一个参数β,用来表示X对Y的影响程度。

一元线性回归的公式如下:Y =0 +1X其中,β0表示Y的偏移量或均值,是X=0时Y的值;β1表示X对Y的影响程度,是X的系数。

一元线性回归的原理是通过拟合一条线来求解X和Y的关系,并计算出X对Y的影响程度。

通常,我们需要用到两个原则:最小二乘法(Least Squares)和最大似然估计(Maximum Likelihood)。

最小二乘法是一种优化方法,其目标是最小化残差的平方和。

残差是Y实际值与拟合模型计算值的差,残差的平方和就是拟合的均方差(Mean Squared Error,MSE)。

因此,最小二乘法的目标是最小化拟合均方差。

最大似然估计是一种概率模型估计方法,其目标是最大化模型似然函数。

似然函数是模型参数取某一特定值时,样本出现的概率,因此,最大似然估计的目标是最大化似然函数。

一元线性回归公式的应用非常广泛,可用于检测两个变量之间的因果关系,或者对比不同变量对另一变量的影响程度,或者预测变量值。

比如,在多重回归中,可以用一元线性回归来研究某一变量的影响程度;在财务分析中,可以用它来预测股票价格;在销售分析中,可以用它来预测某一产品的销售量;在投资分析中,可以利用它来估计投资回报率;在决策分析中,可以利用它来估计某一政策的收益;以及在其他应用中也可以利用它来预测变量值。

此外,一元线性回归还可以用于检验变量之间的关系,比如,用相关分析来检验两个变量之间的关系或使用显著性检验来检验X对Y 的影响是否有效。

对于一元线性回归而言,可以通过以下步骤来建模:首先,分析变量间的关系,看看X是否和Y有线性关系;其次,计算拟合系数β1和β0;最后,检验拟合模型的精度。

一元线性回归分析讲义

因变量; ➢ 相关分析中x、y均为随机变量,回归分析中只有y为随

机变量; ➢ 相关分析测定相关程度和方向,回归分析用回归模型进

行预测和控制。

6

(2) 一元线性回归模型假设条件

➢ 自变量x只有一个; ➢ 因变量Y与自变量x之间具有线性关系; ➢ x是非随机的,Y是随机的; ➢ 误差项, ~ N(0 , 2) , 即 的分布与x无

关; ➢ 不同的x对应的误差项 是相互独立的。

图2-1溶解氧浓度随时间变化曲线

18

根据例1,可以求得: x 2.4, y 0.2

8

8

xi

i 1

19.2000

, i1

yi

1.6100

Lxx 14.5000 , Lxy -0.6840 , Lyy 0.0407

由此可得:

^

b

Lxy

Lxx

-0.0472

,

^

a

y

^

b

x

0.3145

这样就得到流动时间 x 和溶解氧浓度 y 之间的

分析方面的一些工作,…是数理统计 学发展史中的重要事件.”──摘自《中 国大百科全书》(数学卷)。

Yˆ 3 3 .7 3 0 .5 1 6 X

回归分析是处理变量之间相关关系的一种数学方法。 3

八大功能

1.Water Quantity Treatment 2.Water Quality Treatment 3.Groundwater Recharge 4.Micro-Climate Alteration 5.Vegetative Buffering 6.Wildlife Habitat 7.Natural Area Protection 8.Aesthetic Improvement

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

01一元线性回归分析l m一元线性回归分析1一元回归分析在进行回归分析时,我们必需知道或假定在两个随机之间存在着一定的关系。

这种关系可以用Y 的函数的形式表示出来,即Y 是所谓的因变量,它仅仅依赖于自变量X ,它们之间的关系可以用方程式表示。

在最简单的情况下,Y 与X 之间的关系是线性关系。

用线性函数a+bX 来估计Y 的数学期望的问题称为一元线性回归问题。

即,上述估计问题相当于对x 的每一个值,假设bx a y E +=)(,而且,),(~2σbx a N y +,其中a, b, σ2都是未知参数,并且不依赖于x 。

对y 作这样的正态假设,相当于设:ε++=bx a y(3)其中),0(~2σεN ,为随机误差,a, b, σ2都是未知参数。

这种线性关系的确定常常可以通过两类方法,一类是根据实际问题所对应的理论分析,如各种经济理论常常会揭示一些基本的数量关系;另一种直观的方法是通过Y 与X 的散点图来初步确认。

对于公式(3)中的系数a 、b ,需要由观察值),(i i y x 来进行估计。

如果由样本得到了a ,b 的估计值为b aˆ,ˆ,则对于给定的x ,a+bx 的估计为x b aˆˆ+,记作y ˆ,它也就是我们对y 的估计。

方程 x b a yˆˆˆ+= (4)称为y 对x 的线性回归方程,或回归方程,其图形称为回归直线。

例1:有一种溶剂在不同的温度下其在一定量的水中的溶解度不同,现测得这种溶剂在温度x 下,溶解于水中的数量y 如下表所示:这里x 是自变量,y 是随机变量,我们要求y 对x 的回归。

其散点图如下:2.确定回归系数(应用最小二乘法)在样本的容量为n 的情况下,我们我们可以得到n 对观察值为),(i i y x 。

现在我们要利用这n 对观察值来估计参数a ,b 。

显然,y的估计值为:bx a y+=ˆ 在上式中a ,b 为待估计的参数。

估计这两个参数的方法有极大似然法和最小二乘法。

其中最小二乘法是求经验公式时最常用的一种方法,也最简单。

现在就采用这种方法。

当我们做出这一对变量观察值的散点图后,我们可以看出,我们所要求的回归直线,实际上是这样的一条直线,即,使所求的直线能够最好的拟合已有的所有点,或者说要使图上所有的点到这条直线的距离最近。

因此所要求的直线实际上就是使所有的点与这条直线间的误差最小的直线。

我们用i y 表示y 的样本观察值,i yˆ表示根据回归方程所得到的y 的估计值,则估计值与实际观察值之间的误差为,ii i i i x b a y y y e ˆˆˆ--=-= (5)其总的误差,可以表示为误差的平方和的形式,222)ˆˆ()ˆ()ˆ,ˆ(∑∑∑--=-==ii i i i x b a y y y e b a Q (6)现在要使上式取得极小值,只需令Q 对a ,b 的一阶偏导等于0,因此:0)ˆˆ(2ˆ)ˆˆ(ˆ0)ˆˆ(2ˆ)ˆˆ(ˆ222=---=∂--∂=∂∂=---=∂--∂=∂∂∑∑∑∑∑∑∑x b x a xy bx b a y b Q x b a n y ax b a y aQ i i ii由此可解得如下结果:()∑∑∑∑∑∑∑∑∑---=--=-=-=222)())((ˆˆ1ˆ1ˆx x y y x x n x x n yx xy b x b y x nb y n a其中b aˆ,ˆ就是参数a ,b 的无偏估计。

此外,所谓最小二乘估计,实际上就是使误差的平方和最小的估计。

估计出了回归方程的系数,我们就可以在给定的x 值的情况下对y 进行估计,或预测。

例2:求例1中的y 关于x 的回归方程。

解:此处,n=9,有关回归方程计算所需要的数据如下:1444.9093.811,269234,9=====y x n 4060)(291=-∑=i ix x9822.3083)(291=-∑=i iy y8.3534))((91=--∑=i iiy yx x5078.67ˆˆ8706.040608.3534)())((ˆ91291=-===---=∑∑==x b y ax xy y x xbi ii i i用Minitab 求得的结果如下:因此所求的回归直线方程为:x y8706.05078.67ˆ+= 3.参数估计量的分布为了对前面所作的y 与x 是线性关系的假设的合理性进行检验,为了求出预测值的置信区间,我们必须知道所估计的参数的分布。

1).bˆ的分布:由于∑∑==---=ni ini i ix xy y x xb121)())((ˆ按假定,n y y y ,,21相互独立,而且已知),(~2σbx a N y +,其中ix 为常数,所以由b ˆ的表达式知b ˆ为独立正态变量n y y y ,,21的线性组合,于是b ˆ也是正态随机变量。

可以证明))(/,(~ˆ122∑=-ni ix x b N b σ 另外,对于任意给定的0x x =,其对应的回归值00ˆˆˆx b a y +=,由于x b y aˆˆ-=,所以可以写成, )(ˆˆˆˆ000x x b y x b a y -+=+= 也就是说,在0x x =处y 所对应的估计值也是一个正态分布的随机变量,可以证明,))()(1,(~ˆ2122000σ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡--++∑=n i i x x x x n bx a N y2).方差σ2的估计:为了估计方差,考查各个i x 处的i y 与其相对应的回归值)(ˆˆx x b y y ii -+=与其离差i i y y ˆ-的平方和SSD : ∑=-=ni i i yy SSD 12)ˆ( 可以证明,其期望值为,2)2()(σ-=n SSD E因此,)2/()(-n SSD E 是2σ的无偏估计,即,∑=--=-=ni i y y n n SSD 122)ˆ()2(1)2(ˆσ 而且,其自由度为n-2,其分布为,)2(~ˆ)2(2222-=-n SSDn χσσσ4.线性假设的显著性检验现在来检验ε++=bx a y ,),0(~2σεN 这一线性假设是否合适,这也就是检验假设,0:0=b H0:1≠b H由于设)1,0(~N X ,)(~2n Y χ,并且X 与Y 相互独立,则随机变量nY X t /=服从自由度为n 的t (student )分布,记为)(~n t t 。

因此从上面的结果可以得知统计量,)2(~ˆ/)(ˆ22122---∑=n t x xb bni iσσσ(5)即,因为在假设00=b H 下,所以,在此假设下,)2(~)(ˆˆ12--∑=n t x xb ni iσ由此可得,如果,)2()(ˆ212->-∑=n t x xb ni iασ,或写成,)2(ˆ2->=n t s b t bα其中∑=-=ni ib x xs 12)(ˆσ则在显著水平α下拒绝假设0:0=b H ,认为回归效果是显著的,也就是说y 与x 之间存在着线性关系ε++=bx a y ;若上述不等式反号,就认为回归效果不显著,回归效果不显著的原因可能有以下几种:a) 影响y 的除x 外,还有其它不可忽略的因素; b) y 与x 的关系不是线性的,而是存在着其他的关系; c) y 与x 无关。

因此,在这样的情况下,要查明原因,分别处理。

例3:检验例2的回归效果是否显著。

取α=0.05。

解:因为n=9所以∑∑∑===---=-ni ini i i ni i x xy y n bx x b 121212)()ˆ(2ˆ)(ˆˆσ利用前面计算的结果,代入上式,有58.56)4060()8706.0(9822.3083)4006)(29(8706.0)(ˆ212=--=-∑=ni i x x b σ注意,∑∑∑===---=-ni ini i ni i i x x b y y y y 1221212)(ˆ)()ˆ( 在此,58.563646.2)7()2(025.02<==-t n t α,所以拒绝H 0,即认为线性回归的效果是显著的。

在线性回归的效果显著时,由(5)式可得到b 的100(1-α)%的置信区间为:⎪⎪⎪⎪⎪⎭⎫ ⎝⎛--±∑=n i i x x n t b 122)(1ˆ)2(ˆσα 另一种进行检验假设,0:0=b H 0:1≠b H 的方法是利用F 分布。

其公式为:∑∑----=)/()()1/()ˆ(22k n y yk y y F ii其中,k 表示回归方程中的系数的个数,在一元线性回归中显然只有两个系数,所以k=2,n 表示样本数。

统计量F 的公式可以表示成:)/()1()1/(22k n r k r F ---= 拒绝域为:)2,1(->n F F α 5.置信区间在利用回归分析进行预测的过程中,我们不仅需要知道预测变量的值,往往还需要了解它的变化范围,即点估计和区间估计的问题。

对于任意给定的0x x =,其对应的y 的观察值的取值范围可以采用以下方法确定:设0x x =,其对应的y 值为y 0,则000ε++=bx a y ,),0(~20σεN上式中,除x 0外,其他参数都是未知的,我们只能使用它们的估计量,考虑随机变量,00ˆyy u -= 显然,0)ˆ()()(00=-=yE y E u E 而且0ˆy是各y i 的线性组合,且0ˆy 与各y i 是相互独立的,都是正态变量,所以它们的差00ˆyy u -=是两个相互独立的正态随机变量的差,因此,)ˆ()()ˆ()(0000y D y D yy D u D +=-= 由于21220020)()(1)ˆ()(σσ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡--+==∑=n i i x x x x n yD y D从而得到,212202)()(11)(σσ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡--++==∑=ni i u x x x x n u D 也就是,)1,0(~N uuσ由前面)2(~ˆ)2(222--n n χσσ并且可以证明uuσ与22ˆ)2(σσ-n 相互独立,于是)2(~/ˆ/22-n t u u σσσ即,)2(~)()(11ˆˆ122000-⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡--++-∑=n t x x x x n yy n i i σ所以y 0的100(1-α)%的置信区间为:⎪⎪⎪⎪⎪⎭⎫⎝⎛--++-±∑=ni i x x x x n n t y 122020)()(11ˆ)2(ˆσα 从上式可以看出,对于给定的样本观察值及置信度而言,当x 0越是靠近其均值x ,预测区间的宽度就越是窄小,预测也就越精确。

若将上式记为))(ˆ(00x yδ±,对于给的样本观察值,作出曲线, )(ˆ)()(ˆ)(0201x yx y x yx y δδ±=±=则这两条曲线形成一含回归直线x b a yˆˆˆ+=的区域,它在x x =处最窄。