最大似然估计及三大检验(Wald-LM-LR)资料学习资料

Eviews计量经济学三大检验讲解学习

E v i e w s计量经济学三大检验作业1我们有1978-2007年我国财政收入,国内生产总值,财政支出和商品零售价格指数的年度数据。

请用Eview 进行回归分析。

(1) 根据回归结果分析模型的经济意义(包含模型的显著性,拟合优度,系数的显著性,系数的经济意义)建立模型,做OLS 估计,得结果图一,列表如下:43283175.57898859.0003271.0558.6399X X X Y ++--=∧)0636.20)(065848.0)(012559.0)(836.2132(SE )882456.2)(65061.13)(260476.0-)(000492.3-(t =997046.02=R 996705.02=R 845.2924=F模型整体显著性较高(F 检验十分显著),可决系数2R 和调整的可决系数较大,即样本回归方程对样本观测值拟合较好。

t 检验显示2X 的系数不显著(p 值>0.05,不能拒绝β=0的原假设),3X 和4X 的系数显著(p值<0.05,拒绝β=0的原假设)。

从模型的经济意义来看,财政支出、商品零售价格指数与财政收入成正相关,国内生产总值与财政收入成负相关,不符合客观经济规律,可能与模型变量的选取有关。

考虑对模型进行对数变换,结果为图二。

432ln 128427.1ln 631090.0ln 448496.0946444.6ln X X X Y +++-=∧)610249.0)(160929.0)(141418.0)(853146.2(SE)849127.1)(921549.3)(171412.3)(434662.2(t -=987673.02=R 986251.02=R 3969.694=F对数变换后模型整体显著性较高(F 检验十分显著,p 值=0.00<<0.05),可决系数2R 和调整的可决系数略有下降,模型可解释98.63%的因变量变化。

5-最大似然估计

最大似然估计

对应的对数似然函数为:

, ,,。

一阶条件可计算如下:

(5-16)

显然,由上述的一阶条件无法解出参数的解析解。因此,我们必须使用迭代 的方法来获得参数的数值解。

记

,则 Newton-Raphson 迭代的迭代公式为:

(5-17)

其中,下标“(j)”表示迭代的步数;迭代公式的协方差阵也可使用其它两种 计算方法。

又可得到参数 的最优解。 此处,有必要介绍一下中心化的概念。

假定待估参数可划分为

,其中,给定参数 ,参数 的 ML

估计可表示为

,将

代入原来的对数似然函数

可以得到

,则称 称中心化对数似然函数。

为对参数 中心化的对数似然函数,简

5.2 三大检验

5.2.1 定义与性质

第 11 页 共 30 页

最大似然估计

最大似然估计

最大化函数

的结果是等价的。因此,在估计过程中通常只关注条件似

然函数。在不引起误解的情况下,我们仍然使用符号

的似然函数。 参数 的 ML 估计

定义如下:

表示

(5-2)

其中,参数空间 为参数 的定义域。 由于上式中存在连乘的形式,不方便于求解估计量,因此,大多数情况下, 都先对上式进行对数变换再进行最优化。

(5-15) 其中, 的累计分布函数为:

即 收敛于某个取 的概率为 1 的分布。

所以有,

。

同样的, 的累计分布函数为:

其中, 则由上式可知有 或者,也可由

。

为有限分布,所以有

。

直接得到一致的结论。

3.Weibull 分布的 ML 估计

已知

为 Weibull 分布生成的随机样本,其密度函数为:

最大似然估计及三大检验(Wald LM LR)资料

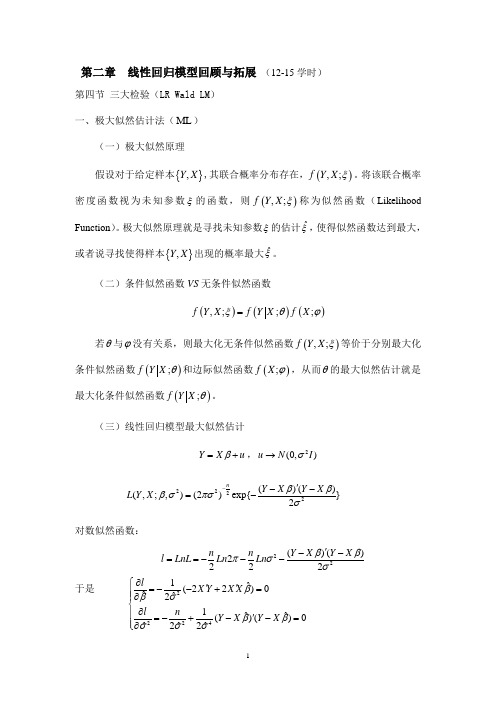

第二章 线性回归模型回顾与拓展 (12-15学时)第四节 三大检验(LR Wald LM ) 一、极大似然估计法(ML )(一)极大似然原理假设对于给定样本{},Y X ,其联合概率分布存在,(),;f Y X ξ。

将该联合概率密度函数视为未知参数ξ的函数,则(),;f Y X ξ称为似然函数(Likelihood Function )。

极大似然原理就是寻找未知参数ξ的估计ˆξ,使得似然函数达到最大,或者说寻找使得样本{},Y X 出现的概率最大ˆξ。

(二)条件似然函数VS 无条件似然函数()()(),;;;f Y X f Y X f X ξθϕ=若θ与ϕ没有关系,则最大化无条件似然函数(),;f Y X ξ等价于分别最大化条件似然函数();f Y X θ和边际似然函数();f X ϕ,从而θ的最大似然估计就是最大化条件似然函数();f Y X θ。

(三)线性回归模型最大似然估计Y X u β=+,2(0,)u N I σ→2222()()(,;,)(2)exp{}2nY X Y X L Y X βββσπσσ-'--=-对数似然函数:22()()2222n n Y X Y X l LnL Ln Ln ββπσσ'--==---于是 22241ˆ(22)0ˆˆ21ˆˆ()()0ˆˆˆ22l X Y X X l n Y X Y X βσβββσσσ∂⎧''=--+=⎪⎪∂⎨∂⎪'=-+--=⎪∂⎩得到 12ˆ()1ˆMLML X X X Y e e n βσ-⎧''=⎪⎨'=⎪⎩(三)得分(Score )和信息矩阵(Information Matrix )(;,)lf Y X θθ∂=∂称为得分; 12...k l l l l θθθθ∂⎡⎤⎢⎥∂⎢⎥∂⎢⎥⎢⎥∂⎢⎥∂⎢⎥=∂⎢⎥⎢⎥⎢⎥⎢⎥∂⎢⎥⎢⎥∂⎣⎦得分向量;(Gradient ) 海瑟矩阵(Hessian Matrix ):2l H θθ∂='∂∂信息矩阵:三*、带约束条件的最小二乘估计(拉格朗日估计)在计量经济分析中,通常是通过样本信息对未知参数进行估计。

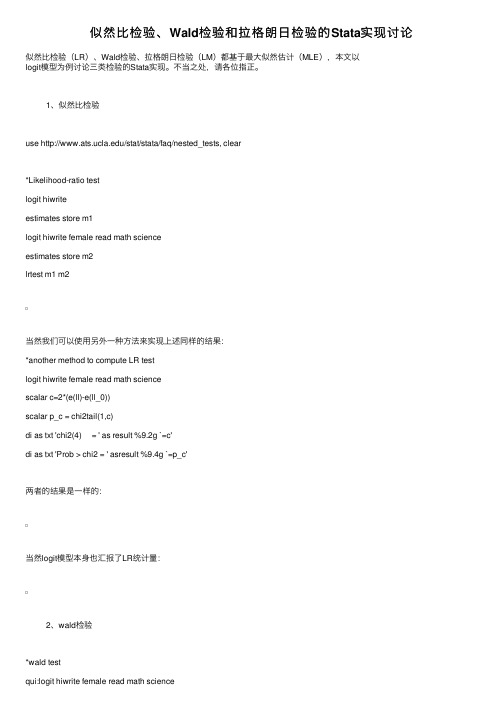

似然比检验、Wald检验和拉格朗日检验的Stata实现讨论

似然⽐检验、Wald检验和拉格朗⽇检验的Stata实现讨论似然⽐检验(LR)、Wald检验、拉格朗⽇检验(LM)都基于最⼤似然估计(MLE),本⽂以logit模型为例讨论三类检验的Stata实现。

不当之处,请各位指正。

1、似然⽐检验use /stat/stata/faq/nested_tests, clear*Likelihood-ratio testlogit hiwriteestimates store m1logit hiwrite female read math scienceestimates store m2lrtest m1 m2当然我们可以使⽤另外⼀种⽅法来实现上述同样的结果:*another method to compute LR testlogit hiwrite female read math sciencescalar c=2*(e(ll)-e(ll_0))scalar p_c = chi2tail(1,c)di as txt 'chi2(4) = ' as result %9.2g `=c'di as txt 'Prob > chi2 = ' asresult %9.4g `=p_c'两者的结果是⼀样的:当然logit模型本⾝也汇报了LR统计量:2、wald检验*wald testqui:logit hiwrite female read math sciencetest female read math science3、拉格朗⽇检验本来Stata⾥有⼀个user-written的命令叫做testomit,但是这个命令当前在Stata⾥并不能被找到。

可能是作者移除了⽹页。

如果您有这个命令的源程序,⿇烦您联系我。

Statalist⾥很多⼈都在讨论如何进⾏LM检验,来⾃Universityof Konstanz的Maarten L. Buis给出的答案如下:* Lagrange multiplier testqui:logit hiwrite female read math science// use the resulting gradient and var-covmatrix to compute the test statisticsmatrix S = e(gradient)*e(V)*e(gradient)'scalar a = el(S,1,1)scalar p_s = chi2tail(1,a)// display the resultdi as txt 'chi2(1) = ' as result %9.2g `=a'di as txt 'Prob > chi2 = ' asresult %9.4g `=p_s'但是由于这种⽅法得到的结果和前述两种检验得到的结果差别真的太⼤,我对这个⽅法持谨慎态度。

三大检验

' e e 有约束模型残差平方和; ** e′e无约束模型残差平方和;

2011-12-19

中级计量经济学

8

• 三、Wald检验

H0 : g ( β ) = C

• 如果约束条件为真,则g ( β

MLE

g ( β MLE ) − C显著异于零时,约束条件无效 无约束极大似然估计值。当

) − C → 0 不应该显著异于零,其中 β MLE 是

• 假设对于给定样本 {Y , X },其联合概率分布存在, f (Y , X ; ξ ) 。将该 联合概率密度函数视为未知参数 ξ 的函数,则 f (Y , X ; ξ ) 称为似然函 数(Likelihood Function), 即观测到所给样本的可能性. • 极大似然原理就是寻找未知参数 ξ 的估计 ξˆ ,使得似然函数达到最 大,或者说寻找使得样本

{Y , X }

出现的概率最大的 ξˆ 。

2011-12-19

中级计量经济学

3

• (三)线性回归模型最大似然估计 • 1、估计结果 u ~N (0, σ 2 I n ) Y = Xβ +u

2 2 − n 2

(Y − X β )′(Y − X β ) L(Y , X ; β , σ ) = (2πσ ) exp{− } 2 2σ

' e e 有约束模型残差平方和; * * e ′e 无 约 束 模 型 残 差 平 方 和 ;

2011-12-19 中级计量经济学 10

四、拉格朗日乘子检验(LM)

• 基本思想:拉格朗日乘子检验(LM),又称为Score检验。该检验基 于约束模型,无需估计无约束模型。 • 假设约束条件为 H 0 : g (θ ) = C ,在约束条件下最大化对数似然函数 ,另

MLE

极大似然估计——基本性质

• 渐近有效性

渐近有效的定义:如果一个估计量一直且渐近正态度分 布(CAN),且其渐近协方差矩阵不大于任何其他CAN 估计量的渐近协方差矩阵,那么它就是渐近有效的。

最大似然估计(MLE)

Outlines

一、似然函数与参数识别条件; 二、极大似然原理与似然方程; 三、极大似然估计量的性质;

四、极大似然估计量的渐进方差估计;

五、三大检验(LR,Wald,LM)

最大似然估计——概述

• 最大似然估计法(Maximum Likelihood,简称ML),是 不同于最小二乘法的另一种参数估计方法,是从最大 似然原理出发发展起来的其它估计方法的基础。 • 基本原理: 对于最大或然法,当从模型总体随机抽取n组样本观 测值后,最合理的参数估计量应该使得从模型中抽取 该n组样本观测值的概率最大。

可知对数似然函数在β与γ处取值相同。

所以,这个模型中β是无法估计的。

极大似然原理与似然方程

• 基本原理:

对于最大或然法,当从模型总体随机抽取n组样本观 测值后,最合理的参数估计量应该使得从模型中抽取 该n组样本观测值的概率最大。 这样得到的参数估计值叫做极大似然估计值(Maximum likelihood estimate,简称MLE).

2 ln L(θ) I(θ) E[ ]称为信息矩阵 θθ'

对MLE的渐近方差协方差进行估计可等同于对信息矩 阵的估计。

MLE的渐近方差的估计

• 第一种估计方法是直接估计,即

ln L(θ) [I (θ)] E[ ] θθ'

最大似然估计及三大检验(WaldLMLR)讲解

第二章 线性回归模型回顾与拓展 (12-15学时)第四节 三大检验(LR Wald LM ) 一、极大似然估计法(ML )(一)极大似然原理假设对于给定样本{},Y X ,其联合概率分布存在,(),;f Y X ξ。

将该联合概率密度函数视为未知参数ξ的函数,则(),;f Y X ξ称为似然函数(Likelihood Function )。

极大似然原理就是寻找未知参数ξ的估计ˆξ,使得似然函数达到最大,或者说寻找使得样本{},Y X 出现的概率最大ˆξ。

(二)条件似然函数VS 无条件似然函数()()(),;;;f Y X f Y X f X ξθϕ=若θ与ϕ没有关系,则最大化无条件似然函数(),;f Y X ξ等价于分别最大化条件似然函数();f Y X θ和边际似然函数();f X ϕ,从而θ的最大似然估计就是最大化条件似然函数();f Y X θ。

(三)线性回归模型最大似然估计Y X u β=+,2(0,)u N I σ→2222()()(,;,)(2)exp{}2nY X Y X L Y X βββσπσσ-'--=-对数似然函数:22()()2222n n Y X Y X l LnL Ln Ln ββπσσ'--==---于是 22241ˆ(22)0ˆˆ21ˆˆ()()0ˆˆˆ22l X Y X X l n Y X Y X βσβββσσσ∂⎧''=--+=⎪⎪∂⎨∂⎪'=-+--=⎪∂⎩得到 12ˆ()1ˆMLML X X X Y e e n βσ-⎧''=⎪⎨'=⎪⎩(三)得分(Score )和信息矩阵(Information Matrix )(;,)lf Y X θθ∂=∂称为得分; 12...k l l l l θθθθ∂⎡⎤⎢⎥∂⎢⎥∂⎢⎥⎢⎥∂⎢⎥∂⎢⎥=∂⎢⎥⎢⎥⎢⎥⎢⎥∂⎢⎥⎢⎥∂⎣⎦得分向量;(Gradient ) 海瑟矩阵(Hessian Matrix ):2l H θθ∂='∂∂信息矩阵:三*、带约束条件的最小二乘估计(拉格朗日估计)在计量经济分析中,通常是通过样本信息对未知参数进行估计。

三大检验选读

• (3)渐进正态性

2018/12/27

中级计量经济学

6

二、似然比检验(LR)

• 1、似然比 • 命题: H0 : g C • 检验思想:如果约束是无效的,有约束的最大似然函数值当然不会超 过无约束的最大似然函数值,但如果约束条件“有效”,有约束的最

大值应当“接近”无约束的最大值,这正是似然比检验的基本思路。

• 对未知参数求导:

2018/12/27

中级计量经济学

4

ˆ (X X ) 1 X Y • 得到, ML 2 1 ˆ ML ee n

• 与OLS对比

将估计量代入对数似然函数,得到最大对数似然估计值

n n l LnL Ln( ) 1 Ln(ee) 2 2

H0 : R r

ˆ r ) R ˆ r ) ~ 2 (q) ˆ W ( R ( X X ) R ( R

2 1 1 a

• 拒绝域,

2 W (q)

• Wald统计量另一种表达形式,

' n(e* e* ee) W ~ 2 (q) ee

2 2 n 2

• 对数似然函数:

n n (Y X )(Y X ) l LnL Ln 2 Ln 2 2 2 2 2

1 l ˆ) 0 ( 2 X Y 2 X X 2 ˆ ˆ 2 l n 1 (Y X ˆ )(Y X ˆ) 0 2 2 4 ˆ ˆ ˆ 2 2

• 似然比:

L( , 2 ) ˆ , ˆ2) L(

• 无约束模型似然函数值: • 有约束模型似然函数值:

ˆ , ˆ2) L(

MLE

(R β- q) '[ R(X'X) R'] (R β- q) ~ 2 ( J )

2 -1 1

Λ

Λ

a

其中 2

e'e n

三大检验——拉格朗日乘子检验

拉格朗日乘子(LM)检验:

• 该检验基于有约束模型而非无约束模型:

ln L* (θ) ln L(θ) λ '[c(θ) q]

由于约束最优值不会大于无约束最优值,所以介于0与1之间。

若接近于0, 则约束可能出错。

三大检验——似然比检验

• 似然比检验统计量的渐近分布:

若正则条件与H0满足,则-2 ln ~ 2 ( J ),其中J 个约束个数。

若该值超过了在一定显著性水平下的 2临界值,应拒绝原假设

a

• 似然比检验的一个缺点是,要求同时估计有约束与无 约束的参数向量;在一些较为复杂的模型中,这些估 计值可能很难计算。

极大似然估计——基本性质

• Cramer-Rao下界(Cramer-Rao lower bound):

如果正则条件满足,参数向量θ的一个CAN 估计量的渐近方差协方差 矩阵至少等于 ln L(θ) ln L(θ) ln L(θ) [I(θ)]1 E[ ] E[( )( ) '] θθ' θ θ

2 ln L(θ) ln L(θ) ln L(θ) 其中I(θ) E[ ] E[( )( ) '] θθ' θ θ

极大似然估计——基本性质

• 渐近有效性

渐近有效的定义:如果一个估计量一直且渐近正态度分 布(CAN),且其渐近协方差矩阵不大于任何其他CAN 估计量的渐近协方差矩阵,那么它就是渐近有效的。

conditional条件法、lr偏似然估计法、wald瓦尔德法

conditional条件法、lr偏似然估计法、wald瓦尔德法条件法、偏似然估计法和瓦尔德法是统计学中经常使用的三种方法,用于估计参数和进行假设检验。

本文将逐步解释这三种方法的原理和应用,并讨论它们的优缺点。

条件法(Method of Moments) 是一种基于样本矩的估计方法。

其核心思想是将理论矩和样本矩之间的差异最小化,从而得到参数的估计值。

具体步骤如下:步骤1:确定估计量的数量首先,根据需要估计的参数的数量,确定需要计算的矩数量。

例如,如果需要估计一个参数,那么只需要计算一个矩;如果需要估计两个参数,那么需要计算两个矩。

步骤2:计算样本矩从样本中计算所需的矩。

常见的矩包括样本均值、方差和偏度。

步骤3:建立理论矩对所需的参数建立理论矩的表达式。

这些表达式是参数的函数。

步骤4:求解方程组将样本矩和理论矩相等,得到参数的估计值。

这可以通过求解一个由样本矩和理论矩的方程组获得。

条件法的优点是简单易用,特别适用于参数估计问题。

然而,它的缺点是对于非线性模型或者高阶矩的估计问题存在较大的不确定性。

偏似然估计法(Maximum Likelihood Estimation, MLE) 是一种基于似然函数的估计方法。

它假设观测数据来自于已知的概率分布,然后通过最大化似然函数来估计参数。

具体步骤如下:步骤1:建立似然函数根据数据的概率分布函数,建立参数的似然函数。

似然函数是参数的函数,表示给定参数情况下观测数据出现的可能性。

步骤2:对似然函数取对数将似然函数取对数,得到对数似然函数。

这样做的好处是可以简化计算。

步骤3:求对数似然函数的导数对对数似然函数求导,得到参数的似然方程。

解这个方程可以求得参数的估计值。

步骤4:计算似然函数的二阶导数对对数似然函数再次求导,得到似然函数的二阶导数。

这个二阶导数称为观测信息矩阵。

步骤5:计算标准误差和置信区间根据观测信息矩阵,计算参数的标准误差,并利用标准误差构建置信区间。

第一节 最大似然估计

1

2

n 1

ln(i2 )

1 2

n 1

i2

2 i

n ln(| ui

i 1

yi

|)

(2)

2 i

2hi( )

ln

Lc

( ,

|

y,

x)

1 2

n[1

ln(2

)

ln(n)]

1

2

n 1

ln(hi )

1 2

n

ln(( )

( ))

n

ln(|

i 1

ui yi

|)

3、例题

Y 0 1X 2 X 2 u

Yi ~ N(ˆ0 ˆ1 X i , 2 )

Yi的分布

P(Yi )

1

e

1

2

2

(Yi

ˆ0

ˆ1

X

i

)

2

2

Yi的概率 密度函数

L(ˆ0 , ˆ1, 2 ) P(Y1,Y2 , ,Yn )

最大似然估计及三大检验(Wald-LM-LR)资料

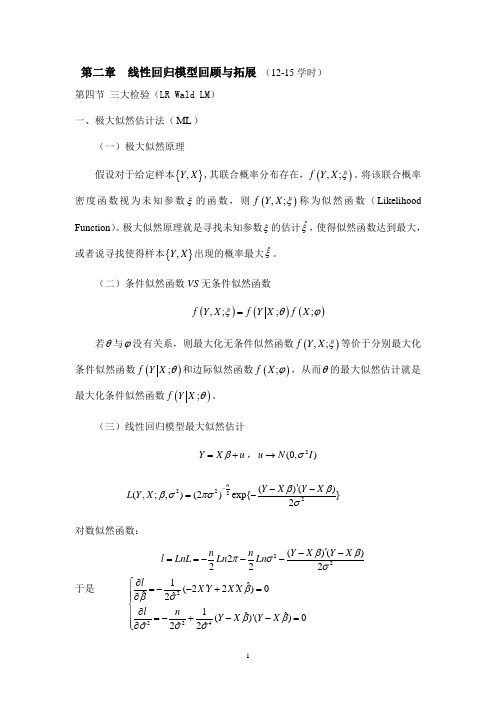

第二章 线性回归模型回顾与拓展 (12-15学时)第四节 三大检验(LR Wald LM ) 一、极大似然估计法(ML )(一)极大似然原理假设对于给定样本{},Y X ,其联合概率分布存在,(),;f Y X ξ。

将该联合概率密度函数视为未知参数ξ的函数,则(),;f Y X ξ称为似然函数(Likelihood Function )。

极大似然原理就是寻找未知参数ξ的估计ˆξ,使得似然函数达到最大,或者说寻找使得样本{},Y X 出现的概率最大ˆξ。

(二)条件似然函数VS 无条件似然函数()()(),;;;f Y X f Y X f X ξθϕ=若θ与ϕ没有关系,则最大化无条件似然函数(),;f Y X ξ等价于分别最大化条件似然函数();f Y X θ和边际似然函数();f X ϕ,从而θ的最大似然估计就是最大化条件似然函数();f Y X θ。

(三)线性回归模型最大似然估计Y X u β=+,2(0,)u N I σ→2222()()(,;,)(2)exp{}2nY X Y X L Y X βββσπσσ-'--=-对数似然函数:22()()2222n n Y X Y X l LnL Ln Ln ββπσσ'--==---于是 22241ˆ(22)0ˆˆ21ˆˆ()()0ˆˆˆ22l X Y X X l n Y X Y X βσβββσσσ∂⎧''=--+=⎪⎪∂⎨∂⎪'=-+--=⎪∂⎩得到 12ˆ()1ˆMLML X X X Y e e n βσ-⎧''=⎪⎨'=⎪⎩(三)得分(Score )和信息矩阵(Information Matrix )(;,)lf Y X θθ∂=∂称为得分; 12...k l l l l θθθθ∂⎡⎤⎢⎥∂⎢⎥∂⎢⎥⎢⎥∂⎢⎥∂⎢⎥=∂⎢⎥⎢⎥⎢⎥⎢⎥∂⎢⎥⎢⎥∂⎣⎦得分向量;(Gradient ) 海瑟矩阵(Hessian Matrix ):2l H θθ∂='∂∂信息矩阵:三*、带约束条件的最小二乘估计(拉格朗日估计)在计量经济分析中,通常是通过样本信息对未知参数进行估计。

三大检验LM_WALD_LR

在实际应用中,应根据具体问题和数据特征选择合适的检验方法,以提高模型诊断的准确性和可靠性。

对未来研究的建议

进一步研究lm_wald_lr三种检验方法在不同类型数据和模型假设下的表现, 以完善其理论和应用体系。

02

通过比较药物治疗前后的基因表达谱,利用lm_wald_lr检验评

估药物疗效。

流行病学研究

03

在流行病学研究中,利用lm_wald_lr检验分析不同人群的基因

变异与疾病风险的关系。

社会调查

01

民意调查

利用lm_wald_lr检验分析民意调 查数据,了解公众对政策、产品 等的态度和意见。

02

社会问题研究

LR检验

LR检验(似然比检验)是用于比较 两个模型拟合优度的统计检验,通 过比较两个模型的似然函数值来评 估模型之间的差异。

lm_wald_lr检验的原理

Wald统计量原理

Wald统计量基于参数的估计值和标准误差,通过构造一个Wald统计量来检验 参数是否为零。如果Wald统计量的值大于临界值,则拒绝原假设,认为参数 不为零。

局限性

lm_wald_lr检验对于样本量和数据分布有一定的要求,如果样本量较小或数据分布不符合正态分布假设,可能会 导致检验结果不准确。此外,对于一些复杂模型或非线性模型,lm_wald_lr检验可能不够敏感或可靠。

02

检验步骤

数据的准备

收集数据

根据研究目的和范围,收集相关数据,确保数据 的准确性和完整性。

结果的解释

判断结果

将计算出的统计量与临界值进行比较,判断检 验假设是否成立。

三大检验

•

如果约束成立,对数似然函数值不会有显著变化。这就意味着在一

阶条件下,第二项应该很小,特别是

应该很小。因此,约束条件

是否成立检验转化成检验 H : =0 ,这就是拉格朗日乘子检验的思 0 想。

•

但是直接检验 H0: =0 比较困难,有一个等价而简单的方法。如

表示拉格朗日乘子向量,此时,拉格朗日函数为, LnL ( ) LnL( ) g( ) C

• 约束条件下最大化问题就是求解下式根,

LnL ( ) LnL( ) g 0 LnL ( ) g( ) g ( ) C 0 其中,g 是矩阵g= 的转置

' n(e* e* ee) 2 W ~ (q) ' e*e*

' e e 有约束模型残差平方和; * * ee无约束模型残差平方和;

• LR、 Wald 、LM关系(一般情况下成立):

Wald LR LM

2014-5-23

中级计量经济学

15

数(Likelihood Function), 即观测到所给样本的可能性.

ˆ ,使得似然函数达到最 • 极大似然原理就是寻找未知参数 的估计

大,或者说寻找使得样本

Y , X 出现的概率最大的 ˆ

。

2014-5-23

中级计量经济学

3

• (三)线性回归模型最大似然估计 • 1、估计结果 Y X u u~N (0, 2 In )

果约束条件成立,在约束估计值处计算对数似然函数的导数应该近似 为零,如果该值显著异于零,则约束条件不成立,拒绝原假设。

• 对数似然函数的导数就是得分向量,因此,LM检验就是检验约束条件

三大检验LMWALDLR

注意:这是做 k 个 t 检验。在原假设成立条件下,统计量

t

=

ˆ j s(ˆ j

)

tk-1,

(j

=

1,

2,

…,

k)

其中 ˆ j 是对j 的估计, s(ˆ j ) , j = 1, 2, …, k 是 ˆ j 的样本标准差。

其中DEBTt表示国债发行总额(单位:亿元),GDPt表示年国内生产总值 (单位:百亿元),DEFt表示年财政赤字额(单位:亿元),REPAYt表示 年还本付息额(单位:亿元)。

(第3版255页)

5000 4000

DEBT

3000

2000

1000

0 0

GDP

200

400

600

800 1000

5000 4000

43.01亿元,占GDP当年总量的1%,2001年国债发行额是4604

亿元,占GDP当年总量的4.8%。以当年价格计算,21年间

(1980-2001)增长了106倍。平均年增长率是24.9%。

5000 4000 3000

DEBT

(第3版254页)

2000

1000

0 80 82 84 86 88 90 92 94 96 98 00

本章开始先简要总结模型参数总显著性的F检验、单个回归参 数显著性的t检验。然后再介绍几个在建模过程中也很常用的 其他检验方法。他们是检验模型若干线性约束条件是否成立 的F检验和似然比(LR)检验、Wald检验、LM检验、JB检验 以及Granger非因果性检验。

11.1 模型总显著性的F 检验

(第3版252页)

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第二章 线性回归模型回顾与拓展 (12-15学时)第四节 三大检验(LR Wald LM ) 一、极大似然估计法(ML )(一)极大似然原理假设对于给定样本{},Y X ,其联合概率分布存在,(),;f Y X ξ。

将该联合概率密度函数视为未知参数ξ的函数,则(),;f Y X ξ称为似然函数(Likelihood Function )。

极大似然原理就是寻找未知参数ξ的估计ˆξ,使得似然函数达到最大,或者说寻找使得样本{},Y X 出现的概率最大ˆξ。

(二)条件似然函数VS 无条件似然函数()()(),;;;f Y X f Y X f X ξθϕ=若θ与ϕ没有关系,则最大化无条件似然函数(),;f Y X ξ等价于分别最大化条件似然函数();f Y X θ和边际似然函数();f X ϕ,从而θ的最大似然估计就是最大化条件似然函数();f Y X θ。

(三)线性回归模型最大似然估计Y X u β=+,2(0,)u N I σ→2222()()(,;,)(2)exp{}2nY X Y X L Y X βββσπσσ-'--=-对数似然函数:22()()2222n n Y X Y X l LnL Ln Ln ββπσσ'--==---于是 22241ˆ(22)0ˆˆ21ˆˆ()()0ˆˆˆ22l X Y X X l n Y X Y X βσβββσσσ∂⎧''=--+=⎪⎪∂⎨∂⎪'=-+--=⎪∂⎩得到 12ˆ()1ˆMLML X X X Y e e n βσ-⎧''=⎪⎨'=⎪⎩(三)得分(Score )和信息矩阵(Information Matrix )(;,)lf Y X θθ∂=∂称为得分; 12...k l l l l θθθθ∂⎡⎤⎢⎥∂⎢⎥∂⎢⎥⎢⎥∂⎢⎥∂⎢⎥=∂⎢⎥⎢⎥⎢⎥⎢⎥∂⎢⎥⎢⎥∂⎣⎦得分向量;(Gradient ) 海瑟矩阵(Hessian Matrix ):2l H θθ∂='∂∂信息矩阵:三*、带约束条件的最小二乘估计(拉格朗日估计)在计量经济分析中,通常是通过样本信息对未知参数进行估计。

但有些时候可能会遇到非样本信息——对未知参数的约束限制(如生产函数中的规模报酬不变等)。

在这种情况下,我们就可以采用拉格朗日估计法。

对于线性模型(1),若其参数β具有某种线性等式约束: 0H β= (6)其中H 是m k ⨯矩阵(m k <,()rank H m =)。

β可视为除分量0β以外的1k ⨯矩阵。

上式表明未知参数12,,,k βββL 之间的某些线性关系的信息。

现在的问题是寻求满足上式又使()()Y X Y X ββ'--达到最小的估计量0ˆH β。

为此,构造拉格朗日函数。

(λ是1m ⨯的向量)()()L Y X Y X H ββλβ''=--+ (7)于是ˆˆ220ˆH HHL X Y X X H βλβ∂'''=-++=∂ (8)ˆ0ˆH HL H βλ∂==∂ (9) 由(8)可得11ˆˆˆ()2H HX X H ββλ-''=- (10) (10)式的ˆβ是OLS 的估计量。

两边再左乘H ,并结合(9)式有 11ˆˆˆ0()2H HH H H X X H ββλ-''==- 所以,11ˆˆ2[()]H H X X H H λβ--''= 代入(10)式,我们便得到估计量:111ˆˆˆ()[()]HX X H H X X H H βββ---''''=- (11) 这就是拉格朗日估计,或称为带约束的最小二乘估计。

它既利用了样本信息,也利用了非样本信息。

另外,ˆHβ也是带约束的极大似然估计量(证明从略)。

四、广义最小二乘估计(GLS ) 1、数理过程在实际经济问题的分析过程中,常常遇到古典假定中2的不满足,即随机扰动项存在异方差或自相关。

比如利用截面数据进行分析时,随机因素的方差会随着解释变量的增大而增大(即所谓的递增异方差——如在研究消费收入的关系时,随着收入的增加,随机因素的变化会增大)。

而利用时间序列数据进行分析时,由于经济变量的惯性作用,随机扰动项之间也会有联系,较为普遍的现象是扰动项的一阶自相关。

(即1t t t u u ρε-=+)当存在异方差或自相关的情况下,传统的OLS 不再是有效估计,这时,我们应采用广义最小二乘法来解决这类问题。

具体地,2'Euu σ=Ω (12)其中212122n n w w σσσσ⎛⎫ ⎪⎛⎫⎪⎪Ω==⎪ ⎪ ⎪ ⎪⎝⎭⎪⎝⎭O O 时t u 存在异方差, 1221211111n n n n ρρρρρρρ----⎛⎫⎪ ⎪Ω=⎪- ⎪ ⎪⎝⎭L L LLL L L时t u 存在一阶自相关。

需要说明的是,无论是异方差还是自相关,矩阵Ω是正定矩阵。

于是,存在非奇异矩阵P ,使得PP 'Ω= 或 1()P P I -''Ω=在模型 Y X u β=+ 两边同时左乘1P -,得 111P Y P X P u β---=+或写成***Y X u β=+ (13) 此时,**111212'['()]()Eu u E P uu P P P I σσ----''==Ω= 即*u 已无异方差和自相关。

那么,对(13)式运用OLS 可以得到**1**11111111ˆ()(())()()X X X Y X P P X X P P Y X X X Y β'---------''''''===ΩΩ (14)这就是未知参数β的广义最小二乘估计量GLS 。

它同样具有良好的统计性质。

即它是无偏的、一致的、渐近正态211ˆˆ(,())E Var X X βββσ--'==Ω的估计量。

换句话说,GLS 估计量是广义模型中的最小方差线性无偏估计。

这就是所谓的Aitken 定理,当I Ω=时高斯—马尔科夫定理为其特例。

2、WLS 和广义差分法广义最小二乘法是处理异方差和自相关问题的一般良好估计方法。

当Ω已知时,比如异方差时,各个22i i w σσ=已知,此时,矩阵PP ⎫⎪= ⎪ ⎝O,1P -⎫⎪⎪=⎪ ⎝O*1Y P Y -⎛ == ⎪ ⎝M,*1X P X -⎛⎫ ⎪⎪== ⎪ ⎝M,*1u P u -⎛ == ⎪M 。

这时由(13)式估计出来的β,其实同加权最小二乘估计(WLS )是相同的。

换句话说,加权最小二乘实际上是广义最小二乘的特例。

再比如随机扰动项有一阶自相关且ρ已知,此时1221211111n n n n PP ρρρρρρρ----⎛⎫⎪ ⎪'Ω== ⎪- ⎪ ⎪⎝⎭L L LLL L L,可以算得100001000010001P ρρρ-⎫⎪- ⎪ ⎪=- ⎪⎪⎪-⎝⎭LL L L L L L L L L那么(13)式中的1*1211n n Y Y Y P Y Y Y ρρ--⎛⎫ ⎪- ⎪== ⎪ ⎪ ⎪-⎝⎭M,1*1211nn X X X P X X X ρρ--⎛⎫⎪- ⎪== ⎪ ⎪ ⎪-⎝⎭M此时估计(13)式得出的ˆβ,其实就是所谓的广义差分法。

也就是说广义差分法也是GLS 的特例。

所以,GLS 是一个普遍适用的方法。

3、Ω未知时的GLS当然,上述情形只是Ω已知的情况。

而在现实应用时,Ω往往是未知的。

于是我们面临一个问题——Ω如何确定?回答当然是对Ω中的未知量进行估计(比如自相关中的ρ,异方差中的i W )。

那么又该如何估计呢?在回答这个问题之前,我们先考察一下GLS 与最大似然估计的关系(可对照OLS 与ML 的关系)一般来说,当2(0,)N μσΩ:或2(,)Y N X βσΩ:时,Y 的对数似然函数为221112()()()222n InL In In Y X Y X πσβσβ-'=--Ω--Ω-或者考虑到PP 'Ω=,而1*P Y Y -=、1*P X X -=,又有(经过适当的运算)2****21ln ln 2ln ln ||()()222n n L P Y X Y X πσββσ=--+---最大化上式,对β求导令其为0,可得到β的极大似然估计量(它其实就是GLS )。

对Ω或P 中的未知量求导令其为0,可得到Ω中未知量(比如ρ)的估计。

这是一种理论上可行的方法,但实际操作可能会遇到障碍,尤其是在有异方差存在时。

为此,我们介绍另一种方法——可行广义最小二乘法FGLS 4、可行广义最小二乘法(FGLS )异方差的具体形式是复杂多样的,但总的来说都是与解释变量有关的,随解释变量的变化而变化。

以下三种假设情况基本上涵盖了文献中讨论过的大多数情形。

(i )2011i i p ip Z Z σααα=+++L (ii )011i i p ip Z Z σααα=+++L(iii )2011i i p ip ln Z Z σααα=+++L (或2011exp()i i p ip Z Z σααα=+++L ) 我们称这些方程为扰动项方差的辅助方程。

式中的Z 是原模型中部分或全部的X 或X 的函数(比如21121312Z =X ,Z =X ,Z X X =等等)。

可行广义最小二乘法的基本思想就是,先利用辅助函数求得参数估计值ˆi α,然后得出估计值ˆi σ从而得到ˆΩ及最终的GLS 结果。

FGLS 的步骤如下: (1)Y 对常数项和12,,,K X X X L 回归,求得β的OLS 估计值;(2)计算残差011ˆˆˆi i i k ki e Y X X βββ=----L (3)选择上述方程的适当形式(3i )2i e 对常数项及1,,P Z Z L 回归,求得α的估计值。

这是针对上述(i )的情况。

式中的Z 为原来X 的平方或交叉乘积。

然后把这些α的估计值代回(i )便得到2i σ的估计值2ˆi σ。

再使用GLS 或WLS 得出最终结果。

需要指出的是,这种方式并不能保证所有的2ˆi σ都为正,如果其中出现了0或负数,那么我们就只能使用原来的2i e 代替2ˆi σ了。

(3ii )对应于上述方程(ii ),让i e 对常数项及1,,P Z Z L 回归,求得α的OLS估计值,代入(ii )得到ˆi σ,然后使用GLS 或WLS (此时选择权数为1ˆi σ,如ˆi σ为负,那么权数为1ie )。

(3iii )对应于方程(iii ),让2i lne 对常数项及1,,P Z Z L 回归,求出α的OLS 估计值,再代回(iii )求得2ˆi ln σ或2ˆi σ。