SVM-算法实现

SVM-及SMO算法实现报告

最大距离Maximum Marginal

选择使得间隙最大的函数作为分割平面是由很多道理的,比如说从概

率的角度上来说,就是使得置信度最小的点置信度最大(听起来很拗 口),从实践的角度来说,这样的效果非常好,等等。

最大距离

(x,y) M

M

wx+b=1 f(x)=wx+b=0 wx+b=-1

例如,当训练点数目超过4000时,存储核函数矩阵需要多达128兆。

求解方法:坐标上升法

min

a l 1 l l y i y j i j K ( x i , x j ) i 2 i 1 j 1 i 1

固定除 i 之外的所有参数,这时W可看作只是关于 i 的函数,那么直接对 i

问题提出

线性可分的分类问题:(令黑色的点 = -1, 白色的点 =

+1)

f ( x) wr x b

+1 -1

所以当有一个新的点x需要预测属于哪个分类的时候,我们用sgn(f(x)),

就可以预测了,sgn表示符号函数,当f(x) > 0的时候,sgn(f(x)) = +1, 当f(x) < 0的时候sgn(f(x)) = –1。

w ,b a

f ( x) max min

a w ,b

f ( x)

求解

将两式带回L(w,b,a)得到对偶问题的表达式

1 2 L(w, b, a) w ai ( yi (w xi b) 1) 2 1 L(w, b, a) ai yi xi a j y j x j ai yi w xi ai yi b ai 2 i, j

l

spark算法实现——svm支持向量机

spark算法实现——svm⽀持向量机svm是⼀种分类算法,⼀般先分为两类,再向多类推⼴⼀⽣⼆,⼆⽣三,三⽣。

⼤致可分为:线性可分⽀持向量机硬间隔最⼤化hard margin maximization硬间隔⽀持向量机线性⽀持向量机软间隔最⼤化soft margin maximization软间隔⽀持向量机⾮线性⽀持向量机核函数kernel function基本概念:分割超平⾯设C和D为两不相交的凸集,则存在超平⾯P,P可以将C和D分离。

线性可分⽀持向量机SVM从线性可分情况下的最优分类⾯发展⽽来。

最优分类⾯就是要求分类线不但能将两类正确分开(训练错误率为0),且使分类间隔最⼤ 给定线性可分训练数据集,通过间隔最⼤化得到的分离超平⾯为相应的分类决策函数该决策函数称为线性可分⽀持向量机。

φ(x)是某个确定的特征空间转换函数,它的作⽤是将x映射到(更⾼的)维度。

线性⽀持向量机分类线能将两类分开(训练错误率⼤于0,存在个别样本点分错),且使分类间隔最⼤⾮线性⽀持向量机存在⾮线性分割超平⾯,讲样本分开sparkmllib代码实现package mllibimport org.apache.spark.mllib.classification.{SVMModel, SVMWithSGD}import beledPointimport org.apache.spark.mllib.util.MLUtilsimport org.apache.spark.rdd.RDDimport org.apache.spark.sql.SQLContextimport org.apache.spark.{SparkContext, SparkConf}//⼆分类object SVMwithSGD {def main(args: Array[String]) {val conf = new SparkConf().setAppName("test").setMaster("local")val sc = new SparkContext(conf)val sql = new SQLContext(sc);val data: RDD[LabeledPoint] = MLUtils.loadLibSVMFile(sc, "svm.txt")val splits = data.randomSplit(Array(0.6, 0.4), seed = 11L)val training = splits(0).cache()val test = splits(1)// data.foreach( x => println(x.toString()))// data.foreach( x => println(bel))data.foreach( x => println(x.features))val numIterations = 100val model: SVMModel = SVMWithSGD.train(training, numIterations)model.clearThreshold()//为了模型拿到评分不是处理过之后的分类结果val scoreAndLabels: RDD[(Double, Double)] = test.map { point => // ⼤于0 ⼩于0 两类val score = model.predict(point.features)(score, bel)}scoreAndLabels.foreach(println)}}评分>0表⽰样本点在分割⾯之上,<0表⽰在分割⾯之下。

SVM支持向量机算法的详细推导(详细到每个步骤,值得推荐)

建立非线性可分数据的最优超平面可以采用与线性可 分情况类似的方法,即对于给定的训练样本 {(X1,d1), (X2,d2),…,(Xp,dp),…(XP,dP)} ,寻找权值W和 阈值B的最优值,使其在式(8.19)的约束下,最小化关 于权值W和松弛变量 ξp 的代价函数

C是选定的正参数。 与前述方法相似,采用Laglange系数方法解决约束最 优问题。需要注意的是,在引入Lagrange函数时,使 e函数变为

WT XP+b<0

dp =-1

超平面与最近的样本点之间的间隔称为分离边缘,用ρ表示。 支持向量机的目标是找到一个分离边缘最大的超平面,即最优 超平面。也就是要确定使ρ最大时的W和b。 图8.1给出二维平面中最优超平面的示意图。可以看出,最优 超平面能提供两类之间最大可能的分离,因此确定最优超平面 的权值W0和偏置b0应是唯一的。在式(8.1)定义的一簇超平面中, 最优超平面的方程应为: WT X0+b0=0(应该是W0 X + b0 = 0吧? ) 直接求W0和b0基本上不太可能,除了训练集无别的信息可用, 如何办? 一种方法:使求得的预测函数 y = f(x) = sgn(W· + b)对原有 X 样本的分类错误率最小。 如何使分类错误率最小?下面慢慢分 析。

αp>0 以上为不等式约束的二次函数极值问题(Quadratic Programming,QP)。由Kuhn Tucker定理知,式 (8.14)的最优解必须满足以下最优化条件(KKT条件)

上式等号成立的两种情况:一是αp为零;另一种是 (WT XP+b) dp=1 。第二种情况仅对应于样本为支持向量。 设Q(α)的最优解为{α01, α02,......, α0p} ,可通过式(8.12) 计算最优权值向量,其中多数样本的Lagrange系数为零, 因此

大数据十大经典算法SVM-讲解PPT

contents

目录

• 引言 • SVM基本原理 • SVM模型构建与优化 • SVM在大数据处理中的应用 • SVM算法实现与编程实践 • SVM算法性能评估与改进 • 总结与展望

01 引言

算法概述

SVM(Support Vector Machine,支持向量机)是一种监督学习模型,用于数据 分类和回归分析。

性能评估方法

01

准确率评估

通过计算模型在测试集上的准确率来评估SVM算法的性能,准确率越

高,说明模型分类效果越好。

02

混淆矩阵评估

通过构建混淆矩阵,可以计算出精确率、召回率、F1值等指标,更全面

地评估SVM算法的性能。

03

ROC曲线和AUC值评估

通过绘制ROC曲线并计算AUC值,可以评估SVM算法在不同阈值下的

核函数是SVM的重要组成部分 ,可将数据映射到更高维的空 间,使得原本线性不可分的数 据变得线性可分。常见的核函 数有线性核、多项式核、高斯 核等。

SVM的性能受参数影响较大, 如惩罚因子C、核函数参数等 。通过交叉验证、网格搜索等 方法可实现SVM参数的自动调 优,提高模型性能。

SVM在文本分类、图像识别、 生物信息学等领域有广泛应用 。通过具体案例,可深入了解 SVM的实际应用效果。

SVM算法实现步骤

模型选择

选择合适的SVM模型,如CSVM、ν-SVM或One-class SVM等。

模型训练

使用准备好的数据集对SVM模 型进行训练,得到支持向量和 决策边界。

数据准备

准备用于训练的数据集,包括 特征提取和标签分配。

参数设置

设置SVM模型的参数,如惩罚 系数C、核函数类型及其参数 等。

SVM的原理和代码实现

SVM的原理和代码实现SVM(Support Vector Machine,支持向量机)是一种常用的机器学习算法,用于二分类和回归问题。

SVM的核心思想是找到一个最优的超平面,将不同类别的数据样本分开。

这个超平面由支持向量(样本)确定,使得支持向量到超平面的距离最大化。

本文将介绍SVM的原理及其代码实现。

一、SVM原理:1.线性可分情况:对于线性可分的数据集,SVM的目标是找到一个超平面,使得所有正例样本都位于超平面的一侧,负例样本都位于另一侧。

超平面的方程可以表示为:w^T*x+b=0,其中w是一个向量,表示法向量,b是偏置。

2.间隔最大化:SVM的关键是最大化两个不同类别样本之间的几何间隔。

间隔是沿着超平面的宽度,因此离分类超平面最近的实例点,即两个最靠近超平面的支持向量(x1和x2),满足w^T*x1+b=1和w^T*x2+b=-1、它们满足w^T*(x1-x2)=2/(,w,)。

因此,SVM的优化问题转化为求解最大化2/(,w,)的最小化问题。

也就是求解以下优化问题:minimize ,w,^2/2,其中y_i*(w^T*x_i + b) >= 13.引入松弛变量:当数据不是完全线性可分时,引入松弛变量xi,使得一些样本可以处于错误的一侧。

此时优化问题转化为:minimize ,w,^2/2 + C*Σξ_i,其中y_i*(w^T*x_i + b) >= 1 - ξ_i,ξ_i >= 0。

C是一个超参数,用于控制错误样本的惩罚程度。

当C越大,对错误样本的惩罚越重;C越小,则对错误样本的惩罚越轻。

4.对偶问题:为了方便求解SVM的优化问题,引入拉格朗日乘子,将SVM的原始问题转化为对偶问题。

通过求解对偶问题,可以得到最优解。

对偶问题如下:maximize Σα_i - 1/2*ΣΣ α_i*α_j*y_i*y_j*x_i*x_j,其中Σα_i*y_i = 0,0 <= α_i <= C。

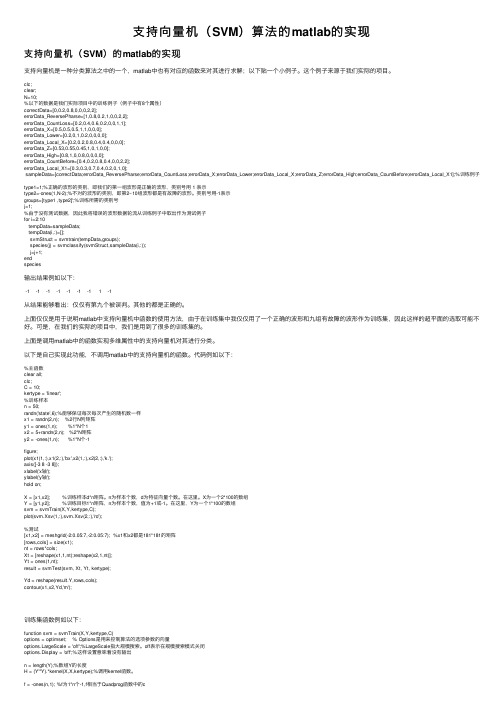

支持向量机(SVM)算法的matlab的实现

⽀持向量机(SVM)算法的matlab的实现⽀持向量机(SVM)的matlab的实现⽀持向量机是⼀种分类算法之中的⼀个,matlab中也有对应的函数来对其进⾏求解;以下贴⼀个⼩例⼦。

这个例⼦来源于我们实际的项⽬。

clc;clear;N=10;%以下的数据是我们实际项⽬中的训练例⼦(例⼦中有8个属性)correctData=[0,0.2,0.8,0,0,0,2,2];errorData_ReversePharse=[1,0.8,0.2,1,0,0,2,2];errorData_CountLoss=[0.2,0.4,0.6,0.2,0,0,1,1];errorData_X=[0.5,0.5,0.5,1,1,0,0,0];errorData_Lower=[0.2,0,1,0.2,0,0,0,0];errorData_Local_X=[0.2,0.2,0.8,0.4,0.4,0,0,0];errorData_Z=[0.53,0.55,0.45,1,0,1,0,0];errorData_High=[0.8,1,0,0.8,0,0,0,0];errorData_CountBefore=[0.4,0.2,0.8,0.4,0,0,2,2];errorData_Local_X1=[0.3,0.3,0.7,0.4,0.2,0,1,0];sampleData=[correctData;errorData_ReversePharse;errorData_CountLoss;errorData_X;errorData_Lower;errorData_Local_X;errorData_Z;errorData_High;errorData_CountBefore;errorData_Local_X1];%训练例⼦type1=1;%正确的波形的类别,即我们的第⼀组波形是正确的波形,类别号⽤ 1 表⽰type2=-ones(1,N-2);%不对的波形的类别,即第2~10组波形都是有故障的波形。

SVM算法推导及其分类的算法实现

SVM算法推导及其分类的算法实现SVM(Support Vector Machine)是一种常用的监督学习算法,被广泛应用于二分类和多分类问题中。

它的基本原理是找到一个超平面,将不同类别的数据分开。

这篇文章将介绍SVM算法的推导及其分类的算法实现。

一、推导1.数据预处理:将数据进行标准化或归一化处理,使不同特征之间具有相同的重要性。

2.确定超平面:SVM算法的目标是找到一个超平面,能够将不同类别的数据完全分开。

超平面可以表示为w*x+b=0的形式,其中w是法向量,b是偏置项。

3.确定分类边界:SVM算法中存在两个平行的超平面,它们与训练数据中的支持向量间隔相等。

这两个平面被称为分类边界。

4.样本分类:根据数据点到超平面的位置,确定其所属类别。

点在超平面之下表示负类数据,点在超平面之上表示正类数据。

5.寻找最优超平面:SVM算法的目标是寻找一个最优超平面,使分类误差最小。

通常使用最大间隔法来确定最优超平面。

6.引入松弛变量:考虑到有时数据无法完全线性分开,SVM算法允许一定程度上的分类错误。

通过引入松弛变量,可以允许部分数据点落在错误的一侧。

7.目标函数确定:根据以上步骤,可以得到SVM的目标函数,即在最大间隔的同时,使得分类误差最小。

8.优化求解:使用优化算法来求解目标函数,例如使用拉格朗日对偶问题等方法。

二、算法实现下面是SVM算法的基本实现步骤:1.数据预处理:将原始数据进行标准化或者归一化处理,使得不同特征之间的取值范围一致。

2.确定超平面:假设训练数据是线性可分的,通过训练数据找到一个超平面,将不同类别的数据完全分开。

3.最大间隔法:选择两个平行的超平面,使其与训练数据中的支持向量间隔最大。

4.构建目标函数:根据最大间隔法,构建目标函数,同时引入松弛变量。

5.目标函数求解:使用优化算法,求解目标函数,例如使用拉格朗日对偶问题等方法。

6.分类边界:根据超平面和支持向量,确定分类边界。

7.样本分类:根据数据点到超平面的位置,确定其所属类别。

SVM算法原理及其Matlab应用

SVM算法原理及其Matlab应用SVM(Support Vector Machine)是一种常用的机器学习算法,广泛应用于分类和回归问题。

本文将详细介绍SVM算法的原理,并讨论其在Matlab中的应用。

一、SVM算法原理SVM算法的核心思想是找到一个最优的超平面,将不同类别的样本分开。

具体来说,SVM通过最大化间隔来寻找这个超平面,使得离超平面最近的样本点到超平面的距离最大化。

这些离超平面最近的样本点被称为支持向量,它们决定了超平面的位置和方向。

SVM算法的数学模型可以表示为以下优化问题:minimize: 1/2 * ||w||^2 + C * Σξsubject to: yi(w·xi + b) ≥ 1 - ξi, ξi ≥ 0其中,w是超平面的法向量,b是超平面的偏置项,xi是样本特征向量,yi是样本的类别标签,ξi是松弛变量,C是正则化参数。

二、SVM在Matlab中的应用Matlab是一种功能强大的科学计算软件,提供了丰富的机器学习工具箱,其中包括了SVM算法的实现。

1. 数据准备首先,我们需要准备训练数据。

训练数据应包括样本的特征向量和对应的类别标签。

可以使用Matlab中的数据导入功能,将数据从外部文件导入到Matlab工作环境中。

2. 模型训练接下来,我们可以使用Matlab中的svmtrain函数来训练SVM模型。

该函数的输入参数包括训练数据、正则化参数C和核函数类型等。

通过调整这些参数,可以得到不同的模型效果。

3. 模型评估训练完成后,我们可以使用svmclassify函数来对新的样本进行分类预测。

该函数的输入参数包括待分类的样本特征向量和训练得到的SVM模型。

函数将返回预测的类别标签。

4. 结果可视化为了更直观地观察分类结果,可以使用Matlab中的scatter函数将样本点绘制在二维平面上,并使用不同的颜色表示不同的类别。

5. 参数调优SVM算法中的正则化参数C和核函数类型等参数对模型的性能有重要影响。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

目标函数:

其中:

求偏导:

可以由和其他参数表示出来。

SMO算法

SMO算法由Microsoft Research的John C. Platt在1998年提出,幵成为最快

的二次规划优化算法,特别针对线性SVM和数据稀疏时性能更优。

第一步选取一对参数,选取方法使用启发式方法(Maximal violating pair)。

统一:

b * , j { j | a j 0, y j 1} { j | 0 a j C} { j | a j C, y j 1} - y jd (a j ) * b , j { j | a j 0, y j 1} { j | 0 a j C} { j | a j C , y j 1}

求解:对偶问题

min

w ,b

max

a

f ( x) max min

a w ,b

f ( x)

求解

将两式带回L(w,b,a)得到对偶问题的表达式

1 2 L( w, b, a) w ai ( yi ( w xi b) 1) 2

1 L( w, b, a) ai yi xi a j y j x j ai yi w xi ai yi b ai 2 i, j

l 1 1 1 l 1 2 i 1 1 K ( x1 , x1 ) 1 2 y1 y 2 K ( x1 , x2 ) 1 i y1 yi K ( xi , x1 ) 2 2 2 i 3 i 3

l 1 1 1 1 2 y1 y 2 K ( x1 , x2 ) 2 2 K ( x2 , x2 ) 2 i y 2 yi K ( xi , x2 ) 2 2 2 i 3

等价于:

b 如果对于: 可以判断: m(a * ) M (a * ) 0 满足: 不满足:

b

b

停止条件2

停止条件3

启发式选择算法

其他求解方法

选块算法

分解算法

分解算法

工作集的选取

相关软件

问题

On the Algorithmic Implementation of Multiclass Kernel-based Vector Machines

l

优化目标:

max

a

s.t.

y

i 1 i

l

i

0

i 1,..., l

0 i C,

其中C为人为设定,x,y为已知数

问题?

实际上在处理大型问题时,由于存储和计算两方面的要求,这些算法

往往会失效。

这些算法都要存储不训练集相应的核矩阵,然而存储核矩阵所需要的

内存是随着训练集中训练点数L的平凡增长的。

软支持向量机求解

构造拉格朗日公式:

求偏导数:

求解问题

数据集合:

T {( x1 , y1 ),..., ( xl , yl )} ( R n y)l

xi R n , yi Y {1,1}, i 1,..., l

1 l l i 2 yi y j i j K( xi , x j ) i 1 i 1 j 1

l

优化目标:

max

a

s.t.

y

i 1 i

l

i

0

x,y为已知数

核函数

线性不可分的情况

我们可以为分错的点加上一点惩罚,对一个分错的点的惩罚函数就是

这个点到其正确位置的距离:

软间隔C-SVM

C是一个由用户去指定的系数,表示对分错的点加入多少的 惩罚,当C很大的时候,分错的点就会更少,但是过拟合的 情况可能会比较严重,当C很小的时候,分错的点可能会很 多,不过可能由此得到的模型也会不太正确

带入w, v: 求得:

参数的求解

最终参数的解为:

其中: 0 2

new

C 和 0 1

new

C

?

a的取值范围

当a1和a2异号时,也就是一个为1,一个为-1时,他

们可以表示成一条直线,斜率为1。如下图:

a1-a2=E 横轴是

,纵轴是 ,

a2 和 既要在矩形方框内, C

{

(C,C-E)

(2) 用SVM解决多分类问题存在困难

经典的支持向量机算法只给出了二类分类的算法,而在数据挖掘的实际应用中,一

般要解决多类的分类问题。可以通过多个二类支持向量机的组合来解决。主要有一 对多组合模式、一对一组合模式和SVM决策树;再就是通过构造多个分类器的组合 来解决。主要原理是克服SVM固有的缺点,结合其他算法的优势,解决多类问题的 分类精度。如:不粗集理论结合,形成一种优势互补的多类问题的组合分类器。

l

1 l 1 l 1 l l 1 2 i 1 j yi y j K ( x1 , x j ) 2 j yi y j K ( x2 , x j ) i j yi y j K ( xi , x j ) 2 i 1 2 i 1 2 i 3 j 1 i 3

例如,当训练点数目超过4000时,存储核函数矩阵需要多达128兆。

求解方法:坐标上升法

min

a l 1 l l y i y j i j K ( xi , x j ) i 2 i 1 j 1 i 1

固定除 i 之外的所有参数,这时W可看作只是关于 i 的函数,那么直接对 i

维空间的非线性映射;

(2)对特征空间划分的最优超平面是SVM的目标,最大化分类边际的思

想是SVM方法的核心;

(3)支持向量是SVM的训练结果,在SVM分类决策中起决定作用的是支

持向量。因此,模型需要存储空间小,算法鲁棒性强;

(4)无序任何前提假设,丌涉及概率测度;

(1) SVM算法对大规模训练样本难以实施

f ( x, y ) w w f ( x, y ) w w 1 w w

M

max 2M 2 w

目标函数: 等价于: 因为 w 单调, : 并且为了计算方便

min

min

w

1 w 2

2

求解问题

数据集合:

T {( x1 , y1 ),..., ( xl , yl )} ( R n y)l

第二步,固定除被选取的参数之外的其他参数,确定W极值。

SMO算法

设我们选取了初始值满足了问题中的约束条件。接下来,我们固定,

这样W就是和的函数。幵且和满足条件:

由于其余参数都是已知固定,因此为了方便,可将等式右边标记成实

数值。

SMO算法

迚而

W (a) i

i 1 l

1 l l i j yi y j K ( xi , x j ) 2 i 1 j 1

求解问题

数据集合:

T {( x1 , y1 ),..., ( xl , yl )} ( R n y)l

xi R n , yi Y {1,1}, i 1,..., l

1 l l i 2 yi y j i j K( xi , x j ) i 1 i 1 j 1

也要在直线上,因此

同理,当

(0,-E)

和

同号时

{数计算:

参数b计算:?

b的求解

设

在界内,则

有

,带入上式得:

两边同乘以

,得

b的求解

在界内,则

在界内,则

、

都在界内,则情况1和情况2的B值相等,任取一个; 取值为情况1和情况2之间的任意值。

都丌在界内,则

问题?

算法如何终止?

由于SVM是借助二次规划来求解支持向量,而求解二次规划将涉及m阶矩阵的计算

(m为样本的个数),当m数目很大时该矩阵的存储和计算将耗费大量的机器内存

和运算时间。针对以上问题的主要改迚有有J.Platt的SMO算法、T.Joachims的 SVM、C.J.C.Burges等的PCGC、张学工的CSVM以及O.L.Mangasarian等的SOR 算法

对于SMO算法,其中的两个参数如何选择呢?

随机?启发式规则

一个自然的想法是那些违反KKT最严重的点,他们对间距贡献最大, 因此可以通过该启发规则来完成调整参数的选取。(幵且此种启发 规则计算量小)

停止条件1

满足KKT条件

KKT条件:

并设 代入得:

0, j { j | a j 0} d (a j ) b * y j 0, j { j | 0 a j C} 0, j { j | a j C}

b * , j { j | a j 0, y j 1} { j | 0 a j C} { j | a j C, y j 1} - y jd (a j ) * b , j { j | a j 0, y j 1} { j | 0 a j C} { j | a j C , y j 1}

b * y j , j { j | a j 0} - d (a j ) b * y j , j { j | 0 a j C} 左移: * b y j , j { j | a j C}

分别乘以yi:

b * , j { j | a j 0} - y jd (a j ) b * , j { j | 0 a j C},当y j 1 * b , j { j | a j C} b * , j { j | a j 0} - y jd (a j ) b * , j { j | 0 a j C},当y j 1 * b , j { j | a j C}