§4随机变量的独立性

随机变量的独立性

P{ X = 0} = 1 p , P{ Z = 0} = 2 p(1 p) ,

P{ X = 0, Z = 0} = P{ X = 0, X + Y = 1}

= P{ X = 0, Y = 1} = P{ X = 0} P{Y = 1} = p(1 p ) .

2 p(1 p ) 2 = p(1 p ) , p = 0.5 . 令

1 ,若X + Y为偶数, Z= 0 ,若X + Y为奇数. 取何值时, 和 相互独立 相互独立? 问p取何值时,X和Z相互独立? 取何值时

解 首先求出Z的概率分布: 首先求出 的概率分布: 的概率分布

P{ Z = 0} = P{ X + Y = 1}

因为X和 因为 和Y 相互独立

= P{ X = 0, Y = 1} + P{ X = 1, Y = 0}

1 α= . 6

2 β = . 9

5

又由分布律的性质,有 又由分布律的性质 有

1 1 1 1 α + + + +β + =1 9 18 3 9

7 α+β = 18

假设随机变量X和 相互独立 相互独立, 例3 假设随机变量 和Y相互独立,都服从参数为 p(0<p<1)的0-1分布,随机变量 分布, ( ) 分布

f (x, y) = f X ( x) fY ( y) 成立,所以 相互独立.8 成立,所以X,Y相互独立 相互独立.

例5 设(X,Y )的联合密度函数为 ,

8 xy 0 ≤ x ≤ y , 0 ≤ y ≤ 1 f ( x, y) = , 其它 0

1

y

y= x

是否相互独立? 问X与Y是否相互独立? 与 是否相互独立 的边缘密度分别为 解 X,Y的边缘密度分别为

随机变量独立性判断随机变量的独立性和相关性

随机变量独立性判断随机变量的独立性和相关性随机变量的独立性和相关性是概率论和数理统计中的重要概念。

在实际问题中,我们经常需要判断随机变量之间是否相互独立或者相关。

本文将介绍如何判断随机变量的独立性和相关性。

一、什么是随机变量的独立性和相关性随机变量的独立性和相关性描述了随机变量之间的关系。

独立性:若两个随机变量X和Y的联合分布等于各自的边缘分布之积,即P(X=x, Y=y) = P(X=x)P(Y=y),则称X和Y独立。

相关性:若两个随机变量X和Y之间存在某种依赖关系,即它们的联合分布和边缘分布不相等,称X和Y相关。

二、判断随机变量的独立性和相关性的方法1. 统计方法利用样本数据进行统计分析,可以判断随机变量的独立性和相关性。

对于两个随机变量X和Y,如果它们的样本相关系数接近于0,可以认为X和Y近似独立;如果样本相关系数接近于1或-1,可以认为X和Y相关。

2. 图形方法通过绘制散点图可以直观地观察随机变量的相关性。

对于两个随机变量X和Y,如果它们的散点图呈现出线性关系,则可以认为X和Y相关;如果散点图呈现出无规律的分布,则可以认为X和Y近似独立。

3. 利用协方差和相关系数判断协方差和相关系数是判断随机变量相关性的重要指标。

协方差衡量了两个随机变量之间的线性相关性,若协方差为0,则可以认为两个随机变量不相关。

相关系数除了衡量两个随机变量的线性相关性,还可以衡量非线性相关性,相关系数的范围在-1至1之间,绝对值越接近1表示相关性越强,绝对值越接近0表示独立性越强。

三、应用举例1. 抛硬币问题假设一次抛硬币,X表示正面次数,Y表示反面次数。

在这个例子中,X和Y的取值只能是0或1,它们的联合分布如下:P(X=0, Y=0) = 1/2P(X=1, Y=0) = 1/2P(X=0, Y=1) = 1/2P(X=1, Y=1) = 1/2可以看出,X和Y的联合分布等于各自的边缘分布之积,即P(X=x, Y=y) = P(X=x)P(Y=y),因此X和Y是独立的。

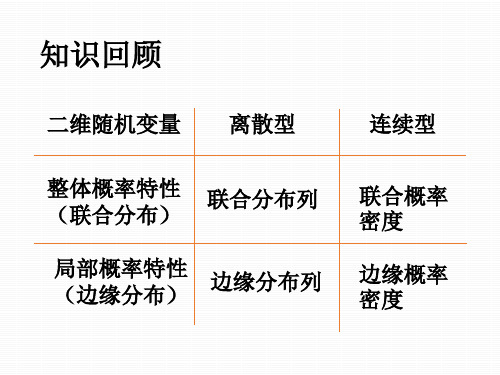

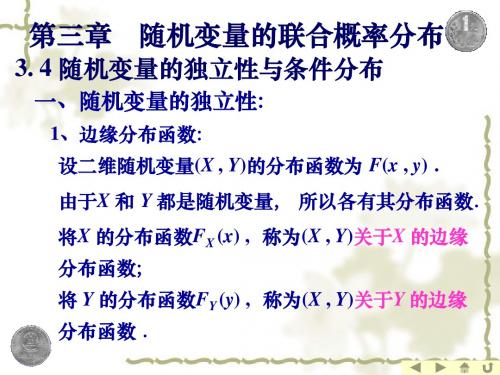

4.4 随机变量的独立性

即为

F(x,y)=Fx(x)FY(y)

反之,若X与Y满足F(x,y)=Fx(x)FY(y) ,则有

P{x1<X≤x2,y1<Y≤y2} =F(x2, y2)- F(x1, y2)-F(x2, y1)+ F(x1, y1) = Fx(x2)FY(y2)- Fx(x1)FY(y2)- Fx(x2)FY(y1)+Fx(x1)FY(y1) =[Fx(x2)-Fx(x1)][FY(y2)-FY(y1)]

则称向量(X1, X2,…, Xm)与(Y1,Y2,…,Yn)是相互独立的。

2.独立性推广的定理 定理1.

如果随机变量X1, X2,…, Xn相互独立,I1,I2,…,In为数 轴上任意n个区间,则事件{x1∈I1},{x2∈I2},…,{xn∈In}相 互独立. 定理2. 若X1, X2,…, Xn相互独立,则

(1)其中任意k个随机变量也相互独立。

(2) Y1=g1(X1), Y2=g2(X2),…, Yn=gn(Xn)也相 互独立, gi(x)(i=1,2,…,n)为n个连续函数。

定理3. 若(X1, X2,…, Xn)和(Y1,Y2,…,Ym)相互独立,则 (1) (X1, X2,…, Xn)中任意k个随机变量构成的随机向量与

四、独立性推广的一些定义

独立性的概念推广至高维随机向量的情形 1.定义: 设(X1,X2,…,Xn)为n维随机向量,其分布函 数为F(x1,x2,…,xn),关于xi的边缘分布函数Fxi(xi), 若对于任意实数x1,x2,…,xn有

FX ( x1 , x2 , , xn ) FX1 ( x1 ) FX 2 ( x2 ) FXn ( xn )

p

i xi x , y j y

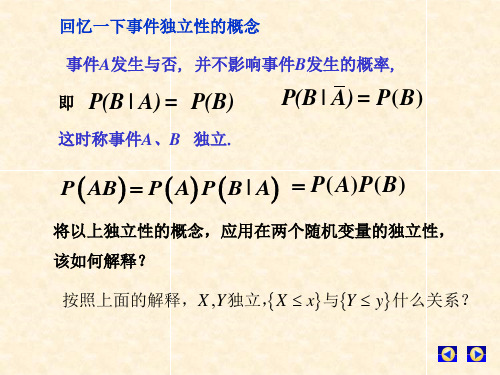

随机变量的独立性

3.随机变量的独立性随机变量的独立性是一个十分重要的概念。

在这一节中,我们利用两个事件相互独立的概念引出两个随机变量的独立性,并推导到有限多个随机变量的独立性。

1.两个随机变量的独立性定义3.6 若二维随机变量(X , Y )对任意实数均有成立,则称随机变量与是相互独立的。

设随机变量(X , Y )的联合分布函数和边缘分布函数分别为和,则与相互独立等价于对任意实数有。

若(X , Y ) 是离散型随机变量,则X与Y相互独立的充分必要条件是即这里分别是(X , Y ),X,Y的分布律。

若(X , Y )是连续性随机变量,则由分布函数与概率密度函数关系知,X与Y独立,即成立的充分必要条件是这里分别是(X , Y ),X,Y的密度函数.10.已知随机变量的联合分布律为试确定常数a,b,使X与Y相互独立解先求出(X , Y )关于X和Y的边缘分布律因要使与相互独立,故可用来确定常数a,b。

由即解得 因此(X , Y )的联合分布律和边缘分布律为经检验,此时X 与Y 是相互独立的。

例11 设随机变量(X , Y )在矩形区域上服从均匀分布,若试求(U , V )的联合分布律,并判断U 与 V 是否独立.解 区域G 如图3-7所示,因(X , Y )在G 上服从均匀分布,其联合密度函数于是得(U, V)的联合分布律和边缘分布律:其中所以U与V是不相互独立的。

例12 设随机变量的联合密度函数为试问X与Y 是否相互独立?解因为(X,Y)关于X的边缘密度函数所以,对任意实数x,y均有故X与Y是相互独立的。

例13 若二维随机变量(X, Y )服从正态分布。

试证X与Y相互独立的充分必要条件是。

证因为(X , Y )的联合密度函数为边缘密度函数为所以易见:成立的充分必要条件是,而X与Y相互独立的充分必要条件是(3.1)式对任意实数x,y成立。

例 14 一负责人到达办公室的时间均匀分布在8~12时之间,他的秘书到达办公室的时间均匀分布在7~9时之间,设他俩到达的时间是相互独立的,求他俩到达的时间相差不超过5分钟概率。

随机变量的独立性

⑵.如果随机变量 X 与Y 相互独立,则由

Fx, y FX xFY y

可知,

返回主目录

第三章 随机变量及其分布

例1

§4随机变量的独立性

设二维随机变量 X, Y 的联合分布函数为

F x,

y

2 1

2

arctan

5 x

2

10 arctan y

x , y

试判断 X 与Y 是否相互独立?

第三章 随机变量及其分布

例 3(续)

§4随机变量的独立性

Y

X

0

1

2

pi

0

1 9

2 9

1

4

9

9

1

2 9

2 9

0

4 9

2

1 9

0

0

1 9

p j

4 9

4 9

1 9

P X 1, Y 2 0 PX 1PY 2 4 1

99

随机变量 X 与Y 不独立.

返回主目录

第三章 随机变量及其分布

连续型随机变量的独立性

2

1 3

试确定常数 , 使得随机变量 X 与Y 相互独立.

由表,可得随机变量 X 与Y 的边缘分布律为

返回主目录

第三章 随机变量及其分布

例 2(续)

§4随机变量的独立性

Y X

1

2

3

pi

1

1 6

1 9

1

1

18

3

2

1 3

1 3

p j

1 2

1 9

1 18

如果随机变量 X 与Y 相互独立,则有

pij pi p j i 1, 2; j 1, 2, 3

随机变量及其分布事件的相互独立性

03

随机试验

在一定条件下进行的试验 ,其结果具有不确定性。

样本空间

随机试验所有可能结果的 集合。

事件

样本空间的一个子集,是 随机试验的结果的集合。

事件的概率

非负性、规范性、可加性 等。根据事件的性质和概率的 定义进行计算。

描述事件发生的可能性大 小的数值。

概率定义

概率的性质 概率计算

事件的相互独立性

取值是连续的实数的随机变量称为连 续随机变量。

02

随机变量的分布

概率分布

离散型随机变量的概率分布

离散型随机变量的取值范围是有限或可数的,每个取值对应的概率是已知的, 这些概率值之和为1。

连续型随机变量的概率分布

连续型随机变量的取值范围是无限的,取值对应的概率是未知的,需要使用概 率密度函数来描述。

多元随机变量的分布

二元随机变量的分布

二元随机变量有两个取值,其分布可以描述为两个边缘分布 的组合。

高维随机变量的分布

高维随机变量有多个取值,其分布可以描述为多个边缘分布 的组合。高维随机变量的分布比一维和二元随机变量的分布 更为复杂,需要考虑更多的因素。

03

事件及其相互独立性

事件的定义

01

02

如果事件的发生不受随机变量的影响,则称事件与随机变量相互独立。

独立性的条件

事件的发生不受随机变量的影响,或者随机变量的取值不影响事件发生的概率。

两个随机变量的相互独立性

定义

如果对于任意两个实数$x$和$y$,有 $P(X=x, Y=y) = P(X=x)P(Y=y)$,则称 $X$和$Y$相互独立。

随机变量及其分布事件的相 互独立性

汇报人: 日期:

目录

随机变量的独立性

对于任意的x, y ,随机事件 X x 与 Y y 相互独立.

结论:在独立的条件下有 F x, y FX x FY y

二维随机变量 X, Y 的联合分布函数F x, y 可由其边缘分布函数 X x 与 FY y 唯一确定. F

ห้องสมุดไป่ตู้

第三章 随机变量及其分布

1

因 p21 ( X 0, Y 0) 0 1 1 而 p2 P( X 0) , p1 P(Y 0) 2 2 p21 p2 p1

故X与Y不独立

第三章 随机变量及其分布

三、连续型随机变量的独立性

§4随机变量的独立性

设 X, Y 是二维连续型随机变量 ,其联合密度函数 为 f x, y , 又随机变量X 的边缘密度函数为 X x , f

试判断随机变量 与Y 是否相互独立? X 解:

当0 x 1时,

2 2 1 2 f X x f x, y dy x xy dy 2 x x 3 3 0

2

第三章 随机变量及其分布

所以,随机变量 的密度函数为 §4随机变量的独立性 X

二、离散型随机变量的独立性 设 X, Y 是二维离散型随机变量 ,其联合分布律为 pij P X x i, Y y j i,j 1, 2,

又随机变量X 的分布律为

§4随机变量的独立性

p i P X x i

p j P Y y j

i 1, 2,

如果对于任意的 , y ,有 x

F x, y FX x FY y

则称 X, Y 是相互独立的随机变量 .

第三章 随机变量及其分布

《概率论》第3章§4相互独立的随机变量

§4

A, B 相互独立 X , Y 相互独立

相互独立的随机变量

11/19

P( A | B) P( A), P( B | A) P( B)

f ( x, y) f X ( x) fY ( y) (a.e) f ( x, y ) f X |Y ( x | y ) = f X ( x) ( a.e) fY ( y )

§4

相互独立的随机变量

1/19

随机变量的独立性

离散型、连续型随机变量的独立性的判断

利用随机变量的独立性进行相关概率的 计算

第三章 多维随机变量及其分布

§4

A, B 相互独立

相互独立的随机变量

A, B 之间没有任何关系

P( AB) P( A) P( B)

2/19

怎样定义 r.v X , Y 之间的独立性 若

FX ( x2 ) FY ( y2 ) FX ( x1 ) FY ( y2 ) FX ( x2 ) FY ( y1 ) FX ( x1 ) FY ( y1 )

[ FX ( x2 ) FX ( x1 )] [ FY ( y2 ) FY ( y1 )]

P{x1 X x2 }P{ y1 Y y2 }

X ~ U (0,1), Y ~ U (0,1)

X , Y 独立,故联合密度为

1, 0 x 1, 0 y 1 f ( x, y ) f X ( x ) f Y ( y ) 其它 0,

故两信号互相干扰的概率为

P{ | X Y | 1 }

120

1

y

y x

1 2 1 2 1

2

( x ) 1 exp{ [ 21 2 1 2(1 )

随机变量的独立性与相关性

随机变量的独立性与相关性随机变量是概率论和统计学中非常重要的概念,它描述了一种具有不确定性的数值变化过程。

在实际应用中,我们经常需要分析随机变量之间的关系,以便更好地理解和应对不确定性。

一、独立性的概念与性质独立性是指两个或多个随机变量之间的关系,在给定其他随机变量的取值时并不影响彼此的概率分布。

具体来说,对于随机变量X 和Y,如果其联合概率分布可以拆解为 X 和 Y 的边缘概率分布的乘积形式,即 P(X,Y) = P(X) * P(Y),则称 X 和 Y 是独立的。

独立性具有以下性质:1. 互斥事件的独立性:如果事件 A 和事件 B 是互斥的,即同时发生的概率为零,那么 A 和 B 是独立的。

这可以通过检验P(A∩B) = P(A) * P(B) 来判断。

2. 集合独立性:对于任意多个事件,如果它们两两独立,那么它们是集合独立的。

也就是说,对于事件集合 {A1, A2, ..., An},如果对于任意的i ≠ j,有P(Ai∩Aj) = P(Ai) * P(Aj),则它们是集合独立的。

3. 独立性的性质传递:如果事件 A 和事件 B 是独立的,事件 B 和事件 C 也是独立的,则事件 A 和事件 C 是独立的。

这可以通过检验P(A∩B∩C) = P(A) * P(B) * P(C) 来判断。

二、相关性的概念与性质相关性描述了两个随机变量之间的线性关系。

具体来说,对于随机变量 X 和 Y,它们之间的相关性可以通过协方差和相关系数来度量。

1. 协方差:协方差用于度量两个随机变量的总体误差。

设 X 和 Y是两个随机变量,它们的期望分别为μx 和μy,协方差定义为 Cov(X,Y) = E[(X-μx)(Y-μy)]。

2. 相关系数:相关系数是协方差的标准化形式,它的取值范围在 -1 到 1 之间。

设 X 和 Y 是两个随机变量,它们的标准差分别为σx 和σy,则相关系数定义为Corr(X,Y) = Cov(X,Y) / (σx * σy)。

概率论与数理统计-第3章-第4讲-随机变量的独立性

1, (x, y) G

f (x, y) 0,

其它.

1

2x

02 随机变量的独立性

例题 设二维离散型随机变量 X, Y 的联合分布律为

应用

Y X

1

1

1 6

2

3

1

1

9

18

2

1 3

试确定常数 , 使得随机变量 X 与Y 相互独立.

02

随机变量的独立性 由表,可得随机变量 X 与Y 的边缘分布律为

P{XY Y 0} P{( X 1)Y 0}

P{X 1 0,Y 0} P{X 1 0,Y 0}

P(X ) P(X ) 1

2

P{X 1}P{Y 0} P{X 1}P{Y 0} 1111 1

22 22 2

第4讲 随机变量的独立性

本节我们学习了二维随机变量的独立性, 后续会推广到更多维. 随机变量的独立性在概率论和数理统计中会发挥重要的作用.

用分布函数表示, 即 设 X,Y 是两个随机变量, 若对任意的x, y, 有 F ( x, y) FX (x)FY ( y)

则称 X, Y 相互独立 .

它表明, 两个随机变量相互独立时, 联合分布函数等于两个 边缘分布函数的乘积 .

01 两个随机变量独立的定义

离散型

X与Y 独立

对一切 i , j 有

01 两个随机变量独立的定义 两个随机变量独立的定义

设 X,Y是两个随机变量, 若对任意的x,y ,有 P ( X x,Y y) P( X x)P(Y y)

则称X,Y相互独立 .

如何判断

两事件A, B独立的定义是: 若 P(AB)=P(A)P(B)则称事件A, B独立 .

01 两个随机变量独立的定义

随机变量的独立性

f (x, y)

fX

(

x)

fY

(

y)

1 4

e

x 2

y

0

x 0, y 0 其他

P( X 2Y )

dx

1

e

x

2

y

dy

0

x/2 4

1 x x e 2 e 4 dx

1 e

3x 4

dx

2

02

02

3

两个随机变量函数的分布

• 随机变量函数的分布:

• 已知随机变量X的分布,如何求随机变量 Y=g(X)的分布

Fmax (z) (F (z))n Fmin (z) 1 [1 F (z)]n

例:设X与Y 独立,均服从U (0, 1), 分别求M max( X ,Y ), N min( X ,Y )的概率密度。

0, x 0

解:X、Y的分布函数F ( x)

x,

0

x

1

1, x 1

0, x 0

例:设X与Y 独立,且 X, Y 等可能地取值 0和1. (1)求 U = max(X, Y) 的分布列. (2)求V = X+Y的分布列.

解: X 0 1 p 1/2 1/2

Y0 1 P 1/2 1/2

(1) U = max(X, Y) 的取值为: 0, 1

P(U=0) = P(X=0, Y=0) = P(X=0)P(Y=0) =1/4

Fmin (z) P( N z) 1 P( N z) 1 P( X z,Y z) 1 P( X z)P(Y z)

即 Fmin (z) 1 (1 FX (z))(1 FY (z))

推广:

设X1, X2 ,, Xn是n个相互独立的随机变量,它们的分布函数分别

随机变量的独立性与相关性

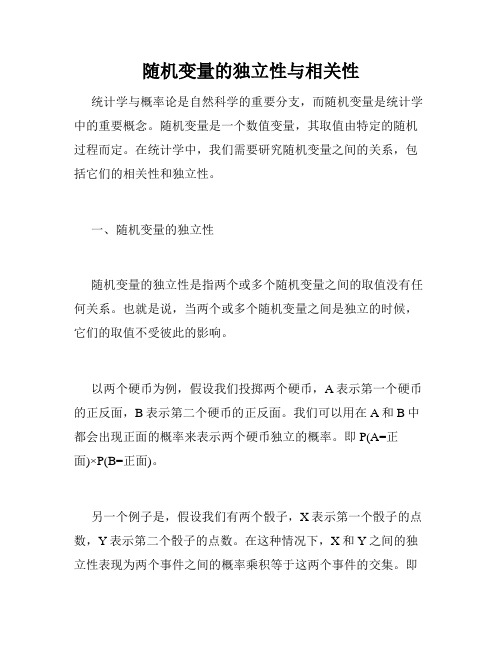

随机变量的独立性与相关性统计学与概率论是自然科学的重要分支,而随机变量是统计学中的重要概念。

随机变量是一个数值变量,其取值由特定的随机过程而定。

在统计学中,我们需要研究随机变量之间的关系,包括它们的相关性和独立性。

一、随机变量的独立性随机变量的独立性是指两个或多个随机变量之间的取值没有任何关系。

也就是说,当两个或多个随机变量之间是独立的时候,它们的取值不受彼此的影响。

以两个硬币为例,假设我们投掷两个硬币,A表示第一个硬币的正反面,B表示第二个硬币的正反面。

我们可以用在A和B中都会出现正面的概率来表示两个硬币独立的概率。

即P(A=正面)×P(B=正面)。

另一个例子是,假设我们有两个骰子,X表示第一个骰子的点数,Y表示第二个骰子的点数。

在这种情况下,X和Y之间的独立性表现为两个事件之间的概率乘积等于这两个事件的交集。

即P(X=2)×P(Y=6)=1/36,因为这意味着第一个骰子的点数是2,第二个骰子的点数是6的概率。

二、随机变量的相关性相对于独立性而言,相关性表示出的是两个或多个随机变量之间的取值存在某种关系。

也就是说,当两个或多个随机变量之间是相关的时候,它们的取值受彼此的影响。

在统计学中,我们用协方差和相关系数来描述随机变量之间的相关性。

协方差是一个衡量两个随机变量之间关系强度的指标,其中正值表示正相关,负值表示负相关,而0表示没有相关性。

相关系数是协方差的标准化版本,其数值范围在-1到1之间,其中1表示完全正相关,-1表示完全负相关,而0表示没有相关性。

相关系数越接近1或-1,证明两个随机变量之间的关系越强。

需要注意的是,虽然相关性和独立性在概念上有所区别,但它们并非互斥的关系。

有时候,两个随机变量之间既有独立性又有相关性。

三、应用随机变量的独立性和相关性在统计学中拥有广泛的应用场景。

例如,在回归分析中,我们需要确定每个输入变量之间是否存在相关性或独立性,以确定模型中是否需要保留特定的变量。

高等数学3.4 随机变量的独立性与条件分布

2 3/15 3/15

0 1

(2) 由( X , Y ) 的联合分布律知 X 的边缘分布为 X P 0 1/15 1 10/15

由条件分布定义可知

P Y = 0 X = 0 = P Y = 1 X = 0 = P Y = 2 X = 0 =

P X = 0 , Y = 0 P X = 0 P X = 0 , Y = 1 P X = 0 P X = 0 , Y = 2 P X = 0

Y P

1 1/2

2 1/9 +α

3 1/18 +β

若X 与 Y 相互独立, 则有 1 = P X = 1, Y = 2 = P X= 1 9 1 1 = ( + ) 3 9 1 = P X = 1, Y= 3 = P X =1 18 1 1 = ( + ) 3 18

Y P = 2

dt

=

同理

x R

fY ( y ) =

( y 2 )2 exp , 2 2 2 2 2 1

y R

若 = 0 , 则对于任意实数 x 与 y 都有 f ( x, y ) = f X ( x )fY ( y ) 因此 X 与 Y 是相互独立的 . 反之, 若 X 与Y 相互独立, 则对于任意实数 x与 y 都有 f ( x, y ) = f X ( x )fY ( y ) 若取 x = 1 , y = 2 , 则有

1 2

2

2 2 ( x ) ( x ) 2 2 1 1 + 2 2 1 1

y 2 ( x 1 ) x 1 1 = 2 2 1 2 1 2(1 ) 2

2

所以( X , Y )关于X的边缘密度为

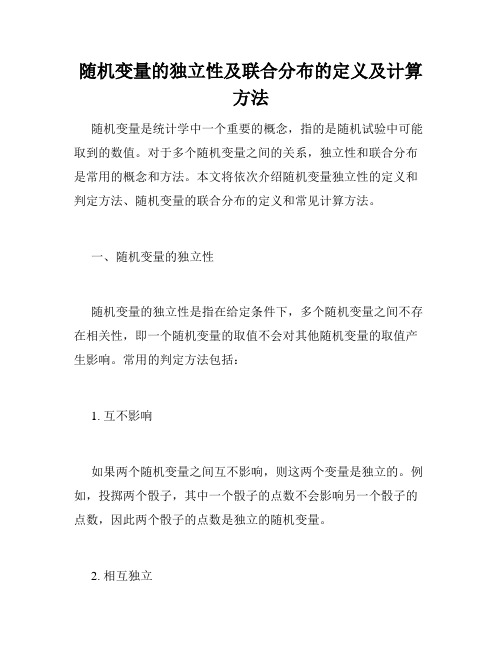

随机变量的独立性及联合分布的定义及计算方法

随机变量的独立性及联合分布的定义及计算方法随机变量是统计学中一个重要的概念,指的是随机试验中可能取到的数值。

对于多个随机变量之间的关系,独立性和联合分布是常用的概念和方法。

本文将依次介绍随机变量独立性的定义和判定方法、随机变量的联合分布的定义和常见计算方法。

一、随机变量的独立性随机变量的独立性是指在给定条件下,多个随机变量之间不存在相关性,即一个随机变量的取值不会对其他随机变量的取值产生影响。

常用的判定方法包括:1. 互不影响如果两个随机变量之间互不影响,则这两个变量是独立的。

例如,投掷两个骰子,其中一个骰子的点数不会影响另一个骰子的点数,因此两个骰子的点数是独立的随机变量。

2. 相互独立如果多个随机变量之间的任意两个变量都是独立的,则这些随机变量是相互独立的。

例如,投掷三个骰子,每个骰子的点数都是独立的随机变量,因此三个骰子的点数是相互独立的随机变量。

3. 独立性定义下的概率乘法公式对于两个独立的随机变量X和Y,它们同时取到某个值的概率等于它们各自取到这个值的概率的乘积。

即P(X=x,Y=y)=P(X=x)P(Y=y)。

该公式也适用于多个独立的随机变量。

二、随机变量的联合分布多个随机变量的联合分布是指这些随机变量取值组合所对应的概率分布函数。

常用的计算方法包括:1. 联合分布函数对于两个随机变量X和Y,它们的联合分布函数定义为F(x,y)=P(X<=x,Y<=y)。

该函数可以用来计算任意两个随机变量的联合分布。

对于多个随机变量,联合分布函数的定义相应地拓展。

2. 联合概率密度函数对于连续型随机变量,它们的联合概率密度函数可以通过对应的联合分布函数求导得到。

即f(x,y)=∂^2 F(x,y)/∂x∂y。

该函数可以用来计算任意两个连续型随机变量的联合分布。

对于多个连续型随机变量,联合概率密度函数的定义相应地拓展。

3. 边缘分布和条件分布对于联合分布中的任意一个随机变量,我们都可以将它的概率分布函数单独计算出来,称为边缘分布。

随机变量的独立性

在区域 G 中 f x, y fX x fY y

故 X ,Y不相互独立.

例5、

V U

0

1

0 1/3 1/3 2/3

1 0 1/3

1/3

1/3 2/3

U、V不相互独立。

例4 .设(X,Y)服从N(μ1,σ12;μ2,σ22;ρ ),

求边缘密度。

f (x, y)

1

exp{ 1 (( x 1 )2 2 x 1 y 2 ( y 2 )2 )}

有 P{X = xi,Y= yj}= P{X= xi}·P{Y= yi}

(X,Y)的联合分布律可用下列形式的联合分布表表示:

Y X

y1

x1

p11

x2

p21

:

:

y2 … yj

p12 … p 1j

p22 … p 2j

:

:

yj+1 … p 1j+1 … p 2j+1 …

:

xi

pi1

pi2 … pij

pij+1 …

例题1 (167 NO1)

设随机变量

X i~

1 1/4

0 1/2

1

1/4

且满足P{X1 X 2 0} 1, 则P{X1=X2 }=(

)

i 1, 2

(A)0;(B)1/4 (C) 1/2 (D) 1

例题 2 (P167 2)设两个随机变量X,Y 独立同分布, P{X=-1}=P{Y=-1)}=1/2 , P(X=1)=P(Y=1)=1/2,则下列各式中成立的是( )

依次类推可得

Y X

1

2

3

1 1/6 1/9 1/18

2 2/6 2/9 2/18

随机变量的独立性

定义3. 7 设X 和Y 为两个随机变量,若对于任意的x 和y 有 P{X x,Y y} P{X x}P{Y y},

则称X 和Y 是相互独立的( Mutually independent )。

若二维随机变量( X , Y )的分布函数为 F (x,y) ,其边缘分

布函数分别为FX (x)和FY (y),则上述独立性条件等价于对所有x 和y 有

fY

(

y)

e y,y

0,

0, 其他。

求X 和Y 的联合概率密

度 f (x,y) 。

解 由X 和Y 相互独立可知

f (x,y) fX (x) fY ( y)

e(xy),x 0,y 0,

0,其他。

概率学与数理统计

F (x,y) FX (x)FY ( y) 。

(3.13)

1. 对于二维离散型随机变量,上述独立性条件等价于对于

( X , Y )的任何可能取的值 (xi,y j ) 有

P{X x,Y y} P{X xi}P{Y y j}。

(3.14)

2. 对于二维连续型随机变量,独立性条件的等价形式是对

一切x 和y 有

f (x,y) fX (x) fY ( y) ,

(3.15)

这里, f (x,y)为( X , Y )的概率密度函数,而 fX (x) 和 fY ( y)

分别是边缘概率密度函数。

如在例3.7中,(1)有放回摸球时,X 与Y 是相互独立的;而

(2)无放回摸球时,X 与Y 不是相互独立的。

π

1 y2,1 0,

y 1, 其他。

可见在圆域 x2 y2 1 上,f (x,y) fX (x) fY ( y) ,故X 和Y 不相

互独立。

概率论与数理统计 4.4 随机变量的独立性

0

1

9

6

0

25 25

6

4

1

25 25

P{ X1

0,

X2

0}

66 10 10

9 25

类似可得其余三个联合概率(见上表)。

再讨论边缘分布

(1)不放回抽取

X2 X1

0

1

pi•

1

4

3

0

3 15

5

4

2

2

1

15 15

5

p• j

3

2

5

5

X1 0

1

3

2

P

5

5

X2 0

1

P3

2

5

5

(2)有放回抽取

X2 X1

0

1

pi•

P(X xi ,Y y j ) P(X xi )P(Y y j )

即

pij pi. p. j

则称 X 和Y 相互独立.

二、例题

概率论

例1 设(X,Y)的概率密度为

xe( x y) , x 0, y 0

f (x, y)

0, 其它

问X和Y是否独立?

解

fX (x)

xe( x y)dy xe x ,

直接求面积

40

P(X <Y) =P(X >Y) =1/2

10

0 15

概率论

x y 5 xy5

45

x

xy

45

x

例3:设( X ,Y )服从二维正态分布,则X与Y相互独立 的充要条件是 0.

证明 : 先证充分性

若

1 0, f ( x, y)

21 2

随机变量的独立性和条件概率分布

随机变量的独立性和条件概率分布是概率论中的重要概念,在很多领域都有广泛的应用。

独立性的概念是指两个或多个事件之间的关系,而条件概率分布则是指随机变量在给定一些条件下的概率分布。

首先来看独立性。

在数学上,独立性通常指的是两个随机变量之间的关系。

如果两个随机变量X和Y是独立的,那么它们可以分别考虑,而且它们之间的任何影响都不会相互影响。

具体来说,如果两个随机变量X和Y是独立的,那么它们的联合概率分布可以拆分成它们各自的概率分布的乘积。

即,P(X=x, Y=y) = P(X=x) * P(Y=y)。

举个例子,假设我们有两个骰子,我们把它们连续掷两次。

我们可以定义随机变量X为第一次掷出的点数,随机变量Y为第二次掷出的点数。

如果我们假设这两个骰子是六面的,并且它们是公平的,那么每个点数出现的概率都是1/6。

因此,我们可以计算出X和Y的概率分布,分别为P(X=1)=P(X=2)=P(X=3)=P(X=4)=P(X=5)=P(X=6)=1/6和P(Y=1)=P(Y=2)=P(Y=3)=P(Y=4)=P(Y=5)=P(Y=6)=1/6。

现在,假设我们想知道掷出的两个点数是相等的这个事件的概率。

我们可以用独立性来计算。

因为X和Y是独立的,所以P(X=x, Y=y) =P(X=x) * P(Y=y),因此,P(X=Y) = ΣP(X=x, Y=x) = ΣP(X=x) *P(Y=x) = 1/6 * 1/6 + 1/6 * 1/6 +...+1/6 * 1/6 = 1/6。

接下来看条件概率分布。

条件概率分布是指,在给定一些条件下,随机变量的概率分布。

具体来说,如果我们知道了一些关于随机变量的信息,那么我们可以通过条件概率分布来计算在这些信息下随机变量的取值的概率。

条件概率分布通常用P(X|Y)表示,表示给定Y的条件下,X的概率分布。

它可以通过原始的概率分布计算得到。

具体来说,如果我们知道了Y的取值,那么我们可以将联合概率分布进行归一化,得到在Y取值的条件下,X取值的概率分布。

随机变量的独立性检验技巧

随机变量的独立性检验技巧随机变量的独立性是概率论中一个非常重要的概念,它描述了两个或多个随机变量之间是否相互独立。

在实际问题中,我们经常需要对随机变量的独立性进行检验,以验证它们之间是否存在相关性。

本文将介绍几种常用的随机变量独立性检验技巧,帮助读者更好地理解和应用这一概念。

### 1.卡方检验卡方检验是一种常用的检验方法,用于检验两个分类变量之间是否独立。

在进行卡方检验时,我们首先需要构建一个列联表,然后计算观察频数与期望频数之间的差异,最终通过卡方统计量来判断两个变量之间是否存在显著性关联。

如果计算得到的卡方值显著大于临界值,就可以拒绝原假设,认为两个变量不独立。

### 2.相关系数检验相关系数检验是用来检验两个连续型随机变量之间是否存在线性相关性的方法。

通过计算皮尔逊相关系数或斯皮尔曼相关系数,我们可以得到两个变量之间的相关性程度。

如果相关系数接近于0,说明两个变量独立;如果相关系数接近于1或-1,说明两个变量之间存在较强的线性相关性。

### 3.协方差检验协方差检验是用来检验两个随机变量之间是否存在线性相关性的方法。

通过计算两个变量的协方差,我们可以得到它们之间的关联程度。

如果协方差为0,说明两个变量独立;如果协方差大于0,说明它们呈正相关;如果协方差小于0,说明它们呈负相关。

### 4.独立性检验除了上述方法外,还有一些其他的独立性检验方法,如Fisher精确检验、Kolmogorov-Smirnov检验等。

这些方法在不同的情况下有着不同的应用场景,读者可以根据具体问题选择合适的方法进行独立性检验。

### 结语随机变量的独立性检验是概率论中的一个重要内容,它在统计学、机器学习等领域有着广泛的应用。

通过本文介绍的几种检验技巧,读者可以更好地理解和应用随机变量的独立性检验方法,从而更准确地分析和解决实际问题。

希望本文能对读者有所帮助,谢谢阅读!。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第三章随机变量及其分布

§4随机变量的独立性

第三章随机变量及其分布

第三章随机变量及其分布

第三章随机变量及其分布

⎛⎞⎛1y x ππ第三章随机变量及其分布

二、离散型随机变量的独立性

第三章随机变量及其分布

例2

第三章随机变量及其分布

第三章

随机变量及其分布

§4随机变量的独立性

第三章随机变量及其分布

§4随机变量的独立性

第三章

随机变量及其分布

§4随机变量的独立性

例3

第三章随机变量及其分布

第三章随机变量及其分布

第三章随机变量及其分布

三、连续型随机变量的独立性第三章随机变量及其分布

第三章随机变量及其分布§2 边缘分布第三章随机变量及其分布

第三章随机变量及其分布第三章随机变量及其分布

{}

第三章随机变量及其分布§4随机变量的独立性第三章随机变量及其分布§4随机变量的独立性

X

反之,如果随机变量Y

相互独立,则对任意的

与

第三章随机变量及其分布

第三章随机变量及其分布

第三章

随机变量及其分布

第三章随机变量及其分布一、和的分布

第三章随机变量及其分布

§4 多维随机变量函数的分布

解:,

,,,的取值都是与由于4321Y X 第三章随机变量及其分布{}{}{}

第三章随机变量及其分布

§4 多维随机变量函数的分布

第三章随机变量及其分布

第三章随机变量及其分布

§4 多维随机变量函数的分布

第三章随机变量及其分布

§4 多维随机变量函数的分布由于X , Y 的对称性可得

第三章随机变量及其分布

第三章随机变量及其分布

§4 多维随机变量函数的分布例3

第三章随机变量及其分布§4 多维随机变量函数的分布

第三章随机变量及其分布

+∞

§4 多维随机变量函数的分布第三章随机变量及其分布§4 多维随机变量函数的分布

例4第三章随机变量及其分布

§4 多维随机变量函数的分布

第三章随机变量及其分布

+∞§4 多维随机变量函数的分布

第三章随机变量及其分布§4 多维随机变量函数的分布

例4(续)

例5

第三章

随机变量及其分布

§4 多维随机变量函数的分布

第三章随机变量及其分布

§4多维随机变量函数的分布

()+∞−−

−x z x 221第三章随机变量及其分布

第三章随机变量及其分布

推广至n 个随机变量的取大和取小

第三章随机变量及其分布

第三章随机变量及其分布

§5 多维随机变量函数的分布

第三章随机变量及其分布

例7:教材10例8

第三章随机变量及其分布

第三章随机变量及其分布

§5 多维随机变量函数的分布例8(续)第三章随机变量及其分布

§5 多维随机变量函数的分布

第三章随机变量及其分布第三章随机变量及其分布

第三章随机变量及其分布§5 多维随机变量函数的分布例1(续)

第三章随机变量及其分布

§5 多维随机变量函数的分布例1(续)。