人工智能导论 第四章不确定性推理

不确定性推理方法(导论)

(1)在每一步推理中,如何把证据及知识的不确定性 传递给结论。

(2)在多步推理中,如何把初始证据的不确定性传递 给最终结论。

5. 结论不确定性的合成

9

第4章 不确定性推理方法

4.1 不确定性推理的基本概念 4.2 可信度方法 4.3 证据理论 4.4 模糊推理方法

10

则 CF (E)=min{CF (E1), CF (E2 ),..., CF (En )} ▪ 组合证据:多个单一证据的析取

E=E1 OR E2 OR … OR En 则 CF (E)=max{ CF (E1), CF (E2 ), ,CF (En )}

17

4.2 可信度方法

4. 不确定性的传递算法

下面首先讨论不确定性推理中的基本问题,然后着 重介绍基于概率论的有关理论发展起来的不确定性 推理方法,主要介绍可信度方法、证据理论,最后 介绍目前在专家系统、信息处理、自动控制等领域 广泛应用的依据模糊理论发展起来的模糊推理方法。

2

第4章 不确定性推理方法

4.1 不确定性推理的基本概念 4.2 可信度方法 4.3 证据理论 4.4 模糊推理方法

Introduction of Artificial Intelligence

第 4 章 不确定性推理方法

教材:

王万良《人工智能导论》(第4版) 高等教育出版社,2017. 7

第4章 不确定性推理方法

现实世界中由于客观上存在的随机性、模糊性,反 映到知识以及由观察所得到的证据上来,就分别形 成了不确定性的知识及不确定性的证据。因而还必 须对不确定性知识的表示及推理进行研究。这就是 本章将要讨论的不确定性推理。

7

4.1 不确定性推理中的基本问题

人工智能2018第四章2-不确定性推理(概率与可信度)

MD(H

,E)

min{P(H

|E),P(H P(H )

)}P(H

),否则

当P(H|E)>P(H)时:表示证据E支持结论H MB(H,E)>0,MD(H,E)=0 。

当P(H|E)<P(H)时,表示E不支持H MD(H,E)>0, MB(H,E) =0。 当p(H/E)=p(H)时,表示E对H无影响,则有MB=MD=0

H (CF(H,E))

(1)前提E可以是命题的合取和析取组合

(2)结论H可为单一命题,也可以是复合命题

(3)CF(H, E)为确定性因子(Certainty factor),简称 可信度,用以量度规则的确定性(可信)程度。取 值于[-1,1],表示E为真时,对H的支持程度。 CF(H, E)值越大,E就越支持H为真。

9

逆概率法

若A1,A2,…,An构成一个完备事件组且都有正概率,对于事件B, 则有以下贝叶斯概率

P( Ai | B)

P( Ai ) P(B | Ai )

n

, i 1, 2,..., n

P(Aj ) P(B | Aj )

j1

其中,P(Ai)是事件Ai的先验概率;P(B|Ai)是在事件Ai发生条件 下事件B的条件概率。

CF1(H)CF2(H)CF1(H)CF2(H) ,CF1(H)0,CF2(H)0

CF12(H)CF1(H)CF2(H)CF1(H)CF2(H) ,CF1(H)0,CF2(H)0

1

CF1(H ) CF2(H ) min{|CF1(H )|,|CF2(H

CF(H,E)近似表示P(H|E)的大小,从而描述了规 则的可信度。

不确定性推理方法

P( H i

︳ E

1

E2 Em ) =

P ( E1 ︳ H i ) P( E 2 ︳ H i ) P( E m ︳ H i ) P( H i )

∑ P( E1 ︳H j ) P( E 2 ︳H j ) P( Em ︳H j ) P( H j )

1 j=

n

i 1,2,, n

普通关系:两个集合中的元素之间是否有关联,

4.4.4 模糊关系与模糊关系的合成

1.模糊关系

模糊关系的定义 : A、B:模糊集合,模糊关系用叉积表示:

R : A B 0,1

叉积常用最小算子运算:

AB (a, b) min A (a), B (b)

A、B:离散模糊集,其隶属函数分别为:

身高与体重的模糊关系表

从X到Y的一个模糊关系R, 用模糊矩阵表示:

1 0.8 R 0.2 0.1 0 0.8 1 0.8 0.2 0.1 0.2 0.8 1 0.8 0.2 0.1 0 0.2 0.1 0.8 0.2 1 0.8 0.8 1

22

25

4.4.4 模糊关系与模糊关系的合成

2.模糊关系的合成

例8 设模糊集合 X {x1, x2 x3 , x4}, Y { y1 , y2 , y3}, Z {z1, z2}

Q X Y , R Y Z , S X Z , 求S。

0.5 0.7 Q 0 1 0.6 0.3 0.4 1 0.8 0 0.2 0.9

7

教学内容设计

可信度方法

1975 年肖特里菲等人在确定性理论的基础上, 结合概率论等提出的一种不确定性推理方法。 优点:直观、简单,且效果好。

人工智能教程习题及答案第4章习题参考解答

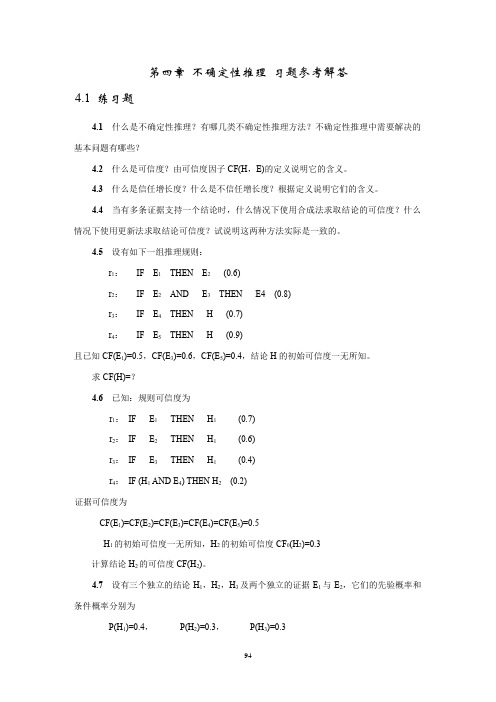

第四章不确定性推理习题参考解答4.1 练习题4.1什么是不确定性推理?有哪几类不确定性推理方法?不确定性推理中需要解决的基本问题有哪些?4.2什么是可信度?由可信度因子CF(H,E)的定义说明它的含义。

4.3什么是信任增长度?什么是不信任增长度?根据定义说明它们的含义。

4.4当有多条证据支持一个结论时,什么情况下使用合成法求取结论的可信度?什么情况下使用更新法求取结论可信度?试说明这两种方法实际是一致的。

4.5设有如下一组推理规则:r1:IF E1THEN E2(0.6)r2:IF E2AND E3THEN E4 (0.8)r3:IF E4THEN H (0.7)r4:IF E5THEN H (0.9)且已知CF(E1)=0.5,CF(E3)=0.6,CF(E5)=0.4,结论H的初始可信度一无所知。

求CF(H)=?4.6已知:规则可信度为r1:IF E1THEN H1(0.7)r2:IF E2THEN H1(0.6)r3:IF E3THEN H1(0.4)r4:IF (H1 AND E4) THEN H2(0.2)证据可信度为CF(E1)=CF(E2)=CF(E3)=CF(E4)=CF(E5)=0.5H1的初始可信度一无所知,H2的初始可信度CF0(H2)=0.3计算结论H2的可信度CF(H2)。

4.7设有三个独立的结论H1,H2,H3及两个独立的证据E1与E2,它们的先验概率和条件概率分别为P(H1)=0.4,P(H2)=0.3,P(H3)=0.3P(E1/H1)=0.5,P(E1/H2)=0.6,P(E1/H3)=0.3P(E2/H1)=0.7,P(E2/H2)=0.9,P(E2/H3)=0.1利用基本Bayes方法分别求出:(1)当只有证据E1出现时,P(H1/E1),P(H2/E1),P(H3/E1)的值各为多少?这说明了什么?(2)当E1和E2同时出现时,P(H1/E1E2),P(H2/E1E2),P(H3/E1E2)的值各是多少?这说明了什么?4.8在主观Bayes方法中,请说明LS与LN的意义。

人工智能导论 第2版 第4章 不确定性推理

✓当P(E|S)=0时,证据肯定不存在。

✓当P(E|S)=P(E)时,证据E与观察S无关。由全概率公式得:

P(H|S)=P(H|E)×P(E)+P(H|¬E)×P(¬E)=P(H)

✓当P(E|S)为其它值时,通过

计算P(H|S)

P(H/S) P(H/E)

P(H)

P(H/¬E)

0

P(E)

1 P(E/S)

23

逆概率法的特点

逆概率法在实际中有很多应用。

✓ 比如:把Hi (i=1,2,…,n)当作可能发生的疾病;把Ej ( j=1,2,…,n)当 作相应的症状;P(Hi)是从大量实践中得到的疾病Hi的先验概率; P(Ej|Hi)是疾病Hi发生时观察到症状Ej的条件概率。

➢逆概率法有较强的理论背景和良好的数学特性,当证据及 结论都彼此独立时计算的复杂度比较低。

1 2 n (H) (H)

(H )

36

主观Bayes方法推理示例(1)

☆例. 设有如下知识:

已知:Θ(H1)=0.1, Θ(H2)=0.01, C(E1|S1)=2, C(E2|S2)=1 求: Θ(H2|S1S2)=?

P(H1)=Θ(H1)/(1+Θ(H1))=0.09 P(H1|E1)=Θ(H1|E1)/(1+Θ(H1|E1))= LS1×Θ(H1)/(1+LS1×Θ(H1))=0.17 ∵C(E1|S1)=2>0 ∴P(H1|S1)=P(H1)+[P(H1|E1)-P(H1)]×1/5×C(E1|S1)

6

2. 不确定性推理的基本问题

• 设计一个不确定性匹配算法; • 指定一个匹配阈值。 • 在匹配时,一个简单条件对应于一个单一的证据,

人工智能导论 第4章 不确定性推理方法(导论) 1-41

CF1(H ) =CF(H , E1)× max{0,CF(E1)} CF2(H ) =CF (H , E2 )× max{0,CF (E2 )}

19

4.2 可信度方法

5. 结论不确定性的合成算法

(2)求出E1与E2对H的综合影响所形成的可信度 CF1,2(H ):

教材:

王万良《人工智能导论》(第4版) 高等教育出版社,2017. 7

第4章 不确定性推理方法

现实世界中由于客观上存在的随机性、模糊性,反 映到知识以及由观察所得到的证据上来,就分别 形 成了不确定性的知识及不确定性的证据。因而 还必 须对不确定性知识的表示及推理进行研究。 这就是 本章将要讨论的不确定性推理。

3

第4章 不确定性推理方法

✓4.1 不确定性推理中的基本问题

4.2 可信度方法 4.3 证据理论 4.4 模糊推理方法

4

4.1 不确定性推理中的基本问题

推理:从已知事实(证据)出发,通过运用相 关 知识逐步推出结论或者证明某个假设成立或 不成 立的思维过程。

不确定性推理:从不确定性的初始证据出发, 通 过运用不确定性的知识,最终推出具有一定 程度 的不确定性但却是合理或者近乎合理的结 论的思 维过程。

r1 : CF1(H ) 0.8 max{0,CF(E1 )}

0.8 max{0,0.35} 0.28

23

4.2 可信度方法

解: 第一步:对每一条规则求出CF(H)。

r2 : CF2 (H ) 0.6 max{0,CF(E2 )}

0.6 max{0,0.8} 0.48

r3 : CF3(H ) 0.5 max{0,CF(E3 )}

4. 不确定性的传递算法

人工智能4不确定性推理

模糊集上的运算主要有:包含、交、并、补等等。

1. 包含运算

定义4.5 设A,B∈F(U),若对任意u∈U,都有

μB(u)≤μA(u) 成立,则称A包含B,记为B A。 2. 交、并、补运算

定义4.6 设A,B∈F(U),以下为扎德算子

A

B : A

B (u)

max{ uU

A

(u

),

B

(u)}

A (u) B (u)

3

模糊集的表示方法(1)

若论域离散且有限,则模糊集A可表示为:

也可写为:

A={μA(u1),μA(u2),…,μA(un)}

或者:

A=μA(u1)/u1+μA(u2)/u2+…+μA(un)/un

n

n

A (u ) / u , 或者A (u ) / u

Ai

i

Ai

i

i 1

i 1

A={μA(u1)/u1,μA(u2)/u2,…,μA(un)/un} A={(μA(u1),u1),(μA(u2),u2),…,(μA(un),un)} 隶属度为0的元素可以不写。

(A, B) 1 [1 (1 0.2)] 0.9 2

即A和B两个模糊集之间的匹配度为0.9。

21

语义距离

如果论域U上两个模糊集A和B的语义距离为d(A,B),则其匹配度为 1-d(A,B)。

曼哈顿距离(Manhattan Distance)或者海明距离(Hamming

Distance)

d (A, B)

A

•

B

{

U

A

(ui

)

B

(ui

)}

A⊙

B

{

《人工智能导论-》- 04 推理-0...(1)

P(X, Y) = P(X)P(Y|X) 又如: P(X, Y, Z) = P(X)P(Y)P(Z|X, Y)

Z Y P(Y)

CPT表为: P(S) = 0.4 P(C) = 0.3 P(E|S,C) = 0.9 P(E|S,~C) = 0.3 P(E|~S,C) = 0.5 P(E|~S,~C) = 0.1 。

i

,

P( Bk | A)

P( Bk ) P( A | Bk ) P( Bi ) P( A | Bi )

i

贝叶斯公式容易由条件概率的定义,乘法公式和全概率公式得到。 在贝叶斯公式中,P(Bi), i=1, 2, …, n称为先验概率,而P(Bi|A) i=1, 2, …, n称为后验概率也是条件概率。

贝叶斯网络(基本概念)

一系列变量的联合概率分布的图形表示。 一个表示变量之间的相互依赖关系的数据结构;图论 与概率论的结合。

贝叶斯网络(因果关系网络)

假设:

命题S(smoker):该患者是一个吸烟者 命题C(coal Miner):该患者是一个煤矿矿井工人 命题L(lung Cancer):他患了肺癌 命题E(emphysema):他患了肺气肿

P( AB) P( B | A) P( A)

为事件A已发生的条件下,事件B的条件概率,P(A) 在概率推理中称为边缘概率。 简称P(B|A)为给定A时B发生的概率。P(AB)称为A与B 的联合概率。有联合概率公式:

P( AB) P( B | A) P( A)

P( | A) 1

P( | A) 0

( A ) 1 ,且对于一事件B有

n n

P( B) P( An B)

n

• 有若{An, n=1, 2, …}为一基本事件族,则

人工智能4 不确定性推理 人工智能课程 中国海洋大学

对于初始证据,其值由用户给出; 对推理所得证据,其值由推理中不确定性的传递算法通过计算得到。

3

• 不确定性的量度 对于不同的知识和不同的证据,其不确定性的程度一般是不相同的,需 要用不同的数据表示其不确定性的程度,同时还要事先规定它的取值范围。 例如,在专家系统 MYCIN 中,用可信度表示知识与证据的不确定性,取值 范围为 [-1, 1]。 在确定一种量度及其范围时,应注意以下几点: 1) 量度能充分表达相应知识及证据不确定性的程度。

1. 为什么要研究不确定性推理问题

• 现实世界的问题求解大部分是不良结构;

• 对不良结构的知识描述具有不确定性: 1) 问题证据的不确定性; 2) 专门知识的不确定性。

2. 什么是不确定性推理

不确定性推理是建立在非经典逻辑基础上的一种推理,它是对 不确定性知识的运用和处理。 不确定性推理就是从不确定性的初始证据出发,通过运用不确

定性的知识,最终推出具有一定程度的不确定性但却合理或者近 乎合理的结论的思维过程。

1

3. 不确定性推理中的基本问题

在不确定性推理中,知识和证据都具有某种程度的不确定性,

这就为推理机的设计与实现增加了复杂性和难度。它除了必须解

决推理方向、推理方法、控制策略等基本问题外,一般还需要解 决不确定性的表示和量度、不确定性匹配、不确定性的传递算法 以及不确定性的合成等重要问题。

16

(3) 有多个证据时

对于有多个证据E1, E2, …, Em和多个结论H1, …, H2, Hn,并且每个证据都以 一定的程度支持结论的情况,上面的式子可进一步扩充为: P(Hi/E1 E2…Em)=

P(E1/Hi ) P(E2 /Hi ) ...P(Em /Hi ) P(Hi )

人工智能导论 第4章 不确定性推理方法(导论)42-76

64

4.4.4 模糊关系与模糊关系的合成

2. 模糊关系的合成

▪ 解:

0.5 0.6 0.3

S

Qo

R

0.7 0

1

0.4 0.8 0.2

1 0

o

0.2 0.8

0.9 0.5

1 0.4 0.3

(0.50.2)(0.6 0.8)(0.30.5)

(0.70.2)(0.4 0.8) (10.5)

AB

ABLeabharlann AB584.4.3 模糊集合的运算

▪ 例4.5 设论域U x1, x2 , x3 , x4 , x5 ,A 及 B 是论域上 的两个模糊集合,已知:

A 0.2 x1 0.4 x 2 0.9 x 3 0.5 x5 B 0.1 x1 0.7 x 3 1.0 x 4 0.3 x5

66

4.4.5 模糊推理

2. 对 IF A THEN B 类型的模糊规则的推理

▪若已知输入为 A,则输出为 B ;若现在已知输入为 A',

则输出 B ' 用合成规则求取 B ' A 'oR

其中模糊关系R: R ( x, y) min[ A ( x), B ( y)]

▪ 控制规则库的N 条规则有N 个模糊关系: R1 , R 2 ,

B B (b1), B (b2

61

4.4.4 模糊关系与模糊关系的合成

1. 模糊关系

▪ 例4.7 已知输入的模糊集合A和输出的模糊集合B:

A 1.0 / a1 0.8 / a2 0.5 / a3 0.2 / a4 0.0 / a5

B 0.7 / b1 1.0 / b2 0.6 / b3 0.0 /b4 ▪ 求A到B的模糊关系R。

人工智能第四章 不确定性推理ppt课件

1]上某个值的函数,即

A:U [0,1]

则称μA为定义在U上的一个隶属函数。由 μA(u)(u∈U)所构成的集合A ={μA(u), u∈U}称为U 上的一个模糊集,μA(u)称为u对A的隶属度, μA 称为模糊集A的隶属函数。

若论域离散且有限,则模糊集A可表示为:

也可写为:

A={μA(u1),μA(u2),…,μA(un)}

A=μA(u1)/u1+μA(u2)/u2+…+μA(un)/un

或者:

n

n

U A (u)/u,或 者 A (u)/u

AiiAii Nhomakorabeai1

i1

A={μA(u1)/u1,μA(u2)/u2,…,μA(un)/un}

• 无论论域U有限还是无限,离散还是连续,

扎德用如下记号作为模糊集A的一般表示

形式:

A A(u)/u

uU

• U上的全体模糊集记为:

F(U)={A|μA:U→[0,1]}

或

F(U)={μA|μA:U→[0,1]}

• 4.17 设某小组有5个同学,分别为S1,S2,S3,S4,S5。 若对每个同学的“学习好”程度打分:

A={(μA(u1),u1),(μA(u2),u2),…,(μA(un),un)} 隶属度为0的元素可以不写。

例如,在论域U={0,1,2,3,4,5,6,7,8,9}上,以下形式都可以用 来表示模糊集“大”:

大={0, 0.2, 0.3, 0.4, 0.5, 0.6, 0.7, 0.8, 0.9, 1} 大=0/0+0.2/1+0.3/2+0.4/3+0.5/4+0.6/5+0.7/6+0.8/7+0.9/8+1/9 大={0/0, 0.2/1, 0.3/2, 0.4/3, 0.5/4, 0.6/5, 0.7/6, 0.8/7, 0.9/8, 1/9} 大={0.2/1, 0.3/2, 0.4/3, 0.5/4, 0.6/5, 0.7/6, 0.8/7, 0.9/8, 1/9}

人工智能导论-第四章02-59

2021/7/28

人工智能导论 - 刘珊

9

条件独立

4.6 贝叶斯网络

U1 …

Z1j

X

2021/7/28

Y1 …

Um

Znj

Yn

人工智能导论 - 刘珊

【说明】:

给定节点X的 父节点U1... Um,节点X与 它的非后代节 点(即Zij)是 条件独立的。

10

条件独立

4.6 贝叶斯网络

U1

Z1j

X

Y1

2021/7/28

• 由于节点D和I无父 节点,故它们的条 件概率表由其先验 概率来填充

4.6 贝叶斯网络

D

碰见 难题

P(D) 0.15

I

遇到 P(I) 干扰 0.05

D I P(A)

A 产生焦虑

T T 0.8 T F 0.4

F T 0.5

C 思维

F F 0.1 E

情绪

迟缓 A P(C) 波动 A P(E)

T 0.8

贝叶斯网络近似推理

4.6 贝叶斯网络

• 马尔可夫链蒙特卡罗(MCMC)算法是目 前使用较广的一类贝叶斯网络推理方法。

• 它通过对前一个事件状态作随机改变来生 成下一个问题状态,通过对某个隐变量进 行随机采样来实现对随机变量的改变。

• MCMC方法可视为:在状态空间中的随机 走动,但是证据变量的值固定不变。

– 近似推理:在不影响推理正确性的前提下,通过 适当降低推理精确度来提高推理效率的一类方法。

2021/7/28

人工智能导论 - 刘珊

15

贝叶斯网络精确推理

4.6 贝叶斯网络

• 主要方法

– 基于枚举的算法 – 基于变量消元的算法 – 基于团树传播的算法等

人工智能第四章不确定性推理

– 如制导回溯、启发式搜索等等

2016-1-22

史忠植 人工智能:不确定性推理

5

内容提要

4.1 概述 4.2 可信度方法 4.3 主观贝叶斯方法 4.4 证据理论 4.5 模糊逻辑和模糊推理 4.6 小结

2016-1-22

史忠植 人工智能:不确定性推理

6

知识的不确定性表示

• 产生式规则:

If E Then H (CF(H, E))

MB(H,E)= m-a--x-{-P--(-H--1-|-E-P-)-(,-H-P-)-(-H--)-}--–---P--(-H--)--- 否则

• MD的定义:

1

若P(H)=0

MD(H,E)= m-i-n---{-P--(-H---P|-E-(-)H-,-)P--(-H--)-}--–---P--(-H--)--- 否则

信度CF(H)

2016-1-22

史忠植 人工智能:不确定性推理

15

结论不确定性合成算法

• r1: if E1 then H (CF(H,E1))

r2: if E2 then H (CF(H,E2)) 求合成的CF(H)

(ห้องสมุดไป่ตู้)首先对每条知识求出CF(H),即:

CF1(H)=CF(H,E1) max{0, CF(E1)} CF2(H)=CF(H,E2) max{0, CF(E2)}

• 已知C(A), AB f(B,A),如何计算C(B)

• 已知C1(A),又得到C2(A),如何确定C(A)

• 如何由C(A1),C(A2)计算C(A1A2), C(A1A2)

–语义问题: 指的是上述表示和计算的含义是

什么,如何进行解释.

2016-1-22

人工智能原理及应用第4章 不确定性推理方法

4.2 概率推理

4.2.1 概率的基本性质和计算公式

4.2.1.2 事件间的关系 两个事件A与B可能有以下几种特殊关系: 并事件:对两个事件A与B,如果事件表达的是“事件A与事件B至 少有一个发生”,则称该事件为A与B的并事件,记为AUB。可见, 并事件是由A与B的所有样本点共同构成的事件。 交事件:如果事件表达的是“事件A与事件B同时发生”,则称该 事件为A与B的交事件,记为A∩B。可见,交事件是由既属于A又属 于B的所有样本点构成的事件。 互斥关系:若A与 B不能同时发生,则称A与B互斥,记作AB= Ø 对立关系:若A与B互斥,且必有一个发生,则称A与B对立,又称 A为B的余事件,或B为A的余事件。

并:记C=“A与B中至少有一个发生”,称为事件A与B的并,记

作 C { ห้องสมุดไป่ตู้ A 或 B} 。

差:记C=“A发生而B不发生”,称为事件A与B的差。

求余: ~ A \ A

4.2 概率推理

4.2.1 概率的基本性质和计算公式

4.1.2.3 事件的概率 定义4.5 设Ω为一个随机实验的样本空间,对Ω上的任意事件A,规定 一个实数与之对应且满足以下三条基本性质,记为P(A),称为事件A 发生的概率:

知识

图4-1 不确定性推理

4.1 不确定推理概述

4.1.1 不确定推理的概念

采用不确定性推理是客观问题的需求,其原因包括以下几个方面: (1)所需知识不完备,不精确 (2)所需知识描述模糊 (3)多种原因导致同一结论 (4)解决方案不唯一

4.1 不确定推理概述

4.1.2不确定性推理的基本问题和方法分类

机缘控制

启发式搜索

图4-2 不确定性推理分类

概率方法 主观Bayes方法 可信度方法 证据理论

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

由Bayes公式得:

P(H|E)=P(E|H)×P(H)/P(E)

(1)

P(¬H|E)=P(E|¬H)×P(¬H)/P(E)

(2)

(1)式除以(2)式得:

P(H|E)/P(¬H|E)=P(E|H)/P(E|¬H)×P(H)/P(¬H)

由LS和几率函数的定义得: Θ(H|E)=LS×Θ(H)

即

29

P(H|E)=LS×P(H)/[(LS-1)×P(H)+1]

对于事件A,m=2,所以P(A) = m/n = 2/7 对于事件B,m=3,所以P(B) = m/n = 3/7

11

• 统计概率

当试验次数足够多时,一个事件(A)发生的次数m 与试验的总次数n之比:

fn(A)=m/n 在一个常数p(0≤p≤1)附近摆动,并稳定于p。

• 定义4.2 在同一组条件下所作的大量重复试验中,

n

P(Em | Hi )

P(H j ) P(E1 | H j ) P(E2 | H j ) P(Em | H j )

j 1

, i 1, 2,..., n

21

例. 设H1,H2,H3分别是三个结论,E是支持这些结论的证据。 已知:

P(H1)=0.3,

P(H2)=0.4,

P(H3)=0.5

递给最终结论。 (5) 结论不确定性的合成

用不同知识进行推理得到了相同结论,但不确 定性的程度却不同。此时,需要用合适的算法 对它们进行合成。

7

• 关于不确定性推理方法的研究沿着两条不同的路 线发展。

• 一、模型法:

– 在推理一级上扩展确定性推理。其特点是把不确定的 证据和不确定的知识分别与某种度量标准对应起来, 并且给出更新结论不确定的算法。这类方法与控制策 略一般无关,即无论用何种控制策略,推理的结果都 是唯一的。模型方法分为:

P(H

)

P(E) LS,LN

P(H

|

E)或者P(H

|E)

• 确定后验概率的方法随着证据肯定存在, 肯定不存在,或者不确定而有所不同。

28

引入几率函数Θ(x),它与概率的关系为:

Θ(x)=P(x)/(1-P(x)), P(x)=Θ(x)/(1+Θ(x))

在证据肯定存在时,P(E)=P(E|S)=1。

5

• 常用的组合证据不确定性计算方法有:

– 最大最小法:

T(E1 AND E2)=min{T(E1),T(E2)} T(E1 OR E2)=max{T(E1),T(E2)}

– 概率法:

T(E1 AND E2)=T(E1)×T(E2) T(E1 OR E2)=T(E1)+T(E2)-T(E1)×T(E2)

• 例如:相关性制导回溯、启发式搜索等等。

• 1. 概率论基础

• 随机现象

• 样本空间:

一个可能的实验结果为一个样本点,样本点的全体构成的 集合称为样本空间。

• 随机事件:ห้องสมุดไป่ตู้

要考察的由一些样本点构成的集合称为随机事件。

• 事件发生了:出现了样本点集合中的一个元素。

• 必然事件:样本点全体构成的集合(即样本空间)所表示 的事件。

事数件p附A近出摆现动的,频并率且fn(稳A)定总于是p在,[0则,1称]上p的为一事个件确A的定概常

率。即

P( A)

lim

n

fn (A)

12

• 0≤P(A)≤1 • P(D)=1,P(Φ)=0 • 设事件A1,A2,…,Ak(k≤n)是两两互不相容的

事件,即有Ai∩Aj=Φ(i≠j),则 k P( Ai ) P( A1) P( A2 ) P( Ak ) i1

的不确定性度量不能超出度量规定的范围。 – 度量的确定应当是直观的,同时应有相应的理论依据。 4

(2) 不确定性匹配算法

– 设计一个不确定性匹配算法; – 指定一个匹配阈值。

(3) 组合证据不确定性的算法

– 在匹配时,一个简单条件对应于一个单一的证 据,一个复合条件对应于一组证据,称这一组 证据为组合证据。

2

• 引起知识不确定性的原因有: 1) 随机性:我有八成的把握打中目标。 2) 模糊性:高个子适合于打篮球。 3) 不完全性:这种药可能会治疗SARS。 4) 经验性:土干了就给花浇水。

3

(1) 不确定性的表示 • 不确定性推理中的“不确定性”一般分为两类:一是知

识的不确定性,一是证据的不确定性。

• 不可能事件:Φ

• 基本事件:单点集合

• 事件的关系

包含、并、交、差、逆

10

• 古典概型 定义4.1 设E为古典概型,样本空间共有n个基本

事件,事件A中含有m个基本事件,则称 P(A) = m/n

为事件A的概率。 例如:D={1,2,3,4,5,6,7},A={取数字3的倍

数},B={取偶数}。 解:基本事件有7个,n=7。

• P(¬A)=1-P(A) • P(A∪B)=P(A)+P(B)-P(AB) • 如果 A B ,则P(A-B)=P(A)-P(B)

13

• 如果在事件B发生的条件下考虑事件A发生的概率, 就称它为事件A的条件概率,记为P(A|B)。

• 定义4.3 设A,B是两个事件,P(B)>0,则称

P(A | B) P(A B) P(B)

为在事件B已发生的条件下事件A的条件概率。 • 条件概率中的条件缩小了样本空间,即条件概率

是在条件所确定的新空间中求A∩B的概率。

14

例. D={1,2,3,4,5,6,7},A={取数字3的倍数},B={取偶数}。 求解在事件B发生的条件下,事件A发生的条件概率。

解:事件B是已经发生的事件,即 取到2;取到4;取到6

当已知条件概率P(H|E1,E2,…,En)时,就可把它作为在证 据E1,E2,…,En出现时结论H的确定性程度。

18

• 经典概率方法要求给出条件概率P(H|E),在实 际中比较困难。

– 例如E代表咳嗽,H代表支气管炎,则P(H|E)表示在 咳嗽的人群中患支气管炎的概率。这个比较困难。 而逆概率P(E|H)表示在得支气管炎的人群中咳嗽的 概率。这个相对容易获得。

E=E1 OR E2 OR … OR En 则:P(E|S)=max{P(E1|S),P(E2|S),…,P(En|S)} 对于“¬”运算则:

P(¬E|S)=1-P(E|S)

27

• 主观Bayes方法推理的任务就是根据证据 E的概率P(E)及LS、LN的值,把H的先验 概率P(H)更新为后验概率P(H|E)或 P(H|¬E)。即

在证据肯定不存在时,P(E)=P(E|S)=0, P(¬E)=1。

由Bayes公式得:

P(H|¬E)=P(¬E|H)×P(H)/P(¬E)

– 数值方法

• 按其所依据的理论又可分为:基于概率的方 法和基于模糊理论的模糊推理。

– 非数值方法

8

二、 控制法:

– 在控制策略一级处理不确定性。其特点是通过识别领 域中引起不确定性的某些特征及相应的控制策略来限 制或者减少不确定性对系统产生的影响。这类方法没 有处理不确定性的统一模型,其效果极大地依赖于控 制策略。

第四章 不确定性推理

• 4.1 概述 • 4.2 基本概率方法 • 4.3 主观Bayes方法 • 4.4 可信度方法

1. 什么是不确定性推理

• 不确定性推理是建立在非经典逻辑基础 上的一种推理,它是对不确定性知识的 运用与处理。

• 所谓不确定性推理就是从不确定性的初 始证据出发,通过运用不确定性的知识, 最终推出具有一定程度的不确定性但却 是合理或者近乎合理的结论的思维过程。

0.32

同理可得: P(H2|E)=0.26, P(H3|E)=0.43

22

• 逆概率法在实际中有很多应用。 • 比如:

– 把Hi (i=1,2,…,n)当作可能发生的疾病; – 把Ej (j=1,2,…,n)当作相应的症状; – P(Hi)是从大量实践中得到的疾病Hi的先验概率; – P(Ej|Hi)是疾病Hi发生时观察到症状Ej的条件概率。 – 则当对某病人观察到有症状E1,E2,…,Em时,应用上述

• 我们根据Bayes定理可以从P(E|H)推出P(H|E)。

19

若A1,A2,…,An是彼此独立的事件,

P( Ai | B)

P( Ai ) P(B | Ai )

n

, i 1, 2,..., n

P(Aj ) P(B | Aj )

j 1

其中,P(Ai)是事件Ai的先验概率;P(B|Ai)是在事件Ai发生条 件下事件B的条件概率。

– 有界法:

T(E1 AND E2)=max{0,T(E1)+T(E2)-1} T(E1 OR E2)=min{1,T(E1)+T(E2)} 其中,T(E)表示证据E为真的程度,如可信度、概率等。

6

(4) 不确定性的传递算法 • 在每一步推理中,如何把证据及知识的不确定

性传递给结论。 • 在多步推理中,如何把初始证据的不确定性传

P(E|

S

)

5 P(E)(5C(E|S))

5

,0C(E|S)5 ,5C(E|S)0

26

• 可以采用最大最小法。 当组合证据是多个单一证据的合取时,即

E=E1 AND E2 AND … AND En 则:P(E|S)=min{P(E1|S),P(E2|S),…,P(En|S)} 当组合证据是多个单一证据的析取时,即

P(E|H1)=0.5, P(E|H2)=0.3, P(E|H3)=0.4

求P(H1|E),P(H2|E)及P(H3|E)的值各是多少?

解:

P(H |E)

P(H )P(E|H )

1

1

1 P(H )P(E|H ) P(H )P(E|H )P(H )P(E|H )