使用OpenGL与fmod实现音乐可视化效果

openmv 循迹黑线思路

openmv 循迹黑线思路摘要:1.介绍OpenMV微控制器及其特点2.详述循迹黑线思路的基本原理3.分析OpenMV在循迹黑线项目中的应用优势4.指导如何利用OpenMV实现循迹功能5.总结项目成果及潜在拓展方向正文:随着科技的不断发展,各类嵌入式系统应运而生,其中OpenMV微控制器因其高度可编程性和较低的成本,受到了广大工程师和创客的喜爱。

本文将介绍如何利用OpenMV实现循迹黑线功能,并探讨其在相关领域中的应用优势。

一、OpenMV微控制器简介OpenMV是一种基于ARM Cortex-M4内核的微控制器,具备较高的性能和丰富的外设。

它具有以下特点:1.强大的处理能力:OpenMV采用16位RISC-V指令集,运行频率最高可达72MHz。

2.丰富的外设:内置12位ADC、DAC、UART、SPI、I2C等通信接口,方便与其他设备连接。

3.低功耗:采用3.3V电源,待机功耗低于1uA。

4.开源:OpenMV提供完整的开发环境、硬件参考设计和固件,便于用户进行二次开发。

二、循迹黑线思路循迹黑线项目是基于OpenMV微控制器的一种应用,其主要原理是通过检测黑线边缘的光电信号变化,控制OpenMV输出相应的PWM信号,实现循迹功能。

具体步骤如下:1.光电传感器检测黑线边缘:利用光电传感器(如GP2Y0D8147)检测黑线边缘的光电信号。

2.信号处理:将检测到的模拟信号经过OpenMV内部的ADC转换为数字信号,并进行滤波、阈值处理,得到循迹信号。

3.控制PWM信号输出:根据循迹信号,通过OpenMV的PWM功能输出相应的PWM信号,控制电机转速。

4.电机驱动:通过驱动电路(如L298N)驱动直流电机,实现循迹运动。

三、OpenMV在循迹黑线项目中的应用优势1.高度可编程性:OpenMV支持C语言编程,用户可以根据实际需求编写相应的程序,实现更为灵活的控制。

2.低成本:相较于其他微控制器,OpenMV具有较低的成本,有利于项目的普及和推广。

基于MFC与OpenGL的可视化机械仿真设计系统

基于MFC与OpenGL的可视化机械仿真设计系统程飞【期刊名称】《五邑大学学报(自然科学版)》【年(卷),期】2014(000)003【摘要】The general visual mechanical design system is more demandingof hardware and the motion simulation generally does not respond to quantitative data input. In light of this, this paper researches on a mechanical design system that is not much demanding of hardware and can respond in real time to quantitative data input in motion simulations. The system is based on the Microsoft foundation Class Library (MFC) and the open Graphics Library (OpenGL) and computer software development. Development examples show: compared to large CAD software programs, the system is of a faster drawing function, and it is capable of calculating and visualizing component data under different conditions of precision. It can achieve rapid design and development of mechanical parts. The paper also gives an example of visualized system development of disc cam mechanisms.%通用可视化机械设计系统对硬件要求高,其仿真运动模拟一般不响应定量数据输入。

OPENGL 高级专题之音频课件

第一个参数为文件的路径.

第二个参数为音频的播放方式,通常为 FSOUND_NORMAL(FSOUND_LOOP_NORMAL 为循环播放).

第三个参数很少使用,默认值为0

初始化音频系统

举例说明:在程序中: sound_1 = FSOUND_Sample_Load(FSOUND_FREE, "Data/1.wav", FSOUND_2D, 0);

FSOUND停止控制 (Stream)

FSOUND_Stream_Stop(handle);

FSOUND停止控制 (handle);

注意 :

要停止一个FSOUND_PlaySound()播放的音频文 件,且函数的第一个参数即文件的播放通道不是 FSOUND_FREE,则用上面函数来停止音频文件, 同时该函数必须是函数FSOUND_PlaySound()里 面所指定的channel。

释放占用资源

void Deinitialize(void) FreeFMOD(); } // 在此处做退出前扫尾工作

{

总结 (FMUSIC )

用FMUSIC播放需要一个handle:

handle = FMUSIC_LoadSong("YourFileName"); FMUSIC_PlaySong(handle);

FMUSIC播放控制

FMUSIC_PlaySong(handle);

FMUSIC音量控制

FMUSIC_SetMasterVolume(handle,256); 256是最高音,0表示静音

C#使用NAudio实现音频可视化的方法

C#使⽤NAudio实现⾳频可视化的⽅法预览:捕捉声卡输出:实现⾳频可视化, 第⼀步就是获得⾳频采样, 这⾥我们选择使⽤计算机正在播放的⾳频作为采样源进⾏处理: NAudio 中, 可以借助 WasapiLoopbackCapture 来进⾏捕捉:WasapiLoopbackCapture cap = new WasapiLoopbackCapture();cap.DataAvailable += (sender, e) => // 录制数据可⽤时触发此事件, 参数中包含⾳频数据{float[] allSamples = Enumerable // 提取数据中的采样.Range(0, e.BytesRecorded / 4) // 除以四是因为, 缓冲区内每 4 个字节构成⼀个浮点数, ⼀个浮点数是⼀个采样.Select(i => BitConverter.ToSingle(e.Buffer, i * 4)) // 转换为 float.ToArray(); // 转换为数组// 获取采样后, 在这⾥进⾏详细处理}cap.StartRecording(); // 开始录制分离左右通道:获取完采样后, 我们还需要对采样进⾏⼀点⼩处理, 因为捕获的数据是分通道的, ⼀般是左右声道:// 设定我们已经将刚刚的采样保存到了变量 AllSamples 中, 类型为 float[]int channelCount = cap.WaveFormat.Channels; // WasapiLoopbackCapture 的 WaveFormat 指定了当前声⾳的波形格式, 其中包含就通道数float[][] channelSamples = Enumerable.Range(0, channelCount).Select(channel => Enumerable.Range(0, AllSamples.Length / channelCount).Select(i => AllSamples[channel + i * channelCount]).ToArray()).ToArray();取通道平均值将采样分为⼀个个通道的采样后, 我们可以将其合并, 取平均值, 以便于绘制:// 设定我们已经将分开了的采样保存到了变量 ChannelSamples 中, 类型为 float[][]// 例如通道数为2, 那么左声道的采样为 ChannelSamples[0], 右声道为 ChannelSamples[1]float[] averageSamples = Enumerable.Range(0, AllSamples.Length / channelCount).Select(index => Enumerable.Range(0, channelCount).Select(channel => ChannelSamples[channel][index]).Average()).ToArray();绘制时域图象:处理刚刚的采样后, 你可以直接将其作为数据绘制到窗⼝中, 这即是时域图象, 这⾥使⽤最简单的折线绘制.// 设定 g 为窗⼝的 Graphics 对象, windowHeight 为窗⼝的显⽰区域⾼度// 设定通道采样平均值为 AverageSamples, 类型为 float[]Point[] points = AverageSamples.Select((v, i) => new Point(i, windowHeight - v)).ToArray(); // 将数据转换为⼀个个的坐标点g.DrawLines(Pens.Black, points); // 连接这些点, 画线傅⾥叶变换:NAudio 中还提供了快速傅⾥叶变换的⽅法, 通过傅⾥叶变换, 可以将时域数据转换为频域数据, 也就是我们所说的频谱// 我们将对 AverageSamples 进⾏傅⾥叶变换, 得到⼀个复数数组// 因为对于快速傅⾥叶变换算法, 需要数据长度为 2 的 n 次⽅, 这⾥进⾏float log = Math.Ceiling(Math.Log(AverageSamples.Length, 2)); // 取对数并向上取整int newLen = (int)Math.Pow(2, log); // 计算新长度float[] filledSamples = new float[newLen];Array.Copy(AverageSamples, filledSamples, AverageSamples.Length); // 拷贝到新数组Complex[] complexSrc = filledSamples.Select(v => new Complex(){ X = v }) // 将采样转换为复数.ToArray();FastFourierTransform(false, log, complexSrc); // 进⾏傅⾥叶变换// 变换之后, complexSrc 则已经被处理过, 其中存储了频域信息分析频域信息:对于傅⾥叶变换的频域信息, 需要稍加处理才可以⽅便的使⽤, ⾸先是提取有⽤的信息:// NAudio 的傅⾥叶变换结果中, 似乎不存在直流分量(这使我们的处理更加⽅便了), 但它也是有共轭什么的(也就是数据左右对称, 只有⼀半是有⽤的)// 仍然使⽤刚刚的 complexSrc 作为变换结果, 它的类型是 Complex[]Complex[] halfData = complexSrc.Take(complexSrc.Length / 2).ToArray(); // ⼀半的数据float[] dftData = halfData.Select(v => Math.Sqrt(v.X * v.X + v.Y * v.Y)) // 取复数的模.ToArray(); // 将复数结果转换为我们所需要的频率幅度// 其实, 到这⾥你完全可以把这些数据绘制到窗⼝上, 这已经算是频域图象了, 但是对于⾳乐可视化来讲, 某些频率的数据我们完全不需要// 例如 10000Hz 的频率, 我们完全没必要去绘制它, 取最⼩频率 ~ 2500Hz ⾜矣// 对于变换结果, 每两个数据之间所差的频率计算公式为采样率/采样数, 那么我们要取的个数也可以由 2500 / (采样率 / 采样数) 来得出int count = 2500 / (cap.WaveFormat.SampleRate / filledSamples.Length);float[] finalData = dftData.Take(count).ToArray();绘制频域图象:得到上⾯分析后的 finalData 后, 我们就可以直接绘制出来了, 这次使⽤柔和的曲线绘制// 设定 g 为窗⼝的 Graphics 对象, height 为窗⼝⾼度PointF[] points = finalData.Select((v, i) => new PointF(i, height - v)).ToArray();g.DrawCurve(Pens.Purple, points); // Graphics 可以直接绘制曲线更优的绘制:上⾯的时域和频域图象, 我们都是⼀股脑的将数据的索引作为 X 坐标, 窗⼝⾼度减去数据值作为 Y 坐标, 有两个突出的问题:数据可能⽆法填满窗⼝的宽度或者超出窗⼝的宽度范围数据太⼤时, 也会导致绘制的线条超出窗⼝⾼度第⼀个问题好解决, 直接使索引所占数据长度的百分⽐恰好等于 X 坐标相对于窗⼝宽度的百分⽐即可:\[x = index \div dataLength * windowWidth\]对于第⼆个问题, 有两个解决⽅案, ⼀是直接为数据加权重, 例如统⼀乘 0.5, 使数据减⼩⼀节, ⼆就是套⼀个函数, 例如 log 函数, 毕竟 log 函数在较⾼⾃变量的情况下, 因变量的变化趋势越来越⼩, 我们只需要对这个 log 函数进⾏稍加处理, 就可以直接应⽤到数据变换数据上, 使其不超出窗⼝绘图区域另外, 我们也可以平滑频谱显⽰(指动画变换), 它的原理⼤概是这样:例如这次进⾏傅⾥叶变换的结果是: {0, 100, 50},下⼀次傅⾥叶变换的结果是: {100, 0, 0},可以得出, 增量为: {100, -100, -50},在更新变换结果时, 我们不再直接将新的结果替换旧的结果, ⽽是在旧的结果的基础上, 加上增量×权重例如权重是0.5时, 那么实际增量是: {50, -50, -25},那么实际新的值是: {50, 50, 25},如果下⼀次变换的结果还是{100, 0, 0}, 那我们再次从{50, 50, 25}向新值逼近, 权重仍然是0.5, 那么实际增量是: {25, -25, -12.5},注意到了吗? 这次的增量是上次增量的⼀半, 这正好是⼀个减速运动, ⽽且新值与旧值的差越⼤, 变化的就越快, ⽽它们会不断重合, 因⽽速度不断变慢, 形成减速运动的频谱图.更多内容:更多关于 NAudio 的使⽤, 可以看这篇⽂章:项⽬已开源:关于本⽂章涉及的⼤部分内容, 均在仓库中的 Null.AudioVisualizer 项⽬中有写. (注释妥当了)其实⾳频可视化我⽼早就想做了, 但是本⼈数学不是⾮常的好, 不过最后总算是坚持下来了, 弄出来了啊, ⼼情⽼激动了到此这篇关于[C#] 使⽤ NAudio 实现⾳频可视化的⽂章就介绍到这了,更多相关C#⾳频可视化内容请搜索以前的⽂章或继续浏览下⾯的相关⽂章希望⼤家以后多多⽀持!。

openmv 循迹黑线思路

openmv 循迹黑线思路如何使用OpenMV进行黑线循迹。

OpenMV是一款功能强大的嵌入式视觉开发平台,它能够快速进行图像处理和计算机视觉任务。

黑线循迹是OpenMV常见的一个应用训练任务,下面将介绍一步一步使用OpenMV 进行黑线循迹的思路。

第一步:准备硬件首先,我们需要准备相应的硬件设备。

OpenMV官方提供了一款名为OpenMV Cam的嵌入式视觉开发板,它是一款非常适合进行黑线循迹任务的硬件设备。

除了OpenMV Cam之外,我们还需要一条黑色的线路,作为循迹的目标。

确保OpenMV Cam和线路之间的距离适中,并且线路在OpenMV Cam的视野范围内。

第二步:安装OpenMV IDE接下来,我们需要安装OpenMV官方提供的开发环境OpenMV IDE。

打开OpenMV官方网站,选择合适的版本下载并安装。

安装完成后打开OpenMV IDE,并将OpenMV Cam连接到电脑上。

第三步:编写代码现在,我们可以开始编写代码了。

在OpenMV IDE的代码编辑区域,我们可以使用Python语言来编写代码。

以下是一个简单的示例代码:pythonimport sensorimport imageimport time# 初始化摄像头sensor.reset()sensor.set_pixformat(sensor.GRAYSCALE)sensor.set_framesize(sensor.QQVGA)sensor.skip_frames(time = 2000)sensor.set_auto_gain(False)sensor.set_auto_whitebal(False)# 设置阈值threshold_index = 0THRESHOLDS = [(0, 64)]# 启动循迹while(True):img = sensor.snapshot().histeq()blobs = img.find_blobs([THRESHOLDS[threshold_index]], pixels_threshold=200, area_threshold=200)if blobs:# 找到最大的blobmax_blob = max(blobs, key=lambda b: b.pixels())img.draw_rectangle(max_blob.rect())img.draw_cross(max_blob.cx(), max_blob.cy())# 偏移计算offset = max_blob.cx() - img.width() / 2print(offset)以上示例代码首先初始化摄像头,接着设置阈值,然后进入一个无限循环。

使用OpenGL实现的图形渲染与游戏引擎开发

使用OpenGL实现的图形渲染与游戏引擎开发OpenGL(Open Graphics Library)是一种跨平台的图形库,广泛应用于计算机图形学、游戏开发、虚拟现实等领域。

通过使用OpenGL,开发者可以实现高性能的图形渲染,创建逼真的视觉效果,并构建强大的游戏引擎。

本文将介绍如何利用OpenGL实现图形渲染以及游戏引擎开发的基本原理和技术。

1. OpenGL简介OpenGL是一种API(Application Programming Interface),提供了一系列函数接口,用于处理2D和3D图形的渲染。

它支持各种平台,包括Windows、Linux、macOS等,使得开发者能够跨平台开发图形应用程序。

OpenGL使用基于状态机的方式管理图形状态,通过调用不同的函数来设置状态并绘制图形。

2. 图形渲染基础在使用OpenGL进行图形渲染时,需要了解一些基本概念和技术:顶点数据:顶点是构成图形的基本单位,包括位置、颜色、法向量等信息。

开发者需要将顶点数据传递给OpenGL,以便绘制出所需的图形。

着色器:着色器是运行在GPU上的小型程序,用于控制顶点和像素的处理过程。

通常包括顶点着色器和片元着色器,开发者可以编写自定义的着色器程序来实现特定的效果。

纹理映射:纹理映射是将2D或3D纹理贴图应用到物体表面上的过程。

通过纹理映射,可以实现更加逼真的视觉效果。

深度测试:深度测试用于确定哪些像素应该被绘制在屏幕上。

通过深度测试,可以解决遮挡关系,确保物体之间的正确渲染顺序。

3. 游戏引擎开发游戏引擎是一种软件框架,提供了各种功能和工具,用于简化游戏开发过程。

使用OpenGL作为图形渲染引擎可以构建高性能的游戏引擎,实现复杂的游戏逻辑和交互效果。

3.1 游戏引擎架构典型的游戏引擎通常包括以下几个核心模块:渲染引擎:负责处理图形渲染相关任务,包括场景管理、光照效果、特效等。

物理引擎:用于模拟游戏中物体之间的物理交互,如碰撞检测、重力模拟等。

使用OpenGL与fmod实现音乐可视化效果

使用OpenGL与fmod实现音乐可视化效果(简单频谱浏览)今天第一篇说说利用OpenGL和fmod实现可视化效果。

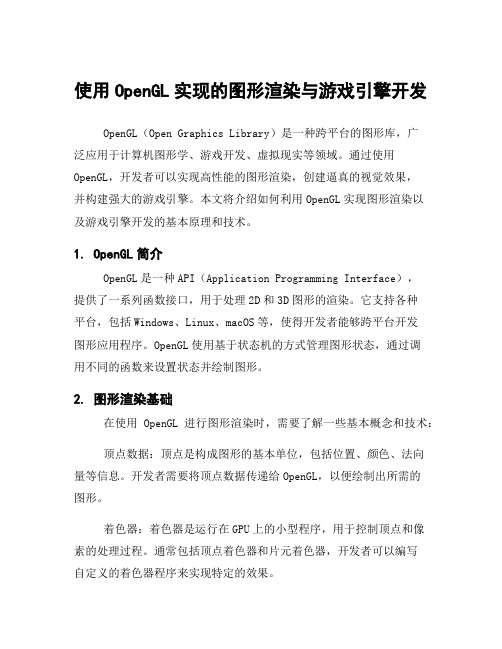

音乐的可视化效果大家应该都知道,下图就是Windows Media Player中的一个简单的可视化效果。

但是大家有没有想过这些效果是怎么实现的呢?其实原理很简单,就是将音乐的频谱的一些数值属性与我们所见的图像的一些属性(如颜色、亮度等等)相关联,当音乐进行时,由于声音属性在不断变化,图像的属性也不断变化,由此产生的动画效果,也就是所谓的可视化效果了。

那什么又是频谱呢?我们知道所有声音都是不同频率(的震动)组合而成的,而每个频率的震动的振幅各不相同。

这种针对声音的,以频率为横轴,震动幅度为纵轴的图像就是频谱,频谱可以被看做为最简单的音乐可视化效果之一。

下图就是WMP中的频谱可视化效果。

明白了原理后,实现频谱可视化效果就简单了。

使用OpenGL、freeglut(glut的“等价”替代品)作为图像库,fmod作为音频库。

OpenGL不用多说,freeglut是免费开源产品,fmod是商业产品,但用于非商业用途时免费。

之所以选用fmod而不适用irrKlang、OpenAL等,是因为其使用简单、功能强大,而且有直接的API(FMOD::Channel的getSpectrum方法)可以很方便的获得声音的频谱信息。

有关OpenGL的东西就不细说了,fmod本人也是刚入门,可以参照快速指南写出简单的程序(我就是参照那个的)。

最后贴一个程序最终截图。

程序源码地址:/p/multimedia-fun/source/browse/trunk/Multimedia%20Fun/fmod-spect rum-1/main.cpp可执行程序下载(务必先安装vc2010运行库):/files/fmod-spectrum-1.rar最后分享几个小经验:1FMOD::Channel::getSpectrum()函数的numvalues必须为2的幂次。

基于OpenGL的三维可视化技术研究与实现

基于OpenGL的三维可视化技术研究与实现随着计算机技术的飞速发展,三维可视化技术也逐渐成为计算机领域的热门研究方向。

其中,基于OpenGL的三维可视化技术因其高效、易用、跨平台等特点,成为了广泛应用的一种技术。

一、OpenGL概述OpenGL是一种跨平台、开放源代码的图像渲染API,是由Silicon Graphics Inc.开发的一套图形程序接口。

OpenGL在3D图形方面的优越性能以及跨平台特性,使得其得到了广泛应用。

OpenGL的发展也比较迅速,在OpenGL 2.0中加入了可编程管线,使得OpenGL可通过GLSL(OpenGL Shading Language)进行高级图形渲染。

二、基于OpenGL的三维可视化技术基于OpenGL的三维可视化技术可以用于各种领域,例如计算机游戏、虚拟现实、医学、建筑设计等等。

其中,计算机游戏是三维可视化技术应用较早的领域之一。

基于OpenGL的游戏开发可以在各种平台上实现高效、流畅的游戏体验。

虚拟现实也是基于三维可视化技术的重要应用领域。

使用基于OpenGL的虚拟现实技术,可以实现逼真的虚拟环境,使用户产生身临其境的体验。

在医学方面,基于OpenGL的三维可视化技术可以用于医学图像重建、医学模拟、手术演示等。

通过可视化技术,医生可以更直观地了解病患情况,选择更合理的治疗方案。

基于OpenGL的三维可视化技术也被广泛应用于建筑设计领域。

使用可视化技术,设计师可以更清晰地了解设计效果,更快速地进行设计调整。

三、基于OpenGL的三维可视化技术实现基于OpenGL的三维可视化技术需要使用OpenGL的相关库函数进行开发。

其中,可以使用GLUT库进行OpenGL窗口的创建和事件处理。

使用OpenGL的矩阵操作函数可以进行三维模型的旋转、缩放、平移等操作。

通过对三维模型的合理组合,可以实现更为复杂的场景效果。

此外,基于OpenGL的三维可视化技术也可以结合其他技术进行应用。

基于OpenGL的3D可视化技术研究

基于OpenGL的3D可视化技术研究一、引言可视化技术在现代科技领域中应用越来越广泛,其中3D可视化技术在很多方面都有较好的发挥空间。

在3D可视化技术中,OpenGL作为一个广泛使用的图形API,其特点在于开放、跨平台、高效率等。

本文将探讨基于OpenGL的3D可视化技术的研究现状、应用案例和未来发展趋势。

二、3D可视化技术的研究现状现阶段,3D可视化技术的研究主要包括三部分:建模、渲染和交互。

在这三部分中,渲染技术是至关重要的。

因为只有完美地渲染出3D模型场景,才能实现良好的交互效果和真实感。

OpenGL作为一个图形API,提供了三维图像的渲染服务,在3D可视化技术中起到了至关重要的作用。

OpenGL是一种开放源代码的图形库,其规范经过OpenGL Architectural Review Board (ARB)的审查和审核,是推广3D图形应用的标准。

目前最新版本为OpenGL 4.6,它支持3D纹理、光照、粒子和透视等渲染效果,可以在不同硬件平台上实现高性能的3D渲染。

三、基于OpenGL的3D可视化技术的应用案例1. 医学领域可视化技术的应用医学领域应用广泛的3D可视化技术可以通过OpenGL渲染出更加真实的脏器模型,帮助医生更好地诊断疾病。

例如,基于OpenGL的X-ray模拟技术可以在没有真实X-ray情况下模拟出人体X-ray影像。

同时,还可以利用OpenGL中的光线追踪技术,实时显示人体的内部结构和器官。

2. 游戏领域可视化技术的应用游戏领域的3D可视化技术需要实时渲染出游戏场景,不仅需要高效率和真实感,还需要具备交互性。

基于OpenGL的3D可视化技术提供了高效的图形操作方法,能够轻松实现对游戏场景的交互操作。

例如,虚拟现实游戏常常使用OpenGL进行3D渲染,并利用头戴式显示器和手柄等交互设备,使玩家沉浸于虚拟世界中。

3. 工业设计领域可视化技术的应用在工业设计领域,基于OpenGL的3D可视化技术可以大幅提升产品设计的效率和质量。

基于OpenGL的CFD设计平台中的流场可视化技术及其实现

为飞行器的外形数据以及流场的外场数据。 (3) 调用 L 库实现关于三维实体几

何变换、投影变换、裁剪、视区变换等操作,并 且 OpenGL 采用深度缓存(Z-buffer)来实现消隐; 并且为了场景的真实性,需要建立光照模型,

表示平面或曲面上的矢量分布,同时显示结构温度场,并提供场景的交互式操作,为飞行器

预设计提供必要的依据并为飞行器设计者提供一个直观方便的设计平台。笔者主要讨论平台

中基于 OpenGL 的流场可视化技术及其实现。

关 键 词:计算机应用;可视化;CFD 设计平台;标量场;矢量场;云图;等值线;

流线

中图分类号:TP 391

程序可以处理的网格有结构网格、非结构网 络、多块网格,其中多块网格(Multi-Block)根据 有无共同交界面分为搭接网格(Patch)与嵌套网 格(Chimera) [3]。结构网格即为由 I,J,K 分别定 义的 N 层 J 行 K 列的网格,对于某一个平面或者 曲面,可以由 I 行 J 列来定义。非结构网格,除 了本身可以按自身的结构实现了网格显示外,对 于每个剖面与切面的流场情况,提出了非结构网 格的标准结构化方法,通过插值与重组转化成结 构化网格。

吴 杰, 黄春生, 范绪箕

(上海交通大学1011研究室,上海 200030)

摘

要:计算流体动力学(CFD)是可视化的重要应用领域,在本研究室自主研发的

复杂外形飞行器气动加热数值模拟设计平台(CFD 设计平台)上,针对结构性网格和非结构网

格分别实现了三维数据场的可视化,用云图和等值线表示平面与曲面上的标量分布,用流线

使用AE制作模拟音乐可视化的教程

使用AE制作模拟音乐可视化的教程模拟音乐可视化是一种非常酷炫的电子音乐效果,它能够将音乐的节奏、旋律以及节拍转化为视觉效果,使观众能够更直观地感受到音乐的力量和节奏感。

在本教程中,我将向大家介绍如何使用Adobe After Effects(简称AE)制作模拟音乐可视化效果。

首先,我们需要准备一段音乐和AE软件。

打开AE软件,创建一个新的合成(Composition),设置合成的尺寸和时长与你的音乐相匹配。

接下来,导入你的音乐文件。

在项目面板中,点击右键,选择导入(Import)-文件(File),然后选择你的音乐文件。

音乐文件导入后,将其拖放到合成中。

在AE中,音频和视频是分开处理的。

点击合成的时间轴,选择“窗口”(Windows)-“音频”(Audio),打开音频面板。

在音频面板中,你可以看到音频的波形。

然后,选中合成的音频层,在顶部工具栏中点击右键,选择“按音频进行关键帧绘制”(Keyframe Assistant)-“按音频进行关键帧绘制”(Convert Audio to Keyframes)。

这样,AE会根据音频的节奏和音量自动创建关键帧。

一旦关键帧创建完成,你可以看到在合成时间轴上出现了一个名为“Audio Amplitude”的特殊效果。

选中该效果,你可以根据自己的需求调整参数,如频率、放大率和颜色等。

现在,我们需要为音频添加可视化效果。

选择合成中的音频层,在顶部工具栏中点击右键,选择“新建”(New)-“新建形状图层”(Shape Layer)。

然后,在属性面板中,将形状的图层类型设置为“分形”(Fractal)。

接下来,调整形状图层的大小和位置,使其适应合成。

在形状图层上,你可以通过调整“增长系数”、“形状复杂度”等参数,来改变形状的外观和行为。

你还可以添加颜色和渐变效果,以突出音乐的强弱变化。

此外,你还可以使用AE中的其他特效和插件来进一步增强音乐可视化效果。

例如,你可以使用“CC Particle World”特效创建粒子效果,使用“Trapcode Sound Keys”插件根据音频创建粒子运动,或者使用“Twitch”插件添加类似电视干扰的效果等。

AE声音可视化教程实现音乐可视化效果

AE声音可视化教程实现音乐可视化效果AE(After Effects)是一款功能强大的视频制作软件,它提供了许多用于音乐可视化的工具和效果。

下面是一个简单的AE声音可视化教程,帮助你实现音乐可视化效果。

步骤1:导入音频文件首先,将你想要制作可视化效果的音频文件导入到AE项目中。

你可以通过拖放文件到项目窗口或使用“文件”菜单中的“导入”选项来完成此操作。

步骤2:创建一个新的合成在项目窗口中选中你刚才导入的音频文件,然后点击右键并选择“新建合成”。

在弹出的对话框中,设置合成的大小、帧速率和持续时间,然后点击“确定”。

步骤3:应用音频效果在时间轴窗口中,选中刚才创建的合成图层,并点击“效果”菜单中的“音频效果”选项。

在下拉菜单中,选择一个你喜欢的音频效果,例如“音频波动”或“音频频谱”。

在效果控制窗口中,你可以调整音频效果的参数以达到你想要的可视化效果。

例如,你可以调整频率范围、波动速度或颜色。

步骤5:添加其他元素如果你想要更丰富的音乐可视化效果,你可以在合成中添加其他元素,例如文字、形状或图像。

你可以使用AE的工具和效果来创建出令人惊叹的音乐可视化效果。

步骤6:渲染和导出完成调整后,点击菜单中的“合成”选项,然后选择“添加到渲染队列”。

在渲染队列窗口中,你可以选择输出格式、帧速率、文件路径等设置。

最后,点击渲染按钮并等待AE将可视化效果渲染成视频文件。

总结:AE提供了许多用于音乐可视化的工具和效果,可以帮助你实现令人惊叹的音乐可视化效果。

通过导入音频文件、创建合成、应用音频效果、调整可视化效果、添加其他元素和渲染导出,你可以制作出独特的音乐可视化视频。

AE音频可视化技巧 制作音乐可视化效果

AE音频可视化技巧:制作音乐可视化效果音频可视化是将音频频谱转化为动态的图像效果,能够使观众在观看视频时更直观、更有趣。

Adobe After Effects (AE) 是一款强大的视频编辑和特效制作软件,具备丰富的音频特效和可视化工具。

本文将介绍一些AE中制作音乐可视化效果的技巧。

第一步,导入音频和背景素材。

打开AE,新建一个项目,然后将你要制作可视化效果的音频文件拖放到项目面板中。

同时,添加一个背景素材,可以是颜色背景或者图片素材。

第二步,创建音频频谱。

在AE中,可以使用“音频功率谱”效果来创建音频频谱图。

选择你导入的音频文件,在“效果控制”窗口中找到“音频功率谱”效果,将其拖放到音频层上。

调整参数来获得你想要的频谱效果。

你可以设置频率的范围、颜色、显示样式等。

第三步,制作频谱动画。

使用AE中的关键帧动画功能,可以让频谱图具备动态效果。

选择音频层上的“音频功率谱”效果,在时间轴中点击一个合适的位置,然后调整频谱的参数。

例如,你可以设置频谱高度、宽度、强度等。

在时间轴上创建多个关键帧,通过调整关键帧的参数来制作频谱的动画。

第四步,添加其他视觉效果。

在音频可视化效果中可以添加其他吸引人的特效来增强视觉效果。

比如,你可以使用AE中的“光效”、“形状图层”、“文字”等工具来设计各种特效。

同时,可以调整特效的颜色、透明度、位置等属性,以获得你想要的效果。

第五步,调整动画效果。

使用AE中的时间轴和图层控制功能,可以对动画进行细致的调整。

你可以调整频谱的运动速度、起始点、结束点等属性。

此外,还可以调整特效的时间点、持续时间等参数,以使整个可视化效果更加流畅和自然。

第六步,渲染和导出。

在完成所有调整后,可以进行最终渲染和导出。

点击AE界面上的“导出”按钮,选择合适的输出格式和参数,然后点击“渲染”按钮,等待渲染完成。

总结来说,制作音乐可视化效果是一项有趣且有创造性的任务。

通过合理运用AE中的音频特效和可视化工具,我们能够制作出各种独特的可视化效果。

可视化软件在音乐作品分析中的运用

可视化软件在音乐作品分析中的运用

音乐作品分析是一项复杂的任务,需要分析音乐作品中的音乐元素,比如节奏、旋律、和声等,以及这些元素之间的关系。

可视化软件可以帮助音乐分析师更好地理解音乐作品,并为其提供有用的可视化工具。

可视化软件可以帮助音乐分析师分析不同的音乐元素,比如节奏、旋律、和声等,并可视化它们之间的关系。

可视化软件可以帮助音乐分析师更好地理解音乐作品,比如他们可以使用可视化软件来分析音乐作品中的节奏、旋律、和声等元素,以及它们之间的关系。

此外,可视化软件还可以帮助音乐分析师更好地理解音乐作品的节奏、旋律和和声等元素的变化,这样他们就可以更好地分析音乐作品的结构和意义。

此外,可视化软件还可以帮助音乐分析师更好地理解音乐作品的演奏技巧,比如他们可以使用可视化软件来分析演奏者使用了哪些技巧,以及这些技巧如何影响音乐作品的整体效果。

可视化软件还可以帮助音乐分析师更好地理解音乐作品的录音技术,比如他们可以使用可视化软件来分析录音技术如何影响音乐作品的整体效果。

总之,可视化软件可以为音乐分析师提供有用的可视化工具,帮助他们更好地理解音乐作品的演奏技巧、录音技术以及音乐元素之间的关系等等。

因此,可视化软件在音乐作品分析中有着重要的作用。

gl_fragcoord用法

GL_FRAGCOORD是一个用于获取当前片段位置的通用变量,它在GLSL(OpenGLShadingLanguage)中经常被使用。

这个变量包含了当前渲染到片段的颜色值,以及相关的坐标信息。

下面我们将详细介绍GL_FRAGCOORD的用法。

一、片段位置和颜色值GL_FRAGCOORD包含了当前渲染到片段的颜色值和坐标信息。

在渲染过程中,每个像素点的颜色是通过片段着色器(FragmentShader)来计算的。

片段着色器中,可以通过GL_FRAGCOORD来获取当前片段的位置信息,并将其与一些常量值(如Z深度值)结合起来,计算出最终的颜色值。

二、坐标系介绍GL_FRAGCOORD是一个4x4的向量,包含了以下坐标信息:*位置坐标:x、y、z分别表示在屏幕上的位置坐标。

这些坐标值是从视口(Viewport)映射到窗口坐标系中的。

*视口坐标:w表示视口的宽度比例因子,它用于将窗口坐标系中的位置转换为片段坐标系中的位置。

*颜色分量:r、g、b、a分别表示红色、绿色、蓝色和alpha(透明度)分量。

这些分量共同构成了片段的颜色值。

三、使用方法在使用GL_FRAGCOORD时,可以通过以下方式获取片段位置和颜色值:1.通过dot或mul等算数运算操作获取其他变量的值,如获取颜色值的加权平均值或计算其他变量与颜色值的乘积等。

2.通过输出操作符将GL_FRAGCOORD的值输出到顶点着色器或其他变量中。

3.使用GL_FRAGCOORD进行一些数学运算或逻辑判断,以实现一些特定的效果或功能。

下面是一个简单的示例代码,展示了如何使用GL_FRAGCOORD获取片段位置和颜色值:```scss#version330core//确保使用GLSL3.3或更高版本outvec4FragColor;//输出变量定义voidmain(){//获取片段位置和颜色值vec4pos=gl_FragCoord.xy/gl_FragCoord.w;//获取位置坐标和视口宽度比例因子vec4color=vec4(0.5,0.0,0.5,1.0);//假设片段颜色值为半透明红色//进行一些操作或计算,将位置坐标和颜色值结合起来,得到最终的颜色值//...//将最终的颜色值输出到像素颜色缓冲区中FragColor=color;}```在上述示例中,我们首先通过gl_FragCoord.xy/gl_FragCoord.w 获取了片段的位置坐标和视口宽度比例因子。

音乐可视化布局设计理念

音乐可视化布局设计理念音乐可视化是指将音乐的声音变成可视的表现形式,通过图形、动画等方式展示音乐的特点和情感。

音乐可视化的布局设计理念主要包括以下几个方面:1. 视觉美感:音乐可视化的主要目的是通过视觉的方式呈现音乐的特点和情感,因此布局设计应注重视觉美感的表达。

可以运用各种颜色、形状、线条等元素来展示音乐的节奏、旋律和情感,提升观众的视觉享受。

2. 结构合理:音乐可视化的布局设计需要考虑到音乐的结构,即音乐的节拍、节奏、旋律等要素。

可以根据音乐的节奏感和情感变化来设计不同的布局结构,如快速的节奏可以采用疏密有致的布局,而缓慢柔和的旋律则可以采用温柔流畅的布局。

3. 动态变化:音乐可视化的布局设计应该能够动态地随着音乐的变化而变化,使观众能够感受到音乐的动感和律动。

可以通过图形元素的移动、扩散、闪烁等方式来体现音乐的节奏和旋律的起伏变化,增加观众的参与感和沉浸感。

4. 多样性和个性化:音乐可视化的布局设计可以根据不同的音乐类型和风格来设计,以展现不同的音乐风格和个性。

可以通过不同的图形、颜色和动画效果来表现不同的音乐特色和情感,使每个音乐可视化作品都具有独特的风格和魅力。

5. 与音乐的协调:音乐可视化的布局设计应与音乐的内容和情感高度协调,使观众在欣赏音乐的同时也能够通过视觉上的呈现更好地理解和感受音乐的情感表达。

可以通过选择合适的图形和颜色来表达音乐的节奏和旋律,使观众能够直观地理解音乐的结构和情感。

总之,音乐可视化的布局设计应注重视觉美感、结构合理、动态变化、多样性和个性化,与音乐的内容和情感高度协调。

通过科学合理地设计布局,可以使音乐可视化作品更好地展示音乐的特点和情感,提升观众的视觉享受和理解音乐的能力。

可视化软件在音乐作品分析中的运用

可视化软件在音乐作品分析中的运用

随着时代的发展,科技的进步也为人们生活带来了不少便利,其中可视化软件也是一个重要的发展方向,它可以使人们更加深入地体验和了解自己喜欢的事物,并对其进行更有效的分析。

本文将重点介绍可视化软件在音乐作品分析中的运用。

首先,可视化软件可以帮助人们更好地理解音乐的结构。

通过可视化软件,人们可以更深入地了解音乐的结构,包括旋律、节奏、和声等细节。

此外,可视化软件还可以帮助人们对音乐作品进行诊断,分析音乐中包含的复杂元素,以及音乐作品在不同形式中的表现。

此外,可视化软件还可以帮助音乐制作者更多地了解他们的音乐,更好地把握音乐的结构,更好地把握音乐的节奏。

此外,可视化软件还可以帮助音乐制作者更好地创作音乐,通过可视化软件,音乐制作者可以更好地控制音乐作品中的复杂元素,以及音乐作品在不同形式中的表现。

此外,可视化软件还可以帮助音乐制作者更好地把握音乐作品中的声音,更有利地使用不同的频率、音色和层次。

最后,可视化软件在音乐制作中扮演着越来越重要的角色,它可以帮助人们更深刻地理解音乐的结构,更好地把握音乐的节奏,也可以帮助音乐制作者更好地创作音乐。

可视化软件的使用将为音乐制作带来新的思维,更多的创作技巧,以及更完善的音乐作品。

在未来,可视化软件将发挥更大的作用,为我们带来更深层次的音乐服务。

- 1 -。

基于MATLAB的音乐旋律二维可视化方法

基于MATLAB的音乐旋律二维可视化方法张岩;吕梦儒【摘要】音频可视化是信息可视化的重要分支,音乐是最具大众性和普遍性的音频信息,乐谱描述音乐的特点是专业性强,形式抽象.为了有利于音乐的展示,提出将音乐进行二维图形映射的可视化处理方法.旋律是音乐的基本要素,主要包含音高、时值和响度等特征,将音乐的旋律进行数据化,绘制二维图形,可以增强人们对音乐的感觉和认知.音频数据受到采样频率和分割帧的影响,会产生大量的过程性数据.MATLAB 提供音频处理函数和大规模数据的分布式并行处理功能,可以完成音乐旋律二维可视化的实时处理.利用傅里叶变换提取音乐旋律的基本特征,形成音高、时值和响度等音乐特征向量矩阵,编制程序完成旋律二维可视化图形的自动绘制.【期刊名称】《沈阳师范大学学报(自然科学版)》【年(卷),期】2018(036)004【总页数】5页(P342-346)【关键词】旋律;MATLAB;visualiztion;FFT;big data【作者】张岩;吕梦儒【作者单位】沈阳师范大学计算机与数学基础教学部,沈阳110034;沈阳师范大学计算机与数学基础教学部,沈阳110034【正文语种】中文【中图分类】TP3110 引言旋律是音乐作品的基本要素,是经过艺术构思而形成的若干乐器的有组织、有节奏的和谐运动。

它建立在一定调式和节拍的基础上,按一定的音高、时值和响度构成的、具有逻辑因素的单声部进行的。

旋律是重要的音乐特征,代表了音乐节奏的分布状态。

所以,旋律二维可视化能够清晰描述音高、时值和响度等旋律特征,有利于人们对音乐的感知和掌握,有利于区分不同音乐的风格和情感类别。

1 音乐旋律的二维可视化和MATLAB大数据处理1.1 音乐旋律的二维可视化音乐乐谱的表现形式有很多种类,如文字谱、数字谱、五线谱、六线谱等等。

最为人们常用的是数字谱和五线谱,其中五线谱多为专业音乐人使用,数字谱则普遍为音乐爱好者使用,2种乐谱都是按照一维(时间)轴变化的,称之为低维乐谱。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

使用OpenGL与fmod实现音乐可视化效果(简单频谱浏览)

今天第一篇说说利用OpenGL和fmod实现可视化效果。

音乐的可视化效果大家应该都知道,下图就是Windows Media Player中的一个简单的可视化效果。

但是大家有没有想过这些效果是怎么实现的呢?其实原理很简单,就是将音乐的频谱的一些数值属性与我们所见的图像的一些属性(如颜色、亮度等等)相关联,当音乐进行时,由于声音属性在不断变化,图像的属性也不断变化,由此产生的动画效果,也就是所谓的可视化效果了。

那什么又是频谱呢?我们知道所有声音都是不同频率(的震动)组合而成的,而每个频率的震动的振幅各不相同。

这种针对声音的,以频率为横轴,震动幅度为纵轴的图像就是频谱,频谱可以被看做为最简单的音乐可视化效果之一。

下图就是WMP中的频谱可视化效果。

明白了原理后,实现频谱可视化效果就简单了。

使用OpenGL、freeglut(glut的“等价”替代品)作为图像库,fmod作为音频库。

OpenGL不用多说,freeglut是免费开源产品,fmod是商业产品,但用于非商业用途时免费。

之所以选用fmod而不适用irrKlang、OpenAL等,是因为其使用简单、功能强大,而且有直接的API(FMOD::Channel的getSpectrum方法)可以很方便的获得声音的频谱信息。

有关OpenGL的东西就不细说了,fmod本人也是刚入门,可以参照快速指南写出简单的程序(我就是参照那个的)。

最后贴一个程序最终截图。

程序源码地址:/p/multimedia-fun/source/browse/trunk/Multimedia%20Fun/fmod-spect rum-1/main.cpp

可执行程序下载(务必先安装vc2010运行库):/files/fmod-spectrum-1.rar

最后分享几个小经验:

1FMOD::Channel::getSpectrum()函数的numvalues必须为2的幂次。

2设置声音循环可以使用FMOD::Sound::setMode()函数,并以FMOD_LOOP_NORMAL 为参数。

设置循环次数可以使用FMOD::Channel::SetLoopCount()函数。

同时,setMode()必须在FMOD::System::playSound()之前调用才有效果,否则则在下一次调用playSound()后起效。

FMOD::Channel::getSpectrum()只在FMOD::Sound的模式为FMOD_SOFTWARE时才有效。

FMOD::Sound的模式可以在FMOD::System::createSound()时指定。

很奇怪的一点,我也不确定。

貌似glColor*要在glRasterPos*前调用才会对glutBitmapCharacter()渲染出的字符的颜色起作用。