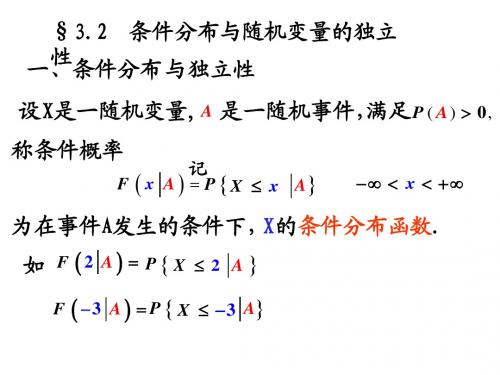

§32 条件概率与随机变量的独立性

2-2-3随机变量的独立性,条件分布

x

FX Y ( x y) pX Y ( x y) d x

x

[ p(x, y)

pY ( y)]d x.

y

FY X ( y x) pY X ( y x) d y

y

[ p(x, y)

pX (x)]d y.

备份题

例1 设

(X,Y )

~

p( x,

y)

Cy(1 0,

x),

0 x 1,0 其 它.

则称X和Y相互独立.

例1 已知 ( X ,Y ) 的分布律为

( X ,Y ) (1,1) (1,2) (1,3) (2,1) (2,2)

111 1

pij

6

9 18

3

(1) 求与应满足的条件;

(2) 若 X 与 Y 相互独立,求 与 的值.

(2,3)

解 将 ( X ,Y ) 的分布律改写为

Y X

1

1

1

6

1

2

3

p• j P{Y yj } 1 2

2 1 9

1

9

3 pi• P{ X xi }

1

1

18

3

1

3

1

18

2

3

(1)由分布律的性质知

0,

0,

2

3

1,

故与应满足的条件是 : 0, 0 且 1 .

3

(2) 因为 X 与 Y 相互独立, 所以有

pij pi• p• j , (i 1,2; j 1,2,3)

xe(x y)dy xe x

0

x>0

pY ( y) 0 xe( x y)dx e y

y >0

即:

随机变量的独立性和相关性

随机变量的独立性和相关性随机变量是概率论和数理统计中的重要概念,用于描述随机事件和随机现象的数值特征。

研究随机变量之间的关系对于深入理解概率和统计学的基本原理至关重要。

在这篇文章中,我们将探讨随机变量的独立性和相关性。

一、独立性独立性是指两个或多个随机变量之间的关系,即一个随机变量的取值对另一个随机变量的取值没有任何影响。

如果两个随机变量X和Y 是独立的,那么它们满足以下条件:P(X=x, Y=y) = P(X=x) * P(Y=y)其中P(X=x, Y=y)表示X等于x,Y等于y的概率,P(X=x)和P(Y=y)分别表示X等于x的概率和Y等于y的概率。

换句话说,当两个随机变量独立时,它们的联合概率等于各自的边缘概率的乘积。

独立性的意义在于可以简化概率计算。

如果X和Y是独立的,那么我们可以通过独立事件的性质计算它们的联合概率。

此外,独立性还可以应用于贝叶斯定理、条件概率和协方差等相关概念的推导与计算。

二、相关性相关性是指两个随机变量之间存在某种程度的关联或依赖关系。

如果两个随机变量X和Y相关,那么它们的取值是彼此依赖的,即当X的取值发生变化时,Y的取值也会随之变化。

在统计学中,相关性通过协方差和相关系数来度量。

协方差描述了两个随机变量之间的总体关系,定义为:cov(X,Y) = E[(X - E(X))(Y - E(Y))]其中cov(X,Y)表示X和Y的协方差,E(X)和E(Y)分别表示X和Y的期望(均值)。

协方差的数值可以为负、零或正,分别表示负相关、无相关或正相关。

相关系数是协方差的标准化形式,用于度量两个随机变量之间的线性相关程度。

相关系数的取值范围在-1和1之间,越接近-1或1表示相关性越强,越接近0表示相关性越弱或不存在。

三、独立性与相关性的区别独立性和相关性是两个不同的概念。

独立性是指两个或多个随机变量之间的独立关系,即一个变量的取值对另一个变量的取值没有影响。

相关性是指两个随机变量之间存在某种关联或依赖关系,即一个变量的取值会随着另一个变量的取值而变化。

概率论中的独立性与条件概率研究

概率论中的独立性与条件概率研究概率论是数学中的一个重要分支,研究随机事件发生的可能性。

在概率论中,独立性和条件概率是两个基本概念,它们在解决实际问题和推导数学公式中起着重要的作用。

独立性是指两个或多个事件之间的关系,当一个事件的发生与另一个事件的发生无关时,我们称这两个事件是独立的。

例如,投掷一枚硬币的结果与掷骰子的结果无关,这两个事件是独立的。

独立性在概率计算中非常重要,它使我们能够简化问题的复杂度,从而更容易计算概率。

条件概率是指在已知某一事件发生的条件下,另一事件发生的概率。

条件概率可以用符号P(A|B)表示,其中A和B分别代表两个事件。

例如,已知某个人患有某种疾病的概率是1%,而在患有该疾病的人中,某种检测方法的准确率为90%。

那么,对于一个随机选取的人,他患有该疾病且检测结果为阳性的概率是多少?在解决这个问题时,我们可以使用条件概率的定义。

设事件A表示一个人患有该疾病,事件B表示检测结果为阳性。

我们需要求解的是P(A|B),即在已知检测结果为阳性的条件下,一个人患有该疾病的概率。

根据条件概率的定义,我们有:P(A|B) = P(A∩B) / P(B)其中,P(A∩B)表示事件A和B同时发生的概率,P(B)表示事件B发生的概率。

根据已知条件,我们可以得到P(A∩B) = P(A) * P(B|A),即一个人患有该疾病且检测结果为阳性的概率等于一个人患有该疾病的概率乘以检测结果为阳性的准确率。

代入上述公式,我们可以得到:P(A|B) = P(A) * P(B|A) / P(B)代入已知条件,我们可以计算出P(A|B) = (0.01 * 0.9) / (0.01 * 0.9 + 0.99 * 0.1) ≈ 0.083。

也就是说,一个随机选取的人患有该疾病且检测结果为阳性的概率约为8.3%。

通过这个简单的例子,我们可以看到条件概率在解决实际问题中的重要性。

它能够帮助我们计算出在已知某些条件下的概率,从而更好地理解和分析问题。

3.2条件分布与随机变量的独立性

3e3 ydy e3

1

19

例5 甲乙两人约定中午12:30分在某地会面. 如果甲 来到的时间在12:15到12:45之间是均匀分布, 乙独立 地到达, 而且到达时间在12:00到13:00之间是均匀分 布, 试求先到的人等待另一人到达的时间不超过5分 钟的概率, 又甲先到的概率是多少?

解 由 X 与Y 独立性知

0

0, x 0

x0

ex , x 0

0, x 0

18

当 x 0时,有

fY|X ( y | x)

f (x, y) fX (x)

xe x(1

ex 0

y)

y

y 0

0

xexy y 0

0 y0

(2)当 X 3时,有

P(Y 1 X 3)

1 fY|X ( y | 3)dy

的边缘分布律中的部分数值, 试将其余数值填入表 中的空白处.

X

Y y1 y2 y3 P{ X xi } pi .

x1

1/ 8

x2

1/ 8

P{ y yj } p j 1/ 6

1

解 由于 P{ X x1,Y y1} P{Y y1} P{X x2 ,Y y1} 1/ 6 1/ 8 1/ 24,

1 p• j

i 1

pij

p• j p• j

1

同样, P{Y y j | X xi }也具有这两点性质。

9

例2 设 X与Y的联合概率分布如右表.

求Y 0 时, X 的条件概率 X Y -1 0 2 分布以及 X 0 时, Y 的条件 0 0.1 0.2 0

概率分布;

1 0.3 0.05 0.1 2 0.15 0 0.1

f ( x, y),( X ,Y ) 关于 Y 的边缘概率密度为fY ( y).若

3.2条件分布及其独立性

解 当x0.5时 P{Xx X0.5}0

当x0.5时

P{X

x, X

0.5} x 0.05.,5,

0.5 x1, x 1.

从而可得

F (x|

X

0.5)

P{X x, X 0.5} P{X 0.5}

P{X

x, X 0.5

0.5}

F(x| X

0.5) 2x0, 1,

x 0.5, 0.5 x1,

1, x 1.

Yy

的条件下

X

的条件密度函数

类似地 可以讨论在Xx的条件下 Y的条件分布

三、连续型随机变量的条件密度函数与独立性

条件密度函数

设(X Y)是连续型随机向量 密度函数为f(x y)

如果fX(x)0 fY(y)0 则

fX|Y (x| y)

f (x, y) fY (y)

fY|X (y| x)

f (x, y) fX (x)

解 在X0时 Y的条件概率分布为

P{Y

1|

X

0}

P{Y 1, X P{X 0}

0}

0.1 0.10.20

1 3

P{Y

0|

X

0}

P{Y 0, X P{X 0}

0}

0.2 0.3

2 3

P{Y

2|

X

0}

P{Y 2,X 0} P{X 0}

0 0.3

0

定理33(独立性的判断)

设X Y是离散型随机变量 其联合概率分布为

§32 条件分布与随机变量的独立性

一、条件分布与独立性的一般概念 二、离散型随机变量的条件概率分布与独立性 三、连续型随机变量的条件密度函数与独立性

一、条件分布与独立性的一般概念

3.2 条件分布与随机变量的独立性

f ( x, y) f X |Y ( x | y) = , x∈R fY ( y )

f ( x, y) fY | X ( y | x ) = , y∈ R fX ( x) 边缘密度函数分别为f △ 设(X, Y) 的密度函数为 f(x, y), 边缘密度函数分别为fX(x) 和fY(y). 则 X 与 Y 相互独立 ⇔ f(x, y)=fX(x)fY(y), ∀x, y∈R . )=f

例1 设(X, Y)服从D={(x, y)|x2+y2≤1}上均匀分布, 求: 服从D {(x )|x 上均匀分布, fY|X(y|x)和fX|Y(x|y).

P18P18-14

条件分布与独立性

三、连续型随机变量的条件密度函数与独立性 △ 设(X, Y) ~ f(x, y), 如果fY(y)>0, fX(x)>0, 则 如果f

P18P18-7

二、离散型随机变量的条件概率分布与独立性 1. 设(X, Y)是二维离散型随机向量, 其概率分布为 是二维离散型随机向量,

条件分布与独立性

P{X=xi , Y=yj}=pij , i , j=1, 2, ⋅⋅⋅ (1) 若P{Y=yj}>0, 则已知Y=yj的条件下X的条件概率分布为 的条件下X的条件概率分布 分布为

P18P18-12

条件分布与独立性

三、连续型随机变量的条件密度函数与独立性

1. 条件分布函数与条件密度函数 条件分布函数与 设(X, Y) ~ f(x, y), 如果fY(y)>0, fX(x)>0, 则 如果f

f ( x, y) f X |Y ( x | y) = , x∈R fY ( y ) f ( x, y) fY | X ( y | x ) = , y∈ R fX ( x) 2. 设(X, Y) 的密度函数为 f(x, y), 边缘密度函数分别为fX(x) 边缘密度函数分别为f 和fY(y). 则 X 与 Y 相互独立 ⇔ f(x, y)=fX(x)fY(y), ∀x, y∈R . )=f

概率与统计中的随机变量独立性

概率与统计中的随机变量独立性概率和统计是数学中重要的分支,用于描述和分析事件发生的概率以及对观测数据进行统计推断。

在概率与统计中,随机变量是一个核心概念,用于描述随机试验的结果。

而随机变量独立性则是指两个或多个随机变量之间的相互关系,它在概率与统计中具有重要的地位。

随机变量独立性的概念首先,我们来讨论随机变量的概念。

随机变量是表示随机试验的结果的数值型变量,它可以是离散型的也可以是连续型的。

离散型随机变量可以取到有限个或者可数个数值,如掷骰子的点数。

而连续型随机变量则可以取到无限个数值,如某商品的销售额。

随机变量独立性是指两个或多个随机变量之间的相互关系。

当两个随机变量之间存在独立性时,它们的取值之间没有任何关联,即一个随机变量的取值不会对另一个随机变量的取值产生任何影响。

换句话说,知道一个随机变量的取值并不能提供任何关于另一个随机变量取值的信息。

随机变量独立性的判定在概率与统计中,我们常常需要判定两个或多个随机变量之间是否存在独立性。

判定随机变量独立性的方法主要有两种:通过概率定义和通过联合分布函数。

通过概率定义判定独立性是指判断两个随机变量的联合概率与各自的边缘概率之间的关系。

假设我们有两个随机变量X和Y,它们的边缘概率分别为P(X)和P(Y),而它们的联合概率为P(X,Y)。

如果满足以下条件,即P(X,Y) = P(X) * P(Y),则可以认为随机变量X和Y是独立的。

另一种判定随机变量独立性的方法是通过联合分布函数。

如果两个随机变量X和Y的联合分布函数可以表示为各自边缘分布函数的乘积形式,即F(X,Y) = F(X)* F(Y),则可以认为X和Y是独立的。

需要注意的是,在连续型随机变量的情况下,联合概率密度函数的乘积等于联合概率密度函数,而在离散型随机变量的情况下,联合概率质量函数的乘积等于联合概率质量函数。

随机变量独立性的意义随机变量独立性在概率与统计中具有重要的意义。

首先,随机变量独立性简化了概率计算和统计推断的过程。

3.2 条件分布与随机变量的独立性

二、随机变量的独立性

则称随机变量 X 和 Y 相互独立。 若随机变量 X 和 Y 相互独立,则联合分布可由边缘分布唯一 确定。

二、随机变量的独立性

定理1:随机变量 X 与 Y 相互独立的充要条件是 X 所生成的 任何事件与 Y 所生成的任何事件相互独立,即对任意实数集 A 和 B,有

解:

四、连续型随机变量的条件分布与独立性

解:

四、连续型随机变量的条件分布与独立性

几乎处处成立,则称 X, Y 相互独立。 注: 这里“几乎处处成立”的含义是: 在平面上除去面积为零 的集合外, 处处成立。

四、连续型随机变量的条件分布与独立性

例:甲乙两人约定中午12时30分在某地会面,如果甲来到的时 间在12:15到12:45之间是均匀分布,乙独立地到达 , 而且到达时 间在12:00到13:00之间是均匀分布,试求:先到的人等待另一人 到达的时间不超过5分钟的概率,又甲先到的概率是多少?

四、连续型随机变量的条件分布与独立性

解 : ( 1)

y y y 0 e dx ye , = 0,

y0 其它

四、连续型随机变量的条件分布与独立性

解 : ( 2)

(3)

四、连续型随机变量的条件分布与独立性

解 : ( 3)

因此

四、连续型随机变量的条件分布与独立性

作业:

解:设 X 为甲到达时刻, Y 为乙到达时刻, 以12时为起点, 以分为 单位, 依题意,

即有 由 X 与 Y 的独立性知

四、连续型随机变量的条件分布与独立性

例:甲乙两人约定中午12时30分在某地会面,如果甲来到的时 间在12:15到12:45之间是均匀分布,乙独立地到达 , 而且到达时 间在12:00到13:00之间是均匀分布,试求:先到的人等待另一人 到达的时间不超过5分钟的概率,又甲先到的概率是多少?

条件分布及其独立性

分析

设(X Y)是连续型随机向量 分布函数和密度函数分别为 F(x y)和f(x y) 我们希望考虑在Yy的条件下X的条件分布

由于{Yy}是一个零概率事件

P{X x|Y y} P{X x,Y y} P{Y y}

(328)

的分子、分母均为0 因而直接根据条件概率定义来考虑X的

(320)

对给定的x和y 如果事件{Xx}与事件{Yy}独立 则有

此时

F(x y) P{Xx Yy}P{Xx}P{Yy} FX(x)FY(y)

F(x|Yy)FX(x)

(321)

一、条件分布与独立性的一般概念

条件分布函数 对每个给定的实数x 我们记条件概率P{Xx|A}为F(x|A)

条件分布函数 对每个给定的实数x 我们记条件概率P{Xx|A}为F(x|A)

并称F(x|A)(x)为在A发生的条件下X的条件分布函数 设A{Yy} 且P{Yy}0 则有

F(x|Y y) P{X x,Y y} F(x,y) P{Y y} FY (y)

(1) pi|j 0 (2) pi| j 1 i

二、离散型随机变量的条件概率分布与独立性

条件概率分布

设(X Y)是二维离散型随机向量 其概率分布为

P{Xxi Yyj}pij i j1 2 则由条件概率公式 当P{Yyj}0时 有

P{X

xi |Yຫໍສະໝຸດ 1 x2 , π 0,

| x|1, 其他.

于是 对一切x(|x|1) 有

fY|X (y| x)

f (x, y) fX (x)

2

1, 1 x2 0,

| y| 1 x2, 其他.

例38(2) 设(X Y)是在D{(x y)|x2y21}上服从均匀分布 的随机向量 求fX|Y (x|y)

《条件概率与独立性》课件

卡方检验法

卡方检验法是一种基于概率分布的统计方法, 通过计算观测值和理论值之间的偏差程度来检 验独立性。

条件概率与独立性的应用

金融市场预测

条件概率和独立性等概率理论方 法常用于分析和预测金融市场趋 势、股票涨跌等。

医学诊断

条件概率和独立性等概率理论方 法常用于医学诊断中的病例分析 和风险评估。

药物研发

计算条件概率

1

先决概率

先决概率是指在给定先决条件的情况下,某个事件的概率。

2

全概率公式

全概率公式是计算条件概率的关键公式之一。

3

贝叶斯公式

贝叶斯公式是计算后验概率的重要工具,常用于医疗、金融领域中的决策分析。

独立性的判定

十字乘法判定法

十字乘法判定法是使用最常见的一种方法,它 通过直觉理解就可以判断两个事件之间是否独 立。

条件概率和独立性等概率理论方 法可以帮助科学家系统地评估新 药物的效果和安全性。

练习与总结

本节将提供练习题目,让你进一步巩固和应用所学知识,并对整个课程的内容进行回顾和总结。

条件概率与独立性

本课程以深入浅出的方式介绍了条件概率与独立性的概念、计算方法、判定 准则以及应用场景,并提供实例和练习,帮助你快速掌握这一重要知识点。

条件概率的定义

什么是条件概率?

条件概率指在某个条件下某一事 件发生的概率,常用于计算和预 测。

如何计算条件概率?

根据公式P(A|B)=P(AB)/P(B),通 过分析样本空间,可以用不同的 方法计算条件概率。

为什么条件概率有用?

条件概率常用于实际应用场景中, 例如医学诊断、金融风险评估、 市场预测等。

独立性的概念

1 什么是独立性?

大学数学易考知识点概率论的条件概率与独立性

大学数学易考知识点概率论的条件概率与独立性大学数学易考知识点:概率论中的条件概率与独立性概率论是数学中一个重要的分支,研究事物发生的可能性。

在大学数学的学习中,概率论是一个比较常见的考点。

其中,条件概率与独立性是概率论中的两个基本概念。

本文将详细介绍条件概率与独立性的概念、性质以及应用。

一、条件概率条件概率是指在已知事件B发生的条件下,事件A发生的概率。

其计算公式为:P(A|B) = P(A∩B) / P(B)其中,P(A|B)表示事件B发生的条件下,事件A发生的概率;P(A∩B)表示事件A与事件B同时发生的概率;P(B)表示事件B发生的概率。

条件概率的计算可以通过实际问题的转化来帮助理解。

例如,某班级有60%的男生和40%的女生,已知班级中80%的学生喜欢数学。

现在要求已知一位学生是男生的条件下,他也喜欢数学的概率。

根据条件概率的计算公式,我们可以得到:P(喜欢数学|男生) = P(喜欢数学∩男生) / P(男生)由于已知喜欢数学的学生占总人数的80%,而男生占总人数的60%,则有:P(喜欢数学|男生) = (0.8*0.6) / 0.6 = 0.8所以,在已知一位学生是男生的条件下,他也喜欢数学的概率为0.8。

条件概率的计算方法对于实际问题的解决非常有用。

通过合理的条件划分,我们可以计算出各种条件下的概率,从而更好地理解和解决问题。

二、独立性在概率论中,独立性是指两个事件的发生与否互相不影响。

具体而言,事件A与事件B相互独立的条件为:P(A|B) = P(A)P(B|A) = P(B)即事件A发生的概率与事件B发生与否无关,事件B发生的概率与事件A发生与否无关。

两个独立事件的条件概率相等于事件的边际概率。

例如,某扑克牌中共有52张牌,我们从牌中随机抽取一张,记录下此牌的花色,然后将此牌放回。

再次从牌中随机抽取一张,记录下此牌为红桃。

问第一次所抽取的牌为红色的概率是多少?根据题意,第一次所抽取的牌为红色的概率为1/2,因为扑克牌中共有52张牌,其中红色牌有26张。

概率论与数理统计— 条件分布及变量的独立性共36页文档

概率论与数理统计— 条件分 布及变量的独立性

31、别人笑我太疯癫,我笑他人看不 穿。(名 言网) 32、我不想听失意者的哭泣,抱怨者 的牢骚 ,这是 羊群中 的瘟疫 ,我不 能被它 传染。 我要尽 量避免 绝望, 辛勤耕 耘,忍 受苦楚 。我一 试再试 ,争取 每天的 成功, 避免以 失败收 常在别 人停滞 不前时 ,我继 续拼搏 。

33、如果惧怕前面跌宕的山岩,生命 就永远 只能是 死水一 潭。 34、当你眼泪忍不住要流出来的时候 ,睁大 眼睛, 千万别 眨眼!你会看到 世界由 清晰变 模糊的 全过程 ,心会 在你泪 水落下 的那一 刻变得 清澈明 晰。盐 。注定 要融化 的,也 许是用 眼泪的 方式。

35、不要以为自己成功一次就可以了 ,也不 要以为 过去的 光荣可 以被永 远心灵的最软弱无力。——斯宾诺莎 7、自知之明是最难得的知识。——西班牙 8、勇气通往天堂,怯懦通往地狱。——塞内加 9、有时候读书是一种巧妙地避开思考的方法。——赫尔普斯 10、阅读一切好书如同和过去最杰出的人谈话。——笛卡儿

计算概率的条件概率与事件独立性

计算概率的条件概率与事件独立性在概率理论中,条件概率和事件的独立性是两个重要的概念。

它们在计算概率、统计分析和决策制定等领域中有广泛的应用。

本文将介绍条件概率和事件的独立性的概念、性质及其应用。

一、条件概率的概念与性质在已知事件B发生的条件下,事件A发生的概率称为事件A在条件B下的条件概率,记作P(A|B),读作“在B条件下A的概率”。

条件概率的计算公式如下:P(A∩B)P(A|B) = ───────────────────P(B)其中,P(A∩B)表示事件A与事件B同时发生的概率,P(B)表示事件B发生的概率。

条件概率具有以下重要性质:1.非负性:对于任意事件A和B,条件概率P(A|B) ≥ 0;2.单位概率:当B是必然事件(P(B) = 1)时,条件概率P(A|B) = P(A);3.互斥概率:当事件A与事件B互斥时,条件概率P(A|B) = 0。

二、事件的独立性的概念与性质事件A和事件B的独立性是指事件A的发生与否不受事件B的发生与否的影响,即P(A|B) = P(A)或P(B|A) = P(B)。

换句话说,事件A和事件B的独立性意味着它们的条件概率与边际概率相等。

事件的独立性具有以下重要性质:1.对称性:如果事件A与事件B独立,那么事件B与事件A也独立;2.自反性:事件A与自身独立;3.传递性:如果事件A与事件B独立,事件B与事件C独立,则事件A与事件C独立。

三、条件概率与事件独立性的应用条件概率和事件独立性在实际问题中有着广泛的应用,以下举几个例子。

1.生活中的应用假设某地区有50%的男性和50%的女性,有10%的人患有某种疾病。

已知患病率在男性中为5%,在女性中为15%。

现在我们来计算一个人是男性的条件下,他患病的概率。

根据条件概率的定义,可以得到: P(男性∩患病)P(患病|男性) = ────────────────── = ───── = 0.1P(男性)这个例子中,我们使用了条件概率来计算一个人是男性的条件下,他患病的概率。

条件概率与事件的独立性

条件概率与事件的独立性概率论中的条件概率和事件的独立性是两个基本概念,它们在统计学、机器学习等领域中具有重要的应用。

条件概率用于描述在给定另一个事件发生的条件下,某个事件发生的概率;而事件的独立性则描述了两个或多个事件之间的相互独立性。

在本文中,我们将深入探讨条件概率与事件的独立性的概念、性质以及应用。

一、条件概率条件概率是在已知事件B发生的条件下,事件A发生的概率。

用数学符号表示为P(A|B),读作"A在B发生的条件下发生的概率"。

其计算公式为:P(A|B) = P(A∩B) / P(B)其中,P(A∩B)表示事件A与事件B同时发生的概率,P(B)表示事件B发生的概率。

条件概率的概念在实际问题中广泛应用。

例如,假设一批产品中有10%的次品,现在从这批产品中随机抽取一件,已知这件产品是次品,求其实际上是某个特定厂家生产的概率。

这个问题就可以利用条件概率来求解,假设事件A表示该产品是某个特定厂家生产的事件,事件B表示这件产品是次品的事件,那么我们需要求解的就是P(A|B)。

二、事件的独立性事件的独立性是指两个或多个事件之间的发生没有相互影响,即一个事件的发生与否不会改变其他事件发生的概率。

具体地,对于两个事件A和B,如果满足以下条件,则称事件A和事件B是相互独立的:P(A∩B) = P(A) * P(B)其中,P(A∩B)表示事件A和事件B同时发生的概率,P(A)和P(B)分别表示事件A和事件B发生的概率。

事件的独立性在概率论中具有重要的应用。

例如,假设有两个骰子,求它们同时投掷时出现两个特定数字的概率。

我们可以将出现某个特定数字的事件定义为事件A和事件B,利用事件的独立性可以得到P(A∩B) = P(A) * P(B)。

三、条件概率与事件的独立性的关系条件概率与事件的独立性之间存在着紧密的联系。

如果事件A和事件B相互独立,那么有以下关系成立:P(A|B) = P(A)这表示在已知事件B发生的条件下,事件A的发生概率与事件B无关。

大学概率论的条件概率与独立性

大学概率论的条件概率与独立性概率论是数学的一个重要分支,用于研究随机现象和随机事件的规律性。

在大学的概率论课程中,我们学习了许多基本概念和理论。

其中,条件概率和独立性是概率论中重要的概念,对于理解和应用概率论具有重要意义。

一、条件概率条件概率是指在某个事件发生的条件下,另一个事件发生的概率。

设A和B是两个事件,且P(B)>0,则在事件B发生的条件下事件A发生的概率,记为P(A|B),表示为“A在B发生的条件下发生的概率”。

计算条件概率的公式为:P(A|B) = P(A∩B) / P(B)这个公式可以从概率的定义来推导。

根据概率的性质,我们可以得到以下重要性质:性质1:对于任何事件A和B,有P(A∩B) = P(A|B) × P(B)性质2:如果事件A和B相互独立,那么P(A|B) = P(A),P(B|A) = P(B)条件概率的概念和性质为我们研究随机事件之间的联系提供了很好的工具。

在实际问题中,条件概率常常用于解决一些复杂的概率计算问题。

二、独立性独立性是概率论中另一个重要的概念,指的是两个事件的发生不受对方的影响。

设A和B是两个事件,如果P(A∩B) = P(A) × P(B),则称事件A和B是相互独立的。

在独立性的定义下,我们有以下性质:性质1:如果事件A和B相互独立,则P(A|B) = P(A),P(B|A) =P(B)性质2:如果事件A和B相互独立,则事件A与B的补事件也相互独立。

性质3:如果事件A和B相互独立,则事件A与B的并事件、交事件以及差事件也相互独立。

独立性是概率论中非常重要的概念,它能够帮助我们简化概率计算过程,提高问题的求解效率。

三、条件概率与独立性的关系在一般情况下,条件概率与独立性是两个不同的概念。

然而,在特殊情况下,条件概率和独立性之间存在着紧密的联系。

具体来说,对于两个事件A和B,如果P(B)>0,以下两个命题等价:命题1:事件A和B相互独立。

3.2条件分布与随机变量的独立性(课件)

P Y y 且 X x F y X x P Y y X x P X x

F ( x, y ) FX ( x ) F y X x FY ( y)F x Y y

独立性: 事件A与 B 独立

2 x, 0 x 1 f X ( x) 其它 0,

1

x

y x f ( x, y ) f 当 x 0 或 x 1 时, Y X y x 不存在. f X ( x)

1, f ( x, y) 0,

0 x 1, x y x yx

其它

求条件密度函数.

0dy 0, x 0 解 2 x, 0 x 1 2 x , 0 x 1 f X ( x ) f ( x , y )d y 0, 其它 0dy 0, x 1 0 x 1 时, y yx f X ( x) f ( x , y )d y

0dy 1 dy 0dy 2x x x

x

x

f ( x, y ) fY X y x f X ( x)

x

x 1

x x

y x

例 设X和Y的联合密度函数为 0 x 1, x y x yx 1, f ( x, y) y求条件密度函数. 0, 其它 yx 解

X Y

例 设随机变量 X 与 Y 独立, 下表列出二维随机向量 ( X , Y ) 的联合分布律 及边缘分布律 的部分数值,

将其余数值 填入空白处.

X

Y

y1

1 24 1 8 1 6

概率论中的条件概率与事件独立性

条件概率与事件 独立性的实际案 例分析

天气预报的准确率与事件独立性分析

天气预报准确率与事件独立性的关系 不同天气预报模型对独立性的影响 实际案例分析:某地区连续两天的天气预报准确率 结论:提高天气预报准确率有助于更好地分析事件独立性

股票价格波动与事件独立性分析

股票价格波动与事件独立性的概念 股票价格波动与事件独立性的关系 股票价格波动与事件独立性的实际案例分析 股票价格波动与事件独立性的应用

掌握条件概率与事件独立性的概念和性质,对于理解概率论和统计学的基本原理、进行科学推断 和决策具有重要的意义。

未来研究方向与展望

深入研究条件概率 与事件独立性的关 系

探讨其在不同领域 的应用前景

探索如何更好地解 释和预测事件发生 的可能性

进一步研究条件概 率与事件独立性的 数学理论基础

感谢您的观看

汇报人:XX

条件概率与事件独立性

汇报人:XX

目录

添加目录标题

01

条件概率的定义与计 算

02

事件独立性的定义与 性质

03

条件概率与事件独立 性的关系

04

条件概率与事件独立 性的应用场景

05

条件概率与事件独立 性的实际案例分析

06

添加章节标题

条件概率的定义 与计算

条件概率的定义

条件概率是指在某 一事件B已经发生 的情况下,另一事 件A发生的概率,

在统计推断中,条件概率与事件独立性可用于构建复杂的概率模型,如贝叶斯推断和 马尔科夫链蒙特卡洛方法。

条件概率与事件独立性在统计推断中的应用有助于提高预测精度和决策的科学性。

在决策论中的应用

风险决策:根据条 件概率评估不同方 案的风险和收益

随机变量的独立性和条件概率分布

随机变量的独立性和条件概率分布是概率论中的重要概念,在很多领域都有广泛的应用。

独立性的概念是指两个或多个事件之间的关系,而条件概率分布则是指随机变量在给定一些条件下的概率分布。

首先来看独立性。

在数学上,独立性通常指的是两个随机变量之间的关系。

如果两个随机变量X和Y是独立的,那么它们可以分别考虑,而且它们之间的任何影响都不会相互影响。

具体来说,如果两个随机变量X和Y是独立的,那么它们的联合概率分布可以拆分成它们各自的概率分布的乘积。

即,P(X=x, Y=y) = P(X=x) * P(Y=y)。

举个例子,假设我们有两个骰子,我们把它们连续掷两次。

我们可以定义随机变量X为第一次掷出的点数,随机变量Y为第二次掷出的点数。

如果我们假设这两个骰子是六面的,并且它们是公平的,那么每个点数出现的概率都是1/6。

因此,我们可以计算出X和Y的概率分布,分别为P(X=1)=P(X=2)=P(X=3)=P(X=4)=P(X=5)=P(X=6)=1/6和P(Y=1)=P(Y=2)=P(Y=3)=P(Y=4)=P(Y=5)=P(Y=6)=1/6。

现在,假设我们想知道掷出的两个点数是相等的这个事件的概率。

我们可以用独立性来计算。

因为X和Y是独立的,所以P(X=x, Y=y) =P(X=x) * P(Y=y),因此,P(X=Y) = ΣP(X=x, Y=x) = ΣP(X=x) *P(Y=x) = 1/6 * 1/6 + 1/6 * 1/6 +...+1/6 * 1/6 = 1/6。

接下来看条件概率分布。

条件概率分布是指,在给定一些条件下,随机变量的概率分布。

具体来说,如果我们知道了一些关于随机变量的信息,那么我们可以通过条件概率分布来计算在这些信息下随机变量的取值的概率。

条件概率分布通常用P(X|Y)表示,表示给定Y的条件下,X的概率分布。

它可以通过原始的概率分布计算得到。

具体来说,如果我们知道了Y的取值,那么我们可以将联合概率分布进行归一化,得到在Y取值的条件下,X取值的概率分布。

条件分布与随机变量的独立性

定理31(独立性的判断) 随机变量X与Y相互独立的充要条件是X所生成的任何事

件与Y生成的任何事件独立 即 对任意实数集A和B 有

P{XA YB}P{XA}P{YB} 定理32 如果随机变量X和Y相互独立 则对任意函数g1(x) g2(y) (322)

均有g1(X)与g2(Y)相互独立

二、离散型随机变量的条件概率分布与独立性

条件概率分布 设(X Y)是二维离散型随机向量 其概率分布为 P{Xxi Yyj}pij i j1 2 则由条件概率公式 当P{Yyj}0时 有

P{X xi ,Y y j} pij P{X xi |Y y j} Y P{Y y j} pj

且

P{X m}

n m 1 n 1 2 n2

p 2q n 2 pq m 1 (m1 2 )

P{Y n} p q

m 1

(n1)p2qn2 (n2 3 )

当n2 3 时

p 2q n 2 P{X m |Y n} 1 (m1 2 n1) (n 1) p 2qn2 n 1 当m1 2 时 p 2q n 2 P{Y n | X m} pq nm1 (nm1 m2 ) pq m1

0, x 0, F (x) x, 0 x 1, 1, x 1. 于是 当x0.5时

x 0.5, 0.5 x 1, P{X x, X 0.5} x 1. 0.5,

例35 设X服从[0 1]上的均匀分布 求在已知X0.5的条 件下X的条件分布函数 解 当x0.5时 P{Xx X0.5}0 当x0.5时

补充例2 一射手击中目标的概率为p(0p1) 射击直到击中目 标两次为止 设以X表示首次击中目标所进行的射击次数 以Y表示 总共进行的射击次数 试求X和Y的联合分布列律及条件分布律 解 X和Y的联合分布律为 P{Xm Yn}p2qn2 (n2 3 m1 2 n1)

§3.2 条件概率与随机变量的独立性

一、条件分布的概念

在第一章中,曾介绍了条件概率的概念,那是对随机事件 而说的。本节要从事件的条件概率引入随机变量的条件概率分 布的概念。

引例 考虑某大学的全体学生,从中随机抽取一个学生,分

别以X和Y表示其体重和身高,则X和Y都是随机变量,它们都有 一定的概率分布。现在若限制1.7<Y<1.8(米),在这个条件下去 求X的条件分布,这就意味着要从该校的学生中把身高在1.7米

P{Y y} 0

所以不能直接用条件概率公式引入“条件分布函数”。

定义3 设二维离散型随机变量(X,Y)的概率密度为f(x,y),

边缘密度为fX(x),fY(y),则对一切使fX(x)>0的x,定义在X=x的 条件下Y的条件概率密度为

fY|X ( y | y)

f (x, y) fX (x)

类似地,对一切使fY(y)>0的y,定义在Y=y的条件下X的条件

X

(

x)

0,

其它

当x>0时,

fY (y)

0

xe(

x

y

)dx

e

y

xexdx

0

e y[xex |0

exdx]

0

e y[ex

]0

ey

e y , y 0 fY ( y) 0, 其它

而对一切x,y均有

f (x, y) fX (x) fY ( y)

故X与Y相互独立。

例5 甲乙两人约定中午12时30分在某地会面. 如果甲来到的 时间在12:15到12:45之间是均匀分布. 乙独立地到达, 而且到达 时间在12:00到13:00之间是均匀分布. 试求先到的人等待另一人 到达的时间不超过5分钟的概率. 又甲先到的概率是多少?

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

定义1 设随机变量(X,Y)的联合分布函数为F(x,y), 边缘 分布函数为FX(x),FY(y), 若对任意实数x,y,有 注:若随机变 P {, X x Y y } P {} X x P {} Y y 量X和Y相互独 即 立,则联合分 F (, x y ) F () x F () y X Y 布由边缘分布 则称随机变量X和Y相互独立。 惟一确定。

P { X x , Y y } p ij i j P { Y y x } j|X i P { X x } p i i

j 1 ,2 ,

条件分布是一种概率分布,它具有概率分布的一切性质。

定义2 若对(X,Y)的据有可能取值(xi,yj),有

P { X x , Y yP } { X x } P { Y y } i j i j

即

pij pi p j

i ,j 1 , 2 ,

X

则称X和Y相互独立。

Y

0

-1

0.1

0

0.2

2

0

例2 设X和Y的联合分布律为

(1)求Y=0时,X的条件概率分布;

1

2

0.3 0.05

0.15 0

0.1

0.1

(2)判断X与是否相互独立? 解 (1) P {0 Y } 0 . 2 0 . 0 5 0 0 . 2 5 在Y=0时,X的条件概率分布为

0, x 0 F (x) x,0 x 1 1, x 1

由条件分布函数的定义,有 由于X在[0,1]上服从均匀分布,故 当 X 1 2 时,

1 { X xX , 1 2 } P PxX | 2 P { X 1 2 }

1 2 关于两个随 P { X DY , D } x y

1 x 2 y 从而,来自定义知 和

三、离散型随机变量的条件分布与独立性

设(X,Y)是二维离散型随机变量,其概率分布为

P { Xx , Y y } p i j i j

{ yj}0 由条件概率公式,当 PY 时,有

i ,j 1 , 2 ,

P { X xY , y } p ij i j P { X xY y } i| j p j P { Y y } j

i 1 ,2 ,

称其为在 Y y j 的条件下随机变量X的条件概率分布。 类似地,定义在 X xi 的条件下随机变量Y的条件概率函数:

P { X 0 , Y 0 }0 . 2 P { X 0 | Y 0 } 0 . 8 P { Y 0 } 0 . 2 5

Y P { X 1 , Y 0 }0 . 0 5 X P { X 1 | Y 0 } 0 . 2 P { Y 0 } 0 . 2 5 0 P { X 2 , Y 0 } 0 P { X 2 | Y 0 } 0 1 P { Y 0 } 0 . 2 5

§3.2 条件概率与随机变量的独立性 一、条件分布的概念

在第一章中,曾介绍了条件概率的概念,那是对随机事件

而说的。本节要从事件的条件概率引入随机变量的条件概率分 布的概念。 引例 考虑某大学的全体学生,从中随机抽取一个学生,分

别以X和Y表示其体重和身高,则X和Y都是随机变量,它们都有

一定的概率分布。现在若限制1.7<Y<1.8(米),在这个条件下去 求X的条件分布,这就意味着要从该校的学生中把身高在1.7米 和1.8米之间的那些人都挑出来,然后在挑出的学生中求其体重 的分布。

P{X 1 2}

1 2

P { Xx , X 1 2 }0

1 1 F ( x) P { X xX , 1 2 } F () x F 当 X 1 2 时, 2 2 1 1 0, x 0 x , x1 2 2 F ( x) x,0 x 1 1, x 1 1, x1 2 0, x 1 2 从而 F(x | X 1 2) x,1 2 x 1 1 , x 1

条件分布函数

设X是一个随机变量,其分布函数为

Fx () P { X x } X

若另有一事件A已经发生,并且A的发生可能会对事件{X≤x},则对 任一给定的实数x,记

F ( x | A ) P { X x | A } x X

并称 FX (x | A)为在事件A发生的条件下,X的条件分布函数。 例1 设X在区间[0,1]上服从上的均匀分布, 求在已知X>1/2 的条件下的条件分布函数。 解 因为X在[0,1]上服从均匀分布,其分布函数为

二、 随机变量的独立性 设A是随机变量Y所生成的事件: A={Y≤y},且

则有

PY { y } 0

P { Xx , Yy }F (, x y ) F (| x Yy ) P { Yy } F () y Y 一般地, 由于随机变量X,Y之间存在相互联系,因而一个随 机变量的取值可能会影响另一个随机变量的取值统计规律性。 在何种情况下, 随机变量X,Y之间没有上述影响, 而具有所谓的 “独立性”, 我们引入如下定义。

证 令

g ), g2(Y), 对任意x,y,记 1(X

2 1 D {| tg () t y } D {| t gt () x } y 2 x 1

{ x , y } P { g ( X ) x , g ( Y ) y } 则由定理1,有 P 1 2

机变量的独 P { X D }{ P Y D } 立性的概念 P { x } P { y } 可以推广到 n个随机变 相互独立。 量的情形

定理1 随机变量X与Y相互独立的充要条件是X所生成的任 何事件与Y生成的任何事件独立, 即, 对任意实数集A, B,有

P { X A , Y B } P { X A } P {} Y B

) 定理2 如果随机变量X与Y相互独立, 则对任意函数 g 1 ( x ,

g 2 ( y ) ,均有 g 1 ( X )和 g 2 ( Y 相互独立。 )